跟煎魚學 Go

寫寫程式碼,喝喝茶,搞搞 Go,一起吧,這是我的專案地址:https://github.com/EDDYCJY/blog

線上閱讀

我的微信公眾號

推薦大家關注我的微信公眾號,長期堅持更新原創知識。也可以加我 WeChat,拉你進 Go 技術交流群:

煎魚的微信公眾號

?

如果有任何疑問或錯誤,歡迎在 issues 進行提問或給予修正意見

如果喜歡或對你有所幫助,歡迎 Star,對作者是一種鼓勵和推進 😀

License

所有文章採用知識共享署名-非商業性使用-相同方式共享 3.0 中國大陸許可協議進行許可

第1課 雜談

- 1.1 聊一聊,Go 的相對路徑問題

- 1.2 Go 的 fake-useragent 瞭解一下

- 1.3 用 Go 來了解一下 Redis 通訊協議

- 1.4 使用 Gomock 進行單元測試

- 1.5 在 Go 中恰到好處的記憶體對齊

- 1.6 來,控制一下 goroutine 的併發數量

- 1.7 for-loop 與 json.Unmarshal 效能分析概要

- 1.8 簡單圍觀一下有趣的 //go: 指令

- 1.9 我要在棧上。不,你應該在堆上

- 1.10 defer 會有效能損耗,儘量不要用

- 1.11 從實踐到原理,帶你參透 gRPC

- 1.12 Go1.13 defer 的效能是如何提高的?

- 1.13 Go 應用記憶體佔用太多,讓排查?(VSZ篇)

- 1.14 乾貨滿滿的 Go Modules 和 goproxy.cn

1.1 聊一聊,Go 的相對路徑問題

前言

Golang 中存在各種執行方式,如何正確的引用檔案路徑成為一個值得商議的問題

以 gin-blog 為例,當我們在專案根目錄下,執行 go run main.go 時能夠正常執行(go build也是正常的)

[$ gin-blog]# go run main.go

[GIN-debug] [WARNING] Running in "debug" mode. Switch to "release" mode in production.

- using env: export GIN_MODE=release

- using code: gin.SetMode(gin.ReleaseMode)

[GIN-debug] GET /api/v1/tags --> gin-blog/routers/api/v1.GetTags (3 handlers)

...

那麼在不同的目錄層級下,不同的方式執行,又是怎麼樣的呢,帶著我們的疑問去學習

問題

1、 go run 我們上移目錄層級,到 $GOPATH/src 下,執行 go run gin-blog/main.go

[$ src]# go run gin-blog/main.go

2018/03/12 16:06:13 Fail to parse 'conf/app.ini': open conf/app.ini: no such file or directory

exit status 1

2、 go build,執行 ./gin-blog/main

[$ src]# ./gin-blog/main

2018/03/12 16:49:35 Fail to parse 'conf/app.ini': open conf/app.ini: no such file or directory

這時候你要打一個大大的問號,就是我的程式讀取到什麼地方去了

我們透過分析得知,Golang的相對路徑是相對於執行命令時的目錄;自然也就讀取不到了

思考

既然已經知道問題的所在點,我們就可以尋思做點什麼 : )

我們想到相對路徑是相對執行命令的目錄,那麼我們取得可執行檔案的地址,拼接起來不就好了嗎?

實踐

我們編寫取得當前可執行檔案路徑的方法

import (

"path/filepath"

"os"

"os/exec"

"string"

)

func GetAppPath() string {

file, _ := exec.LookPath(os.Args[0])

path, _ := filepath.Abs(file)

index := strings.LastIndex(path, string(os.PathSeparator))

return path[:index]

}

將其放到啟動程式碼處檢視路徑

log.Println(GetAppPath())

我們分別執行以下兩個命令,檢視輸出結果 1、 go run

$ go run main.go

2018/03/12 18:45:40 /tmp/go-build962610262/b001/exe

2、 go build

$ ./main

2018/03/12 18:49:44 $GOPATH/src/gin-blog

剖析

我們聚焦在 go run 的輸出結果上,發現它是一個臨時檔案的地址,這是為什麼呢?

在go help run中,我們可以看到

Run compiles and runs the main package comprising the named Go source files.

A Go source file is defined to be a file ending in a literal ".go" suffix.

也就是 go run 執行時會將檔案放到 /tmp/go-build... 目錄下,編譯並執行

因此go run main.go出現/tmp/go-build962610262/b001/exe結果也不奇怪了,因為它已經跑到臨時目錄下去執行可執行檔案了

這就已經很清楚了,那麼我們想想,會出現哪些問題呢

- 依賴相對路徑的檔案,出現路徑出錯的問題

go run和go build不一樣,一個到臨時目錄下執行,一個可手動在編譯後的目錄下執行,路徑的處理方式會不同- 不斷

go run,不斷產生新的臨時檔案

這其實就是根本原因了,因為 go run 和 go build 的編譯檔案執行路徑並不同,執行的層級也有可能不一樣,自然而然就出現各種讀取不到的奇怪問題了

解決方案

一、取得編譯後的可執行檔案路徑

1、 將設定檔案的相對路徑與GetAppPath()的結果相拼接,可解決go build main.go的可執行檔案跨目錄執行的問題(如:./src/gin-blog/main)

import (

"path/filepath"

"os"

"os/exec"

"string"

)

func GetAppPath() string {

file, _ := exec.LookPath(os.Args[0])

path, _ := filepath.Abs(file)

index := strings.LastIndex(path, string(os.PathSeparator))

return path[:index]

}

但是這種方式,對於go run依舊無效,這時候就需要2來補救

2、 透過傳遞引數指定路徑,可解決go run的問題

package main

import (

"flag"

"fmt"

)

func main() {

var appPath string

flag.StringVar(&appPath, "app-path", "app-path")

flag.Parse()

fmt.Printf("App path: %s", appPath)

}

執行

go run main.go --app-path "Your project address"

二、增加os.Getwd()進行多層判斷

參見 beego 讀取 app.conf 的程式碼

該寫法可相容 go build 和在專案根目錄執行 go run ,但是若跨目錄執行 go run 就不行

三、設定全域性系統變數

我們可以透過os.Getenv來取得系統全域性變數,然後與相對路徑進行拼接

1、 設定專案工作區

簡單來說,就是設定專案(應用)的工作路徑,然後與設定檔案、日誌檔案等相對路徑進行拼接,達到相對的絕對路徑來保證路徑一致

參見 gogs 讀取GOGS_WORK_DIR進行拼接的程式碼

2、 利用系統自帶變數

簡單來說就是透過系統自帶的全域性變數,例如$HOME等,將設定檔案存放在$HOME/conf或/etc/conf下

這樣子就能更加固定的存放設定檔案,不需要額外去設定一個環境變數

(這點今早與一位SFer討論了一波,感謝)

拓展

go test 在一些場景下也會遇到路徑問題,因為go test只能夠在當前目錄執行,所以在執行測試用例的時候,你的執行目錄已經是測試目錄了

需要注意的是,如果採用取得外部引數的辦法,用 os.args 時,go test -args 和 go run、go build 會有命令列引數位置的不一致問題

小結

這三種解決方案,在目前可見的開源專案或介紹中都能找到這些的身影

優缺點也是顯而易見的,我認為應在不同專案選定合適的解決方案即可

建議大家不要強依賴讀取設定檔案的模組,應當將其“堆積木”化,需要什麼設定才去註冊什麼設定變數,可以解決一部分的問題

大家又有什麼想法呢,一起討論一波?

1.2 Go 的 fake-useragent 瞭解一下

有的網站會根據 User-Agent 的不同,跳轉到不同(PC、M)的站點,也有根據版本的不同給出不一樣的提示等等,而 User-Agent 的變化更是爬蟲裡的基礎姿勢

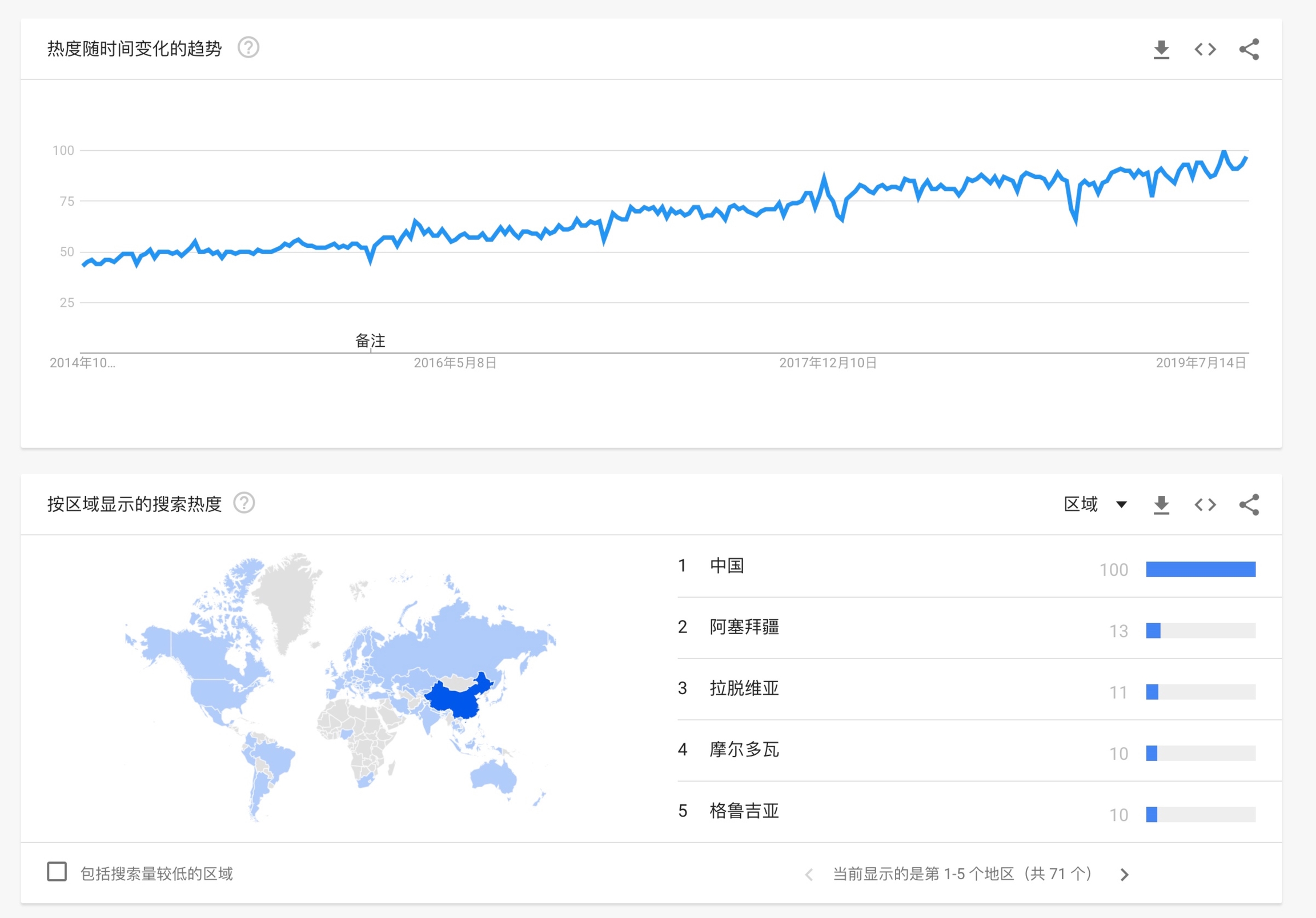

使用 Go 編寫網路爬蟲或需要模擬瀏覽器頭(User-Agent)的時候,你是否會覺得很麻煩,取得請求頭(Request Headers)的 User-Agent 還得找來找去,挺繁瑣。先前我也遇到了這個問題,因此有了這個專案 fake-useragent,用來解決你我的痛點

專案地址:https://github.com/EDDYCJY/fake-useragent

支援

- All User-Agent Random

- Chrome

- InternetExplorer (IE)

- Firefox

- Safari

- Android

- MacOSX

- IOS

- Linux

- IPhone

- IPad

- Computer

- Mobile

安裝

$ go get github.com/EDDYCJY/fake-useragent

用法

package main

import (

"log"

"github.com/EDDYCJY/fake-useragent"

)

func main() {

// 推荐使用

random := browser.Random()

log.Printf("Random: %s", random)

chrome := browser.Chrome()

log.Printf("Chrome: %s", chrome)

internetExplorer := browser.InternetExplorer()

log.Printf("IE: %s", internetExplorer)

firefox := browser.Firefox()

log.Printf("Firefox: %s", firefox)

safari := browser.Safari()

log.Printf("Safari: %s", safari)

android := browser.Android()

log.Printf("Android: %s", android)

macOSX := browser.MacOSX()

log.Printf("MacOSX: %s", macOSX)

ios := browser.IOS()

log.Printf("IOS: %s", ios)

linux := browser.Linux()

log.Printf("Linux: %s", linux)

iphone := browser.IPhone()

log.Printf("IPhone: %s", iphone)

ipad := browser.IPad()

log.Printf("IPad: %s", ipad)

computer := browser.Computer()

log.Printf("Computer: %s", computer)

mobile := browser.Mobile()

log.Printf("Mobile: %s", mobile)

}

定製

你可以調整抓取資料來源的最大頁數、時間間隔以及最大超時時間。 如果不填寫,則為預設值。

client := browser.Client{

MaxPage: 3,

Delay: 200 * time.Millisecond,

Timeout: 10 * time.Second,

}

cache := browser.Cache{}

b := browser.NewBrowser(client, cache)

random := b.Random()

更新瀏覽器頭的臨時檔案快取

client := browser.Client{}

cache := browser.Cache{

UpdateFile: true,

}

b := browser.NewBrowser(client, cache)

最後,建議常規用法就好,預設引數能夠滿足日常需求

輸出

Random: Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_2) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36

Chrome: Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/60.0.3112.113 Safari/537.36

IE: Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1; WOW64; Trident/5.0)

Firefox: Mozilla/5.0 (Windows NT 6.3; WOW64; rv:41.0) Gecko/20100101 Firefox/41.0

Safari: Mozilla/5.0 (iPhone; CPU iPhone OS 11_2_5 like Mac OS X) AppleWebKit/604.5.6 (KHTML, like Gecko) Version/11.0 Mobile/15D60 Safari/604.1

Android: Mozilla/5.0 (Linux; Android 6.0; MYA-L22 Build/HUAWEIMYA-L22) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/62.0.3202.84 Mobile Safari/537.36

MacOSX: Mozilla/5.0 (Macintosh; Intel Mac OS X 10_10_5) AppleWebKit/602.2.14 (KHTML, like Gecko) Version/10.0.1 Safari/602.2.14

IOS: Mozilla/5.0 (iPhone; CPU iPhone OS 10_1 like Mac OS X) AppleWebKit/602.2.14 (KHTML, like Gecko) Version/10.0 Mobile/14B72 Safari/602.1

Linux: Mozilla/5.0 (X11; Linux x86_64; rv:42.0) Gecko/20100101 Firefox/42.0

IPhone: Mozilla/5.0 (iPhone; CPU iPhone OS 10_2 like Mac OS X) AppleWebKit/602.3.12 (KHTML, like Gecko) Version/10.0 Mobile/14C92 Safari/602.1

IPad: Mozilla/5.0 (iPad; CPU OS 5_0_1 like Mac OS X) AppleWebKit/534.46 (KHTML, like Gecko) Version/5.1 Mobile/9A405 Safari/7534.48.3

Computer: Mozilla/5.0 (Windows NT 10.0; WOW64; rv:54.0) Gecko/20100101 Firefox/54.0

Mobile: Mozilla/5.0 (Linux; Android 7.0; Redmi Note 4 Build/NRD90M) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.111 Mobile Safari/537.36

注意

如果第一次使用,fake-useragent 將收集資料並在臨時目錄中建立一個檔案作為檔案快取,請耐心等待幾秒鐘

最後

如果在專案中發現了什麼問題,歡迎提交 PR 或者 issue。希望你能夠喜歡這個專案,根本目的還是為了解決痛點,歡迎 Star!😁

專案地址:https://github.com/EDDYCJY/fake-useragent

1.3 用 Go 來了解一下 Redis 通訊協議

Go、PHP、Java... 都有那麼多包來支撐你使用 Redis,那你是否有想過

有了服務端,有了客戶端,他們倆是怎樣通訊,又是基於什麼通訊協議做出互動的呢?

介紹

基於我們的目的,本文主要講解和實踐 Redis 的通訊協議

Redis 的客戶端和服務端是透過 TCP 連線來進行資料互動, 伺服器預設的埠號為 6379

客戶端和伺服器傳送的命令或資料一律以 \r\n (CRLF)結尾(這是一條約定)

協議

在 Redis 中分為請求和回覆,而請求協議又分為新版和舊版,新版統一請求協議在 Redis 1.2 版本中引入,最終在 Redis 2.0 版本成為 Redis 伺服器通訊的標準方式

本文是基於新版協議來實作功能,不建議使用舊版(1.2 挺老舊了)。如下是新協議的各種範例:

請求協議

1、 格式示例

*<参数数量> CR LF

$<参数 1 的字节数量> CR LF

<参数 1 的数据> CR LF

...

$<参数 N 的字节数量> CR LF

<参数 N 的数据> CR LF

在該協議下所有傳送至 Redis 伺服器的引數都是二進位制安全(binary safe)的

2、列印示例

*3

$3

SET

$5

mykey

$7

myvalue

3、實際協議值

"*3\r\n$3\r\nSET\r\n$5\r\nmykey\r\n$7\r\nmyvalue\r\n"

這就是 Redis 的請求協議規範,按照範例1編寫客戶端邏輯,最終傳送的是範例3,相信你已經有大致的概念了,Redis 的協議非常的簡潔易懂,這也是好上手的原因之一,你可以想想協議這麼定義的好處在哪?

回覆

Redis 會根據你請求協議的不同(執行的命令結果也不同),返回多種不同型別的回覆。在這個回覆“協議”中,可以透過檢查第一個位元組,確定這個回覆是什麼型別,如下:

- 狀態回覆(status reply)的第一個位元組是 "+"

- 錯誤回覆(error reply)的第一個位元組是 "-"

- 整數回覆(integer reply)的第一個位元組是 ":"

- 批量回復(bulk reply)的第一個位元組是 "$"

- 多條批量回復(multi bulk reply)的第一個位元組是 "*"

有了回覆的頭部標識,結尾的 CRLF,你可以大致猜想出回覆“協議”是怎麼樣的,但是實踐才能得出真理,斎知道怕是你很快就忘記了 😀

實踐

與 Redis 伺服器互動

package main

import (

"log"

"net"

"os"

"github.com/EDDYCJY/redis-protocol-example/protocol"

)

const (

Address = "127.0.0.1:6379"

Network = "tcp"

)

func Conn(network, address string) (net.Conn, error) {

conn, err := net.Dial(network, address)

if err != nil {

return nil, err

}

return conn, nil

}

func main() {

// 读取入参

args := os.Args[1:]

if len(args) <= 0 {

log.Fatalf("Os.Args <= 0")

}

// 获取请求协议

reqCommand := protocol.GetRequest(args)

// 连接 Redis 服务器

redisConn, err := Conn(Network, Address)

if err != nil {

log.Fatalf("Conn err: %v", err)

}

defer redisConn.Close()

// 写入请求内容

_, err = redisConn.Write(reqCommand)

if err != nil {

log.Fatalf("Conn Write err: %v", err)

}

// 读取回复

command := make([]byte, 1024)

n, err := redisConn.Read(command)

if err != nil {

log.Fatalf("Conn Read err: %v", err)

}

// 处理回复

reply, err := protocol.GetReply(command[:n])

if err != nil {

log.Fatalf("protocol.GetReply err: %v", err)

}

// 处理后的回复内容

log.Printf("Reply: %v", reply)

// 原始的回复内容

log.Printf("Command: %v", string(command[:n]))

}

在這裡我們完成了整個 Redis 客戶端和服務端互動的流程,分別如下:

1、讀取命令列引數:取得執行的 Redis 命令

2、取得請求協議引數

3、連線 Redis 伺服器,取得連線控制代碼

4、將請求協議引數寫入連線:傳送請求的命令列引數

5、從連線中讀取返回的資料:讀取先前請求的回覆資料

6、根據回覆“協議”內容,處理回覆的資料集

7、輸出處理後的回覆內容及原始回覆內容

請求

func GetRequest(args []string) []byte {

req := []string{

"*" + strconv.Itoa(len(args)),

}

for _, arg := range args {

req = append(req, "$"+strconv.Itoa(len(arg)))

req = append(req, arg)

}

str := strings.Join(req, "\r\n")

return []byte(str + "\r\n")

}

透過對 Redis 的請求協議的分析,可得出它的規律,先加上標誌位,計算引數總數量,再迴圈合併各個引數的位元組數量、值就可以了

回覆

func GetReply(reply []byte) (interface{}, error) {

replyType := reply[0]

switch replyType {

case StatusReply:

return doStatusReply(reply[1:])

case ErrorReply:

return doErrorReply(reply[1:])

case IntegerReply:

return doIntegerReply(reply[1:])

case BulkReply:

return doBulkReply(reply[1:])

case MultiBulkReply:

return doMultiBulkReply(reply[1:])

default:

return nil, nil

}

}

func doStatusReply(reply []byte) (string, error) {

if len(reply) == 3 && reply[1] == 'O' && reply[2] == 'K' {

return OkReply, nil

}

if len(reply) == 5 && reply[1] == 'P' && reply[2] == 'O' && reply[3] == 'N' && reply[4] == 'G' {

return PongReply, nil

}

return string(reply), nil

}

func doErrorReply(reply []byte) (string, error) {

return string(reply), nil

}

func doIntegerReply(reply []byte) (int, error) {

pos := getFlagPos('\r', reply)

result, err := strconv.Atoi(string(reply[:pos]))

if err != nil {

return 0, err

}

return result, nil

}

...

在這裡我們對所有回覆型別進行了分發,不同的回覆標誌位對應不同的處理方式,在這裡需求注意幾項問題,如下:

1、當請求的值不存在,會將特殊值 -1 用作回覆

2、伺服器傳送的所有字串都由 CRLF 結尾

3、多條批量回復是可基於批量回復的,要注意理解

4、無內容的多條批量回復是存在的

最重要的是,對不同回覆的規則的把控,能夠讓你更好的理解 Redis 的請求、回覆的互動過程 👌

小結

寫這篇文章的起因,是因為常常在使用 Redis 時,只是用,你不知道它是基於什麼樣的通訊協議來通訊,這樣的感覺是十分難受的

透過本文的講解,我相信你已經大致瞭解 Redis 客戶端是怎麼樣和服務端互動,也清楚了其所用的通訊原理,希望能夠對你有所幫助!

最後,如果想詳細檢視程式碼,右拐專案地址:https://github.com/EDDYCJY/redis-protocol-example

如果對你有所幫助,歡迎點個 Star 👍

參考

1.4 使用 Gomock 進行單元測試

在實際專案中,需要進行單元測試的時候。卻往往發現有一大堆依賴項。這時候就是 Gomock 大顯身手的時候了

Gomock 是 Go 語言的一個 mock 框架,官方的那種 🤪

安裝

$ go get -u github.com/golang/mock/gomock

$ go install github.com/golang/mock/mockgen

- 第一步:我們將安裝 gomock 第三方庫和 mock 程式碼的生成工具 mockgen。而後者可以大大的節省我們的工作量。只需要瞭解其使用方式就可以

- 第二步:輸入

mockgen驗證程式碼生成工具是否安裝正確。若無法正常響應,請檢查bin目錄下是否包含該二進位制檔案

用法

在 mockgen 命令中,支援兩種生成模式:

- source:從原始檔生成 mock 介面(透過 -source 啟用)

mockgen -source=foo.go [other options]

- reflect:透過使用反射程式來生成 mock 介面。它透過傳遞兩個非標誌引數來啟用:匯入路徑和逗號分隔的介面列表

mockgen database/sql/driver Conn,Driver

從本質上來講,兩種方式生成的 mock 程式碼並沒有什麼區別。因此選擇合適的就可以了

寫測試用例

在本文將模擬一個簡單 Demo 來編寫測試用例,熟悉整體的測試流程

步驟

- 想清楚整體邏輯

- 定義想要(模擬)依賴項的 interface(介面)

- 使用

mockgen命令對所需 mock 的 interface 生成 mock 檔案 - 編寫單元測試的邏輯,在測試中使用 mock

- 進行單元測試的驗證

目錄

├── mock

├── person

│ └── male.go

└── user

├── user.go

└── user_test.go

編寫

interface 方法

開啟 person/male.go 檔案,寫入以下內容:

package person

type Male interface {

Get(id int64) error

}

呼叫方法

開啟 user/user.go 檔案,寫入以下內容:

package user

import "github.com/EDDYCJY/mockd/person"

type User struct {

Person person.Male

}

func NewUser(p person.Male) *User {

return &User{Person: p}

}

func (u *User) GetUserInfo(id int64) error {

return u.Person.Get(id)

}

生成 mock 檔案

回到 mockd/ 的根目錄下,執行以下命令

$ mockgen -source=./person/male.go -destination=./mock/male_mock.go -package=mock

在執行完畢後,可以發現 mock/ 目錄下多出了 male_mock.go 檔案,這就是 mock 檔案。那麼命令中的指令又分別有什麼用呢?如下:

- -source:設定需要模擬(mock)的介面檔案

- -destination:設定 mock 檔案輸出的地方,若不設定則列印到標準輸出中

- -package:設定 mock 檔案的包名,若不設定則為

mock_字首加上檔名(如本文的包名會為 mock_person)

想了解更多的指令符,可參見 官方文件

輸出的 mock 檔案

// Code generated by MockGen. DO NOT EDIT.

// Source: ./person/male.go

// Package mock is a generated GoMock package.

package mock

import (

gomock "github.com/golang/mock/gomock"

reflect "reflect"

)

// MockMale is a mock of Male interface

type MockMale struct {

ctrl *gomock.Controller

recorder *MockMaleMockRecorder

}

// MockMaleMockRecorder is the mock recorder for MockMale

type MockMaleMockRecorder struct {

mock *MockMale

}

// NewMockMale creates a new mock instance

func NewMockMale(ctrl *gomock.Controller) *MockMale {

mock := &MockMale{ctrl: ctrl}

mock.recorder = &MockMaleMockRecorder{mock}

return mock

}

// EXPECT returns an object that allows the caller to indicate expected use

func (m *MockMale) EXPECT() *MockMaleMockRecorder {

return m.recorder

}

// Get mocks base method

func (m *MockMale) Get(id int64) error {

ret := m.ctrl.Call(m, "Get", id)

ret0, _ := ret[0].(error)

return ret0

}

// Get indicates an expected call of Get

func (mr *MockMaleMockRecorder) Get(id interface{}) *gomock.Call {

return mr.mock.ctrl.RecordCallWithMethodType(mr.mock, "Get", reflect.TypeOf((*MockMale)(nil).Get), id)

}

測試用例

開啟 user/user_test.go 檔案,寫入以下內容:

package user

import (

"testing"

"github.com/EDDYCJY/mockd/mock"

"github.com/golang/mock/gomock"

)

func TestUser_GetUserInfo(t *testing.T) {

ctl := gomock.NewController(t)

defer ctl.Finish()

var id int64 = 1

mockMale := mock.NewMockMale(ctl)

gomock.InOrder(

mockMale.EXPECT().Get(id).Return(nil),

)

user := NewUser(mockMale)

err := user.GetUserInfo(id)

if err != nil {

t.Errorf("user.GetUserInfo err: %v", err)

}

}

- gomock.NewController:返回

gomock.Controller,它代表 mock 生態系統中的頂級控制元件。定義了 mock 物件的範圍、生命週期和期待值。另外它在多個 goroutine 中是安全的 - mock.NewMockMale:建立一個新的 mock 例項

- gomock.InOrder:宣告給定的呼叫應按順序進行(是對 gomock.After 的二次封裝)

- mockMale.EXPECT().Get(id).Return(nil):這裡有三個步驟,

EXPECT()返回一個允許呼叫者設定期望和返回值的物件。Get(id)是設定入參並呼叫 mock 例項中的方法。Return(nil)是設定先前呼叫的方法出參。簡單來說,就是設定入參並呼叫,最後設定返回值 - NewUser(mockMale):建立 User 例項,值得注意的是,在這裡注入了 mock 物件,因此實際在隨後的

user.GetUserInfo(id)呼叫(入參:id 為 1)中。它呼叫的是我們事先模擬好的 mock 方法 - ctl.Finish():進行 mock 用例的期望值斷言,一般會使用

defer延遲執行,以防止我們忘記這一操作

測試

回到 mockd/ 的根目錄下,執行以下命令

$ go test ./user

ok github.com/EDDYCJY/mockd/user

看到這樣的結果,就大功告成啦!你可以自己調整一下 Return() 的返回值,以此得到不一樣的測試結果哦 😄

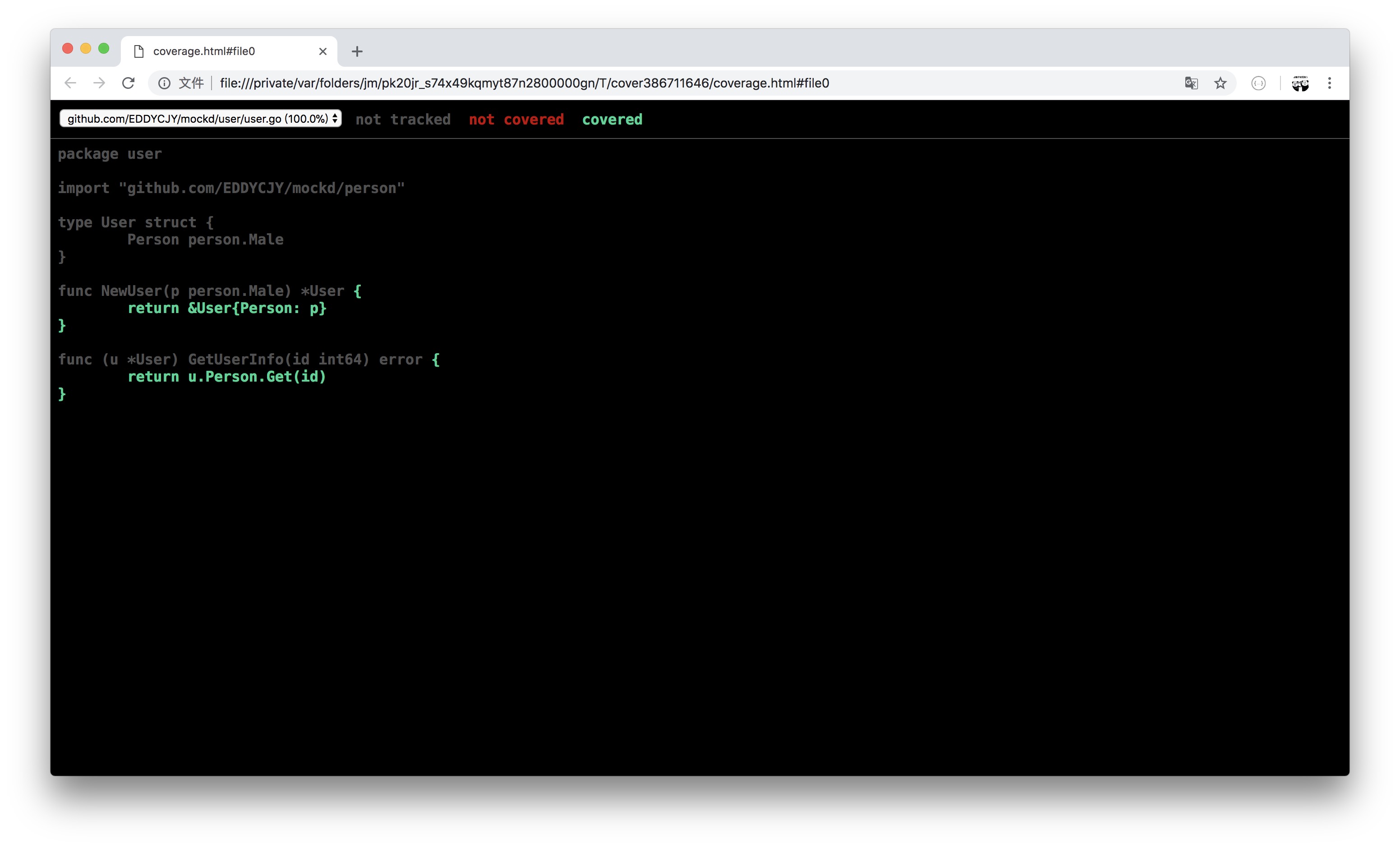

檢視測試情況

測試覆蓋率

$ go test -cover ./user

ok github.com/EDDYCJY/mockd/user (cached) coverage: 100.0% of statements

可透過設定 -cover 標誌符來開啟覆蓋率的統計,展示內容為 coverage: 100.0%。

視覺化介面

- 生成測試覆蓋率的 profile 檔案

$ go test ./... -coverprofile=cover.out

- 利用 profile 檔案生成視覺化介面

$ go tool cover -html=cover.out

- 檢視視覺化介面,分析覆蓋情況

更多

一、常用 mock 方法

呼叫方法

- Call.Do():宣告在匹配時要執行的操作

- Call.DoAndReturn():宣告在匹配呼叫時要執行的操作,並且模擬返回該函式的返回值

- Call.MaxTimes():設定最大的呼叫次數為 n 次

- Call.MinTimes():設定最小的呼叫次數為 n 次

- Call.AnyTimes():允許呼叫次數為 0 次或更多次

- Call.Times():設定呼叫次數為 n 次

引數匹配

- gomock.Any():匹配任意值

- gomock.Eq():透過反射匹配到指定的型別值,而不需要手動設定

- gomock.Nil():返回 nil

建議更多的方法可參見 官方文件

二、生成多個 mock 檔案

你可能會想一條條命令生成 mock 檔案,豈不得崩潰?

當然,官方提供了更方便的方式,我們可以利用 go:generate 來完成批次處理的功能

go generate [-run regexp] [-n] [-v] [-x] [build flags] [file.go... | packages]

修改 interface 方法

開啟 person/male.go 檔案,修改為以下內容:

package person

//go:generate mockgen -destination=../mock/male_mock.go -package=mock github.com/EDDYCJY/mockd/person Male

type Male interface {

Get(id int64) error

}

我們關注到 go:generate 這條語句,可分為以下部分:

- 宣告

//go:generate(注意不要留空格) - 使用

mockgen命令 - 定義

-destination - 定義

-package - 定義

source,此處為 person 的包路徑 - 定義

interfaces,此處為Male

重新生成 mock 檔案

回到 mockd/ 的根目錄下,執行以下命令

$ go generate ./...

再檢查 mock/ 發現也已經正確生成了,在多個檔案時是不是很方便呢 🤩

總結

在單元測試這一環,gomock 給我們提供了極大的便利。能夠 mock 掉許許多多的依賴項

其中還有很多的使用方式和功能。你可以 mark 住後詳細閱讀下官方文件,記憶會更深刻

1.5 在 Go 中恰到好處的記憶體對齊

問題

type Part1 struct {

a bool

b int32

c int8

d int64

e byte

}

在開始之前,希望你計算一下 Part1 共佔用的大小是多少呢?

func main() {

fmt.Printf("bool size: %d\n", unsafe.Sizeof(bool(true)))

fmt.Printf("int32 size: %d\n", unsafe.Sizeof(int32(0)))

fmt.Printf("int8 size: %d\n", unsafe.Sizeof(int8(0)))

fmt.Printf("int64 size: %d\n", unsafe.Sizeof(int64(0)))

fmt.Printf("byte size: %d\n", unsafe.Sizeof(byte(0)))

fmt.Printf("string size: %d\n", unsafe.Sizeof("EDDYCJY"))

}

輸出結果:

bool size: 1

int32 size: 4

int8 size: 1

int64 size: 8

byte size: 1

string size: 16

這麼一算,Part1 這一個結構體的佔用記憶體大小為 1+4+1+8+1 = 15 個位元組。相信有的小夥伴是這麼算的,看上去也沒什麼毛病

真實情況是怎麼樣的呢?我們實際呼叫看看,如下:

type Part1 struct {

a bool

b int32

c int8

d int64

e byte

}

func main() {

part1 := Part1{}

fmt.Printf("part1 size: %d, align: %d\n", unsafe.Sizeof(part1), unsafe.Alignof(part1))

}

輸出結果:

part1 size: 32, align: 8

最終輸出為佔用 32 個位元組。這與前面所預期的結果完全不一樣。這充分地說明了先前的計算方式是錯誤的。為什麼呢?

在這裡要提到 “記憶體對齊” 這一概念,才能夠用正確的姿勢去計算,接下來我們詳細的講講它是什麼

記憶體對齊

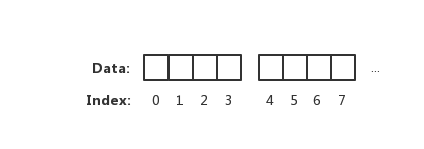

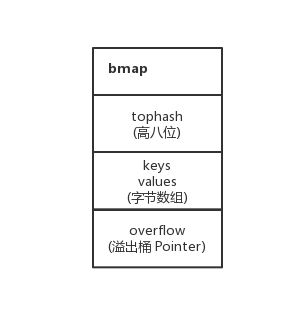

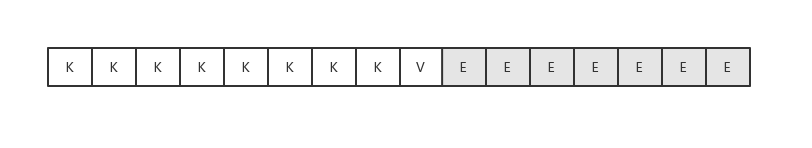

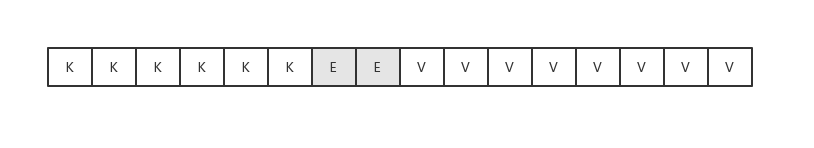

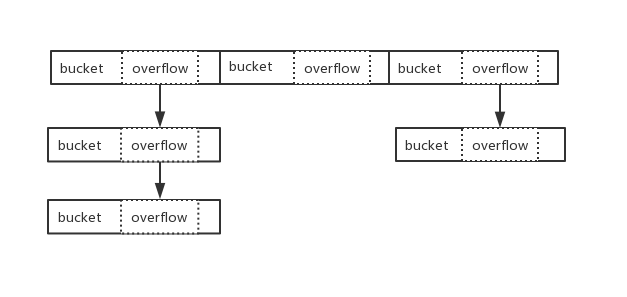

有的小夥伴可能會認為記憶體讀取,就是一個簡單的位元組陣列擺放

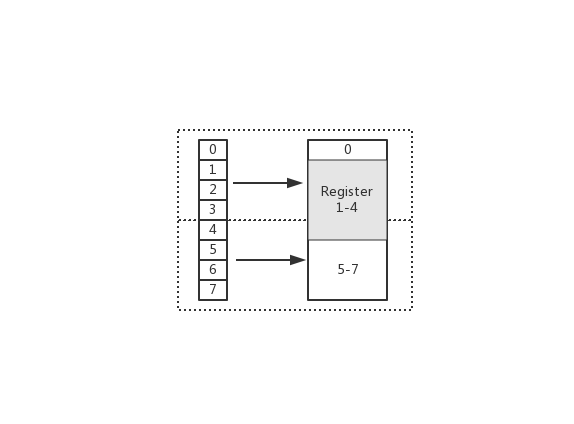

上圖表示一個坑一個蘿蔔的記憶體讀取方式。但實際上 CPU 並不會以一個一個位元組去讀取和寫入記憶體。相反 CPU 讀取記憶體是一塊一塊讀取的,塊的大小可以為 2、4、6、8、16 位元組等大小。塊大小我們稱其為記憶體訪問粒度。如下圖:

在樣例中,假設訪問粒度為 4。 CPU 是以每 4 個位元組大小的訪問粒度去讀取和寫入記憶體的。這才是正確的姿勢

為什麼要關心對齊

- 你正在編寫的程式碼在效能(CPU、Memory)方面有一定的要求

- 你正在處理向量方面的指令

- 某些硬體平臺(ARM)體系不支援未對齊的記憶體訪問

另外作為一個工程師,你也很有必要學習這塊知識點哦 :)

為什麼要做對齊

- 平臺(移植性)原因:不是所有的硬體平臺都能夠訪問任意地址上的任意資料。例如:特定的硬體平臺只允許在特定地址取得特定型別的資料,否則會導致異常情況

- 效能原因:若訪問未對齊的記憶體,將會導致 CPU 進行兩次記憶體訪問,並且要花費額外的時鐘週期來處理對齊及運算。而本身就對齊的記憶體僅需要一次訪問就可以完成讀取動作

在上圖中,假設從 Index 1 開始讀取,將會出現很崩潰的問題。因為它的記憶體訪問邊界是不對齊的。因此 CPU 會做一些額外的處理工作。如下:

- CPU 首次讀取未對齊地址的第一個記憶體塊,讀取 0-3 位元組。並移除不需要的位元組 0

- CPU 再次讀取未對齊地址的第二個記憶體塊,讀取 4-7 位元組。並移除不需要的位元組 5、6、7 位元組

- 合併 1-4 位元組的資料

- 合併後放入暫存器

從上述流程可得出,不做 “記憶體對齊” 是一件有點 "麻煩" 的事。因為它會增加許多耗費時間的動作

而假設做了記憶體對齊,從 Index 0 開始讀取 4 個位元組,只需要讀取一次,也不需要額外的運算。這顯然高效很多,是標準的空間換時間做法

預設係數

在不同平臺上的編譯器都有自己預設的 “對齊係數”,可透過預編譯命令 #pragma pack(n) 進行變更,n 就是代指 “對齊係數”。一般來講,我們常用的平臺的係數如下:

- 32 位:4

- 64 位:8

另外要注意,不同硬體平臺佔用的大小和對齊值都可能是不一樣的。因此本文的值不是唯一的,除錯的時候需按本機的實際情況考慮

成員對齊

func main() {

fmt.Printf("bool align: %d\n", unsafe.Alignof(bool(true)))

fmt.Printf("int32 align: %d\n", unsafe.Alignof(int32(0)))

fmt.Printf("int8 align: %d\n", unsafe.Alignof(int8(0)))

fmt.Printf("int64 align: %d\n", unsafe.Alignof(int64(0)))

fmt.Printf("byte align: %d\n", unsafe.Alignof(byte(0)))

fmt.Printf("string align: %d\n", unsafe.Alignof("EDDYCJY"))

fmt.Printf("map align: %d\n", unsafe.Alignof(map[string]string{}))

}

輸出結果:

bool align: 1

int32 align: 4

int8 align: 1

int64 align: 8

byte align: 1

string align: 8

map align: 8

在 Go 中可以呼叫 unsafe.Alignof 來返回相應型別的對齊係數。透過觀察輸出結果,可得知基本都是 2^n,最大也不會超過 8。這是因為我手提(64 位)編譯器預設對齊係數是 8,因此最大值不會超過這個數

整體對齊

在上小節中,提到了結構體中的成員變數要做位元組對齊。那麼想當然身為最終結果的結構體,也是需要做位元組對齊的

對齊規則

- 結構體的成員變數,第一個成員變數的偏移量為 0。往後的每個成員變數的對齊值必須為編譯器預設對齊長度(

#pragma pack(n))或當前成員變數型別的長度(unsafe.Sizeof),取最小值作為當前型別的對齊值。其偏移量必須為對齊值的整數倍 - 結構體本身,對齊值必須為編譯器預設對齊長度(

#pragma pack(n))或結構體的所有成員變數型別中的最大長度,取最大數的最小整數倍作為對齊值 - 結合以上兩點,可得知若編譯器預設對齊長度(

#pragma pack(n))超過結構體內成員變數的型別最大長度時,預設對齊長度是沒有任何意義的

分析流程

接下來我們一起分析一下,“它” 到底經歷了些什麼,影響了 “預期” 結果

| 成員變數 | 型別 | 偏移量 | 自身佔用 |

|---|---|---|---|

| a | bool | 0 | 1 |

| 位元組對齊 | 無 | 1 | 3 |

| b | int32 | 4 | 4 |

| c | int8 | 8 | 1 |

| 位元組對齊 | 無 | 9 | 7 |

| d | int64 | 16 | 8 |

| e | byte | 24 | 1 |

| 位元組對齊 | 無 | 25 | 7 |

| 總佔用大小 | - | - | 32 |

成員對齊

- 第一個成員 a

- 型別為 bool

- 大小/對齊值為 1 位元組

- 初始地址,偏移量為 0。佔用了第 1 位

- 第二個成員 b

- 型別為 int32

- 大小/對齊值為 4 位元組

- 根據規則 1,其偏移量必須為 4 的整數倍。確定偏移量為 4,因此 2-4 位為 Padding。而當前數值從第 5 位開始填充,到第 8 位。如下:axxx|bbbb

- 第三個成員 c

- 型別為 int8

- 大小/對齊值為 1 位元組

- 根據規則1,其偏移量必須為 1 的整數倍。當前偏移量為 8。不需要額外對齊,填充 1 個位元組到第 9 位。如下:axxx|bbbb|c...

- 第四個成員 d

-

型別為 int64

-

大小/對齊值為 8 位元組

-

根據規則 1,其偏移量必須為 8 的整數倍。確定偏移量為 16,因此

9-16 位為 Padding。而當前數值從第 17 位開始寫入,到第 24 位。如下:axxx|bbbb|cxxx|xxxx|dddd|dddd

-

- 第五個成員 e

- 型別為 byte

- 大小/對齊值為 1 位元組

- 根據規則 1,其偏移量必須為 1 的整數倍。當前偏移量為 24。不需要額外對齊,填充 1 個位元組到第 25 位。如下:axxx|bbbb|cxxx|xxxx|dddd|dddd|e...

整體對齊

在每個成員變數進行對齊後,根據規則 2,整個結構體本身也要進行位元組對齊,因為可發現它可能並不是 2^n,不是偶數倍。顯然不符合對齊的規則

根據規則 2,可得出對齊值為 8。現在的偏移量為 25,不是 8 的整倍數。因此確定偏移量為 32。對結構體進行對齊

結果

Part1 記憶體佈局:axxx|bbbb|cxxx|xxxx|dddd|dddd|exxx|xxxx

小結

透過本節的分析,可得知先前的 “推算” 為什麼錯誤?

是因為實際記憶體管理並非 “一個蘿蔔一個坑” 的思想。而是一塊一塊。透過空間換時間(效率)的思想來完成這塊讀取、寫入。另外也需要兼顧不同平臺的記憶體操作情況

巧妙的結構體

在上一小節,可得知根據成員變數的型別不同,其結構體的記憶體會產生對齊等動作。那假設欄位順序不同,會不會有什麼變化呢?我們一起來試試吧 :-)

type Part1 struct {

a bool

b int32

c int8

d int64

e byte

}

type Part2 struct {

e byte

c int8

a bool

b int32

d int64

}

func main() {

part1 := Part1{}

part2 := Part2{}

fmt.Printf("part1 size: %d, align: %d\n", unsafe.Sizeof(part1), unsafe.Alignof(part1))

fmt.Printf("part2 size: %d, align: %d\n", unsafe.Sizeof(part2), unsafe.Alignof(part2))

}

輸出結果:

part1 size: 32, align: 8

part2 size: 16, align: 8

透過結果可以驚喜的發現,只是 “簡單” 對成員變數的欄位順序進行改變,就改變了結構體佔用大小

接下來我們一起剖析一下 Part2,看看它的內部到底和上一位之間有什麼區別,才導致了這樣的結果?

分析流程

| 成員變數 | 型別 | 偏移量 | 自身佔用 |

|---|---|---|---|

| e | byte | 0 | 1 |

| c | int8 | 1 | 1 |

| a | bool | 2 | 1 |

| 位元組對齊 | 無 | 3 | 1 |

| b | int32 | 4 | 4 |

| d | int64 | 8 | 8 |

| 總佔用大小 | - | - | 16 |

成員對齊

- 第一個成員 e

- 型別為 byte

- 大小/對齊值為 1 位元組

- 初始地址,偏移量為 0。佔用了第 1 位

- 第二個成員 c

- 型別為 int8

- 大小/對齊值為 1 位元組

- 根據規則1,其偏移量必須為 1 的整數倍。當前偏移量為 2。不需要額外對齊

- 第三個成員 a

- 型別為 bool

- 大小/對齊值為 1 位元組

- 根據規則1,其偏移量必須為 1 的整數倍。當前偏移量為 3。不需要額外對齊

- 第四個成員 b

- 型別為 int32

- 大小/對齊值為 4 位元組

- 根據規則1,其偏移量必須為 4 的整數倍。確定偏移量為 4,因此第 3 位為 Padding。而當前數值從第 4 位開始填充,到第 8 位。如下:ecax|bbbb

- 第五個成員 d

- 型別為 int64

- 大小/對齊值為 8 位元組

- 根據規則1,其偏移量必須為 8 的整數倍。當前偏移量為 8。不需要額外對齊,從 9-16 位填充 8 個位元組。如下:ecax|bbbb|dddd|dddd

整體對齊

符合規則 2,不需要額外對齊

結果

Part2 記憶體佈局:ecax|bbbb|dddd|dddd

總結

透過對比 Part1 和 Part2 的記憶體佈局,你會發現兩者有很大的不同。如下:

- Part1:axxx|bbbb|cxxx|xxxx|dddd|dddd|exxx|xxxx

- Part2:ecax|bbbb|dddd|dddd

仔細一看,Part1 存在許多 Padding。顯然它佔據了不少空間,那麼 Padding 是怎麼出現的呢?

透過本文的介紹,可得知是由於不同型別導致需要進行位元組對齊,以此保證記憶體的訪問邊界

那麼也不難理解,為什麼調整結構體內成員變數的欄位順序就能達到縮小結構體佔用大小的疑問了,是因為巧妙地減少了 Padding 的存在。讓它們更 “緊湊” 了。這一點對於加深 Go 的記憶體佈局印象和大物件的最佳化非常有幫

當然了,沒什麼特殊問題,你可以不關注這一塊。但你要知道這塊知識點 😄

參考

1.6 來,控制一下 goroutine 的併發數量

問題

func main() {

userCount := math.MaxInt64

for i := 0; i < userCount; i++ {

go func(i int) {

// 做一些各种各样的业务逻辑处理

fmt.Printf("go func: %d\n", i)

time.Sleep(time.Second)

}(i)

}

}

在這裡,假設 userCount 是一個外部傳入的引數(不可預測,有可能值非常大),有人會全部丟進去迴圈。想著全部都併發 goroutine 去同時做某一件事。覺得這樣子會效率會更高,對不對!

那麼,你覺得這裡有沒有什麼問題?

噩夢般的開始

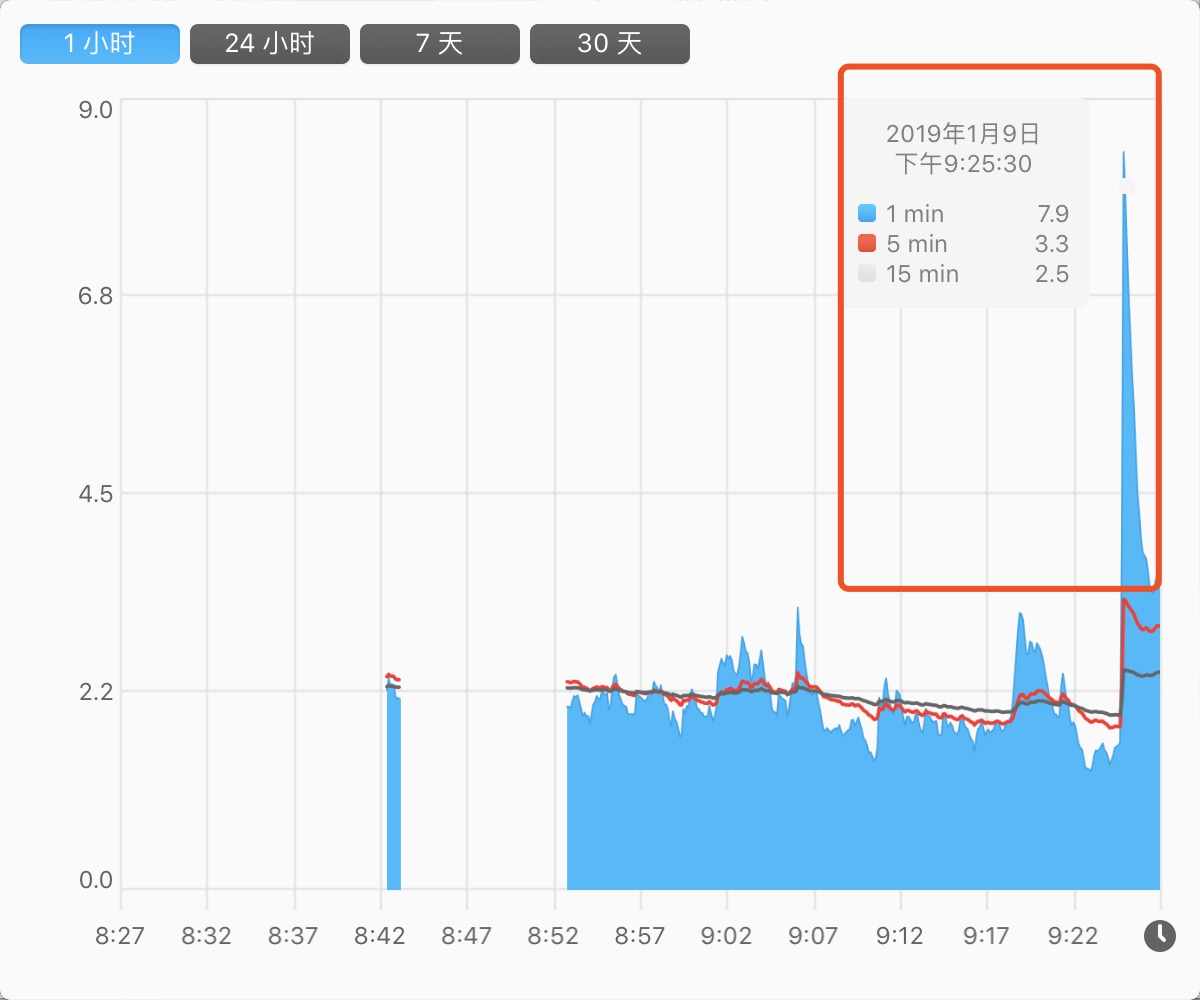

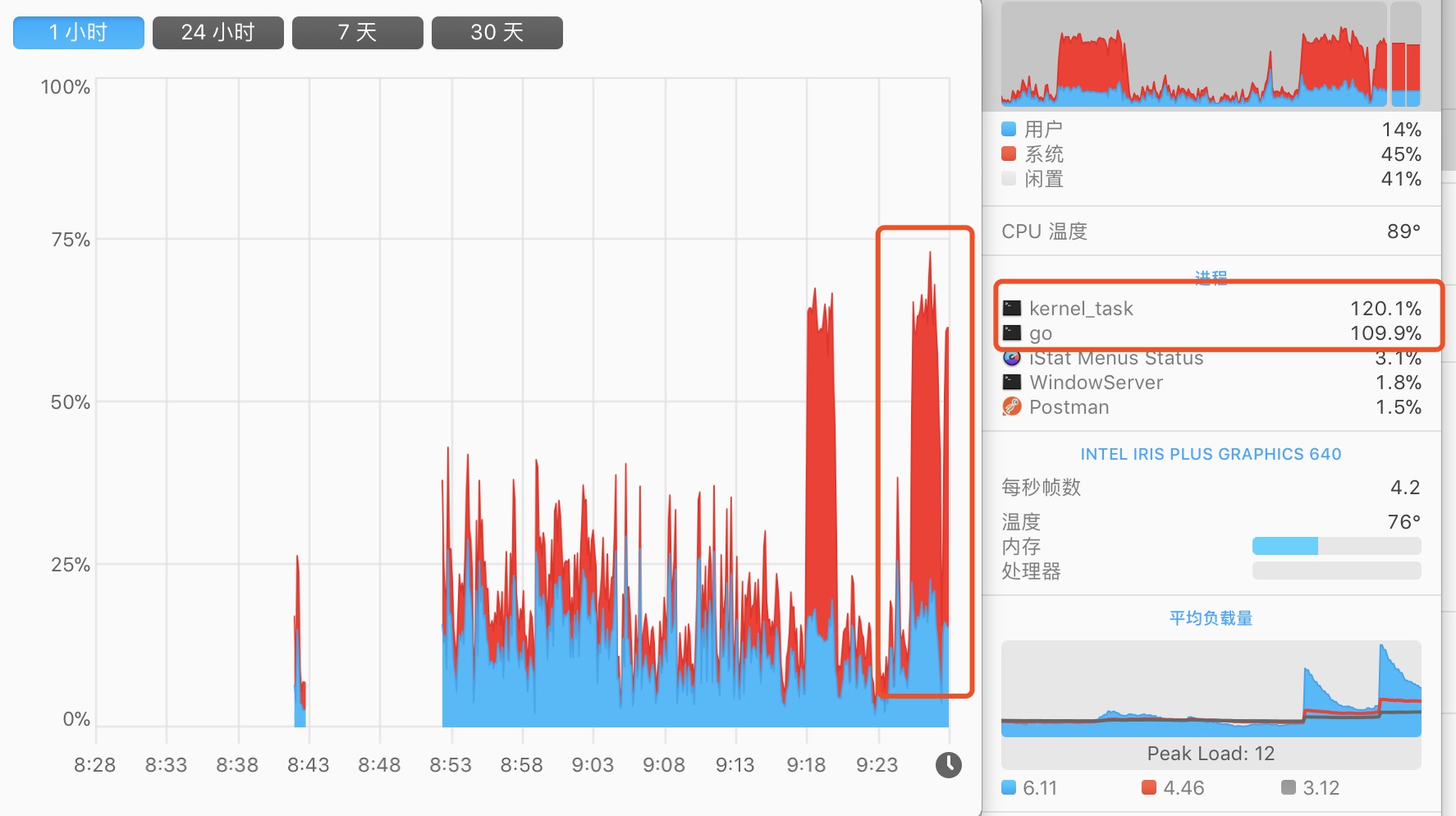

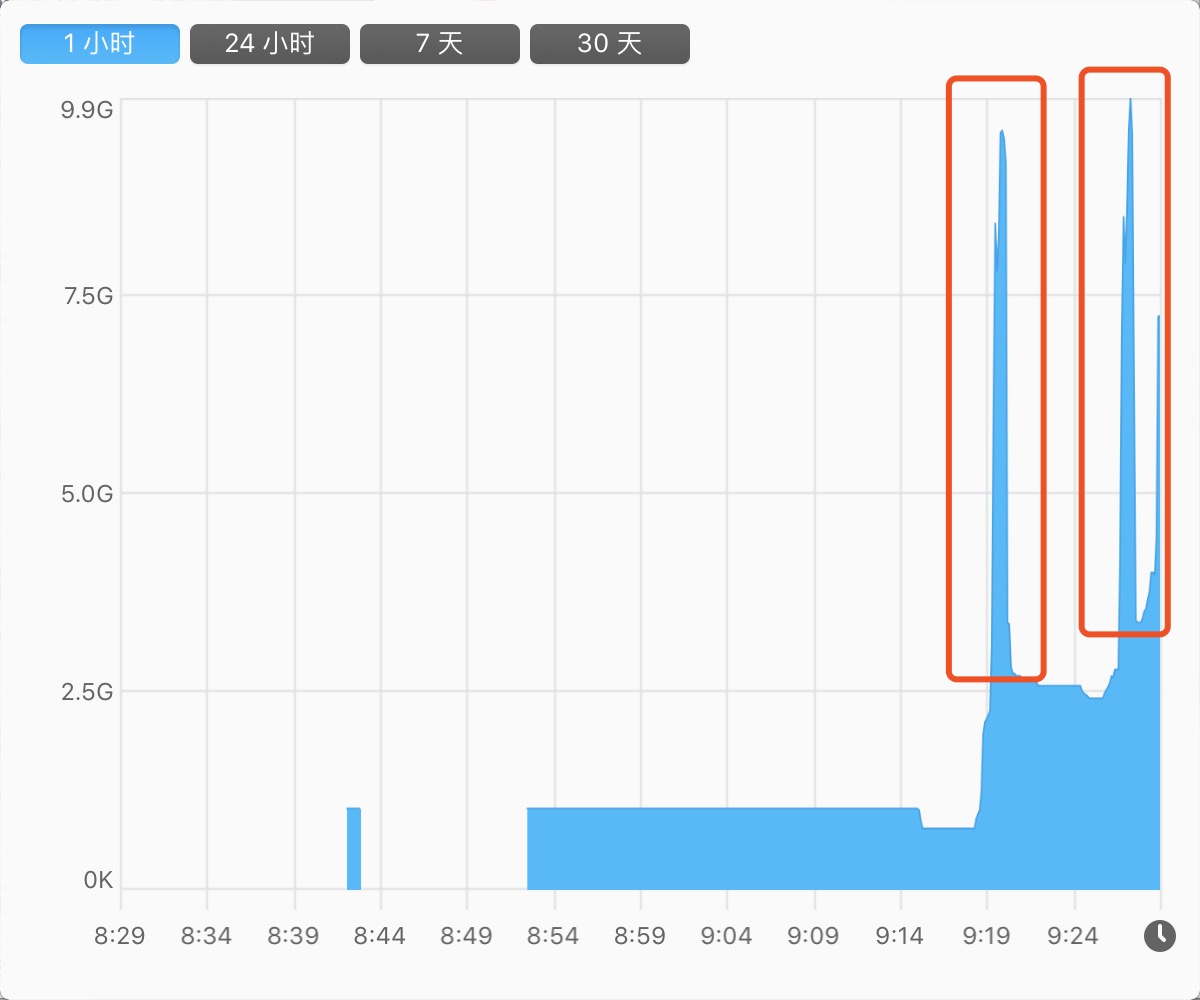

當然,在特定場景下,問題可大了。因為在本文被丟進去同時併發的可是一個極端值。我們可以一起觀察下圖的指標分析,看看情況有多 “崩潰”。下圖是上述程式碼的表現:

輸出結果

...

go func: 5839

go func: 5840

go func: 5841

go func: 5842

go func: 5915

go func: 5524

go func: 5916

go func: 8209

go func: 8264

signal: killed

如果你自己執行過程式碼,在 “輸出結果” 上你會遇到如下問題:

- 系統資源佔用率不斷上漲

- 輸出一定數量後:控制檯就不再重新整理輸出最新的值了

- 訊號量:signal: killed

系統負載

CPU

短時間內系統負載暴增

虛擬記憶體

短時間內佔用的虛擬記憶體暴增

top

PID COMMAND %CPU TIME #TH #WQ #PORT MEM PURG CMPRS PGRP PPID STATE BOOSTS

...

73414 test 100.2 01:59.50 9/1 0 18 6801M+ 0B 114G+ 73403 73403 running *0[1]

小結

如果仔細看過監控工具的示意圖,就可以知道其實我間隔的執行了兩次,能看到系統間的使用率幅度非常大。當程序被殺掉後,整體又恢復為正常值

在這裡,我們回到主題,就是在不控制併發的 goroutine 數量 會發生什麼問題?大致如下:

- CPU 使用率浮動上漲

- Memory 佔用不斷上漲。也可以看看 CMPRS,它表示程序的壓縮資料的位元組數。已經到達 114G+ 了

- 主程序崩潰(被殺掉了)

簡單來說,“崩潰” 的原因就是對系統資源的佔用過大。常見的比如:開啟檔案數(too many files open)、記憶體佔用等等

危害

對該臺伺服器產生非常大的影響,影響自身及相關聯的應用。很有可能導致不可用或響應緩慢,另外啟動了複數 “失控” 的 goroutine,導致程式流轉混亂

解決方案

在前面花了大量篇幅,渲染了在存在大量併發 goroutine 數量時,不控制的話會出現 “嚴重” 的問題,接下來一起思考下解決方案。如下:

- 控制/限制 goroutine 同時併發執行的數量

- 改變應用程式的邏輯寫法(避免大規模的使用系統資源和等待)

調整服務的硬體設定、最大開啟數、記憶體等閾值

控制 goroutine 併發數量

接下來正式的開始解決這個問題,希望你認真閱讀的同時加以思考,因為這個問題在實際專案中真的是太常見了!

問題已經丟擲來了,你需要做的是想想有什麼辦法解決這個問題。建議你自行思考一下技術方案。再接著往下看 :-)

嘗試 chan

func main() {

userCount := 10

ch := make(chan bool, 2)

for i := 0; i < userCount; i++ {

ch <- true

go Read(ch, i)

}

//time.Sleep(time.Second)

}

func Read(ch chan bool, i int) {

fmt.Printf("go func: %d\n", i)

<- ch

}

輸出結果:

go func: 1

go func: 2

go func: 3

go func: 4

go func: 5

go func: 6

go func: 7

go func: 8

go func: 0

嗯,我們似乎很好的控制了 2 個 2 個的 “順序” 執行多個 goroutine。但是,問題出現了。你仔細數一下輸出結果,才 9 個值?

這明顯就不對。原因出在當主協程結束時,子協程也是會被終止掉的。因此剩餘的 goroutine 沒來及把值輸出,就被送上路了(不信你把 time.Sleep 開啟看看,看看輸出數量)

嘗試 sync

...

var wg = sync.WaitGroup{}

func main() {

userCount := 10

for i := 0; i < userCount; i++ {

wg.Add(1)

go Read(i)

}

wg.Wait()

}

func Read(i int) {

defer wg.Done()

fmt.Printf("go func: %d\n", i)

}

嗯,單純的使用 sync.WaitGroup 也不行。沒有控制到同時併發的 goroutine 數量(代指達不到本文所要求的目標)

小結

單純簡單使用 channel 或 sync 都有明顯缺陷,不行。我們再看看元件配合能不能實作

嘗試 chan + sync

...

var wg = sync.WaitGroup{}

func main() {

userCount := 10

ch := make(chan bool, 2)

for i := 0; i < userCount; i++ {

wg.Add(1)

go Read(ch, i)

}

wg.Wait()

}

func Read(ch chan bool, i int) {

defer wg.Done()

ch <- true

fmt.Printf("go func: %d, time: %d\n", i, time.Now().Unix())

time.Sleep(time.Second)

<-ch

}

輸出結果:

go func: 9, time: 1547911938

go func: 1, time: 1547911938

go func: 6, time: 1547911939

go func: 7, time: 1547911939

go func: 8, time: 1547911940

go func: 0, time: 1547911940

go func: 3, time: 1547911941

go func: 2, time: 1547911941

go func: 4, time: 1547911942

go func: 5, time: 1547911942

從輸出結果來看,確實實作了控制 goroutine 以 2 個 2 個的數量去執行我們的 “業務邏輯”,當然結果集也理所應當的是亂序輸出

方案一:簡單 Semaphore

在確立了簡單使用 chan + sync 的方案是可行後,我們重新將流轉邏輯封裝為 gsema,主程式變成如下:

import (

"fmt"

"time"

"github.com/EDDYCJY/gsema"

)

var sema = gsema.NewSemaphore(3)

func main() {

userCount := 10

for i := 0; i < userCount; i++ {

go Read(i)

}

sema.Wait()

}

func Read(i int) {

defer sema.Done()

sema.Add(1)

fmt.Printf("go func: %d, time: %d\n", i, time.Now().Unix())

time.Sleep(time.Second)

}

分析方案

在上述程式碼中,程式執行流程如下:

- 設定允許的併發數目為 3 個

- 迴圈 10 次,每次啟動一個 goroutine 來執行任務

- 每一個 goroutine 在內部利用

sema進行調控是否阻塞 - 按允許併發數逐漸釋出 goroutine,最後結束任務

看上去人模人樣,沒什麼嚴重問題。但卻有一個 “大” 坑,認真看到第二點 “每次啟動一個 goroutine” 這句話。這裡有點問題,提前產生那麼多的 goroutine 會不會有什麼問題,接下來一起分析下利弊,如下:

利

- 適合量不大、複雜度低的使用場景

- 幾百幾千個、幾十萬個也是可以接受的(看具體業務場景)

- 實際業務邏輯在執行前就已經被阻塞等待了(因為併發數受限),基本實際業務邏輯損耗的效能比 goroutine 本身大

- goroutine 本身很輕便,僅損耗極少許的記憶體空間和排程。這種等待響應的情況都是躺好了,等待任務喚醒

- Semaphore 操作複雜度低且流轉簡單,容易控制

弊

- 不適合量很大、複雜度高的使用場景

- 有幾百萬、幾千萬個 goroutine 的話,就浪費了大量排程 goroutine 和記憶體空間。恰好你的伺服器也接受不了的話

- Semaphore 操作複雜度提高,要管理更多的狀態

小結

- 基於什麼業務場景,就用什麼方案去做事

- 有足夠的時間,允許你去追求更優秀、極致的方案(用第三方庫也行)

用哪種方案,我認為主要基於以上兩點去思考,都是 OK 的。沒有對錯,只有當前業務場景能不能接受,這個預先啟動的 goroutine 數量你的系統是否能夠接受

當然了,常見/簡單的 Go 應用採用這類技術方案,基本就能解決問題了。因為像本文第一節 “問題” 如此超巨大數量的情況,情況很少。其並不存在那些 “特殊性”。因此用這個方案基本 OK

靈活控制 goroutine 併發數量

小手一緊。隔壁老王發現了新的問題。“方案一” 中,在輸入輸出一體的情況下,在常見的業務場景中確實可以

但,這次新的業務場景比較特殊,要控制輸入的數量,以此達到改變允許併發執行 goroutine 的數量。我們仔細想想,要做出如下改變:

- 輸入/輸出要抽離,才可以分別控制

- 輸入/輸出要可變,理所應當在 for-loop 中(可設定數值的地方)

- 允許改變 goroutine 併發數量,但它也必須有一個最大值(因為允許改變是相對)

方案二:靈活 chan + sync

package main

import (

"fmt"

"sync"

"time"

)

var wg sync.WaitGroup

func main() {

userCount := 10

ch := make(chan int, 5)

for i := 0; i < userCount; i++ {

wg.Add(1)

go func() {

defer wg.Done()

for d := range ch {

fmt.Printf("go func: %d, time: %d\n", d, time.Now().Unix())

time.Sleep(time.Second * time.Duration(d))

}

}()

}

for i := 0; i < 10; i++ {

ch <- 1

ch <- 2

//time.Sleep(time.Second)

}

close(ch)

wg.Wait()

}

輸出結果:

...

go func: 1, time: 1547950567

go func: 3, time: 1547950567

go func: 1, time: 1547950567

go func: 2, time: 1547950567

go func: 2, time: 1547950567

go func: 3, time: 1547950567

go func: 1, time: 1547950568

go func: 2, time: 1547950568

go func: 3, time: 1547950568

go func: 1, time: 1547950568

go func: 3, time: 1547950569

go func: 2, time: 1547950569

在 “方案二” 中,我們可以隨時隨地的根據新的業務需求,做如下事情:

- 變更 channel 的輸入數量

- 能夠根據特殊情況,變更 channel 的迴圈值

- 變更最大允許併發的 goroutine 數量

總的來說,就是可控空間都儘量放開了,是不是更加靈活了呢 :-)

方案三:第三方庫

比較成熟的第三方庫也不少,基本都是以生成和管理 goroutine 為目標的池工具。我簡單列了幾個,具體建議大家閱讀下原始碼或者多找找,原理相似

總結

在本文的開頭,我花了大力氣(極端數量),告訴你同時併發過多的 goroutine 數量會導致系統佔用資源不斷上漲。最終該服務崩盤的極端情況。為的是希望你今後避免這種問題,給你留下深刻的印象

接下來我們以 “控制 goroutine 併發數量” 為主題,展開了一番分析。分別給出了三種方案。在我看來,各具優缺點,我建議你挑選合適自身場景的技術方案就可以了

因為,有不同型別的技術方案也能解決這個問題,千人千面。本文推薦的是較常見的解決方案,也歡迎大家在評論區繼續補充 :-)

1.7 for-loop 與 json.Unmarshal 效能分析概要

在專案中,常常會遇到迴圈交換賦值的資料處理場景,尤其是 RPC,資料互動格式要轉為 Protobuf,賦值是無法避免的。一般會有如下幾種做法:

- for

- for range

- json.Marshal/Unmarshal

這時候又面臨 “選擇困難症”,用哪個好?又想程式碼量少,又擔心效能有沒有影響啊...

為了弄清楚這個疑惑,接下來將分別編寫三種使用場景。來簡單看看它們的效能情況,看看誰更 “好”

功能程式碼

...

type Person struct {

Name string `json:"name"`

Age int `json:"age"`

Avatar string `json:"avatar"`

Type string `json:"type"`

}

type AgainPerson struct {

Name string `json:"name"`

Age int `json:"age"`

Avatar string `json:"avatar"`

Type string `json:"type"`

}

const MAX = 10000

func InitPerson() []Person {

var persons []Person

for i := 0; i < MAX; i++ {

persons = append(persons, Person{

Name: "EDDYCJY",

Age: i,

Avatar: "https://github.com/EDDYCJY",

Type: "Person",

})

}

return persons

}

func ForStruct(p []Person, count int) {

for i := 0; i < count; i++ {

_, _ = i, p[i]

}

}

func ForRangeStruct(p []Person) {

for i, v := range p {

_, _ = i, v

}

}

func JsonToStruct(data []byte, againPerson []AgainPerson) ([]AgainPerson, error) {

err := json.Unmarshal(data, &againPerson)

return againPerson, err

}

func JsonIteratorToStruct(data []byte, againPerson []AgainPerson) ([]AgainPerson, error) {

var jsonIter = jsoniter.ConfigCompatibleWithStandardLibrary

err := jsonIter.Unmarshal(data, &againPerson)

return againPerson, err

}

測試程式碼

...

func BenchmarkForStruct(b *testing.B) {

person := InitPerson()

count := len(person)

b.ResetTimer()

for i := 0; i < b.N; i++ {

ForStruct(person, count)

}

}

func BenchmarkForRangeStruct(b *testing.B) {

person := InitPerson()

b.ResetTimer()

for i := 0; i < b.N; i++ {

ForRangeStruct(person)

}

}

func BenchmarkJsonToStruct(b *testing.B) {

var (

person = InitPerson()

againPersons []AgainPerson

)

data, err := json.Marshal(person)

if err != nil {

b.Fatalf("json.Marshal err: %v", err)

}

b.ResetTimer()

for i := 0; i < b.N; i++ {

JsonToStruct(data, againPersons)

}

}

func BenchmarkJsonIteratorToStruct(b *testing.B) {

var (

person = InitPerson()

againPersons []AgainPerson

)

data, err := json.Marshal(person)

if err != nil {

b.Fatalf("json.Marshal err: %v", err)

}

b.ResetTimer()

for i := 0; i < b.N; i++ {

JsonIteratorToStruct(data, againPersons)

}

}

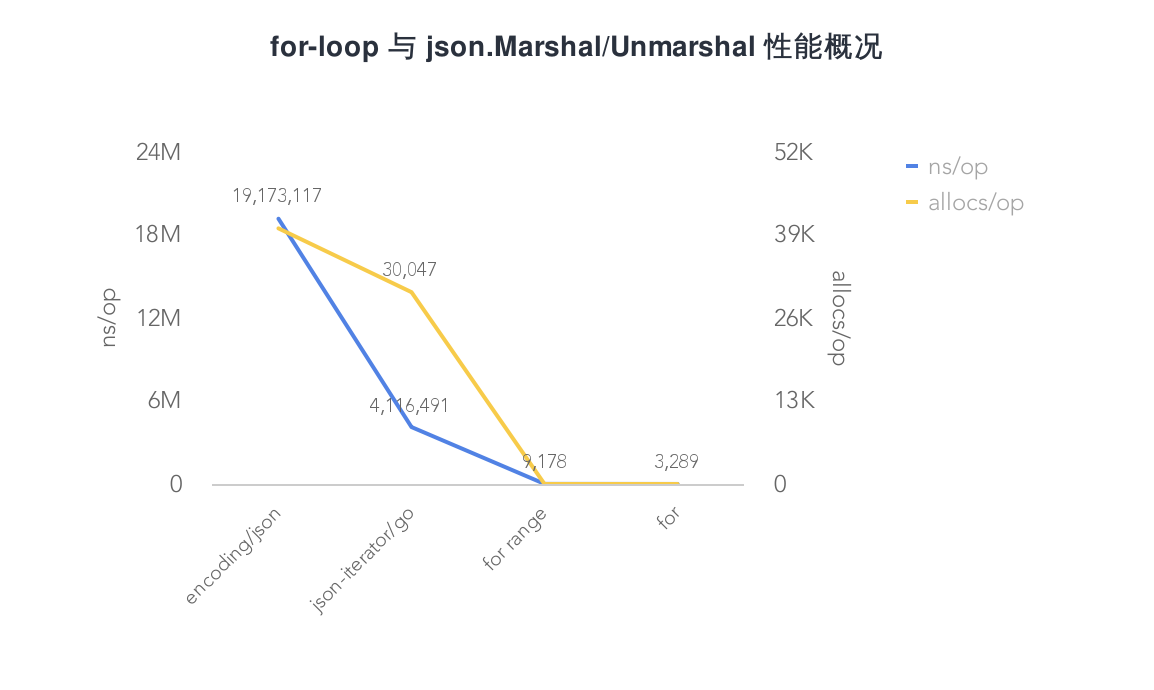

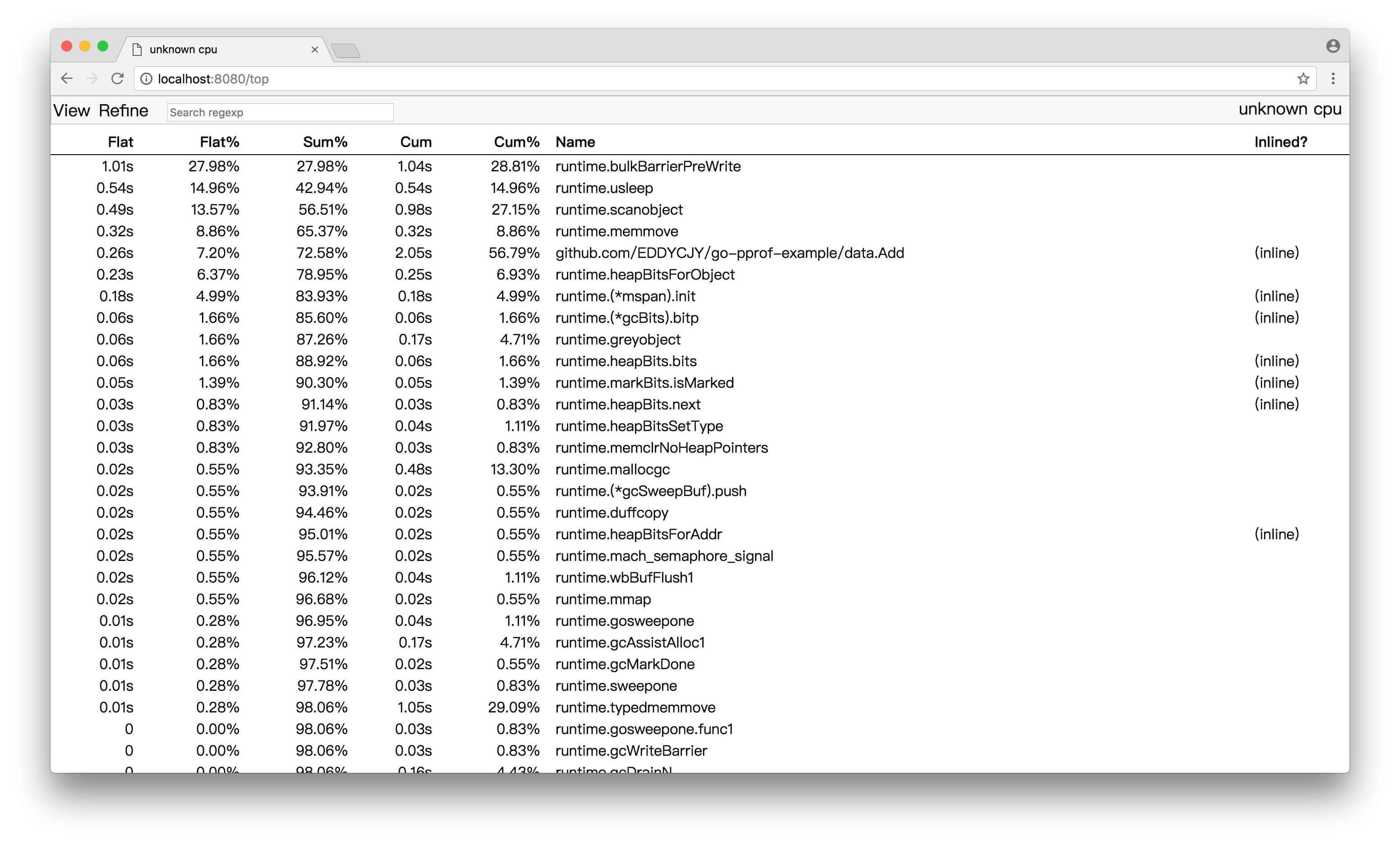

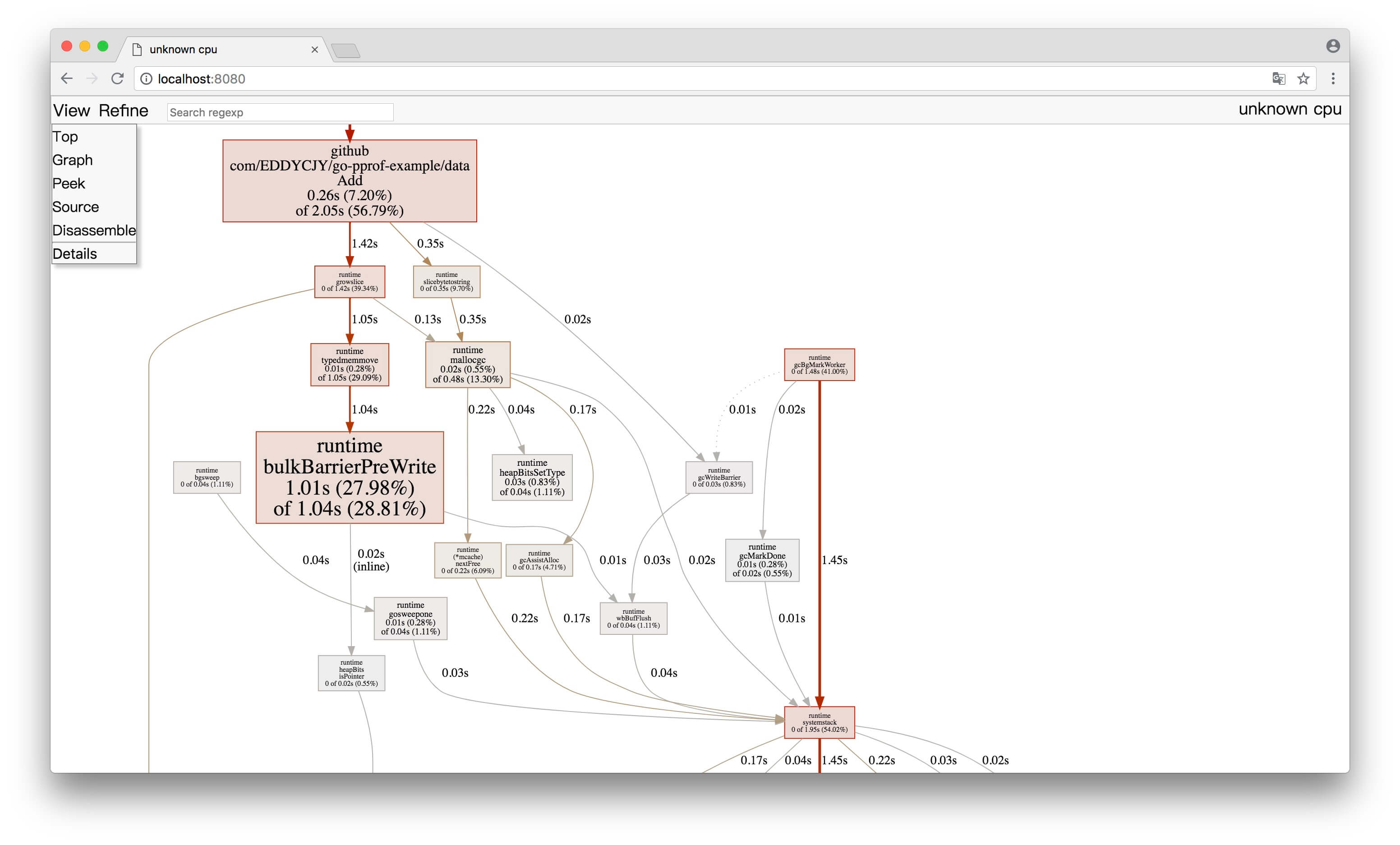

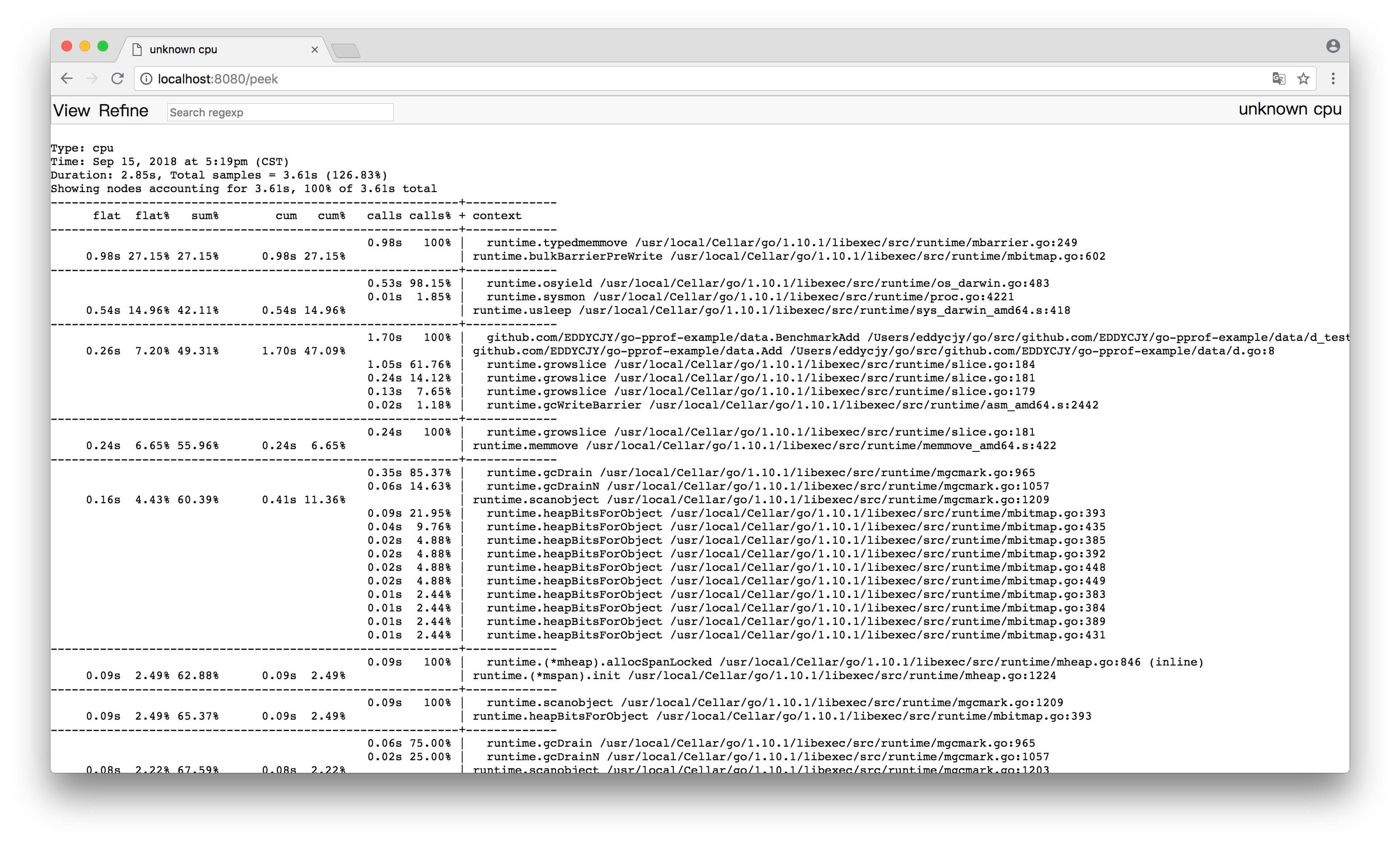

測試結果

BenchmarkForStruct-4 500000 3289 ns/op 0 B/op 0 allocs/op

BenchmarkForRangeStruct-4 200000 9178 ns/op 0 B/op 0 allocs/op

BenchmarkJsonToStruct-4 100 19173117 ns/op 2618509 B/op 40036 allocs/op

BenchmarkJsonIteratorToStruct-4 300 4116491 ns/op 3694017 B/op 30047 allocs/op

從測試結果來看,效能排名為:for < for range < json-iterator < encoding/json。接下來我們看看是什麼原因導致了這樣子的排名?

效能對比

for-loop

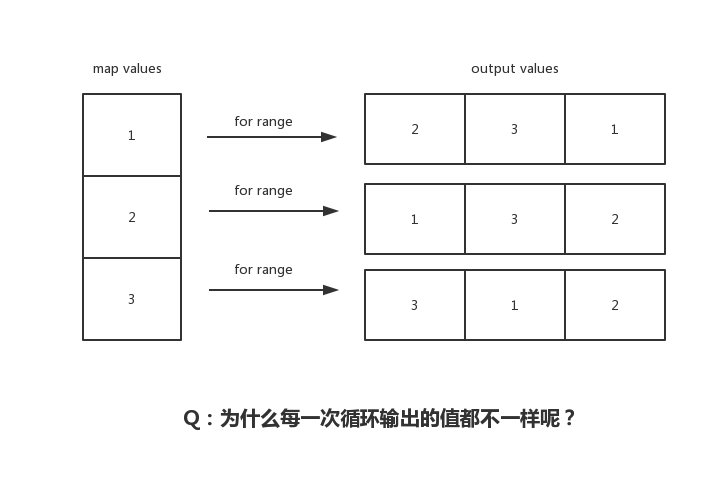

在測試結果中,for range 在效能上相較 for 差。這是為什麼呢?在這裡我們可以參見 for range 的 實作,偽實作如下:

for_temp := range

len_temp := len(for_temp)

for index_temp = 0; index_temp < len_temp; index_temp++ {

value_temp = for_temp[index_temp]

index = index_temp

value = value_temp

original body

}

透過分析偽實作,可得知 for range 相較 for 多做了如下事項

Expression

RangeClause = [ ExpressionList "=" | IdentifierList ":=" ] "range" Expression .

在迴圈開始之前會對範圍表示式進行求值,多做了 “解” 表示式的動作,得到了最終的範圍值

Copy

...

value_temp = for_temp[index_temp]

index = index_temp

value = value_temp

...

從偽實作上可以得出,for range 始終使用值複製的方式來生成迴圈變數。通俗來講,就是在每次迴圈時,都會對迴圈變數重新分配

小結

透過上述的分析,可得知其比 for 慢的原因是 for range 有額外的效能開銷,主要為值複製的動作導致的效能下降。這是它慢的原因

那麼其實在 for range 中,我們可以使用 _ 和 T[i] 也能達到和 for 差不多的效能。但這可能不是 for range 的設計本意了

json.Marshal/Unmarshal

encoding/json

json 互轉是在三種方案中最慢的,這是為什麼呢?

眾所皆知,官方的 encoding/json 標準庫,是透過大量反射來實作的。那麼 “慢”,也是必然的。可參見下述程式碼:

...

func newTypeEncoder(t reflect.Type, allowAddr bool) encoderFunc {

...

switch t.Kind() {

case reflect.Bool:

return boolEncoder

case reflect.Int, reflect.Int8, reflect.Int16, reflect.Int32, reflect.Int64:

return intEncoder

case reflect.Uint, reflect.Uint8, reflect.Uint16, reflect.Uint32, reflect.Uint64, reflect.Uintptr:

return uintEncoder

case reflect.Float32:

return float32Encoder

case reflect.Float64:

return float64Encoder

case reflect.String:

return stringEncoder

case reflect.Interface:

return interfaceEncoder

case reflect.Struct:

return newStructEncoder(t)

case reflect.Map:

return newMapEncoder(t)

case reflect.Slice:

return newSliceEncoder(t)

case reflect.Array:

return newArrayEncoder(t)

case reflect.Ptr:

return newPtrEncoder(t)

default:

return unsupportedTypeEncoder

}

}

既然官方的標準庫存在一定的 “問題”,那麼有沒有其他解決方法呢?目前在社群裡,大多為兩類方案。如下:

- 預編譯生成程式碼(提前確定型別),可以解決執行時的反射帶來的效能開銷。缺點是增加了預生成的步驟

- 最佳化序列化的邏輯,效能達到最大化

接下來的實驗,我們用第二種方案的庫來測試,看看有沒有改變。另外也推薦大家瞭解如下專案:

json-iterator/go

目前社群較常用的是 json-iterator/go,我們在測試程式碼中用到了它

它的用法與標準庫 100% 相容,並且效能有較大提升。我們一起粗略的看下是怎麼做到的,如下:

reflect2

利用 modern-go/reflect2 減少執行時排程開銷

...

type StructDescriptor struct {

Type reflect2.Type

Fields []*Binding

}

...

type Binding struct {

levels []int

Field reflect2.StructField

FromNames []string

ToNames []string

Encoder ValEncoder

Decoder ValDecoder

}

type Extension interface {

UpdateStructDescriptor(structDescriptor *StructDescriptor)

CreateMapKeyDecoder(typ reflect2.Type) ValDecoder

CreateMapKeyEncoder(typ reflect2.Type) ValEncoder

CreateDecoder(typ reflect2.Type) ValDecoder

CreateEncoder(typ reflect2.Type) ValEncoder

DecorateDecoder(typ reflect2.Type, decoder ValDecoder) ValDecoder

DecorateEncoder(typ reflect2.Type, encoder ValEncoder) ValEncoder

}

struct Encoder/Decoder Cache

型別為 struct 時,只需要反射一次 Name 和 Type,會快取 struct Encoder 和 Decoder

var typeDecoders = map[string]ValDecoder{}

var fieldDecoders = map[string]ValDecoder{}

var typeEncoders = map[string]ValEncoder{}

var fieldEncoders = map[string]ValEncoder{}

var extensions = []Extension{}

....

fieldNames := calcFieldNames(field.Name(), tagParts[0], tag)

fieldCacheKey := fmt.Sprintf("%s/%s", typ.String(), field.Name())

decoder := fieldDecoders[fieldCacheKey]

if decoder == nil {

decoder = decoderOfType(ctx.append(field.Name()), field.Type())

}

encoder := fieldEncoders[fieldCacheKey]

if encoder == nil {

encoder = encoderOfType(ctx.append(field.Name()), field.Type())

}

文字解析最佳化

小結

相較於官方標準庫,第三方庫 json-iterator/go 在執行時上做的更好。這是它快的原因

有個需要注意的點,在 Go1.10 後 map 型別與標準庫的已經沒有太大的效能差異。但是,例如 struct 型別等仍然有較大的效能提高

總結

在本文中,我們首先進行了效能測試,再分析了不同方案,得知為什麼了快慢的原因。那麼最終在選擇方案時,可以根據不同的應用場景去抉擇:

- 對效能開銷有較高要求:選用

for,開銷最小 - 中規中矩:選用

for range,大物件慎用 - 量小、佔用小、數量可控:選用

json.Marshal/Unmarshal的方案也可以。其重複程式碼少,但開銷最大

在絕大多數場景中,使用哪種並沒有太大的影響。但作為工程師你應當清楚其利弊。以上就是不同的方案分析概要,希望對你有所幫助 :)

1.8 簡單圍觀一下有趣的 //go: 指令

前言

如果你平時有翻看原始碼的習慣,你肯定會發現。咦,怎麼有的方法上面總是寫著 //go: 這類指令呢。他們到底是幹嘛用的?

今天我們一同揭開他們的面紗,我將簡單給你介紹一下,它們都負責些什麼

go:linkname

//go:linkname localname importpath.name

該指令指示編譯器使用 importpath.name 作為原始碼中宣告為 localname 的變數或函式的目標檔案符號名稱。但是由於這個偽指令,可以破壞型別系統和包模組化。因此只有引用了 unsafe 包才可以使用

簡單來講,就是 importpath.name 是 localname 的符號別名,編譯器實際上會呼叫 localname 。但前提是使用了 unsafe 包才能使用

案例

time/time.go

...

func now() (sec int64, nsec int32, mono int64)

runtime/timestub.go

import _ "unsafe" // for go:linkname

//go:linkname time_now time.now

func time_now() (sec int64, nsec int32, mono int64) {

sec, nsec = walltime()

return sec, nsec, nanotime() - startNano

}

在這個案例中可以看到 time.now,它並沒有具體的實作。如果你初看可能會懵逼。這時候建議你全域性搜尋一下原始碼,你就會發現其實作在 runtime.time_now 中

配合先前的用法解釋,可得知在 runtime 包中,我們聲明瞭 time_now 方法是 time.now 的符號別名。並且在檔案頭引入了 unsafe 達成前提條件

go:noescape

//go:noescape

該指令指定下一個有宣告但沒有主體(意味著實作有可能不是 Go)的函式,不允許編譯器對其做逃逸分析

一般情況下,該指令用於記憶體分配最佳化。因為編譯器預設會進行逃逸分析,會透過規則判定一個變數是分配到堆上還是棧上。但凡事有意外,一些函式雖然逃逸分析其是存放到堆上。但是對於我們來說,它是特別的。我們就可以使用 go:noescape 指令強制要求編譯器將其分配到函式棧上

案例

// memmove copies n bytes from "from" to "to".

// in memmove_*.s

//go:noescape

func memmove(to, from unsafe.Pointer, n uintptr)

我們觀察一下這個案例,它滿足了該指令的常見特性。如下:

- memmove_*.s:只有宣告,沒有主體。其主體是由底層彙編實作的

- memmove:函式功能,在棧上處理效能會更好

go:nosplit

//go:nosplit

該指令指定檔案中宣告的下一個函式不得包含堆疊溢位檢查。簡單來講,就是這個函式跳過堆疊溢位的檢查

案例

//go:nosplit

func key32(p *uintptr) *uint32 {

return (*uint32)(unsafe.Pointer(p))

}

go:nowritebarrierrec

//go:nowritebarrierrec

該指令表示編譯器遇到寫屏障時就會產生一個錯誤,並且允許遞迴。也就是這個函式呼叫的其他函式如果有寫屏障也會報錯。簡單來講,就是針對寫屏障的處理,防止其死迴圈

案例

//go:nowritebarrierrec

func gcFlushBgCredit(scanWork int64) {

...

}

go:yeswritebarrierrec

//go:yeswritebarrierrec

該指令與 go:nowritebarrierrec 相對,在標註 go:nowritebarrierrec 指令的函式上,遇到寫屏障會產生錯誤。而當編譯器遇到 go:yeswritebarrierrec 指令時將會停止

案例

//go:yeswritebarrierrec

func gchelper() {

...

}

go:noinline

該指令表示該函式禁止進行內聯

案例

//go:noinline

func unexportedPanicForTesting(b []byte, i int) byte {

return b[i]

}

我們觀察一下這個案例,是直接透過索引取值,邏輯比較簡單。如果不加上 go:noinline 的話,就會出現編譯器對其進行內聯最佳化

顯然,內聯有好有壞。該指令就是提供這一特殊處理

go:norace

//go:norace

該指令表示禁止進行競態檢測。而另外一種常見的形式就是在啟動時執行 go run -race,能夠檢測應用程式中是否存在雙向的資料競爭。非常有用

案例

//go:norace

func forkAndExecInChild(argv0 *byte, argv, envv []*byte, chroot, dir *byte, attr *ProcAttr, sys *SysProcAttr, pipe int) (pid int, err Errno) {

...

}

go:notinheap

//go:notinheap

該指令常用於型別宣告,它表示這個型別不允許從 GC 堆上進行申請記憶體。在執行時中常用其來做較低層次的內部結構,避免排程器和記憶體分配中的寫屏障。能夠提高效能

案例

// notInHeap is off-heap memory allocated by a lower-level allocator

// like sysAlloc or persistentAlloc.

//

// In general, it's better to use real types marked as go:notinheap,

// but this serves as a generic type for situations where that isn't

// possible (like in the allocators).

//

//go:notinheap

type notInHeap struct{}

總結

在本文我們簡單介紹了一些常見的指令集,我建議僅供瞭解。一般我們是用不到的,因為你的瓶頸可能更多的在自身應用上

但是瞭解這一些,對你瞭解底層原始碼和執行機制會更有幫助。如果想再深入些,可閱讀我給出的參考連結 :)

參考

1.9 我要在棧上。不,你應該在堆上

我們在寫程式碼的時候,有時候會想這個變數到底分配到哪裡了?這時候可能會有人說,在棧上,在堆上。信我準沒錯...

但從結果上來講你還是一知半解,這可不行,萬一被人懵了呢。今天我們一起來深挖下 Go 在這塊的奧妙,自己動手豐衣足食

問題

type User struct {

ID int64

Name string

Avatar string

}

func GetUserInfo() *User {

return &User{ID: 13746731, Name: "EDDYCJY", Avatar: "https://avatars0.githubusercontent.com/u/13746731"}

}

func main() {

_ = GetUserInfo()

}

開局就是一把問號,帶著問題進行學習。請問 main 呼叫 GetUserInfo 後返回的 &User{...}。這個變數是分配到棧上了呢,還是分配到堆上了?

什麼是堆/棧

在這裡並不打算詳細介紹堆疊,僅簡單介紹本文所需的基礎知識。如下:

- 堆(Heap):一般來講是人為手動進行管理,手動申請、分配、釋放。一般所涉及的記憶體大小並不定,一般會存放較大的物件。另外其分配相對慢,涉及到的指令動作也相對多

- 棧(Stack):由編譯器進行管理,自動申請、分配、釋放。一般不會太大,我們常見的函式引數(不同平臺允許存放的數量不同),區域性變數等等都會存放在棧上

今天我們介紹的 Go 語言,它的堆疊分配是透過 Compiler 進行分析,GC 去管理的,而對其的分析選擇動作就是今天探討的重點

什麼是逃逸分析

在編譯程式最佳化理論中,逃逸分析是一種確定指標動態範圍的方法,簡單來說就是分析在程式的哪些地方可以訪問到該指標

通俗地講,逃逸分析就是確定一個變數要放堆上還是棧上,規則如下:

- 是否有在其他地方(非區域性)被引用。只要有可能被引用了,那麼它一定分配到堆上。否則分配到棧上

- 即使沒有被外部引用,但物件過大,無法存放在棧區上。依然有可能分配到堆上

對此你可以理解為,逃逸分析是編譯器用於決定變數分配到堆上還是棧上的一種行為

在什麼階段確立逃逸

在編譯階段確立逃逸,注意並不是在執行時

為什麼需要逃逸

這個問題我們可以反過來想,如果變數都分配到堆上了會出現什麼事情?例如:

- 垃圾回收(GC)的壓力不斷增大

- 申請、分配、回收記憶體的系統開銷增大(相對於棧)

- 動態分配產生一定量的記憶體碎片

其實總的來說,就是頻繁申請、分配堆記憶體是有一定 “代價” 的。會影響應用程式執行的效率,間接影響到整體系統。因此 “按需分配” 最大限度的靈活利用資源,才是正確的治理之道。這就是為什麼需要逃逸分析的原因,你覺得呢?

怎麼確定是否逃逸

第一,透過編譯器命令,就可以看到詳細的逃逸分析過程。而指令集 -gcflags 用於將標識引數傳遞給 Go 編譯器,涉及如下:

-m會打印出逃逸分析的最佳化策略,實際上最多總共可以用 4 個-m,但是資訊量較大,一般用 1 個就可以了-l會停用函式內聯,在這裡停用掉 inline 能更好的觀察逃逸情況,減少干擾

$ go build -gcflags '-m -l' main.go

第二,透過反編譯命令檢視

$ go tool compile -S main.go

注:可以透過 go tool compile -help 檢視所有允許傳遞給編譯器的標識引數

逃逸案例

案例一:指標

第一個案例是一開始丟擲的問題,現在你再看看,想想,如下:

type User struct {

ID int64

Name string

Avatar string

}

func GetUserInfo() *User {

return &User{ID: 13746731, Name: "EDDYCJY", Avatar: "https://avatars0.githubusercontent.com/u/13746731"}

}

func main() {

_ = GetUserInfo()

}

執行命令觀察一下,如下:

$ go build -gcflags '-m -l' main.go

# command-line-arguments

./main.go:10:54: &User literal escapes to heap

透過檢視分析結果,可得知 &User 逃到了堆裡,也就是分配到堆上了。這是不是有問題啊...再看看彙編程式碼確定一下,如下:

$ go tool compile -S main.go

"".GetUserInfo STEXT size=190 args=0x8 locals=0x18

0x0000 00000 (main.go:9) TEXT "".GetUserInfo(SB), $24-8

...

0x0028 00040 (main.go:10) MOVQ AX, (SP)

0x002c 00044 (main.go:10) CALL runtime.newobject(SB)

0x0031 00049 (main.go:10) PCDATA $2, $1

0x0031 00049 (main.go:10) MOVQ 8(SP), AX

0x0036 00054 (main.go:10) MOVQ $13746731, (AX)

0x003d 00061 (main.go:10) MOVQ $7, 16(AX)

0x0045 00069 (main.go:10) PCDATA $2, $-2

0x0045 00069 (main.go:10) PCDATA $0, $-2

0x0045 00069 (main.go:10) CMPL runtime.writeBarrier(SB), $0

0x004c 00076 (main.go:10) JNE 156

0x004e 00078 (main.go:10) LEAQ go.string."EDDYCJY"(SB), CX

...

我們將目光集中到 CALL 指令,發現其執行了 runtime.newobject 方法,也就是確實是分配到了堆上。這是為什麼呢?

分析結果

這是因為 GetUserInfo() 返回的是指標物件,引用被返回到了方法之外了。因此編譯器會把該物件分配到堆上,而不是棧上。否則方法結束之後,區域性變數就被回收了,豈不是翻車。所以最終分配到堆上是理所當然的

再想想

那你可能會想,那就是所有指標物件,都應該在堆上?並不。如下:

func main() {

str := new(string)

*str = "EDDYCJY"

}

你想想這個物件會分配到哪裡?如下:

$ go build -gcflags '-m -l' main.go

# command-line-arguments

./main.go:4:12: main new(string) does not escape

顯然,該物件分配到棧上了。很核心的一點就是它有沒有被作用域之外所引用,而這裡作用域仍然保留在 main 中,因此它沒有發生逃逸

案例二:未確定型別

func main() {

str := new(string)

*str = "EDDYCJY"

fmt.Println(str)

}

執行命令觀察一下,如下:

$ go build -gcflags '-m -l' main.go

# command-line-arguments

./main.go:9:13: str escapes to heap

./main.go:6:12: new(string) escapes to heap

./main.go:9:13: main ... argument does not escape

透過檢視分析結果,可得知 str 變數逃到了堆上,也就是該物件在堆上分配。但上個案例時它還在棧上,我們也就 fmt 輸出了它而已。這...到底發生了什麼事?

分析結果

相對案例一,案例二隻加了一行程式碼 fmt.Println(str),問題肯定出在它身上。其原型:

func Println(a ...interface{}) (n int, err error)

透過對其分析,可得知當形參為 interface 型別時,在編譯階段編譯器無法確定其具體的型別。因此會產生逃逸,最終分配到堆上

如果你有興趣追原始碼的話,可以看下內部的 reflect.TypeOf(arg).Kind() 語句,其會造成堆逃逸,而表象就是 interface 型別會導致該物件分配到堆上

案例三、洩露引數

type User struct {

ID int64

Name string

Avatar string

}

func GetUserInfo(u *User) *User {

return u

}

func main() {

_ = GetUserInfo(&User{ID: 13746731, Name: "EDDYCJY", Avatar: "https://avatars0.githubusercontent.com/u/13746731"})

}

執行命令觀察一下,如下:

$ go build -gcflags '-m -l' main.go

# command-line-arguments

./main.go:9:18: leaking param: u to result ~r1 level=0

./main.go:14:63: main &User literal does not escape

我們注意到 leaking param 的表述,它說明了變數 u 是一個洩露引數。結合程式碼可得知其傳給 GetUserInfo 方法後,沒有做任何引用之類的涉及變數的動作,直接就把這個變數返回出去了。因此這個變數實際上並沒有逃逸,它的作用域還在 main() 之中,所以分配在棧上

再想想

那你再想想怎麼樣才能讓它分配到堆上?結合案例一,舉一反三。修改如下:

type User struct {

ID int64

Name string

Avatar string

}

func GetUserInfo(u User) *User {

return &u

}

func main() {

_ = GetUserInfo(User{ID: 13746731, Name: "EDDYCJY", Avatar: "https://avatars0.githubusercontent.com/u/13746731"})

}

執行命令觀察一下,如下:

$ go build -gcflags '-m -l' main.go

# command-line-arguments

./main.go:10:9: &u escapes to heap

./main.go:9:18: moved to heap: u

只要一小改,它就考慮會被外部所引用,因此妥妥的分配到堆上了

總結

在本文我給你介紹了逃逸分析的概念和規則,並列舉了一些例子加深理解。但實際肯定遠遠不止這些案例,你需要做到的是掌握方法,遇到再看就好了。除此之外你還需要注意:

- 靜態分配到棧上,效能一定比動態分配到堆上好

- 底層分配到堆,還是棧。實際上對你來說是透明的,不需要過度關心

- 每個 Go 版本的逃逸分析都會有所不同(會改變,會最佳化)

- 直接透過

go build -gcflags '-m -l'就可以看到逃逸分析的過程和結果 - 到處都用指標傳遞並不一定是最好的,要用對

之前就有想過要不要寫 “逃逸分析” 相關的文章,直到最近看到在夜讀裡有人問,還是有寫的必要。對於這塊的知識點。我的建議是適當瞭解,但沒必要硬記。靠基礎知識點加命令除錯觀察就好了。像是曹大之前講的 “你琢磨半天逃逸分析,一壓測,瓶頸在鎖上”,完全沒必要過度在意...

參考

1.10 defer 會有效能損耗,儘量不要用

上個月在 @polaris @軒脈刃 的全棧技術群裡看到一個小夥伴問 “說 defer 在棧退出時執行,會有效能損耗,儘量不要用,這個怎麼解?”。

恰好前段時間寫了一篇 《深入理解 Go defer》 去詳細剖析 defer 關鍵字。那麼這一次簡單結合前文對這個問題進行探討一波,希望對你有所幫助,但在此之前希望你花幾分鐘,自己思考一下答案,再繼續往下看。

測試

func DoDefer(key, value string) {

defer func(key, value string) {

_ = key + value

}(key, value)

}

func DoNotDefer(key, value string) {

_ = key + value

}

基準測試:

func BenchmarkDoDefer(b *testing.B) {

for i := 0; i < b.N; i++ {

DoDefer("煎鱼", "https://github.com/EDDYCJY/blog")

}

}

func BenchmarkDoNotDefer(b *testing.B) {

for i := 0; i < b.N; i++ {

DoNotDefer("煎鱼", "https://github.com/EDDYCJY/blog")

}

}

輸出結果:

$ go test -bench=. -benchmem -run=none

goos: darwin

goarch: amd64

pkg: github.com/EDDYCJY/awesomeDefer

BenchmarkDoDefer-4 20000000 91.4 ns/op 48 B/op 1 allocs/op

BenchmarkDoNotDefer-4 30000000 41.6 ns/op 48 B/op 1 allocs/op

PASS

ok github.com/EDDYCJY/awesomeDefer 3.234s

從結果上來,使用 defer 後的函式開銷確實比沒使用高了不少,這損耗用到哪裡去了呢?

想一下

$ go tool compile -S main.go

"".main STEXT size=163 args=0x0 locals=0x40

...

0x0059 00089 (main.go:6) MOVQ AX, 16(SP)

0x005e 00094 (main.go:6) MOVQ $1, 24(SP)

0x0067 00103 (main.go:6) MOVQ $1, 32(SP)

0x0070 00112 (main.go:6) CALL runtime.deferproc(SB)

0x0075 00117 (main.go:6) TESTL AX, AX

0x0077 00119 (main.go:6) JNE 137

0x0079 00121 (main.go:7) XCHGL AX, AX

0x007a 00122 (main.go:7) CALL runtime.deferreturn(SB)

0x007f 00127 (main.go:7) MOVQ 56(SP), BP

0x0084 00132 (main.go:7) ADDQ $64, SP

0x0088 00136 (main.go:7) RET

0x0089 00137 (main.go:6) XCHGL AX, AX

0x008a 00138 (main.go:6) CALL runtime.deferreturn(SB)

0x008f 00143 (main.go:6) MOVQ 56(SP), BP

0x0094 00148 (main.go:6) ADDQ $64, SP

0x0098 00152 (main.go:6) RET

...

我們在前文提到 defer 關鍵字其實涉及了一系列的連鎖呼叫,內部 runtime 函式的呼叫就至少多了三步,分別是 runtime.deferproc 一次和 runtime.deferreturn 兩次。

而這還只是在執行時的顯式動作,另外編譯器做的事也不少,例如:

- 在

deferproc階段(註冊延遲呼叫),還得取得/傳入目標函式地址、函式引數等等。 - 在

deferreturn階段,需要在函式呼叫結尾處插入該方法的呼叫,同時若有被defer的函式,還需要使用runtime·jmpdefer進行跳轉以便於後續呼叫。

這一些動作途中還要涉及最小單元 _defer 的取得/生成, defer 和 recover 連結串列的邏輯處理和消耗等動作。

Q&A

最後討論的時候有提到 “問題指的是本來就是用來執行 close() 一些操作的,然後說盡量不能用,例子就把 defer db.close() 前面的 defer 刪去了” 這個疑問。

這是一個比較類似 “教科書” 式的說法,在一些入門教程中會潛移默化的告訴你在資源控制後加個 defer 延遲關閉一下。例如:

resp, err := http.Get(...)

if err != nil {

return err

}

defer resp.Body.Close()

但是一定得這麼寫嗎?其實並不,很多人給出的理由都是 “怕你忘記” 這種說辭,這沒有毛病。但需要認清場景,假設我的應用場景如下:

resp, err := http.Get(...)

if err != nil {

return err

}

defer resp.Body.Close()

// do something

time.Sleep(time.Second * 60)

嗯,一個請求當然沒問題,流量、併發一下子大了呢,那可能就是個災難了。你想想為什麼?從常見的 defer + close 的使用組合來講,用之前建議先看清楚應用場景,在保證無異常的情況下確保儘早關閉才是首選。如果只是小範圍呼叫很快就返回的話,偷個懶直接一套組合拳出去也未嘗不可。

結論

一個 defer 關鍵字實際上包含了不少的動作和處理,和你單純呼叫一個函式一條指令是沒法比的。而與對照物相比,它確確實實是有效能損耗,目前延遲呼叫的全部開銷大約在 50ns,但 defer 所提供的作用遠遠大於此,你從全域性來看,它的損耗非常小,並且官方還不斷地在最佳化中。

因此,對於 “Go defer 會有效能損耗,儘量不能用?” 這個問題,我認為該用就用,應該及時關閉就不要延遲,在 hot paths 用時一定要想清楚場景。

補充

最後補充上柴大的回覆:“不是效能問題,defer 最大的功能是 Panic 後依然有效。如果沒有 defer,Panic 後就會導致 unlock 丟失,從而導致死鎖了”,非常經典。

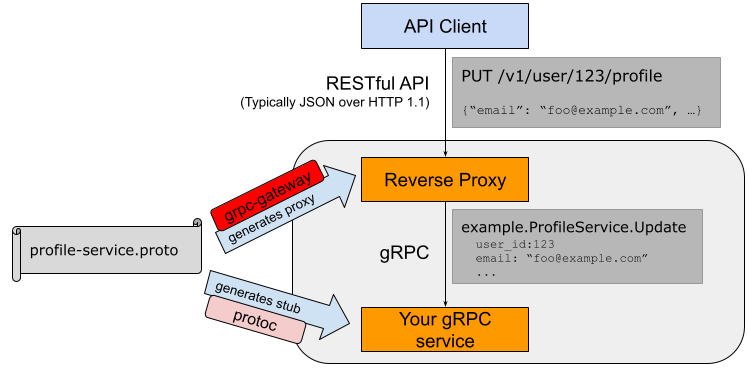

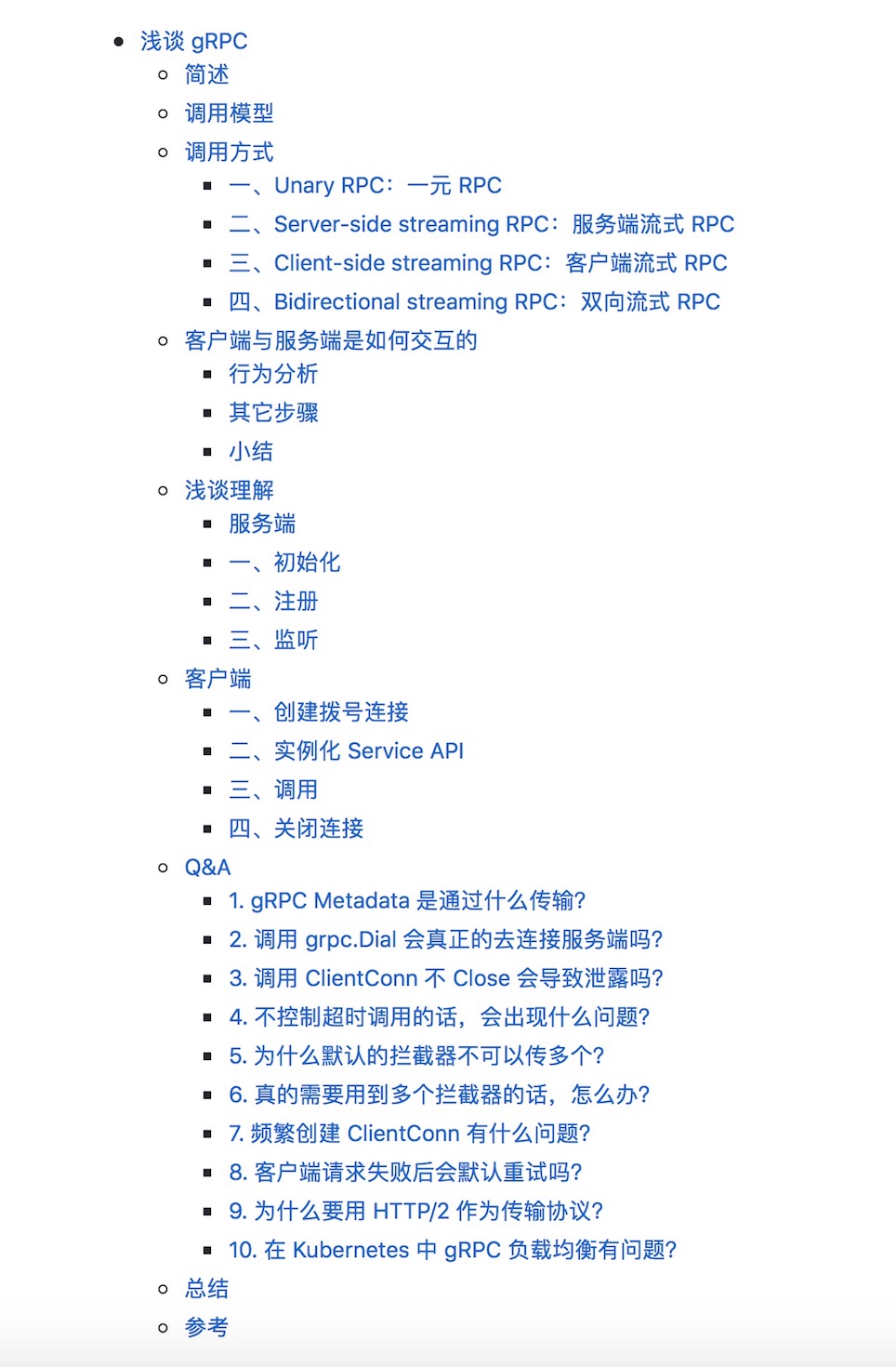

1.11 從實踐到原理,帶你參透 gRPC

gRPC 在 Go 語言中大放異彩,越來越多的小夥伴在使用,最近也在公司安利了一波,希望這一篇文章能帶你一覽 gRPC 的巧妙之處,本文篇幅比較長,請做好閱讀準備。本文目錄如下:

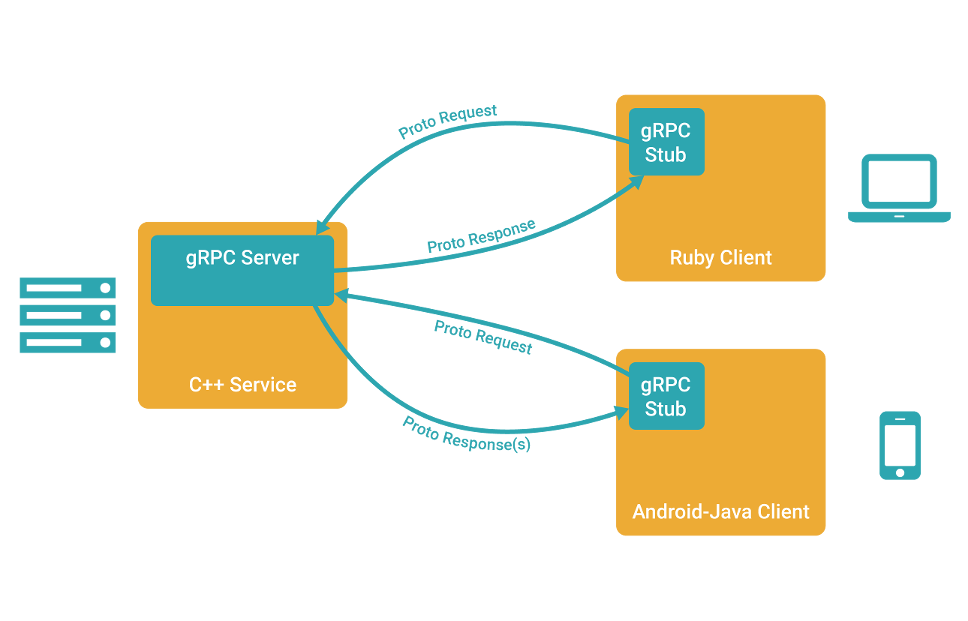

簡述

gRPC 是一個高效能、開源和通用的 RPC 框架,面向移動和 HTTP/2 設計。目前提供 C、Java 和 Go 語言版本,分別是:grpc, grpc-java, grpc-go. 其中 C 版本支援 C, C++, Node.js, Python, Ruby, Objective-C, PHP 和 C# 支援。

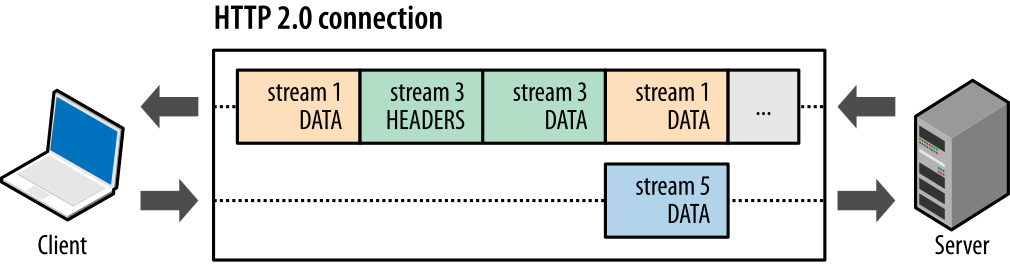

gRPC 基於 HTTP/2 標準設計,帶來諸如雙向流、流控、頭部壓縮、單 TCP 連線上的多複用請求等特性。這些特性使得其在移動裝置上表現更好,更省電和節省空間佔用。

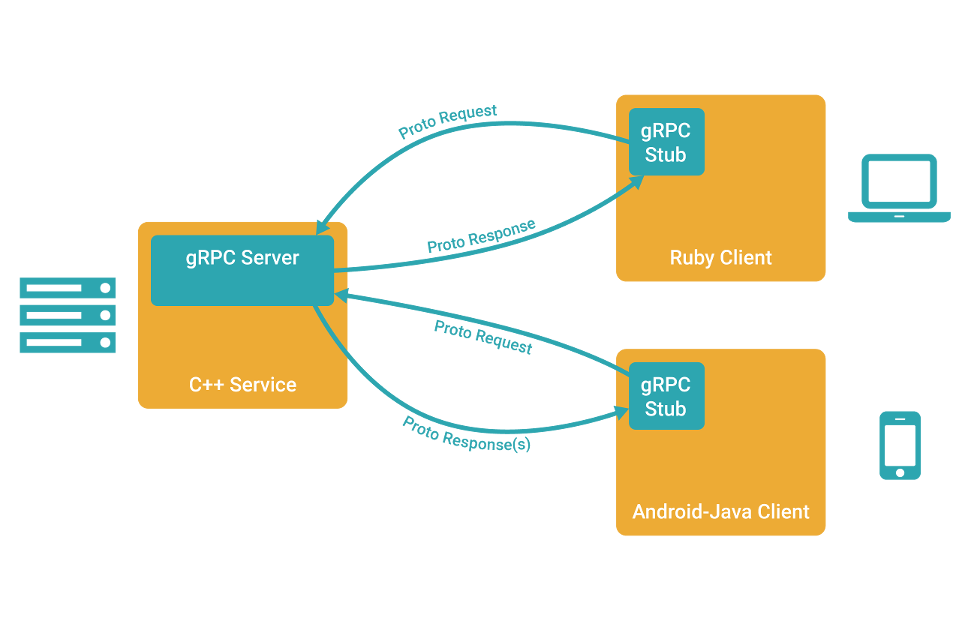

呼叫模型

1、客戶端(gRPC Stub)呼叫 A 方法,發起 RPC 呼叫。

2、對請求資訊使用 Protobuf 進行物件序列化壓縮(IDL)。

3、服務端(gRPC Server)接收到請求後,解碼請求體,進行業務邏輯處理並返回。

4、對響應結果使用 Protobuf 進行物件序列化壓縮(IDL)。

5、客戶端接受到服務端響應,解碼請求體。回撥被呼叫的 A 方法,喚醒正在等待響應(阻塞)的客戶端呼叫並返回響應結果。

呼叫方式

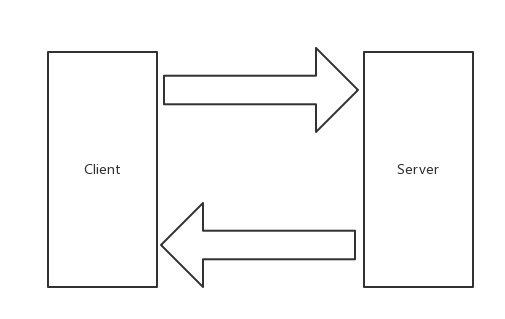

一、Unary RPC:一元 RPC

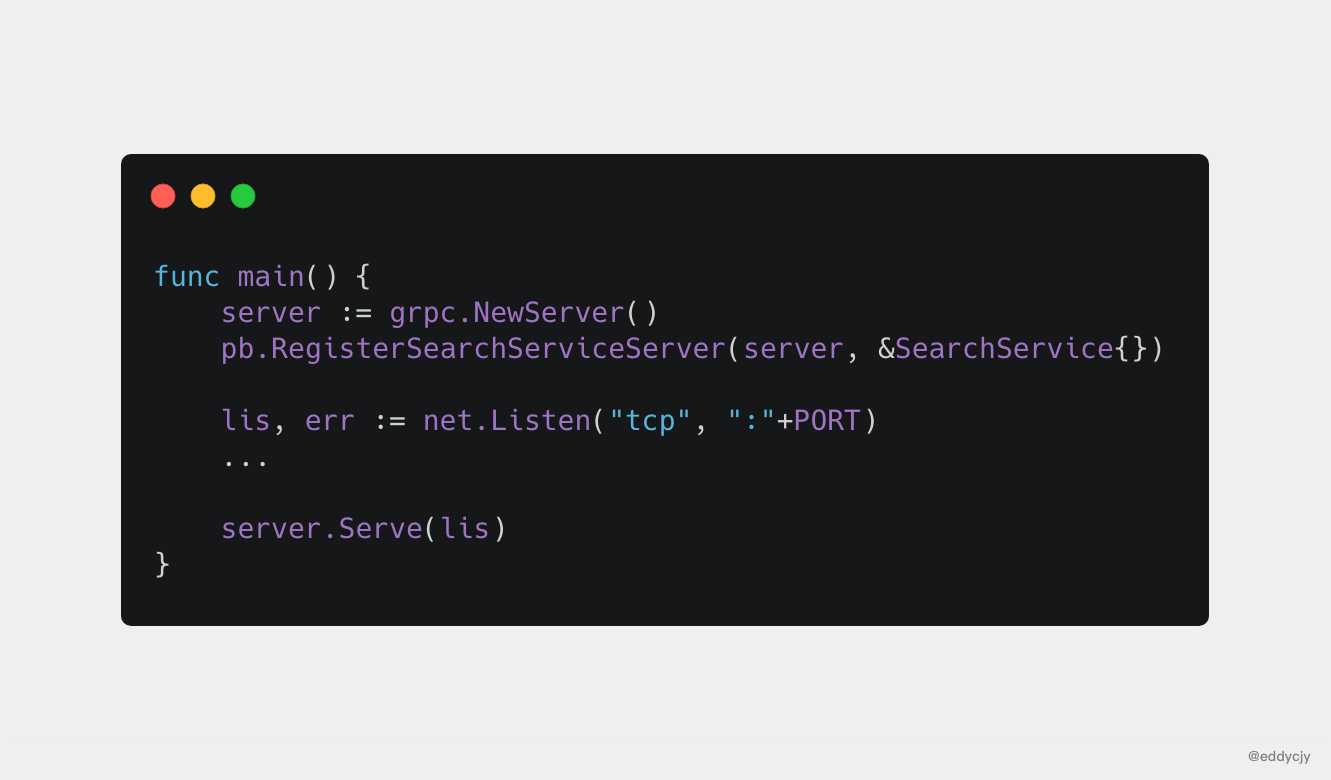

Server

type SearchService struct{}

func (s *SearchService) Search(ctx context.Context, r *pb.SearchRequest) (*pb.SearchResponse, error) {

return &pb.SearchResponse{Response: r.GetRequest() + " Server"}, nil

}

const PORT = "9001"

func main() {

server := grpc.NewServer()

pb.RegisterSearchServiceServer(server, &SearchService{})

lis, err := net.Listen("tcp", ":"+PORT)

...

server.Serve(lis)

}

- 建立 gRPC Server 物件,你可以理解為它是 Server 端的抽象物件。

- 將 SearchService(其包含需要被呼叫的服務端介面)註冊到 gRPC Server。 的內部註冊中心。這樣可以在接受到請求時,透過內部的 “服務發現”,發現該服務端介面並轉接進行邏輯處理。

- 建立 Listen,監聽 TCP 埠。

- gRPC Server 開始 lis.Accept,直到 Stop 或 GracefulStop。

Client

func main() {

conn, err := grpc.Dial(":"+PORT, grpc.WithInsecure())

...

defer conn.Close()

client := pb.NewSearchServiceClient(conn)

resp, err := client.Search(context.Background(), &pb.SearchRequest{

Request: "gRPC",

})

...

}

- 建立與給定目標(服務端)的連線控制代碼。

- 建立 SearchService 的客戶端物件。

- 傳送 RPC 請求,等待同步響應,得到回撥後返回響應結果。

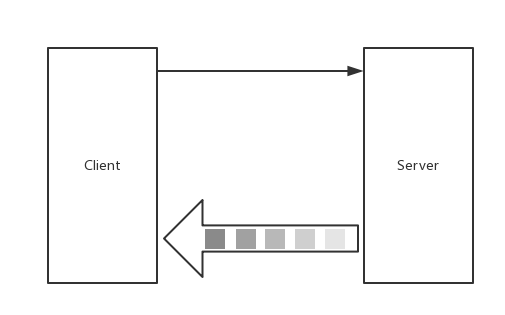

二、Server-side streaming RPC:服務端流式 RPC

Server

func (s *StreamService) List(r *pb.StreamRequest, stream pb.StreamService_ListServer) error {

for n := 0; n <= 6; n++ {

stream.Send(&pb.StreamResponse{

Pt: &pb.StreamPoint{

...

},

})

}

return nil

}

Client

func printLists(client pb.StreamServiceClient, r *pb.StreamRequest) error {

stream, err := client.List(context.Background(), r)

...

for {

resp, err := stream.Recv()

if err == io.EOF {

break

}

...

}

return nil

}

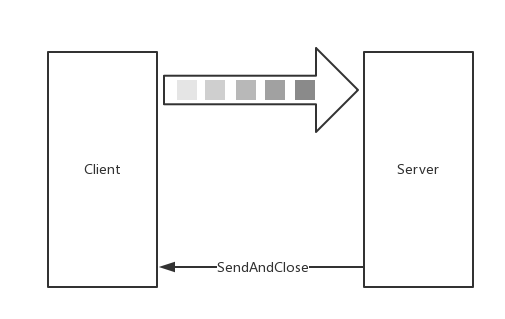

三、Client-side streaming RPC:客戶端流式 RPC

Server

func (s *StreamService) Record(stream pb.StreamService_RecordServer) error {

for {

r, err := stream.Recv()

if err == io.EOF {

return stream.SendAndClose(&pb.StreamResponse{Pt: &pb.StreamPoint{...}})

}

...

}

return nil

}

Client

func printRecord(client pb.StreamServiceClient, r *pb.StreamRequest) error {

stream, err := client.Record(context.Background())

...

for n := 0; n < 6; n++ {

stream.Send(r)

}

resp, err := stream.CloseAndRecv()

...

return nil

}

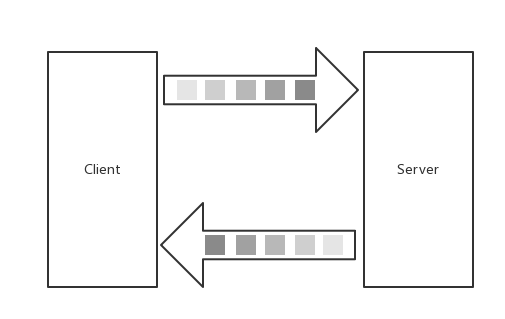

四、Bidirectional streaming RPC:雙向流式 RPC

Server

func (s *StreamService) Route(stream pb.StreamService_RouteServer) error {

for {

stream.Send(&pb.StreamResponse{...})

r, err := stream.Recv()

if err == io.EOF {

return nil

}

...

}

return nil

}

Client

func printRoute(client pb.StreamServiceClient, r *pb.StreamRequest) error {

stream, err := client.Route(context.Background())

...

for n := 0; n <= 6; n++ {

stream.Send(r)

resp, err := stream.Recv()

if err == io.EOF {

break

}

...

}

stream.CloseSend()

return nil

}

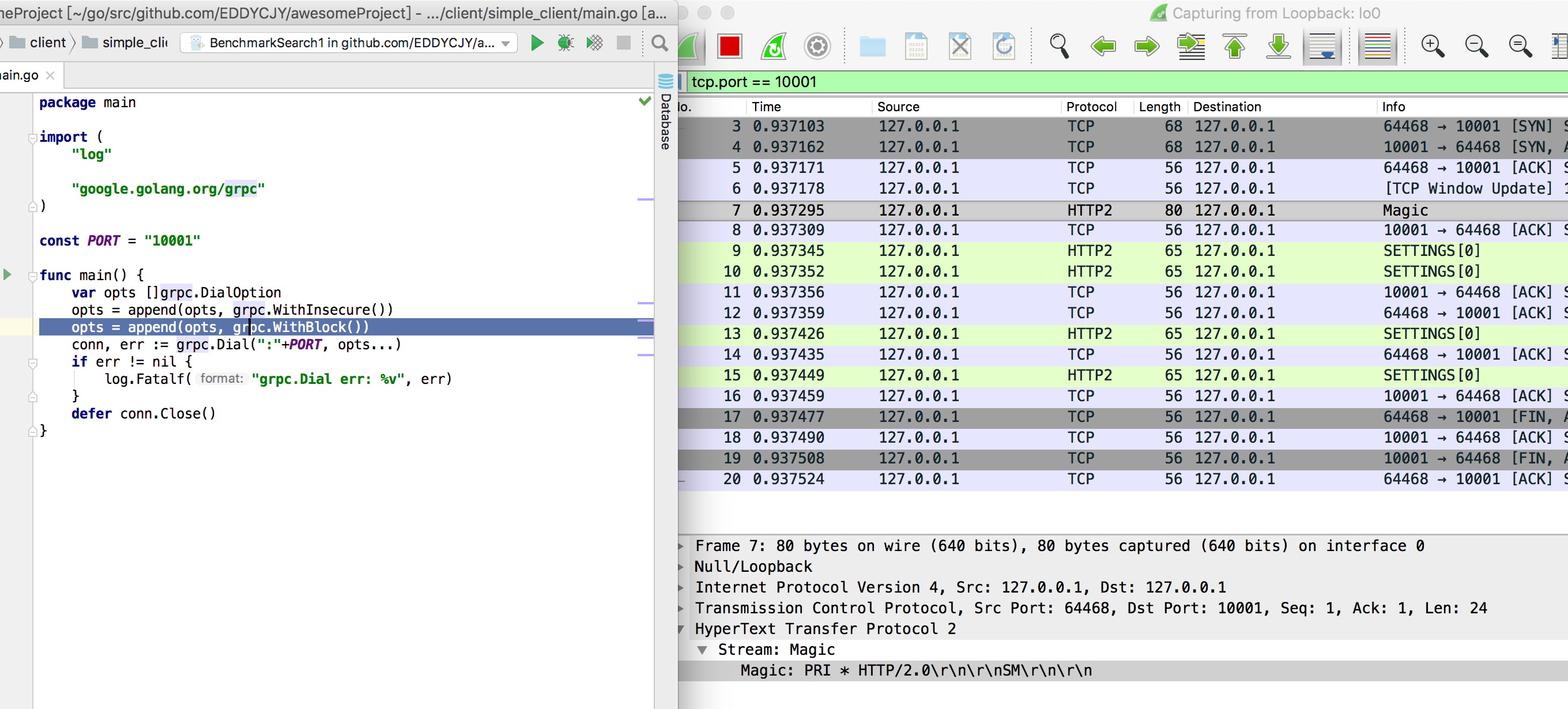

客戶端與服務端是如何互動的

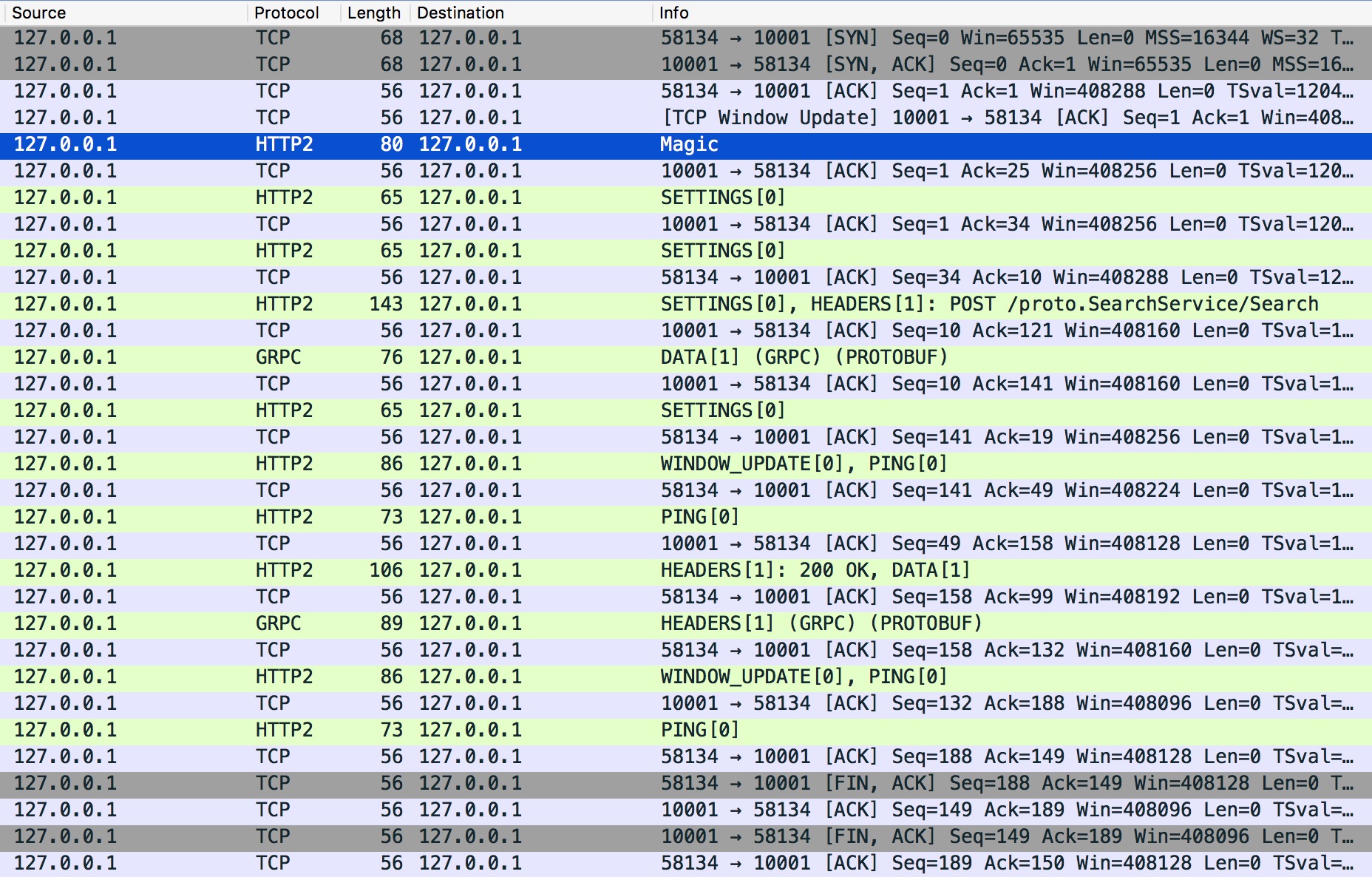

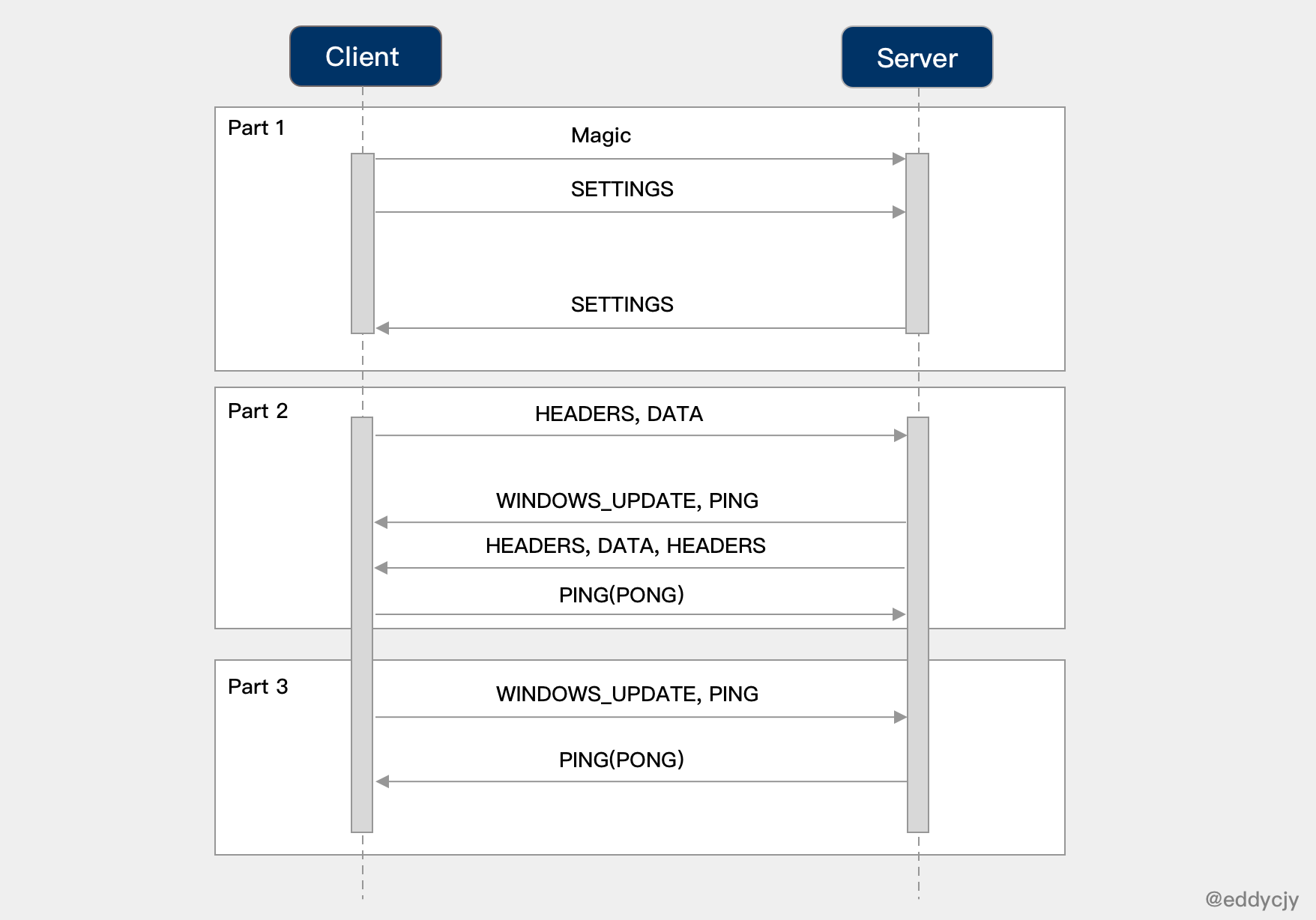

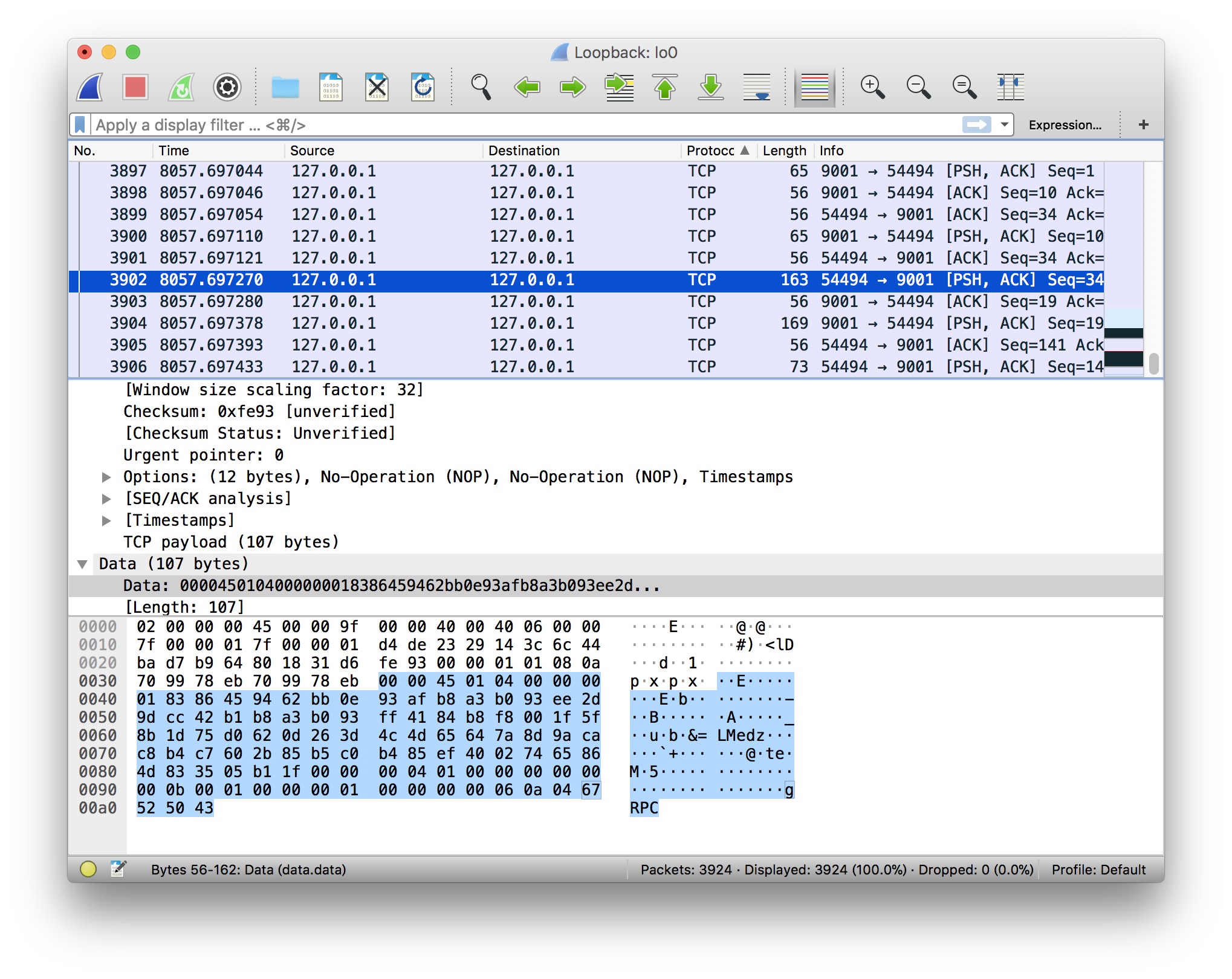

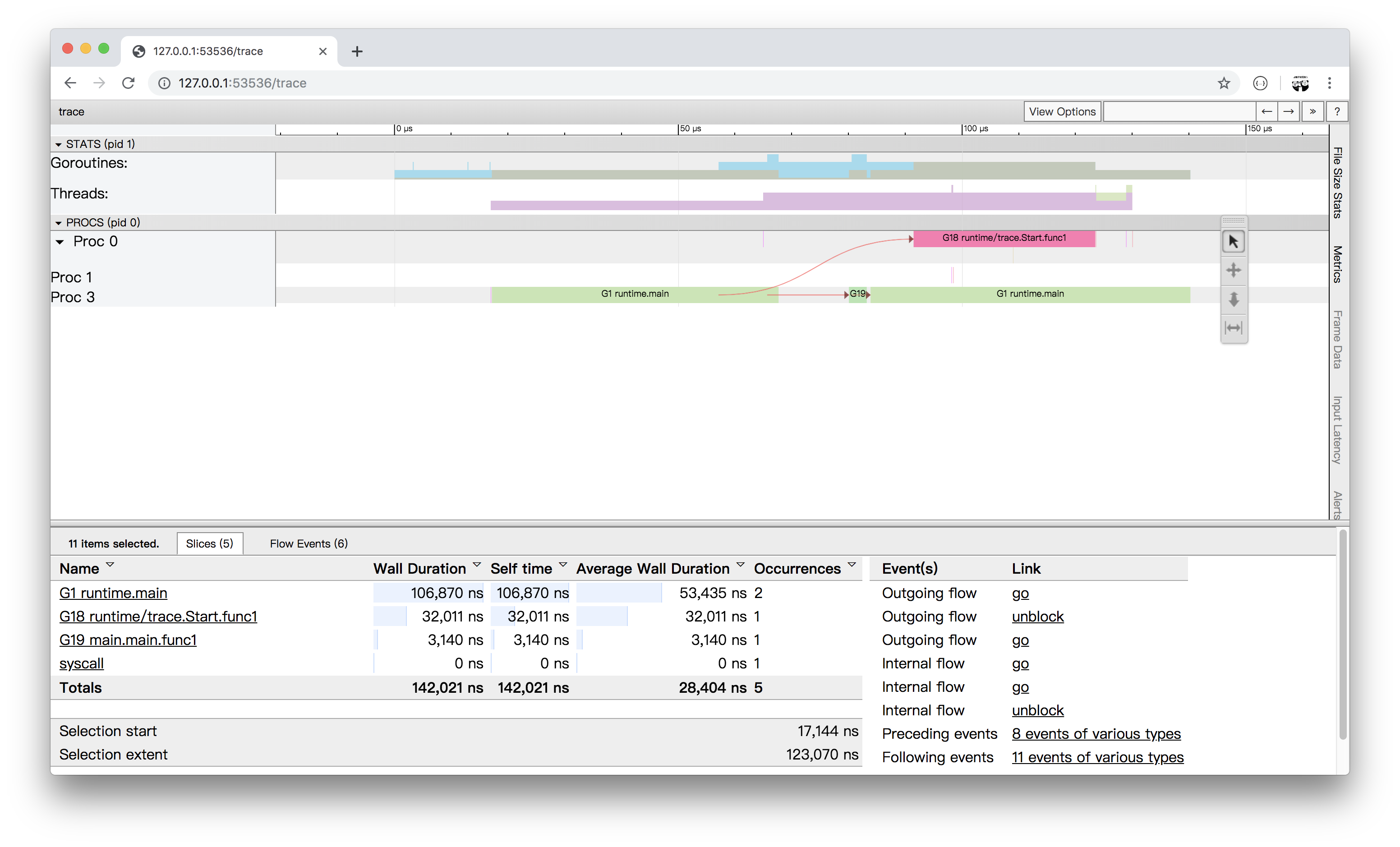

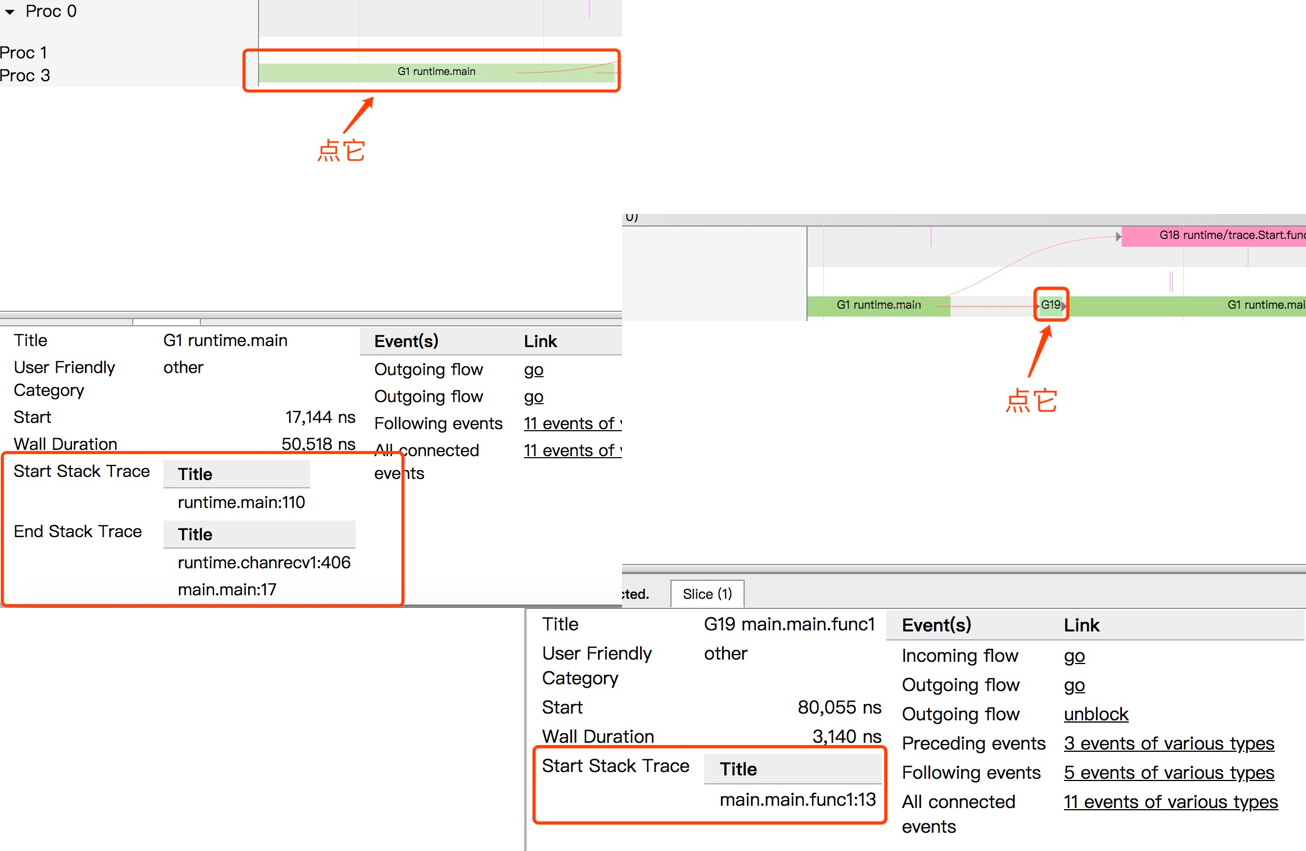

在開始分析之前,我們要先 gRPC 的呼叫有一個初始印象。那麼最簡單的就是對 Client 端呼叫 Server 端進行抓包去剖析,看看整個過程中它都做了些什麼事。如下圖:

- Magic

- SETTINGS

- HEADERS

- DATA

- SETTINGS

- WINDOW_UPDATE

- PING

- HEADERS

- DATA

- HEADERS

- WINDOW_UPDATE

- PING

我們略加整理發現共有十二個行為,是比較重要的。在開始分析之前,建議你自己先想一下,它們的作用都是什麼?大膽猜測一下,帶著疑問去學習效果更佳。

行為分析

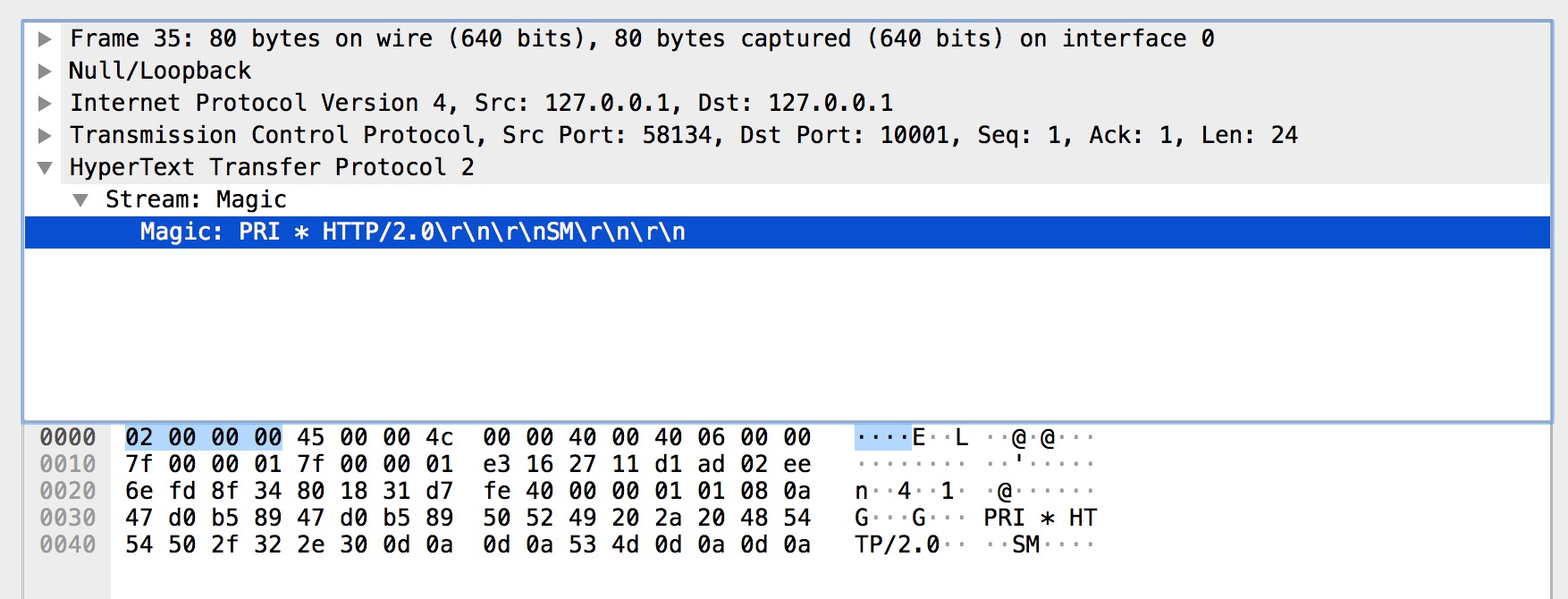

Magic

Magic 幀的主要作用是建立 HTTP/2 請求的前言。在 HTTP/2 中,要求兩端都要傳送一個連線前言,作為對所使用協議的最終確認,並確定 HTTP/2 連線的初始設定,客戶端和服務端各自發送不同的連線前言。

而上圖中的 Magic 幀是客戶端的前言之一,內容為 PRI * HTTP/2.0\r\n\r\nSM\r\n\r\n,以確定啟用 HTTP/2 連線。

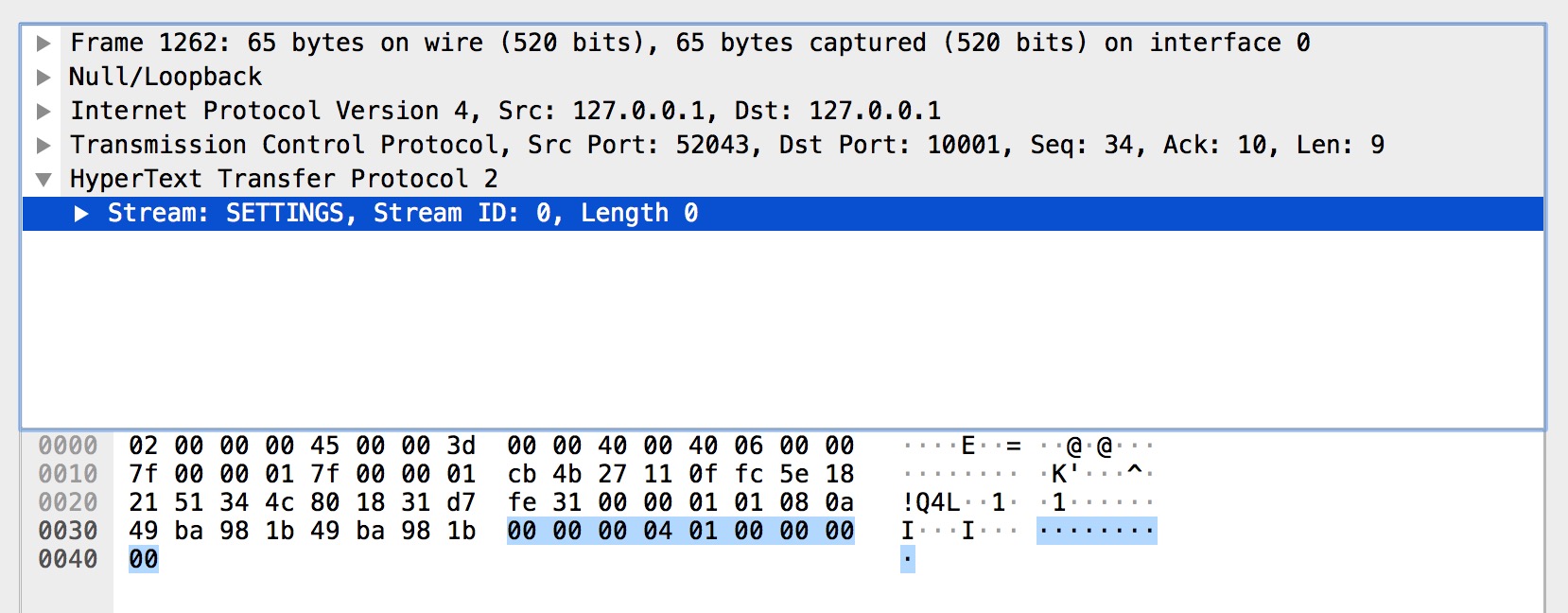

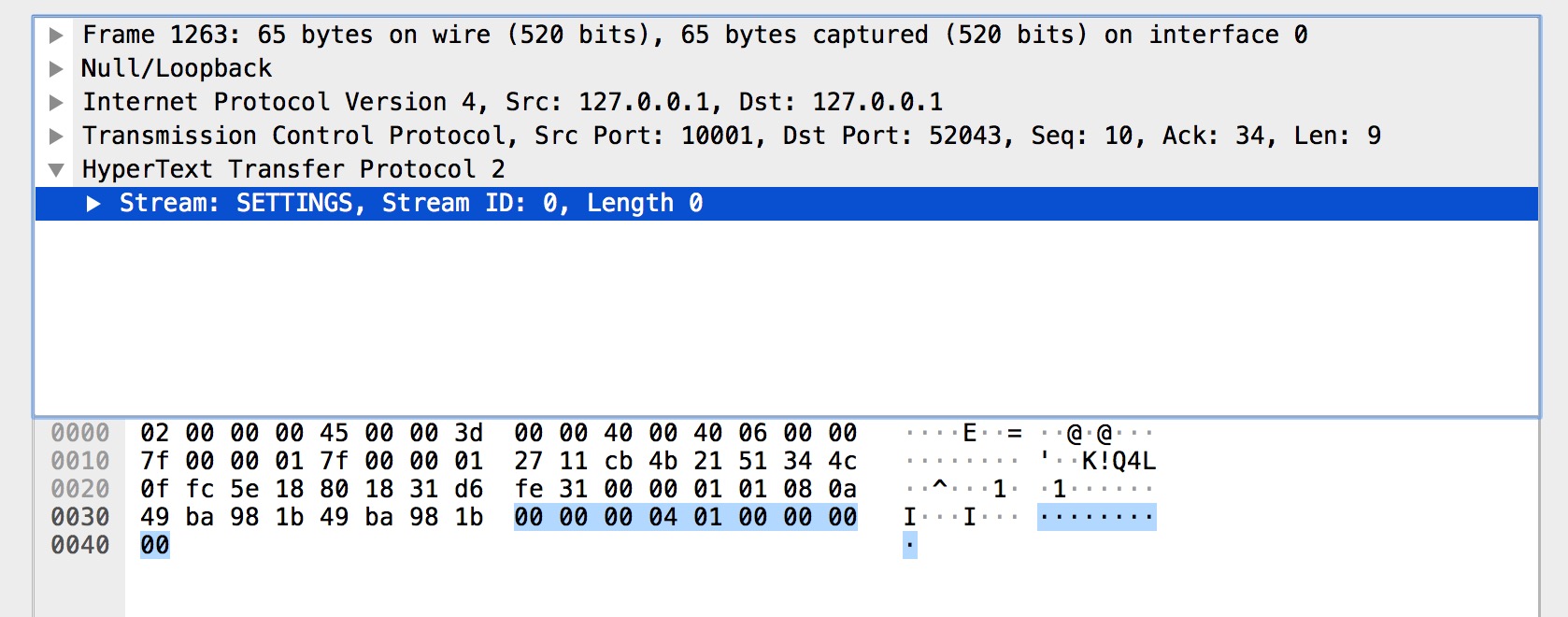

SETTINGS

SETTINGS 幀的主要作用是設定這一個連線的引數,作用域是整個連線而並非單一的流。

而上圖的 SETTINGS 幀都是空 SETTINGS 幀,圖一是客戶端連線的前言(Magic 和 SETTINGS 幀分別組成連線前言)。圖二是服務端的。另外我們從圖中可以看到多個 SETTINGS 幀,這是為什麼呢?是因為傳送完連線前言後,客戶端和服務端還需要有一步互動確認的動作。對應的就是帶有 ACK 標識 SETTINGS 幀。

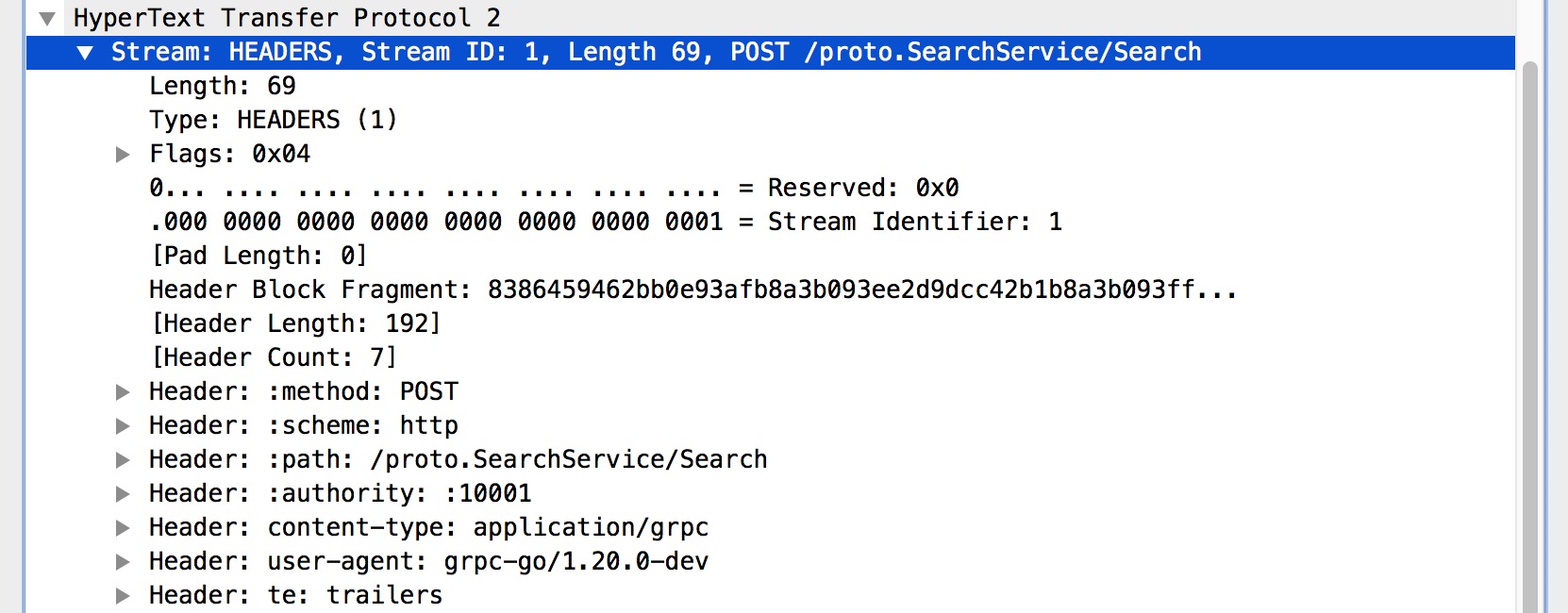

HEADERS

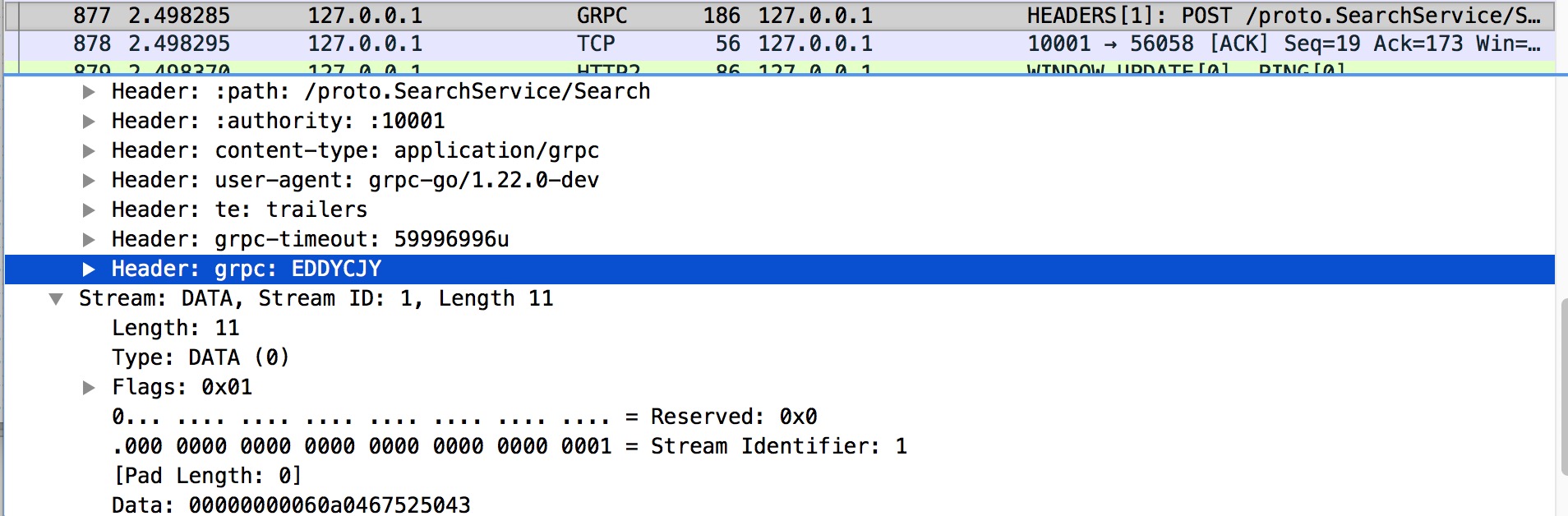

HEADERS 幀的主要作用是儲存和傳播 HTTP 的標頭資訊。我們關注到 HEADERS 裡有一些眼熟的資訊,分別如下:

- method:POST

- scheme:http

- path:/proto.SearchService/Search

- authority::10001

- content-type:application/grpc

- user-agent:grpc-go/1.20.0-dev

你會發現這些東西非常眼熟,其實都是 gRPC 的基礎屬性,實際上遠遠不止這些,只是設定了多少展示多少。例如像平時常見的 grpc-timeout、grpc-encoding 也是在這裡設定的。

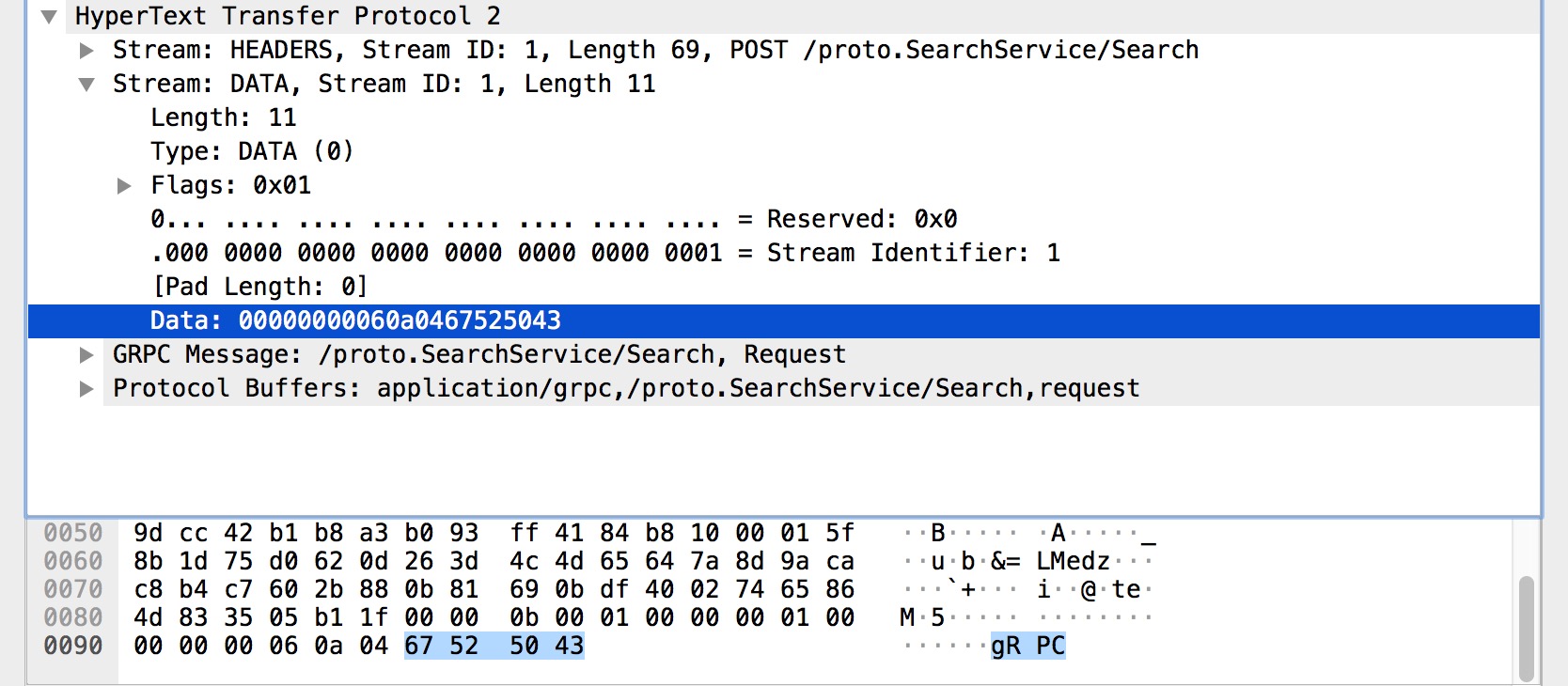

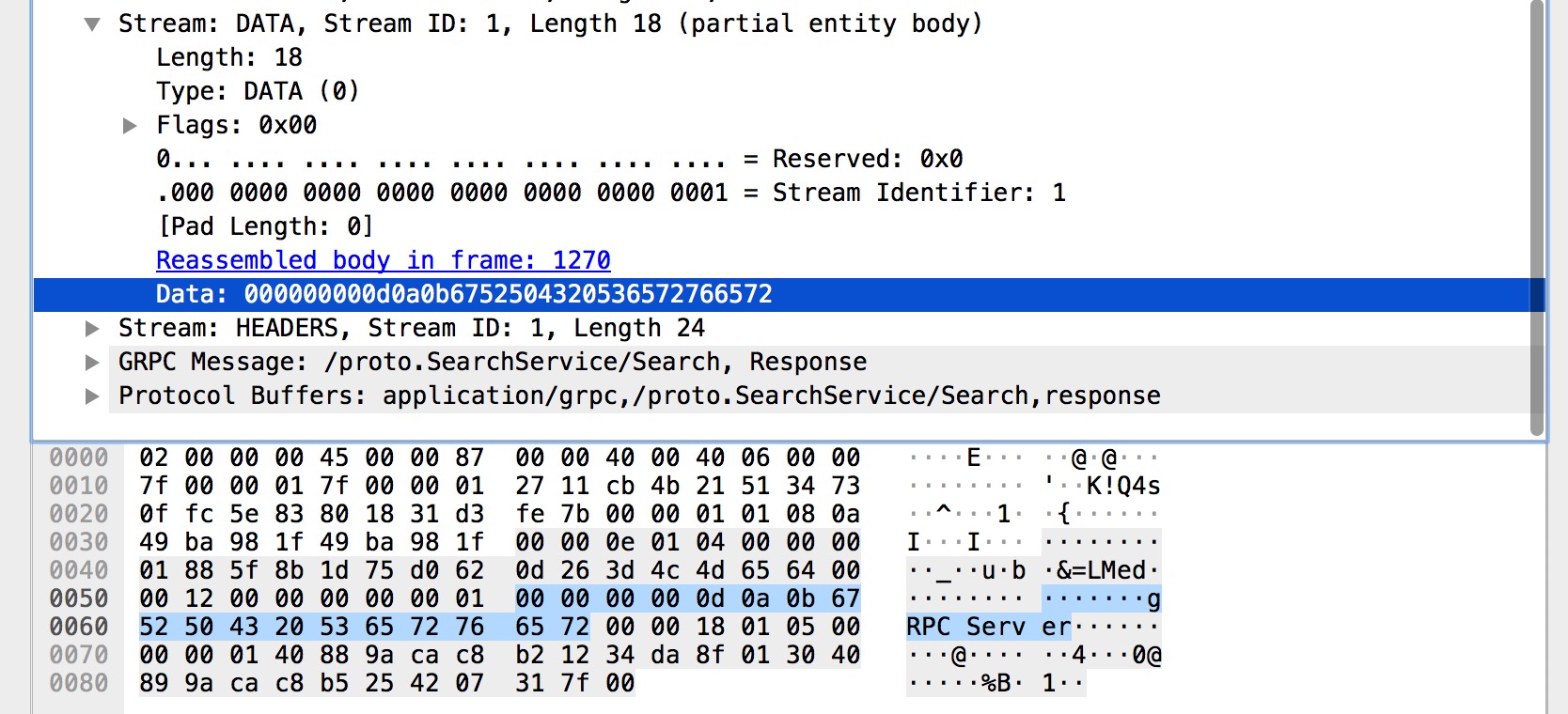

DATA

DATA 幀的主要作用是裝填主體資訊,是資料幀。而在上圖中,可以很明顯看到我們的請求引數 gRPC 儲存在裡面。只需要瞭解到這一點就可以了。

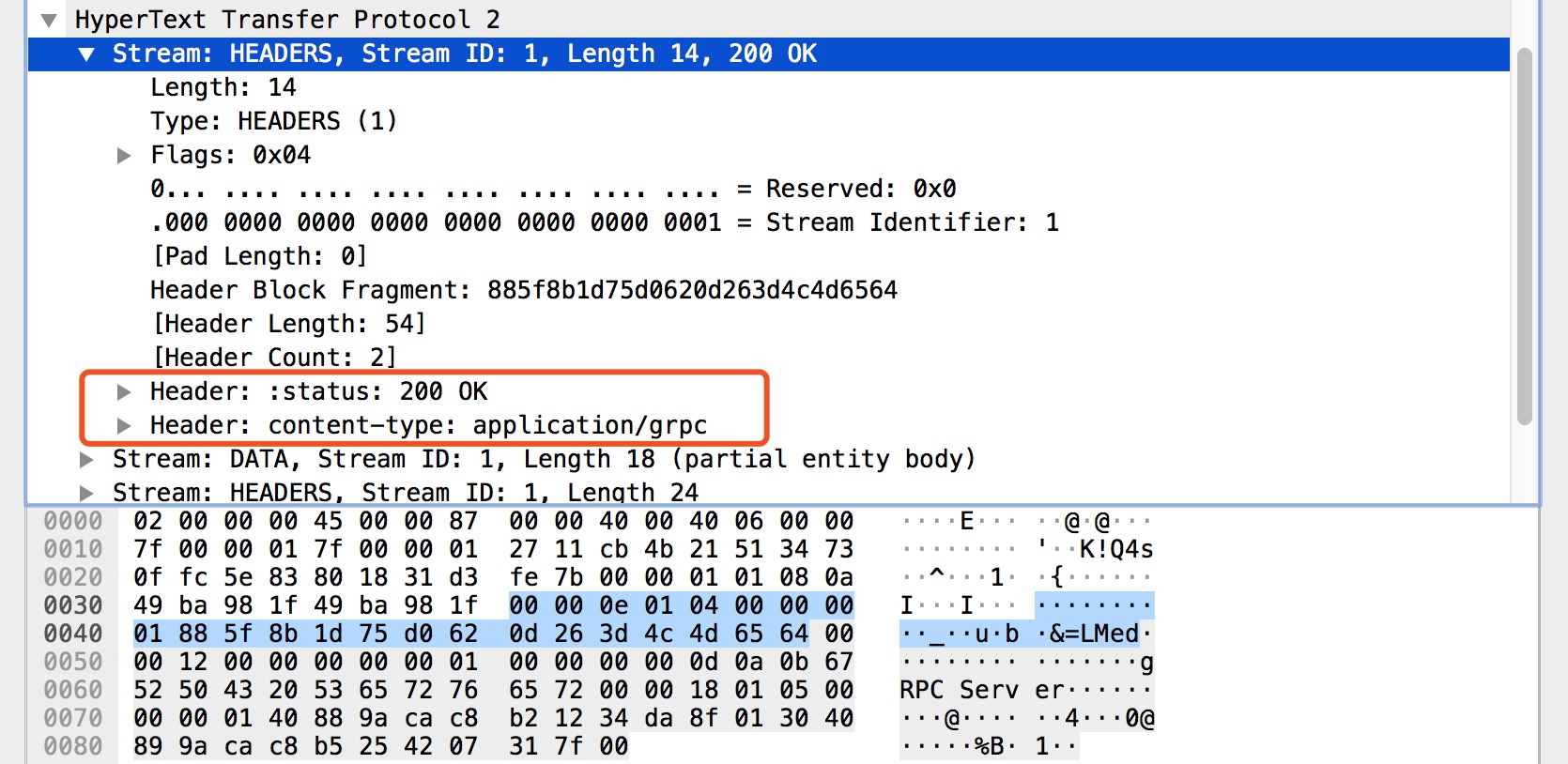

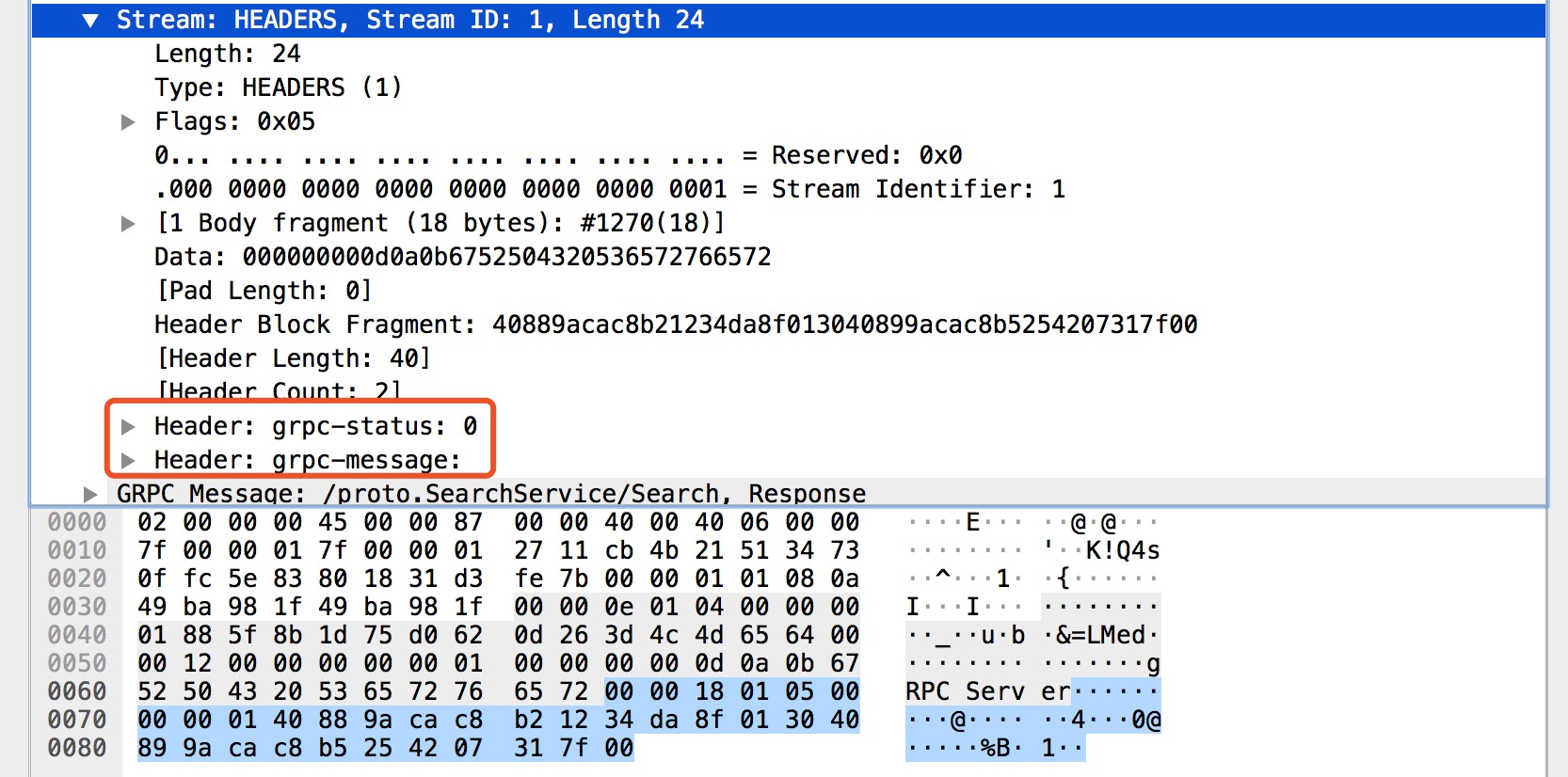

HEADERS, DATA, HEADERS

在上圖中 HEADERS 幀比較簡單,就是告訴我們 HTTP 響應狀態和響應的內容格式。

在上圖中 DATA 幀主要承載了響應結果的資料集,圖中的 gRPC Server 就是我們 RPC 方法的響應結果。

在上圖中 HEADERS 幀主要承載了 gRPC 狀態 和 gRPC 狀態訊息,圖中的 grpc-status 和 grpc-message 就是我們的 gRPC 呼叫狀態的結果。

其它步驟

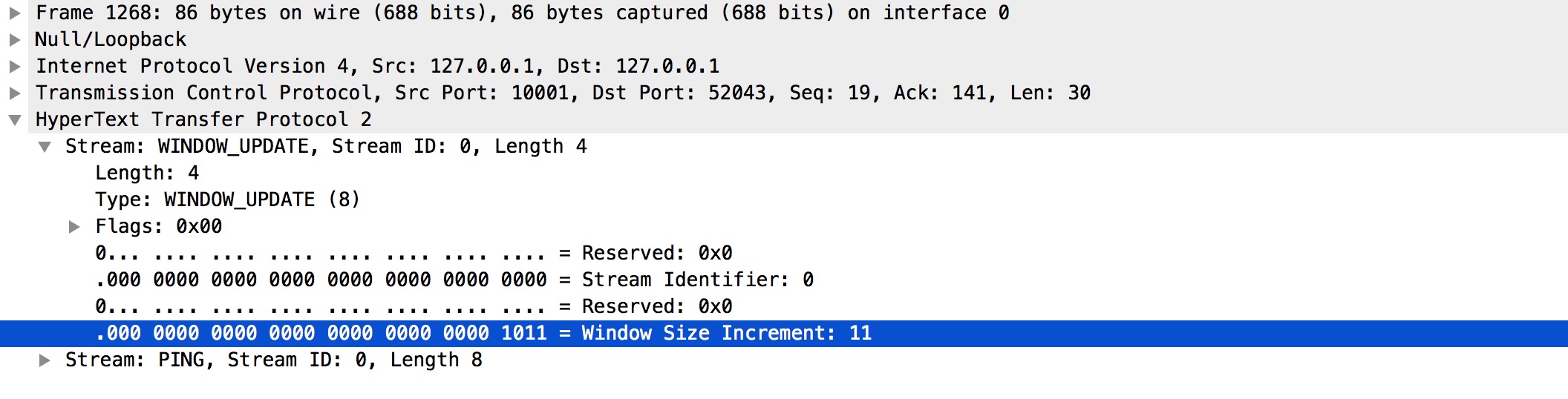

WINDOW_UPDATE

主要作用是管理和流的視窗控制。通常情況下開啟一個連線後,伺服器和客戶端會立即交換 SETTINGS 幀來確定流控制視窗的大小。預設情況下,該大小設定為約 65 KB,但可透過發出一個 WINDOW_UPDATE 幀為流控制設定不同的大小。

PING/PONG

主要作用是判斷當前連線是否仍然可用,也常用於計算往返時間。其實也就是 PING/PONG,大家對此應該很熟。

小結

- 在建立連線之前,客戶端/服務端都會發送連線前言(Magic+SETTINGS),確立協議和設定項。

- 在傳輸資料時,是會涉及滑動視窗(WINDOW_UPDATE)等流控策略的。

- 傳播 gRPC 附加資訊時,是基於 HEADERS 幀進行傳播和設定;而具體的請求/響應資料是儲存的 DATA 幀中的。

- 請求/響應結果會分為 HTTP 和 gRPC 狀態響應兩種型別。

- 客戶端發起 PING,服務端就會回應 PONG,反之亦可。

這塊 gRPC 的基礎使用,你可以看看我另外的 《gRPC 入門系列》,相信對你一定有幫助。

淺談理解

服務端

為什麼四行程式碼,就能夠起一個 gRPC Server,內部做了什麼邏輯。你有想過嗎?接下來我們一步步剖析,看看裡面到底是何方神聖。

一、初始化

// grpc.NewServer()

func NewServer(opt ...ServerOption) *Server {

opts := defaultServerOptions

for _, o := range opt {

o(&opts)

}

s := &Server{

lis: make(map[net.Listener]bool),

opts: opts,

conns: make(map[io.Closer]bool),

m: make(map[string]*service),

quit: make(chan struct{}),

done: make(chan struct{}),

czData: new(channelzData),

}

s.cv = sync.NewCond(&s.mu)

...

return s

}

這塊比較簡單,主要是例項 grpc.Server 並進行初始化動作。涉及如下:

- lis:監聽地址列表。

- opts:服務選項,這塊包含 Credentials、Interceptor 以及一些基礎設定。

- conns:客戶端連線控制代碼列表。

- m:服務資訊對映。

- quit:退出訊號。

- done:完成訊號。

- czData:用於儲存 ClientConn,addrConn 和 Server 的channelz 相關資料。

- cv:當優雅退出時,會等待這個訊號量,直到所有 RPC 請求都處理並斷開才會繼續處理。

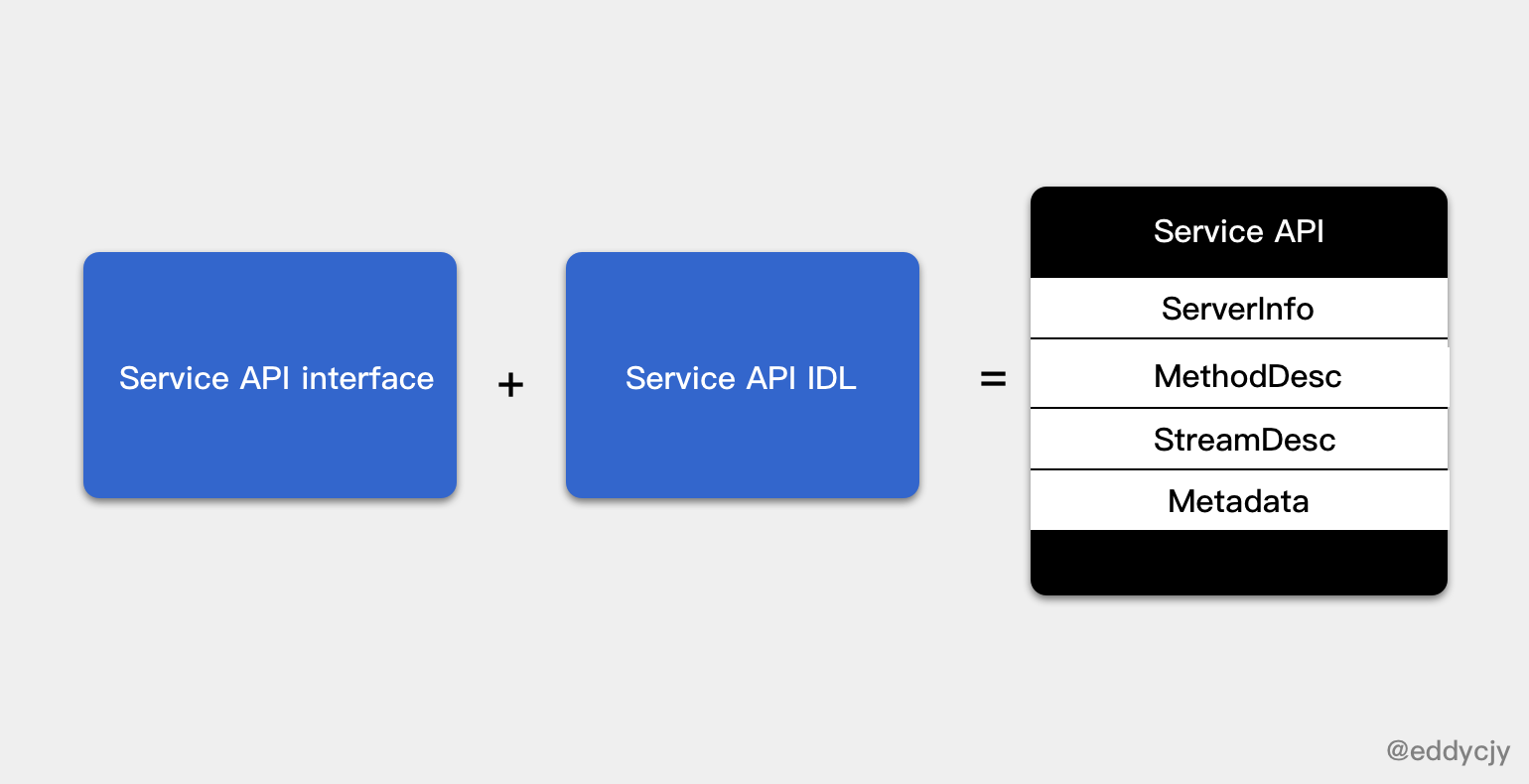

二、註冊

pb.RegisterSearchServiceServer(server, &SearchService{})

步驟一:Service API interface

// search.pb.go

type SearchServiceServer interface {

Search(context.Context, *SearchRequest) (*SearchResponse, error)

}

func RegisterSearchServiceServer(s *grpc.Server, srv SearchServiceServer) {

s.RegisterService(&_SearchService_serviceDesc, srv)

}

還記得我們平時編寫的 Protobuf 嗎?在生成出來的 .pb.go 檔案中,會定義出 Service APIs interface 的具體實作約束。而我們在 gRPC Server 進行註冊時,會傳入應用 Service 的功能介面實作,此時生成的 RegisterServer 方法就會保證兩者之間的一致性。

步驟二:Service API IDL

你想亂傳糊弄一下?不可能的,請乖乖定義與 Protobuf 一致的介面方法。但是那個 &_SearchService_serviceDesc 又有什麼作用呢?程式碼如下:

// search.pb.go

var _SearchService_serviceDesc = grpc.ServiceDesc{

ServiceName: "proto.SearchService",

HandlerType: (*SearchServiceServer)(nil),

Methods: []grpc.MethodDesc{

{

MethodName: "Search",

Handler: _SearchService_Search_Handler,

},

},

Streams: []grpc.StreamDesc{},

Metadata: "search.proto",

}

這看上去像服務的描述程式碼,用來向內部表述 “我” 都有什麼。涉及如下:

- ServiceName:服務名稱

- HandlerType:服務介面,用於檢查使用者提供的實作是否滿足介面要求

- Methods:一元方法集,注意結構內的

Handler方法,其對應最終的 RPC 處理方法,在執行 RPC 方法的階段會使用。 - Streams:流式方法集

- Metadata:元資料,是一個描述資料屬性的東西。在這裡主要是描述

SearchServiceServer服務

步驟三:Register Service

func (s *Server) register(sd *ServiceDesc, ss interface{}) {

...

srv := &service{

server: ss,

md: make(map[string]*MethodDesc),

sd: make(map[string]*StreamDesc),

mdata: sd.Metadata,

}

for i := range sd.Methods {

d := &sd.Methods[i]

srv.md[d.MethodName] = d

}

for i := range sd.Streams {

...

}

s.m[sd.ServiceName] = srv

}

在最後一步中,我們會將先前的服務介面資訊、服務描述資訊給註冊到內部 service 去,以便於後續實際呼叫的使用。涉及如下:

- server:服務的介面資訊

- md:一元服務的 RPC 方法集

- sd:流式服務的 RPC 方法集

- mdata:metadata,元資料

小結

在這一章節中,主要介紹的是 gRPC Server 在啟動前的整理和註冊行為,看上去很簡單,但其實一切都是為了後續的實際執行的預先準備。因此我們整理一下思路,將其串聯起來看看,如下:

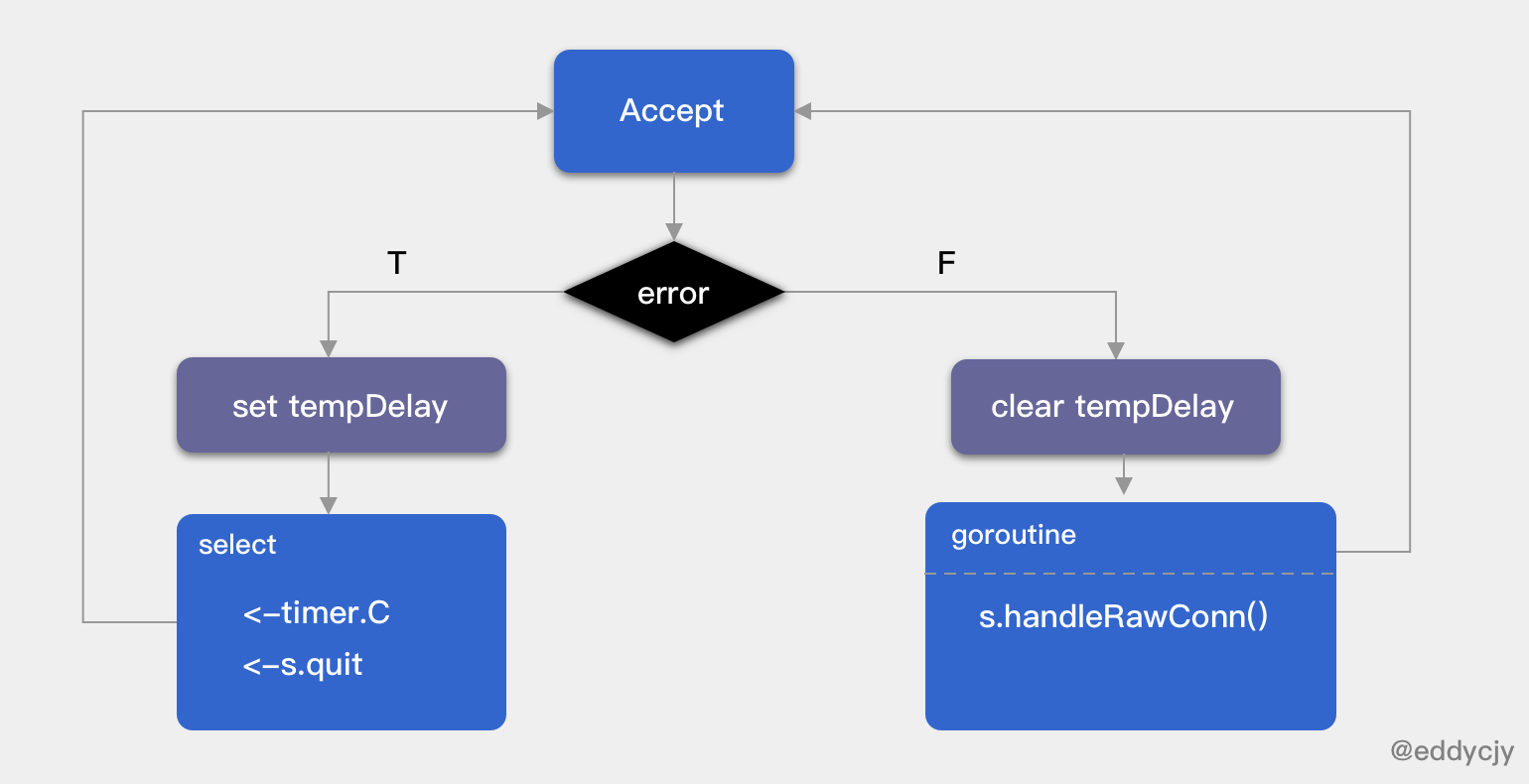

三、監聽

接下來到了整個流程中,最重要也是大家最關注的監聽/處理階段,核心程式碼如下:

func (s *Server) Serve(lis net.Listener) error {

...

var tempDelay time.Duration

for {

rawConn, err := lis.Accept()

if err != nil {

if ne, ok := err.(interface {

Temporary() bool

}); ok && ne.Temporary() {

if tempDelay == 0 {

tempDelay = 5 * time.Millisecond

} else {

tempDelay *= 2

}

if max := 1 * time.Second; tempDelay > max {

tempDelay = max

}

...

timer := time.NewTimer(tempDelay)

select {

case <-timer.C:

case <-s.quit:

timer.Stop()

return nil

}

continue

}

...

return err

}

tempDelay = 0

s.serveWG.Add(1)

go func() {

s.handleRawConn(rawConn)

s.serveWG.Done()

}()

}

}

Serve 會根據外部傳入的 Listener 不同而呼叫不同的監聽模式,這也是 net.Listener 的魅力,靈活性和擴充套件性會比較高。而在 gRPC Server 中最常用的就是 TCPConn,基於 TCP Listener 去做。接下來我們一起看看具體的處理邏輯,如下:

- 迴圈處理連線,透過

lis.Accept取出連線,如果佇列中沒有需處理的連線時,會形成阻塞等待。 - 若

lis.Accept失敗,則觸發休眠機制,若為第一次失敗那麼休眠 5ms,否則翻倍,再次失敗則不斷翻倍直至上限休眠時間 1s,而休眠完畢後就會嘗試去取下一個 “它”。 - 若

lis.Accept成功,則重置休眠的時間計數和啟動一個新的 goroutine 呼叫handleRawConn方法去執行/處理新的請求,也就是大家很喜歡說的 “每一個請求都是不同的 goroutine 在處理”。 - 在迴圈過程中,包含了 “退出” 服務的場景,主要是硬關閉和優雅重啟服務兩種情況。

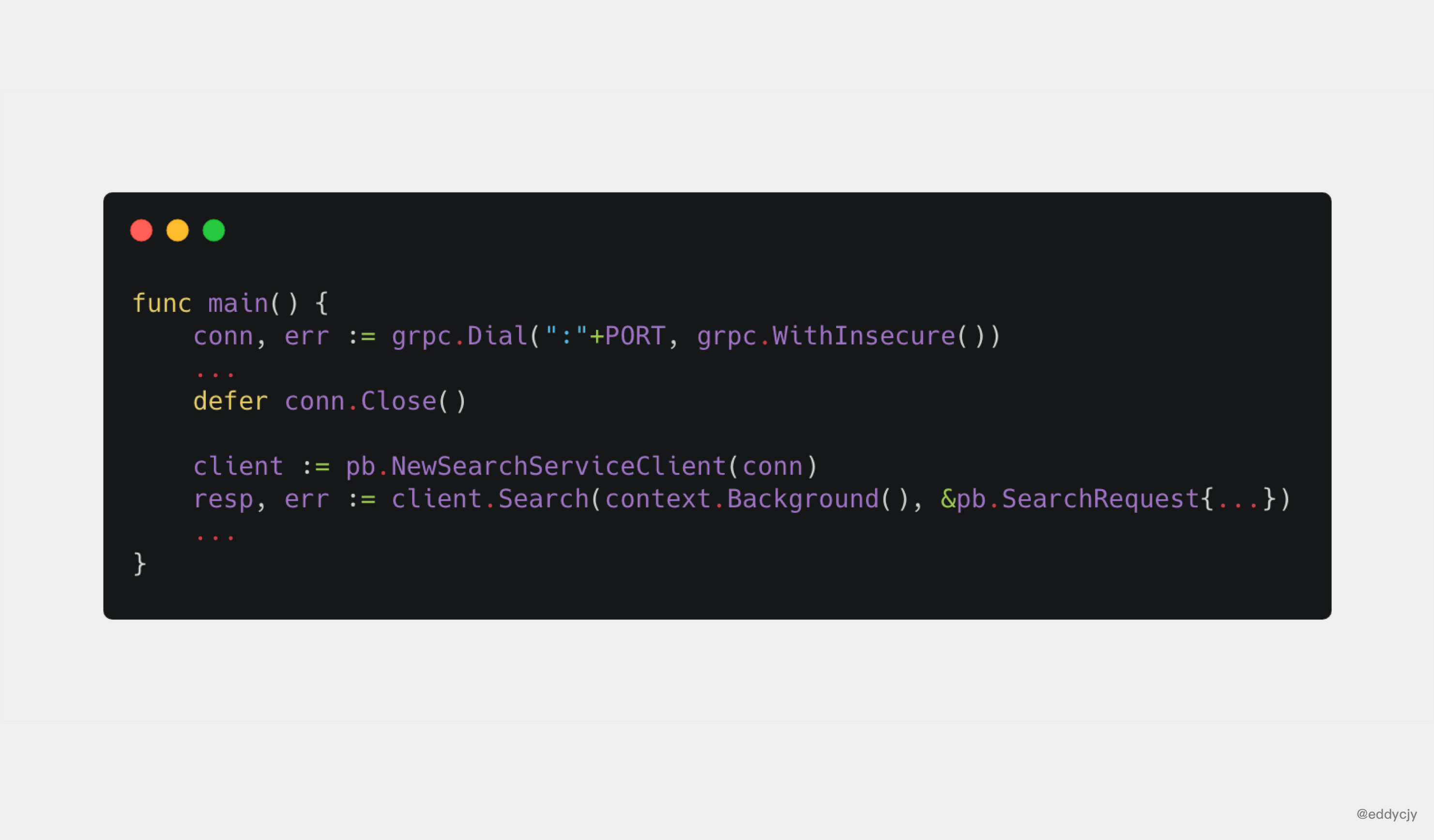

客戶端

一、建立撥號連線

// grpc.Dial(":"+PORT, grpc.WithInsecure())

func DialContext(ctx context.Context, target string, opts ...DialOption) (conn *ClientConn, err error) {

cc := &ClientConn{

target: target,

csMgr: &connectivityStateManager{},

conns: make(map[*addrConn]struct{}),

dopts: defaultDialOptions(),

blockingpicker: newPickerWrapper(),

czData: new(channelzData),

firstResolveEvent: grpcsync.NewEvent(),

}

...

chainUnaryClientInterceptors(cc)

chainStreamClientInterceptors(cc)

...

}

grpc.Dial 方法實際上是對於 grpc.DialContext 的封裝,區別在於 ctx 是直接傳入 context.Background。其主要功能是建立與給定目標的客戶端連線,其承擔了以下職責:

- 初始化 ClientConn

- 初始化(基於程序 LB)負載均衡設定

- 初始化 channelz

- 初始化重試規則和客戶端一元/流式攔截器

- 初始化協議棧上的基礎資訊

- 相關 context 的超時控制

- 初始化並解析地址資訊

- 建立與服務端之間的連線

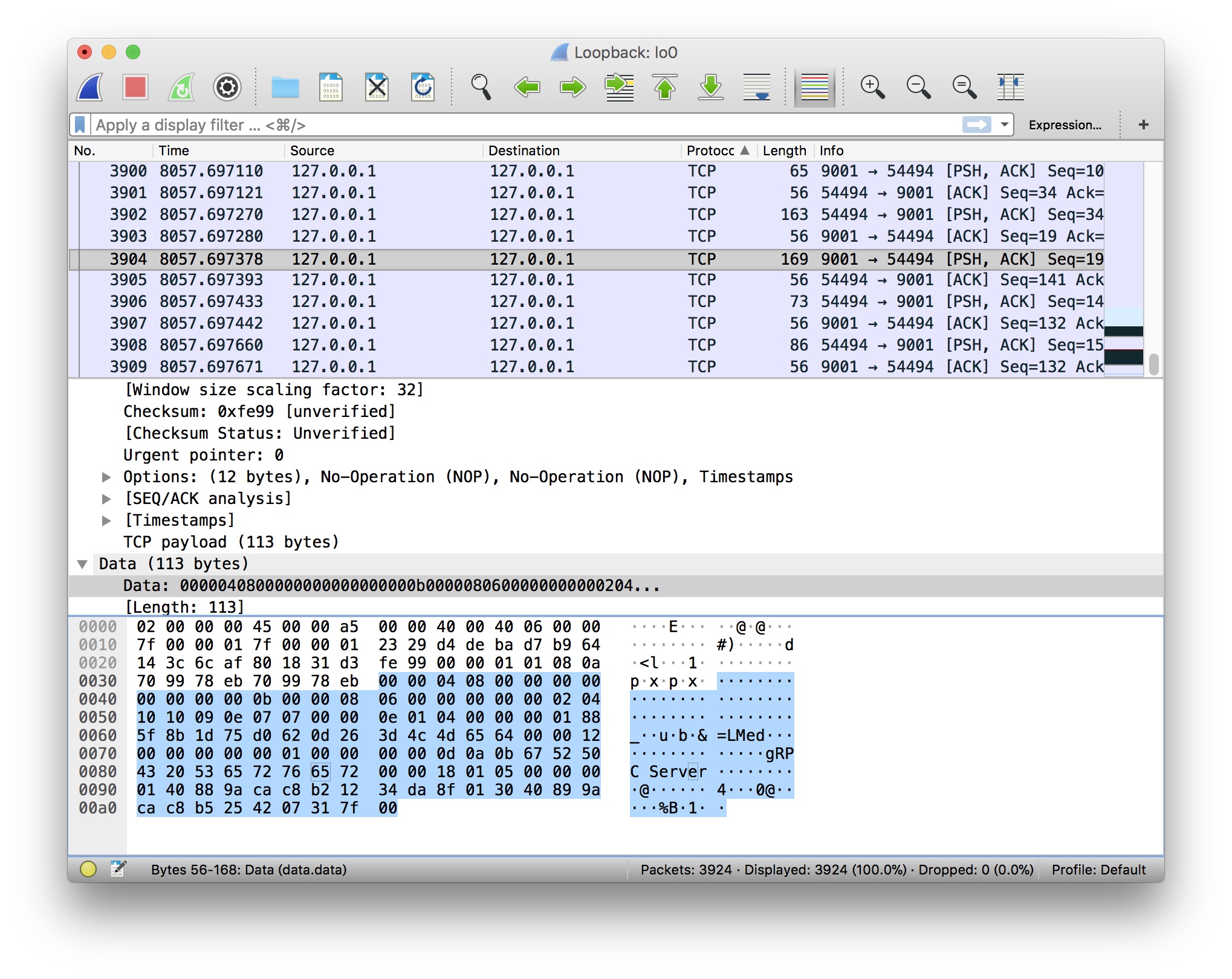

連沒連

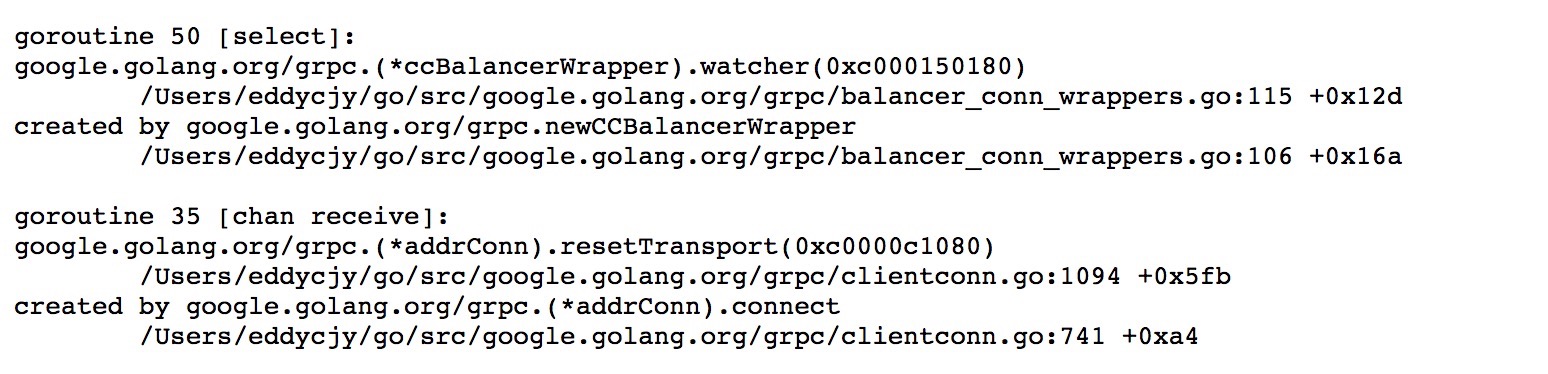

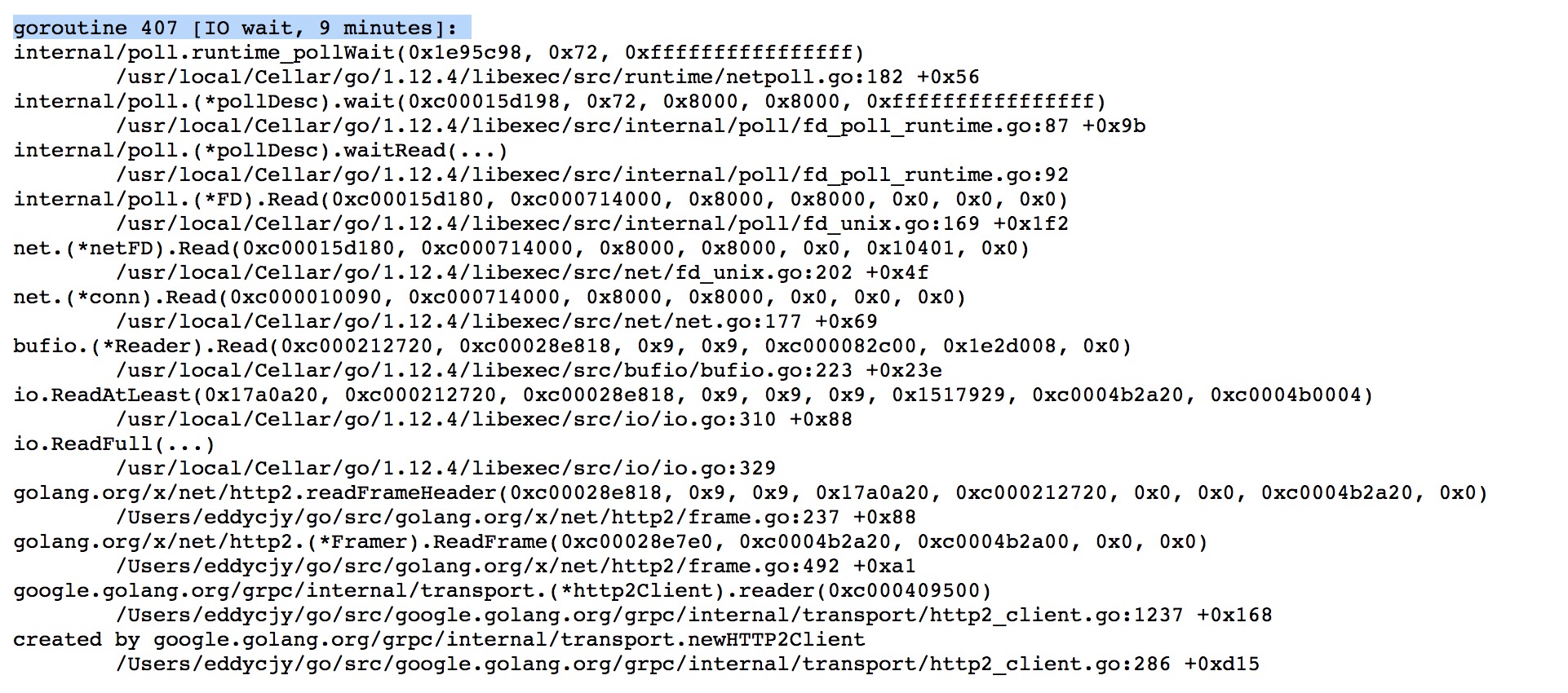

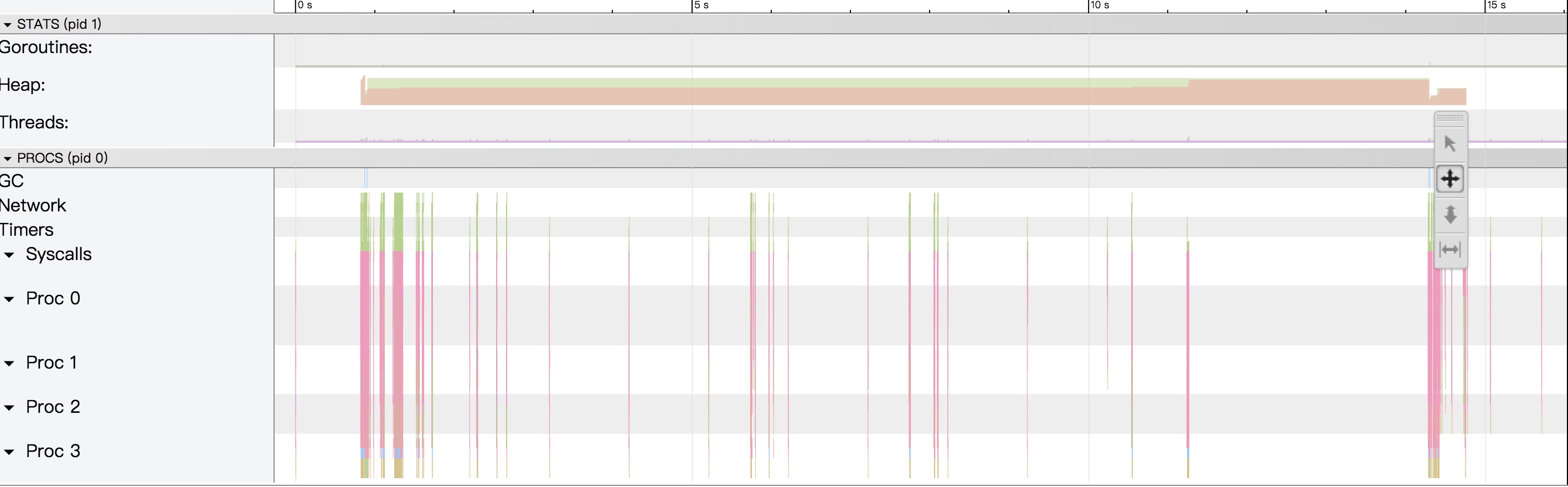

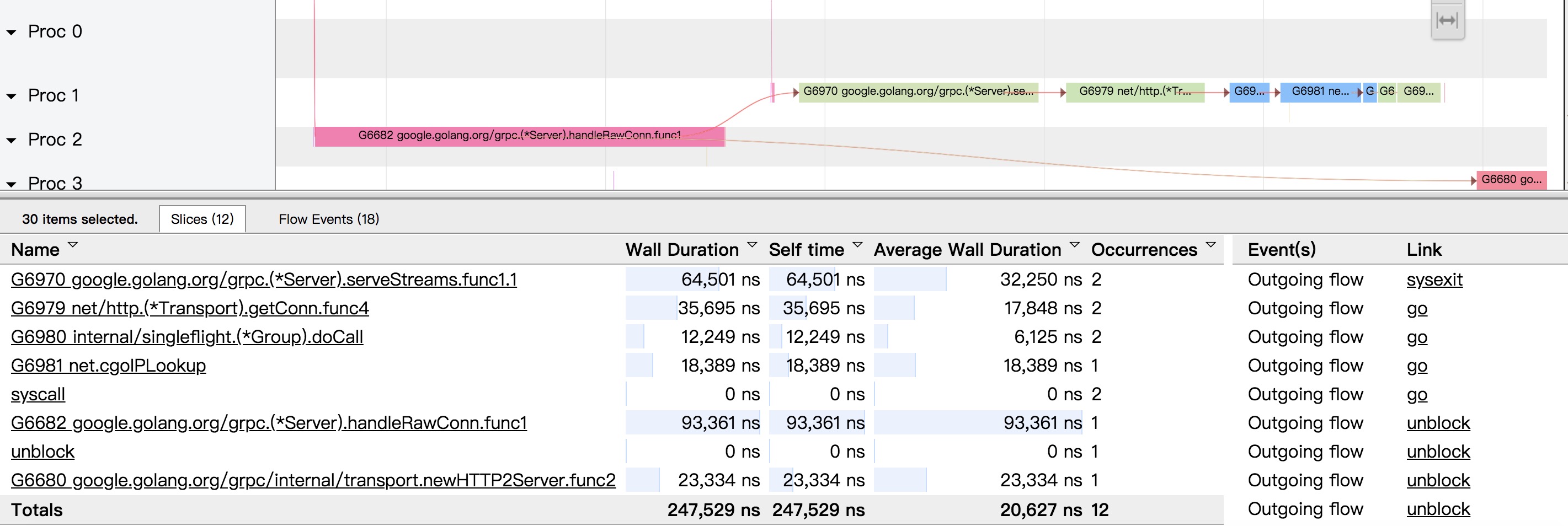

之前聽到有的人說呼叫 grpc.Dial 後客戶端就已經與服務端建立起了連線,但這對不對呢?我們先鳥瞰全貌,看看正在跑的 goroutine。如下:

我們可以有幾個核心方法一直在等待/處理訊號,透過分析底層原始碼可得知。涉及如下:

func (ac *addrConn) connect()

func (ac *addrConn) resetTransport()

func (ac *addrConn) createTransport(addr resolver.Address, copts transport.ConnectOptions, connectDeadline time.Time)

func (ac *addrConn) getReadyTransport()

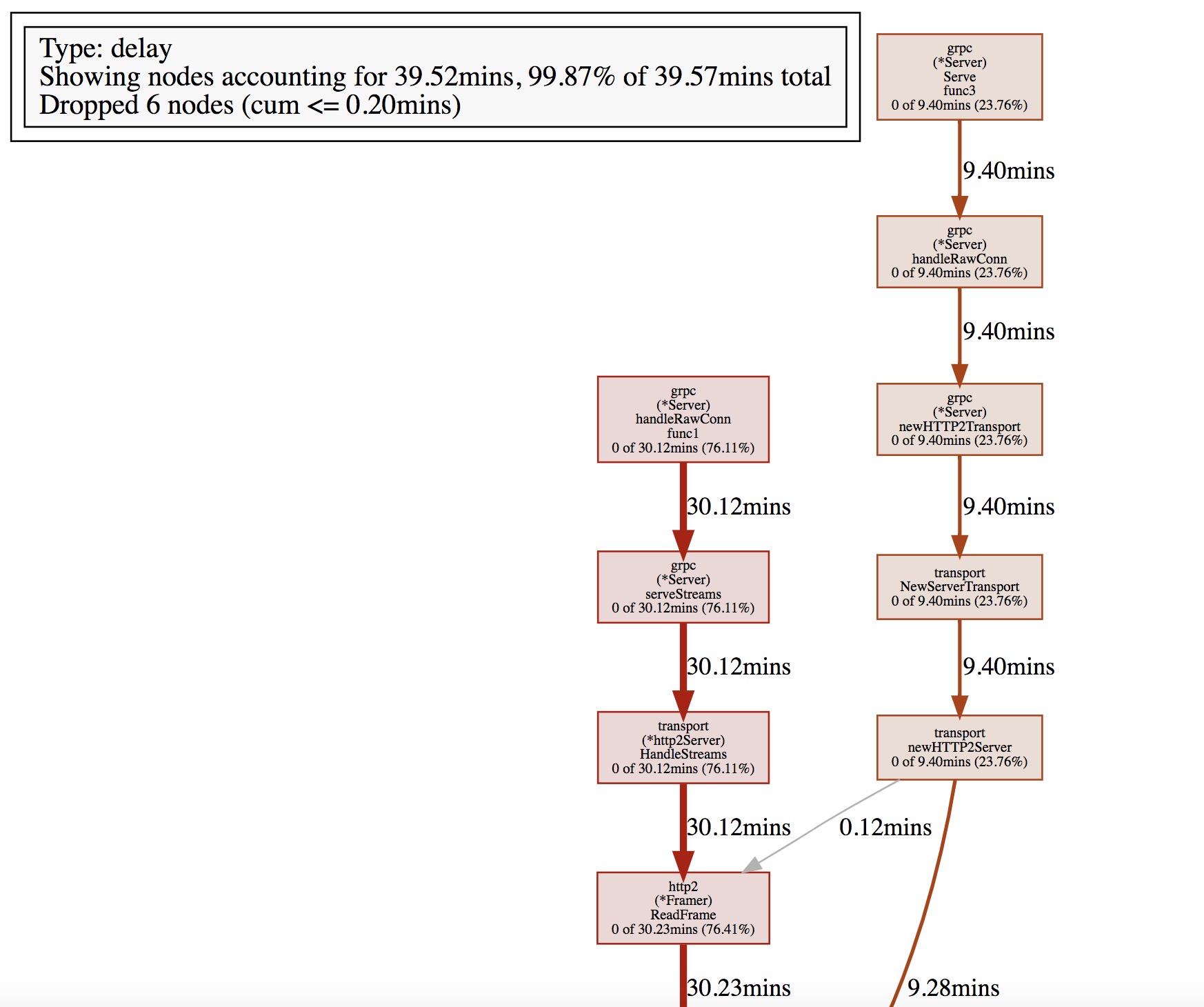

在這裡主要分析 goroutine 提示的 resetTransport 方法,看看都做了啥。核心程式碼如下:

func (ac *addrConn) resetTransport() {

for i := 0; ; i++ {

if ac.state == connectivity.Shutdown {

return

}

...

connectDeadline := time.Now().Add(dialDuration)

ac.updateConnectivityState(connectivity.Connecting)

newTr, addr, reconnect, err := ac.tryAllAddrs(addrs, connectDeadline)

if err != nil {

if ac.state == connectivity.Shutdown {

return

}

ac.updateConnectivityState(connectivity.TransientFailure)

timer := time.NewTimer(backoffFor)

select {

case <-timer.C:

...

}

continue

}

if ac.state == connectivity.Shutdown {

newTr.Close()

return

}

...

if !healthcheckManagingState {

ac.updateConnectivityState(connectivity.Ready)

}

...

if ac.state == connectivity.Shutdown {

return

}

ac.updateConnectivityState(connectivity.TransientFailure)

}

}

在該方法中會不斷地去嘗試建立連線,若成功則結束。否則不斷地根據 Backoff 演算法的重試機制去嘗試建立連線,直到成功為止。從結論上來講,單純呼叫 DialContext 是非同步建立連線的,也就是並不是馬上生效,處於 Connecting 狀態,而正式下要到達 Ready 狀態才可用。

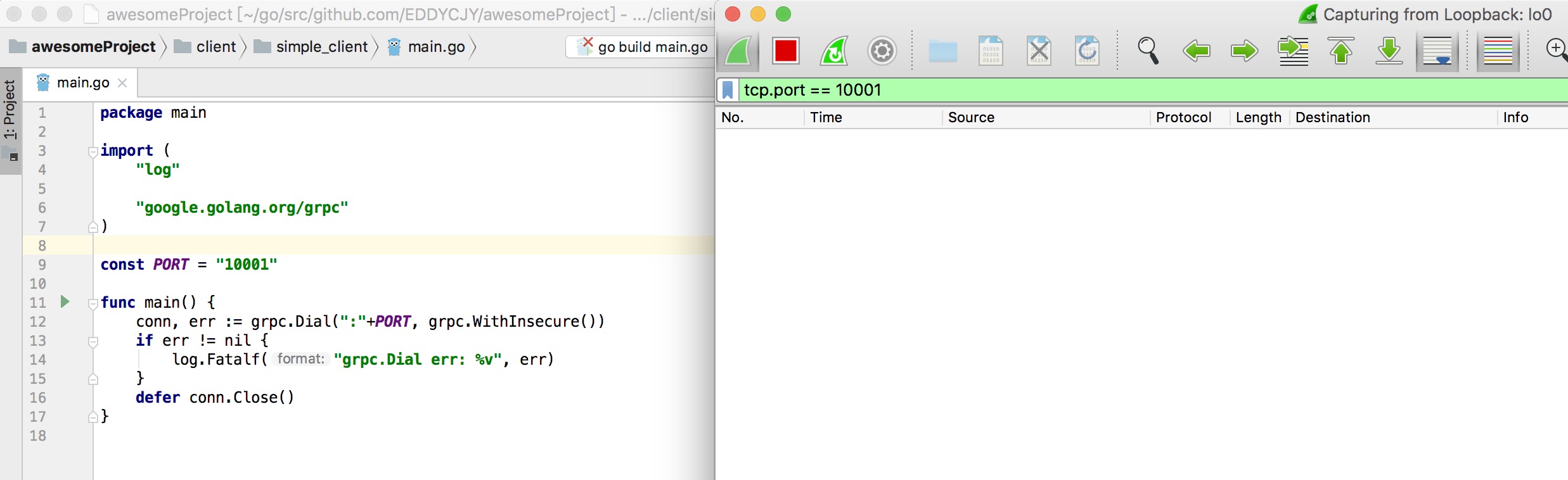

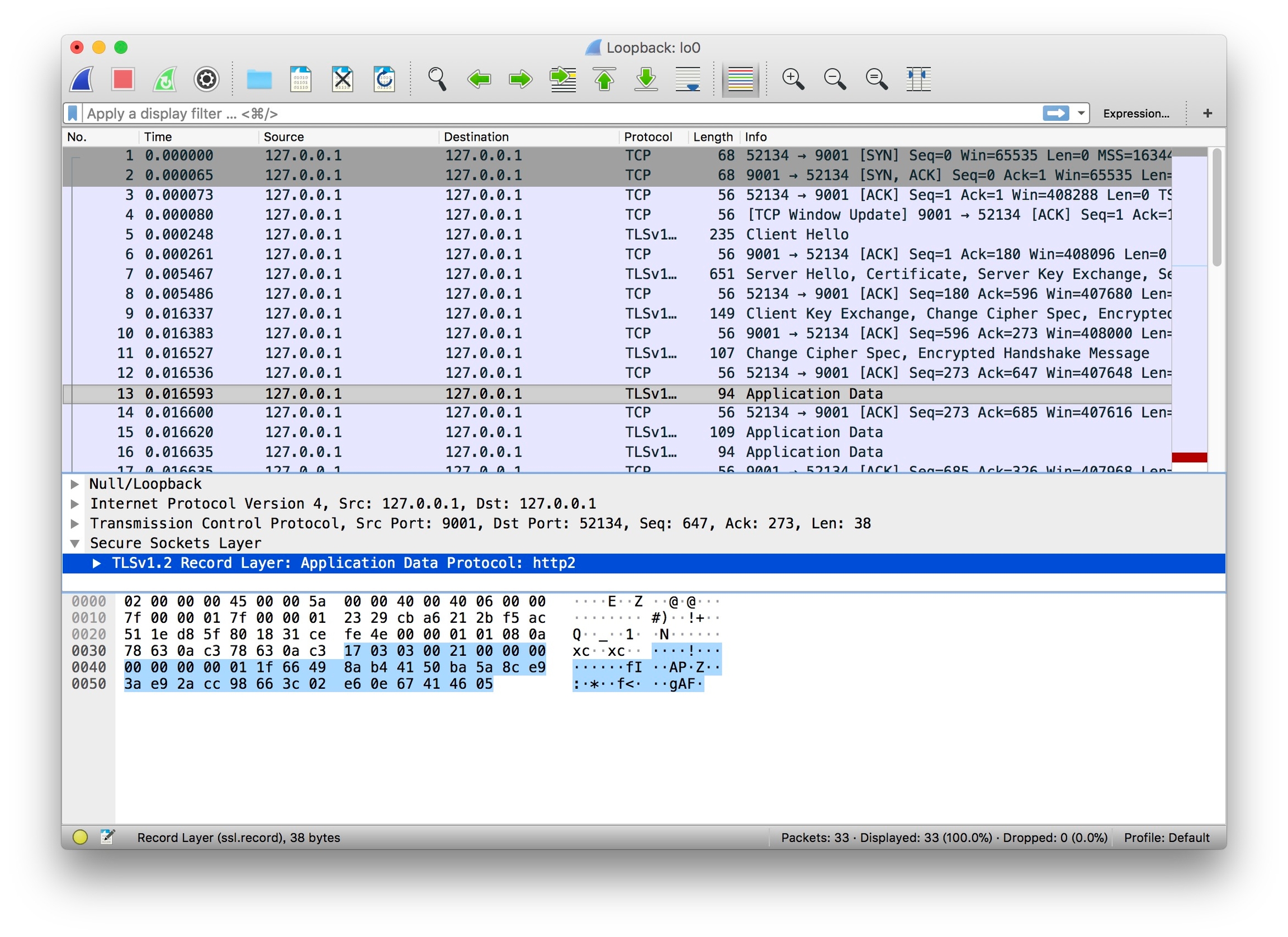

真的連了嗎

在抓包工具上提示一個包都沒有,那麼這算真正連線了嗎?我認為這是一個表述問題,我們應該儘可能的嚴謹。如果你真的想透過 DialContext 方法就打通與服務端的連線,則需要呼叫 WithBlock 方法,雖然會導致阻塞等待,但最終連線會到達 Ready 狀態(握手成功)。如下圖:

二、例項化 Service API

type SearchServiceClient interface {

Search(ctx context.Context, in *SearchRequest, opts ...grpc.CallOption) (*SearchResponse, error)

}

type searchServiceClient struct {

cc *grpc.ClientConn

}

func NewSearchServiceClient(cc *grpc.ClientConn) SearchServiceClient {

return &searchServiceClient{cc}

}

這塊就是例項 Service API interface,比較簡單。

三、呼叫

// search.pb.go

func (c *searchServiceClient) Search(ctx context.Context, in *SearchRequest, opts ...grpc.CallOption) (*SearchResponse, error) {

out := new(SearchResponse)

err := c.cc.Invoke(ctx, "/proto.SearchService/Search", in, out, opts...)

if err != nil {

return nil, err

}

return out, nil

}

proto 生成的 RPC 方法更像是一個包裝盒,把需要的東西放進去,而實際上呼叫的還是 grpc.invoke 方法。如下:

func invoke(ctx context.Context, method string, req, reply interface{}, cc *ClientConn, opts ...CallOption) error {

cs, err := newClientStream(ctx, unaryStreamDesc, cc, method, opts...)

if err != nil {

return err

}

if err := cs.SendMsg(req); err != nil {

return err

}

return cs.RecvMsg(reply)

}

透過概覽,可以關注到三塊呼叫。如下:

- newClientStream:取得傳輸層 Trasport 並組合封裝到 ClientStream 中返回,在這塊會涉及負載均衡、超時控制、 Encoding、 Stream 的動作,與服務端基本一致的行為。

- cs.SendMsg:傳送 RPC 請求出去,但其並不承擔等待響應的功能。

- cs.RecvMsg:阻塞等待接受到的 RPC 方法響應結果。

連線

// clientconn.go

func (cc *ClientConn) getTransport(ctx context.Context, failfast bool, method string) (transport.ClientTransport, func(balancer.DoneInfo), error) {

t, done, err := cc.blockingpicker.pick(ctx, failfast, balancer.PickOptions{

FullMethodName: method,

})

if err != nil {

return nil, nil, toRPCErr(err)

}

return t, done, nil

}

在 newClientStream 方法中,我們透過 getTransport 方法取得了 Transport 層中抽象出來的 ClientTransport 和 ServerTransport,實際上就是取得一個連線給後續 RPC 呼叫傳輸使用。

四、關閉連線

// conn.Close()

func (cc *ClientConn) Close() error {

defer cc.cancel()

...

cc.csMgr.updateState(connectivity.Shutdown)

...

cc.blockingpicker.close()

if rWrapper != nil {

rWrapper.close()

}

if bWrapper != nil {

bWrapper.close()

}

for ac := range conns {

ac.tearDown(ErrClientConnClosing)

}

if channelz.IsOn() {

...

channelz.AddTraceEvent(cc.channelzID, ted)

channelz.RemoveEntry(cc.channelzID)

}

return nil

}

該方法會取消 ClientConn 上下文,同時關閉所有底層傳輸。涉及如下:

- Context Cancel

- 清空並關閉客戶端連線

- 清空並關閉解析器連線

- 清空並關閉負載均衡連線

- 新增跟蹤引用

- 移除當前通道資訊

Q&A

1. gRPC Metadata 是透過什麼傳輸?

2. 呼叫 grpc.Dial 會真正的去連線服務端嗎?

會,但是是非同步連線的,連線狀態為正在連線。但如果你設定了 grpc.WithBlock 選項,就會阻塞等待(等待握手成功)。另外你需要注意,當未設定 grpc.WithBlock 時,ctx 超時控制對其無任何效果。

3. 呼叫 ClientConn 不 Close 會導致洩露嗎?

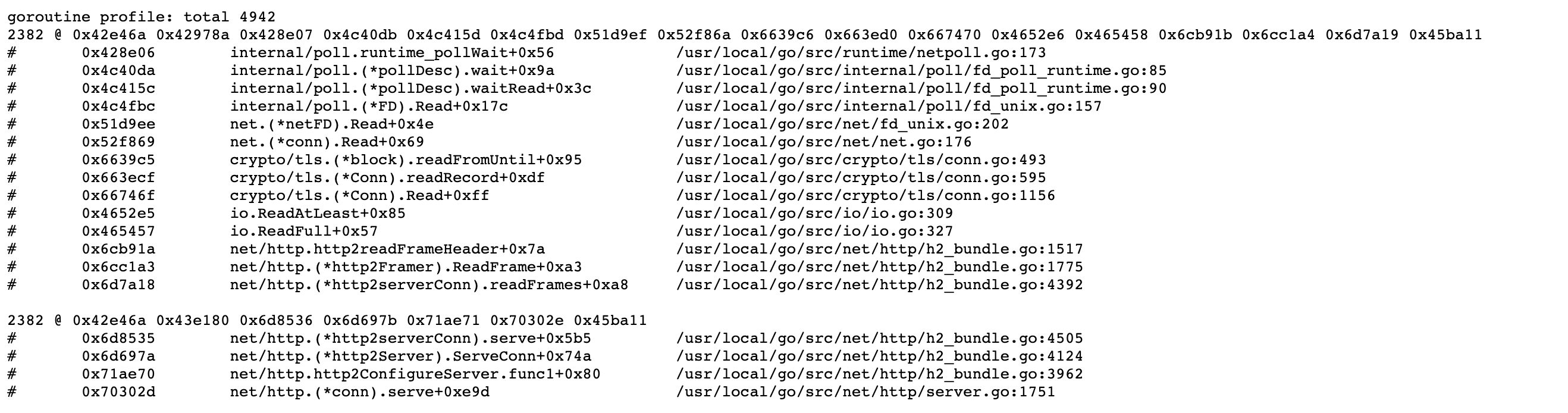

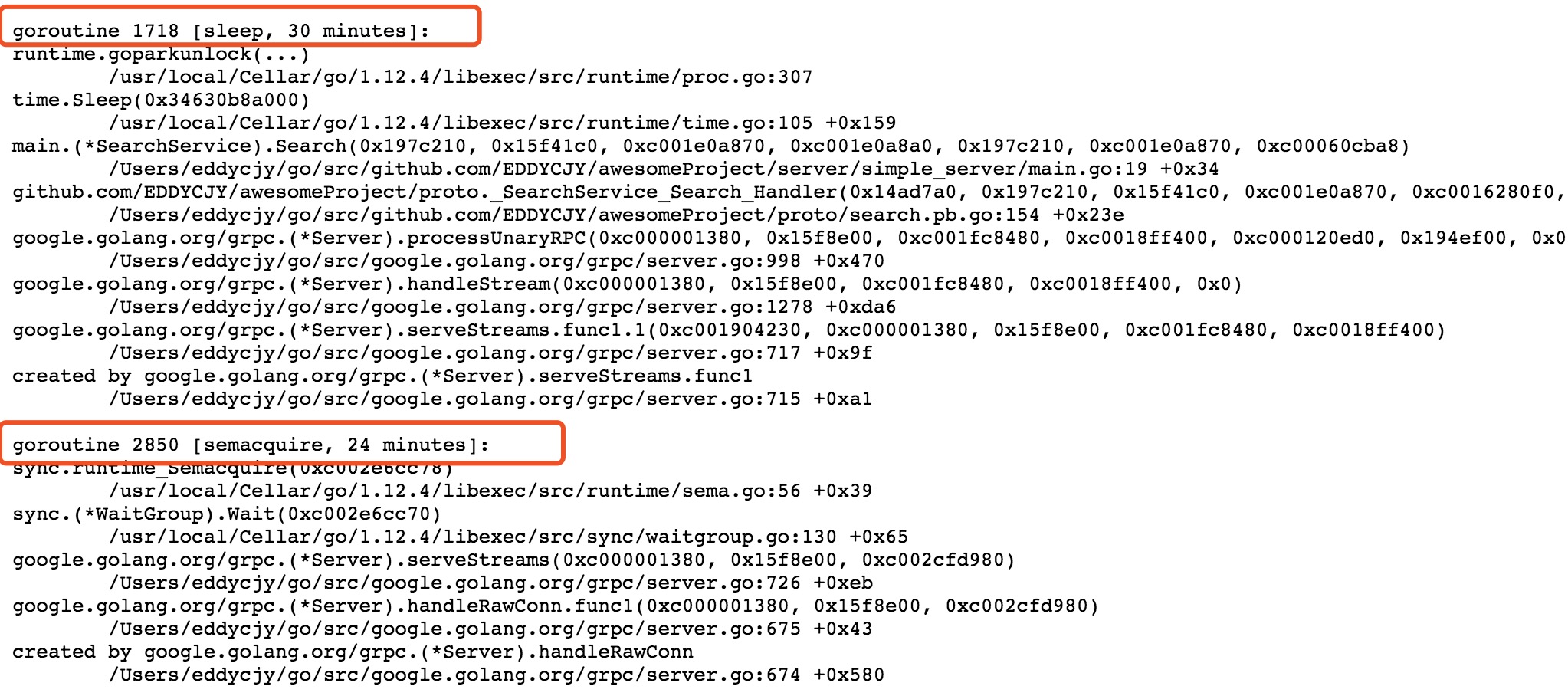

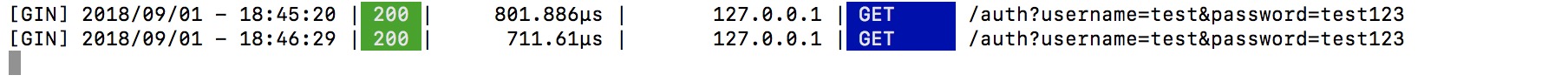

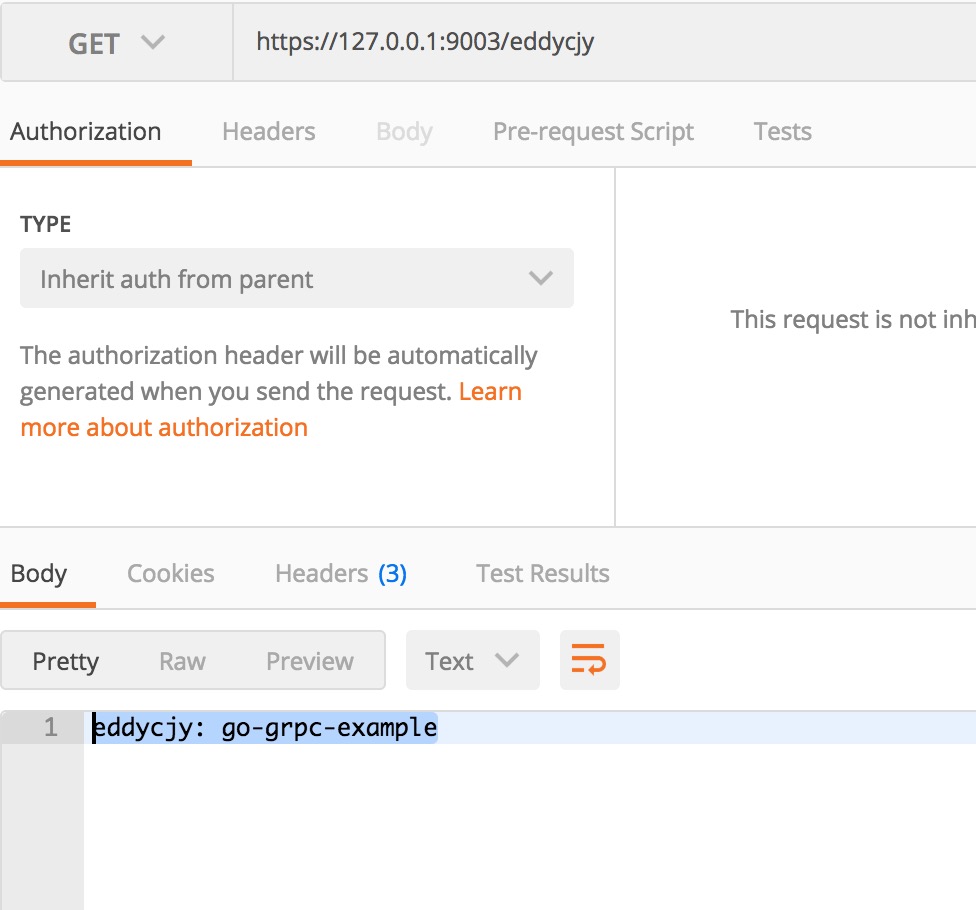

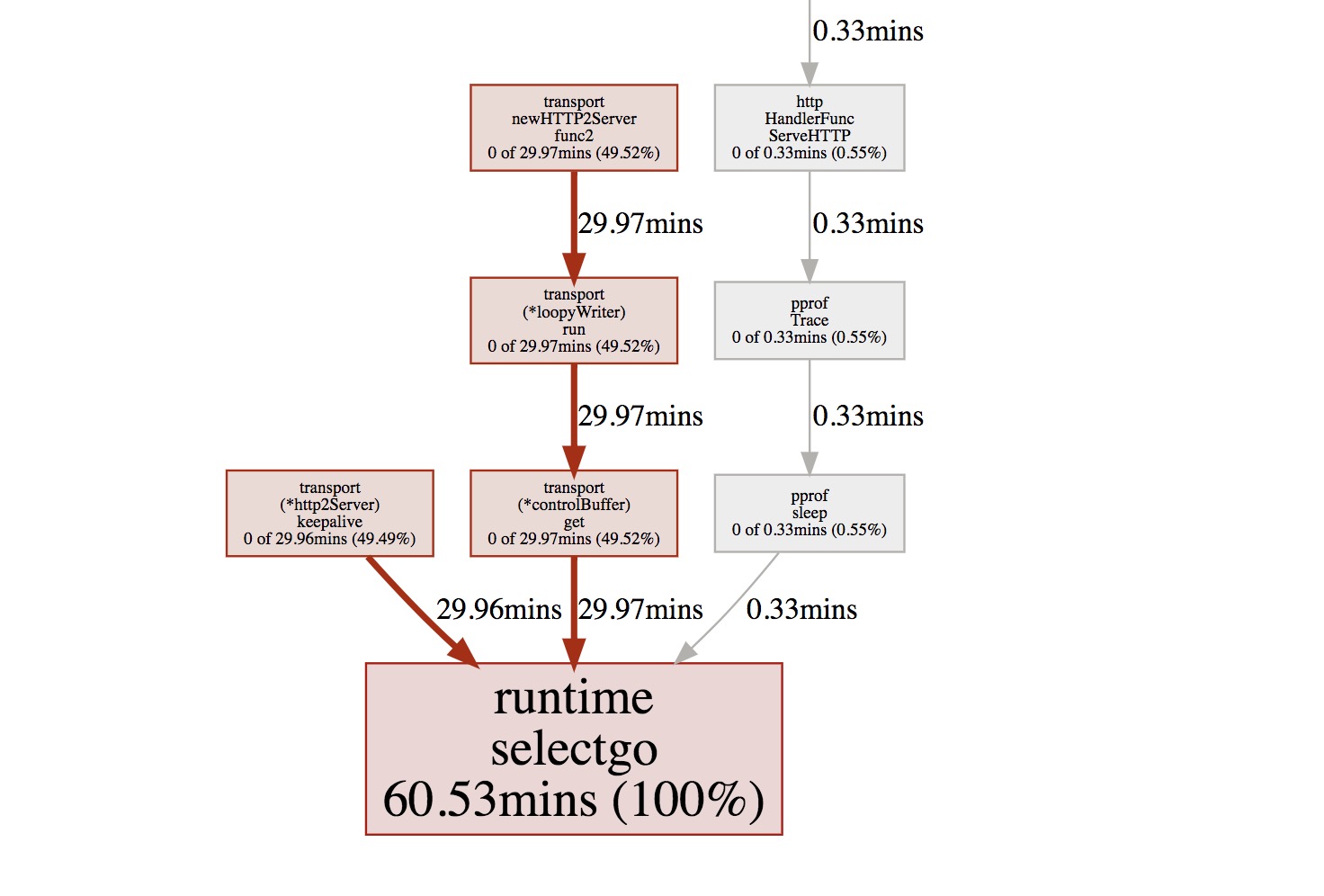

會,除非你的客戶端不是常駐程序,那麼在應用結束時會被動地回收資源。但如果是常駐程序,你又真的忘記執行 Close 語句,會造成的洩露。如下圖:

3.1. 客戶端

3.2. 服務端

3.3. TCP

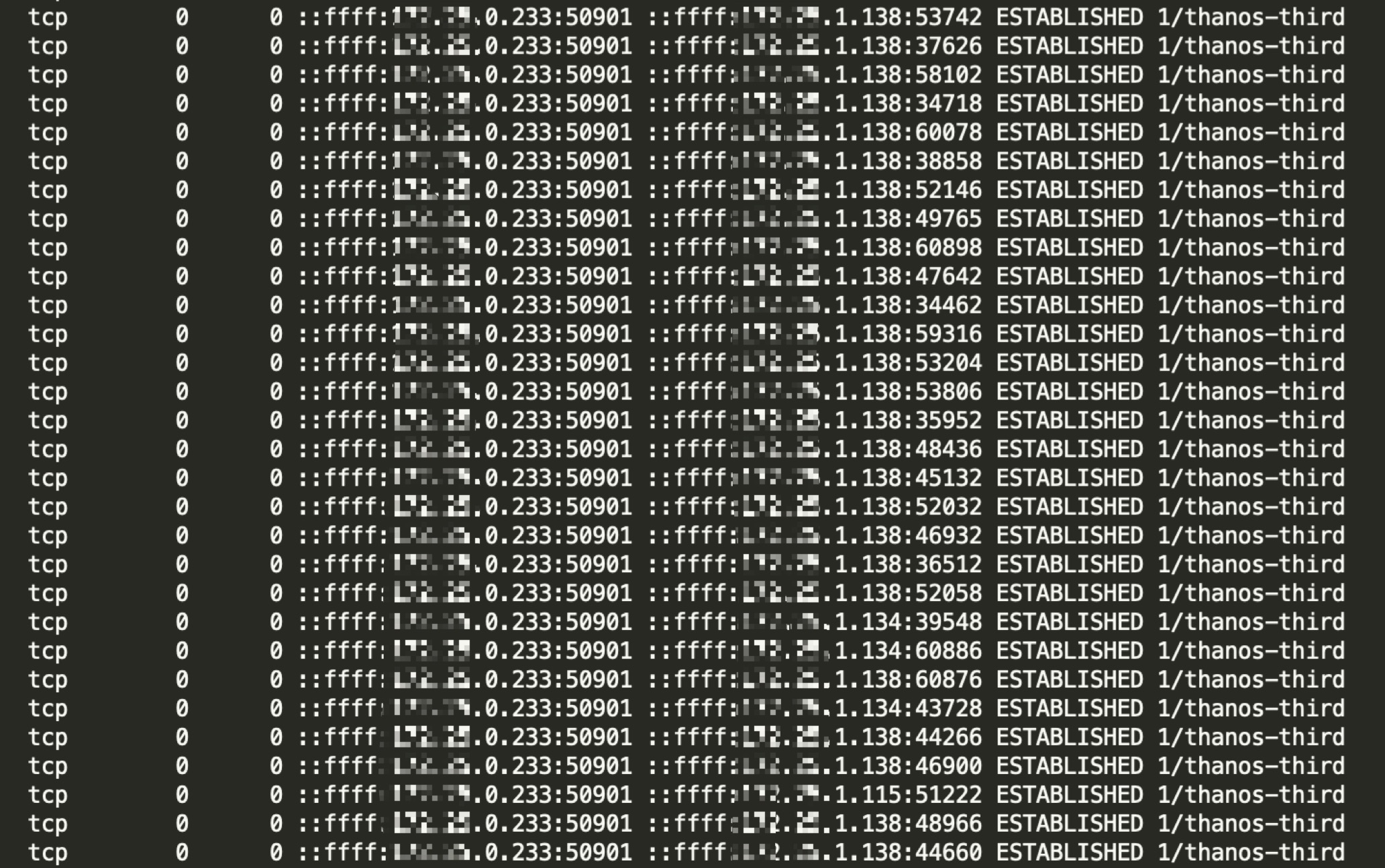

4. 不控制超時呼叫的話,會出現什麼問題?

短時間內不會出現問題,但是會不斷積蓄洩露,積蓄到最後當然就是服務無法提供響應了。如下圖:

5. 為什麼預設的攔截器不可以傳多個?

func chainUnaryClientInterceptors(cc *ClientConn) {

interceptors := cc.dopts.chainUnaryInts

if cc.dopts.unaryInt != nil {

interceptors = append([]UnaryClientInterceptor{cc.dopts.unaryInt}, interceptors...)

}

var chainedInt UnaryClientInterceptor

if len(interceptors) == 0 {

chainedInt = nil

} else if len(interceptors) == 1 {

chainedInt = interceptors[0]

} else {

chainedInt = func(ctx context.Context, method string, req, reply interface{}, cc *ClientConn, invoker UnaryInvoker, opts ...CallOption) error {

return interceptors[0](ctx, method, req, reply, cc, getChainUnaryInvoker(interceptors, 0, invoker), opts...)

}

}

cc.dopts.unaryInt = chainedInt

}

當存在多個攔截器時,取的就是第一個攔截器。因此結論是允許傳多個,但並沒有用。

6. 真的需要用到多個攔截器的話,怎麼辦?

可以使用 go-grpc-middleware 提供的 grpc.UnaryInterceptor 和 grpc.StreamInterceptor 鏈式方法,方便快捷省心。

單單會用還不行,我們再深剖一下,看看它是怎麼實作的。核心程式碼如下:

func ChainUnaryClient(interceptors ...grpc.UnaryClientInterceptor) grpc.UnaryClientInterceptor {

n := len(interceptors)

if n > 1 {

lastI := n - 1

return func(ctx context.Context, method string, req, reply interface{}, cc *grpc.ClientConn, invoker grpc.UnaryInvoker, opts ...grpc.CallOption) error {

var (

chainHandler grpc.UnaryInvoker

curI int

)

chainHandler = func(currentCtx context.Context, currentMethod string, currentReq, currentRepl interface{}, currentConn *grpc.ClientConn, currentOpts ...grpc.CallOption) error {

if curI == lastI {

return invoker(currentCtx, currentMethod, currentReq, currentRepl, currentConn, currentOpts...)

}

curI++

err := interceptors[curI](currentCtx, currentMethod, currentReq, currentRepl, currentConn, chainHandler, currentOpts...)

curI--

return err

}

return interceptors[0](ctx, method, req, reply, cc, chainHandler, opts...)

}

}

...

}

當攔截器數量大於 1 時,從 interceptors[1] 開始遞迴,每一個遞迴的攔截器 interceptors[i] 會不斷地執行,最後才真正的去執行 handler 方法。同時也經常有人會問攔截器的執行順序是什麼,透過這段程式碼你得出結論了嗎?

7. 頻繁建立 ClientConn 有什麼問題?

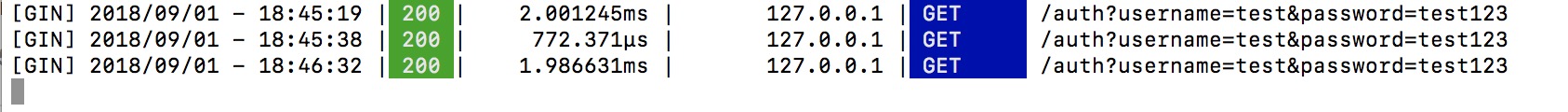

這個問題我們可以反向驗證一下,假設不公用 ClientConn 看看會怎麼樣?如下:

func BenchmarkSearch(b *testing.B) {

for i := 0; i < b.N; i++ {

conn, err := GetClientConn()

if err != nil {

b.Errorf("GetClientConn err: %v", err)

}

_, err = Search(context.Background(), conn)

if err != nil {

b.Errorf("Search err: %v", err)

}

}

}

輸出結果:

... connection error: desc = "transport: Error while dialing dial tcp :10001: socket: too many open files"

... connection error: desc = "transport: Error while dialing dial tcp :10001: socket: too many open files"

... connection error: desc = "transport: Error while dialing dial tcp :10001: socket: too many open files"

... connection error: desc = "transport: Error while dialing dial tcp :10001: socket: too many open files"

FAIL

exit status 1

當你的應用場景是存在高頻次同時生成/呼叫 ClientConn 時,可能會導致系統的檔案控制代碼佔用過多。這種情況下你可以變更應用程式生成/呼叫 ClientConn 的模式,又或是池化它,這塊可以參考 grpc-go-pool 專案。

8. 客戶端請求失敗後會預設重試嗎?

會不斷地進行重試,直到上下文取消。而重試時間方面採用 backoff 演算法作為的重連機制,預設的最大重試時間間隔是 120s。

9. 為什麼要用 HTTP/2 作為傳輸協議?

許多客戶端要透過 HTTP 代理來訪問網路,gRPC 全部用 HTTP/2 實作,等到代理開始支援 HTTP/2 就能透明轉發 gRPC 的資料。不光如此,負責負載均衡、訪問控制等等的反向代理都能無縫相容 gRPC,比起自己設計 wire protocol 的 Thrift,這樣做科學不少。@ctiller @滕亦飛

10. 在 Kubernetes 中 gRPC 負載均衡有問題?

gRPC 的 RPC 協議是基於 HTTP/2 標準實作的,HTTP/2 的一大特性就是不需要像 HTTP/1.1 一樣,每次發出請求都要重新建立一個新連線,而是會複用原有的連線。

所以這將導致 kube-proxy 只有在連線建立時才會做負載均衡,而在這之後的每一次 RPC 請求都會利用原本的連線,那麼實際上後續的每一次的 RPC 請求都跑到了同一個地方。

注:使用 k8s service 做負載均衡的情況下

總結

- gRPC 基於 HTTP/2 + Protobuf。

- gRPC 有四種呼叫方式,分別是一元、服務端/客戶端流式、雙向流式。

- gRPC 的附加資訊都會體現在 HEADERS 幀,資料在 DATA 幀上。

- Client 請求若使用 grpc.Dial 預設是非同步建立連線,當時狀態為 Connecting。

- Client 請求若需要同步則呼叫 WithBlock(),完成狀態為 Ready。

- Server 監聽是迴圈等待連線,若沒有則休眠,最大休眠時間 1s;若接收到新請求則起一個新的 goroutine 去處理。

- grpc.ClientConn 不關閉連線,會導致 goroutine 和 Memory 等洩露。

- 任何內/外呼叫如果不加超時控制,會出現洩漏和客戶端不斷重試。

- 特定場景下,如果不對 grpc.ClientConn 加以調控,會影響呼叫。

- 攔截器如果不用 go-grpc-middleware 鏈式處理,會覆蓋。

- 在選擇 gRPC 的負載均衡模式時,需要謹慎。

參考

- http://doc.oschina.net/grpc

- https://github.com/grpc/grpc/blob/master/doc/PROTOCOL-HTTP2.md

- https://juejin.im/post/5b88a4f56fb9a01a0b31a67e

- https://www.ibm.com/developerworks/cn/web/wa-http2-under-the-hood/index.html

- https://github.com/grpc/grpc-go/issues/1953

- https://www.zhihu.com/question/52670041

1.12 Go1.13 defer 的效能是如何提高的?

最近 Go1.13 終於釋出了,其中一個值得關注的特性就是 defer 在大部分的場景下效能提升了30%,但是官方並沒有具體寫是怎麼提升的,這讓大家非常的疑惑。而我因為之前寫過《深入理解 Go defer》 和 《Go defer 會有效能損耗,儘量不要用?》 這類文章,因此我挺感興趣它是做了什麼改變才能得到這樣子的結果,所以今天和大家一起探索其中奧妙。

一、測試

Go1.12

$ go test -bench=. -benchmem -run=none

goos: darwin

goarch: amd64

pkg: github.com/EDDYCJY/awesomeDefer

BenchmarkDoDefer-4 20000000 91.4 ns/op 48 B/op 1 allocs/op

BenchmarkDoNotDefer-4 30000000 41.6 ns/op 48 B/op 1 allocs/op

PASS

ok github.com/EDDYCJY/awesomeDefer 3.234s

Go1.13

$ go test -bench=. -benchmem -run=none

goos: darwin

goarch: amd64

pkg: github.com/EDDYCJY/awesomeDefer

BenchmarkDoDefer-4 15986062 74.7 ns/op 48 B/op 1 allocs/op

BenchmarkDoNotDefer-4 29231842 40.3 ns/op 48 B/op 1 allocs/op

PASS

ok github.com/EDDYCJY/awesomeDefer 3.444s

在開場,我先以不標準的測試基準驗證了先前的測試用例,確確實實在這兩個版本中,defer 的效能得到了提高,但是看上去似乎不是百分百提高 30 %。

二、看一下

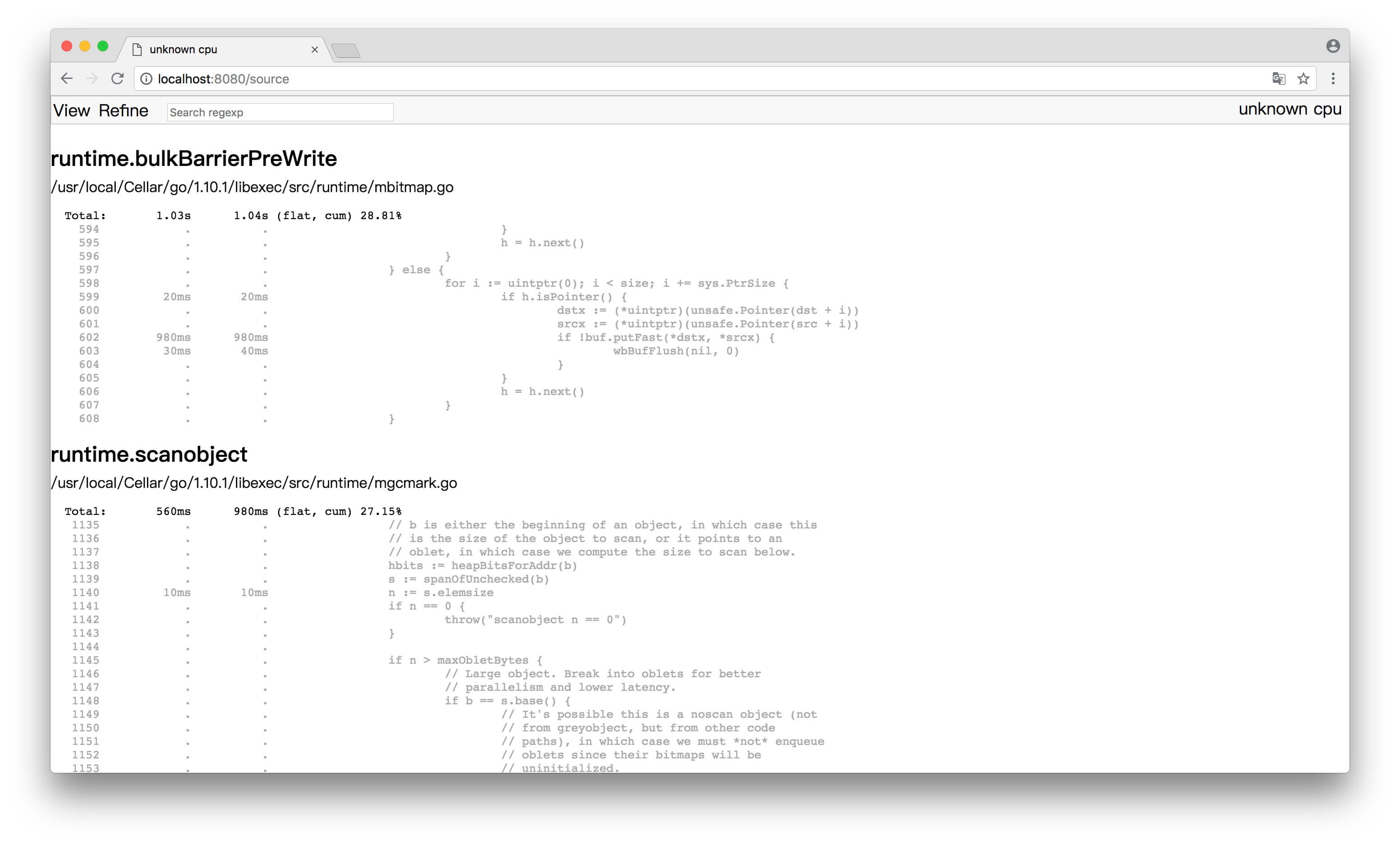

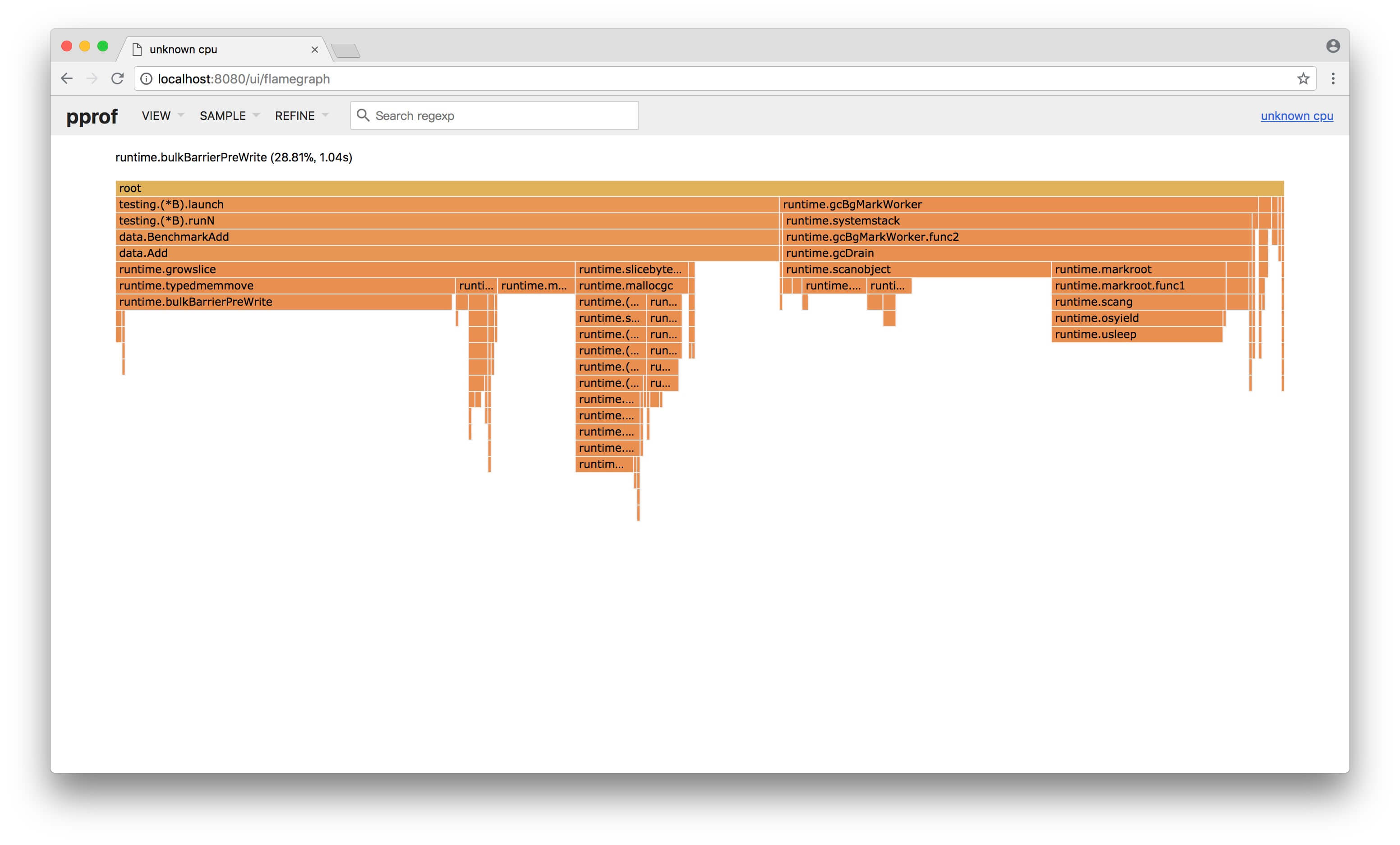

之前(Go1.12)

0x0070 00112 (main.go:6) CALL runtime.deferproc(SB)

0x0075 00117 (main.go:6) TESTL AX, AX

0x0077 00119 (main.go:6) JNE 137

0x0079 00121 (main.go:7) XCHGL AX, AX

0x007a 00122 (main.go:7) CALL runtime.deferreturn(SB)

0x007f 00127 (main.go:7) MOVQ 56(SP), BP

現在(Go1.13)

0x006e 00110 (main.go:4) MOVQ AX, (SP)

0x0072 00114 (main.go:4) CALL runtime.deferprocStack(SB)

0x0077 00119 (main.go:4) TESTL AX, AX

0x0079 00121 (main.go:4) JNE 139

0x007b 00123 (main.go:7) XCHGL AX, AX

0x007c 00124 (main.go:7) CALL runtime.deferreturn(SB)

0x0081 00129 (main.go:7) MOVQ 112(SP), BP

從彙編的角度來看,像是 runtime.deferproc 改成了 runtime.deferprocStack 呼叫,難道是做了什麼最佳化,我們抱著疑問繼續看下去。

三、觀察原始碼

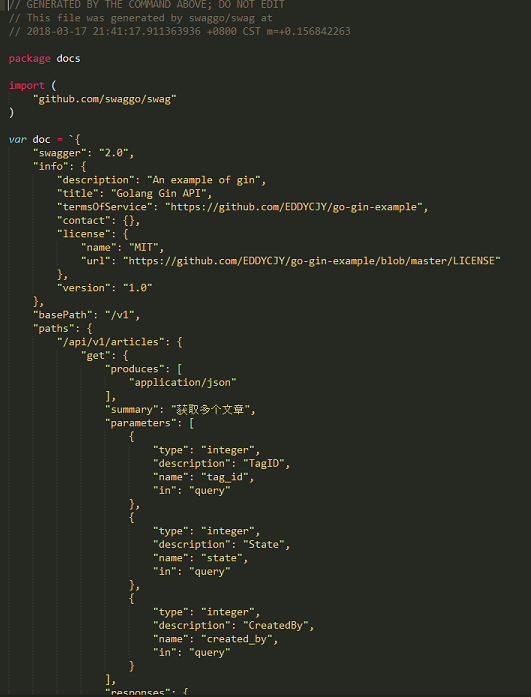

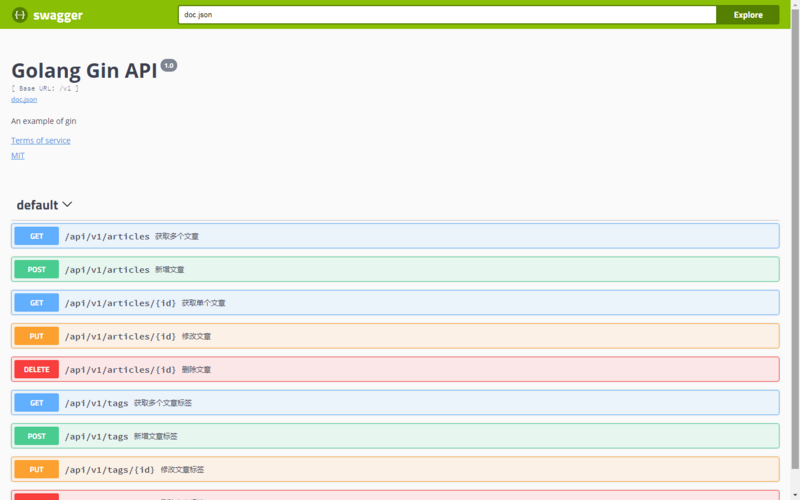

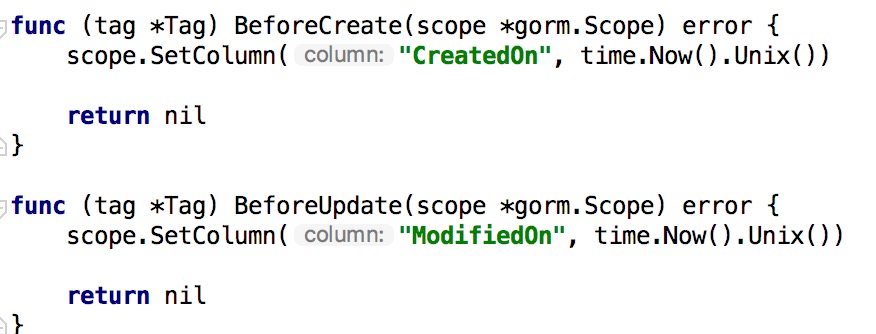

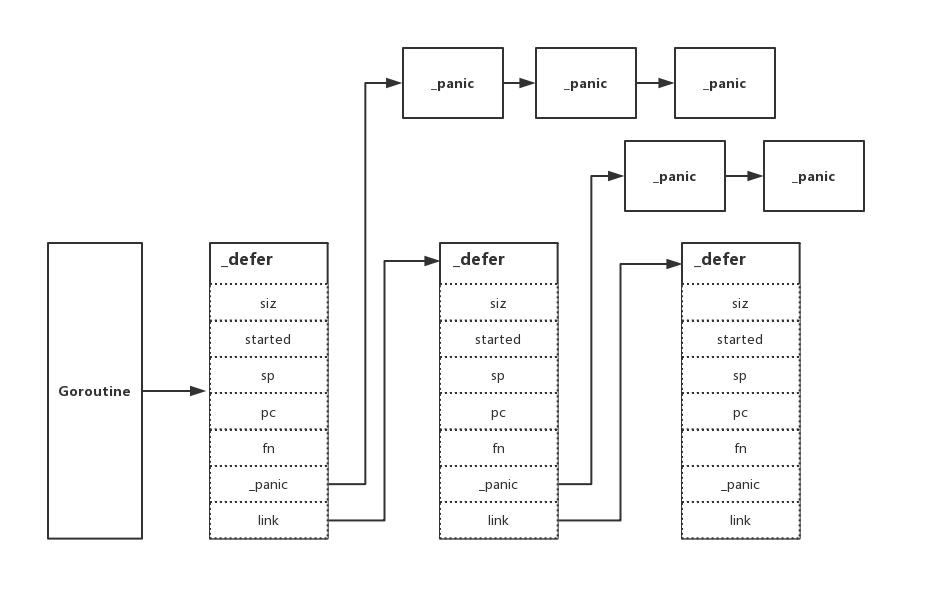

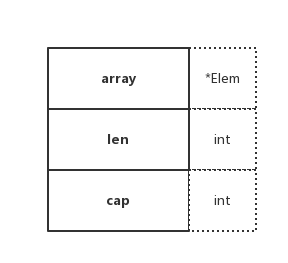

_defer

type _defer struct {

siz int32

siz int32 // includes both arguments and results

started bool

heap bool

sp uintptr // sp at time of defer

pc uintptr

fn *funcval

...

相較於以前的版本,最小單元的 _defer 結構體主要是新增了 heap 欄位,用於標識這個 _defer 是在堆上,還是在棧上進行分配,其餘欄位並沒有明確變更,那我們可以把聚焦點放在 defer 的堆疊分配上了,看看是做了什麼事。

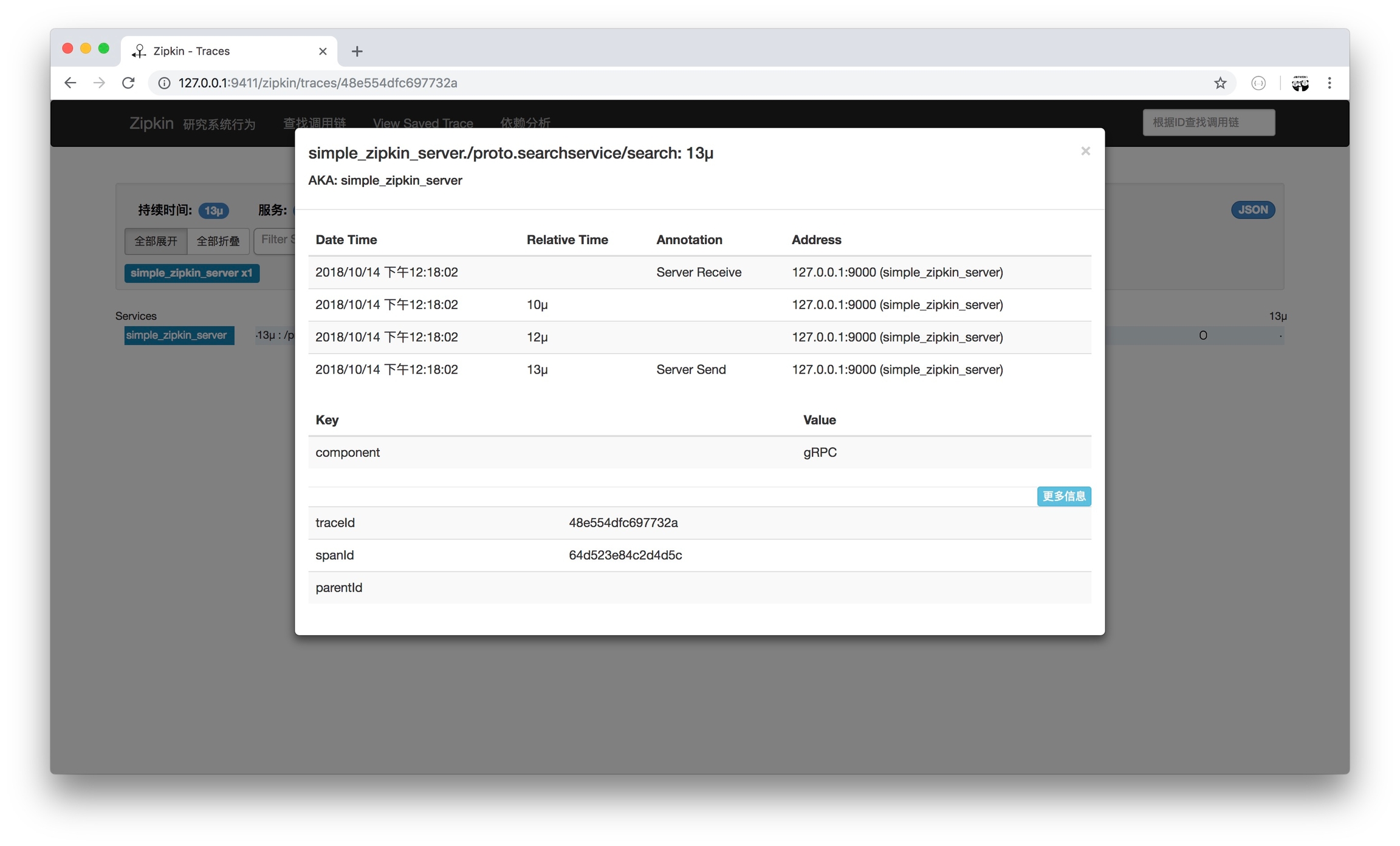

deferprocStack

func deferprocStack(d *_defer) {

gp := getg()

if gp.m.curg != gp {

throw("defer on system stack")

}

d.started = false

d.heap = false

d.sp = getcallersp()

d.pc = getcallerpc()

*(*uintptr)(unsafe.Pointer(&d._panic)) = 0

*(*uintptr)(unsafe.Pointer(&d.link)) = uintptr(unsafe.Pointer(gp._defer))

*(*uintptr)(unsafe.Pointer(&gp._defer)) = uintptr(unsafe.Pointer(d))

return0()

}

這一塊程式碼挺常規的,主要是取得呼叫 defer 函式的函式棧指標、傳入函式的引數具體地址以及PC(程式計數器),這塊在前文 《深入理解 Go defer》 有詳細介紹過,這裡就不再贅述了。

那這個 deferprocStack 特殊在哪呢,我們可以看到它把 d.heap 設定為了 false,也就是代表 deferprocStack 方法是針對將 _defer 分配在棧上的應用場景的。

deferproc

那麼問題來了,它又在哪裡處理分配到堆上的應用場景呢?

func newdefer(siz int32) *_defer {

...

d.heap = true

d.link = gp._defer

gp._defer = d

return d

}

那麼 newdefer 是在哪裡呼叫的呢,如下:

func deferproc(siz int32, fn *funcval) { // arguments of fn follow fn

...

sp := getcallersp()

argp := uintptr(unsafe.Pointer(&fn)) + unsafe.Sizeof(fn)

callerpc := getcallerpc()

d := newdefer(siz)

...

}

非常明確,先前的版本中呼叫的 deferproc 方法,現在被用於對應分配到堆上的場景了。

小結

- 第一點:可以確定的是

deferproc並沒有被去掉,而是流程被優化了。 - 第二點:編譯器會根據應用場景去選擇使用

deferproc還是deferprocStack方法,他們分別是針對分配在堆上和棧上的使用場景。

四、編譯器如何選擇

esc

// src/cmd/compile/internal/gc/esc.go

case ODEFER:

if e.loopdepth == 1 { // top level

n.Esc = EscNever // force stack allocation of defer record (see ssa.go)

break

}

ssa

// src/cmd/compile/internal/gc/ssa.go

case ODEFER:

d := callDefer

if n.Esc == EscNever {

d = callDeferStack

}

s.call(n.Left, d)

小結

這塊結合來看,核心就是當 e.loopdepth == 1 時,會將逃逸分析結果 n.Esc 設定為 EscNever,也就是將 _defer 分配到棧上,那這個 e.loopdepth 到底又是何方神聖呢,我們再詳細看看程式碼,如下:

// src/cmd/compile/internal/gc/esc.go

type NodeEscState struct {

Curfn *Node

Flowsrc []EscStep

Retval Nodes

Loopdepth int32

Level Level

Walkgen uint32

Maxextraloopdepth int32

}

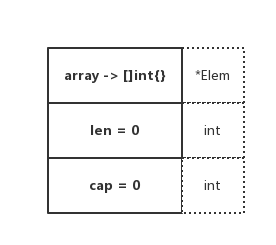

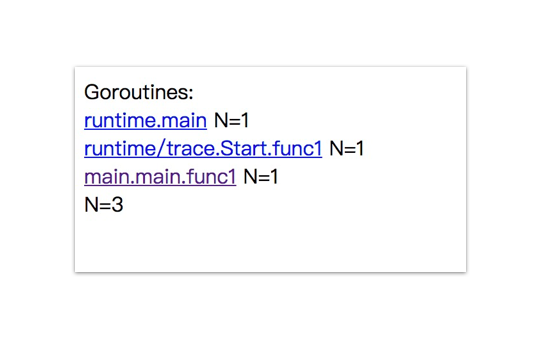

這裡重點檢視 Loopdepth 欄位,目前它共有三個值標識,分別是: