Day 1:

- 原文:https://ithelp.ithome.com.tw/articles/10374851

- 發布日期:2025-09-11

2025/10/28 UPDATE:

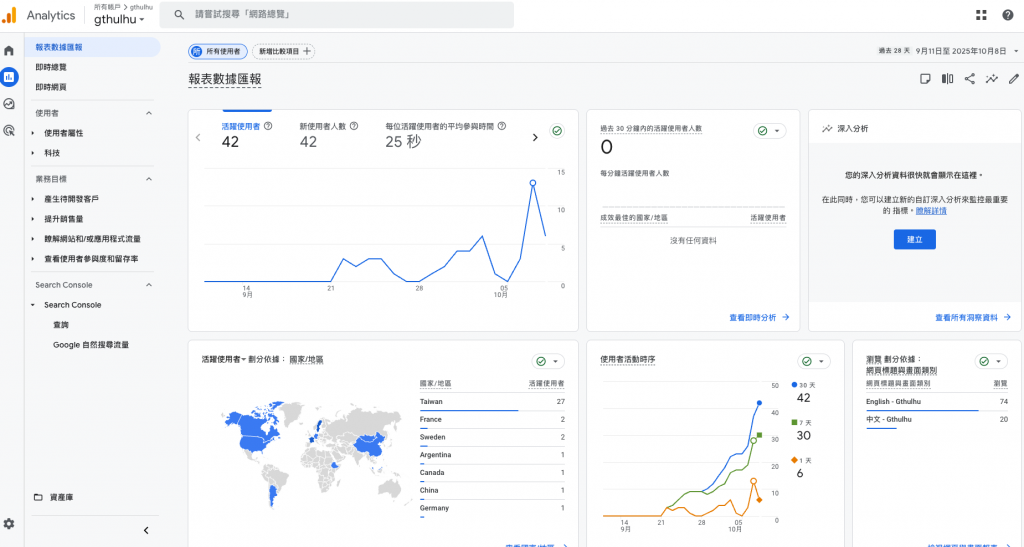

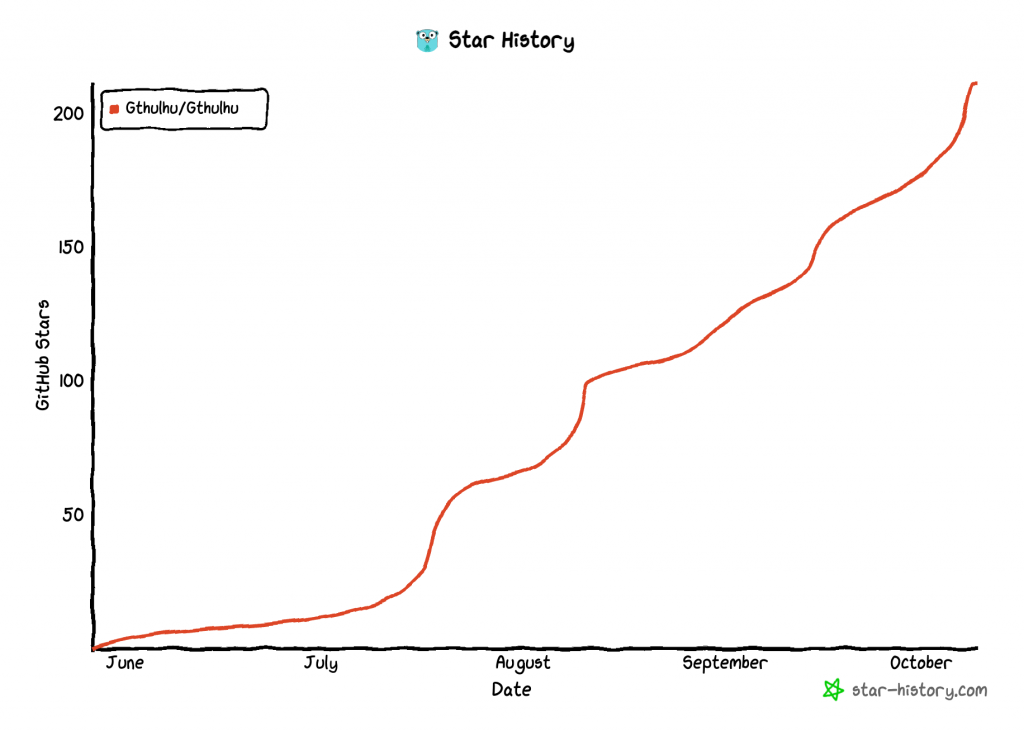

Gthulhu 已加入 CNCF landscape,請參考:landscape.cncf.io

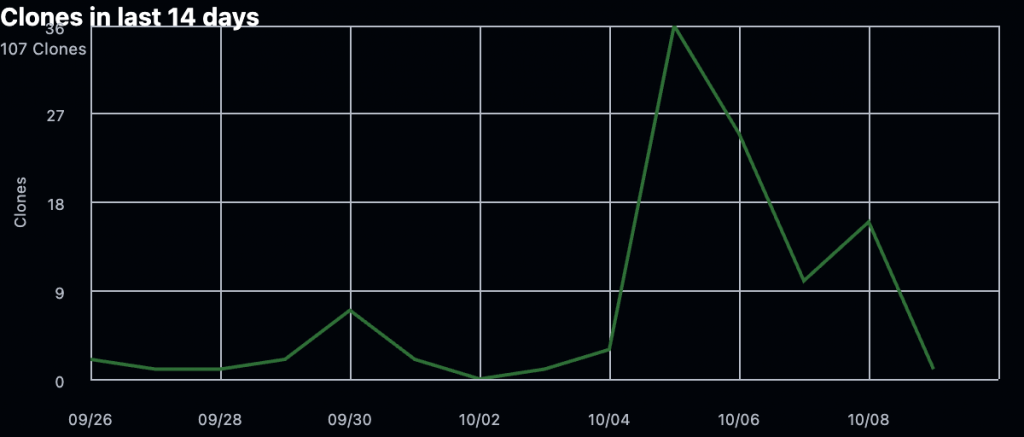

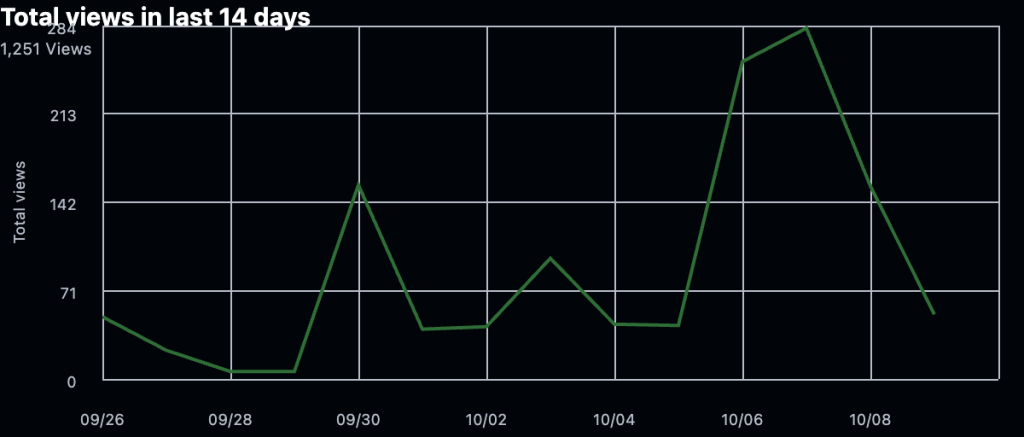

如果覺得文章對你有所啟發,可以考慮用 🌟 支持 Gthulhu 專案,短期目標是集齊 300 個 🌟 藉此被 CNCF Landscape 採納 [ref]。

系列規劃概述

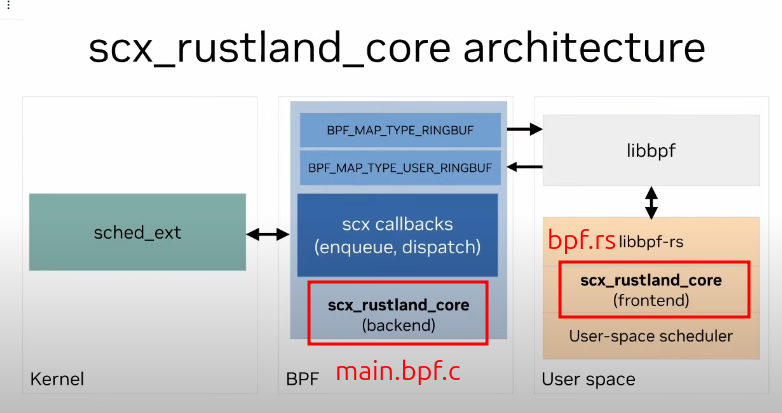

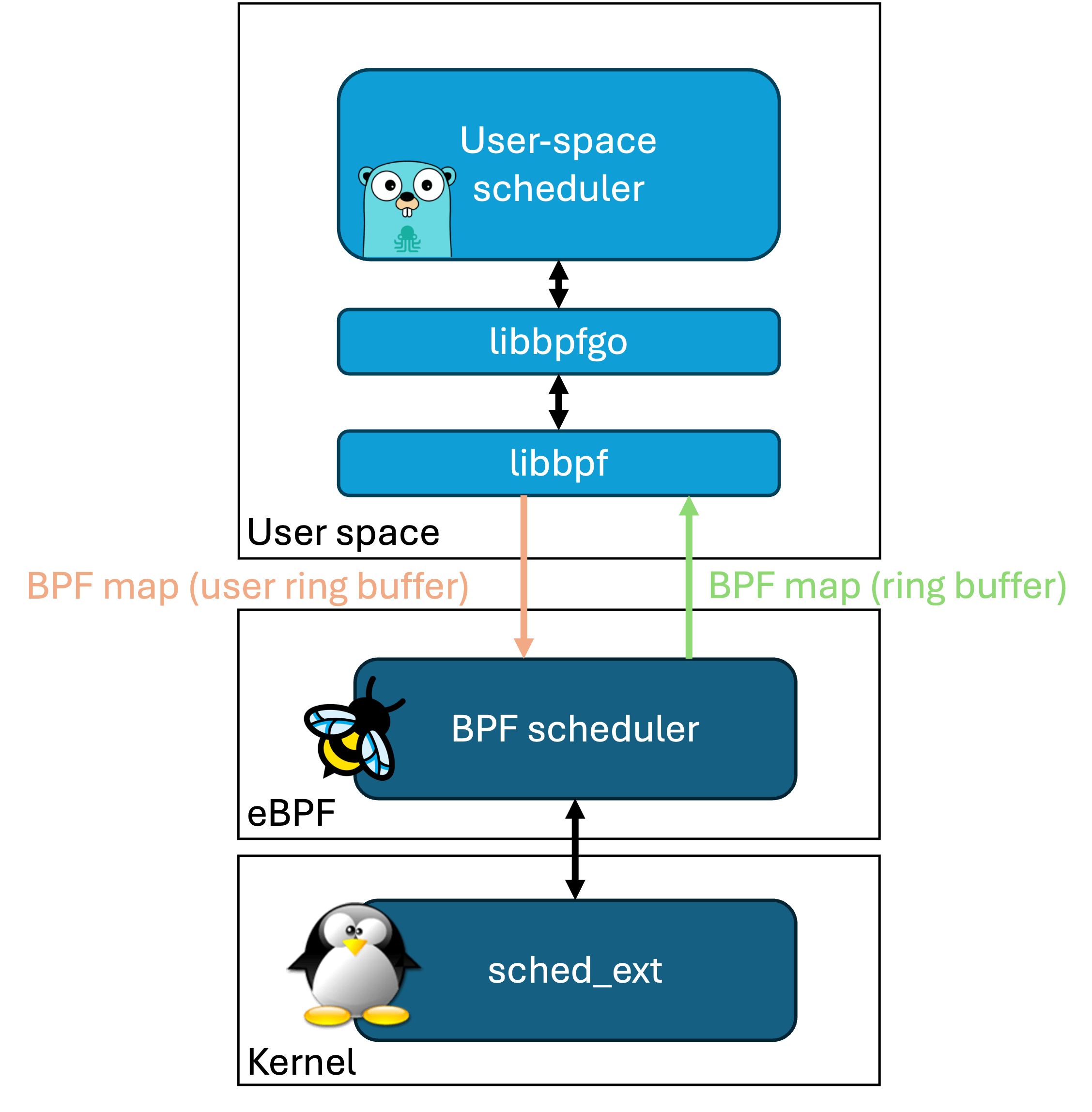

大家好,我是 Ian。我在今年年初受到大神 Andrea Righi 的演講「Crafting a Linux kernel scheduler in Rust」啟發,將 scx_rustland 移植到 golang 平台上運作,並且考慮 Cloud-Native 的應用場景打造了一款適用於雲原生的通用排程器「Gthulhu」。

該系列文會以系統性的方式帶你學習如何開發 eBPF 應用,從零開始逐步掌握 eBPF 技術,並最終實現一個完整的 Linux 排程器。整個系列分為六個階段,每個階段都建立在前一階段的基礎之上。

寫在開始之前

在 ChatGPT 問世以後,我在技術寫作上變得比以往要消極,因為我認為人們不在需要透過閱讀網路文章來學習「簡單的」基礎知識(看 StackOverflow 慘淡的流量就知道),語法怎麼用、特殊指令怎麼下已經不在需要逐篇文章翻閱才能得到答案了。所以過去一年多來我公開在個人 Medium 的文章基本上只會寫一些 ChatGPT、Perplexity 無法準確回答我的知識,經過了這些累積,我想也是時候來寫寫廢文了。

今年的系列文我會讓 GitHub Copilot Plus 基於我提供的 context 負責全部的編撰工作,並且由我本人驗證文章的正確性、適時的補充必要知識。

這麼做的原因如下:

我認為在 AI 工具爆炸式發展的年代,很大程度的顛覆了我們接受新知的方式,所以我們可以在社群媒體上看到很多非工程背景的人利用 Claude Code、Cursor、Copilot 等工具 Vibe 出非常厲害的系統。那麼,軟體工程師又要如何在最嚴峻的世代量化自己的價值呢?筆者個人的想法是:比起外行人只能 vibe coding,我們可以用更精確的 prompt(或是 context engineering)的方式高效的產出「就像是親手寫出來的程式碼」。

除了發表對 AI 工具發展的感想外,今年的挑戰對我來說也與以往十分不同。雖然我在開源社群混了些年,也貢獻過不少知名專案,但是從 0 到 60 認真打造一個開源軟體專案倒是頭一回。希望能藉由鐵人賽這個活動讓更多人認識 Gthulhu。

2025/09/21

我認為 Coding Agent 在產生部分文章的表現有待加強,所以在探討 scheduler 的部分會以我自己撰寫的內容為主。

目錄

eBPF 基礎

eBPF 網路程式基礎

eBPF 進階功能

scheduler extenstion 介紹

scx_goland 移植

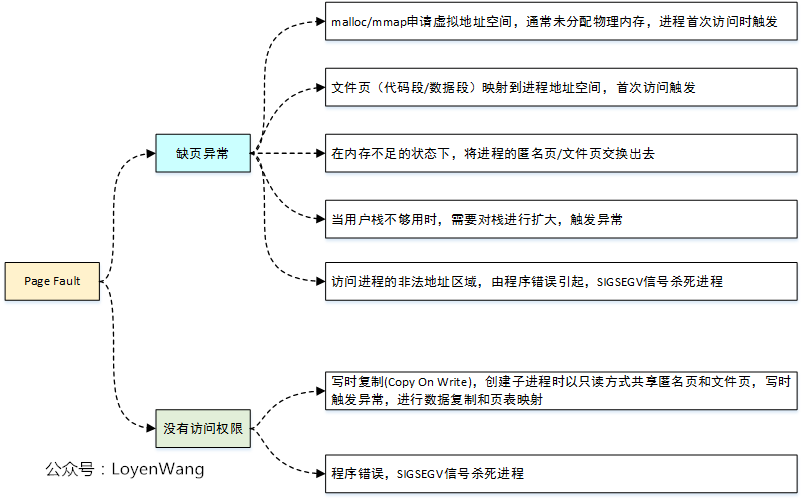

- scx_goland_core 移植與挑戰(一):page fault

- scx_goland_core 移植與挑戰(二):watchdog failed to check in for default timeout

- scx_goland_core 移植與挑戰(三):data unsync

Gthulhu 開發與整合

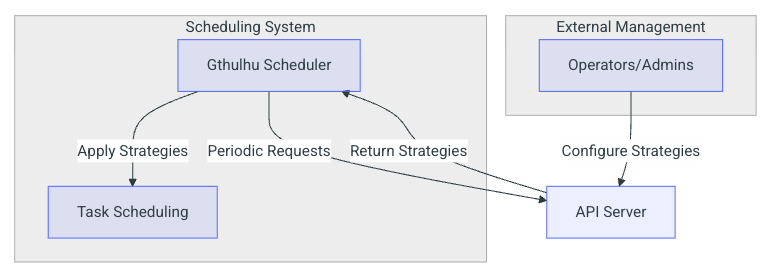

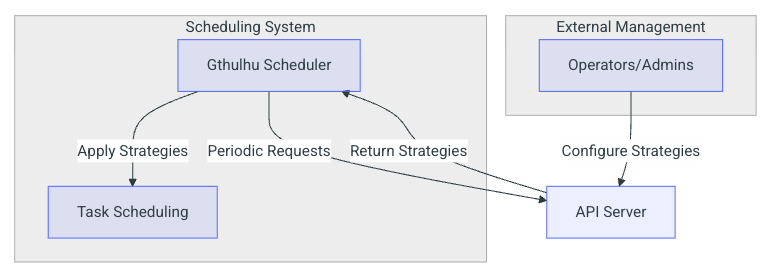

- Gthulhu 系統設計

- Gthulhu API server 系統設計

- 使用 Kubernetes 部署 Gthulhu

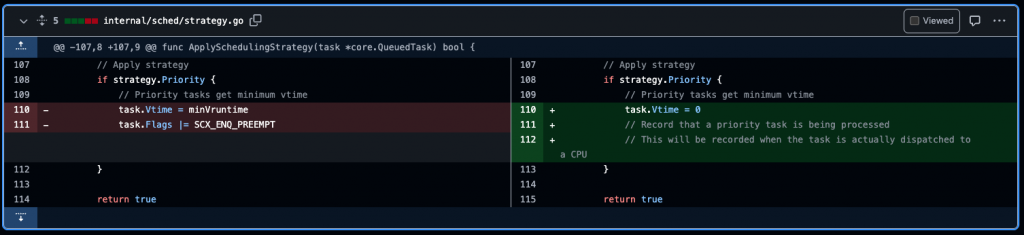

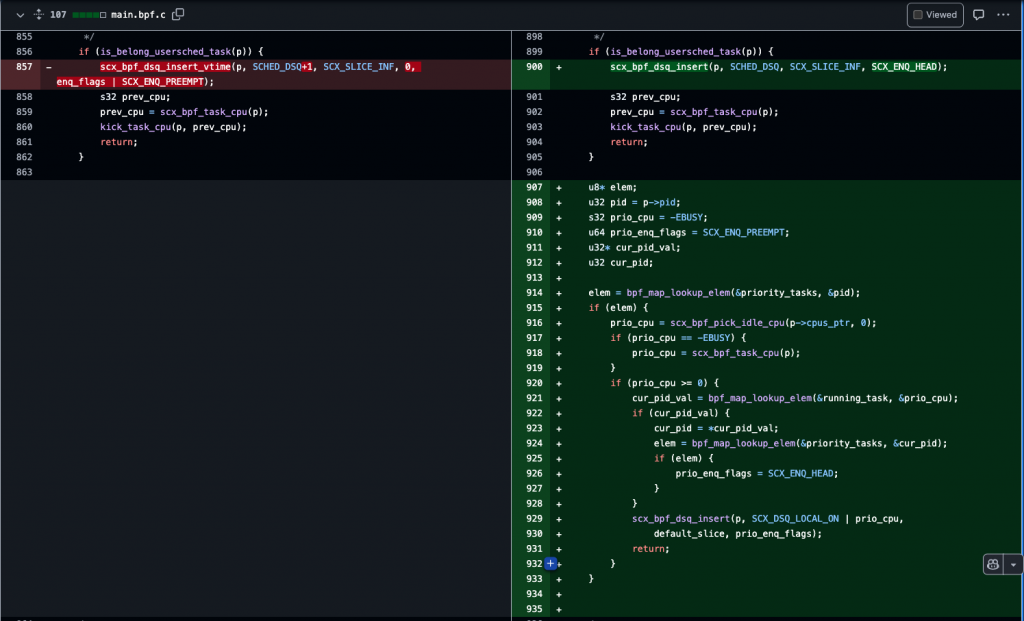

- 搶佔式任務處理

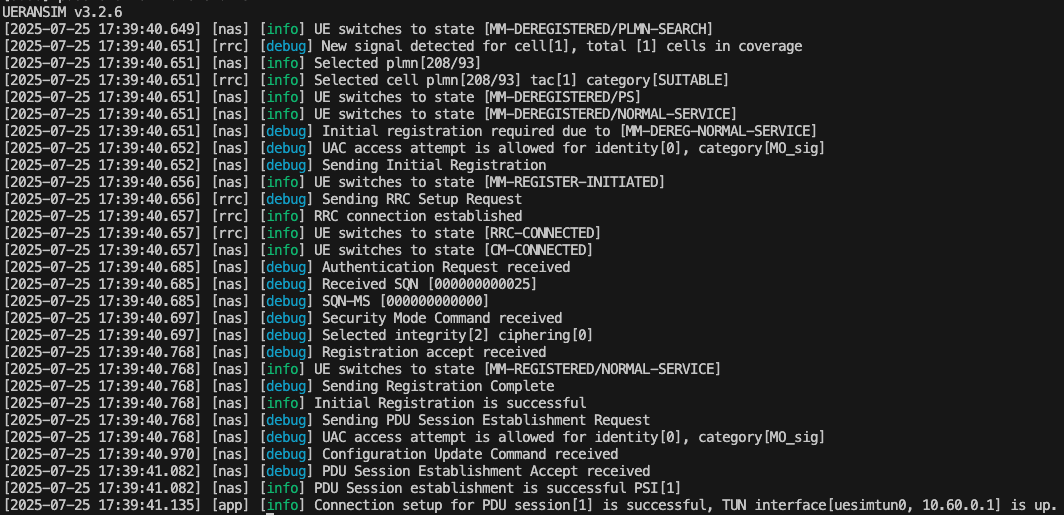

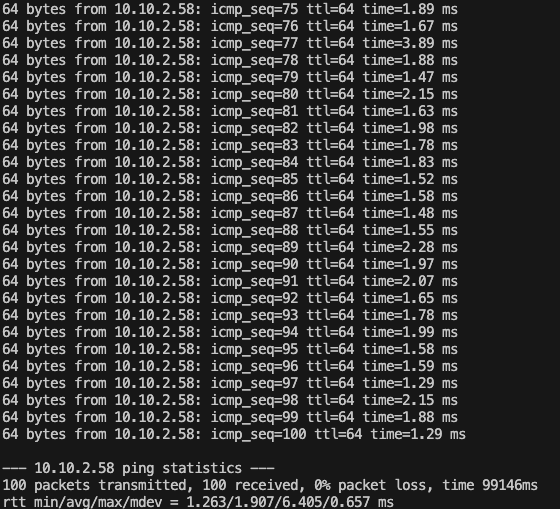

- 整合 free5GC 實作低延遲資料層處理(上)

- 整合 free5GC 實作低延遲資料層處理(下)

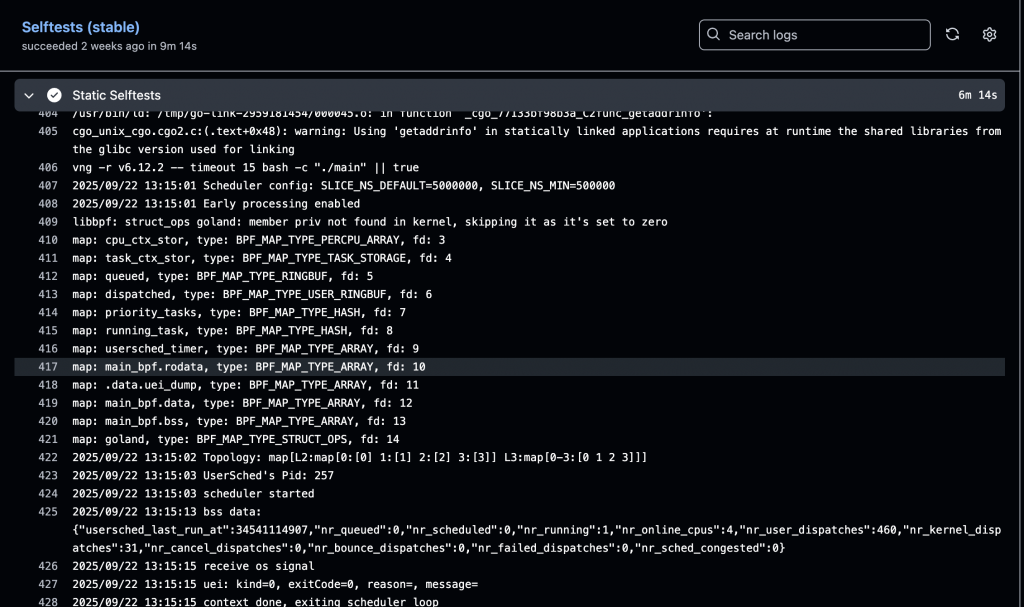

- 實作自動化測試流水線

- AI 賦能的智慧排程器

- 可插拔式排程器

- 使用 plugin 模式實作簡易排程器

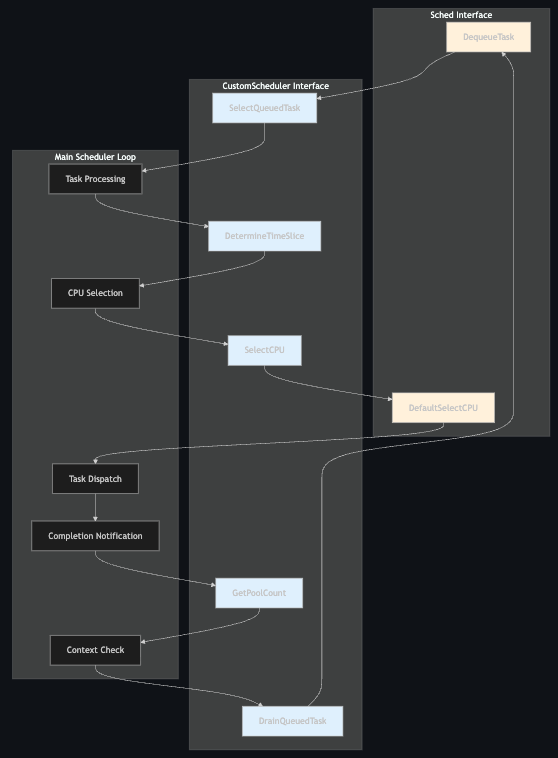

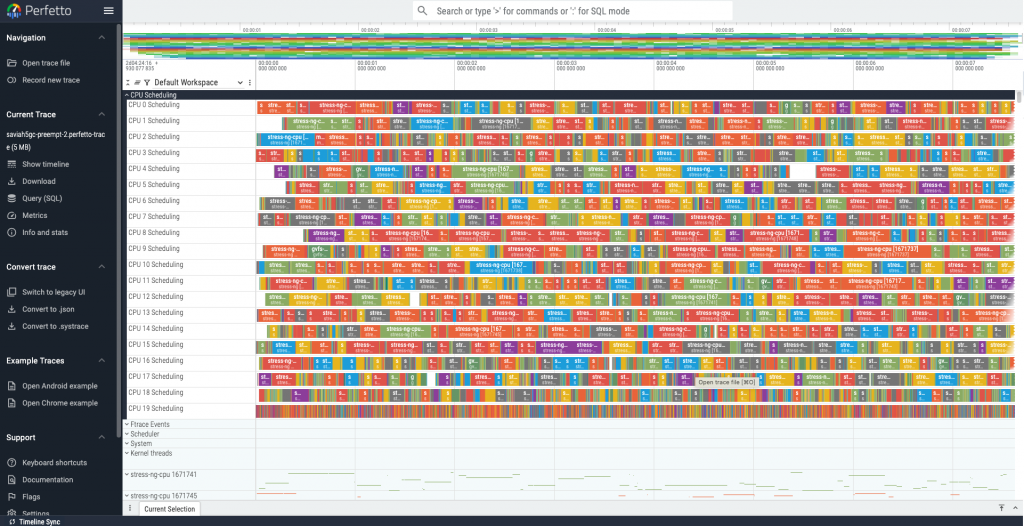

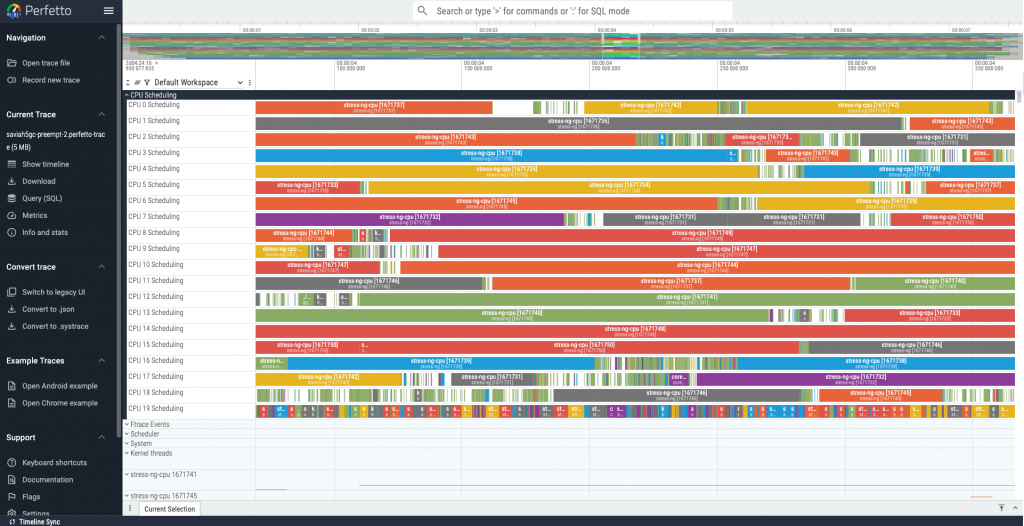

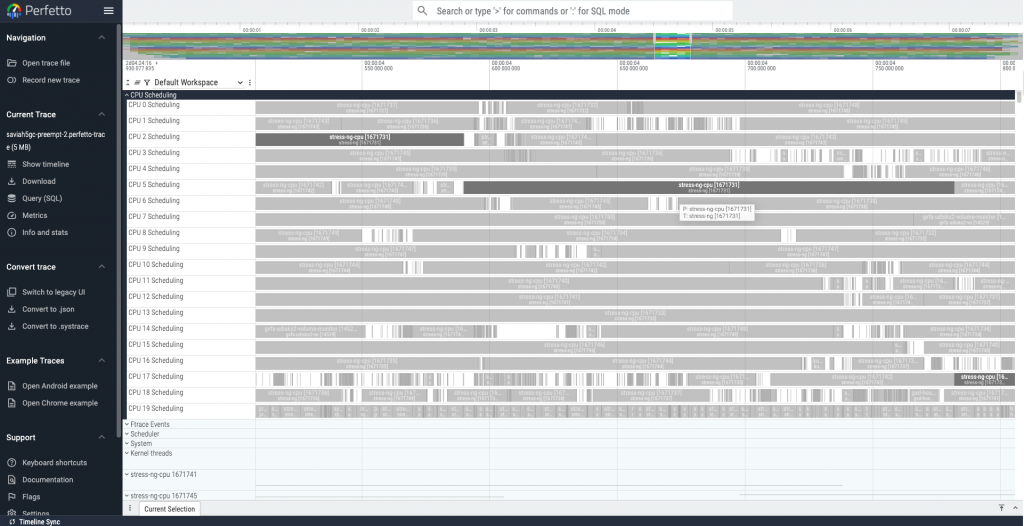

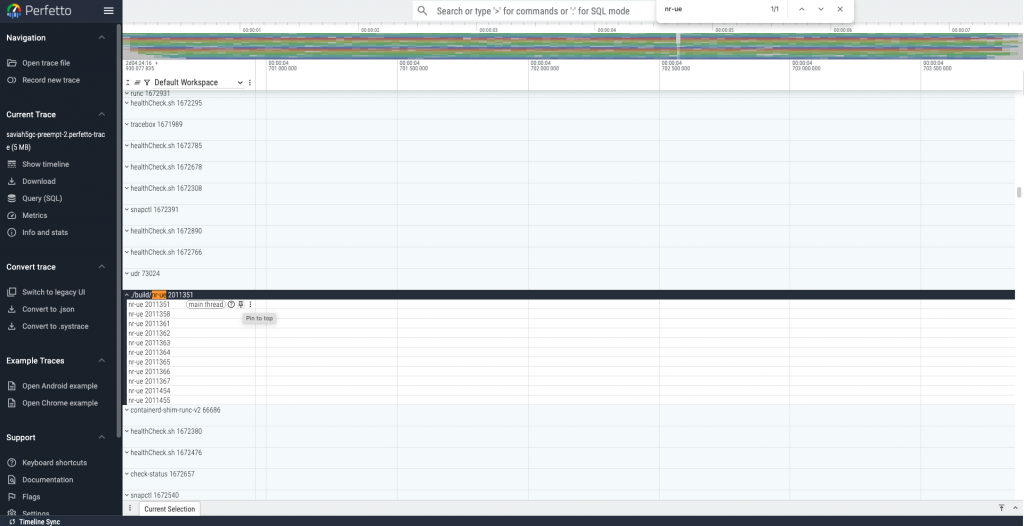

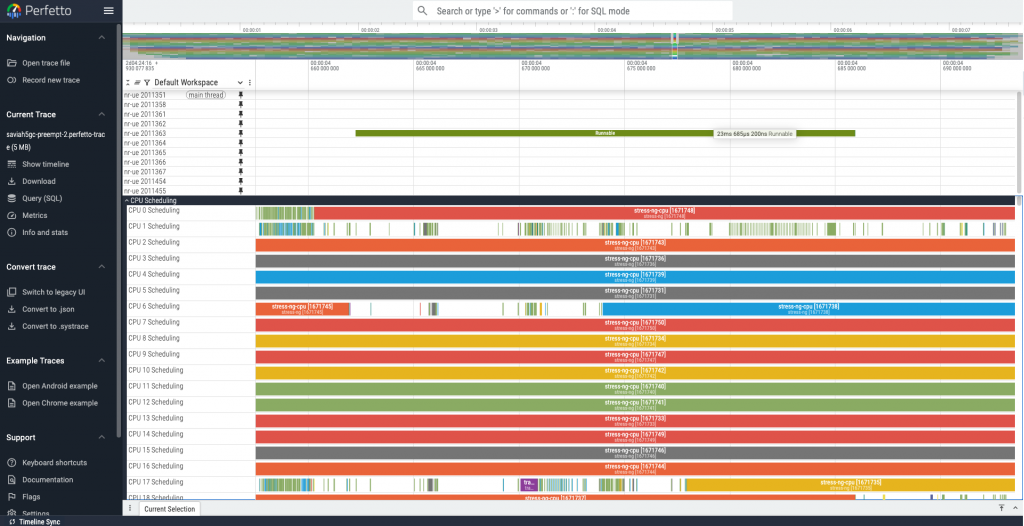

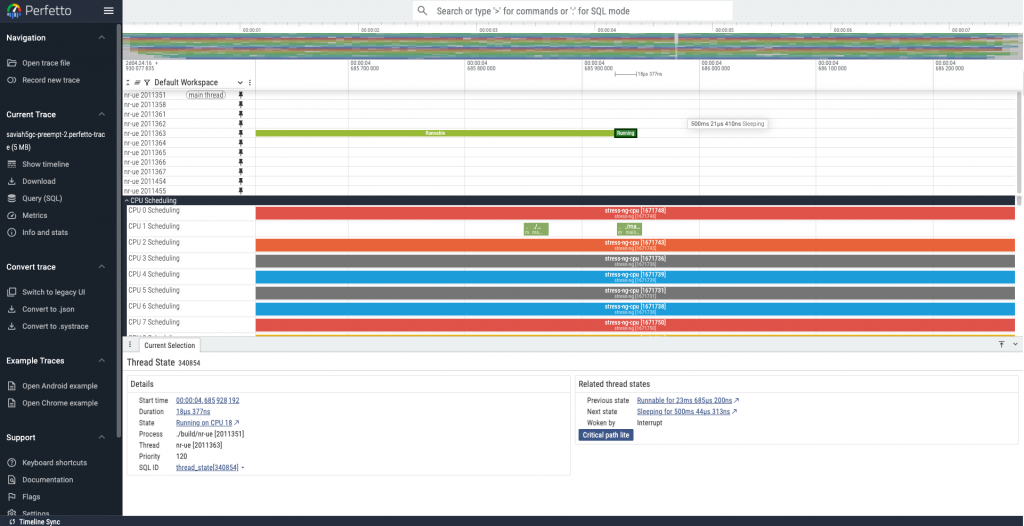

- 使用 perfetto 觀察排程器行為

- 結語

預期成果

完成這個系列後,讀者將能夠:

- 理解 eBPF 技術

- 使用 Golang 開發客製化的系統排程器

- 具備解決實際生產問題的能力

- 為開源社群做出有意義的貢獻

關於筆者

目前任職於禾薪科技,對核心網路與雲原生開發有一定的經驗與理解,目前也是 free5GC(a Linux Foundation project)的 TSC Member、現任微軟 MVP、書籍作家、大學兼任講師,同時跟女友一起經營寵物客製化用品的生意。

Day 2:

- 原文:https://ithelp.ithome.com.tw/articles/10377305

- 發布日期:2025-09-12

如果覺得文章對你有所啟發,可以考慮用 🌟 支持 Gthulhu 專案,短期目標是集齊 300 個 🌟 藉此被 CNCF Landscape 採納 [ref]。

前言

歡迎來到「30 篇文帶你用 eBPF 與 Golang 打造 Linux Scheduler」系列的第一篇!在這個系列中,我們將從零開始深入探索 eBPF(extended Berkeley Packet Filter)技術,並最終實現一個完整的 Linux 排程器。

eBPF 被譽為「Linux 內核的 JavaScript」,它革命性地改變了我們與 Linux 內核互動的方式。但要真正掌握 eBPF,我們必須先了解它的來龍去脈。今天,讓我們一起回顧 eBPF 的誕生與演進史,理解這項技術的設計哲學和發展脈絡。

理論基礎

Classic BPF 的誕生(1992年)

故事要從 1992 年說起。當時,Steven McCanne 和 Van Jacobson 在加州大學柏克萊分校發表了一篇名為「The BSD Packet Filter: A New Architecture for User-level Packet Capture」的論文,提出了 Berkeley Packet Filter(BPF)的概念。

Classic BPF 的設計目標很簡單:在內核空間提供一個安全、高效的封包過濾機制。它的核心思想包括:

-

虛擬機器架構:BPF 定義了一個簡單的虛擬機器,包含:

- 32 位累加器(A)

- 32 位索引暫存器(X)

- 16 個 32 位記憶體位置

- 程式計數器

-

有限的指令集:只支援基本的算術、邏輯和跳躍指令

-

安全性保證:

- 程式必須終止(不允許無限迴圈)

- 只能讀取封包資料,不能修改

- 記憶體存取範圍受限

從 Classic BPF 到 eBPF 的轉變

儘管 Classic BPF 在封包過濾方面表現出色,但隨著系統需求的複雜化,它的局限性也逐漸顯現:

- 功能受限:只能用於封包過濾

- 程式大小限制:最多 4096 條指令

- 缺乏現代特性:沒有函數呼叫、迴圈控制等

2013 年,Alexei Starovoitov 開始著手改造 BPF。他的目標是建立一個更強大、更通用的內核程式設計平台。

PLUMgrid 的貢獻

PLUMgrid 是一家專注於網路虛擬化的公司,他們需要在內核中實現複雜的網路功能。傳統的方法需要修改內核原始碼或載入內核模組,這在雲端環境中是不現實的。

PLUMgrid 團隊意識到,如果能夠擴展 BPF 的能力,就能在不修改內核的情況下實現複雜的網路邏輯。於是他們開發了 iovisor.ko,這是 eBPF 的前身。

Internal BPF 的誕生

2014 年,Alexei Starovoitov 將 PLUMgrid 的工作整合到 Linux 內核中,創造了 Internal BPF(也稱為 eBPF)。這個新的 BPF 虛擬機器有以下特點:

-

64 位架構:

- 10 個 64 位暫存器(r0-r9)

- 512 字節的堆疊空間

- 更大的程式空間

-

豐富的指令集:

- 支援 64 位算術運算

- 原子操作

- 函數呼叫

-

多種程式類型:

- 網路程式(XDP、TC)

- 追蹤程式(kprobe、tracepoint)

- 排程器程式(sched_ext)

筆者補充:

起初 eBPF 的應用偏向可觀測性以及網路封包處理,在近幾年才發展成可用於排程器程式,甚至是 TCP 壅塞演算法的開發。

eBPF 的技術突破

1. Verifier 機制

eBPF 最重要的創新是引入了 Verifier(驗證器)。Verifier 在程式載入時進行靜態分析,確保程式的安全性:

// Verifier 檢查的項目包括:

// 1. 程式必須終止

// 2. 記憶體存取安全

// 3. 函數呼叫合法性

// 4. 暫存器狀態追蹤

static int check_func_call(struct bpf_verifier_env *env,

struct bpf_insn *insn, int *insn_idx)

{

int subprog = find_subprog(env, *insn_idx + insn->imm + 1);

// 檢查函數是否存在

if (subprog < 0) {

verbose(env, "function not found\n");

return -EINVAL;

}

// 檢查呼叫堆疊深度

if (env->subprog_cnt >= BPF_MAX_SUBPROGS) {

verbose(env, "too many subprograms\n");

return -E2BIG;

}

return 0;

}

2. JIT 編譯

eBPF 程式在通過 Verifier 檢查後,會被 JIT(Just-In-Time)編譯器編譯成原生機器碼,實現接近原生程式碼的執行效能。

3. Maps 機制

eBPF Maps 提供了程式與使用者空間、程式與程式之間的資料共享機制:

// 定義一個 Hash Map

struct {

__uint(type, BPF_MAP_TYPE_HASH);

__uint(max_entries, 10000);

__type(key, __u32);

__type(value, __u64);

} packet_count SEC(".maps");

eBPF 在 Linux Kernel 中的地位

核心子系統整合

eBPF 並不是一個獨立的功能,而是深度整合到 Linux 內核的各個子系統中:

-

網路子系統:

- XDP(eXpress Data Path)

- TC(Traffic Control)

- Socket filters

-

追蹤子系統:

- kprobes/kretprobes

- tracepoints

- perf events

-

安全子系統:

- LSM(Linux Security Modules)

- seccomp-bpf

-

排程子系統:

- sched_ext(Linux 6.12+)

設計哲學

eBPF 的設計遵循幾個重要原則:

- 安全第一:所有程式必須通過 Verifier 檢查

- 效能導向:JIT 編譯確保高效執行

- 通用性:一套機制支援多種應用場景

- 向後相容:與 Classic BPF 保持相容性

重要里程碑

讓我們梳理一下 eBPF 發展的重要時間點:

- 1992年:Classic BPF 論文發表

- 2013年:Alexei Starovoitov 開始 eBPF 開發

- 2014年:eBPF 合併到 Linux 3.15

- 2016年:XDP 框架引入(Linux 4.8)

- 2018年:BTF(BPF Type Format)引入

- 2019年:BPF_PROG_TYPE_TRACING 引入

- 2024年:sched_ext 合併到 Linux 6.12

實戰應用:觀察 eBPF 系統

雖然這篇文章主要是理論介紹,但讓我們透過一些簡單的命令來觀察現代 Linux 系統中的 eBPF:

檢查 eBPF 支援

# 檢查內核是否支援 eBPF

grep CONFIG_BPF /boot/config-$(uname -r)

# 檢查 BTF 支援

ls -la /sys/kernel/btf/vmlinux

# 檢查可用的 BPF 程式類型

cat /proc/kallsyms | grep bpf_prog_type

觀察已載入的 eBPF 程式

# 安裝 bpftool(如果尚未安裝)

sudo apt update && sudo apt install linux-tools-common linux-tools-generic

# 列出所有已載入的 eBPF 程式

sudo bpftool prog list

# 列出所有 eBPF Maps

sudo bpftool map list

# 檢視特定程式的詳細資訊

sudo bpftool prog show id <PROG_ID> --pretty

觀察 eBPF 系統統計

# 檢視 eBPF 相關的內核統計

cat /proc/kallsyms | grep -E "bpf_|ebpf_" | wc -l

# 檢查 eBPF 程式的輸出

sudo cat /sys/kernel/debug/tracing/trace_pipe

深度分析:為什麼 eBPF 如此重要?

1. 安全性與隔離性

傳統的內核模組開發需要管理員權限,並且一個錯誤可能導致整個系統崩潰。eBPF 透過 Verifier 提供了安全的內核程式設計環境:

// Verifier 確保這個程式是安全的

SEC("xdp")

int xdp_drop_packets(struct xdp_md *ctx)

{

void *data_end = (void *)(long)ctx->data_end;

void *data = (void *)(long)ctx->data;

struct ethhdr *eth = data;

// Verifier 檢查邊界

if (eth + 1 > data_end)

return XDP_PASS;

// 只能返回預定義的值

if (eth->h_proto == bpf_htons(ETH_P_IP))

return XDP_DROP;

return XDP_PASS;

}

2. 效能優勢

eBPF 程式執行在內核空間,避免了使用者空間與內核空間的切換開銷:

- 零拷貝:直接在內核處理資料

- JIT 編譯:接近原生程式碼的效能

- 批次處理:可以批次處理多個事件

3. 可觀測性革命

eBPF 讓系統可觀測性達到了前所未有的程度:

// 追蹤系統呼叫,且開銷非常低

SEC("tracepoint/syscalls/sys_enter_openat")

int trace_openat(struct trace_event_raw_sys_enter *ctx)

{

char filename[256];

bpf_probe_read_user_str(filename, sizeof(filename),

(void *)ctx->args[1]);

bpf_printk("Process %d opening file: %s\n",

bpf_get_current_pid_tgid() >> 32, filename);

return 0;

}

筆者補充:

這邊 Copilot 給的範例比較古老,自 Linux v5.5 開始支援了更接近 zero overhead 的方式(利用 eBPF Trampolines),請參考:

總結

eBPF 的設計使它被多家科技公司採納,也因此得以在 kernel 社群中快速成長。我們可以預期 eBPF 在未來將被應用在 kernel 中的各個領域,以更安全、高效的方式提供給開發者一個全新的選擇。

在下一篇文章中,我們將深入探討 eBPF 的核心架構,包括虛擬機器、指令集、Verifier 機制等。這些知識將為我們後續的實作打下堅實的基礎。

Day 3:

- 原文:https://ithelp.ithome.com.tw/articles/10379593

- 發布日期:2025-09-13

如果覺得文章對你有所啟發,可以考慮用 🌟 支持 Gthulhu 專案,短期目標是集齊 300 個 🌟 藉此被 CNCF Landscape 採納 [ref]。

前言

在上一篇文章中,我們回顧了 eBPF 的誕生與演進史,了解了從 Classic BPF 到 eBPF 的技術發展脈絡。今天,我們將深入 eBPF 的核心架構,探討它的虛擬機器設計、指令集架構、Verifier 機制以及 JIT 編譯器的工作原理。

理解 eBPF 的架構設計對於後續的程式開發至關重要。只有掌握了這些底層機制,我們才能寫出高效、安全的 eBPF 程式。

理論基礎

eBPF 虛擬機器架構

eBPF 虛擬機器是一個 64 位的 RISC(精簡指令集)架構,專門設計用於在 Linux 內核中安全高效地執行使用者程式碼。

暫存器設計

eBPF VM 包含 11 個 64 位暫存器:

// eBPF 暫存器定義

enum {

BPF_REG_0 = 0, // 返回值暫存器

BPF_REG_1, // 函數參數 1 / 程式 context

BPF_REG_2, // 函數參數 2

BPF_REG_3, // 函數參數 3

BPF_REG_4, // 函數參數 4

BPF_REG_5, // 函數參數 5

BPF_REG_6, // 被呼叫者保存暫存器

BPF_REG_7, // 被呼叫者保存暫存器

BPF_REG_8, // 被呼叫者保存暫存器

BPF_REG_9, // 被呼叫者保存暫存器

BPF_REG_10, // 堆疊指標(Read Only)

__MAX_BPF_REG,

};

每個暫存器都有特定的用途:

- R0:存放函數返回值和程式退出碼

- R1-R5:函數參數傳遞

- R6-R9:被呼叫者保存暫存器(callee-saved)

- R10:堆疊指標,指向 512 字節的堆疊空間

記憶體模型

eBPF 程式的記憶體空間分為幾個部分:

- 程式記憶體:存放 eBPF 指令

- 堆疊記憶體:512 字節的堆疊空間

- Map 記憶體:透過 BPF Maps 存取的共享記憶體

- Context 記憶體:程式輸入參數(如封包資料)

eBPF 指令集架構

指令格式

每個 eBPF 指令都是 64 位(8 字節),格式如下:

struct bpf_insn {

__u8 code; // 操作碼

__u8 dst_reg:4; // 目標暫存器

__u8 src_reg:4; // 來源暫存器

__s16 off; // 偏移量

__s32 imm; // 立即數

};

指令分類

eBPF 指令可以分為以下幾類:

1. 算術指令

// 64 位加法:dst_reg += src_reg

BPF_ALU64 | BPF_ADD | BPF_X

// 32 位加法:dst_reg += imm

BPF_ALU | BPF_ADD | BPF_K

// 示例:計算兩個數的和

BPF_MOV64_IMM(BPF_REG_1, 10), // r1 = 10

BPF_MOV64_IMM(BPF_REG_2, 20), // r2 = 20

BPF_ALU64_REG(BPF_ADD, BPF_REG_1, BPF_REG_2), // r1 += r2

2. 跳躍指令

// 無條件跳躍

BPF_JMP | BPF_JA

// 條件跳躍:if (dst_reg == src_reg) goto pc + off

BPF_JMP | BPF_JEQ | BPF_X

// 示例:簡單的條件判斷

BPF_MOV64_IMM(BPF_REG_1, 42), // r1 = 42

BPF_JMP_IMM(BPF_JEQ, BPF_REG_1, 42, 2), // if r1 == 42 goto +2

BPF_MOV64_IMM(BPF_REG_0, 0), // r0 = 0 (false case)

BPF_EXIT_INSN(), // exit

BPF_MOV64_IMM(BPF_REG_0, 1), // r0 = 1 (true case)

BPF_EXIT_INSN(), // exit

3. 記憶體指令

// 載入指令:dst_reg = *(size *)(src_reg + off)

BPF_MEM | BPF_LDX | BPF_W // 載入 32 位

BPF_MEM | BPF_LDX | BPF_DW // 載入 64 位

// 儲存指令:*(size *)(dst_reg + off) = src_reg

BPF_MEM | BPF_STX | BPF_W // 儲存 32 位

BPF_MEM | BPF_STX | BPF_DW // 儲存 64 位

// 示例:存取堆疊變數

BPF_MOV64_IMM(BPF_REG_1, 123), // r1 = 123

BPF_STX_MEM(BPF_DW, BPF_REG_10, BPF_REG_1, -8), // *(u64*)(r10-8) = r1

BPF_LDX_MEM(BPF_DW, BPF_REG_2, BPF_REG_10, -8), // r2 = *(u64*)(r10-8)

4. 函數呼叫指令

// 呼叫 helper 函數

BPF_JMP | BPF_CALL

// 示例:呼叫 bpf_printk

BPF_LD_MAP_FD(BPF_REG_1, fmt_map_fd), // r1 = format string

BPF_MOV64_IMM(BPF_REG_2, 42), // r2 = 42

BPF_CALL_FUNC(BPF_FUNC_trace_printk), // call bpf_trace_printk(r1, r2)

eBPF Verifier 機制深度解析

Verifier 是 eBPF 安全性的核心,它在程式載入時進行靜態分析,確保程式不會對系統造成危害。

Verifier 的工作流程

// 簡化的 Verifier 檢查流程

int bpf_check(struct bpf_prog **prog, union bpf_attr *attr)

{

struct bpf_verifier_env *env;

int ret = -EINVAL;

// 1. 初始化驗證環境

env = kzalloc(sizeof(struct bpf_verifier_env), GFP_KERNEL);

// 2. 基本格式檢查

ret = check_cfg(env);

if (ret < 0)

goto err_free_env;

// 3. 指令層級檢查

ret = do_check(env);

if (ret < 0)

goto err_free_env;

// 4. 特權操作檢查

ret = check_map_access(env);

if (ret < 0)

goto err_free_env;

// 5. 最終最佳化

ret = convert_pseudo_ld_imm64(env);

err_free_env:

kfree(env);

return ret;

}

關鍵檢查項目

1. 控制流程檢查

Verifier 會檢查程式的所有執行路徑:

// 檢查無限迴圈

static int check_cfg(struct bpf_verifier_env *env)

{

int insn_cnt = env->prog->len;

bool *visited;

int ret = 0;

int i;

visited = kcalloc(insn_cnt, sizeof(bool), GFP_KERNEL);

if (!visited)

return -ENOMEM;

// 深度優先搜尋,檢查所有路徑

ret = visit_insn(env, 0, visited);

// 檢查是否有未訪問的指令(dead code)

for (i = 0; i < insn_cnt; i++) {

if (!visited[i]) {

verbose(env, "unreachable insn %d\n", i);

ret = -EINVAL;

break;

}

}

kfree(visited);

return ret;

}

2. 記憶體存取檢查

// 檢查記憶體存取的安全性

static int check_mem_access(struct bpf_verifier_env *env,

int regno, int off, int size,

enum bpf_access_type type)

{

struct bpf_reg_state *reg = &env->cur_state.regs[regno];

// 檢查暫存器類型

if (reg->type != PTR_TO_STACK &&

reg->type != PTR_TO_MAP_VALUE &&

reg->type != PTR_TO_CTX) {

verbose(env, "invalid read from register\n");

return -EACCES;

}

// 檢查存取邊界

if (off < reg->min_value || off + size > reg->max_value) {

verbose(env, "invalid memory access\n");

return -EACCES;

}

// 檢查對齊

if (off % size != 0) {

verbose(env, "misaligned memory access\n");

return -EACCES;

}

return 0;

}

3. 暫存器狀態追蹤

Verifier 會追蹤每個暫存器在程式執行過程中的狀態:

struct bpf_reg_state {

enum bpf_reg_type type; // 暫存器類型

s32 min_value; // 最小可能值

u32 max_value; // 最大可能值

u32 id; // 暫存器 ID

u32 ref_obj_id; // 引用物件 ID

struct tnum var_off; // 變數偏移

};

// 更新暫存器狀態

static void mark_reg_known(struct bpf_reg_state *reg, u64 imm)

{

reg->min_value = imm;

reg->max_value = imm;

reg->var_off = tnum_const(imm);

reg->type = SCALAR_VALUE;

}

JIT 編譯器原理

通過 Verifier 檢查的 eBPF 程式會被 JIT 編譯器編譯成原生機器碼。

JIT 編譯流程

// x86_64 JIT 編譯器的簡化流程

struct bpf_prog *bpf_int_jit_compile(struct bpf_prog *prog)

{

struct bpf_binary_header *header;

struct x64_jit_data *jit_data;

int proglen, oldproglen = 0;

u8 *image = NULL;

int pass;

// 多次遍歷最佳化

for (pass = 0; pass < 20; pass++) {

proglen = do_jit(prog, NULL, 0, &jit_data);

if (proglen <= 0) {

image = NULL;

goto out;

}

// 如果程式大小穩定,分配記憶體並生成程式碼

if (proglen == oldproglen) {

header = bpf_jit_binary_alloc(proglen, &image,

1, jit_fill_hole);

if (!header) {

prog = orig_prog;

goto out;

}

proglen = do_jit(prog, image, proglen, &jit_data);

break;

}

oldproglen = proglen;

}

out:

return prog;

}

指令翻譯示例

讓我們看看一個簡單的 eBPF 指令如何被翻譯成 x86_64 機器碼:

// eBPF 指令:r1 += r2

// BPF_ALU64_REG(BPF_ADD, BPF_REG_1, BPF_REG_2)

static int emit_add(u8 **pprog, u32 dst_reg, u32 src_reg)

{

u8 *prog = *pprog;

// 生成 x86_64 ADD 指令

// 對應 "add %rsi, %rdi" (假設 r1->rdi, r2->rsi)

*prog++ = 0x48; // REX prefix for 64-bit

*prog++ = 0x01; // ADD opcode

*prog++ = 0xfe; // ModR/M byte: add %rsi, %rdi

*pprog = prog;

return 0;

}

Hook 點與程式類型

eBPF 程式必須附加到特定的 Hook 點才能執行。不同的程式類型對應不同的 Hook 點和功能。

主要程式類型

enum bpf_prog_type {

BPF_PROG_TYPE_UNSPEC,

BPF_PROG_TYPE_SOCKET_FILTER, // Socket 過濾器

BPF_PROG_TYPE_KPROBE, // 內核 probe

BPF_PROG_TYPE_SCHED_CLS, // 排程分類器

BPF_PROG_TYPE_SCHED_ACT, // 排程動作

BPF_PROG_TYPE_TRACEPOINT, // 追蹤點

BPF_PROG_TYPE_XDP, // eXpress Data Path

BPF_PROG_TYPE_PERF_EVENT, // perf 事件

BPF_PROG_TYPE_CGROUP_SKB, // cgroup skb

BPF_PROG_TYPE_CGROUP_SOCK, // cgroup socket

BPF_PROG_TYPE_CGROUP_DEVICE, // cgroup 裝置

BPF_PROG_TYPE_SK_MSG, // socket message

BPF_PROG_TYPE_RAW_TRACEPOINT, // 原始追蹤點

BPF_PROG_TYPE_SOCK_OPS, // socket 操作

BPF_PROG_TYPE_SK_SKB, // socket skb

BPF_PROG_TYPE_STRUCT_OPS, // 結構操作

BPF_PROG_TYPE_EXT, // 擴展程式

BPF_PROG_TYPE_LSM, // Linux Security Module

BPF_PROG_TYPE_SK_LOOKUP, // socket lookup

BPF_PROG_TYPE_SYSCALL, // 系統呼叫

};

Context 類型

每種程式類型都有對應的 Context 結構:

// XDP 程式的 Context

struct xdp_md {

__u32 data; // 封包資料開始

__u32 data_end; // 封包資料結束

__u32 data_meta; // metadata 區域

__u32 ingress_ifindex; // 輸入介面索引

__u32 rx_queue_index; // 接收佇列索引

};

// 追蹤程式的 Context

struct pt_regs {

unsigned long r15;

unsigned long r14;

unsigned long r13;

// ... 其他暫存器

unsigned long rip; // 指令指標

unsigned long cs;

unsigned long eflags;

unsigned long rsp; // 堆疊指標

unsigned long ss;

};

實戰演練:解析 eBPF ByteCode

讓我們寫一個簡單的工具來解析 eBPF ByteCode:

// bytecode_analyzer.c

#include <stdio.h>

#include <stdint.h>

#include <linux/bpf.h>

// eBPF 指令操作碼定義

#define BPF_CLASS(code) ((code) & 0x07)

#define BPF_OP(code) ((code) & 0xf0)

#define BPF_SRC(code) ((code) & 0x08)

const char* get_opcode_name(uint8_t code)

{

uint8_t cls = BPF_CLASS(code);

uint8_t op = BPF_OP(code);

switch (cls) {

case BPF_ALU64:

switch (op) {

case BPF_ADD: return "add64";

case BPF_SUB: return "sub64";

case BPF_MUL: return "mul64";

case BPF_DIV: return "div64";

case BPF_MOV: return "mov64";

default: return "unknown_alu64";

}

case BPF_JMP:

switch (op) {

case BPF_JA: return "ja";

case BPF_JEQ: return "jeq";

case BPF_JNE: return "jne";

case BPF_JGT: return "jgt";

case BPF_EXIT: return "exit";

case BPF_CALL: return "call";

default: return "unknown_jmp";

}

case BPF_LD:

return "ld";

case BPF_LDX:

return "ldx";

case BPF_ST:

return "st";

case BPF_STX:

return "stx";

default:

return "unknown";

}

}

void disassemble_insn(struct bpf_insn *insn, int idx)

{

printf("%04d: %s", idx, get_opcode_name(insn->code));

// 根據指令類型顯示操作數

if (BPF_CLASS(insn->code) == BPF_ALU64 ||

BPF_CLASS(insn->code) == BPF_ALU) {

if (BPF_SRC(insn->code) == BPF_K) {

printf(" r%d, #%d", insn->dst_reg, insn->imm);

} else {

printf(" r%d, r%d", insn->dst_reg, insn->src_reg);

}

} else if (BPF_CLASS(insn->code) == BPF_JMP) {

if (insn->code == (BPF_JMP | BPF_CALL)) {

printf(" %d", insn->imm);

} else if (insn->code == (BPF_JMP | BPF_JA)) {

printf(" %+d", insn->off);

} else {

printf(" r%d, r%d, %+d", insn->dst_reg, insn->src_reg, insn->off);

}

}

printf("\n");

}

int main()

{

// 簡單的 eBPF 程式:return 42

struct bpf_insn program[] = {

BPF_MOV64_IMM(BPF_REG_0, 42), // r0 = 42

BPF_EXIT_INSN(), // exit

};

int insn_count = sizeof(program) / sizeof(program[0]);

printf("eBPF ByteCode 反組譯:\n");

printf("===================\n");

for (int i = 0; i < insn_count; i++) {

disassemble_insn(&program[i], i);

}

return 0;

}

編譯並執行:

# Makefile

CC = gcc

CFLAGS = -Wall -Wextra -std=c99

bytecode_analyzer: bytecode_analyzer.c

$(CC) $(CFLAGS) -o $@ $<

clean:

rm -f bytecode_analyzer

.PHONY: clean

make bytecode_analyzer

./bytecode_analyzer

預期輸出:

eBPF ByteCode 反組譯:

===================

0000: mov64 r0, #42

0001: exit

深度分析:eBPF 的設計權衡

1. 安全性 vs 效能

eBPF 在設計時面臨安全性和效能的權衡:

安全性措施:

- Verifier 靜態分析

- 有界迴圈檢查

- 記憶體存取限制

- 特權操作控制

效能最佳化:

- JIT 編譯

- 零拷貝操作

- 內聯 helper 函數

- 暫存器最佳化

2. 通用性 vs 特化

eBPF 既要支援多種應用場景,又要在特定領域有出色表現:

通用性特點:

- 統一的虛擬機器架構

- 標準化的指令集

- 一致的開發工具鏈

特化支援:

- 不同的程式類型

- 專用的 helper 函數

- 特定的 Context 結構

3. 簡潔性 vs 功能性

指令集設計的權衡:

簡潔性:

- 精簡指令集(RISC)

- 統一的指令格式

- 有限的暫存器數量

功能性:

- 64 位運算支援

- 原子操作

- 函數呼叫機制

總結

今天我們深入探討了 eBPF 的核心架構,包括:

- 虛擬機器設計:64 位 RISC 架構,11 個暫存器,512 字節堆疊

- 指令集架構:統一的 64 位指令格式,支援算術、跳躍、記憶體和函數呼叫

- Verifier 機制:多層次的安全檢查,確保程式安全性

- JIT 編譯:將 eBPF 程式編譯成高效的原生機器碼

- Hook 點系統:支援多種程式類型和執行環境

這些底層機制的理解對於編寫高效的 eBPF 程式至關重要。在下一篇文章中,我們將開始搭建 eBPF 開發環境,並實際編寫第一個 eBPF 程式。

Day 4:

- 原文:https://ithelp.ithome.com.tw/articles/10379882

- 發布日期:2025-09-14

如果覺得文章對你有所啟發,可以考慮用 🌟 支持 Gthulhu 專案,短期目標是集齊 300 個 🌟 藉此被 CNCF Landscape 採納 [ref]。

前言

在前兩篇文章中,我們了解了 eBPF 的歷史發展和核心架構。現在是時候動手實作了!但在開始編寫 eBPF 程式之前,我們需要搭建一個完整的開發環境。

eBPF 開發需要特定的內核支援、編譯工具鏈和函式庫。今天我們將一步步搭建這個環境,確保後續的開發工作能夠順利進行。

理論基礎

eBPF 開發環境需求

要進行 eBPF 開發,我們需要以下組件:

- Linux 內核:支援 eBPF 和 BTF 的現代內核(推薦 6.12+ 以使用 sched_ext)

- 編譯工具鏈:LLVM/Clang 17+,支援 eBPF 目標

- 開發函式庫:libbpf、libbpfgo

- 開發工具:bpftool、pahole

- 除錯工具:trace-cmd、perf

BTF(BPF Type Format)的重要性

BTF 是 eBPF 生態系統的重要組成部分,它提供:

- 型別資訊保存:將 C 結構體資訊嵌入內核

- CO-RE 支援:一次編譯,到處執行

- 除錯資訊:更好的除錯體驗

- 反射能力:執行時型別檢查

在 Ubuntu 25.04 上安裝 Gthulhu

為了節省各位的時間,我們直接跳過編譯 kernel 與安裝 kernel 的過程,使用直接支援 sched_ext 的 Ubuntu 25.04 。

讀者可以直接使用以下腳本安裝必要的套件:

sudo apt-get update

sudo apt-get install --yes bsdutils

sudo apt-get install --yes build-essential

sudo apt-get install --yes pkgconf

sudo apt-get install --yes llvm-17 clang-17 clang-format-17

sudo apt-get install --yes libbpf-dev libelf-dev libzstd-dev zlib1g-dev

sudo apt-get install --yes virtme-ng

sudo apt-get install --yes gcc-multilib

sudo apt-get install --yes systemtap-sdt-dev

sudo apt-get install --yes python3 python3-pip ninja-build

sudo apt-get install --yes libseccomp-dev protobuf-compiler

sudo apt-get install --yes meson cmake

for tool in "clang" "clang-format" "llc" "llvm-strip"

do

sudo rm -f /usr/bin/$tool

sudo ln -s /usr/bin/$tool-17 /usr/bin/$tool

done

curl --proto '=https' --tlsv1.2 -sSf https://sh.rustup.rs | sh

source $HOME/.cargo/env

這些套件包含了所有編譯 scx 的必要套件。

在編譯 Gthulhu 之前,我們還需要安裝 golang:

wget https://go.dev/dl/go1.24.2.linux-amd64.tar.gz

sudo tar -C /usr/local -xzf go1.24.2.linux-amd64.tar.gz

新增以下內容至 ~/.profile:

export GOROOT=/usr/local/go

export GOPATH=$HOME/go

export PATH=$GOROOT/bin:$GOPATH/bin:$PATH

新增後,記得使用 source ~/.profile 讓變更的內容生效。

安裝完必要套件後,安裝 Gthulhu:

git clone https://github.com/Gthulhu/Gthulhu.git

cd Gthulhu

make dep

git submodule init

git submodule sync

git submodule update

cd scx

meson setup build --prefix ~

meson compile -C build

cd ..

cd libbpfgo

make

cd ..

make

編譯完成後,Gthulhu 理應能順利執行在你的系統上:

問題一:undefined reference to eu_search_tree_init

如果你遇到了類似的問題,是因為目前系統使用的是 elfutils 版的 libelf,你可以自行下載與編譯 libelf 來解決這個問題:

sudo apt remove --purge elfutils libelf-dev

cd ~

git clone https://github.com/arachsys/libelf.git

cd libelf

make

sudo make install

問題二:ERROR: Program 'clang' not found or not executable

如果你在執行 meson setup build --prefix ~ 命令時遇到該問題,可以嘗試以下命令:

sudo update-alternatives --install /usr/bin/clang clang /usr/bin/clang-17 100

sudo update-alternatives --install /usr/bin/llvm-strip llvm-strip /usr/bin/llvm-strip-17 100

深度分析:開發工具鏈的選擇

LLVM vs GCC

為什麼 eBPF 使用 LLVM 而不是 GCC?

- eBPF 後端支援:LLVM 率先支援 eBPF 目標架構

- 社群驅動:eBPF 社群主要圍繞 LLVM 生態發展

- 最佳化品質:LLVM 的 eBPF 後端最佳化更成熟

- 工具鏈整合:更好的工具鏈整合和除錯支援

libbpf vs 其他函式庫

libbpf 的優勢:

- 官方支援:Linux 內核官方維護

- 完整功能:支援所有 eBPF 功能

- 向前相容:與新內核功能同步更新

- CO-RE 支援:完整的 CO-RE 功能實現

BTF 的重要性

BTF 為什麼如此重要:

// 沒有 BTF 的時代,需要手動定義結構

struct task_struct_offsets {

int pid_offset;

int comm_offset;

int cred_offset;

};

// 有了 BTF,可以直接使用

#include "vmlinux.h"

// task_struct 定義自動可用,支援不同內核版本

除錯和監控工具設定

設定 trace-cmd

# 安裝 trace-cmd

sudo apt install -y trace-cmd

# 或從源碼編譯

git clone https://git.kernel.org/pub/scm/utils/trace-cmd/trace-cmd.git

cd trace-cmd

make -j$(nproc)

sudo make install

設定 perf 工具

# 安裝 perf

sudo apt install -y linux-perf

# 或從內核源碼編譯

cd linux/tools/perf

make -j$(nproc)

sudo make install

eBPF 除錯設定

# 掛載 debugfs(如果未掛載)

sudo mount -t debugfs none /sys/kernel/debug

# 掛載 bpffs(如果未掛載)

sudo mount -t bpf none /sys/fs/bpf

# 設定權限(可選,用於非 root 使用者)

sudo chown $USER:$USER /sys/fs/bpf

總結

今天我們完成了 eBPF 開發環境的搭建,包括:

- 內核準備:確保支援 eBPF 和 BTF 功能

- 工具鏈安裝:LLVM/Clang、bpftool、pahole

- 函式庫安裝:libbpf、libbpfgo

- 環境驗證:完整的檢查和測試流程

- 開發工作流程:專案結構和建置系統

一個正確配置的開發環境是成功進行 eBPF 開發的基礎。在下一篇文章中,我們將使用這個環境編寫第一個 eBPF 程式。

Day 5:

- 原文:https://ithelp.ithome.com.tw/articles/10380334

- 發布日期:2025-09-15

如果覺得文章對你有所啟發,可以考慮用 🌟 支持 Gthulhu 專案,短期目標是集齊 300 個 🌟 藉此被 CNCF Landscape 採納 [ref]。

前言

經過前面三篇文章的鋪墊,我們已經了解了 eBPF 的歷史、架構,並搭建好了完整的開發環境。現在終於到了最激動人心的時刻 —— 編寫第一個 eBPF 程式!

今天我們將從最簡單的 "Hello World" 開始,學習 eBPF 程式的基本結構、編譯流程,以及如何使用 Go 語言載入和管理 eBPF 程式。

理論基礎

eBPF 程式的生命週期

一個 eBPF 程式從編寫到執行需要經歷以下步驟:

- 編寫:使用 C 語言編寫 eBPF 程式

- 編譯:使用 Clang 編譯為 eBPF 字節碼

- 載入:透過系統呼叫載入到內核

- 驗證:內核 Verifier 檢查程式安全性

- JIT 編譯:編譯為原生機器碼

- 附加:附加到特定的 Hook 點

- 執行:響應系統事件執行程式

- 卸載:程式生命週期結束時清理

eBPF 程式的基本結構

每個 eBPF 程式都包含:

// 1. 標頭檔包含

#include <linux/bpf.h>

#include <bpf/bpf_helpers.h>

// 2. 程式定義(使用 SEC 宏標記)

SEC("program_type")

int program_function(struct context *ctx) {

// 程式邏輯

return 0;

}

// 3. 授權聲明(必需)

char _license[] SEC("license") = "GPL";

實作演練:Hello World 程式

第一步:建立專案結構

mkdir -p ~/ebpf-hello-world/{src/kernel,src/userspace,headers,bin}

cd ~/ebpf-hello-world

# 建立專案結構

tree

預期結構:

ebpf-hello-world/

├── src/

│ ├── kernel/

│ └── userspace/

├── headers/

├── bin/

├── Makefile

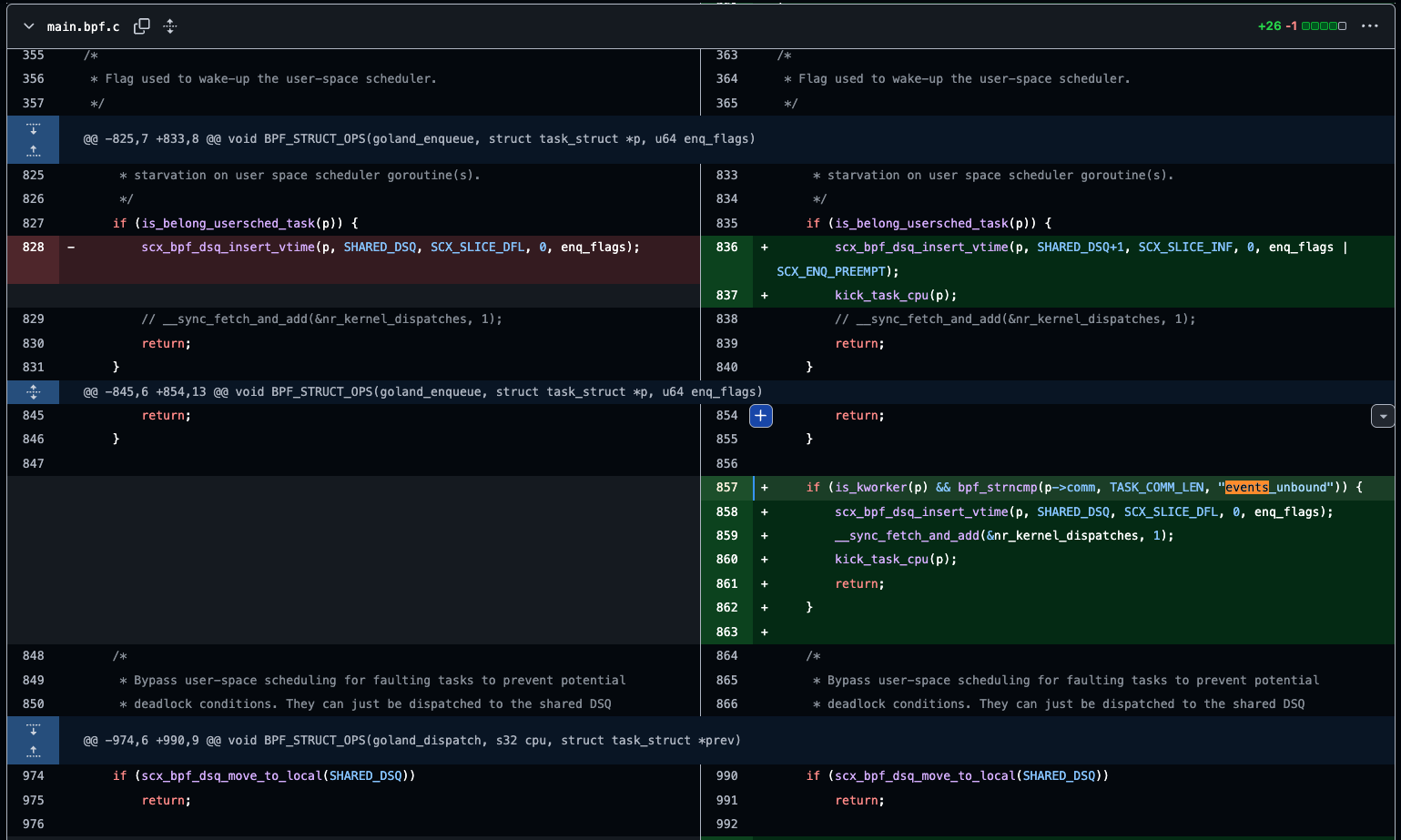

└── go.mod

第二步:編寫 eBPF 程式

建立我們的第一個 eBPF 程式:

// src/kernel/hello.bpf.c

#include "vmlinux.h"

#include <bpf/bpf_helpers.h>

#include <bpf/bpf_tracing.h>

// 定義一個字符映射,用於格式化輸出

char LICENSE[] SEC("license") = "GPL";

// 定義一個簡單的追蹤點程式

SEC("tp/syscalls/sys_enter_openat")

int trace_openat(struct trace_event_raw_sys_enter *ctx)

{

// 獲取當前程序的 PID 和 TID

u64 pid_tgid = bpf_get_current_pid_tgid();

u32 pid = pid_tgid >> 32;

u32 tid = pid_tgid & 0xffffffff;

// 獲取使用者 ID

u64 uid_gid = bpf_get_current_uid_gid();

u32 uid = uid_gid & 0xffffffff;

// 獲取程序名稱

char comm[16];

bpf_get_current_comm(&comm, sizeof(comm));

// 使用 bpf_printk 輸出資訊

bpf_printk("Hello from eBPF! PID=%d, TID=%d, UID=%d, COMM=%s\n",

pid, tid, uid, comm);

return 0;

}

// 定義一個更簡單的追蹤程式

SEC("tp/syscalls/sys_enter_write")

int trace_write(struct trace_event_raw_sys_enter *ctx)

{

// 簡單的計數輸出

static u64 count = 0;

count++;

bpf_printk("Write syscall #%llu\n", count);

return 0;

}

// 定義一個 kprobe 程式

SEC("kprobe/do_sys_openat2")

int kprobe_openat(struct pt_regs *ctx)

{

// 從暫存器獲取參數

int dfd = (int)PT_REGS_PARM1(ctx);

const char __user *filename = (const char __user *)PT_REGS_PARM2(ctx);

// 獲取檔案名(前 64 個字符)

char fname[64];

bpf_probe_read_user_str(fname, sizeof(fname), filename);

bpf_printk("Opening file: %s (dfd=%d)\n", fname, dfd);

return 0;

}

第三步:生成 vmlinux.h

# 生成包含所有內核型別定義的標頭檔

bpftool btf dump file /sys/kernel/btf/vmlinux format c > headers/vmlinux.h

# 檢查檔案大小(應該很大,幾MB)

ls -lh headers/vmlinux.h

第四步:建立 Makefile

# Makefile

CLANG := clang

LLVM_STRIP := llvm-strip

BPFTOOL := bpftool

GO := go

# 編譯器設定

CLANG_BPF_SYS_INCLUDES := $(shell $(CLANG) -v -E - </dev/null 2>&1 \

| sed -n '/<...> search starts here:/,/End of search list./{ //!p }')

BPF_CFLAGS := -g -O2 -Wall -Werror -target bpf -D__TARGET_ARCH_x86 \

$(foreach dir,$(CLANG_BPF_SYS_INCLUDES),-idirafter $(dir))

# 目錄定義

KERNEL_SRC := src/kernel

USERSPACE_SRC := src/userspace

HEADERS := headers

# 目標檔案

BPF_OBJ := hello.bpf.o

USERSPACE_BIN := bin/hello

.PHONY: all clean vmlinux.h userspace kernel

all: vmlinux.h kernel userspace

# 生成 vmlinux.h

vmlinux.h:

@echo "生成 vmlinux.h..."

$(BPFTOOL) btf dump file /sys/kernel/btf/vmlinux format c > $(HEADERS)/vmlinux.h

# 編譯 eBPF 程式

kernel: $(BPF_OBJ)

$(BPF_OBJ): $(KERNEL_SRC)/hello.bpf.c | vmlinux.h

@echo "編譯 eBPF 程式..."

$(CLANG) $(BPF_CFLAGS) -I$(HEADERS) -c $< -o $@

$(LLVM_STRIP) -g $@

# 編譯使用者空間程式

userspace: $(USERSPACE_BIN)

$(USERSPACE_BIN): $(USERSPACE_SRC)/main.go | $(BPF_OBJ)

@echo "編譯使用者空間程式..."

mkdir -p bin

$(GO) build -o $@ $<

# 執行程式

run: all

sudo ./$(USERSPACE_BIN)

# 檢視 eBPF 程式資訊

info: $(BPF_OBJ)

$(BPFTOOL) prog load $(BPF_OBJ) /sys/fs/bpf/hello_prog

$(BPFTOOL) prog show pinned /sys/fs/bpf/hello_prog

sudo rm -f /sys/fs/bpf/hello_prog

# 清理

clean:

rm -f *.o $(USERSPACE_BIN) $(HEADERS)/vmlinux.h

# 初始化 Go 模組

init:

$(GO) mod init ebpf-hello-world

$(GO) get github.com/aquasecurity/libbpfgo@latest

# 幫助

help:

@echo "可用目標:"

@echo " all - 編譯所有程式"

@echo " kernel - 編譯 eBPF 程式"

@echo " userspace - 編譯使用者空間程式"

@echo " run - 執行程式"

@echo " info - 顯示 eBPF 程式資訊"

@echo " clean - 清理建置檔案"

@echo " init - 初始化 Go 模組"

第五步:編寫 Go 載入程式

// src/userspace/main.go

package main

import (

"context"

"fmt"

"log"

"os"

"os/signal"

"syscall"

"time"

bpf "github.com/aquasecurity/libbpfgo"

)

func main() {

// 檢查 root 權限

if os.Geteuid() != 0 {

log.Fatal("此程式需要 root 權限執行")

}

// 載入 eBPF 程式

bpfModule, err := bpf.NewModuleFromFile("hello.bpf.o")

if err != nil {

log.Fatalf("載入 eBPF 模組失敗: %v", err)

}

defer bpfModule.Close()

// 載入程式到內核

if err := bpfModule.BPFLoadObject(); err != nil {

log.Fatalf("載入 eBPF 物件失敗: %v", err)

}

fmt.Println("✓ eBPF 程式載入成功")

// 獲取並附加追蹤點程式

progOpenat, err := bpfModule.GetProgram("trace_openat")

if err != nil {

log.Fatalf("獲取 trace_openat 程式失敗: %v", err)

}

progWrite, err := bpfModule.GetProgram("trace_write")

if err != nil {

log.Fatalf("獲取 trace_write 程式失敗: %v", err)

}

progKprobe, err := bpfModule.GetProgram("kprobe_openat")

if err != nil {

log.Fatalf("獲取 kprobe_openat 程式失敗: %v", err)

}

// 附加到追蹤點

linkOpenat, err := progOpenat.AttachTracepoint(&bpf.TracepointOpts{

Group: "syscalls",

Name: "sys_enter_openat",

})

if err != nil {

log.Fatalf("附加 openat 追蹤點失敗: %v", err)

}

defer linkOpenat.Close()

linkWrite, err := progWrite.AttachTracepoint(&bpf.TracepointOpts{

Group: "syscalls",

Name: "sys_enter_write",

})

if err != nil {

log.Fatalf("附加 write 追蹤點失敗: %v", err)

}

defer linkWrite.Close()

// 附加 kprobe

linkKprobe, err := progKprobe.AttachKprobe(&bpf.KprobeOpts{

Symbol: "do_sys_openat2",

})

if err != nil {

log.Fatalf("附加 kprobe 失敗: %v", err)

}

defer linkKprobe.Close()

fmt.Println("✓ 所有程式附加成功")

fmt.Println("正在追蹤系統呼叫...")

fmt.Println("請在另一個終端執行一些檔案操作,如:")

fmt.Println(" ls /tmp")

fmt.Println(" echo 'test' > /tmp/test.txt")

fmt.Println(" cat /tmp/test.txt")

fmt.Println()

fmt.Println("檢視輸出:sudo cat /sys/kernel/debug/tracing/trace_pipe")

fmt.Println("按 Ctrl+C 退出...")

// 設定信號處理

ctx, cancel := context.WithCancel(context.Background())

defer cancel()

sigChan := make(chan os.Signal, 1)

signal.Notify(sigChan, syscall.SIGINT, syscall.SIGTERM)

// 定期輸出統計資訊

ticker := time.NewTicker(5 * time.Second)

defer ticker.Stop()

startTime := time.Now()

for {

select {

case <-ctx.Done():

return

case sig := <-sigChan:

fmt.Printf("\n收到信號 %v,正在退出...\n", sig)

cancel()

case <-ticker.C:

uptime := time.Since(startTime)

fmt.Printf("程式運行時間: %v\n", uptime.Round(time.Second))

}

}

}

第六步:初始化和建置

# 初始化 Go 模組

make init

# 建置所有組件

make all

# 檢查建置結果

ls -la *.o bin/

第七步:執行程式

# 執行 Hello World 程式(需要 root 權限)

sudo make run

在另一個終端中,執行一些檔案操作來觸發追蹤:

# 在另一個終端執行

ls /tmp

echo "Hello eBPF!" > /tmp/test.txt

cat /tmp/test.txt

rm /tmp/test.txt

第八步:觀察輸出

在第三個終端中觀察 eBPF 程式的輸出:

# 觀察追蹤輸出

sudo cat /sys/kernel/debug/tracing/trace_pipe

你應該看到類似這樣的輸出:

bash-1234 [001] .... 12345.678901: bpf_trace_printk: Hello from eBPF! PID=1234, TID=1234, UID=1000, COMM=bash

bash-1234 [001] .... 12345.678902: bpf_trace_printk: Opening file: /tmp/test.txt (dfd=-100)

cat-1235 [002] .... 12345.678903: bpf_trace_printk: Write syscall #1

cat-1235 [002] .... 12345.678904: bpf_trace_printk: Hello from eBPF! PID=1235, TID=1235, UID=1000, COMM=cat

深度分析:Hello World 程式的工作原理

1. SEC() 宏的作用

SEC("tp/syscalls/sys_enter_openat")

SEC() 宏告訴編譯器和載入器:

- 這是一個 eBPF 程式

- 程式類型是追蹤點(tracepoint)

- 要附加到

syscalls/sys_enter_openat追蹤點

2. Context 結構

不同類型的 eBPF 程式有不同的 Context:

// 追蹤點程式的 Context

struct trace_event_raw_sys_enter *ctx

// kprobe 程式的 Context

struct pt_regs *ctx

// XDP 程式的 Context

struct xdp_md *ctx

3. Helper 函數的使用

我們使用了幾個重要的 helper 函數:

// 獲取程序 ID 和線程 ID

u64 pid_tgid = bpf_get_current_pid_tgid();

// 獲取程序名稱

bpf_get_current_comm(&comm, sizeof(comm));

// 讀取使用者空間字串

bpf_probe_read_user_str(fname, sizeof(fname), filename);

// 輸出除錯資訊

bpf_printk("格式化字串", 參數...);

4. Go 載入器的工作

Go 程式的主要職責:

- 載入模組:讀取 .o 檔案

- 載入物件:呼叫 BPF 系統呼叫

- 獲取程式:找到特定的 eBPF 程式

- 附加程式:將程式附加到 Hook 點

- 管理生命週期:處理信號和清理

實戰應用:改進和擴展

1. 新增 Maps 支援

讓我們改進程式,新增一個 Map 來統計檔案操作:

// src/kernel/hello_with_maps.bpf.c

#include "vmlinux.h"

#include <bpf/bpf_helpers.h>

#include <bpf/bpf_tracing.h>

// 定義一個 Hash Map 來統計檔案操作

struct {

__uint(type, BPF_MAP_TYPE_HASH);

__uint(max_entries, 10000);

__type(key, u32); // PID

__type(value, u64); // 計數

} file_ops_count SEC(".maps");

// 定義一個陣列 Map 來儲存統計資訊

struct file_stats {

u64 total_opens;

u64 total_writes;

u64 total_reads;

};

struct {

__uint(type, BPF_MAP_TYPE_ARRAY);

__uint(max_entries, 1);

__type(key, u32);

__type(value, struct file_stats);

} global_stats SEC(".maps");

char LICENSE[] SEC("license") = "GPL";

SEC("tp/syscalls/sys_enter_openat")

int trace_openat_with_stats(struct trace_event_raw_sys_enter *ctx)

{

u32 pid = bpf_get_current_pid_tgid() >> 32;

u64 *count;

// 更新每個程序的計數

count = bpf_map_lookup_elem(&file_ops_count, &pid);

if (count) {

__sync_fetch_and_add(count, 1);

} else {

u64 initial_count = 1;

bpf_map_update_elem(&file_ops_count, &pid, &initial_count, BPF_ANY);

}

// 更新全局統計

u32 key = 0;

struct file_stats *stats = bpf_map_lookup_elem(&global_stats, &key);

if (stats) {

__sync_fetch_and_add(&stats->total_opens, 1);

} else {

struct file_stats initial_stats = {1, 0, 0};

bpf_map_update_elem(&global_stats, &key, &initial_stats, BPF_ANY);

}

// 獲取檔案名稱並輸出

char comm[16];

bpf_get_current_comm(&comm, sizeof(comm));

bpf_printk("PID %d (%s) opened file, total opens: %llu\n",

pid, comm, stats ? stats->total_opens : 1);

return 0;

}

對應的 Go 程式讀取 Map 資料:

// src/userspace/main_with_maps.go

package main

import (

"fmt"

"log"

"os"

"time"

"unsafe"

bpf "github.com/aquasecurity/libbpfgo"

)

type FileStats struct {

TotalOpens uint64

TotalWrites uint64

TotalReads uint64

}

func main() {

if os.Geteuid() != 0 {

log.Fatal("需要 root 權限")

}

// 載入程式

bpfModule, err := bpf.NewModuleFromFile("hello_with_maps.bpf.o")

if err != nil {

log.Fatalf("載入失敗: %v", err)

}

defer bpfModule.Close()

if err := bpfModule.BPFLoadObject(); err != nil {

log.Fatalf("載入物件失敗: %v", err)

}

// 附加程式

prog, err := bpfModule.GetProgram("trace_openat_with_stats")

if err != nil {

log.Fatalf("獲取程式失敗: %v", err)

}

link, err := prog.AttachTracepoint(&bpf.TracepointOpts{

Group: "syscalls",

Name: "sys_enter_openat",

})

if err != nil {

log.Fatalf("附加失敗: %v", err)

}

defer link.Close()

// 獲取 Maps

fileOpsMap, err := bpfModule.GetMap("file_ops_count")

if err != nil {

log.Fatalf("獲取 map 失敗: %v", err)

}

globalStatsMap, err := bpfModule.GetMap("global_stats")

if err != nil {

log.Fatalf("獲取 stats map 失敗: %v", err)

}

fmt.Println("eBPF 程式啟動,監控檔案操作...")

// 定期讀取統計資訊

ticker := time.NewTicker(3 * time.Second)

defer ticker.Stop()

for {

select {

case <-ticker.C:

fmt.Println("\n=== 統計資訊 ===")

// 讀取全局統計

key := uint32(0)

statsBytes, err := globalStatsMap.GetValue(unsafe.Pointer(&key))

if err == nil && len(statsBytes) == int(unsafe.Sizeof(FileStats{})) {

stats := (*FileStats)(unsafe.Pointer(&statsBytes[0]))

fmt.Printf("總檔案開啟次數: %d\n", stats.TotalOpens)

}

// 讀取前幾個程序的統計

fmt.Println("\n各程序檔案操作次數:")

iterator := fileOpsMap.Iterator()

count := 0

for iterator.Next() && count < 5 {

keyBytes := iterator.Key()

valueBytes, _ := iterator.Value()

if len(keyBytes) == 4 && len(valueBytes) == 8 {

pid := *(*uint32)(unsafe.Pointer(&keyBytes[0]))

ops := *(*uint64)(unsafe.Pointer(&valueBytes[0]))

fmt.Printf(" PID %d: %d 次操作\n", pid, ops)

count++

}

}

}

}

}

2. 新增過濾機制

我們可以新增過濾,只監控特定的程序:

// 只監控特定程序名稱

SEC("tp/syscalls/sys_enter_openat")

int trace_filtered_openat(struct trace_event_raw_sys_enter *ctx)

{

char comm[16];

bpf_get_current_comm(&comm, sizeof(comm));

// 只監控 bash 和 cat

if (comm[0] == 'b' && comm[1] == 'a' && comm[2] == 's' && comm[3] == 'h') {

// bash

} else if (comm[0] == 'c' && comm[1] == 'a' && comm[2] == 't') {

// cat

} else {

return 0; // 忽略其他程序

}

bpf_printk("Filtered: %s opened a file\n", comm);

return 0;

}

疑難排解指南

常見編譯錯誤

- 找不到 vmlinux.h

# 解決方法:重新生成

make vmlinux.h

- BPF helper 函數未定義

# 檢查 libbpf 版本

pkg-config --modversion libbpf

# 更新到最新版本

sudo apt update && sudo apt upgrade libbpf-dev

- 載入失敗

# 檢查內核支援

grep CONFIG_BPF /boot/config-$(uname -r)

# 檢查權限

sudo dmesg | grep bpf

除錯技巧

- 檢視 Verifier 日誌

# 啟用詳細 verifier 日誌

echo 2 | sudo tee /proc/sys/kernel/bpf_verbosity

- 使用 bpftool 除錯

# 檢視載入的程式

sudo bpftool prog list

# 檢視程式詳細資訊

sudo bpftool prog show id <ID> --pretty

# 反組譯程式

sudo bpftool prog dump xlated id <ID>

總結

今天我們成功編寫並執行了第一個 eBPF 程式!我們學習了:

- eBPF 程式結構:SEC() 宏、helper 函數、授權聲明

- 編譯流程:從 C 源碼到 eBPF 字節碼

- Go 載入器:使用 libbpfgo 管理 eBPF 程式

- 實際應用:系統呼叫追蹤和統計

- 進階特性:Maps 的使用和資料共享

這個 Hello World 程式為我們後續的學習奠定了基礎。在下一篇文章中,我們將深入探討 eBPF Maps,學習如何在內核和使用者空間之間高效地共享資料。

Day 6:

- 原文:https://ithelp.ithome.com.tw/articles/10381236

- 發布日期:2025-09-16

如果覺得文章對你有所啟發,可以考慮用 🌟 支持 Gthulhu 專案,短期目標是集齊 300 個 🌟 藉此被 CNCF Landscape 採納 [ref]。

前言

在上一篇文章中,我們成功編寫了第一個 eBPF 程式,並學會了基本的程式結構和載入流程。今天我們將深入探討 eBPF Maps——這個連接內核空間和使用者空間的重要橋樑。

eBPF Maps 不僅僅是簡單的資料結構,它們是 eBPF 程式持久化狀態、程式間通訊、以及與使用者空間互動的核心機制。

認識 eBPF Maps

eBPF Maps 的設計理念

eBPF Maps 解決了幾個核心問題:

Maps 的分類

eBPF Maps 可以按照不同維度分類:

按資料結構分類

- Array Maps:基於索引的陣列

- Hash Maps:基於鍵值的雜湊表

- Trie Maps:最長前綴匹配

- Stack/Queue Maps:堆疊和佇列結構

按使用場景分類

- 統計 Maps:Per-CPU Maps、Percpu Array/Hash

- 通訊 Maps:(User-)Ring Buffer、Perf Event Array

- 配置 Maps:Program Array、Map in Map

- 網路 Maps:Socket Maps、Device Maps

筆者補充:詳細的 Map 種類請參考:https://docs.ebpf.io/linux/map-type/

實作演練:深入探索各種 Maps

第一步:專案結構準備

mkdir -p ~/ebpf-maps-demo/{src/kernel,src/userspace,headers,bin}

cd ~/ebpf-maps-demo

# 建立 Makefile 和 Go module

cp ~/ebpf-hello-world/Makefile .

cp ~/ebpf-hello-world/go.mod .

第二步:Array Maps 實作

Array Maps 是最簡單的 Map 型別,適合存儲固定大小的陣列資料。

// src/kernel/array_maps_demo.bpf.c

#include "vmlinux.h"

#include <bpf/bpf_helpers.h>

#include <bpf/bpf_tracing.h>

// 定義一個簡單的陣列 Map

struct {

__uint(type, BPF_MAP_TYPE_ARRAY);

__uint(max_entries, 256); // 最大 256 個元素

__type(key, __u32); // 鍵類型:32位整數(索引)

__type(value, __u64); // 值類型:64位整數(計數)

} syscall_count_array SEC(".maps");

// 定義一個 Per-CPU 陣列 Map

struct {

__uint(type, BPF_MAP_TYPE_PERCPU_ARRAY);

__uint(max_entries, 10);

__type(key, __u32);

__type(value, __u64);

} percpu_stats SEC(".maps");

// 定義統計結構

struct syscall_stats {

__u64 count;

__u64 total_time;

__u64 min_time;

__u64 max_time;

};

// 複雜的陣列 Map

struct {

__uint(type, BPF_MAP_TYPE_ARRAY);

__uint(max_entries, 512);

__type(key, __u32);

__type(value, struct syscall_stats);

} detailed_stats SEC(".maps");

char LICENSE[] SEC("license") = "GPL";

SEC("tp/raw_syscalls/sys_enter")

int trace_syscall_enter(struct trace_event_raw_sys_enter *ctx)

{

__u32 syscall_nr = ctx->id;

__u64 *count;

__u64 timestamp = bpf_ktime_get_ns();

// 限制系統呼叫號範圍,避免越界

if (syscall_nr >= 256)

return 0;

// 更新簡單計數陣列

count = bpf_map_lookup_elem(&syscall_count_array, &syscall_nr);

if (count) {

__sync_fetch_and_add(count, 1);

} else {

__u64 initial = 1;

bpf_map_update_elem(&syscall_count_array, &syscall_nr, &initial, BPF_ANY);

}

// 更新 Per-CPU 統計(假設只統計前10個系統呼叫)

if (syscall_nr < 10) {

__u64 *percpu_count = bpf_map_lookup_elem(&percpu_stats, &syscall_nr);

if (percpu_count) {

*percpu_count += 1;

} else {

__u64 initial = 1;

bpf_map_update_elem(&percpu_stats, &syscall_nr, &initial, BPF_ANY);

}

}

// 更新詳細統計(限制範圍)

if (syscall_nr < 512) {

struct syscall_stats *stats = bpf_map_lookup_elem(&detailed_stats, &syscall_nr);

if (stats) {

__sync_fetch_and_add(&stats->count, 1);

if (stats->min_time == 0 || timestamp < stats->min_time) {

stats->min_time = timestamp;

}

if (timestamp > stats->max_time) {

stats->max_time = timestamp;

}

} else {

struct syscall_stats new_stats = {

.count = 1,

.total_time = 0,

.min_time = timestamp,

.max_time = timestamp

};

bpf_map_update_elem(&detailed_stats, &syscall_nr, &new_stats, BPF_ANY);

}

}

return 0;

}

第三步:Hash Maps 實作

Hash Maps 提供靈活的鍵值對存儲,適合動態資料。

// src/kernel/hash_maps_demo.bpf.c

#include "vmlinux.h"

#include <bpf/bpf_helpers.h>

#include <bpf/bpf_tracing.h>

// 定義進程統計結構

struct process_stats {

__u64 file_opens;

__u64 memory_allocs;

__u64 network_ops;

__u64 first_seen;

__u64 last_seen;

char comm[16];

};

// PID -> 進程統計的 Hash Map

struct {

__uint(type, BPF_MAP_TYPE_HASH);

__uint(max_entries, 10000);

__type(key, __u32); // PID

__type(value, struct process_stats);

} process_map SEC(".maps");

// 檔案名 Hash -> 存取次數

struct {

__uint(type, BPF_MAP_TYPE_HASH);

__uint(max_entries, 1000);

__type(key, __u64); // 檔名雜湊

__type(value, __u64); // 存取次數

} file_access_map SEC(".maps");

// Per-CPU Hash Map 示例

struct {

__uint(type, BPF_MAP_TYPE_PERCPU_HASH);

__uint(max_entries, 1000);

__type(key, __u32);

__type(value, __u64);

} percpu_process_stats SEC(".maps");

char LICENSE[] SEC("license") = "GPL";

// 簡單的字串雜湊函數

static __always_inline __u64 hash_string(const char *str, int len)

{

__u64 hash = 5381;

for (int i = 0; i < len && i < 16; i++) {

if (str[i] == 0) break;

hash = ((hash << 5) + hash) + str[i];

}

return hash;

}

SEC("tp/syscalls/sys_enter_openat")

int trace_file_opens(struct trace_event_raw_sys_enter *ctx)

{

__u32 pid = bpf_get_current_pid_tgid() >> 32;

__u64 now = bpf_ktime_get_ns();

// 更新進程統計

struct process_stats *stats = bpf_map_lookup_elem(&process_map, &pid);

if (stats) {

__sync_fetch_and_add(&stats->file_opens, 1);

stats->last_seen = now;

} else {

struct process_stats new_stats = {

.file_opens = 1,

.memory_allocs = 0,

.network_ops = 0,

.first_seen = now,

.last_seen = now

};

bpf_get_current_comm(&new_stats.comm, sizeof(new_stats.comm));

bpf_map_update_elem(&process_map, &pid, &new_stats, BPF_ANY);

}

// 嘗試獲取檔案名並雜湊

char filename[64];

long ret = bpf_probe_read_user_str(filename, sizeof(filename),

(void *)ctx->args[1]);

if (ret > 0) {

__u64 file_hash = hash_string(filename, ret);

__u64 *count = bpf_map_lookup_elem(&file_access_map, &file_hash);

if (count) {

__sync_fetch_and_add(count, 1);

} else {

__u64 initial = 1;

bpf_map_update_elem(&file_access_map, &file_hash, &initial, BPF_ANY);

}

}

// 更新 Per-CPU 統計

__u64 *percpu_count = bpf_map_lookup_elem(&percpu_process_stats, &pid);

if (percpu_count) {

*percpu_count += 1;

} else {

__u64 initial = 1;

bpf_map_update_elem(&percpu_process_stats, &pid, &initial, BPF_ANY);

}

return 0;

}

第四步:Ring Buffer 實作

Ring Buffer 是現代 eBPF 推薦的事件通信機制。

// src/kernel/ringbuf_demo.bpf.c

#include "vmlinux.h"

#include <bpf/bpf_helpers.h>

#include <bpf/bpf_tracing.h>

// 定義事件結構

struct file_event {

__u32 pid;

__u32 tgid;

__u32 uid;

__u64 timestamp;

__u32 filename_len;

char comm[16];

char filename[256];

};

// Ring Buffer Map

struct {

__uint(type, BPF_MAP_TYPE_RINGBUF);

__uint(max_entries, 256 * 1024); // 256KB buffer

} events SEC(".maps");

char LICENSE[] SEC("license") = "GPL";

SEC("tp/syscalls/sys_enter_openat")

int trace_file_events(struct trace_event_raw_sys_enter *ctx)

{

struct file_event *event;

// 從 ring buffer 分配空間

event = bpf_ringbuf_reserve(&events, sizeof(*event), 0);

if (!event) {

return 0; // 分配失敗,buffer 可能已滿

}

// 填充事件資料

__u64 pid_tgid = bpf_get_current_pid_tgid();

event->pid = pid_tgid >> 32;

event->tgid = pid_tgid & 0xffffffff;

event->uid = bpf_get_current_uid_gid() & 0xffffffff;

event->timestamp = bpf_ktime_get_ns();

// 獲取進程名稱

bpf_get_current_comm(&event->comm, sizeof(event->comm));

// 讀取檔案名

long ret = bpf_probe_read_user_str(event->filename, sizeof(event->filename),

(void *)ctx->args[1]);

if (ret > 0) {

event->filename_len = ret;

} else {

event->filename_len = 0;

event->filename[0] = '\0';

}

// 提交事件到 ring buffer

bpf_ringbuf_submit(event, 0);

return 0;

}

第五步:Go 使用者空間程式

現在編寫一個完整的 Go 程式來操作所有這些 Maps:

// src/userspace/maps_demo.go

package main

import (

"bytes"

"context"

"encoding/binary"

"fmt"

"log"

"os"

"os/signal"

"sort"

"syscall"

"time"

"unsafe"

bpf "github.com/aquasecurity/libbpfgo"

)

// Go 結構對應 C 結構

type ProcessStats struct {

FileOpens uint64

MemoryAllocs uint64

NetworkOps uint64

FirstSeen uint64

LastSeen uint64

Comm [16]byte

}

type SyscallStats struct {

Count uint64

TotalTime uint64

MinTime uint64

MaxTime uint64

}

type FileEvent struct {

PID uint32

TGID uint32

UID uint32

Timestamp uint64

FilenameLen uint32

Comm [16]byte

Filename [256]byte

}

func main() {

if os.Geteuid() != 0 {

log.Fatal("需要 root 權限執行")

}

// 選擇要載入的程式

var objFile string

var progName string

if len(os.Args) > 1 {

switch os.Args[1] {

case "array":

objFile = "array_maps_demo.bpf.o"

progName = "trace_syscall_enter"

case "hash":

objFile = "hash_maps_demo.bpf.o"

progName = "trace_file_opens"

case "ringbuf":

objFile = "ringbuf_demo.bpf.o"

progName = "trace_file_events"

default:

fmt.Println("使用方法: ./maps_demo [array|hash|ringbuf]")

os.Exit(1)

}

} else {

objFile = "hash_maps_demo.bpf.o"

progName = "trace_file_opens"

}

fmt.Printf("載入 eBPF 程式: %s\n", objFile)

// 載入 eBPF 程式

bpfModule, err := bpf.NewModuleFromFile(objFile)

if err != nil {

log.Fatalf("載入 eBPF 模組失敗: %v", err)

}

defer bpfModule.Close()

if err := bpfModule.BPFLoadObject(); err != nil {

log.Fatalf("載入 eBPF 物件失敗: %v", err)

}

// 獲取並附加程式

prog, err := bpfModule.GetProgram(progName)

if err != nil {

log.Fatalf("獲取程式失敗: %v", err)

}

var link *bpf.BPFLink

if progName == "trace_syscall_enter" {

link, err = prog.AttachTracepoint(&bpf.TracepointOpts{

Group: "raw_syscalls",

Name: "sys_enter",

})

} else {

link, err = prog.AttachTracepoint(&bpf.TracepointOpts{

Group: "syscalls",

Name: "sys_enter_openat",

})

}

if err != nil {

log.Fatalf("附加程式失敗: %v", err)

}

defer link.Close()

fmt.Printf("✓ eBPF 程式 %s 附加成功\n", progName)

// 設定信號處理

ctx, cancel := context.WithCancel(context.Background())

defer cancel()

sigChan := make(chan os.Signal, 1)

signal.Notify(sigChan, syscall.SIGINT, syscall.SIGTERM)

// 根據程式類型執行不同的處理邏輯

switch os.Args[1] {

case "array":

runArrayDemo(ctx, bpfModule, sigChan)

case "hash":

runHashDemo(ctx, bpfModule, sigChan)

case "ringbuf":

runRingBufDemo(ctx, bpfModule, sigChan)

default:

runHashDemo(ctx, bpfModule, sigChan)

}

}

func runArrayDemo(ctx context.Context, module *bpf.Module, sigChan chan os.Signal) {

syscallCountMap, err := module.GetMap("syscall_count_array")

if err != nil {

log.Fatalf("獲取 syscall_count_array 失敗: %v", err)

}

detailedStatsMap, err := module.GetMap("detailed_stats")

if err != nil {

log.Fatalf("獲取 detailed_stats 失敗: %v", err)

}

ticker := time.NewTicker(3 * time.Second)

defer ticker.Stop()

for {

select {

case <-ctx.Done():

return

case sig := <-sigChan:

fmt.Printf("\n收到信號 %v,正在退出...\n", sig)

cancel()

case <-ticker.C:

fmt.Println("\n=== Array Maps 統計 ===")

// 顯示系統呼叫計數

fmt.Println("系統呼叫計數 (前10個):")

for i := uint32(0); i < 10; i++ {

valueBytes, err := syscallCountMap.GetValue(unsafe.Pointer(&i))

if err == nil && len(valueBytes) == 8 {

count := binary.LittleEndian.Uint64(valueBytes)

if count > 0 {

fmt.Printf(" syscall_%d: %d 次\n", i, count)

}

}

}

// 顯示詳細統計

fmt.Println("\n詳細統計 (有活動的系統呼叫):")

for i := uint32(0); i < 20; i++ {

valueBytes, err := detailedStatsMap.GetValue(unsafe.Pointer(&i))

if err == nil && len(valueBytes) == int(unsafe.Sizeof(SyscallStats{})) {

stats := (*SyscallStats)(unsafe.Pointer(&valueBytes[0]))

if stats.Count > 0 {

fmt.Printf(" syscall_%d: %d次, 最小時間: %d, 最大時間: %d\n",

i, stats.Count, stats.MinTime, stats.MaxTime)

}

}

}

}

}

}

func runHashDemo(ctx context.Context, module *bpf.Module, sigChan chan os.Signal) {

processMap, err := module.GetMap("process_map")

if err != nil {

log.Fatalf("獲取 process_map 失敗: %v", err)

}

fileAccessMap, err := module.GetMap("file_access_map")

if err != nil {

log.Fatalf("獲取 file_access_map 失敗: %v", err)

}

ticker := time.NewTicker(3 * time.Second)

defer ticker.Stop()

for {

select {

case <-ctx.Done():

return

case sig := <-sigChan:

fmt.Printf("\n收到信號 %v,正在退出...\n", sig)

cancel()

case <-ticker.C:

fmt.Println("\n=== Hash Maps 統計 ===")

// 顯示進程統計

fmt.Println("進程檔案操作統計:")

type ProcessInfo struct {

PID uint32

Stats ProcessStats

}

var processes []ProcessInfo

iterator := processMap.Iterator()

for iterator.Next() {

keyBytes := iterator.Key()

valueBytes, _ := iterator.Value()

if len(keyBytes) == 4 && len(valueBytes) == int(unsafe.Sizeof(ProcessStats{})) {

pid := binary.LittleEndian.Uint32(keyBytes)

stats := (*ProcessStats)(unsafe.Pointer(&valueBytes[0]))

processes = append(processes, ProcessInfo{PID: pid, Stats: *stats})

}

}

// 按檔案操作次數排序

sort.Slice(processes, func(i, j int) bool {

return processes[i].Stats.FileOpens > processes[j].Stats.FileOpens

})

// 顯示前10個進程

count := 10

if len(processes) < count {

count = len(processes)

}

for i := 0; i < count; i++ {

p := processes[i]

comm := string(bytes.TrimRight(p.Stats.Comm[:], "\x00"))

fmt.Printf(" PID %d (%s): %d 次檔案操作\n",

p.PID, comm, p.Stats.FileOpens)

}

// 顯示檔案存取統計

fmt.Println("\n檔案存取統計 (雜湊):")

fileIterator := fileAccessMap.Iterator()

fileCount := 0

for fileIterator.Next() && fileCount < 5 {

keyBytes := fileIterator.Key()

valueBytes, _ := fileIterator.Value()

if len(keyBytes) == 8 && len(valueBytes) == 8 {

hash := binary.LittleEndian.Uint64(keyBytes)

count := binary.LittleEndian.Uint64(valueBytes)

fmt.Printf(" Hash 0x%x: %d 次存取\n", hash, count)

fileCount++

}

}

}

}

}

func runRingBufDemo(ctx context.Context, module *bpf.Module, sigChan chan os.Signal) {

eventsMap, err := module.GetMap("events")

if err != nil {

log.Fatalf("獲取 events ringbuf 失敗: %v", err)

}

// 建立 ring buffer

rb, err := module.InitRingBuf("events", make(chan []byte, 100))

if err != nil {

log.Fatalf("初始化 ring buffer 失敗: %v", err)

}

defer rb.Close()

// 開始 polling

rb.Poll(300) // 300ms timeout

fmt.Println("開始監聽檔案事件 (Ring Buffer)...")

fmt.Println("執行一些檔案操作來觸發事件...")

eventCount := 0

for {

select {

case <-ctx.Done():

return

case sig := <-sigChan:

fmt.Printf("\n收到信號 %v,正在退出...\n", sig)

cancel()

case data := <-rb.EventsChannel:

if len(data) == int(unsafe.Sizeof(FileEvent{})) {

event := (*FileEvent)(unsafe.Pointer(&data[0]))

comm := string(bytes.TrimRight(event.Comm[:], "\x00"))

filename := string(bytes.TrimRight(event.Filename[:event.FilenameLen], "\x00"))

eventCount++

fmt.Printf("[%d] PID %d (%s) 開啟檔案: %s\n",

eventCount, event.PID, comm, filename)

}

}

}

}

第六步:編譯和測試

更新 Makefile 以支援多個程式:

# 更新 Makefile

BPF_PROGS := array_maps_demo.bpf.o hash_maps_demo.bpf.o ringbuf_demo.bpf.o

all: vmlinux.h $(BPF_PROGS) userspace

$(BPF_PROGS): %.bpf.o: $(KERNEL_SRC)/%.bpf.c | vmlinux.h

@echo "編譯 eBPF 程式: $<"

$(CLANG) $(BPF_CFLAGS) -I$(HEADERS) -c $< -o $@

$(LLVM_STRIP) -g $@

userspace: bin/maps_demo

bin/maps_demo: $(USERSPACE_SRC)/maps_demo.go

@echo "編譯使用者空間程式..."

mkdir -p bin

$(GO) build -o $@ $<

test-array: all

sudo ./bin/maps_demo array

test-hash: all

sudo ./bin/maps_demo hash

test-ringbuf: all

sudo ./bin/maps_demo ringbuf

編譯和測試:

# 編譯所有程式

make all

# 測試 Array Maps

make test-array

# 測試 Hash Maps

make test-hash

# 測試 Ring Buffer

make test-ringbuf

深度分析:Maps 的效能考量

1. Map 類型選擇

不同 Map 類型的效能特性:

| Map 類型 | 查找複雜度 | 記憶體使用 | 併發性能 | 適用場景 |

|---|---|---|---|---|

| Array | O(1) | 固定 | 優秀 | 固定索引、統計計數 |

| Hash | O(1) 平均 | 動態 | 良好 | 動態鍵值、進程追蹤 |

| LRU Hash | O(1) | 有界 | 良好 | 快取、最近使用 |

| Ring Buffer | O(1) | 環形 | 優秀 | 事件流、日誌 |

2. Per-CPU Maps 的優勢

// Per-CPU Maps 避免鎖爭用

struct {

__uint(type, BPF_MAP_TYPE_PERCPU_HASH);

__uint(max_entries, 1000);

__type(key, __u32);

__type(value, __u64);

} percpu_map SEC(".maps");

// 在多核系統上,每個 CPU 有獨立的副本

SEC("tp/syscalls/sys_enter_write")

int count_writes(void *ctx)

{

__u32 pid = bpf_get_current_pid_tgid() >> 32;

__u64 *count = bpf_map_lookup_elem(&percpu_map, &pid);

if (count) {

*count += 1; // 無需原子操作,只在當前 CPU 上修改

}

return 0;

}

使用者空間需要聚合所有 CPU 的值:

// 讀取 Per-CPU Map 的值

func readPerCPUValue(m *bpf.BPFMap, key unsafe.Pointer) (uint64, error) {

values, err := m.GetValuePerCPU(key)

if err != nil {

return 0, err

}

var total uint64

for _, valueBytes := range values {

if len(valueBytes) == 8 {

val := binary.LittleEndian.Uint64(valueBytes)

total += val

}

}

return total, nil

}

3. 記憶體管理最佳化

// Map 大小設計原則

struct {

__uint(type, BPF_MAP_TYPE_HASH);

__uint(max_entries, 10000); // 根據實際需求設定

__uint(map_flags, BPF_F_NO_PREALLOC); // 延遲分配記憶體

__type(key, __u32);

__type(value, struct large_value);

} optimized_map SEC(".maps");

疑難排解與最佳化

常見問題

- Map 滿了怎麼辦?

// 使用 LRU Map 自動淘汰舊項目

struct {

__uint(type, BPF_MAP_TYPE_LRU_HASH);

__uint(max_entries, 1000);

__type(key, __u32);

__type(value, __u64);

} lru_map SEC(".maps");

- 如何處理 Map 更新衝突?

// 使用原子操作

__sync_fetch_and_add(&stats->counter, 1);

// 或使用 CAS 操作

__u64 old_val, new_val;

do {

old_val = stats->counter;

new_val = old_val + 1;

} while (!__sync_bool_compare_and_swap(&stats->counter, old_val, new_val));

- 監控 Map 使用情況

sudo bpftool map show

sudo bpftool map dump id <MAP_ID>

# 檢查 Map 統計

cat /proc/kallsyms | grep bpf_map

總結

今天我們深入探討了 eBPF Maps 的各個方面:

- Map 類型:Array、Hash、Ring Buffer 等不同類型的特點和用途

- 效能考量:Per-CPU Maps、記憶體管理、併發處理

- 實際應用:統計系統、配置管理、事件聚合

- 最佳實務:類型選擇、大小設定、錯誤處理

Maps 是 eBPF 程式設計的核心,掌握了 Maps 的使用,就掌握了 eBPF 開發的精髓。在下一篇文章中,我們將探索 XDP 網路程式設計,學習如何在最底層處理網路封包。

Day 7:

- 原文:https://ithelp.ithome.com.tw/articles/10382013

- 發布日期:2025-09-17

如果覺得文章對你有所啟發,可以考慮用 🌟 支持 Gthulhu 專案,短期目標是集齊 300 個 🌟 藉此被 CNCF Landscape 採納 [ref]。

前言

在前面的文章中,我們已經掌握了 eBPF 的基礎概念和 Maps 的使用方法。從本篇開始,我們將進入 eBPF 的實際應用領域。首先要介紹的是 XDP(eXpress Data Path),這是 eBPF 在網路程式設計中最重要的應用之一。

XDP 讓我們能夠在網路封包進入內核網路堆疊之前就進行處理,這帶來了前所未有的高效能網路處理能力。在本篇文章中,我們將深入理解 XDP 的工作原理,並實作一個簡單的封包過濾器。

XDP 技術概述

什麼是 XDP?

XDP(eXpress Data Path)是一種基於 eBPF 技術的高效能網路資料路徑。它的核心特點是:

- 極早期處理:在封包進入內核網路堆疊之前處理

- 零拷貝:直接在網卡驅動層面操作封包

- 高效能:接近 DPDK 的效能表現

- 靈活性:保持內核的完整網路功能

XDP 在網路堆疊中的位置

┌─────────────────┐

│ User Space │ ← 應用程式

└─────────────────┘

┌─────────────────┐

│ Socket Layer │ ← TCP/UDP Socket

└─────────────────┘

┌─────────────────┐

│ Network Stack │ ← IP/TCP/UDP 處理

└─────────────────┘

┌─────────────────┐

│ XDP Hook │ ← XDP 程式在這裡執行

└─────────────────┘

┌─────────────────┐

│ Network Driver │ ← 網卡驅動

└─────────────────┘

┌─────────────────┐

│ Network Card │ ← 硬體網卡

└─────────────────┘

XDP 程式的返回值

XDP 程式必須返回一個 action code,告訴內核如何處理封包:

// XDP action code

enum xdp_action {

XDP_ABORTED = 0, // 異常終止,丟棄封包並記錄

XDP_DROP, // 丟棄封包

XDP_PASS, // 將封包傳遞給網路堆疊

XDP_TX, // 從同一網卡傳送封包

XDP_REDIRECT, // 重定向到其他網卡或 CPU

};

action code 詳解

- XDP_DROP:最常用的動作,用於 DDoS 防護或惡意流量過濾

- XDP_PASS:允許封包正常進入網路堆疊

- XDP_TX:用於實現反射攻擊防護或負載均衡

- XDP_REDIRECT:用於流量轉發或負載分散

- XDP_ABORTED:錯誤處理,很少使用

實作:簡單的封包過濾器

讓我們實作一個簡單的 XDP 程式,用來過濾特定的 IP 位址。

eBPF 程式實作

首先建立 packet_filter.bpf.c:

#include <linux/bpf.h>

#include <linux/if_ether.h>

#include <linux/ip.h>

#include <linux/in.h>

#include <bpf/bpf_helpers.h>

#include <bpf/bpf_endian.h>

// 統計 Map

struct {

__uint(type, BPF_MAP_TYPE_PERCPU_ARRAY);

__uint(max_entries, 256);

__type(key, __u32);

__type(value, __u64);

} stats_map SEC(".maps");

// 被阻擋的 IP 列表

struct {

__uint(type, BPF_MAP_TYPE_HASH);

__uint(max_entries, 1024);

__type(key, __u32);

__type(value, __u8);

} blocked_ips SEC(".maps");

// 統計類型

enum {

STAT_RX_PACKETS = 0,

STAT_RX_BYTES,

STAT_DROPPED_PACKETS,

STAT_DROPPED_BYTES,

STAT_PASSED_PACKETS,

STAT_PASSED_BYTES,

};

static __always_inline void update_stats(__u32 key, __u64 bytes)

{

__u64 *value = bpf_map_lookup_elem(&stats_map, &key);

if (value) {

__sync_fetch_and_add(value, bytes);

}

}

SEC("xdp")

int packet_filter(struct xdp_md *ctx)

{

void *data_end = (void *)(long)ctx->data_end;

void *data = (void *)(long)ctx->data;

// 檢查乙太網路標頭

struct ethhdr *eth = data;

if (data + sizeof(*eth) > data_end) {

return XDP_ABORTED;

}

// 只處理 IPv4 封包

if (bpf_ntohs(eth->h_proto) != ETH_P_IP) {

return XDP_PASS;

}

// 檢查 IP 標頭

struct iphdr *ip = data + sizeof(*eth);

if (data + sizeof(*eth) + sizeof(*ip) > data_end) {

return XDP_ABORTED;

}

__u32 packet_size = data_end - data;

__u32 src_ip = ip->saddr;

// 更新接收統計

update_stats(STAT_RX_PACKETS, 1);

update_stats(STAT_RX_BYTES, packet_size);

// 檢查是否為被阻擋的 IP

__u8 *blocked = bpf_map_lookup_elem(&blocked_ips, &src_ip);

if (blocked) {

// 更新丟棄統計

update_stats(STAT_DROPPED_PACKETS, 1);

update_stats(STAT_DROPPED_BYTES, packet_size);

bpf_printk("Blocked packet from IP: %pI4", &src_ip);

return XDP_DROP;

}

// 更新通過統計

update_stats(STAT_PASSED_PACKETS, 1);

update_stats(STAT_PASSED_BYTES, packet_size);

return XDP_PASS;

}

char _license[] SEC("license") = "GPL";

Go 語言載入器實作

建立 main.go:

package main

import (

"fmt"

"log"

"net"

"os"

"os/signal"

"syscall"

"time"

"unsafe"

"github.com/aquasecurity/libbpfgo"

)

const (

STAT_RX_PACKETS = iota

STAT_RX_BYTES

STAT_DROPPED_PACKETS

STAT_DROPPED_BYTES

STAT_PASSED_PACKETS

STAT_PASSED_BYTES

)

type PacketFilter struct {

module *libbpfgo.Module

link *libbpfgo.BPFLink

}

func NewPacketFilter(objPath, ifaceName string) (*PacketFilter, error) {

// 載入 eBPF 物件

module, err := libbpfgo.NewModuleFromFile(objPath)

if err != nil {

return nil, fmt.Errorf("failed to load BPF object: %v", err)

}

if err := module.BPFLoadObject(); err != nil {

return nil, fmt.Errorf("failed to load BPF object: %v", err)

}

// 取得程式

prog, err := module.GetProgram("packet_filter")

if err != nil {

return nil, fmt.Errorf("failed to get BPF program: %v", err)

}

// 附加到網路介面

link, err := prog.AttachXDP(ifaceName)

if err != nil {

return nil, fmt.Errorf("failed to attach XDP program: %v", err)

}

return &PacketFilter{

module: module,

link: link,

}, nil

}

func (pf *PacketFilter) AddBlockedIP(ip string) error {

ipAddr := net.ParseIP(ip)

if ipAddr == nil {

return fmt.Errorf("invalid IP address: %s", ip)

}

// 轉換為 uint32 (little endian)

ipv4 := ipAddr.To4()

if ipv4 == nil {

return fmt.Errorf("not an IPv4 address: %s", ip)

}

ipUint32 := *(*uint32)(unsafe.Pointer(&ipv4[0]))

blockedMap, err := pf.module.GetMap("blocked_ips")

if err != nil {

return fmt.Errorf("failed to get blocked_ips map: %v", err)

}

key := ipUint32

value := uint8(1)

if err := blockedMap.Update(unsafe.Pointer(&key), unsafe.Pointer(&value)); err != nil {

return fmt.Errorf("failed to update blocked_ips map: %v", err)

}

fmt.Printf("Added blocked IP: %s\n", ip)

return nil

}

func (pf *PacketFilter) GetStats() (map[string]uint64, error) {

statsMap, err := pf.module.GetMap("stats_map")

if err != nil {

return nil, fmt.Errorf("failed to get stats_map: %v", err)

}

stats := make(map[string]uint64)

statNames := []string{

"rx_packets", "rx_bytes", "dropped_packets",

"dropped_bytes", "passed_packets", "passed_bytes",

}

for i, name := range statNames {

key := uint32(i)

value, err := statsMap.GetValue(unsafe.Pointer(&key))

if err != nil {

continue

}

// 對於 PERCPU_ARRAY,需要計算所有 CPU 的總和

cpuCount := len(value) / 8 // 每個 uint64 是 8 bytes

total := uint64(0)

for j := 0; j < cpuCount; j++ {

cpuValue := *(*uint64)(unsafe.Pointer(&value[j*8]))

total += cpuValue

}

stats[name] = total

}

return stats, nil

}

func (pf *PacketFilter) PrintStats() {

stats, err := pf.GetStats()

if err != nil {

log.Printf("Failed to get stats: %v", err)

return

}

fmt.Println("\n=== Packet Filter Statistics ===")

fmt.Printf("RX Packets: %d\n", stats["rx_packets"])

fmt.Printf("RX Bytes: %d\n", stats["rx_bytes"])

fmt.Printf("Dropped Packets: %d\n", stats["dropped_packets"])

fmt.Printf("Dropped Bytes: %d\n", stats["dropped_bytes"])

fmt.Printf("Passed Packets: %d\n", stats["passed_packets"])

fmt.Printf("Passed Bytes: %d\n", stats["passed_bytes"])

if stats["rx_packets"] > 0 {

dropRate := float64(stats["dropped_packets"]) / float64(stats["rx_packets"]) * 100

fmt.Printf("Drop Rate: %.2f%%\n", dropRate)

}

}

func (pf *PacketFilter) Close() {

if pf.link != nil {

pf.link.Destroy()

}

if pf.module != nil {

pf.module.Close()

}

}

func main() {

if len(os.Args) != 3 {

fmt.Printf("Usage: %s <interface> <blocked_ip>\n", os.Args[0])

fmt.Printf("Example: %s eth0 192.168.1.100\n", os.Args[0])

os.Exit(1)

}

ifaceName := os.Args[1]

blockedIP := os.Args[2]

// 建立封包過濾器

filter, err := NewPacketFilter("packet_filter.bpf.o", ifaceName)

if err != nil {

log.Fatalf("Failed to create packet filter: %v", err)

}

defer filter.Close()

// 新增被阻擋的 IP

if err := filter.AddBlockedIP(blockedIP); err != nil {

log.Fatalf("Failed to add blocked IP: %v", err)

}

fmt.Printf("XDP packet filter loaded on interface %s\n", ifaceName)

fmt.Printf("Blocking traffic from IP: %s\n", blockedIP)

fmt.Println("Press Ctrl+C to stop...")

// 設定信號處理

sigChan := make(chan os.Signal, 1)

signal.Notify(sigChan, syscall.SIGINT, syscall.SIGTERM)

// 定期顯示統計資訊

ticker := time.NewTicker(5 * time.Second)

defer ticker.Stop()

for {

select {

case <-ticker.C:

filter.PrintStats()

case <-sigChan:

fmt.Println("\nShutting down...")

filter.PrintStats()

return

}

}

}

Makefile

建立 Makefile:

# XDP Packet Filter Makefile

CLANG ?= clang

LLVM_STRIP ?= llvm-strip

ARCH := x86_64

# 輸出檔案

BPF_OBJ = packet_filter.bpf.o

TARGET = packet_filter

# 編譯標誌

CFLAGS := -O2 -g -Wall -Werror

BPF_CFLAGS := -target bpf -D__TARGET_ARCH_$(ARCH)

# 包含路徑

INCLUDES := -I/usr/include/$(shell uname -m)-linux-gnu

.PHONY: all clean test

all: $(BPF_OBJ) $(TARGET)

# 編譯 eBPF 程式

$(BPF_OBJ): packet_filter.bpf.c

$(CLANG) $(BPF_CFLAGS) $(INCLUDES) $(CFLAGS) -c $< -o $@

$(LLVM_STRIP) -g $@

# 編譯 Go 程式

$(TARGET): main.go $(BPF_OBJ)

go build -o $(TARGET) main.go

# 測試 (需要 root 權限)

test: $(BPF_OBJ) $(TARGET)

@echo "Testing packet filter..."

@echo "Note: This requires root privileges and a valid network interface"

@echo "Run: sudo ./$(TARGET) <interface> <blocked_ip>"

# 安裝依賴

deps:

go mod init packet-filter

go get github.com/aquasecurity/libbpfgo

# 檢查程式

verify: $(BPF_OBJ)

bpftool prog show

bpftool map show

clean:

rm -f $(BPF_OBJ) $(TARGET)

rm -f go.mod go.sum

help:

@echo "Available targets:"

@echo " all - Build eBPF object and Go binary"

@echo " deps - Install Go dependencies"

@echo " test - Run test (requires root)"

@echo " verify - Verify loaded BPF programs"

@echo " clean - Clean build artifacts"

@echo " help - Show this help message"

使用與測試

編譯程式

# 安裝依賴

make deps

# 編譯

make all

執行測試

# 需要 root 權限

sudo ./packet_filter eth0 192.168.1.100

# 或者使用 loopback 介面測試

sudo ./packet_filter lo 127.0.0.1

測試封包過濾

在另一個終端機中:

# 測試正常流量 (應該通過)

ping 8.8.8.8

# 從被阻擋的 IP 發送流量 (如果可能的話)

# 或者使用 hping3 模擬

sudo hping3 -S -p 80 -a 192.168.1.100 target_ip

XDP 模式比較

XDP 支援多種載入模式:

-

Generic XDP (SKB 模式):

- 相容性最好,但效能較低

- 在網路堆疊中較晚執行

- Libbpf-go 目前尚不支援 attch Generic XDP type 的 eBPF program

-

Native XDP (驅動模式):

- 效能最好,在驅動層面執行

- 需要驅動支援

-

Offloaded XDP (硬體模式):

- 效能最高,在網卡硬體執行

- 需要特殊硬體支援

實戰應用場景

DDoS 防護

// 簡單的速率限制

struct rate_limit_key {

__u32 src_ip;

__u32 time_window;

};

// 實現每秒封包數限制

if (packet_count > MAX_PPS) {

return XDP_DROP;

}

負載均衡

// 基於 hash 的負載均衡

__u32 hash = jhash_2words(src_ip, dst_port, 0);

__u32 backend = hash % num_backends;

// 修改目標 IP

ip->daddr = backends[backend];

// 重新計算 checksum

return XDP_TX;

流量監控

// 記錄流量模式

struct flow_key {

__u32 src_ip;

__u32 dst_ip;

__u16 src_port;

__u16 dst_port;

__u8 protocol;

};

// 更新流量統計

update_flow_stats(&flow_key, packet_size);

總結

在本篇文章中,我們深入學習了 XDP 技術:

- 理解了 XDP 的工作原理:在網路堆疊早期進行高效能封包處理

- 掌握了 XDP 程式的基本結構:動作代碼、封包解析、邊界檢查

- 實作了完整的封包過濾器:包含統計功能和動態配置

- 學習了效能最佳化技巧:記憶體存取、統計方法、原子操作

XDP 是 eBPF 在網路領域最重要的應用之一,為高效能網路處理打開了新的可能性。在下一篇文章中,我們將進一步實作一個完整的負載均衡器,展示 XDP 在實際應用中的強大能力。

在下一篇文章中,我們將使用 XDP 技術實作一個完整的 Tiny Load Balancer,學習如何修改封包內容並實現負載均衡功能。

Day 8:

- 原文:https://ithelp.ithome.com.tw/articles/10382716

- 發布日期:2025-09-18

如果覺得文章對你有所啟發,可以考慮用 🌟 支持 Gthulhu 專案,短期目標是集齊 300 個 🌟 藉此被 CNCF Landscape 採納 [ref]。

前言

在上一篇文章中,我們學習了 XDP 的基本概念和封包過濾技術。今天我們將進行一個稍具挑戰性的實戰專案:使用 XDP 技術打造一個完整的 Tiny Load Balancer。

該專案受 eBPF Summit 2021: An eBPF Load Balancer from scratch 啟發,並且修改自 lb-from-scratch 專案。

這個專案將帶領我們深入學習:

- 網路封包的解析與修改

- L2/L3/L4 層的封包處理

- 實作簡單的負載均衡演算法

- 完整的測試環境搭建

通過這個實戰專案,您將對 eBPF 在網路程式設計中的強大能力有更深刻的理解。

負載均衡器架構設計

整體架構

┌─────────────┐ ┌─────────────────┐ ┌─────────────┐

│ Client │───▶│ Load Balancer │───▶│ Backend A │

│192.17.0.4 │ │ 192.17.0.5 │ │192.17.0.2 │

└─────────────┘ │ │ └─────────────┘

│ XDP Hook │

│ │ ┌─────────────┐

└─────────────────┘───▶│ Backend B │

│192.17.0.3 │

└─────────────┘

負載均衡原理

我們的 TinyLB 工作原理:

- 入站處理:攔截發送到 LB IP 的封包

- 後端選擇:使用演算法選擇後端伺服器

- 封包修改:修改目標 IP 和 MAC 位址

- 轉發封包:將修改後的封包傳送出去

- 出站處理:修改返回封包的來源資訊

eBPF 程式實作

主程式檔案

建立 xdp_lb_kern.c:

#include "xdp_lb_kern.h"

#define IP_ADDRESS(x) (unsigned int)(192 + (17 << 8) + (0 << 16) + (x << 24))

#define BACKEND_A 2

#define BACKEND_B 3

#define CLIENT 4

#define LB 5

#define HTTP_PORT 80

struct {

__uint(type, BPF_MAP_TYPE_HASH);

__type(key, __u32);

__type(value, __u32);

__uint(max_entries, 64);

} lb_map SEC(".maps");

SEC("xdp")

int tiny_lb(struct xdp_md *ctx)

{

void *data = (void *)(long)ctx->data;

void *data_end = (void *)(long)ctx->data_end;

struct ethhdr *eth = data;

if (data + sizeof(struct ethhdr) > data_end)

return XDP_ABORTED;

if (bpf_ntohs(eth->h_proto) != ETH_P_IP)

return XDP_PASS;

struct iphdr *iph = data + sizeof(struct ethhdr);

if (data + sizeof(struct ethhdr) + sizeof(struct iphdr) > data_end)

return XDP_ABORTED;

if (iph->protocol != IPPROTO_TCP)

return XDP_PASS;

struct tcphdr *tcph = data + sizeof(struct ethhdr) + sizeof(struct iphdr);

if (data + sizeof(struct ethhdr) + sizeof(struct iphdr) + sizeof(struct tcphdr) > data_end)

return XDP_ABORTED;

__be32 ip_saddr = iph->saddr;

if (ip_saddr == IP_ADDRESS(CLIENT) &&

bpf_ntohs(tcph->dest) == HTTP_PORT)

{

bpf_printk("Got http request from %x", ip_saddr);

int dst = BACKEND_A;

if (bpf_ktime_get_ns() % 2)

dst = BACKEND_B;

__u32 *dst_ip = bpf_map_lookup_elem(&lb_map, &dst);

if (!dst_ip) {

bpf_printk("Error: Destination IP not found in the map");

return XDP_PASS;

}

iph->daddr = bpf_htonl(*dst_ip);

eth->h_dest[5] = dst;

} else if (iph->saddr == IP_ADDRESS(BACKEND_A) || iph->saddr == IP_ADDRESS(BACKEND_B))

{

bpf_printk("Got the http response from backend [%x]: forward to client %x", iph->saddr, iph->daddr);

int c = CLIENT;

__u32 *client_ip = bpf_map_lookup_elem(&lb_map, &c);

if (!client_ip) {

bpf_printk("Error: Client IP not found in the map");

return XDP_PASS;

}

iph->daddr = bpf_htonl(*client_ip);

eth->h_dest[5] = CLIENT;

}

iph->saddr = IP_ADDRESS(LB);

eth->h_source[5] = LB;

iph->check = iph_csum(iph);

bpf_printk("Forward from lb %x to client %x", iph->saddr, iph->daddr);

return XDP_TX;

}

char _license[] SEC("license") = "GPL";

參考上方的程式碼,XDP type program 允許接受 pointer to struct xdp_md 作為 program context。這個 context 本身就是 L2 以上的資料內容,所以我們可以做型別轉換來取得每一層的資料的起始位置:

SEC("xdp")

int tiny_lb(struct xdp_md *ctx)

{

void *data = (void *)(long)ctx->data;

void *data_end = (void *)(long)ctx->data_end;

struct ethhdr *eth = data;

if (data + sizeof(struct ethhdr) > data_end)

return XDP_ABORTED;

if (bpf_ntohs(eth->h_proto) != ETH_P_IP)

return XDP_PASS;

struct iphdr *iph = data + sizeof(struct ethhdr);

if (data + sizeof(struct ethhdr) + sizeof(struct iphdr) > data_end)

return XDP_ABORTED;

if (iph->protocol != IPPROTO_TCP)

return XDP_PASS;

struct tcphdr *tcph = data + sizeof(struct ethhdr) + sizeof(struct iphdr);

if (data + sizeof(struct ethhdr) + sizeof(struct iphdr) + sizeof(struct tcphdr) > data_end)

return XDP_ABORTED;

藉由這個方式,我們就能將不屬於 TCP 的網路封包過濾掉囉。

讓我們繼續向下追蹤,會發現範例程式使用 eBPF Maps 來管理 Load Balancer 後面 Backend Service 的 entity:

struct {

__uint(type, BPF_MAP_TYPE_HASH);

__type(key, __u32);

__type(value, __u32);

__uint(max_entries, 64);

} lb_map SEC(".maps");

稍後會在 Golang 撰寫的管理程式看到操作 MAP 的程式碼。

若 Dst Port 為 80 且 Src IP 來自給定的 Client,那麼就根據當前的時間 %2 決定要將請求轉發到哪一個後端伺服器中:

if (ip_saddr == IP_ADDRESS(CLIENT) &&

bpf_ntohs(tcph->dest) == HTTP_PORT)

{

bpf_printk("Got http request from %x", ip_saddr);

int dst = BACKEND_A;

if (bpf_ktime_get_ns() % 2)

dst = BACKEND_B;

__u32 *dst_ip = bpf_map_lookup_elem(&lb_map, &dst);

if (!dst_ip) {

bpf_printk("Error: Destination IP not found in the map");

return XDP_PASS;

}

iph->daddr = bpf_htonl(*dst_ip);

eth->h_dest[5] = dst;

}

反之,若 Src IP 來自後端伺服器,我們就將請求的 Dst IP 設定為 Client IP:

else if (iph->saddr == IP_ADDRESS(BACKEND_A) || iph->saddr == IP_ADDRESS(BACKEND_B))

{

bpf_printk("Got the http response from backend [%x]: forward to client %x", iph->saddr, iph->daddr);

int c = CLIENT;

__u32 *client_ip = bpf_map_lookup_elem(&lb_map, &c);

if (!client_ip) {

bpf_printk("Error: Client IP not found in the map");

return XDP_PASS;

}

iph->daddr = bpf_htonl(*client_ip);

eth->h_dest[5] = CLIENT;

}

Go 語言負載均衡器管理程式

建立 main.go:

package main

import (

"os"

"time"

"unsafe"

bpf "github.com/aquasecurity/libbpfgo"

)

func IP_ADDRESS(d, c, b, a int) uint32 {

return uint32(a + b<<8 + c<<16 + d<<24)

}

func main() {