iT 邦幫忙鐵人賽 60 天整理

本書整理自兩個 iT 邦幫忙鐵人賽系列,共 60 篇文章。

系列目錄

- 下班加減學點Golang與Docker(30 篇)

- 應該是 Profilling 吧?(30 篇)

下班加減學點Golang與Docker

章節

- Day 01 學Golang的緣由

- Day 02 第一隻Go程式

- Day 03 Array & Slice

- Day 04 Container 3兄弟-List

- Day 05 Container 3兄弟-Heap

- Day 06 Container 3兄弟-Ring

- Day 07 字典 Map

- Day 08 Type & Struct, 從單細胞生物, 來到多細胞生物了

- Day 09 Interface & OOP 就說你是鴨子! 你就是要呱呱叫

- Day 10 Package 使用多個套件之前必須要懂的包

- Day 11 govendor 好多依賴要管理

- Day 12 go modules 終於不會再被GOPATH綁死了

- Day 13 Defer 延遲調用

- Day 14 Goroutine 讓你用少少的線程, 能接受更多的工作, 但沒說會作比較快

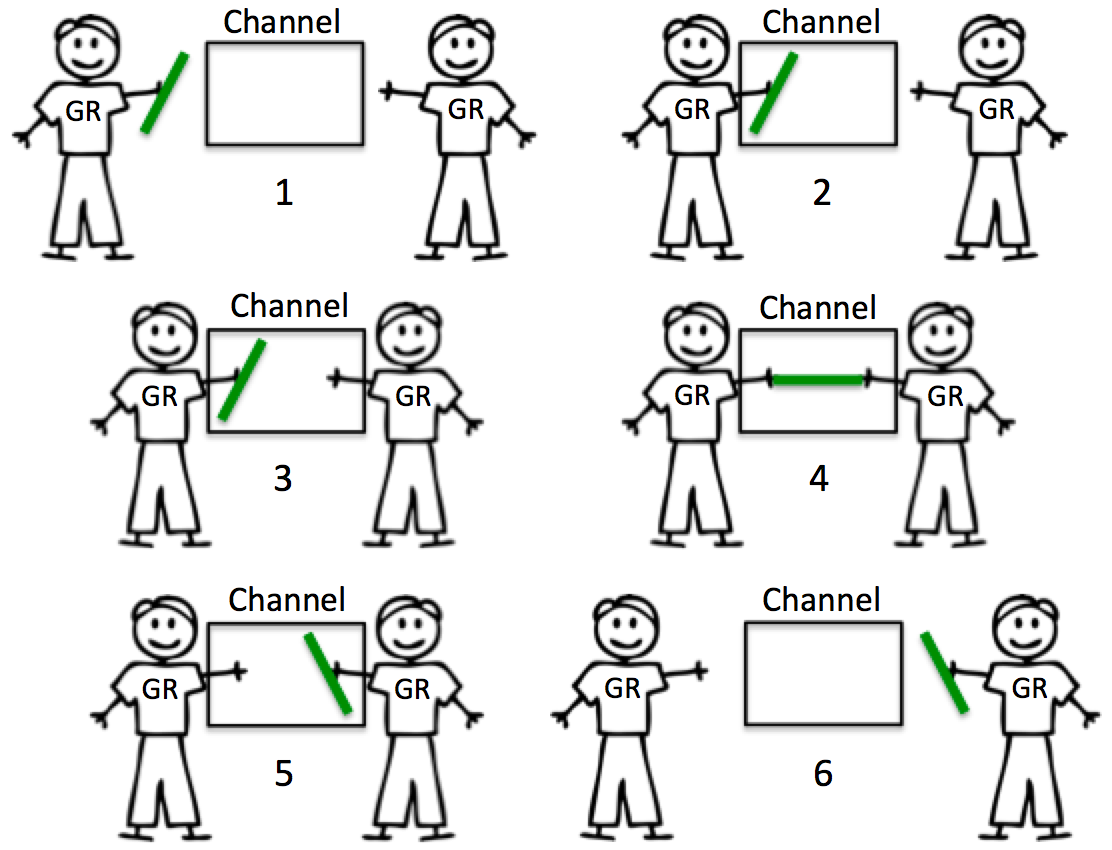

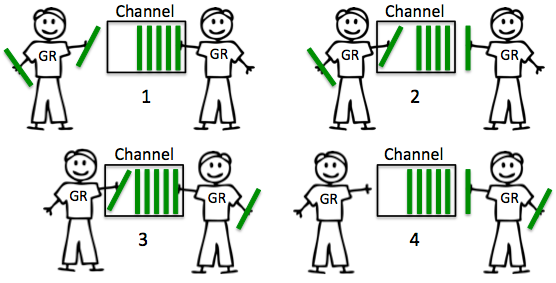

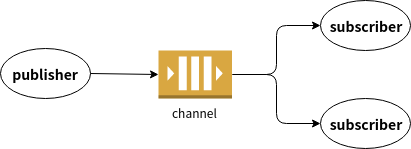

- Day 15 Channel, goroutine之間的溝通橋樑

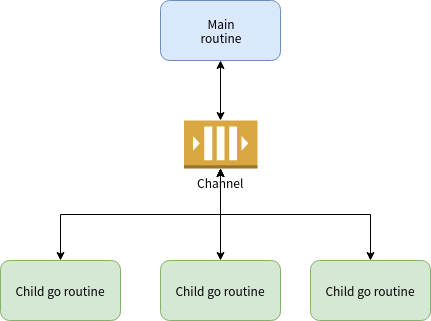

- Day 16 Context, 眾Goroutine手上的電話蟲

- Day 17 Reflection

- Day 18 database/sql, 和資料庫打個招呼

- Day 19 database/sql Scan & Value, 讓操作sql有一點點ORM的感覺

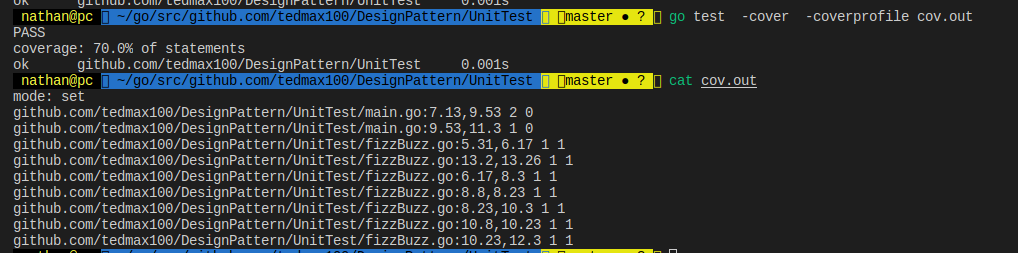

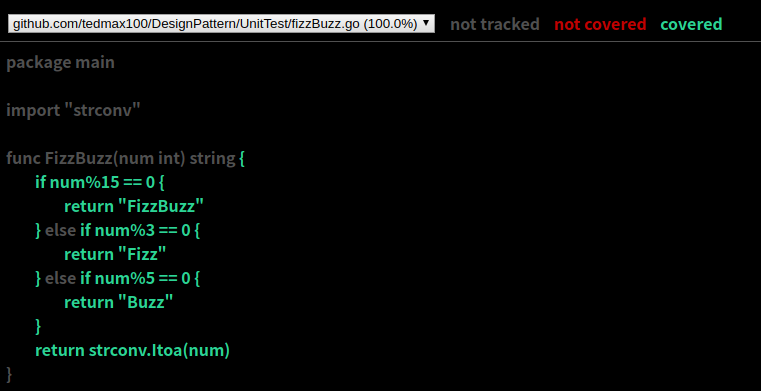

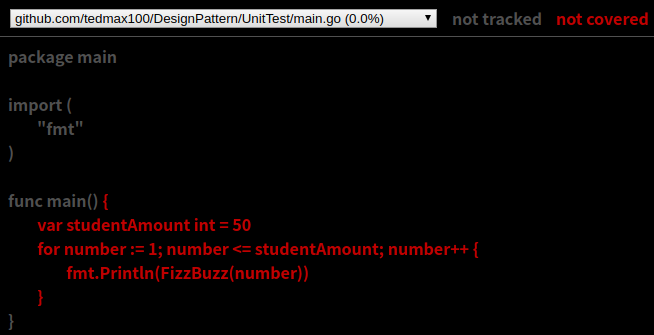

- Day 20 Testing初探

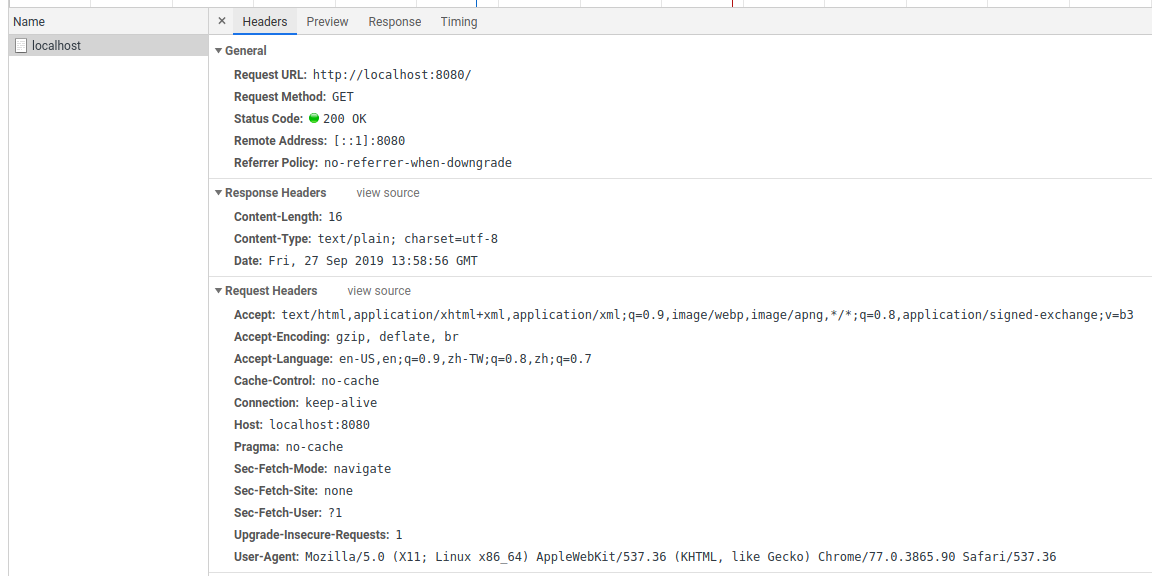

- Day 21 Http Service淺談

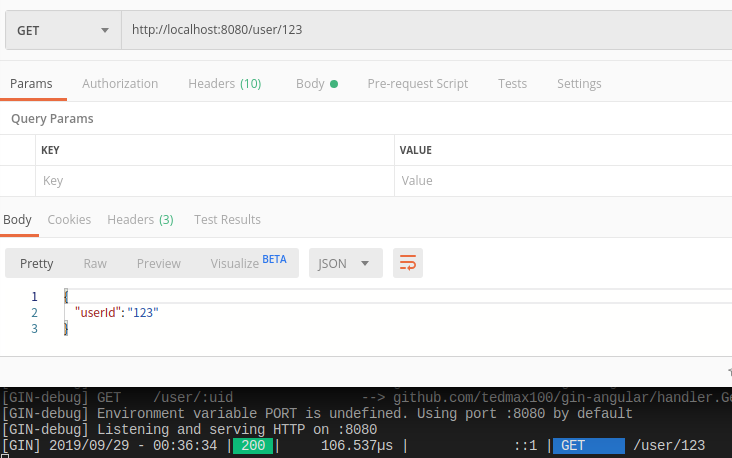

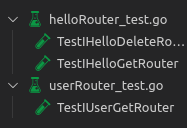

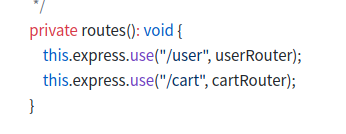

- Day 22 Gin框架 with httptest and testify的第一次接觸

- Day 23 Gin框架搭配模板

- Day 24 Gin框架 檔案上傳 & 資料綁定和驗證

- Day 25 Go Websocket 長連線

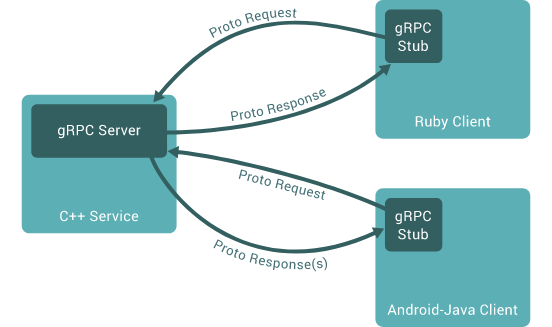

- Day 26 Go gRPC第一次接觸...

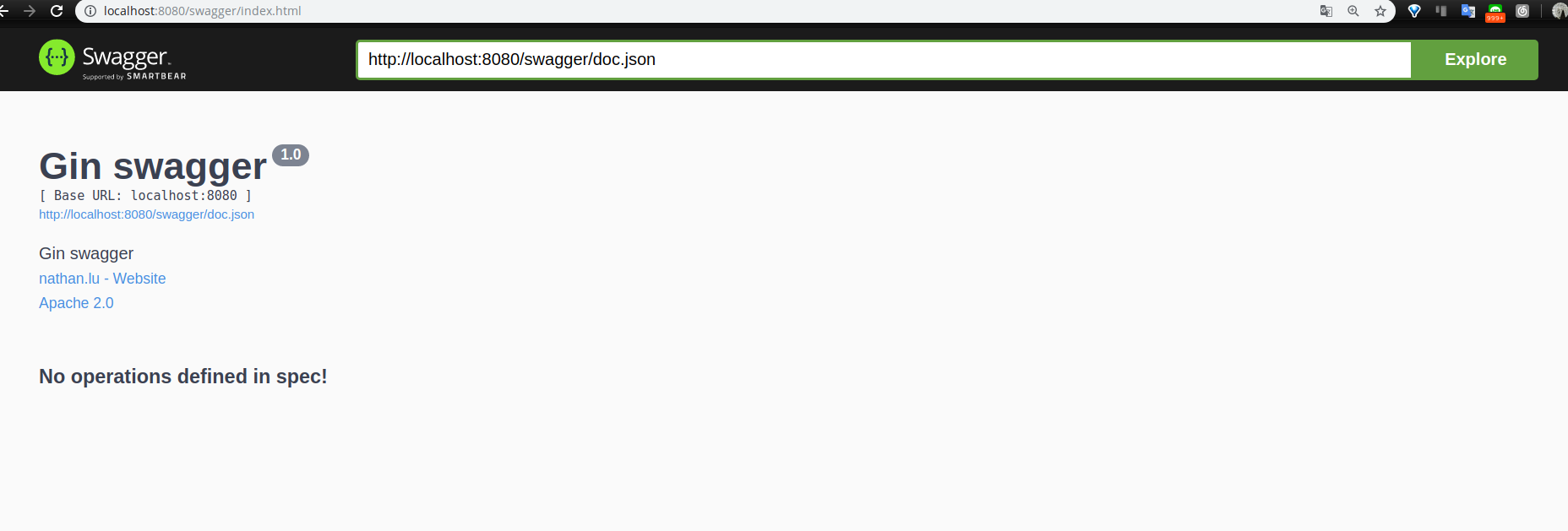

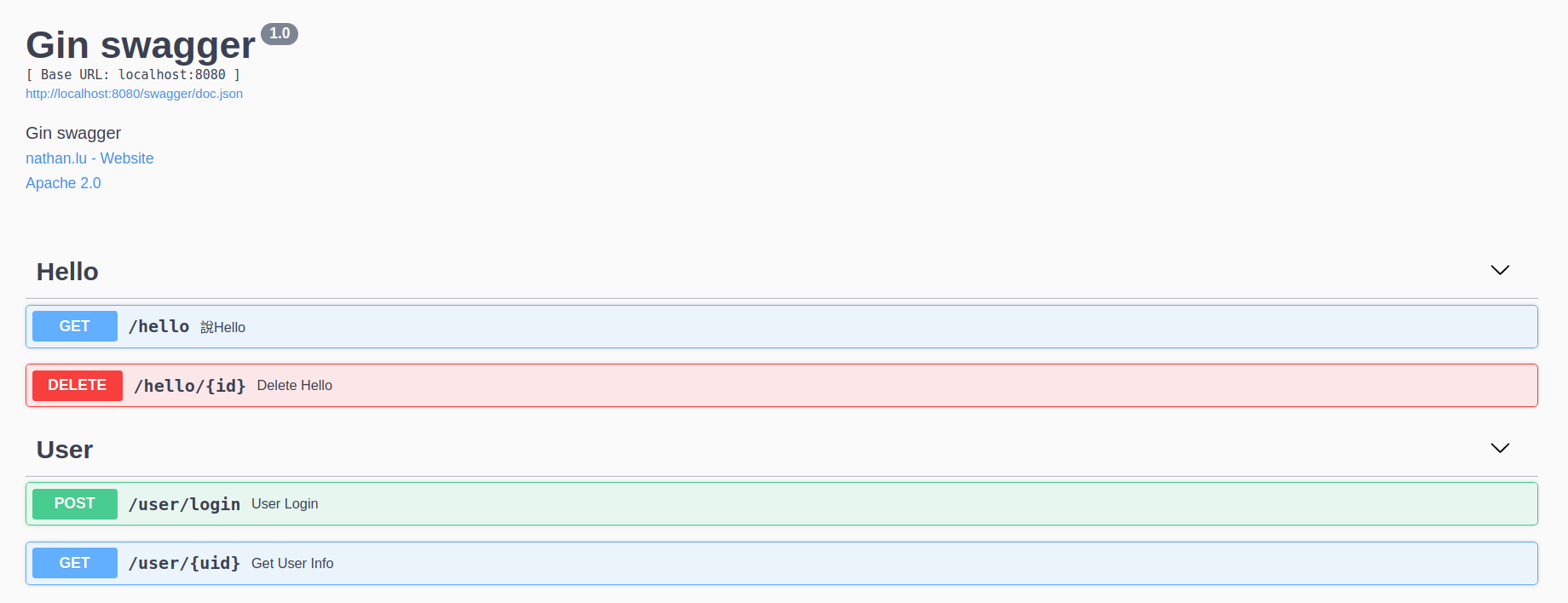

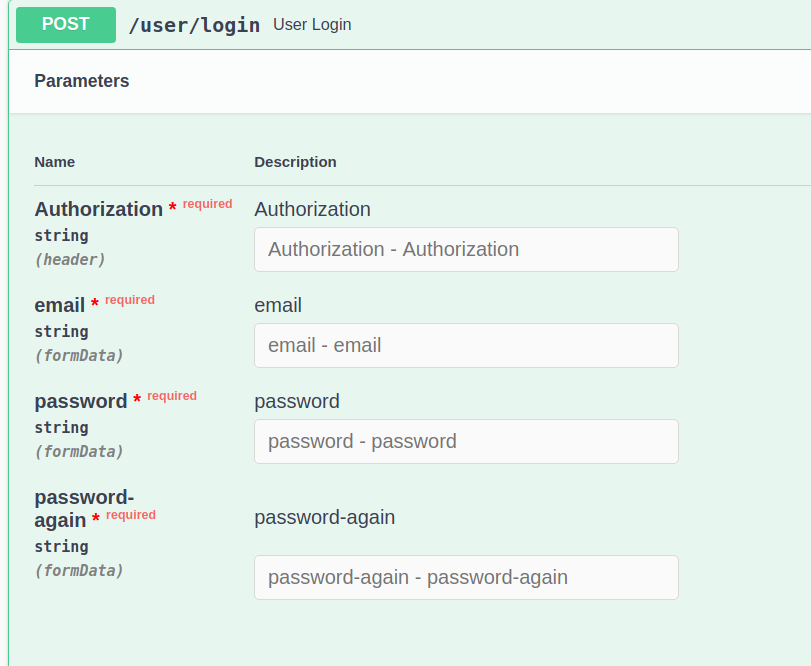

- Day 27 Gin With Swagger, 懶人API Doc生成神器

- Day 28 Go 鍊結參數 LDFLAGS

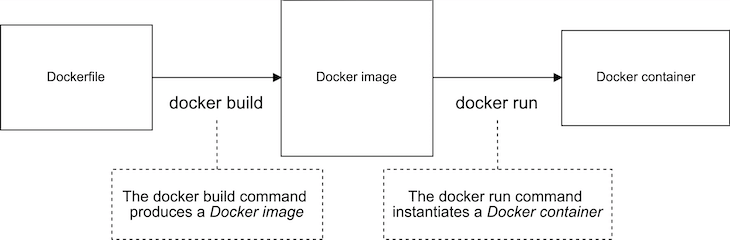

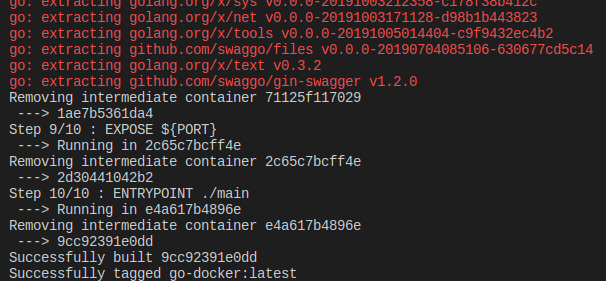

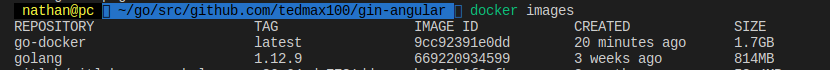

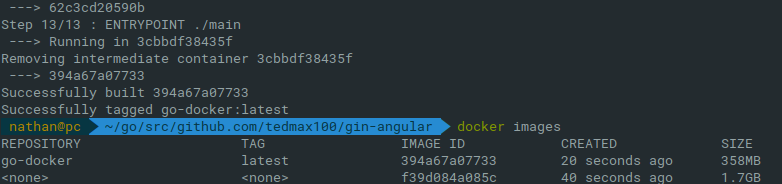

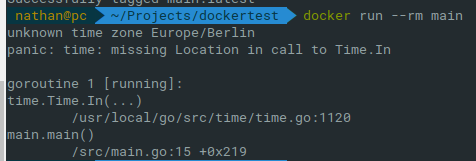

- Day 29 Go 交叉編譯 與 Docker <3

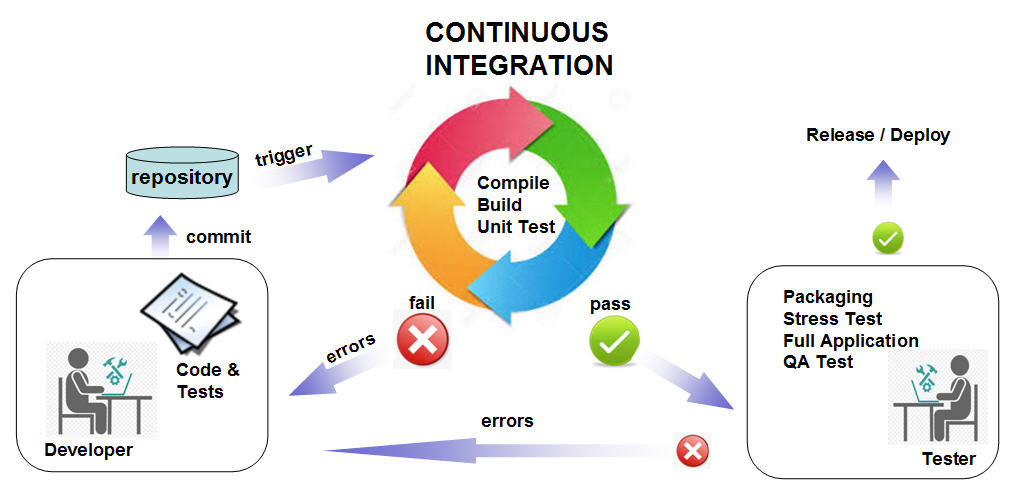

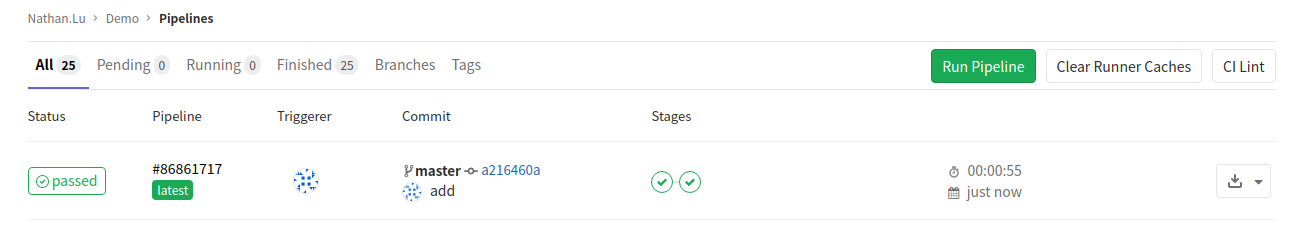

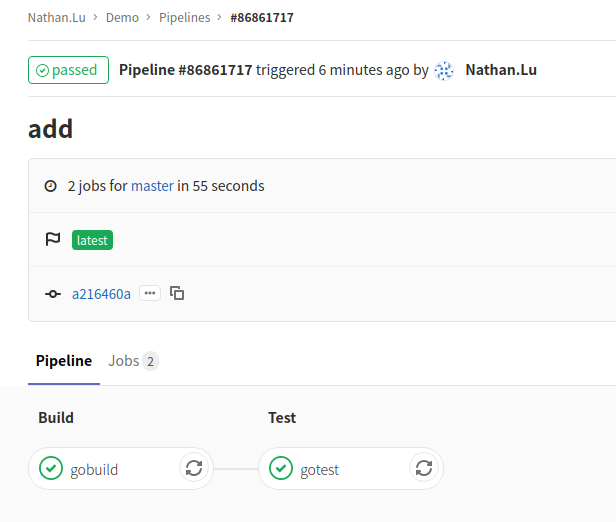

- Day 30 CI with Go & Docker on Gitlab

學Golang的緣由

- 系列:下班加減學點Golang與Docker系列 第 1 篇

- Day:1

- 發佈時間:2019-09-08 11:39:34

- 原文:https://ithelp.ithome.com.tw/articles/10214255

學Golang的緣由

這是小弟第一次參加鐵人賽, 來挑戰一下自我.

開始學著寫Golang的原因是因為寫了幾年NodeJS跟C#,

但Node真的一個專案打包成docker image超臃腫.

就嘗試找一個也支援高併發, 性能優, 方便部屬的語言,

但希望它的執行檔大小能是超小的, 且各種OS都支援.

就選擇Golang這語言了.

就下班加減學一點學一點, 至今也看了兩三個月.

一些東西紀錄在自己的部落格當作筆記

Go語言特性

- Google開發並負責維護的開源專案!

- 靜態、編譯型, 自帶GC和併發處理的語言, 能編譯出目標平台的可執行檔案, 編譯速度也快.

- 全平台適用, Arm都能執行

- 上手容易, 我覺得跟C比較真的頗容易, 但跟JS比我覺得還是差一些

- 原生支援併發 (goroutine), 透過channel進行通信

- 關鍵字少, 30個左右吧

- 用字首大小寫, 判別是否是public / private

- 沒用到的import 或者是 變數, 都會在編譯時期給予警告

- 沒有繼承!

- 適合寫些工具, 像是hugo、fzf、Drone、Docker

- 適合其他語言大部分的業務, RestAPI, RPC, WebSocket

- 內含測試框架

- 不必在煩惱 到底要i++還是++i了, 因為在Go裡沒有++i, 也不能透過i++賦值給其他的變數

從Node到Golang

Hello World

NodeJS

console.log("hello world");

> node app.js

Golang的對等寫法

package main

import (

"fmt"

)

func main() {

fmt.Println("hello world")

}

> go run main.go

Array 和 Slice

const names = ["it", "home"];

names := []string { "it", "home"}

印出後面幾個字的子字串

let game = "it home iron man";

console.log(game.substr(8, game.length));

game := "it home iron man"

fmt.Println(game[8: ])

流程控制

const gender = 'female';

switch (gender) {

case 'female':

console.log("you are a girl");

break;

case 'male':

console.log("your are a boy");

break;

default:

console.log("wtf");

}

gender := "female"

switch gender {

case "female":

fmt.Println("you are a girl")

case "male":

fmt.Println("your are a boy")

default:

fmt.Println("wtf")

}

看得出來Go省略了break這關鍵字

Loop

Javascript有for loop, while loop, do while loop

Go只有for loop 就能模擬上面三個

for i := 0; i < 10; i++ {

fmt.Println(i)

}

// key value pairs

kvs := map[string]string{

"name": "it home",

"website": "https://ithelp.ithome.com.tw",

}

for key, value := range kvs {

fmt.Println(key, value)

}

Object

const Post = {

ID: 10213107

Title: "下班加減學點Golang",

Author: "Nathan",

Difficulty: "Beginner",

}

type Post struct {

ID int

Title string

Author string

Difficulty string

}

p := Post {

ID: 10213107,

Title : "下班加減學點Golang",

Author: "Nathan",

Difficulty:"Beginner",

}

Go能透過定義抽象的struct與其屬性, 在實例化

也能透過map[string]interface來定義

Post := map[string]interface{} {

"ID": 10213107,

"Title" : "下班加減學點Golang",

"Author": "Nathan",

"Difficulty":"Beginner",

}

從上面幾個例子就能看的出來Node跟Go語法結構上很類似,

所以學過Node再來學Go好像就沒那麼難了 XD

之後會慢慢補充Go的更多東西.

謝謝各位

幹話王部落格

OpenTelemetry 入門指南:建立全面可觀測性架構

第一隻Go程式

- 系列:下班加減學點Golang與Docker系列 第 2 篇

- Day:2

- 發佈時間:2019-09-09 00:03:54

- 原文:https://ithelp.ithome.com.tw/articles/10214347

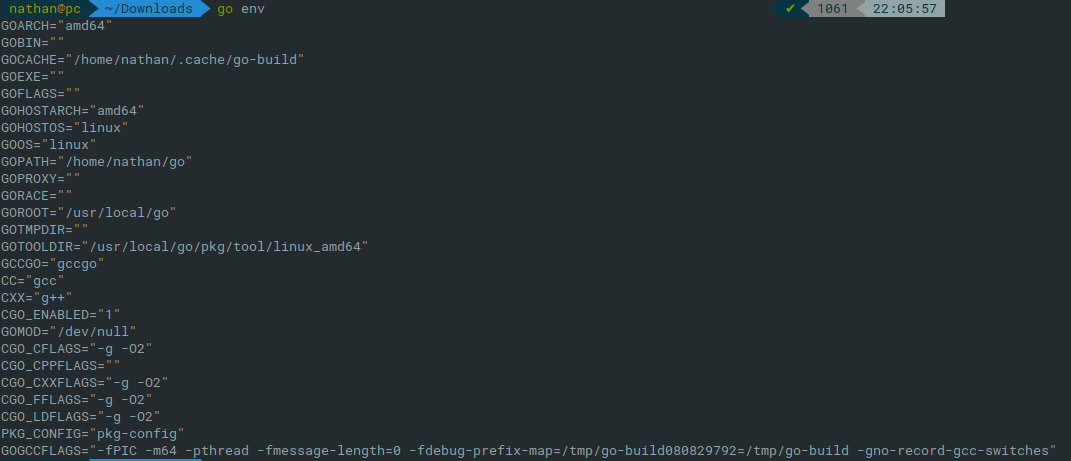

安裝Go跟開發環境

Install the GO on Linux

# Download file

wget https://dl.google.com/go/go1.12.7.linux-amd64.tar.gz

# Extract it into /usr/local

tar -C /usr/local -xzf go1.12.7.linux-amd64.tar.gz

# Add /usr/local/go/bin to the Path environment variable

export PATH=$PATH:/usr/local/go/bin

# Check installation

go env

其他名稱會在後面講package時會稍微提到.

Upgrade Go

# Download file

wget https://dl.google.com/go/go$VERSION.linux-amd64.tar.gz

# Extract it into /usr/local

tar -C /usr/local -xzf go$VERSION.linux-amd64.tar.gz

# Add /usr/local/go/bin to the Path environment variable

export PATH=$PATH:/usr/local/go/bin

Upgrade by shell script

Workspaces

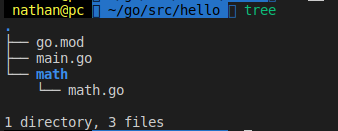

Workspaces

Setting GoPath

在GoPath所顯示的目錄下創建以下資料夾

- src : go source file

- pkg : 編譯產生的文件, .a檔案(一包object file) ; 暫態緩存文件

- bin : 編譯後可執行檔案

mkdir -p $GOPATH/src $GOPATH/pkg $GOPATH/bin

Hello Go

mkdir -p $GOPATH/src/hello

cd $GOPATH/src/hello

code .

以VsCode開啟該目錄

package main

import "fmt"

func main() {

fmt.Println("Hello Go")

}

# 編譯產生可執行的二進制檔案, 會被安裝到$GOPATH/bin底下

go install hello

# 執行

$GOPATH/bin/hello

> Hello Go

Main package

Go每支檔案都會需要宣告這是屬於哪個package的, 相當於C#的namespace概念.

主要的會有一個叫做main的package包, 做為這隻可執行程式的入口包.

如果該專案沒有main包時, 就沒法被編譯成可執行檔案.

所以如果是要做成共享套件, 就可以不必有main包的存在於該專案內.

main裡面會有main方法作為程式的執行進入點.

// main包宣告

package main

// 匯入fmt包

import (

"fmt"

)

// main 方法, 作為執行程式的入口

func main() {

fmt.Println("Hello IThome")

}

import

用來導入其他的包, 要用雙引號作為字串來使用.

- 單行匯入

import "包A"

import "包B"

- 多行匯入, 宣告順序不影響真正的匯入結果

import (

"包A"

"包B"

)

要是我有一個包在$GOPATH/src/底下的資料夾路徑是這樣的

- github.com

- ithome

- packageA

那我要引入 packageA的話要按照$GOPATH開始計算的路徑, 使用/進行路徑分隔.

也因為跟資料夾路徑有關, 所以建議上都是把資料夾名稱跟package名稱取名成一致.

- packageA

- ithome

import (

"github.com/ithome/packageA"

)

安裝第三方套件

今天想安裝mysql套件, 他的遠端路徑是 github.com/go-sql-driver/mysql

依照 /作路徑分隔的話.

第一段表示網域名稱

第二段表示作者或者是機構名稱

第三段則是專案名稱

透過go get指令, 透過這指令下載原始碼並且編譯.

由於go get需要GOPATH已經被設置, Go1.8之後GOPATH預設在用戶目錄的go資料夾下.

go get github.com/go-sql-driver/mysql

go get 參數說明:

- -d 只有下載, 不會安裝

- -v verbose, 顯示下載編譯時的log

- -u 更新既有的依賴包

有了基本包的概念, 就能寫簡單的範例了.

# 安裝logrus這log套件

go get github.com/sirupsen/logrus

go/src/packagedemo/mylib/add.go

package mylib

func Add(a, b int) int {

return a + b

}

go/src/packageDemo/main.go

package main

import (

"fmt"

"packagedemo/mylib"

// 這裡使用log 這別名來取代logrus這包名

log "github.com/sirupsen/logrus"

)

func main() {

fmt.Println(mylib.Add(1,2))

log.Info("IThome Iron man")

}

執行

go run main.go

# 輸出 :

# 3

# INFO[0000] IThome Iron man

Array & Slice

- 系列:下班加減學點Golang與Docker系列 第 3 篇

- Day:3

- 發佈時間:2019-09-10 00:30:59

- 原文:https://ithelp.ithome.com.tw/articles/10214513

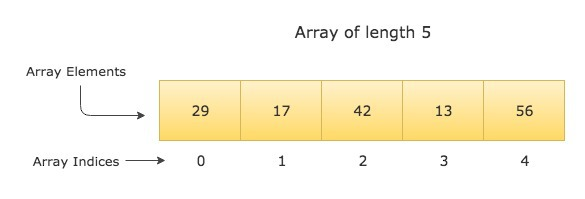

Array

// n 陣列元素數量

// type 陣列元素類型

var array變數 [n]type

- 長度是固定的, 聲明後無法被改變

- 長度是陣列類型的一部份, 所以兩個長度不同但元素類型相同的陣列, 是不同的類型, ex: [2]int 跟[3]int是不同的類型.

初始化方式

a := [3]int{1,2,3}

b := [...]int{1,2,3,4} //透過初始化給的元素數量來給定長度

c := [3]int{2:100, 1:200} //透過索引初始化元素, 沒被初始化的就是該類型的預設值

d := [...]struct {

name string

age uint8

} {

{ "user1", 5 },

{ "user2", 18 },

}

// 多維度陣列

aa := [2][3]int{{1,2,3}, {4,5,6}}

bb := [...][3]int{{1,2,3}, {4,5,6}} //只有第一個維度能用...

操作方法

// 取值

data := aa[1] //透過索引取用

//賦值

aa[1] = 2 //透過索引賦值

// 走訪陣列每個元素

for k, v := range d {

fmt.Println(k, v)

}

/*

0 {user1, 5}

1 {user2, 18}

*/

Array的傳遞

package main

import "fmt"

func main() {

arrA := [2]int{}

var arrB [2]int

arrB = arrA

fmt.Printf("arrA : %p , %v\n", &arrA, arrA)

fmt.Printf("arrB : %p , %v\n", &arrB, arrB)

arr(arrA)

}

func arr(x [2]int) {

fmt.Printf("pass Array : %p , %v\n", &x, x)

}

/*

arrA : 0xc000016100 , [0 0]

arrB : 0xc000016110 , [0 0]

pass Array : 0xc000016150 , [0 0]

*/

3個都是[2]int的記憶體位置都不同, 這很明顯Go在Array的賦值和傳參數都是value type,靠複製整個Array的, 因此如果是1億數量的int64陣列, 一個元素佔64bits, 那這陣列就要800MB, 這樣copy 瞬間會需要1.6GB的記憶體空間.

所以也能改成方法參數傳指針, 來避掉這問題.

package main

import (

"fmt"

"time"

)

func main() {

arrA := [2]int{1, 2}

fmt.Printf("arrA : %p , %v\n", &arrA, arrA)

arr(&arrA)

arrA[0]++

fmt.Printf("arrA : %p , %v\n", &arrA, arrA)

}

func arr(x *[2]int) {

fmt.Printf("pass Array : %p , %v\n", x, *x)

time.Sleep(time.Second)

(*x)[0]++

}

/*

arrA : 0xc00008e010 , [1 2]

pass Array : 0xc00008e010 , [1 2]

arrA : 0xc00008e010 , [3 2]

*/

會看到都是操作同一個位置的陣列了.

但會引發另一個問題, 原來陣列的指針指向改變了, 函數內的也會更著變動.

這兩個問題, Slice都能有效的處理解決.

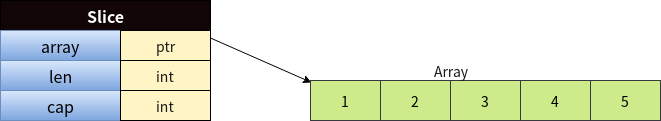

Slice

動態分配大小的Array, 可以不必事先指定大小.

雖然是這樣講, 但他其實是一個結構, 透過ptr指向引用的底層Array.

// type 元素類型

// array 指向array的指針

// len 目前slice中有多少元素數量

// cap 可容納多少個元素

type slice struct {

array unsafe.Pointer

len int

cap int

}

初始化方式

- 從現有的array或是slice生出新的slice

package main

import (

"fmt"

"reflect"

)

func main() {

var arr = [...]int{0, 1, 2, 3, 4, 5, 6, 7, 8, 9}

// 取開始到中間的所有元素

slice0 := arr[:5]

fmt.Println(slice0)

// 取中間到尾部的所有元素

slice1 := arr[5:]

fmt.Println(slice1)

// 取中間區間的所有元素

slice2 := arr[2:7]

fmt.Println(slice2)

// 取所有元素, 表示原有的slice

slice3 := arr[:]

fmt.Println(slice3)

// 重置slice, 清空擁有的元素

slice4 := arr[0:0]

fmt.Println(slice4)

fmt.Println("-------------------")

slice := arr[1:3]

fmt.Println(reflect.TypeOf(arr))

fmt.Println(reflect.TypeOf(slice))

fmt.Println(len(slice), cap(slice))

fmt.Println(arr)

fmt.Println(slice)

fmt.Println("-------------------")

slice[0] = 0

fmt.Println(arr)

fmt.Println(slice)

}

/*

[0 1 2 3 4]

[5 6 7 8 9]

[2 3 4 5 6]

[0 1 2 3 4 5 6 7 8 9]

[]

-------------------

[10]int

[]int

2 9

[0 1 2 3 4 5 6 7 8 9]

[1 2]

-------------------

[0 0 2 3 4 5 6 7 8 9]

[0 2]

*/

- 宣告slice

package main

import (

"fmt"

)

func main() {

// 宣告字串slice

var numList []int

// 宣告一個空slice

var numEmptyList = []int{}

fmt.Println(numList, numEmptyList)

fmt.Println(len(numList), len(numEmptyList))

fmt.Println(numList == nil)

fmt.Println(numEmptyList == nil)

}

/*

[] []

0 0

true

false

*/

這裡第18行是true, 是因為numList只是宣告, 還沒真正實例化

第19行則是有被實例化被分配到記憶體內了.

因為slice還是個struct動態結構, 所以只能和nil作比較.

- 使用make()

// type 元素類型

// size 為slice先分配多少個元素的預設值進去

// cap 預分配的數量, 只是能提前分配空間, 降低之後多次分配空間的效能問題.

make([]type, size, cap)

透過make()生成的slice, 一定會實例化配置記憶體,

但透過從其他slice指定開始和結束位置的slice, 只是把新的slice指向舊的slice已經分配好的空間, 只是新的slice註明開始跟結束位子而已, 此時新的slice並不會真的去跟記憶體要一個新的連續空間來宣告新array.

package main

import (

"fmt"

)

func main() {

// 宣告int slice, 壹開始2個都先分配2元素進去

a := make([]int, 2)

// 會發現b, 它的預先配置在記憶體的位置大小, 其實已經是能塞10個元素的配置了

b := make([]int, 2, 10)

fmt.Println(a, b)

fmt.Println(len(a), len(b))

fmt.Println(cap(a), cap(b))

}

/*

[0 0] [0 0]

2 2

2 10

*/

透過append()添加元素

append()能為slice動態添加數個元素.

當slice不能容納足夠多的元素時, slice就會進行擴容.

"擴容"往往發生在append()被調用時.

擴容時,容量的擴展規律按照容量的2倍在擴容, 例如1、2、4、8.

package main

import (

"fmt"

)

func main() {

// 宣告一個len 和cap 都是0的slice

numbers := make([]int, 0)

for i := 0; i < 10; i++ {

numbers = append(numbers, i)

fmt.Printf("len: %d, cap: %d, ptr: %p\n", len(numbers), cap(numbers), numbers)

}

}

/*

len: 1, cap: 1, ptr: 0xc000016100

len: 2, cap: 2, ptr: 0xc000016130

len: 3, cap: 4, ptr: 0xc000018560

len: 4, cap: 4, ptr: 0xc000018560

len: 5, cap: 8, ptr: 0xc00001a340

len: 6, cap: 8, ptr: 0xc00001a340

len: 7, cap: 8, ptr: 0xc00001a340

len: 8, cap: 8, ptr: 0xc00001a340

len: 9, cap: 16, ptr: 0xc00006e080

len: 10, cap: 16, ptr: 0xc00006e080

*/

可以很明顯看到, 當原來的cap滿的時候, 會產生擴容現象.

舉個生活例子來說明這len和cap以及擴容.

公司發展初期, 資金少, 人員配置也少, 只需要小小的辦公室就能容納所有員工.

隨著業務的擴展和收入的增加, 就需要擴編, 但現有辦公室大小是固定的, 無法改變它.

所以公司決定! 換個更大的辦公室, 每次搬家就要把所有人搬遷到新的辦公處.

員工就是slice中的元素

辦公室就是配置好的記憶體空間, 大小是固定的

搬家就是重新配置

不論搬家多少次, 公司名稱都是固定的, 表示外部使用這slice的變數名稱是不會修改的,

但因為搬家後地址發生變化, 所以slice內部array指向的地址會有所修改.

// 添加多個元素

numbers = append(numbers, 1, 2, 3)

// 透過令一個slice來添加多個元素

nums := []int{4,5,6,7}

numbers = append(numbers, nums...)

More example

package main

import (

"fmt"

)

func main() {

a := make([]int, 0, 10)

b := append(a, 1)

_ = append(a, 2)

fmt.Println(b[0])

}

// 2

// 因為b.ptr = a.ptr, 且a的cap有10,足夠插入新元素,

// 第9行執行完, 會發現a的len還是0

// 執行了 第10行後, 當然append a就會把第0個元素的值給修改掉了.

package main

import (

"fmt"

)

func main() {

a := make([]int, 10, 20)

b := a[5:]

fmt.Println(len(b), cap(b))

}

// 5 15

// 因為b等於是對a作重新slice, 只取a的第5到結束的值. 那就是10-5 = 5, 所以len(b)=5

// cap同上, 指針指到的是a.ptr的第5個元素, 20-5= 15

package main

import (

"fmt"

)

func doAppend(a []int) {

b := append(a, 0)

fmt.Println(b)

}

func main() {

a := []int{1, 2, 3, 4, 5}

doAppend(a[0:2])

fmt.Println(a)

}

// [1 2 0]

// [1 2 0 4 5]

// 調用doAppend時, 傳入2個元素, 但這操作卻把外部的a的第3個元素也改掉了

// 只要把第14行的程式改成doAppend(a[0:2:2])

// [1 2 0]

// [1 2 3 4 5]

// 結果就會正確了, 因為[0:2:2]最後的2就是指定重新切片後的capacity, 這時候指定是2.

// 所以append操作時發現cap >2, 就會重新分配記憶體來存放, 這樣就不會改到原本的了

透過copy()複製slice到令一個slice

Go內建copy()方法, 可以快速的把slice 作copy

// 回傳有多少個元素被複製過去

func copy(dst, src []Type) int

package main

import (

"fmt"

)

func main() {

numbers := make([]int, 0)

for i := 0; i < 10; i++ {

numbers = append(numbers, i)

}

copyA := make([]int, len(numbers))

fmt.Println("copy cnt:", copy(copyA, numbers))

fmt.Println("copied data:", copyA)

copyB := make([]int, 3)

fmt.Println("copy cnt:", copy(copyB, numbers[2:5]))

fmt.Println("copied data:", copyB)

copyC := make([]int, 3)

fmt.Println("copy cnt:", copy(copyC, numbers))

fmt.Println("copied data:", copyC)

}

/*

copy cnt: 10

copied data: [0 1 2 3 4 5 6 7 8 9]

copy cnt: 3

copied data: [2 3 4]

copy cnt: 3

copied data: [0 1 2]

*/

- copyA宣告的容量是來源的既有元素數量, 所以能完整copy來源所有元素.

- copyB只宣告了3個容量的slice, 之前提過slice可以取開始和結束區間, 這裡用這方式來取值作copy

- copyC一樣容量只有3, 但要複製來源所有元素時, 卻因為容量不夠, 所以沒法複製全部. 又因為擴容只會發生在append, 因此這例子不會自動擴容, 導致後半段資料全被切掉.

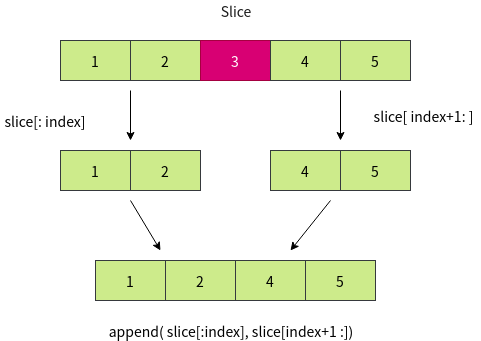

刪除slice中的元素

因為slice並沒有提供刪除專用的api.

所以只能用本身特性來刪除元素.

本質操作上就是, 以被刪除的元素位置為分界點, 將該元素的前後兩個部份作拼接.

package main

import (

"fmt"

)

func main() {

numbers := [...]int{1, 2, 3, 4, 5}

fmt.Println(numbers)

index := 2

fmt.Println(numbers[:index], numbers[index+1:])

deletedNumbers := append(numbers[:index], numbers[index+1:]...)

fmt.Println(deletedNumbers)

}

/*

[1 2 3 4 5]

[1 2] [4 5]

[1 2 4 5]

*/

因為slice如果頻繁刪除新增裡面的元素的話,

是會頻繁的搬動位置, 這點對效能損耗較高.

可能就要考慮其他資料結構來實做.

動動腦, 以下會輸出什麼?

package main

import (

"fmt"

)

func main() {

a := make([]int, 20)

a = []int{7, 8, 9, 10}

b := a[15:16]

fmt.Println(b)

}

- 0

- Panic

- 7

- 不知道

package main

import (

"fmt"

)

func main() {

s := make([]int, 0, 2)

doSomething(s)

fmt.Println(s)

}

func doSomething(a []int) {

a = append(a, 1)

}

出來是 []

但能否解釋為什麼? 這樣才能修正這問題.

新增Common mistakes with for loops in Go

Container 3兄弟-List

- 系列:下班加減學點Golang與Docker系列 第 4 篇

- Day:4

- 發佈時間:2019-09-11 00:04:39

- 原文:https://ithelp.ithome.com.tw/articles/10214704

Go有提供幾種 List、Heap、Ring

來依序玩看看

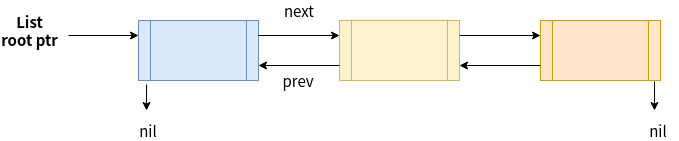

List

因為上篇講Array & Slice, 這兩種底層都需要連續的記憶體空間來配置.

List則是可以非連續空間的容器, 也可以支援快速增刪元素.

List由多個節點所組成的, 節點之間透過一些變數紀錄彼此的關係.

且List並沒有限制每個節點的元素類型. 所以可以是任意類型.

但後續轉換時就要注意.

List有多種實現方式 :

- Single Linked List

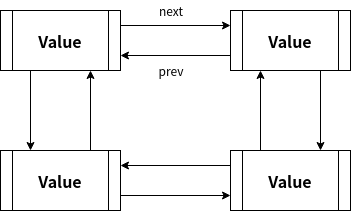

- Double Linked List : Go內建這個類型, 相較於single linked list, 在增刪元素時不需要移動元素, 可以原地增刪. 還能夠雙向走訪.

這是List 的source code, 可以看到有next, prev這兩個ptr, 指向前後各一個元素的位置.

呼叫Init()時, prev, next都指向root節點.

// Element is an element of a linked list.

type Element struct {

// Next and previous pointers in the doubly-linked list of elements.

// To simplify the implementation, internally a list l is implemented

// as a ring, such that &l.root is both the next element of the last

// list element (l.Back()) and the previous element of the first list

// element (l.Front()).

next, prev *Element

// The list to which this element belongs.

list *List

// The value stored with this element.

Value interface{}

}

// List represents a doubly linked list.

// The zero value for List is an empty list ready to use.

type List struct {

root Element // sentinel list element, only &root, root.prev, and root.next are used

len int // current list length excluding (this) sentinel element

}

// Init initializes or clears list l.

func (l *List) Init() *List {

l.root.next = &l.root

l.root.prev = &l.root

l.len = 0

return l

}

// New returns an initialized list.

func New() *List { return new(List).Init() }

初始化List

// 透過New(), New會去呼叫Init()

變數名稱 := list.New()

// 透過聲明來初始化

var 變數名稱 list.List

插入新元素

PushFront、PushBack 可以在List的最前面或最後面增加元素.

PushFront 是對目前List的root節點前面在多一個元素; 看原始碼會發現呼叫了insertValue(), 第二個參數是root, 然後又呼叫了insert(&Element, root), 第一個參數是新增的元素, 第二個參數是該新增元素要插入在誰的後面, 這裡是安插在root後面.

PushBack 是對目前List的尾巴節點後面多一個元素.

InsertBefore、InsertAfter則是在被標記的元素前或後增加元素.

原始碼

// insert inserts e after at, increments l.len, and returns e.

func (l *List) insert(e, at *Element) *Element {

n := at.next

at.next = e

e.prev = at

e.next = n

n.prev = e

e.list = l

l.len++

return e

}

// insertValue is a convenience wrapper for insert(&Element{Value: v}, at).

func (l *List) insertValue(v interface{}, at *Element) *Element {

return l.insert(&Element{Value: v}, at)

}

// PushFront inserts a new element e with value v at the front of list l and returns e.

func (l *List) PushFront(v interface{}) *Element {

l.lazyInit()

return l.insertValue(v, &l.root)

}

// PushBack inserts a new element e with value v at the back of list l and returns e.

func (l *List) PushBack(v interface{}) *Element {

l.lazyInit()

return l.insertValue(v, l.root.prev)

}

// InsertBefore inserts a new element e with value v immediately before mark and returns e.

// If mark is not an element of l, the list is not modified.

// The mark must not be nil.

func (l *List) InsertBefore(v interface{}, mark *Element) *Element {

if mark.list != l {

return nil

}

// see comment in List.Remove about initialization of l

return l.insertValue(v, mark.prev)

}

// InsertAfter inserts a new element e with value v immediately after mark and returns e.

// If mark is not an element of l, the list is not modified.

// The mark must not be nil.

func (l *List) InsertAfter(v interface{}, mark *Element) *Element {

if mark.list != l {

return nil

}

// see comment in List.Remove about initialization of l

return l.insertValue(v, mark)

}

package main

import (

"container/list"

"fmt"

)

func traverse(list *list.List) {

// 走訪list

fmt.Printf("root -> ")

for el := list.Front(); el != nil; el = el.Next() {

fmt.Printf("%v -> ", el.Value)

}

}

func main() {

// 宣告一個List, 並且初始化

list := list.New()

// 最後面新增20

list.PushBack(20)

// 最前面新增10

list.PushFront("10")

// 最後面新增25, 並且保存該新增元素到變數上

element := list.PushBack(25)

// 在該元素後面新增26

list.InsertAfter("26", element)

// 在該元素前面新增24

list.InsertBefore(24, element)

traverse(list)

fmt.Println("\n---------------------")

// element 換到第一個元素的後面

list.MoveAfter(element, list.Front())

traverse(list)

fmt.Println("\n---------------------")

// element 換到第一個元素的前面

list.MoveBefore(element, list.Front())

traverse(list)

fmt.Println("\n---------------------")

// element 換到最後面

list.MoveToBack(element)

traverse(list)

fmt.Println("\n---------------------")

// element 換到最前面

list.MoveToFront(element)

traverse(list)

fmt.Println("\n---------------------")

// 移除該元素

list.Remove(element)

traverse(list)

}

/*

root -> 10 -> 20 -> 24 -> 25 -> 26 ->

---------------------

root -> 10 -> 25 -> 20 -> 24 -> 26 ->

---------------------

root -> 25 -> 10 -> 20 -> 24 -> 26 ->

---------------------

root -> 10 -> 20 -> 24 -> 26 -> 25 ->

---------------------

root -> 25 -> 10 -> 20 -> 24 -> 26 ->

---------------------

root -> 10 -> 20 -> 24 -> 26 ->

*/

走訪List

走訪List需要配合Front()取得第一個元素, 開始往下走訪.

每次就呼叫目前元素的Next(), 只要元素不是nil 就能繼續往下走.

也能逆向往前走, 改用Prev()就可.

取得List長度

list.Len()

List vs Slice

比較新增元素、插入元素、走訪的速度

package main

import (

"container/list"

"fmt"

"time"

)

func main() {

t := time.Now()

sli := make([]int, 10)

for i := 0; i < 1*100000*1000; i++ {

sli = append(sli, 1)

}

fmt.Println("Slice 新增元素耗費:" + time.Now().Sub(t).String())

// 比较走訪

t = time.Now()

for _ = range sli {

}

fmt.Println("走訪Slice耗費:" + time.Now().Sub(t).String())

// 比較插入元素

t = time.Now()

slif := sli[:100000*500]

slib := sli[100000*500:]

slif = append(slif, 10)

slif = append(slif, slib...)

fmt.Println("Slice 的插入元素耗費 : " + time.Now().Sub(t).String())

// 比較刪除元素

t = time.Now()

index := 100000

_ = append(sli[:index], sli[index+1:]...)

fmt.Println("Slice 的刪除元素耗費 : " + time.Now().Sub(t).String())

sli = make([]int, 10)

// ---------Slice end, start list

fmt.Println("------------------------------")

t = time.Now()

l := list.New()

for i := 0; i < 1*100000*1000; i++ {

l.PushBack(1)

}

fmt.Println("List 新增元素耗費: " + time.Now().Sub(t).String())

t = time.Now()

for e := l.Front(); e != nil; e = e.Next() {

}

fmt.Println("走訪List耗費:" + time.Now().Sub(t).String())

var em *list.Element

i := 0

// 找到1/3處的元素

for e := l.Front(); e != nil; e = e.Next() {

i++

if i == l.Len()/3 {

em = e

break

}

}

// 因為是記算插入元素的速度, 所以忽略查找的時間

t = time.Now()

l.InsertAfter(2, em)

fmt.Println("List 的插入元素耗費 : " + time.Now().Sub(t).String())

// 比較刪除元素

t = time.Now()

l.Remove(em)

fmt.Println("List 的刪除元素耗費:" + time.Now().Sub(t).String())

}

/*

Slice 新增元素耗費:1.749752738s

走訪Slice耗費:35.548381ms

Slice 的插入元素耗費 : 46.402953ms

Slice 的刪除元素耗費 : 92.097862ms

------------------------------

List 新增元素耗費: 17.721431965s

走訪List耗費:364.763942ms

List 的插入元素耗費 : 2.17µs

List 的刪除元素耗費:73ns

*/

結論

對於資料量很多的情境下,

如果很頻繁的插入或是刪除, List的成本低到幾乎可以不計算.

但如果頻繁的新增或是走訪查找, Slice的效能高過List許多.

首圖是參考該文章的, 該文有講單鏈, 雙鏈跟環鏈, 有機會再分享

Container 3兄弟-Heap

- 系列:下班加減學點Golang與Docker系列 第 5 篇

- Day:5

- 發佈時間:2019-09-12 00:25:02

- 原文:https://ithelp.ithome.com.tw/articles/10214861

Heap

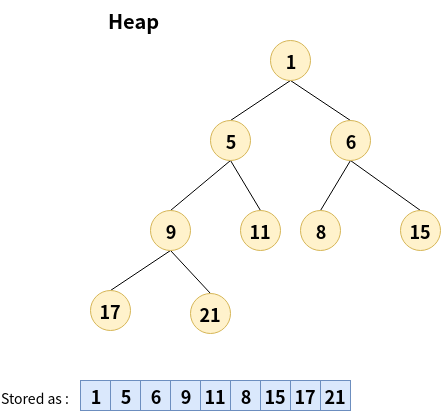

Heap(堆積)其實是一個Complete Binary Tree(完全二元樹).

Go的Heap特性是 各個節點都自己是其子樹的根, 且值是最小的.

同個根節點的左子樹的值會小於右子樹.

所以根節點的值是最小的, 位於索引0的位置.

也有另一種是最大的(max heap), 只是Go這裡是最小的(min heap).

定義 : n個元素 k1, k2,...ki...kn, 並且若且唯若滿足下列關係時稱為heap

ki <= k2i, ki <= k(2i+1) 或者 ki >= k2i, ki >= k(2i+1), i = 1,2,3...,n/2

又因為最小(或最大)的值, 取出該值都只要O(1)的時間.

通常該結構是用來實現(priority queue)優先隊列的方法之一. 能對任務工作作優先等級的排序用.

底層還是以陣列形式表示

Dijkstra's algorithm也是能用Heap做實現.

Heap Interface

這裡會提到接口interface, 之後會更詳細的介紹interface的部份

只要實現這些接口, 就可以操作heap提供的各種方法了.

可以看得出來heap接口繼承了sort.Interface, 而sort.Interface內又有三個方法需要實現.

繼承後面會有更詳細的部份介紹.

總之就是要實現這5個方法就行了.

type Interface interface {

sort.Interface

Push(x interface{}) // add x as element Len()

Pop() interface{} // remove and return element Len() - 1.

}

// sort.Interface

type Interface interface {

// Len is the number of elements in the collection.

Len() int

// Less reports whether the element with

// index i should sort before the element with index j.

Less(i, j int) bool

// Swap swaps the elements with indexes i and j.

Swap(i, j int)

}

初始化Heap

heap.Init(customizeHeap)

Heap內建的操作方法

// 一個滿足以上全部接口的堆積結構, 在操作前都要先執行Init()做初始化排序.

// 複雜度O(log n), n = Len(), 因為是二元搜尋樹的查找

func Init(h Interface) {

// heapify

n := h.Len()

for i := n/2 - 1; i >= 0; i-- {

down(h, i, n)

}

}

// 對Array增加一個新元素在最後面

// 並透過up()重新排序把元素作上升, 來滿足min heap的要求.

// 複雜度O(log n), n = Len()

func Push(h Interface, x interface{}) {

h.Push(x) // 會呼叫我們自定義好的Push()

up(h, h.Len()-1)

}

// 刪除並且返回Len()-1位置的元素(Array最後一個的元素)

// 等同於對Array做了取[:n-1]的動作, 等於是把第一個元素跟最後一個做了互換後, 透過down(), 把新的根節點下沉到適合的位置, 用來滿足min heap的要求.

// Pop()跟Remove(h, 0 )是一樣的

func Pop(h Interface) interface{} {

n := h.Len() - 1

h.Swap(0, n)

down(h, 0, n)

return h.Pop() // 會呼叫我們自定義好的Pop()

}

// 如果heap中有元素的值被修改, 則透過Fix()重新排序, down() & up()也會被呼叫.

// 複雜度O(log n), n = Len()

func Fix(h Interface, i int) {

if !down(h, i, h.Len()) {

up(h, i)

}

}

// 刪除heap中第i個元素, 並且重新排序

// 複雜度O(log n), n = Len()

func Remove(h Interface, i int) interface{} {

n := h.Len() - 1

if n != i {

h.Swap(i, n)

if !down(h, i, n) {

up(h, i)

}

}

return h.Pop()

}

// 把元素下沉到對應的子樹合適的位置上

func down(h Interface, i0, n int) bool {...}

// 把元素上升到對應的子樹合適的位置上

func up(h Interface, j int) {...}

實現自定義的int Heap

首先定義一個類型或是結構, 並且實現那5個方法.

取官網的範例來說明

package main

import (

"container/heap"

"fmt"

)

// An IntHeap is a min-heap of ints.

type IntHeap []int

// 返回元素個數

func (h IntHeap) Len() int { return len(h) }

// 比較大小, 只要索引i的元素<索引j的元素, 就會返回true, 否則返回false, 因為是Min Heap, 所以都在比小

// Max Heap就是反過來比大, 但這方法名還是叫Less不能改就是了XD

func (h IntHeap) Less(i, j int) bool { return h[i] < h[j] }

// 交換h[i]跟h[j]的元素, Golang對swap的寫法很簡單, 不必在創建temp變數在那裡賦值.

func (h IntHeap) Swap(i, j int) { h[i], h[j] = h[j], h[i] }

// 新增元素

func (h *IntHeap) Push(x interface{}) {

*h = append(*h, x.(int))

}

// Pop出最後一個元素

func (h *IntHeap) Pop() interface{} {

old := *h

n := len(old)

// 把最後一個賦值給x

x := old[n-1]

// 建立一組新的slice , 取原有的slice 開始到n-1個元素, 並賦值

*h = old[0 : n-1]

return x

}

func main() {

h := &IntHeap{2, 1, 5}

heap.Init(h)

heap.Push(h, 3)

heap.Push(h, 4)

heap.Push(h, 9)

fmt.Printf("minimum: %d\n", (*h)[0])

// first : 1

for h.Len() > 0 {

fmt.Printf("%d ", heap.Pop(h))

}

// 2 3 4 5 9

// 把上面走訪heap整段註解掉

// 修改第1個元素的值

// 會把原本h[1]的元素, 移動到適當的位置去

(*h)[1] = 6

// 讓heap重新排序

heap.Fix(h, 1)

for h.Len() > 0 {

fmt.Printf("%d ", heap.Pop(h))

}

// 2 4 5 6 9

}

實現Priority Queue

package main

import (

"container/heap"

"fmt"

)

// 元素結構

type Item struct {

value string // 元素的值

priority int // 元素的優先權值

index int // 紀錄索引值

}

// PriorityQueue, 本質上是一個*item的Array

type PriorityQueue []*Item

// sort.Interface的實現

// 返回元素個數

func (pq PriorityQueue) Len() int { return len(pq) }

// 因為希望Pop出來的是priority值最大的元素, 所以這裡的邏輯是反著寫

// 其實這就是個Max Heap, 根節點的priority的值大於其他.

func (pq PriorityQueue) Less(i, j int) bool {

return pq[i].priority > pq[j].priority

}

// 交換pq[i]跟pq[j]的元素, 這裡還要互換兩個元素彼此的index

func (pq PriorityQueue) Swap(i, j int) {

pq[i], pq[j] = pq[j], pq[i]

pq[i].index = i

pq[j].index = j

}

// heap.Interface的實現

// 新增元素在Array最後

func (pq *PriorityQueue) Push(x interface{}) {

n := len(*pq)

item := x.(*Item) // 這裡用類型斷言, 日後會補充

item.index = n // 設定新增進來元素的index

*pq = append(*pq, item)

}

// Pop出Array最後1個元素

func (pq *PriorityQueue) Pop() interface{} {

old := *pq

n := len(old)

item := old[n-1]

old[n-1] = nil // 把元素設置為沒有指向任何東西, 等GC來回收原來指向所配置出來的空間

item.index = -1 // 保險起見, 把pop出去的元素index設置成-1

*pq = old[0 : n-1] // 從old slice來取 0 ~ n-1的元素來形成新的slice, 並賦值給*pq

return item

}

// 更新元素的值和優先權, 並且重新排序

func (pq *PriorityQueue) update(item *Item, value string, priority int) {

item.value = value

item.priority = priority

heap.Fix(pq, item.index)

}

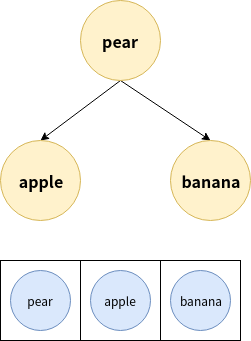

func main() {

items := map[string]int{

"banana": 3, "apple": 2, "pear": 4,

}

pq := make(PriorityQueue, len(items))

i := 0

for value, priority := range items {

pq[i] = &Item{

value: value,

priority: priority,

index: i, // 依照清單個數, 依序給index

}

i++

}

// 初始化Heap

heap.Init(&pq)

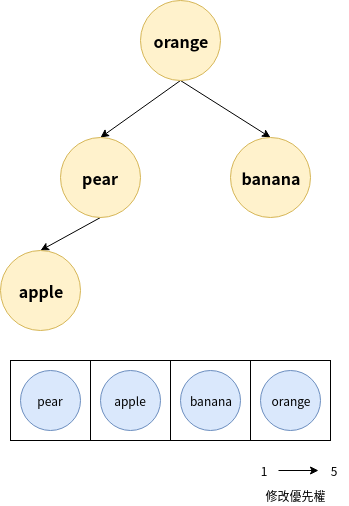

// 新增一個新元素

item := &Item{

value: "orange",

priority: 1,

}

heap.Push(&pq, item)

// 修改該元素

pq.update(item, item.value, 5)

// 依序Pop出來

for pq.Len() > 0 {

item := heap.Pop(&pq).(*Item)

fmt.Printf("%.2d:%s ", item.priority, item.value)

}

}

// 05:orange 04:pear 03:banana 02:apple

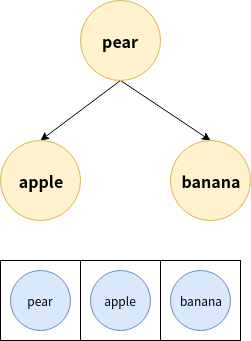

初始化完成時的heap跟Array

新增orange, 並修改優先權後, 明顯orange被上升到合適的位置了

依序Pop出來

我發現Array位置沒改對...原諒我, 懶得修圖了 - .-

但二元樹是對的!'

LeetCode 23 可以嘗試用heap來實現

小弟我日後補上

Container 3兄弟-Ring

- 系列:下班加減學點Golang與Docker系列 第 6 篇

- Day:6

- 發佈時間:2019-09-13 01:17:06

- 原文:https://ithelp.ithome.com.tw/articles/10214925

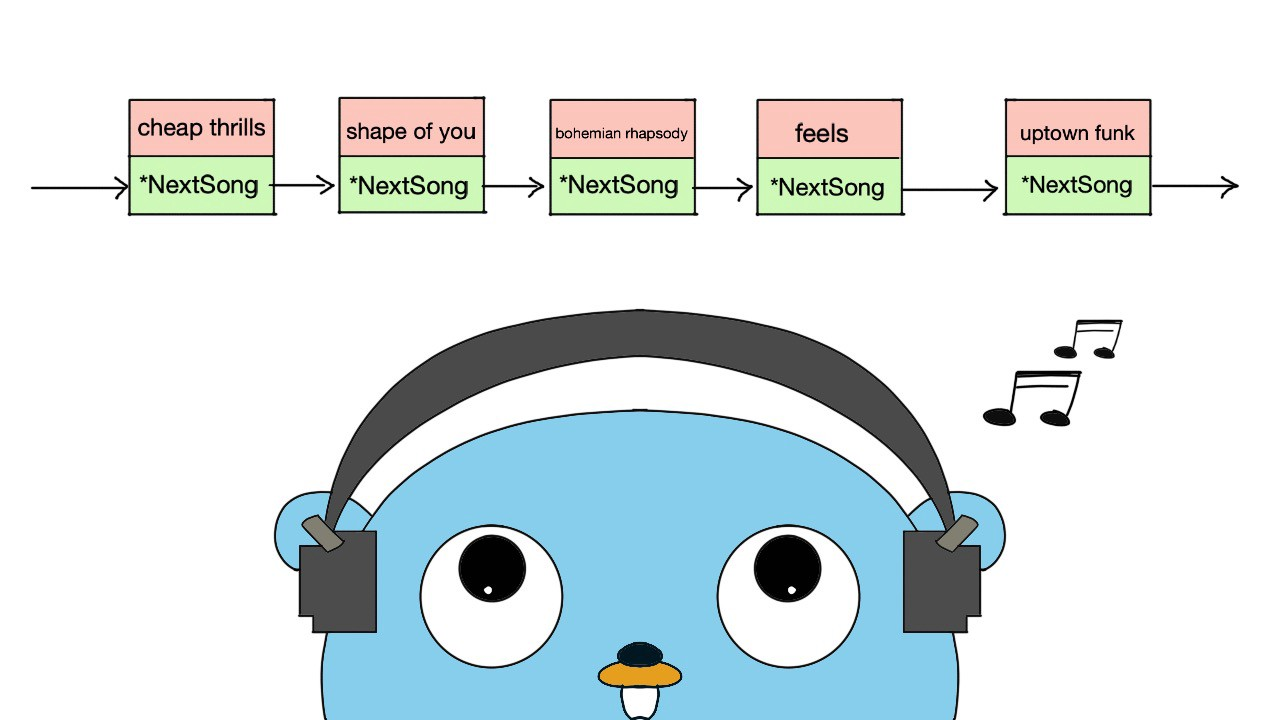

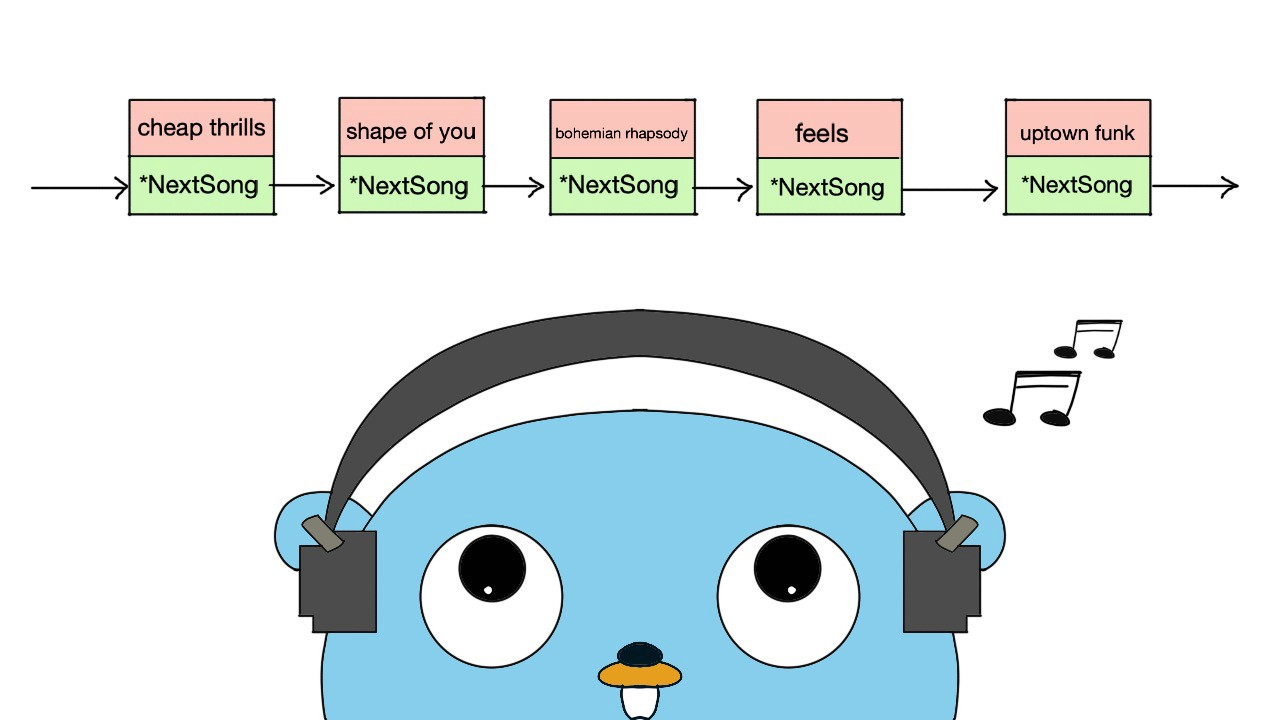

這隻又跑出來了XD

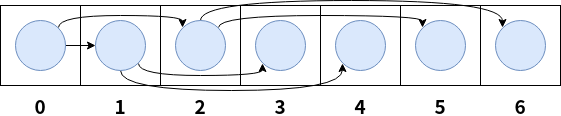

Ring其實就是雙向環鏈(circular doubled linked list)

用這圖, 是想表達, 我們有一個歌單

可以單向依序放到完, 當然也能選擇循環依序播放阿 !!!

Ring可以滿足這行為的操作!!

Ring

只有一個Value屬性,開發者可以任意操作.

prev, next都是給操作方法操作用的.

type Ring struct {

next, prev *Ring

Value interface{}

}

Ring vs List

可以發現Ring的結構跟List超像.

- 結構差別是List是由List和Element類別兩個聯合表示; 而Ring自己就能代表值和關聯.

- Ring一開始要指定初始元素個數, 被創建出來後, 長度就不可變; 但List則不必, 也沒這必要.

- 通過var聲明的Ring的零值是長度為1的環鏈; 而List的零值則是長度為0的雙向鏈結, 因為只有root ptr, 並沒有指向任何元素.

- Ring的Len()是O(N), 它需要把每個元素走訪一次直到走到自己; List的則是O(1), 因為有個len變數在紀錄長度. 這在某些情境上, 大大影響效能.

初始化

- 透過New(size), 生出長度為size的Ring

// New creates a ring of n elements.

func New(n int) *Ring {

if n <= 0 {

return nil

}

r := new(Ring)

p := r

for i := 1; i < n; i++ {

p.next = &Ring{prev: p}

p = p.next

}

p.next = r

r.prev = p

return r

}

func (r *Ring) init() *Ring {

r.next = r

r.prev = r

return r

}

- 透過宣告, 生出長度為1的Ring

var ring變數 ring.Ring

操作方法

- 透過next取得下一個元素

func (r *Ring) Next() *Ring {...}

- 透過prev取得前一個元素

func (r *Ring) Prev() *Ring {...}

- 讓目前環鏈依據目前所在的元素位置, 往前(n<0)或是往後(n>0)移動數個位置

func (r *Ring) Move(n int) *Ring {...}

- 讓目前的環鏈與另一個環鏈作連結, s會插入到r目前指向的元素後面, 返回插入前, r.Next()所表示的元素

如果r跟s指向的是同一個ring, 就會刪掉r跟s之間的元素,

被刪掉的元素會組成一個新的ring, 返回的就是指向這新ring的指針

func (r *Ring) Link(s *Ring) *Ring {...}

- 從當前環鏈所在的Next()依序刪除n個元素, 返回值是被刪除的元素們

func (r *Ring) Unlink(n int) *Ring {...}

- 取得環鏈元素個數, 複雜度為O(N)

func (r *Ring) Len() int {...}

- 傳入一個函數, Do會依序地讓每個元素的Value當作參數去執行該函數; 類似JS的map()

也能透過累加數值在外部變數上

或者實做策略模式, 執行每個元素的封裝行為.

但要避免函數f去改變了r, 會發生不可預期的行為.

func (r *Ring) Do(f func(interface{})) {...}

基本範例

package main

import (

"container/ring"

"fmt"

)

// 宣告一個要給Do()執行的函數, 用來列印值而已

var printRing = func(v interface{}) {

fmt.Print(v.(int), "->")

}

// 只是用來呼叫r.Do跟代入printRing, 只是多一個換行

func PrintRing(r *ring.Ring) {

r.Do(printRing)

fmt.Println()

}

func main() {

// 透過var 來宣告ring

var varRing ring.Ring

// 查看透過var宣告的ring的長度

fmt.Println("查看透過var宣告的ring的長度: ", varRing.Len())

fmt.Println("----------------------")

//透過New創建10個元素的ring

r := ring.New(10)

// 查看透過New()初始化ring的長度

fmt.Println("查看透過New()初始化ring的長度: ", r.Len())

// 給ring中每個元素進行走訪並且給值

for i := 0; i < 10; i++ {

r.Value = i

// 取得下一個元素

r = r.Next()

}

fmt.Print("r : ")

PrintRing(r)

// 往後移動ring的指向

r = r.Move(2)

fmt.Println("ring 向後移動2個位置的元素值:", r.Value)

// 往前移動ring的指向

r = r.Move(-8)

fmt.Println("ring 向前移動8個位置的元素值:", r.Value)

// 從ring當前指向開始刪除n個元素

deletedElm := r.Unlink(2)

fmt.Print("r 所剩下的元素 : ")

PrintRing(r)

fmt.Print("從r刪除的元素 : ")

PrintRing(deletedElm)

// 準備第2個ring r2

r2 := ring.New(3)

for i := 0; i < 3; i++ {

r2.Value = i + 10

r2 = r2.Next()

}

fmt.Print("r2 : ")

PrintRing(r2)

fmt.Println("現在r的指向在 :", r.Value)

// Link r 跟 r2

fmt.Print("Link r 跟 r2 : ")

linkedRing := r.Link(r2)

PrintRing(r)

// 以原本r.Next()開始走訪

fmt.Print("以原本r.Next()開始走訪 : ")

PrintRing(linkedRing)

}

/*

查看透過var宣告的ring的長度: 1

----------------------

查看透過New()初始化ring的長度: 10

r : 0->1->2->3->4->5->6->7->8->9->

ring 向後移動2個位置的元素值: 2

ring 向前移動8個位置的元素值: 4

r 所剩下的元素 : 4->7->8->9->0->1->2->3->

從r刪除的元素 : 5->6->

r2 : 10->11->12->

現在r的指向在 : 4

Link r 跟 r2 : 4->10->11->12->7->8->9->0->1->2->3->

以原本r.Next()開始走訪 : 7->8->9->0->1->2->3->4->10->11->12->

*/

輪播範例

package main

import (

"container/ring"

"fmt"

"time"

)

// song類別

type song struct {

name string

artist string

length time.Duration

}

// 定義歌單

var (

songs = []song{

{

name: "Something Just Like This",

artist: "The Chainsmokers",

length: 247,

},

{

name: "Blame",

artist: "Calvin Harris",

length: 214,

},

{

name: "Wolves",

artist: "Selena Gomez",

length: 197,

},

{

name: "Sing You To Sleep",

artist: "Matt Cab",

length: 236,

},

}

)

func main() {

// 載入歌單

songList := ring.New(len(songs))

repeatedCnt := 0

for i := 0; i < songList.Len(); i++ {

songList.Value = songs[i]

songList = songList.Next()

}

// 開始播放

for {

if repeatedCnt == 1 {

break

}

songList.Do(func(v interface{}) {

time.Sleep((v.(song).length / 100) * time.Second) // 加速播放

fmt.Printf("現正播放%s, 演唱者為%s\n", v.(song).name, v.(song).artist)

})

repeatedCnt++

fmt.Printf("播放次數 : %d\n", repeatedCnt)

}

fmt.Println("播放完畢")

}

/*

現正播放Something Just Like This, 演唱者為The Chainsmokers

現正播放Blame, 演唱者為Calvin Harris

現正播放Wolves, 演唱者為Selena Gomez

現正播放Sing You To Sleep, 演唱者為Matt Cab

播放次數 1:

現正播放Something Just Like This, 演唱者為The Chainsmokers

現正播放Blame, 演唱者為Calvin Harris

現正播放Wolves, 演唱者為Selena Gomez

現正播放Sing You To Sleep, 演唱者為Matt Cab

播放次數 2:

現正播放Something Just Like This, 演唱者為The Chainsmokers

現正播放Blame, 演唱者為Calvin Harris

現正播放Wolves, 演唱者為Selena Gomez

現正播放Sing You To Sleep, 演唱者為Matt Cab

播放次數 3:

播放完畢

*/

3兄弟各自適合的使用場景

- List

- FIFO queue

- Heap

- 排序

- Priority queue

- 定時器

- Ring

- 上面提到的輪播

- 保存近n筆操作日誌

應該還有更多, 我暫時還沒想到, 歡迎大家補充給我.

感謝各位.

字典 Map

- 系列:下班加減學點Golang與Docker系列 第 7 篇

- Day:7

- 發佈時間:2019-09-14 00:19:15

- 原文:https://ithelp.ithome.com.tw/articles/10215194

Map

Map是一種透過Key來取得Value的一種資料結構, 目的是為了快速查找用O(1).

為什麼MAP能這麼快定位到資料是否存在,或資料本身的位置

因為它使用更多資訊來紀錄資料放在哪邊

就像關聯式資料庫的索引,以空間來換取時間 (反正現在記憶體夠大夠便宜XD)

而Key具唯一性,在Map中若Key重複, 會把Value作後蓋前的更新.

Java的話是HashMap, C# & Python則是Dictionary.

Go的map是一張hash table的引用, 它是一個無序的key/value成對的集合.

Key跟Value可以是不同類型, 但在同一個map內的key一定要同一種類型.

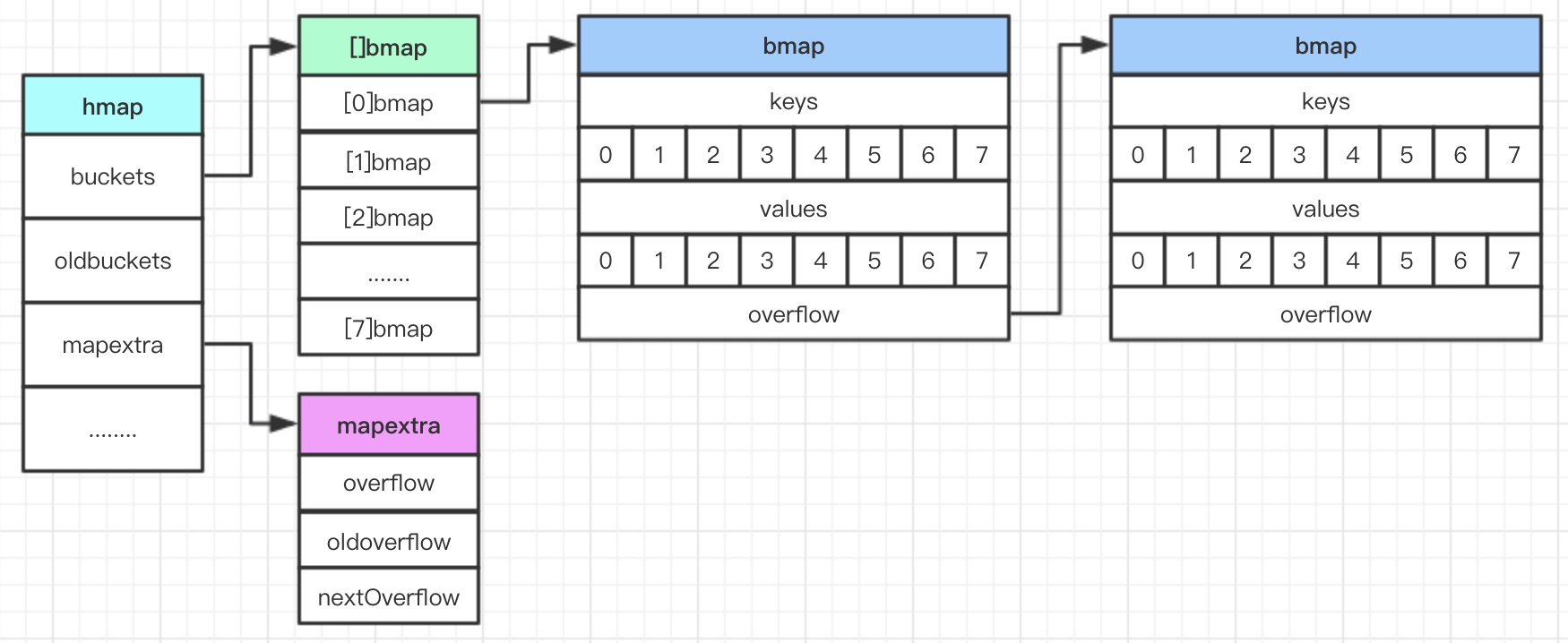

底層實現

Go在map的底層實現是透過之前提到的Array+List去實現的.

Go這裡把hash table稱為buckets是個Array.

bucket內每個元素是指向一串List, 每個節點為bmap, 裡面最多放8組key和value.

根據Hash函數獲得key的特徵值, 作為hash key去映射看是對到哪個bucket.

所以查找Hash table只需要O(1).

如果特徵值重複, 表示元素發生碰撞. 碰撞的元素就會放在同一個特徵值的list中.

當bmap因為最多放8組key, 超過多的會放到overflow這裡.

然後同一list的bmap過多的話, 會進行擴容. 盡量避免碰撞發生.

更多詳情能看連結, 有更多大神整理出文章.

Map格式

map[KeyType]ValueType

初始化Map

map是內建型別, 所以不需要額外import任何lib.

map是個reference type.

不是透過該2種方式創建的話, 後續在存取上會引生panic錯誤

// make創建

map變數 := make(map[keyType]valueType)

// 直接實例化, 大括號內能給key:value

map變數 := map[keyType]valueType{}

map變數 := map[string]int{"C":5, "B":6}

注意

// 通過宣告但沒實例化

var colors map[string]string

colors["red"] = "#da1337"

// 會出現error

// siignment to entry in nil map

// 這是因為使用一個沒初始化的map, 其實你得到的是一個指向nil的指標而已.

操作方法

新增元素

map變數[key] = value

刪除元素

使用delete()

delete(map變數, key)

查詢取值

查詢分兩類, 一種直接給key; 一種是走訪, 不需要知道key

Key查找

- 直接取值

v := map變數[key]

value := colors["blue"]

// 直接判斷value是否為零值; key不在, 是返回該valuetype的零值

if value != "" {...}

- 取值和取得這key是否存在的標誌

v, exist := map變數[key]

value, exists := colors["blue"]

// 判斷key是否存在

if exists != "" {...}

- 走訪, 就不必知道key了

for key, value := range map變數 {...}

package main

import "fmt"

func main() {

mapDemo := map[int]int{

1: 1,

2: 2,

3: 3,

4: 4,

5: 5,

6: 6,

7: 7,

8: 8,

9: 9,

10: 10,

}

for k, v := range mapDemo {

fmt.Println("value :", v, ", key : ", k)

}

}

/*

value : 9 , key : 9

value : 10 , key : 10

value : 6 , key : 6

value : 7 , key : 7

value : 3 , key : 3

value : 4 , key : 4

value : 5 , key : 5

value : 8 , key : 8

value : 1 , key : 1

value : 2 , key : 2

*/

疑, 為什麼走訪順序不如預期中的那樣排序.

雖然前面有提過本質是hash table本來就是無序的.

但小弟稍微提一下, 更多大神有針對這情況作討論.

Go是random key的方式挑選要從哪個開始走訪.

但是有自己一套隨機函數, 讓挑中每個元素的機會都是一樣的.

也是為了避免太常挑到array裡是nil的部份.

- 清空map

抱歉...Go沒有清空的方法, 就是重新make一個新的map.

不必去擔心GC的效率.

map變數 := make(map[keyType]valueType)

- 取得map的元素個數

len(map變數)

基本範例

package main

import "fmt"

func main() {

// 初始化一個key是string, value是int的map

m := make(map[string]int)

// 依據key 塞值

m["k1"] = 7

m["k2"] = 13

fmt.Println("map:", m)

// 依據key取值

v1 := m["k1"]

fmt.Println("v1: ", v1)

// 取得map的長度

fmt.Println("len:", len(m))

// 根據key刪除元素

delete(m, "k2")

fmt.Println("map:", m)

// 判斷k2在不再map內

_, prs := m["k2"]

fmt.Println("prs:", prs)

// 從給定的元素直接去實例化map

n := map[string]int{"foo": 1, "bar": 2}

fmt.Println("map:", n)

}

/*

map: map[k1:7 k2:13]

v1: 7

len: 2

map: map[k1:7]

prs: false

map: map[bar:2 foo:1]

*/

Sync.Map

因為map在併發情況下讀寫map, 並沒保證線程安全.

package main

func main() {

m := make(map[int]int)

// 一條goroutine 拼命塞值

go func() {

for {

m[1] = 1

}

}()

// 一條goroutine 拼命取值

go func() {

for {

_ = m[1]

}

}()

// 無窮迴圈

for {

}

}

/*

fatal error: concurrent map read and map write

*/

噴錯了!! 因為使用了兩個goroutine併發的讀跟寫,

在讀取時, 會檢查hashWriting這標記, 如果這標記為true, 產生了race condition.

map內部機制會對這種併發操作進行檢查並提早發現.

當然也能透過加上讀寫鎖, 來保證線程安全. 但這樣效能很差.

Go則是提供了sync.Map, 該結構具有這些特性:

- 無須初始化, 只需要聲明宣告

- 不能透過上面的操作方法, 要用Store/Load/Delete/LoadOrStore/Range來操作

- Lock-free, 採用CAS演算法

- 沒提供len()方法

type Map struct {

mu Mutex // 給dirty map用的

read atomic.Value // readOnly, 這本身保證線程安全

dirty map[interface{}]*entry

misses int

}

操作方式

Store 儲存一組key跟value

func (m *Map) Store(key, value interface{}) {...}

Load 依靠key來尋找, 如果存在返回值跟true ; 不存在就返回nil跟false

func (m *Map) Load(key interface{}) (value interface{}, ok bool) {...}

LoadOrStore 依靠key來尋找, 如果存在返回value跟true ; 不存在就新增key跟value, 並返回false

func (m *Map) LoadOrStore(key, value interface{}) (actual interface{}, loaded bool) {...}

Delete 依靠key來刪除

func (m *Map) Delete(key interface{}) {...}

Range 走訪讀取map中元素的key和value傳給函數f

func (m *Map) Range(f func(key, value interface{}) bool) {...}

基本範例

package main

import (

"fmt"

"sync"

)

var printMap = func(key, value interface{}) bool {

fmt.Printf("key: %s, value: %d\n", key, value)

return true

}

func main() {

// 初始化sync.map

var m sync.Map

// 新增元素

m.Store("k1", 7)

m.Store("k2", map[string]int{"k4": 5})

// 走訪map

m.Range(printMap)

fmt.Println("------------")

// 依據key讀取元素

v1, _ := m.Load("k1")

fmt.Println("v1: ", v1)

fmt.Println("------------")

// 依照key 刪除元素

m.Delete("k2")

// 讀取或是新增元素

v1, exist := m.LoadOrStore("k1", 8)

fmt.Printf("v1: %d, exist: %v\n", v1, exist)

v3, exist3 := m.LoadOrStore("k3", 2)

fmt.Printf("v3: %d, exist: %v\n", v3, exist3)

m.Range(printMap)

fmt.Println("------------")

_, exist2 := m.Load("k2")

fmt.Printf("v3 exist: %v\n", exist2)

}

/*

key: k1, value: 7

key: k2, value: map[%!d(string=k4):5]

------------

v1: 7

------------

v1: 7, exist: true

v3: 2, exist: false

key: k1, value: 7

key: k3, value: 2

------------

v3 exist: false

*/

Type & Struct, 從單細胞生物, 來到多細胞生物了

- 系列:下班加減學點Golang與Docker系列 第 8 篇

- Day:8

- 發佈時間:2019-09-15 01:11:43

- 原文:https://ithelp.ithome.com.tw/articles/10215377

Type

type這關鍵字用來聲明宣告一些東西

- struct

等下就介紹 - interface

下次介紹 - 基礎型別

package main

import (

"fmt"

)

// 宣告別名

type name = string

// 定義新的基礎型別

type newStr string

func SayName(str name) {

fmt.Println(str)

}

func Say(str newStr) {

fmt.Println(str)

}

func main() {

var str = "test"

SayName(str)

// 這行會噴型別錯誤, 註解掉用下面的方式寫

// Say(str)

var ns newStr

ns = "test newStr"

Say(ns)

}

/*

main.go:25:6: cannot use str (type string) as type newStr in argument to Say

str是字串類型, 可以傳入也是string但卻是別名的SayName, 可見類型一致.

但透過type宣告出來的基礎型別, 卻是不同的類型, 無法傳入使用string的Say.

*/

- 類型查詢

//在switch使用變數名稱.(type), 查詢變數是由哪種類型賦值的

switch v := a.(type) {

case string:

fmt.Println("string type")

case int:

fmt.Println("int type")

default:

fmt.Println("other type", v)

}

Struct

Struct(結構體)是類型中帶有屬性成員的複合類型.

其實就非常類似其他語言的Class (87%相似)

用結構體名稱和結構體屬性來描述真實世界的實體和實體對應的各種屬性.

- 每個屬性必須要有自己的類型和值

- 屬性名稱在結構體內必須唯一

- 屬性的類型也可以是結構體, 或是自己所在的結構體的指針, 但不能跟是自己的類型.

- 可以屬性都不要設置, 稱為empty struct, 能用來給channel發訊號用.

- 屬性成員名稱小寫開頭為private, 大寫為public

- 沒有繼承, 用的是組合這概念, 這部份更多應用明天分享.

type 類型名稱 struct {

屬性1 屬性1類型

屬性2 屬性2類型

屬性3, 屬性4, 屬性5 屬性345類型 (需要相同類型)

類型 // 匿名屬性, 類型名稱就是成員屬性名稱

...

}

初始化

有很多種方式...這裡有沒有列出全部, 我也不太清楚QQ

JS要建立一個object, 也是超多種方式XD

// 匿名結構體, 無須透過type關鍵字來定義

p := struct {

X int

Y int

} {

X : 20,

Y : 10,

}

// 透過var聲明

type Point struct {

X int

Y int

}

var p Point

p.X = 20

p.Y = 10

// 透過var的簡短聲明

var p = Point{

X: 20,

Y: 10,

}

// 透過new實例出結構體,p是一個Point指標類型, 指向Point結構體的實例.

p := new(Point)

p.X = 20

p.Y = 10

new()的方法介面 : 回傳的就是指向該類型的指標

func new(Type) *Type

// 因為沒有類別也沒多載, 所以用各種不同名稱的外部方法來模擬建構式

func NewEmptyPoint() Point {

return Point{

}

}

func NewPoint(x, y int) Point {

return Point{

X : x,

Y : y,

}

}

func NewEmptyPointPtr() *Point {

return &Point{

}

}

func NewPointPtr(x, y int) *Point {

return &Point{

X : x,

Y : y,

}

}

// demo/pointer.go

package pointer

type Point struct {

X int

Y int

}

func New(x, y int) Point {

return &Point{

X : x,

Y : y,

}

}

// main.go

package main

import "demo/pointer"

func main() {

// 這樣有沒有比較像建構式的feel了

p := pointer.New(10, 20)

}

這裡會發現跟C有些不同了, C對於ptr類型需要用->來存取成員屬性.

Go施予了語法糖來方便開發者, 自動的把ptr類型的p.X轉成(*p).X

Pointer to Struct vs Struct value

上面會發現struct在使用上會有pointer to struct(結構體指針)跟Struct value(結構體實例)2種類型.

- 結構體指針

- 一個指向結構體實例的ptr

- 傳遞給函數當參數時, 就只會複製該ptr而已, 省很多記憶體, 也快速.

- 對結構體指針作任何修改, 都會影響到該指針所指向的結構體去作修改.

- 要直接操作指向的對象時,要加上*

- 會發生逃逸現象, 需要透過GC來回收.

- 結構體指針的空值都是nil

- 結構體實例

- 傳遞給函數當參數時, 會複製物件本身.

- 傳遞給函數時, 會放在stack內; 在離開函數時, 會被釋放.

package main

import "fmt"

type Bag struct {

items []int

}

func Insert(b *Bag, itemId int) {

fmt.Printf("address of *b: %p\n", b)

b.items = append(b.items, itemId)

}

func InsertValue(b Bag, itemId int) Bag {

fmt.Printf("address of b: %p\n", &b)

b.items = append(b.items, itemId)

return b

}

func main() {

bag := new(Bag)

fmt.Printf("address of bag: %p\n", bag)

fmt.Println("新增元素前給ptr: ", bag)

Insert(bag, 1000)

fmt.Println("新增元素後給ptr: ", bag)

bagValue := Bag{}

fmt.Printf("address of bagValue: %p\n", bag)

fmt.Println("新增元素前給實例前: ", bagValue)

InsertValue(bagValue, 1001)

fmt.Println("新增元素後, 但沒賦值回去: ", bagValue)

bagValue = InsertValue(bagValue, 1001)

fmt.Println("新增元素後, 有沒賦值回去: ", bagValue)

}

/*

address of bag: 0xc00000c080

新增元素前給ptr: &{[]}

address of *b: 0xc00000c080

新增元素後給ptr: &{[1000]}

address of bagValue: 0xc00000c080

新增元素前給實例前: {[]}

address of b: 0xc00000c100

新增元素後, 但沒賦值回去: {[]}

address of b: 0xc00000c140

新增元素後, 有沒賦值回去: {[1001]}

*/

看完輸出能發現, 透過指針傳遞的都是指向同一個位置的變數, 我們對它作操作, 在方法結束後, 他的改變都是有效的.

透過值傳遞, 都不是同一個變數, 都是透過複製出來的副本, 所以要透過回傳, 再把回傳值複製一份給外面, 不然就不會真的作到修改.

結構體方法

Go中的方法, 適用於特定類型的函數. 稱為Receiver(接收器)

如果該特定類型是結構體實例或者是結構體指針時.

接收器的概念就類似JS的this. 就是方法作用的目標!!

當然任何類型都可以有自己的方法.

// (b *Bag) 這個就是接收器, 接受來自Point類型的指標

func (b *Bag) Insert(itemId int) {...}

// (b Bag) 這個就是接收器, 接受來自Point實例

func (b Bag) Insert(itemId int) {...}

接收器的命名

官方建議receiver的名字, 第一個字小寫, 而不是用self/this等命名.

接收器的類型

選擇在結構體方法的接收器是要用值還是指標...

蠻難抉擇的, 大部分都是用指標.

只有小部份情形會用值傳遞.

- map, func, chan 其實引用類型(reference type), 都是指針了,別再用一個指針指向他們, 然後作操作.

- 如果結構體內有sync.Mutex或其他跟同步相關字眼的, 也別傳值, 傳指針, 讓各地方都用同一個記憶體空間作同步操作.

- 如果想要呼叫的函數, 就直接能作內容修改, 就傳指針

- 如果是自定義的結構體、Array、Slice就傳指針, 不用多複製; 且意圖更明顯, 就是在操作該物件自己; 官方建議如果Array容量很小還是傳值比較好, 但我自己不太清楚怎樣去定義"小", 所以我還是都傳指針.

- 如果是基礎型別或者是內建的型別(time.Time這種), 它內部沒有指針屬性或者沒有mutable屬性時, 就傳值, 就不會發生逃逸進到Heap等待GC.

- 不清楚? 就是傳指針

但又如何XD

反正Go其實就只有傳值這概念, 只是傳的如果是指針類型, 還是複製一份指針的副本.

上面有提到會把ptr類型轉成(*ptr), 直接指向該物件去操作.

所以官方才說不清楚判斷該傳什麼, 就傳指針.

我們要清楚的是, 該類型到底是基礎型別還是引用類型(), 這2種都傳值

裡面有沒有同步需要用到的mutex這些, 有就是傳值,

其他都傳ptr 就行了.

引用類型的範例

package main

import "fmt"

func PrintMap(m map[string]int) {

fmt.Printf("address of map: %p\n", m)

}

func PrintFunc(f func()) {

fmt.Printf("address of func: %p\n", f)

}

func PrintChan(c chan int) {

fmt.Printf("address of chan: %p\n", c)

}

func PrintSlice(s []int) {

fmt.Printf("address of slice: %p\n", s)

}

func PrintArray(a [3]int) {

fmt.Printf("address of array: %p\n", &a)

}

func PrintArrayPtr(a *[3]int) {

fmt.Printf("address of array: %p\n", a)

}

func main() {

m := make(map[string]int)

fmt.Printf("address of map: %p\n", m)

PrintMap(m)

fun := func() {

fmt.Println("func")

}

fmt.Printf("address of func: %p\n", fun)

PrintFunc(fun)

channel := make(chan int)

fmt.Printf("address of chan: %p\n", channel)

PrintChan(channel)

s := make([]int, 10)

fmt.Printf("address of slice: %p\n", s)

PrintSlice(s)

// Array不是引用類型

a := [3]int{1, 2, 3}

fmt.Printf("value of array: %p\n", a)

fmt.Printf("address of array: %p\n", &a)

PrintArray(a)

PrintArrayPtr(&a)

}

/*

address of map: 0xc000078150

address of map: 0xc000078150

address of func: 0x489520

address of func: 0x489520

address of chan: 0xc000076060

address of chan: 0xc000076060

address of slice: 0xc0000200f0

address of slice: 0xc0000200f0

value of array: %!p([3]int=[1 2 3])

address of array: 0xc000018560

address of array: 0xc0000185a0

address of array: 0xc000018560

*/

很明顯這些都是引用類型, 我們操作的一直都是指針類型的變數,

就不必再用一個指針去指向它們了.

後面的0xnnnnnn數字不同, 每次跑我也都不同, 那是記憶體開始位置, 每次都會不同的, so...跑出來跟我範例不同, 不是程式寫錯QQ

[Go 語言教學影片] 在 struct 內的 pointers 跟 values 差異

這是AppleBoy大大的影片, 有提到goroutine內傳指標會出現的問題.

動動腦, 以下會輸出什麼?

package main

import "fmt"

func named() (n, _ int) {

return 1, 2

}

func main() {

fmt.Print(named())

}

- 1 0

- 1 2

- 不能編譯

- 0 0

Interface & OOP 就說你是鴨子! 你就是要呱呱叫

- 系列:下班加減學點Golang與Docker系列 第 9 篇

- Day:9

- 發佈時間:2019-09-16 00:06:18

- 原文:https://ithelp.ithome.com.tw/articles/10215623

Interface

一個interface(接口) 就是包含了一系列行為的method集合.

好處:

- 能建立低耦合的系統

- 透過這些被定義在接口的抽象行為, 讓要在多個單獨組件間彼此組合/通信會變得更為容易.

- 隱藏每個Class對其實現的細節

- Reusability, 因為可重複利用, 能把一些複雜問題給簡化.

Go Interface

Go沒有真正的繼承, 所以沒有OOP那種該類別實際告訴大家我實現了某個接口這種聲明;

所以對於實現Interface是透過隱性的向上轉型的方式(Duck typing), 在程式代碼的上下文判定struct是否實現了接口聲明的方法.

所以只要該類型實現了該接口所有方法就是實現了該接口.

example :

package main

import (

"fmt"

)

type Engine interface {

Start()

Stop()

}

// CarEngine並沒繼承Engine也沒宣告自己實現了Engine

type CarEngine struct {

}

// CarEngine有自己的公開方法Start()

func (c CarEngine) Start() {

fmt.Println("Car engine is started")

}

func (c CarEngine) Stop() {

fmt.Println("Car engine is stoped")

}

type TrainEngine struct {

}

func (t TrainEngine) Start() {

fmt.Println("Train engine is started")

}

func (t TrainEngine) Stop() {

fmt.Println("Train engine is stoped")

}

// Starting和Stoping 的參數要求代入的是Engine這類型

func Starting(e Engine) {

e.Start()

}

func Stoping(e Engine) {

e.Stop()

}

func main() {

carEngine := CarEngine{}

trainEngine := TrainEngine{}

// 這裡會檢查CarEngine和TrainEngine是否有實現Engine的全部方法

engines := []Engine{

carEngine, trainEngine,

}

for _, engine := range engines {

Starting(engine)

Stoping(engine)

}

}

// 如果把TrainEngine的Stop刪除

// 在48行就會在編譯時期被檢查出錯誤

因為Duck typing幾乎都出現在動態語言上, 程式寫起來飛快,但錯誤往往都是在執行時才能被發現. 靜態語言就是能在編譯時期發現這類的錯誤.

Go採取了折衷的方法, 在安全和靈活之間取得平衡:

- 靜態類型

- 隱性實現

- 只有某個類型的變數實現了某個接口的全部方法, 這個變數才能在要求使用該接口的地方.

一個類型可以實現多個接口

// io.Writer

type Writer interface {

Write(p []byte) (n int, err error)

}

// io.Closer

type Closer interface {

Close() error

}

type Socket struct {

}

func (s *Socket) Write(p []byte) (n int, err error) {

fmt.Println("Write has be involked")

return 0, nil

}

func (s *Socket) Close() error {

fmt.Println("Close has be involked")

return nil

}

func usingWriter(writer io.Writer) {

writer.Write(nil)

}

func usingCloser(closer io.Closer) {

closer.Close()

}

func main() {

s := new(Socket)

usingWriter(s)

usingCloser(s)

}

// Output :

// Write has be involked

// Close has be involked

多個類型可以實現同樣的接口(polymorphism)

type Service interface {

Start()

Log(string)

}

type Logger struct{}

func (g *Logger) Log(l string) {

fmt.Println(l)

}

type GameService struct {

Logger

}

func (g *GameService) Start() {

fmt.Println("game service start")

}

func main() {

var s Service = new(GameService)

s.Start()

s.Log("hello")

}

// Output :

// game service start

// hello

接口的嵌套組合

type device struct {

}

// 實現

func (d *device) Write(p []byte) (n int, err error) {

return 0, nil

}

// 實現

func (d *device) Close() error {

return nil

}

/*

// WriteCloser is the interface that groups the basic Write and Close methods.

type WriteCloser interface {

Writer

Closer

}

// Implementations must not retain p.

type Writer interface {

Write(p []byte) (n int, err error)

}

*/

func main() {

// 宣告io.WriteClose, 並賦予device的實例

var wc io.WriteCloser = new(device)

wc.Write(nil)

wc.Close()

// 宣告io.Writer, 並賦予device的實例

var writeOnly io.Writer = new(device)

writeOnly.Write(nil)

}

空接口 interface

interface{}是接口類型的特殊形式; 空接口沒有任何方法, 所以任何類型都沒必要去實現空接口; 反過來說, 任何值都滿足空接口的實現需求, 所以它可以保存任何值, 也能從空接口中取出值.

空接口類型類似C#, Java中的Object, C的void*.

空接口內部只保存了對象的類型和指針, 所以在使用上會比較慢一些.

// eface = empty interface

type eface struct {

_type *_type

data unsafe.Pointer

}

var any interface{}

any = 1

fmt.Println(any)

any = false

fmt.Println(any)

// Output :

// 1

// false

var a int =1

var i interface{} = a

var b int = i

// 第三行會報錯

// cannot use i (type interface{}) as type int in assigment : need type assertion

// 因為i 在此時還是interface{}類型, 並不是int類型

// 要使用類型斷言

var b int = i.(int)

接口斷言 Type Assertions

Type Assertion是對於interface value的一種操作方法.

語法格式

t, ok := i.(T)

i 代表實現接口的變數

T 表示轉換的目標類型

t 表示轉換後的變量

ok 檢查i接口是否實現T類型的效果

鳥和豬有不同的特性, 一個能飛能走, 一個只能走.

讓鳥跟豬各自實現Flyer和Walker的接口.

然後實例被放進interface{}的map中, interface{}表示空接口, 所以什麼類型都能放.

透過斷言操作來操作各接口.

type Flyer interface {

Fly()

}

type Walker interface {

Walk()

}

type bird struct {

}

func (b *bird) Fly() {

fmt.Println("bird can fly")

}

func (b *bird) Walk() {

fmt.Println("bird can walk")

}

type pig struct {

}

func (p *pig) Walk() {

fmt.Println("pig can walk")

}

func main() {

animals := map[string]interface{}{

"bird": new(bird),

"pig": new(pig),

}

for name, obj := range animals {

f, isFlyer := obj.(Flyer)

w, isWalker := obj.(Walker)

fmt.Printf("name: %s isFlyer: %v isWalker: %v\n", name, isFlyer, isWalker)

if isFlyer {

f.Fly()

}

if isWalker {

w.Walk()

}

}

}

// Output :

// name: bird; isFlyer: true, isWalker: true

// bird can fly

// bird can walk

// name: pig; isFlyer: false, isWalker: true

// pig can walk

上面寫法會很多if

能用type switch簡化

switch obj := obj.(type) {

case Flyer:

fmt.Printf("name: %s\n", name)

obj.Fly()

case Walker:

fmt.Printf("name: %s\n", name)

obj.Walk()

}

Go OOP

封裝

透過package級別做封裝

私有成員跟方法在Go是以小寫開頭的, 只有在該package內可見.

公開成員跟方法是以大寫開頭.

type Bag struct {

// private property for Bag

item []int

}

// public method for Bag

func (b *Bag) Insert(itemid int) {

b.items = append(b.items, itemid)

}

func main() {

b := new(Bag)

b.Insert(1002)

}

Go沒有建構式, 透過簡單工廠方法來實現

type Bag struct {

// private property for Bag

item []int

}

// simple factory method

func NewBag() Bag {

return &Bag{}

}

繼承

Go其實沒有繼承, 都是依靠組合(composition), 允許嵌入組合.

也因為沒有繼承, 就不會出現可多重繼承裡會出現的死亡鑽石問題.

只要嵌入一個匿名類型的組合就等同於實現了繼承,

如果只是嵌入struct那跟脆弱基類是一樣的脆弱, 所以會透過嵌入接口, 來提早檢查問題.

多態

Go 依賴接口來實現這特性.

只要對象實現相同的接口, Go就能處理不同類型的那些對象.

package main

import "fmt"

type Shape interface {

Area() int64

}

type Rectangle struct {

width, height int64

}

func NewRectangle(width, height int64) *Rectangle {

return &Rectangle{

width: width,

height: height,

}

}

func (r *Rectangle) Area() int64 {

return r.width * r.height

}

type Circle struct {

radius int64

}

func NewCircle(radius int64) *Circle {

return &Circle{

radius: radius,

}

}

func (c *Circle) Area() int64 {

return c.radius * c.radius

}

func main() {

r := NewRectangle(10, 5)

c := NewCircle(5)

s := []Shape{r, c}

for _, shape := range s {

fmt.Println(shape.Area())

}

}

Package 使用多個套件之前必須要懂的包

- 系列:下班加減學點Golang與Docker系列 第 10 篇

- Day:10

- 發佈時間:2019-09-17 00:18:32

- 原文:https://ithelp.ithome.com.tw/articles/10216224

這次聊Package, 主要是因為接著都會需要對業務面向作模組的拆分.

或者對功能作拆分, 甚至是第三方套件的引入.

一個專案只要不是只有一個main.go, 就一定會有其他的package.

Package(包)

程式碼的目錄, 可以重複利用程式的方案, 方便維護。

Go默認提供很多package, 像是fmt、is等。

開發者也可以創建自己的package。

package要求所有檔案的第一行添加package名稱,標示該文件所歸屬的package。

package 包名稱

- 一個目錄下的同級檔案屬於同一個package

- package名稱可以與目錄不同名稱, 但盡可能一樣

- main package為應用程式執行的entry point; 若沒有main package則無法編譯成可執行的檔案在bin下

- package name, Go團隊建議簡單扁平為原則。 所以盡量避免下划線、中划線和參雜大寫字母。

Creating a package

- 可執行包(executable package)

可自己執行,表示有main package - 工具包(utility package)

不可自己執行,但是可以給可執行包做擴展應用的作用

// main.go

package main

import (

"fmt"

. "hello/math"

)

func main() {

fmt.Println("hello")

fmt.Println(Average([]float64{1, 2}))

}

// math/math.go

package math

func Average(xs []float64) float64 {

total := float64(0)

for _, x := range xs {

total += x

}

return total / float64(len(xs))

}

# 編譯hello package

cd $GOPATH/src/hello;

go install;

# 因為有main package, 所以會安裝到$GOPATH/bin 作為可執行包

# 編譯hello package

cd $GOPATH/src/hello/math;

go install;

# 因為沒有main package, 所以會安裝到$GOPATH/pkg下 作為工具包

Import package

使用import package,Go會先在 $GOROOT/src下尋找指定的package。

若找不到就往$GOPATH/src目錄下尋找。

找不到就會報出編譯錯誤。

package main

import (

// fmt位於$GOROOT/src下,找到!

"fmt"

// gin並不在$GOROOT/src, 接著找$GOPATH/src找github.com這目錄,找到往內找gin-gonic目錄,再找gin package

"github.com/gin-gonic/gin"

//

. "github.com/go-sql-driver/mysql"

)

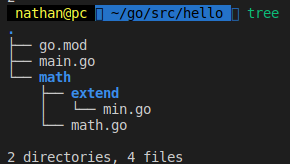

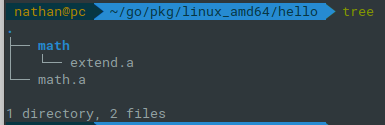

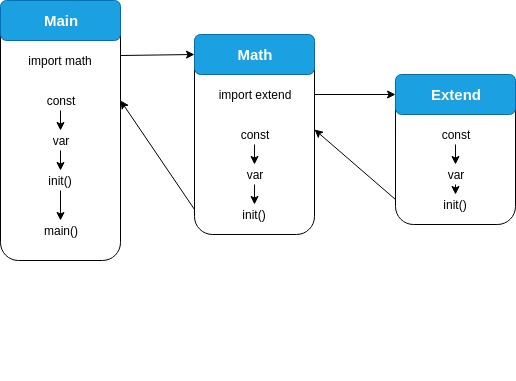

Nested package

在一個package內嵌套令一個package; 使用上只要指名路徑關係.

// math/math/extend/min.go

package extend

func init() {

fmt.Println("extend ==> init()")

}

func Min(a float64, b float64) float64 {

if a >= b {

return a

}

return b

}

// math/math.go

package math

import (

"fmt"

"hello/math/extend"

)

func init() {

fmt.Println("math ==> init()")

}

func Average(xs []float64) float64 {

total := float64(0)

for _, x := range xs {

total += x

}

return total / float64(len(xs))

}

func Min(a float64, b float64) float64 {

return extend.Min(a, b)

}

// main.go

package main

import (

"fmt"

. "hello/math"

)

func init() {

fmt.Println("main ==> init()")

}

func main() {

fmt.Println("hello")

fmt.Println(Average([]float64{1, 2}))

fmt.Println(Min(1, 2))

}

Package Initialization

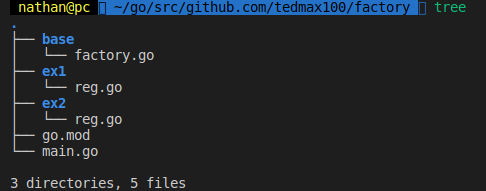

工廠模式自動註冊-管理多個packge

// base/factory.go

package base

// define interface for Class

type Class interface {

Do()

}

var (

// 存放註冊好的 類別工廠資訊

factoryByName = make(map[string]func() Class)

)

// 註冊一個類別工廠

func Register(name string, factory func() Class) {

factoryByName[name] = factory

}

// 根據name創建對應的類別

func Create(name string) Class {

if f, ok := factoryByName[name]; ok {

return f()

}

panic("name not found")

}

// ex1/reg.go

package ex1

import (

"fmt"

"github.com/tedmax100/factory/base"

)

type Class1 struct {

}

func (c *Class1) Do() {

fmt.Println("class1")

}

func init() {

base.Register("Class1", func() base.Class {

return new(Class1)

})

}

// ex2/reg.go

package ex1

import (

"fmt"

"github.com/tedmax100/factory/base"

)

type Class2 struct {

}

func (c *Class2) Do() {

fmt.Println("class2")

}

func init() {

base.Register("Class2", func() base.Class {

return new(Class2)

})

}

// main.go

package main

import (

"github.com/tedmax100/factory/base"

_ "github.com/tedmax100/factory/ex1"

_ "github.com/tedmax100/factory/ex2"

)

//因為上面使用匿名導入了ex1 & ex2 package.

//main()執行前, 這兩個package的init()會被調用, 而註冊了class1 & class2

func main() {

c1 := base.Create("Class1")

c1.Do()

---

[淺談Go專案布局與internal package](https://ithelp.ithome.com.tw/articles/10337030)

govendor 好多依賴要管理

- 系列:下班加減學點Golang與Docker系列 第 11 篇

- Day:11

- 發佈時間:2019-09-18 00:01:28

- 原文:https://ithelp.ithome.com.tw/articles/10216807

回憶一下之前Day01提到的

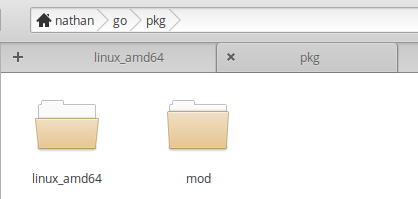

Go WorkSpace 工作目錄

我們安裝好Go之後進去預設的GOPATH目錄下, 就會看到這樣的目錄結構.

- GOPATH

|

-- bin/

|

-- pkg/

|

-- src/

|

-- project1/

|

-- vendor/

|

-- project2/

|

-- vendor/

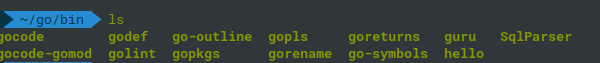

- bin 包含可安裝並執行的command (可執行的二進制文件)

- pkg 包含各種package objects (二進制的library檔, *.a檔)

- src 包含各專案的代碼

GOPATH

GOPATH是一個環境變數, 用絕對路徑來指定工作目錄的位置.

要是我們多人參與開發, 每個人都有一套自己的目錄結構, 讀取配置文件的位置也不統一, 這樣輸出的二進制文件也不會統一, 會導致開發的標準不一.

GOPATH存在的目的是

- 所有在Go代碼裡, 透過import 宣告的package path, 用來計算該包的路徑用.

- 儲存任何透過go get獲取的依賴包.

- go build、go install產生的二進制文件會放在$GOPATH/bin底下

go get

官方提供的工具, 會把go get取得的第三方套件代碼存放到$GOPATH/src中.

有許多社群做了幾個package management工具 Glide、dep、 govendor, 包含後面出的gomodule等, 都是為了方便專案去管理使用了哪些依賴包跟對應的版本, 以及下載位置.

小弟接觸比較晚, 就挑了govendor和gomodule來學習.

這兩個可以共存XD

vendor

在Go Module還沒出來時, 在1.5版提供了vendor. 但要手動環境變數GO15VENDOREXPERIMENT=1

1.6版則是默認是1

1.7版則是不必再設定該環境變數, 默認開啟vendor

vendor特性

在我們執行go build 或者是go run時, go會依照下列順序依序去找我們的要的依賴包

- 當下專案目錄的vendor資料夾

- 一路往上層目錄查找, 直到找到$GOPATH/src下的vendor

- 在GOROOT目錄下查找

- 在GOPATH下查找

vendor使用建議

- 一個專案只會有一個vendor目錄, 且就位於專案的根目錄內.

govendor

govendor就是一個基於vendor這種目錄機制所做出來的套件管理工具.

go在以前常用的套件包管理工具其中之一就是govendor.

能在go build時的應用路徑搜尋調整成為當前專案項目目錄/vendor目錄的方式.

安裝govendor

go get -u -v github.com/kardianos/govendor

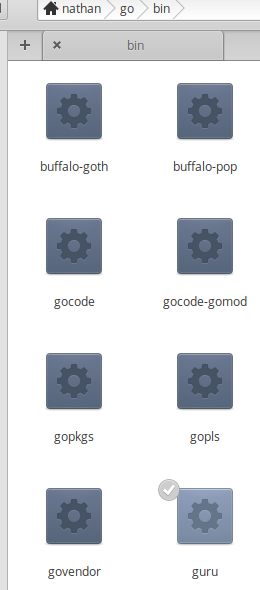

安裝好到$GOPATH/bin下, 會看到govendor的可執行檔.

使用govendor

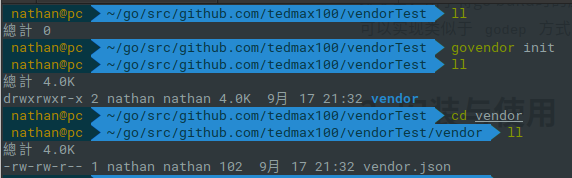

初始化vendor

// 移動該專案的根目錄

govendor init

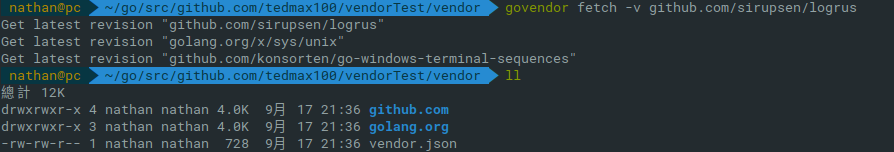

下載依賴包

下載master主幹下最新的commit

govendor fetch 路徑

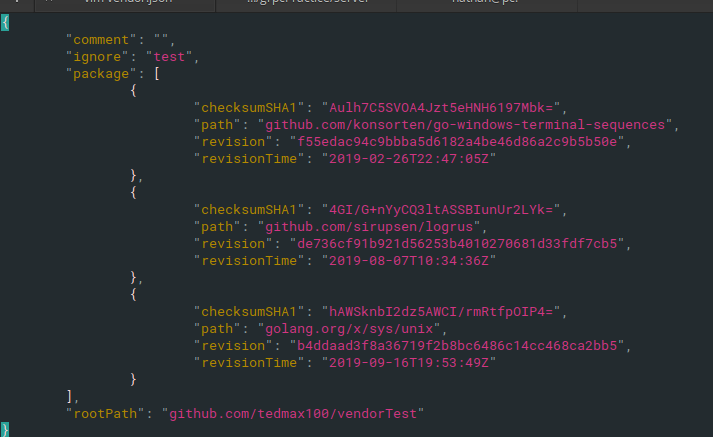

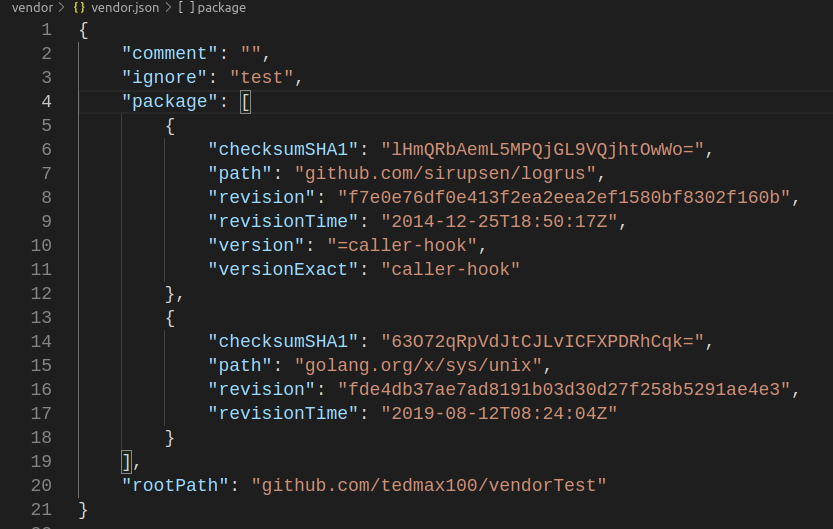

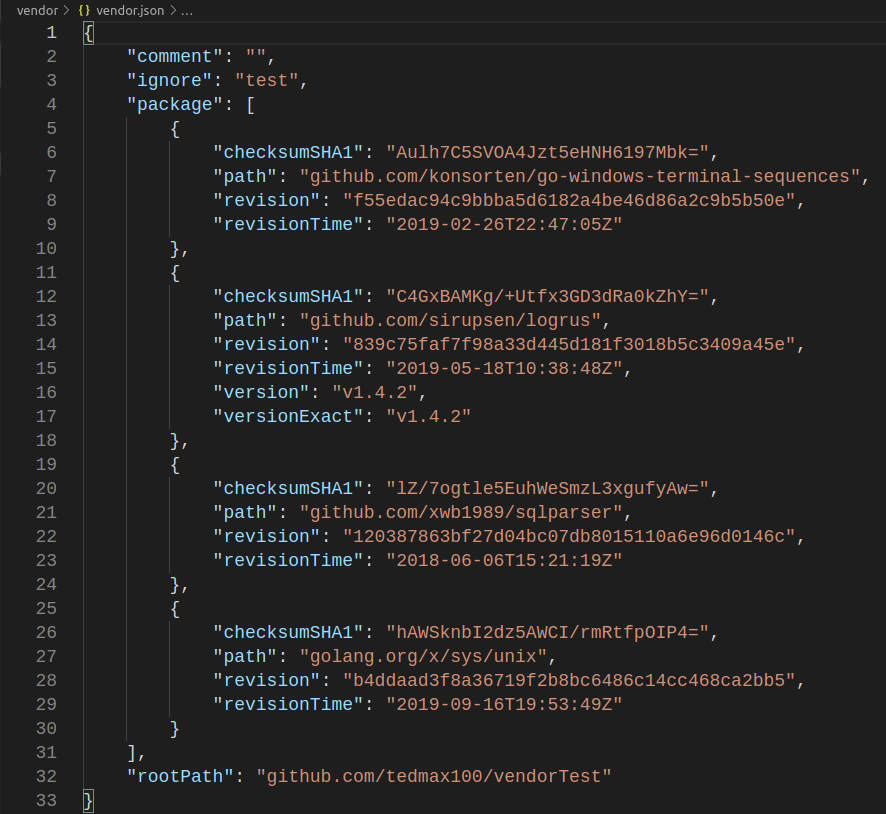

vendor.json

用來紀錄依賴包的commit的hash跟時間等等

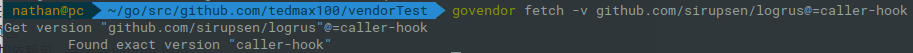

下載特定的版本

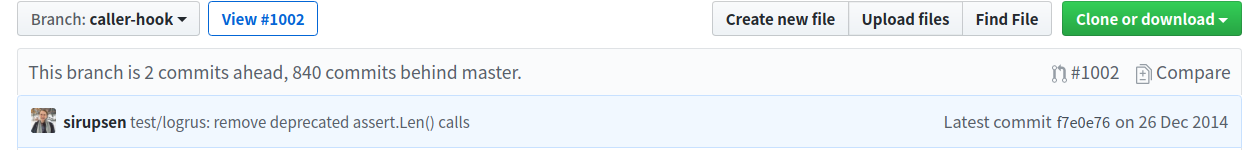

govendor fetch 路徑@v版本

vendor.json

用來紀錄依賴包的列表版本, commit的hash跟時間等等

下載特定的tag 或是branch

govendor fetch 路徑@=tag_name

govendor fetch 路徑@=branch_name

加入GOPATH現有的包到vendor管理下

從GOPATH下複製指定的包

govendor add path

這依賴包位於我的$GOPATH/src/githut.com/xwb1989/sqlparser目錄下

添加所有的依賴包

govendor add +external

使用自己小改過的包來取代官方第三方依賴包

可能內部對github.com/go-sql-driver/mysql有加入點東西, 就能用這種方式改用自己的,但是程式import 還是照常github.com/go-sql-driver/mysql

govendor get 'github.com/go-sql-driver/mysql::github.com/tedmax100/go-mysql'

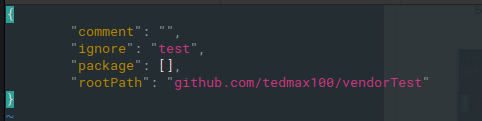

刪除沒用的依賴包

govendor remove +unused

輸入完之後, 會發現全空, 因為我這時該專案目錄下還沒有任何程式作import.

package main

import (

log "github.com/sirupsen/logrus"

)

func main() {

log.WithFields(log.Fields{

"animal": "walrus",

}).Info("A walrus appears")

}

透過govendor再次安裝依賴包

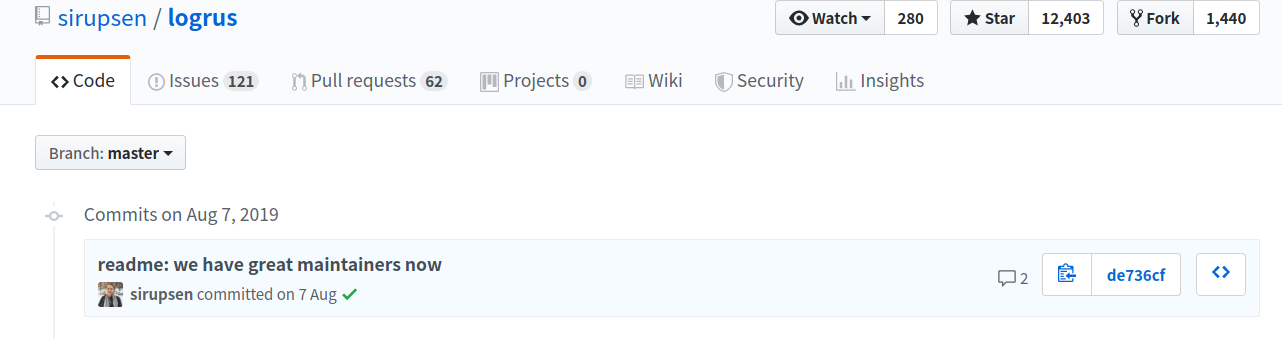

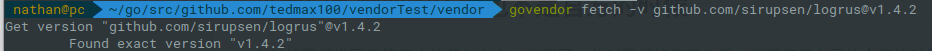

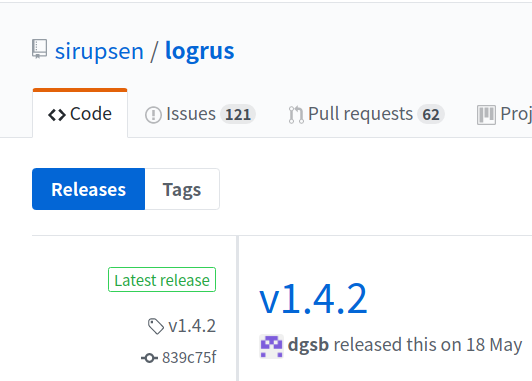

govendor fetch github.com/sirupsen/logrus@v1.4.2

govendor add github.com/xwb1989/sqlparser/

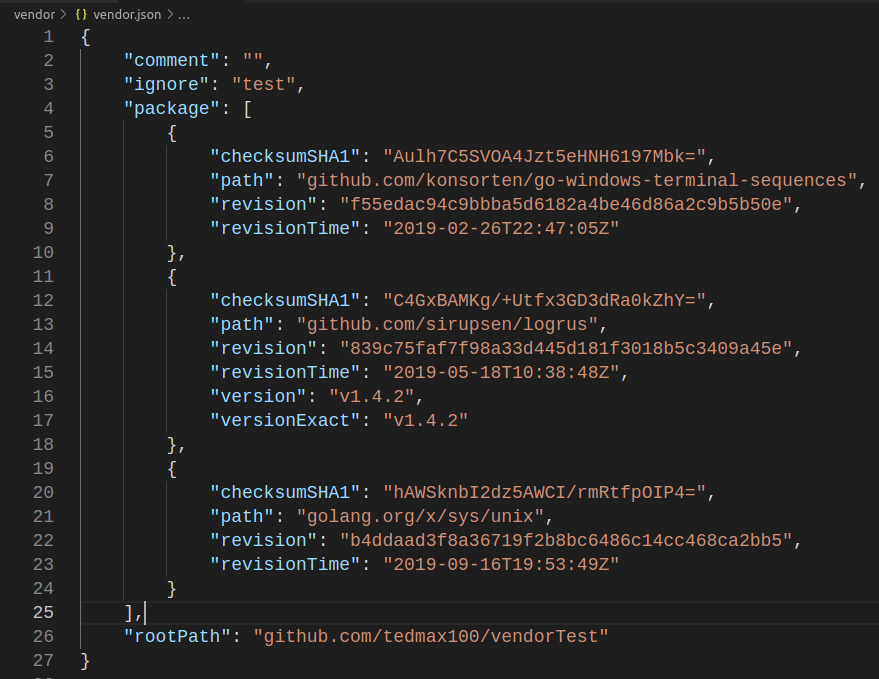

govendor remove +unused

只會留下有用到的.

再次清空govendor所有依賴

執行add

govendor add +external

也會得到跟上圖一樣的結果.

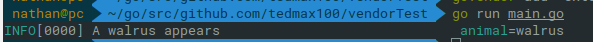

go run main.go

成功執行!

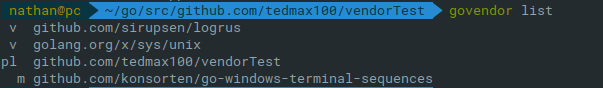

列出該專案所有存在的依賴包

govendor list

從vendor.json恢復所有依賴包原始碼到vendor目錄下

govendor sync

與npm、yarn相同的使用命令

| command | npm | yarn | govendor |

|---|---|---|---|

| 初始化 | npm init | yarn init | govendor init |

| 增加依賴包 | npm install -s | yarn add | govendor fetch |

| 刪除依賴包 | npm uninstall | yarn remove | govendor remove |

| 同步依賴包 | npm install | yarn install | govendor sync |

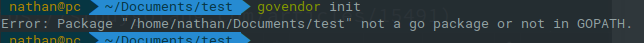

govendor看似完美了, 但幹麻還出gomodule?

因為govendor要求一定要在$GOPATH/src下執行.

不然會報錯誤

下一篇的go module就是能解決這問題

go modules 終於不會再被GOPATH綁死了

- 系列:下班加減學點Golang與Docker系列 第 12 篇

- Day:12

- 發佈時間:2019-09-19 00:42:59

- 原文:https://ithelp.ithome.com.tw/articles/10217414

Go Modules

Go modules 出現原因

- 解除對GOPATH的完全依賴, 有go modules就能在$GOPATH外開專案了.

- 不同環境或者是多專案, 需要一套切換vendor目錄.

- 同一個依賴包的多種版本共存問題, 加入了版本化的支援.

- 可以使用GOProxy來解決某些地區無法使用go get的問題.

- 以往需要將vendor目錄一起提交到git, 避免CI/CD去拉到外部的依賴包.

- go modules有build cache, 在CI build server上速度飛快.

環境準備

- Go version >= 1.11

- GO111MODULE=on (Go MOdule模式), 使用go module, 不諮詢GOPATH, 只是下載下來的依賴包依然存在GOPATH/pkg/mod/底下.

GO111MODULE=off, 這表示是GOPATH模式, 查找依賴包順序如同昨天提的vendor目錄和GOPATH下.

GO111MODULE=auto, 默認模式,在這模式下要使用go module, 需要滿足兩個條件

- 該專案目錄不在GOPATH/src/下

- 當前或上一層目錄存在go.mod檔案

Go Mododules 對於匯入依賴包的影響

- 可以在$GOPATH之外的地方建立專案

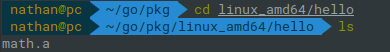

- 該專案Go Module開啟後, 下載的package會放在$GOPATH/pkg/mod下.

- $GOPATH/bin的功能依然保持

Go Mod Commands

有兩種方式能定義一個正確的Go module

// 在$GOPATH/src的目錄下, 建立合理的module路徑

// 進入該module目錄, 執行下面命令

go mod init [module name]

///

```bash

// 在任意地方, 建立好module路徑

// 在該目錄下, 執行

go mod init [folder/]module name

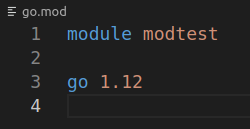

就會在該專案下生出了go.mod文件了.

go.mod的一些名詞

- module

- 定義模組路徑

- go

- 定義預期的go version

- require

- 指定依賴的功能包和其版本或是更高版本[預設是最新版]

- exclude

- 排除該功能包和其版本

- replace

- 使用不同的依賴包版本替換原有的依賴包版本

- 註解

- // 單行註解

- /* 多行註解 */

- indirect 被間接導入的依賴包

module my/package

go 1.12

require other/thing v1.0.2 // 註解

require new/thing/v2 v2.3.4 // indirect

exclude old/thing v1.2.3

replace bad/thing v1.4.5 => good/thing v1.4.5

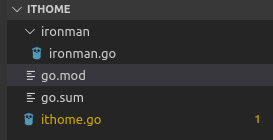

同專案的子目錄

因為go.mod在專案的根目錄下, 子目錄的導入路徑會是該專案的導入路徑+子目錄路徑.

舉例: 建立了ithome的專案, 底下有一個ironman的子目錄.

則不需要也在子目錄建立go mod init指令, Go build會自動辨識ironman這目錄是ithome的一部分.

Go Mod Require

- 安裝一下logrus

go get github.com/sirupsen/logrus

go.mod的內容

module modtest

go 1.12

require github.com/sirupsen/logrus v1.4.2 // indirect

此時把v1.4.2 改成v1.4.1

執行

go mod download

go.mod的內容

module modtest

go 1.12

require github.com/sirupsen/logrus v1.4.1 // indirect

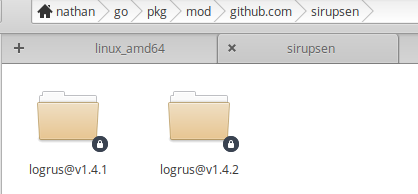

也會發生$GOPATH/pkg/mod/github.com/sirupsen目錄下,多了logrus@v1.4.1和1.4.2版本的源碼

Go Mod Exclude

go.mod的內容

module modtest

go 1.12

require github.com/sirupsen/logrus v1.4.2 // indirect

exclude github.com/gin-gonic/gin v1.4.0

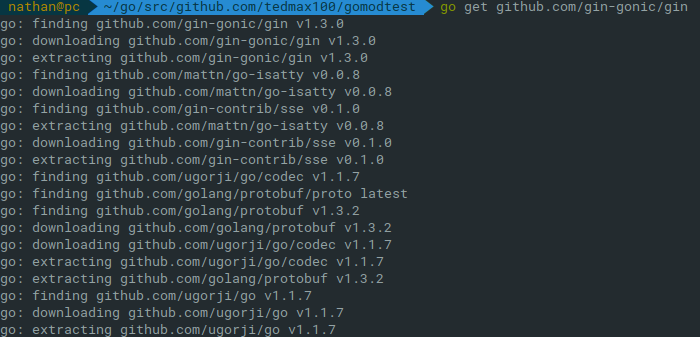

go get github.com/gin-gonic/gin

會發現應該是要下載當前最新板的v1.4.0的gin; 但因為有exclude gin 1.4.0 ;

所以改成下載v1.3.9

go.mod的內容

module modtest

go 1.12

require (

github.com/gin-contrib/sse v0.1.0 // indirect

github.com/gin-gonic/gin v1.3.0 // indirect

github.com/golang/protobuf v1.3.2 // indirect

github.com/mattn/go-isatty v0.0.8 // indirect

github.com/sirupsen/logrus v1.4.2

github.com/ugorji/go v1.1.7 // indirect

gopkg.in/go-playground/validator.v8 v8.18.2 // indirect

gopkg.in/yaml.v2 v2.2.2 // indirect

)

exclude github.com/gin-gonic/gin v1.4.0

如果exclude指定gin的依賴功能包, 該功能包會避開該版號作安裝

Go Mod Replace

如果有package被replace, 則編譯時會使用對應的項目來作取代.

- 與require類似, 可以指向令一個repo

- 又或是指向本地的一個目錄

gomodtest

// go.mod

module modtest

go 1.12

require github.com/sirupsen/logrus v1.4.2 // indirect

// modtest.go

package gomodtest

import (

log "github.com/sirupsen/logrus"

)

func Init() {

log.Info("godmodtest init")

}

func Exec() {

log.Info("godmodtest exec")

}

gomaintest

// go.mod

module github.com/tedmax100/gomaintest

go 1.12

replace github.com/tedmax100/modtest => ../gomodtest

// main.go

package main

import (

modtest "github.com/tedmax100/modtest"

)

func main() {

modtest.Exec()

}

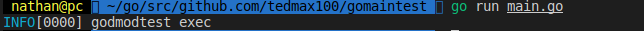

執行結果

notes

- Replace和Exclude都只對當前這module有影響, 對其他功能包不會去影響到 ;

其他功能包自己的replace也不會影響到這包.

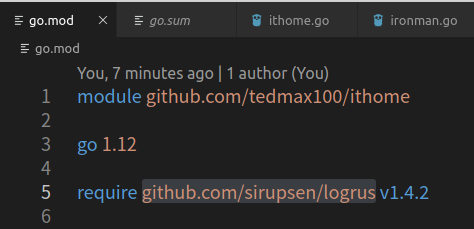

自己寫個共用依賴模組用在自己的專案試試看

依賴包專案

目錄結構 /GOPATH/src/ithome

go mod init github.com/tedmax100/ithome

因為我等等要推上github的repo中, 這裡就如以前說的會有域名/目錄/專案...

這樣的層次關係.

go get github.com/sirupsen/logrus

這裡跟govendor fetch有些不同了, 再有go modules專案內輸入go get.

預設會去抓最新的tag版本; 如果沒有設立tag, 就抓最新的commit版本.

go.sum這時候就會把logrus目錄下go.mod跟go.sum的依賴包跟其版本保存起來.

go.sum 其實跟npm的package-lock.json有著一樣的功能.

go.mod(npm的package.json)定義我們指名要的依賴跟版本.

go.sum把go.mod的所有依賴包, 每一個像是樹的根節點一樣, 開始走訪去下載, 並且紀錄關係在此.

ironman/ironman.go

package ironman

import (

log "github.com/sirupsen/logrus"

)

func PrintIronMan() {

log.Info("hi iron man")

}

ithome.go

package ithome

import (

// 這裡因為我們定義的mod name就這麼長,

// 子目錄的導入路徑會是該專案的導入路徑+子目錄路徑.

"github.com/tedmax100/ithome/ironman"

log "github.com/sirupsen/logrus"

)

func PrintItHome() {

log.Info("hi ItHome")

ironman.PrintIronMan()

}

存檔, commit, 推上github.

這裡我沒有打release tag.

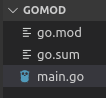

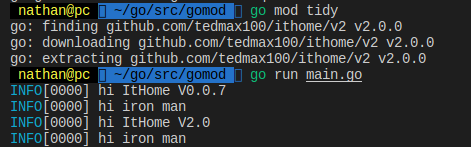

可執行的專案

目錄結構 /GOPATH/src/gomod

go mod init gomod

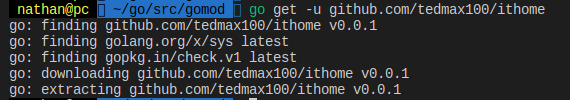

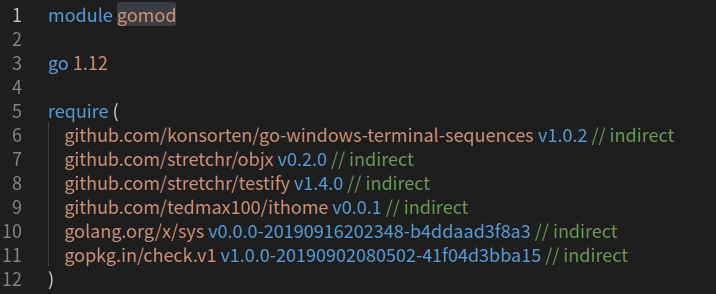

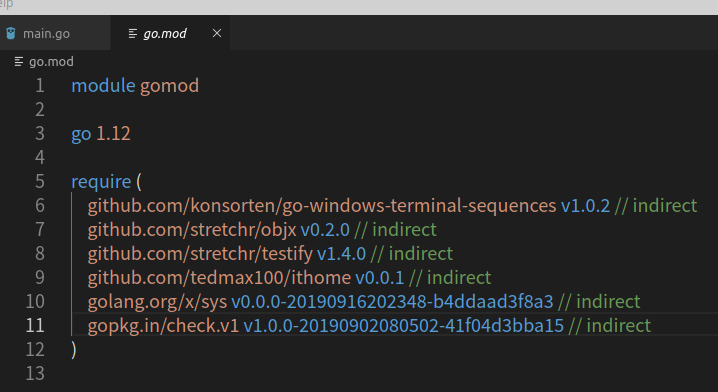

// 下載依賴包

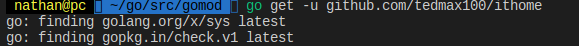

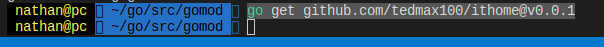

go get -u github.com/tedmax100/ithome

main.go

package main

import (

"github.com/tedmax100/ithome"

)

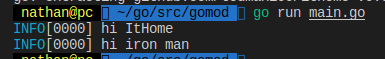

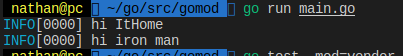

func main() {

ithome.PrintItHome()

}

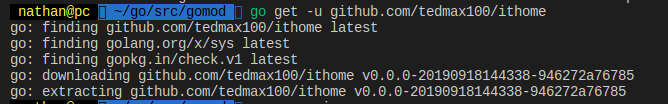

執行main.go

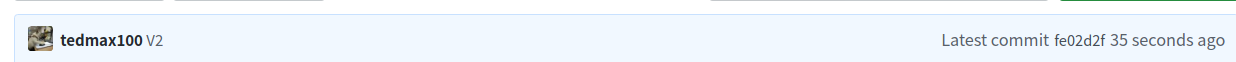

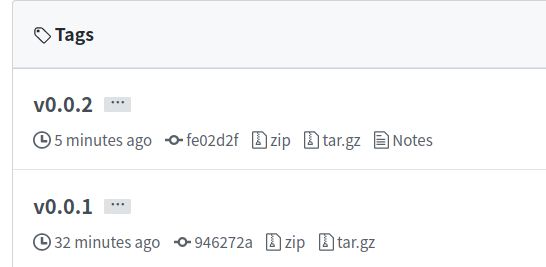

把依賴包給作個release tag, 試試看

// 作個更新

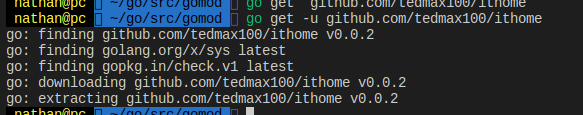

go get -u github.com/tedmax100/ithome

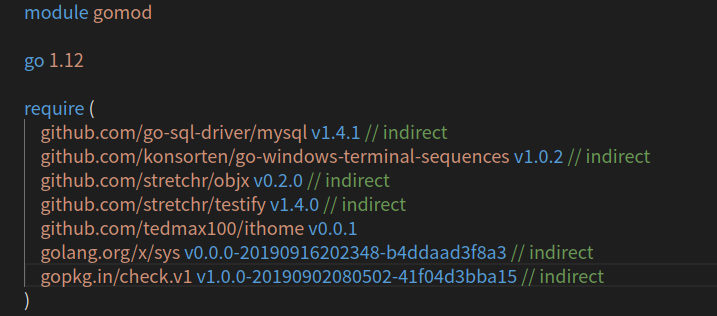

可以看到ithome這依賴包, 從本來是紀錄commit hash, 變成是紀錄tag版本號了.

把依賴包給再進個commit, 但tag 還在v0.0.1

// 作個更新

go get -u github.com/tedmax100/ithome

正如前面說的, 他會先找tag/release有沒有, 沒有才去找最新的commit.

但因為我們已經有tag v0.0.1, 所以怎樣更新依賴,

只要沒有更新版的依賴被release就不會被更新.

那! 就來進版吧

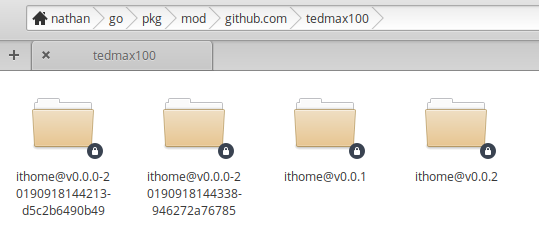

各版本有下載過得都會在go/pkg/mod/匯入包路徑底下

反悔了! 想退回去指定的某一版

go get github.com/tedmax100/ithome@v0.0.1

因為快取有了, 就不必重抓

也會順便更改go.mod和go.sum的內容

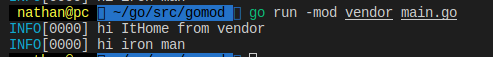

這外部的難用, 我要用自己魔改過得, 放在vendor底下的

或 我怕外部有人偷偷在代碼放後門, 我要用自己網路cache有的, 複製到vendor下

go mod vendor

這會建立出一個vendor目錄, 底下有現在go.mod依賴包的代碼.

我們改一下程式

gomod/vendor/github.com/tedmax100/ithome/ithome.go

package ithome

import (

"github.com/tedmax100/ithome/ironman"

log "github.com/sirupsen/logrus"

)

func PrintItHome() {

// 就改這行, 存檔

log.Info("hi ItHome from vendor")

ironman.PrintIronMan()

}

開心的在terminal輸入

go run main.go

笑XD

因為只要啟用了go modules, 就會完全忽略了vendor目錄的存在, 只讀取go.mod的內容.

那怎辦呢?

原本的指令go build, go install, go runm, go test啦

等等的加上-mod=vendor

多安裝一些依賴包

go get github.com/go-sql-driver/mysql

結果最後根本沒有半個地方有import

怎辦, 自己檢查每一個.go檔案, 看哪些沒有import ?

哪些依賴又沒有抓到呢?

# add missing and remove unused module

go mod tidy

依賴包的module名稱能不能帶上版本號?

要是有breaking change, 新舊版本無法兼容呢?

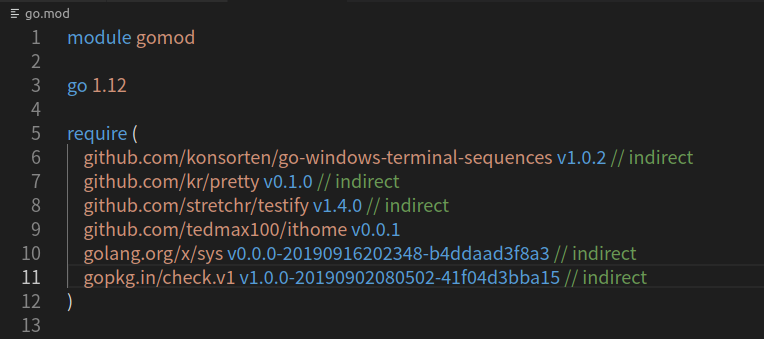

ithome/go.mod

module github.com/tedmax100/ithome@v2.0.0 // 這裡打上版本號

go 1.12

require github.com/sirupsen/logrus v1.4.2

改個程式

package ithome

import (

"github.com/tedmax100/ithome/ironman"

log "github.com/sirupsen/logrus"

)

func PrintItHome() {

log.Info("hi ItHome V0.0.7")

ironman.PrintIronMan()

}

func PrintItHomeV2() {

log.Info("hi ItHome V2.0")

ironman.PrintIronMan()

}

存檔commit, push作release

跑到執行專案, 執行

go get -u github.com/tedmax100/ithome

這時候發現, 不會去下載這2.0.0版本的依賴包

因為版本號的v2.0.0, 這個第一個數字表示主版本號, 不同版本間若是無法兼容使用,

則建議是提昇這版本號, 且建議遠端分之多上v2分支.

版本號若是v1.10.13, 這個1表示主要版本號, 10表示次要版本號, 13表示修正版本號

且go get -u會檢查go mod的版本號, 並不會主動去下載並提昇到不同的主要版本號的依賴包.

這裡import改成使用v2版

package main

import (

"github.com/tedmax100/ithome/v2"

)

func main() {

ithome.PrintItHome()

ithome.PrintItHomeV2()

}

go mod tidy

開心了, 收工

go mod 可以相當完美的跟vendor做切換並存.

有機會來玩玩看goproxy.

Defer 延遲調用

- 系列:下班加減學點Golang與Docker系列 第 13 篇

- Day:13

- 發佈時間:2019-09-20 00:04:36

- 原文:https://ithelp.ithome.com.tw/articles/10217900

看個例子, 這是一個讀取資料庫取資料的方法

func (db *DB) ReadData(age int, results []Result) {

// 查詢資料庫

// 錯誤, 釋放連線

// 取值反射錯誤, 釋放連線

// 成功, 釋放連線

}

因為GO沒有try{} finally{} 這語句.

所以很多情況如果要在離開函數之前, 作一些必要的動作時

就要在各種case下, 加上處理.

early return的寫法, 也要每個return前都寫一樣的處理, 破壞簡潔.

wtf 很容易寫成這樣 ... 只要邏輯的層數多點的話

But!!!

Go有Defer這延遲載入的語句!!!

剛剛的例子就能夠改成

func (db *DB) ReadData(age int, results []Result) {

// 查詢資料庫

defer 釋放連線

// 錯誤

// 取值反射錯誤

// 成功

}

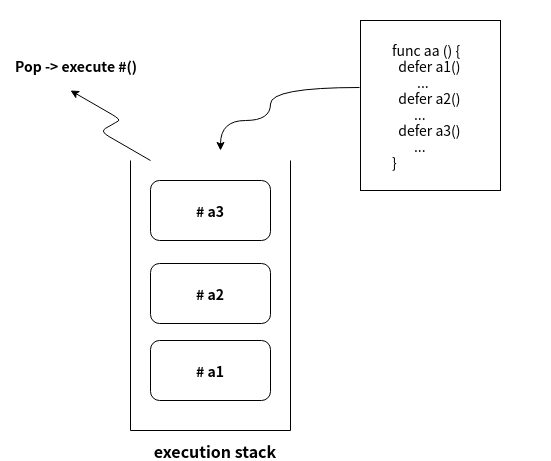

來看看defer實際的存放跟執行順序先

defer 會被後面的執行語句, 依照後進先出LIFO的方式作執行,

至於defer被觸發的時間點, 就在當前函數返回之前就會被調用.

defer的結構

type _defer struct {

siz int32

started bool

sp uintptr

pc uintptr

fn *funcval

_panic *_panic

link *_defer

}

fn 存的就是指向defer關鍵字傳入的語句了

func main() {

fmt.Println("begin")

defer fmt.Print(1)

fmt.Println("do something")

defer fmt.Print(2)

fmt.Println("end")

}

/*

begin

do something

end

2

1

*/

也能傳入匿名函數

func main() {

fmt.Println("ithome")

defer func() {

fmt.Println("ironman")

fmt.Println("Day 13 post sucess")

}()

}

/*

ithome

ironman

Day 13 post sucess

*/

進階題 : defer 裡函數裡包著函數

func calc(index string, a, b int) int {

ret := a + b

fmt.Println(index, a, b, ret)

return ret

}

func main() {

a := 1

b := 2

// 記得是FILO

defer calc("1", a, calc("10", 2, b))

a = 0

defer calc("2", a, calc("20", a, b))

b = 1

}

/*

10 2 2 4

20 0 2 2

2 0 2 2

1 1 4 5

*/

func main() {

for i := 0; i < 5; i++ {

defer fmt.Println(i)

}

}

/*

4

3

2

1

0

*/

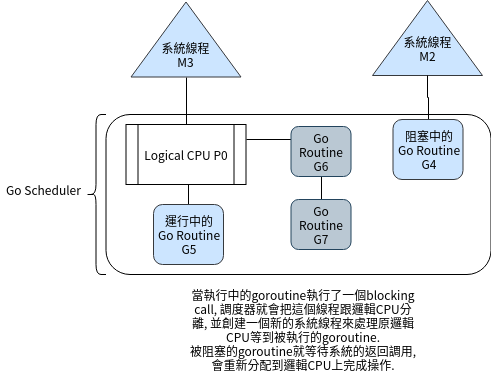

使用情境