開篇詞|想真正學會 Go 併發,建議這樣學

你好,我是晁嶽攀(鳥窩),曾在微博研發平台架構中心擔任資深架構師,也是微服務框架 rpcx 的作者。歡迎來到這份《Go 併發程式設計實戰》學習內容。

這份內容的目標,不只是教你「會用 goroutine / channel」,而是幫你建立一套可以在實務專案裡穩定解題的併發思維。

為什麼要學 Go 併發?

我過去長期使用 Java 做專案開發,後來投入 Go,原因很直接:Go 在併發場景的開發體驗和執行效率,真的很有優勢。

Go 的特點大致有幾個:

- 語法相對精簡,程式碼比較容易維護

- 工具鏈完整,建置與部署方便

goroutine建立成本低,適合處理大量併發任務channel讓 goroutine 之間的資料傳遞更直觀

你可以很快寫出一個會動的併發程式,但要寫得穩、寫得準、寫得不踩坑,就是另一回事了。

多數人學 Go 併發時,常卡住的地方

我把常見問題整理成 5 類:

- 不知道該選哪一種併發原語(例如

Mutex、channel、WaitGroup)。 - 好幾種做法都能解,卻不知道哪個才是比較好的解法。

- 不知道怎麼做任務編排,導致流程順序失控。

- 程式會

panic、死鎖(deadlock)或卡住,但很難除錯。 - 現成原語不夠用時,程式越寫越複雜、可讀性越差。

這些問題很正常,幾乎每個開始深入學 Go 的工程師都會遇到。

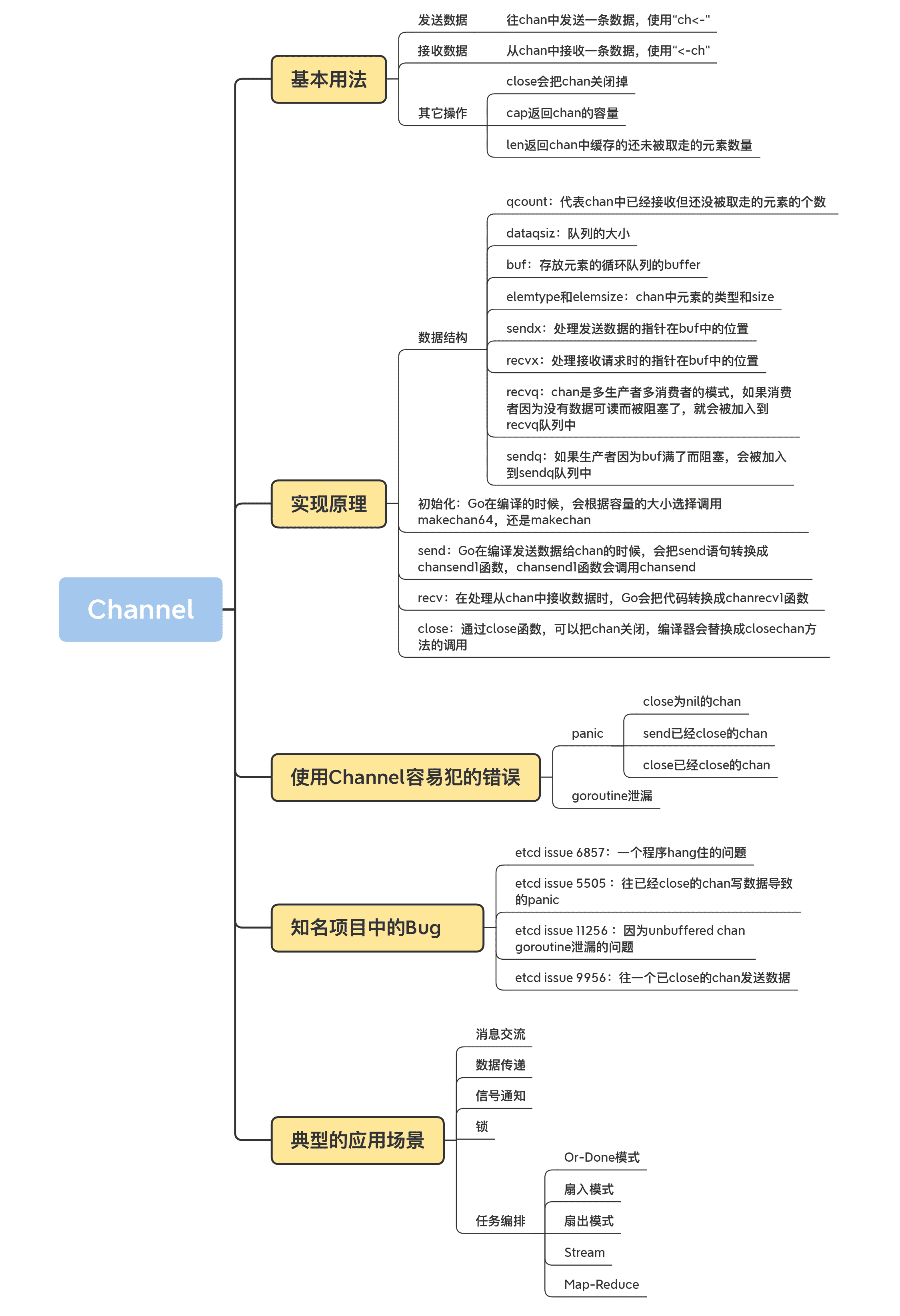

這份內容的學習方式:兩條主線

我建議用「兩條主線」來學,才不會變成零散記憶。

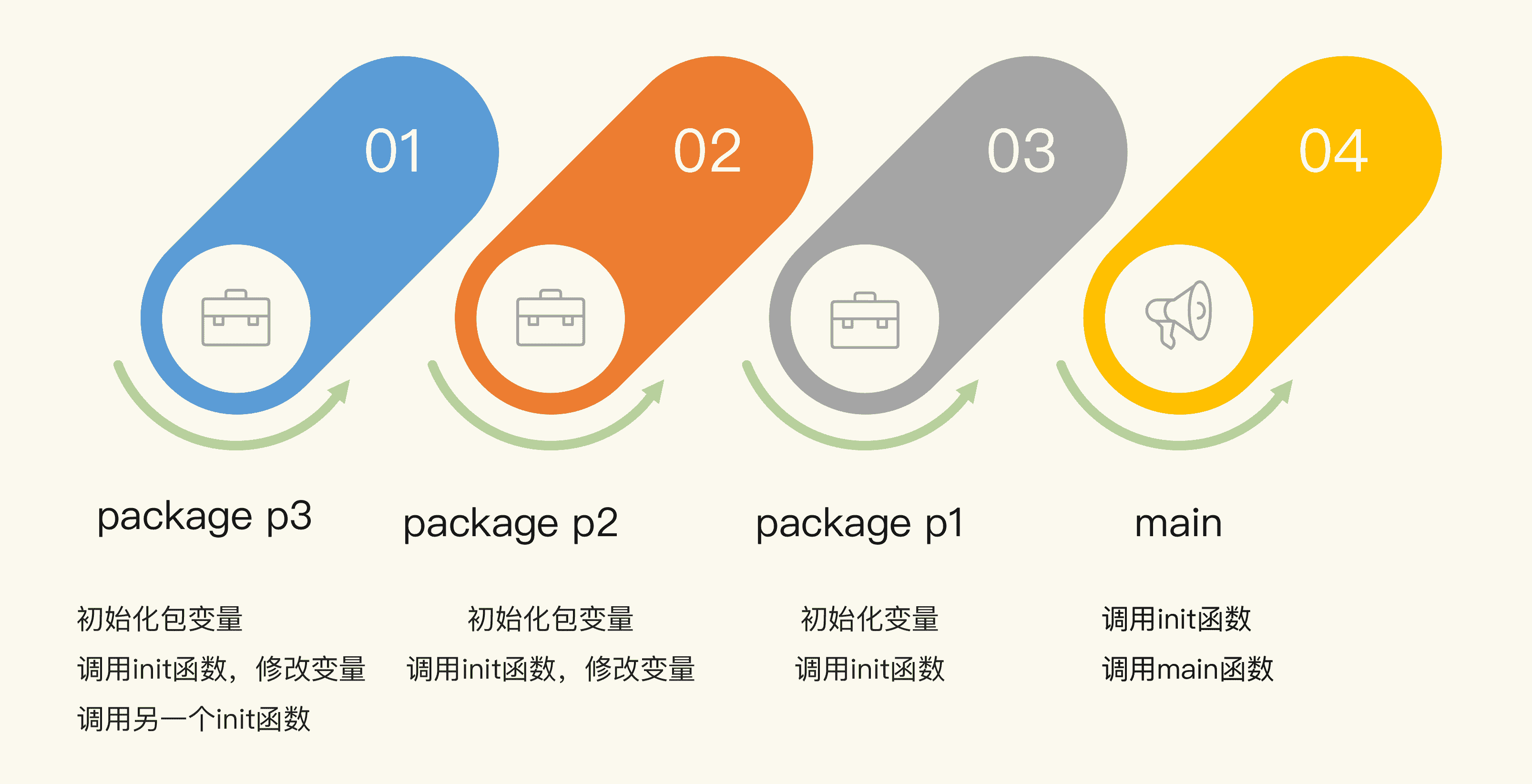

1) 知識主線(你要有哪些工具)

課程核心分成 5 個模組:

- 基本併發原語

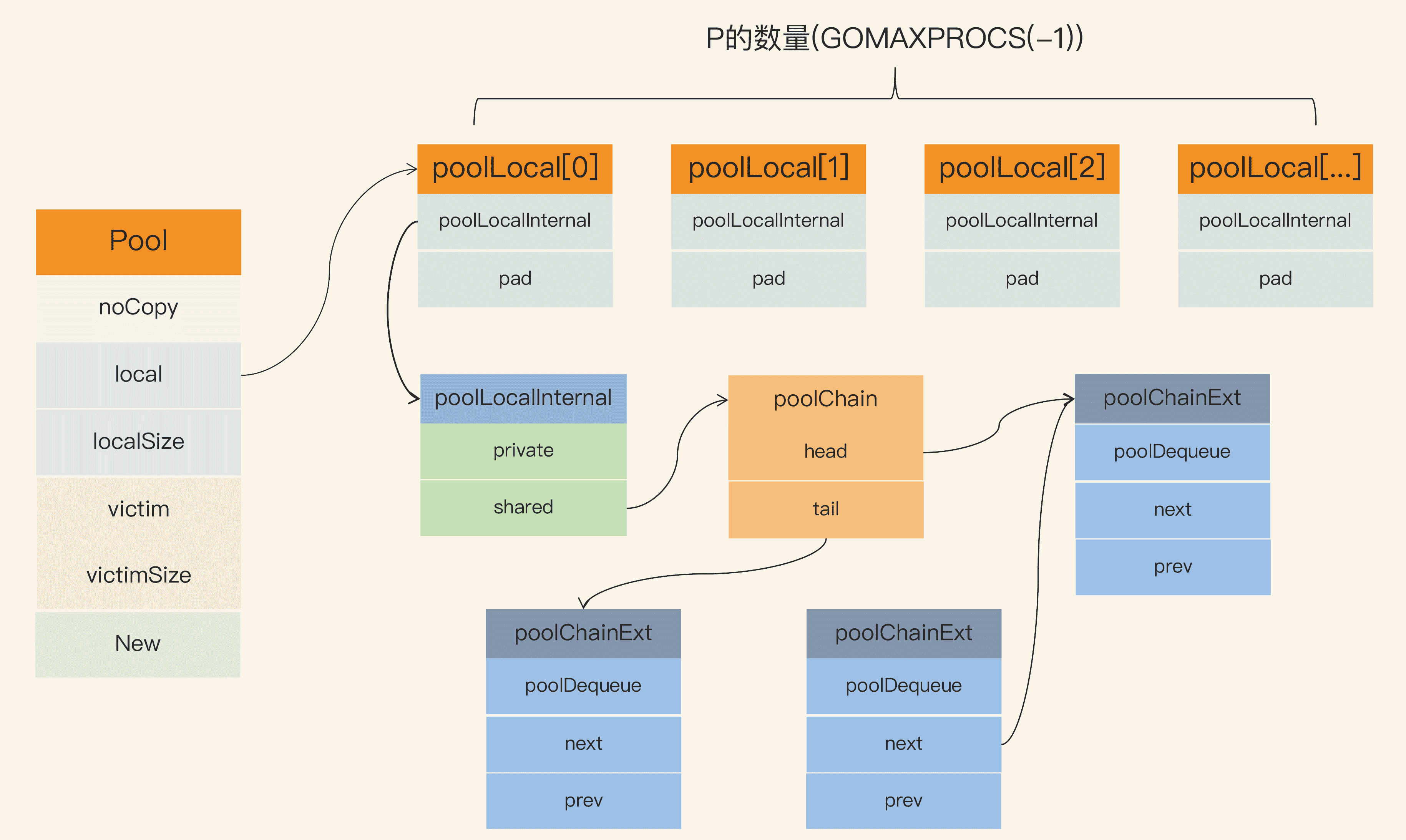

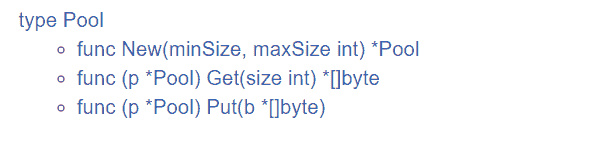

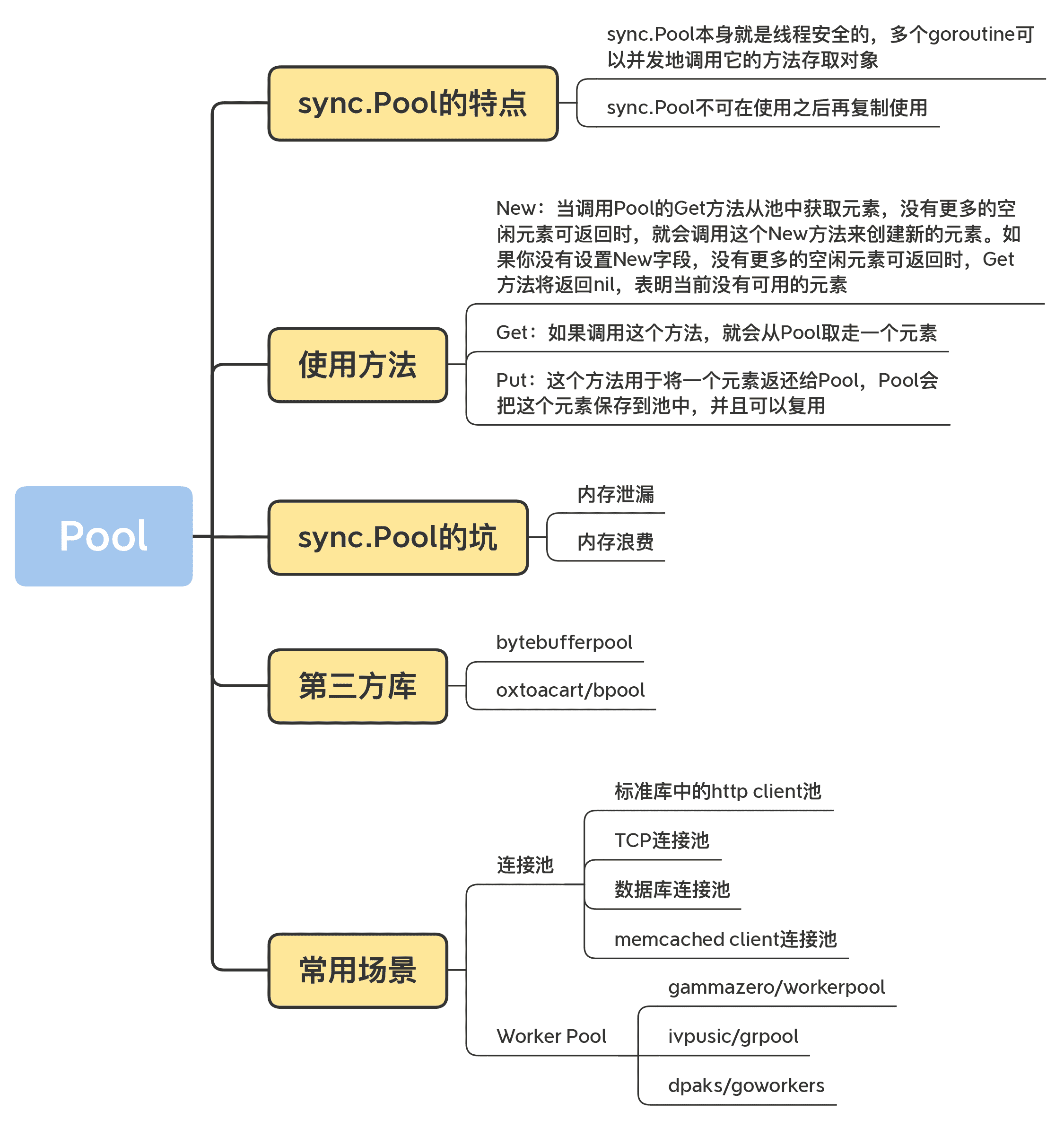

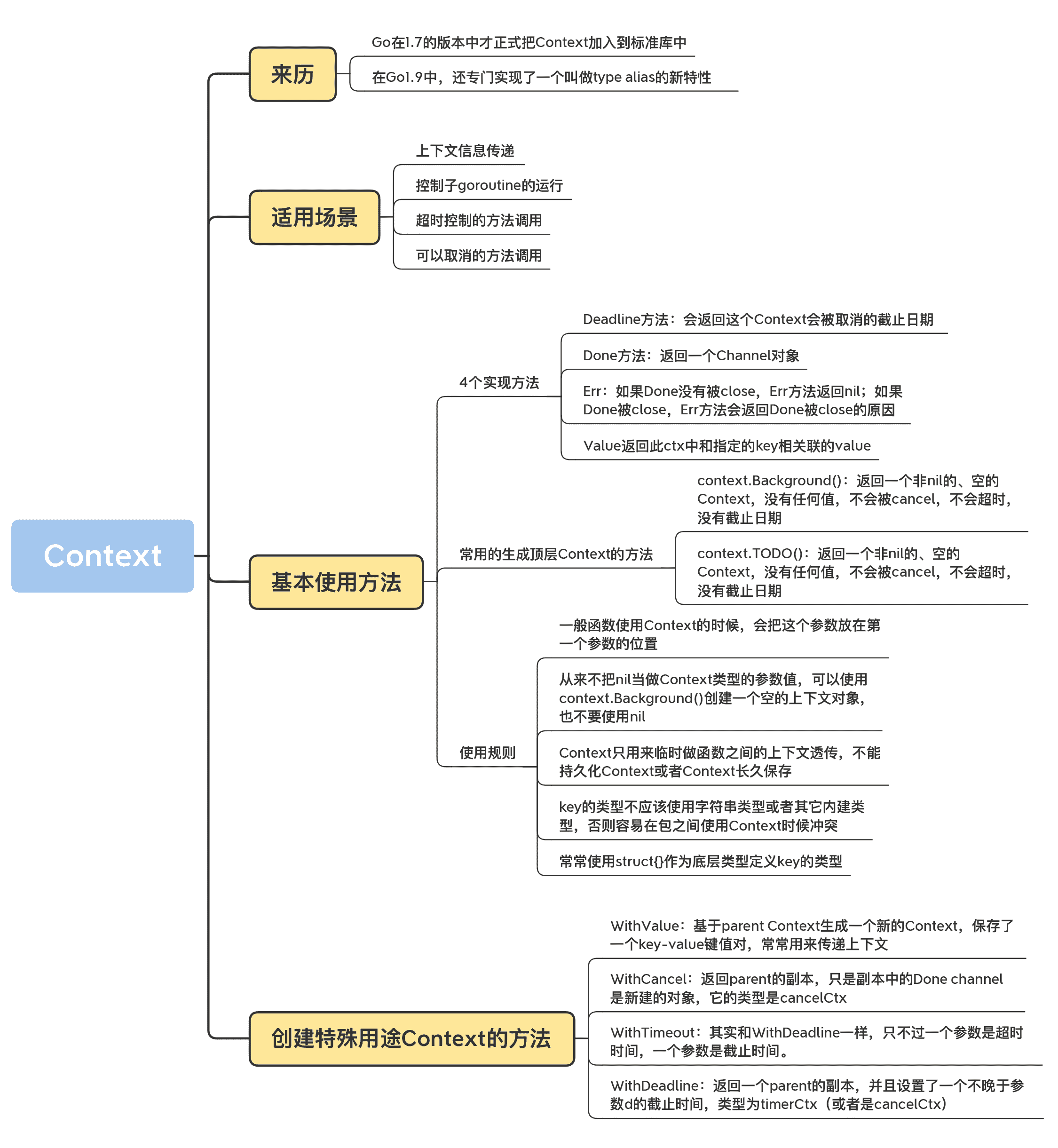

Mutex、RWMutex、WaitGroup、Cond、Pool、Context等

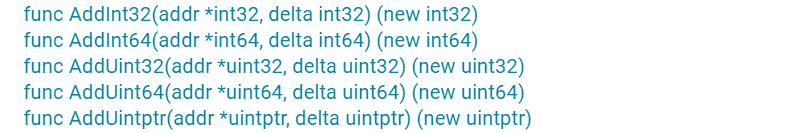

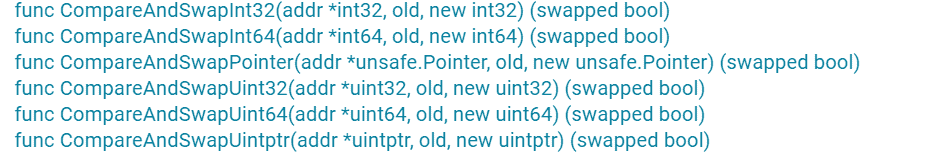

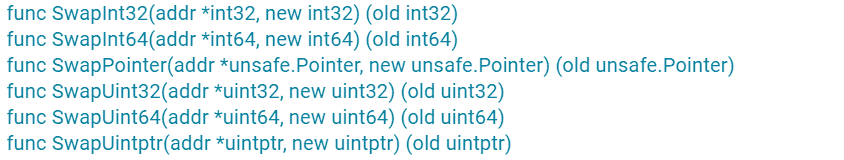

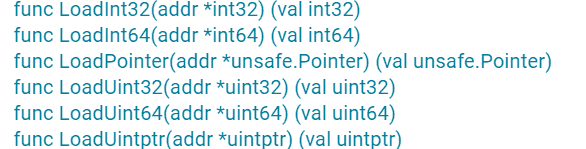

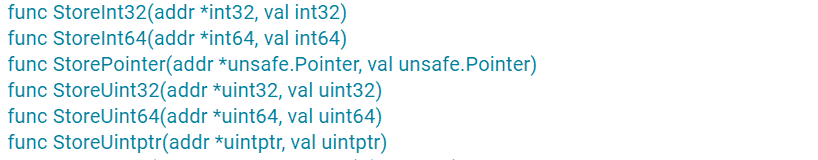

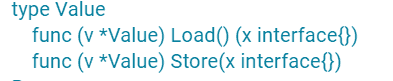

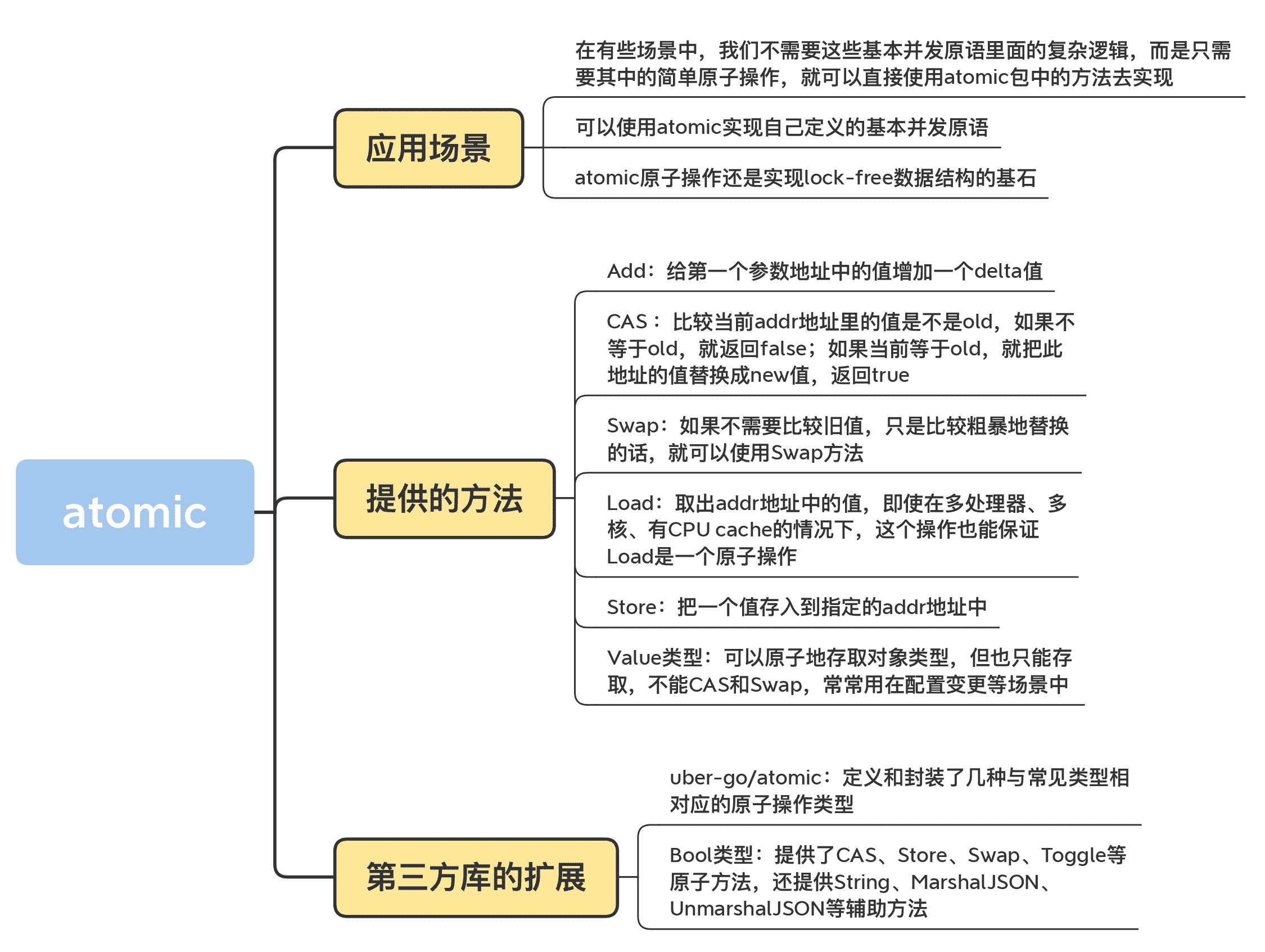

- 原子操作(atomic)

- 併發原語的基礎能力,理解後更容易看懂底層設計

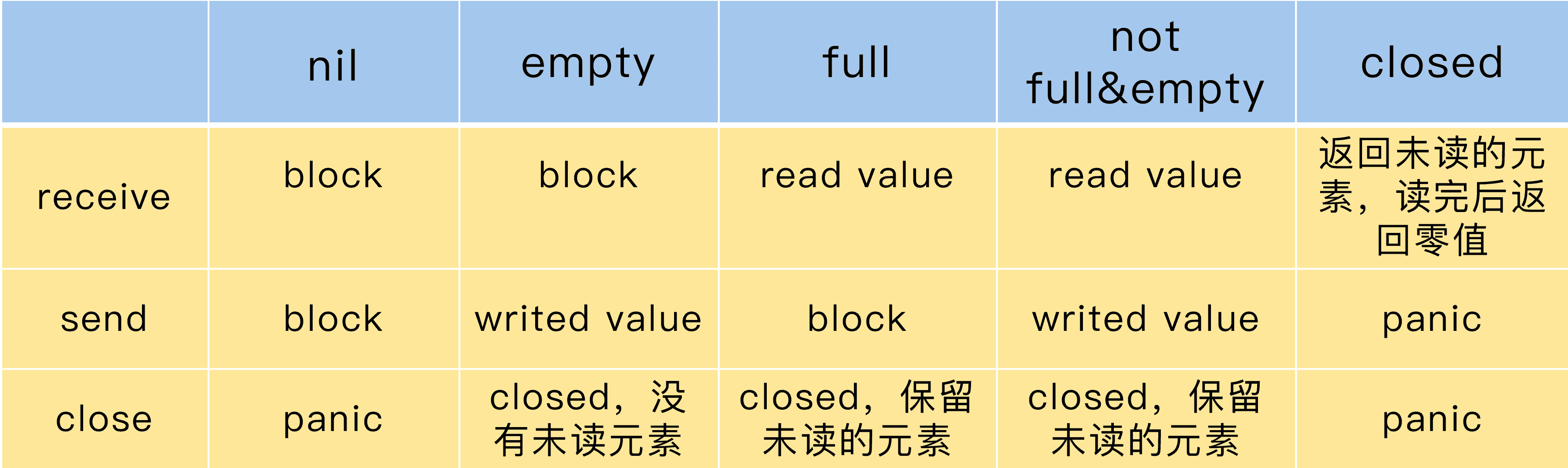

- Channel

- Go 特有的資料傳遞機制,也是任務編排的核心工具之一

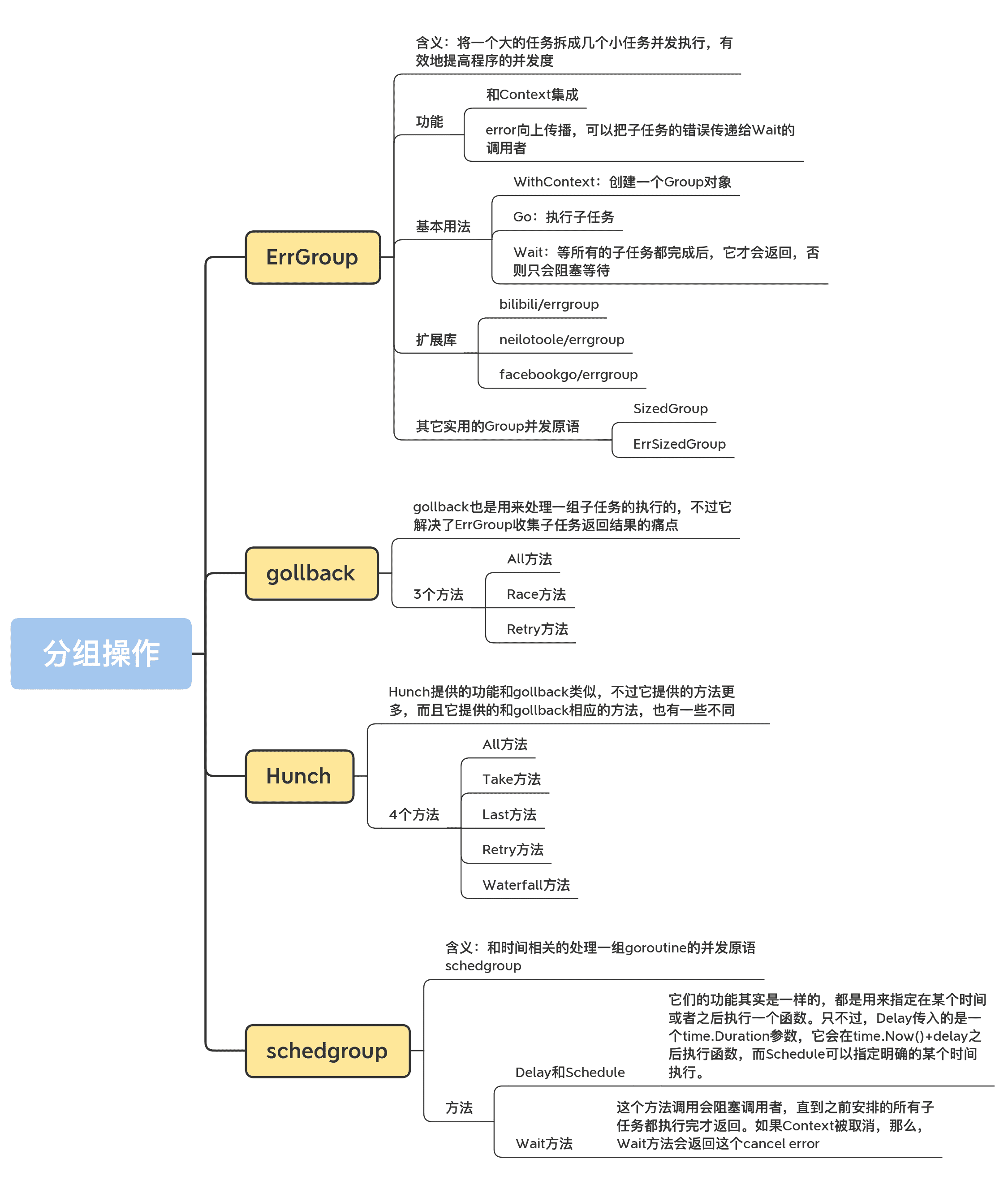

- 擴充併發原語

- 例如信號量(Semaphore)、

singleflight、循環柵欄(CyclicBarrier)、errgroup

- 例如信號量(Semaphore)、

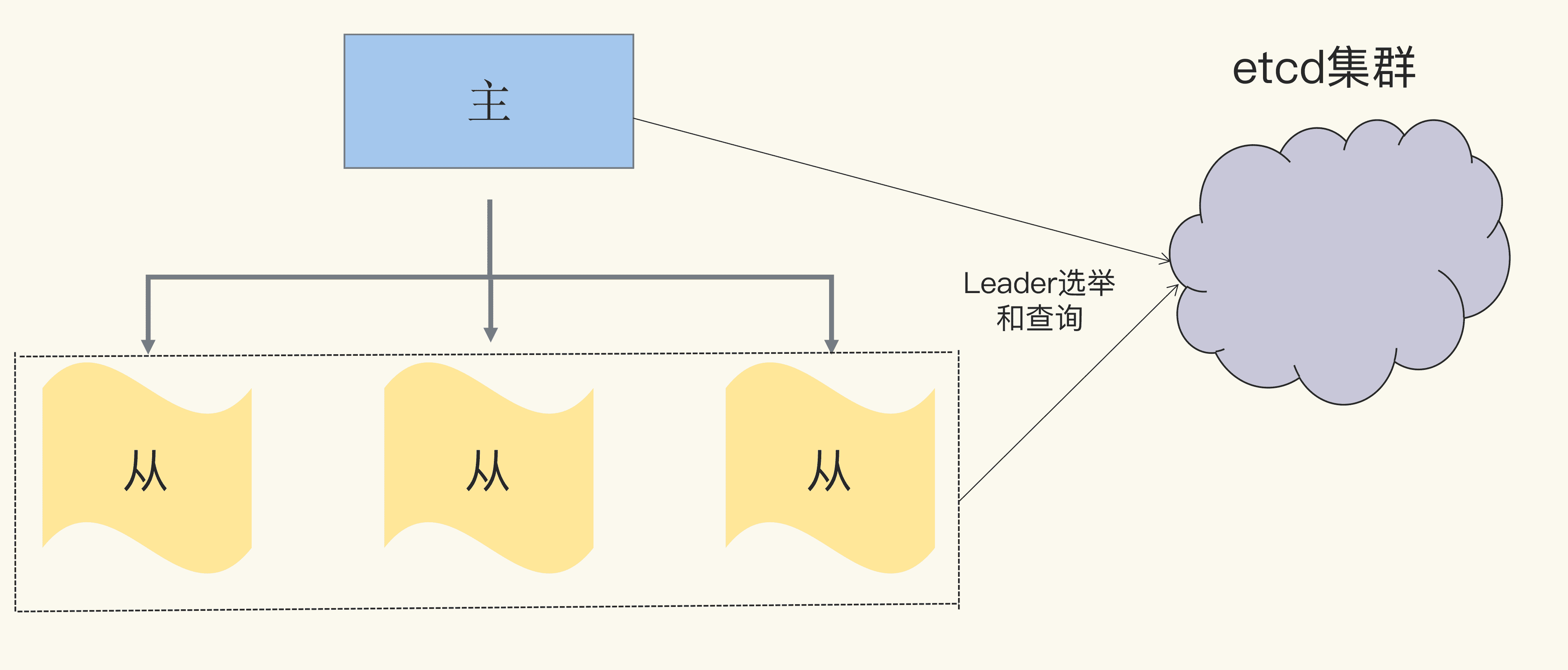

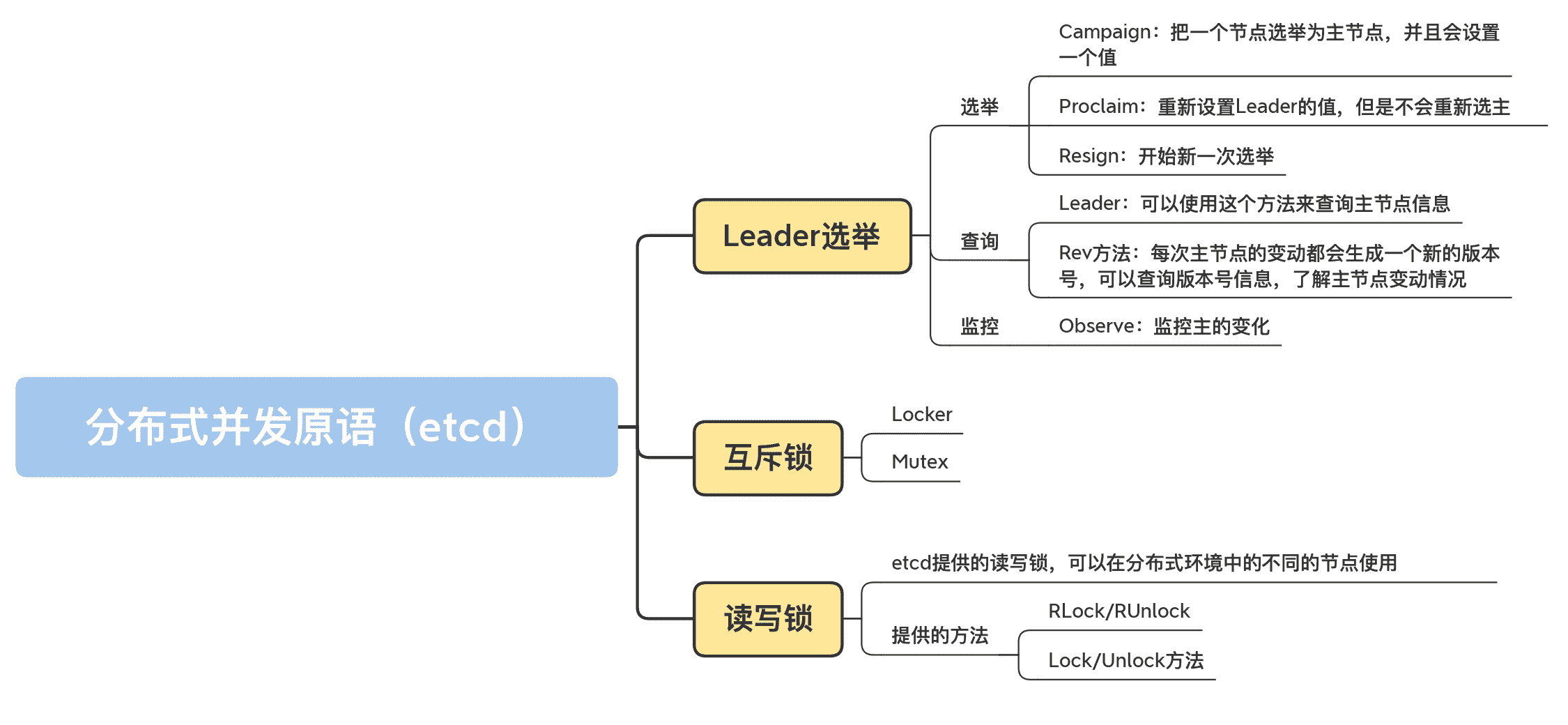

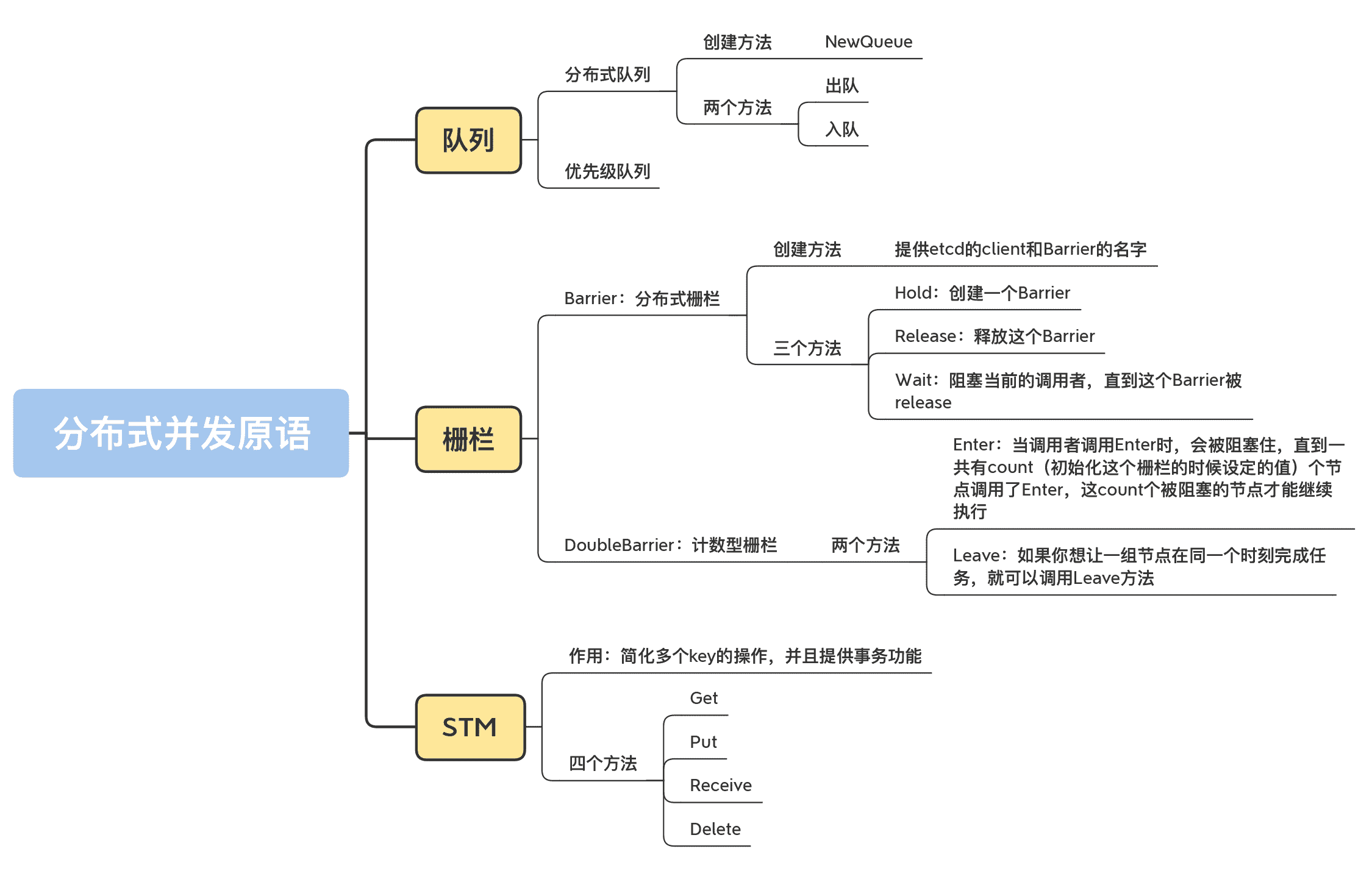

- 分散式併發原語

- 例如 Leader 選舉、分散式鎖、分散式佇列等

你可以把它想成「武器庫」:工具越完整,面對不同併發情境時越不容易硬解。

2) 學習主線(每個工具要學到什麼程度)

每個模組都建議用同一套節奏學習:

- 基本用法

- 實作原理

- 常見踩坑情境

- 真實專案中的錯誤案例(Bug)

這樣學的好處是:你不只知道 API 怎麼呼叫,也知道它為什麼會壞、壞在哪裡、怎麼避開。

學習地圖(先建立全局觀)

Go 併發程式設計學習地圖

+--------------------+ +--------------------+

| 知識主線 | | 學習主線 |

| (你要有的工具庫) | | (每個工具怎麼學) |

+--------------------+ +--------------------+

| |

v v

+--------------------------------+ +------------------+

| 基本原語 / atomic / channel / | | 用法 |

| 擴充原語 / 分散式原語 | | 原理 |

+--------------------------------+ | 易錯情境 |

| | 真實 Bug 案例 |

+----------+----------+------------------+

|

v

+---------------------------+

| 實務上能選對工具、避開坑洞 |

+---------------------------+

實務上怎麼選工具?先用這個原則

剛開始學時,可以先用這個簡化判斷:

- 任務編排:優先考慮

channel - 共享資源保護:優先考慮傳統同步原語(例如

Mutex)

但這只是入門準則,不是萬用答案。

同一個問題,常常有不只一種可行方案;真正的關鍵是:

- 原語的底層機制是什麼

- 成本在哪裡(效能、複雜度、可維護性)

- 哪些情境容易出錯

所以,不建議「什麼都用 channel」;能不能用是一回事,適不適合是另一回事。

為什麼要看原始碼與真實 Bug?

如果你只停在 API 用法,遇到邊界情況通常會很痛苦。

深入看 Go 併發原語的原始碼,你會學到很多實戰價值很高的設計,例如:

Mutex在公平性與效能上的取捨sync.Map為了提升效能做的資料結構設計- 各種異常狀況(panic、競態、死鎖)是怎麼被觸發的

而真實專案的 Bug 案例更重要,因為它能幫你建立「避坑清單」。

最後的目標:不只會用,還能組合與設計

學到後面,你的能力應該分成 3 個層次:

- 會用:知道常見併發原語的用途與基本寫法。

- 會選:面對情境能選出更合適的做法,避免誤用。

- 會設計:能組合既有原語,甚至設計新的併發解法。

能力進階示意

[會用 API] -> [看懂原理與限制] -> [選對工具] -> [組合/設計新原語]

初學 進階 實務穩定 高階

例如:

- 你可以把多個原語組合成新的控制流程(例如限制併發數量 + 等待全部完成)

- 也可以依照需求設計出標準庫沒有直接提供的解法

建議你怎麼讀這份內容

- 想補基礎:從「基本併發原語」開始

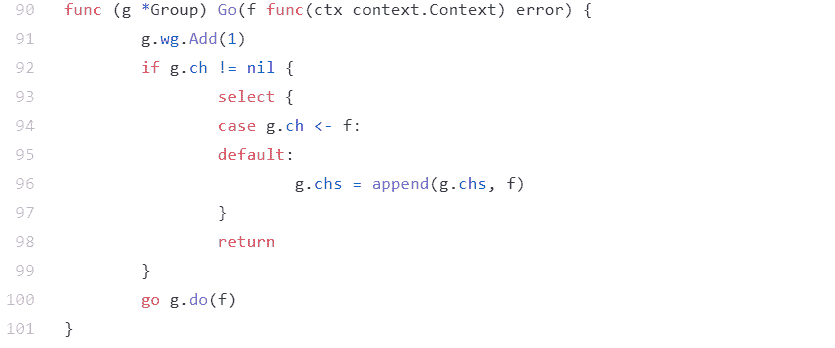

- 對

channel不熟:先讀Channel相關章節 - 已熟悉標準庫:可先看「擴充併發原語」與「分散式併發原語」

- 想快速提升實戰能力:優先看每章的「易錯情境」與「真實 Bug」

結語

Go 併發世界很大,工具也很多。真正的差別不在於你背了多少 API,而在於:

- 你是否能理解原理

- 你是否能選對工具

- 你是否能在複雜場景裡穩定解題

把這份內容當成你的練功地圖,循序建立工具庫、補齊原理、累積避坑經驗,你的 Go 併發能力會進步得很快。

如果你是和同事、朋友一起學,效果通常更好,因為很多併發問題非常適合透過 code review 和討論來釐清。

01|Mutex:如何解決資源併發訪問問題?

你好,我是鳥窩。

本章導讀

┌──────────────┐ Lock() ┌──────────────┐

│ goroutine A │ ────────────────> │ Mutex 鎖 │

└──────────────┘ └──────┬───────┘

│ 取得鎖

v

┌──────────────┐

│ 臨界區/共享資源 │

└──────┬───────┘

│ Unlock()

┌──────────────┐ 等待/阻塞 │

│ goroutine B │ ──────────────────────────┘

└──────────────┘

今天是我們 Go 併發程式設計實戰課的第一講,我們就直接從解決併發訪問這個棘手問題入手。

說起併發訪問問題,真是太常見了,比如多個 goroutine 併發更新同一個資源,像計數器;同時更新使用者的賬戶資訊;秒殺系統;往同一個 buffer 中併發寫入資料等等。如果沒有互斥控制,就會出現一些異常情況,比如計數器的計數不準確、使用者的賬戶可能出現透支、秒殺系統出現超賣、buffer 中的資料混亂,等等,後果都很嚴重。

這些問題怎麼解決呢?對,用互斥鎖,那在 Go 語言裡,就是 Mutex。

這節課,我會帶你詳細瞭解互斥鎖的實作機制,以及 Go 標準庫的互斥鎖 Mutex 的基本使用方法。在後面的 3 節課裡,我還會講解 Mutex 的具體實作原理、易錯場景和一些拓展用法。

好了,我們先來看看互斥鎖的實作機制。

互斥鎖的實作機制

互斥鎖是併發控制的一個基本手段,是為了避免競爭而建立的一種併發控制機制。在學習它的具體實作原理前,我們要先搞懂一個概念,就是臨界區。

在併發程式設計中,如果程式中的一部分會被併發訪問或修改,那麼,為了避免併發訪問導致的意想不到的結果,這部分程式需要被保護起來,這部分被保護起來的程式,就叫做臨界區。

可以說,臨界區就是一個被共享的資源,或者說是一個整體的一組共享資源,比如對資料庫的訪問、對某一個共享資料結構的操作、對一個 I/O 裝置的使用、對一個連線池中的連線的呼叫,等等。

如果很多執行緒同步訪問臨界區,就會造成訪問或操作錯誤,這當然不是我們希望看到的結果。所以,我們可以使用互斥鎖,限定臨界區只能同時由一個執行緒持有。

當臨界區由一個執行緒持有的時候,其它執行緒如果想進入這個臨界區,就會返回失敗,或者是等待。直到持有的執行緒退出臨界區,這些等待執行緒中的某一個才有機會接著持有這個臨界區。

你看,互斥鎖就很好地解決了資源競爭問題,有人也把互斥鎖叫做排它鎖。那在 Go 標準庫中,它提供了 Mutex 來實作互斥鎖這個功能。

根據 2019 年第一篇全面分析 Go 併發 Bug 的論文Understanding Real-World Concurrency Bugs in Go,Mutex 是使用最廣泛的同步原語(Synchronization primitives,有人也叫做併發原語。我們在這個課程中根據英文直譯優先用同步原語,但是併發原語的指代範圍更大,還可以包括任務編排的型別,所以後面我們講 Channel 或者擴充套件型別時也會用併發原語)。關於同步原語,並沒有一個嚴格的定義,你可以把它看作解決併發問題的一個基礎的資料結構。

在這門課的前兩個模組,我會和你講互斥鎖 Mutex、讀寫鎖 RWMutex、併發編排 WaitGroup、條件變數 Cond、Channel 等同步原語。所以,在這裡,我先和你說一下同步原語的適用場景。

- 共享資源。併發地讀寫共享資源,會出現資料競爭(data race)的問題,所以需要 Mutex、RWMutex 這樣的併發原語來保護。

- 任務編排。需要 goroutine 按照一定的規律執行,而 goroutine 之間有相互等待或者依賴的順序關係,我們常常使用 WaitGroup 或者 Channel 來實作。

- 訊息傳遞。資訊交流以及不同的 goroutine 之間的執行緒安全的資料交流,常常使用 Channel 來實作。

今天這一講,咱們就從公認的使用最廣泛的 Mutex 開始學習吧。是騾子是馬咱得拉出來遛遛,看看我們到底可以怎麼使用 Mutex。

Mutex 的基本使用方法

在正式看 Mutex 用法之前呢,我想先給你交代一件事:Locker 介面。

在 Go 的標準庫中,package sync 提供了鎖相關的一系列同步原語,這個 package 還定義了一個 Locker 的介面,Mutex 就實作了這個介面。

Locker 的介面定義了鎖同步原語的方法集:

type Locker interface {

Lock()

Unlock()

}

可以看到,Go 定義的鎖介面的方法集很簡單,就是請求鎖(Lock)和釋放鎖(Unlock)這兩個方法,秉承了 Go 語言一貫的簡潔風格。

但是,這個介面在實際專案應用得不多,因為我們一般會直接使用具體的同步原語,而不是透過介面。

我們這一講介紹的 Mutex 以及後面會介紹的讀寫鎖 RWMutex 都實作了 Locker 介面,所以首先我把這個介面介紹了,讓你做到心中有數。

下面我們直接看 Mutex。

簡單來說,互斥鎖 Mutex 就提供兩個方法 Lock 和 Unlock:進入臨界區之前呼叫 Lock 方法,退出臨界區的時候呼叫 Unlock 方法:

func(m *Mutex)Lock()

func(m *Mutex)Unlock()

當一個 goroutine 透過呼叫 Lock 方法獲得了這個鎖的擁有權後, 其它請求鎖的 goroutine 就會阻塞在 Lock 方法的呼叫上,直到鎖被釋放並且自己獲取到了這個鎖的擁有權。

看到這兒,你可能會問,為啥一定要加鎖呢?別急,我帶你來看一個併發訪問場景中不使用鎖的例子,看看實作起來會出現什麼狀況。

在這個例子中,我們建立了 10 個 goroutine,同時不斷地對一個變數(count)進行加 1 操作,每個 goroutine 負責執行 10 萬次的加 1 操作,我們期望的最後計數的結果是 10 * 100000 = 1000000 (一百萬)。

import (

"fmt"

"sync"

)

func main() {

var count = 0

// 使用WaitGroup等待10個goroutine完成

var wg sync.WaitGroup

wg.Add(10)

for i := 0; i < 10; i++ {

go func() {

defer wg.Done()

// 對變數count執行10次加1

for j := 0; j < 100000; j++ {

count++

}

}()

}

// 等待10個goroutine完成

wg.Wait()

fmt.Println(count)

}

在這段程式碼中,我們使用 sync.WaitGroup 來等待所有的 goroutine 執行完畢後,再輸出最終的結果。sync.WaitGroup 這個同步原語我會在後面的課程中具體介紹,現在你只需要知道,我們使用它來控制等待一組 goroutine 全部做完任務。

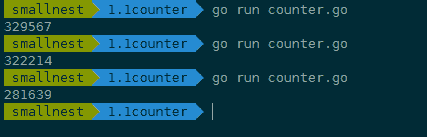

但是,每次執行,你都可能得到不同的結果,基本上不會得到理想中的一百萬的結果。

這是為什麼呢?

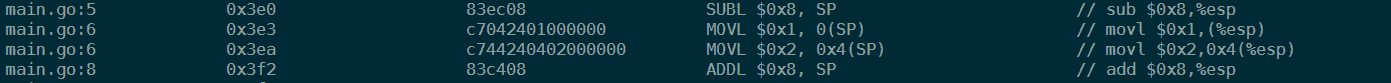

其實,這是因為,count++ 不是一個原子操作,它至少包含幾個步驟,比如讀取變數 count 的當前值,對這個值加 1,把結果再儲存到 count 中。因為不是原子操作,就可能有併發的問題。

比如,10 個 goroutine 同時讀取到 count 的值為 9527,接著各自按照自己的邏輯加 1,值變成了 9528,然後把這個結果再寫回到 count 變數。但是,實際上,此時我們增加的總數應該是 10 才對,這裡卻只增加了 1,好多計數都被“吞”掉了。這是併發訪問共享資料的常見錯誤。

// count++操作的彙編程式碼

MOVQ "".count(SB), AX

LEAQ 1(AX), CX

MOVQ CX, "".count(SB)

這個問題,有經驗的開發人員還是比較容易發現的,但是,很多時候,併發問題隱藏得非常深,即使是有經驗的人,也不太容易發現或者 Debug 出來。

針對這個問題,Go 提供了一個檢測併發訪問共享資源是否有問題的工具: race detector,它可以幫助我們自動發現程式有沒有 data race 的問題。

Go race detector 是基於 Google 的 C/C++ sanitizers 技術實作的,編譯器透過探測所有的記憶體訪問,加入程式碼能監視對這些記憶體地址的訪問(讀還是寫)。在程式碼執行的時候,race detector 就能監控到對共享變數的非同步訪問,出現 race 的時候,就會打印出警告資訊。

這個技術在 Google 內部幫了大忙,探測出了 Chromium 等程式碼的大量併發問題。Go 1.1 中就引入了這種技術,並且一下子就發現了標準庫中的 42 個併發問題。現在,race detector 已經成了 Go 持續整合過程中的一部分。

我們來看看這個工具怎麼用。

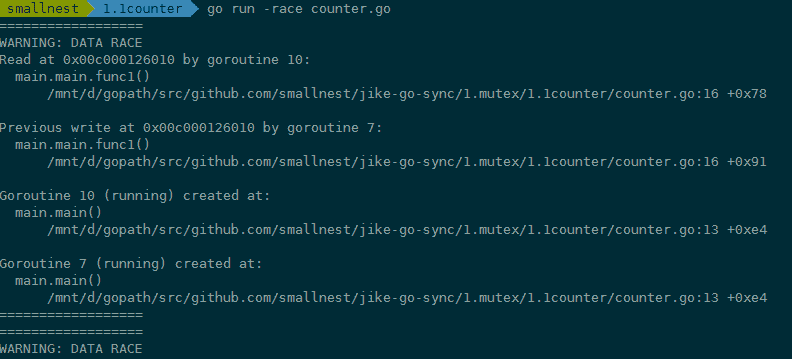

在編譯(compile)、測試(test)或者執行(run)Go 程式碼的時候,加上 race 引數,就有可能發現併發問題。比如在上面的例子中,我們可以加上 race 引數執行,檢測一下是不是有併發問題。如果你 go run -race counter.go,就會輸出警告資訊。

這個警告不但會告訴你有併發問題,而且還會告訴你哪個 goroutine 在哪一行對哪個變數有寫操作,同時,哪個 goroutine 在哪一行對哪個變數有讀操作,就是這些併發的讀寫訪問,引起了 data race。

例子中的 goroutine 10 對記憶體地址 0x00c000126010 有讀的操作(counter.go 檔案第 16 行),同時,goroutine 7 對記憶體地址 0x00c000126010 有寫的操作(counter.go 檔案第 16 行)。而且還可能有多個 goroutine 在同時進行讀寫,所以,警告資訊可能會很長。

雖然這個工具使用起來很方便,但是,因為它的實作方式,只能透過真正對實際地址進行讀寫訪問的時候才能探測,所以它並不能在編譯的時候發現 data race 的問題。而且,在執行的時候,只有在觸發了 data race 之後,才能檢測到,如果碰巧沒有觸發(比如一個 data race 問題只能在 2 月 14 號零點或者 11 月 11 號零點才出現),是檢測不出來的。

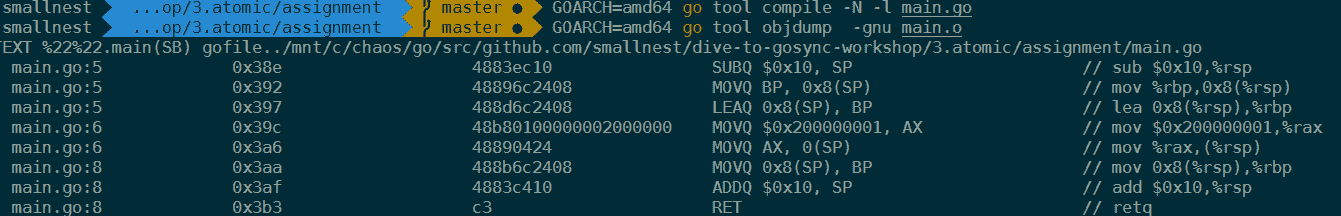

而且,把開啟了 race 的程式部署線上上,還是比較影響效能的。執行 go tool compile -race -S counter.go,可以檢視計數器例子的程式碼,重點關注一下 count++ 前後的編譯後的程式碼:

0x002a 00042 (counter.go:13) CALL runtime.racefuncenter(SB)

......

0x0061 00097 (counter.go:14) JMP 173

0x0063 00099 (counter.go:15) MOVQ AX, "".j+8(SP)

0x0068 00104 (counter.go:16) PCDATA $0, $1

0x0068 00104 (counter.go:16) MOVQ "".&count+128(SP), AX

0x0070 00112 (counter.go:16) PCDATA $0, $0

0x0070 00112 (counter.go:16) MOVQ AX, (SP)

0x0074 00116 (counter.go:16) CALL runtime.raceread(SB)

0x0079 00121 (counter.go:16) PCDATA $0, $1

0x0079 00121 (counter.go:16) MOVQ "".&count+128(SP), AX

0x0081 00129 (counter.go:16) MOVQ (AX), CX

0x0084 00132 (counter.go:16) MOVQ CX, ""..autotmp_8+16(SP)

0x0089 00137 (counter.go:16) PCDATA $0, $0

0x0089 00137 (counter.go:16) MOVQ AX, (SP)

0x008d 00141 (counter.go:16) CALL runtime.racewrite(SB)

0x0092 00146 (counter.go:16) MOVQ ""..autotmp_8+16(SP), AX

......

0x00b6 00182 (counter.go:18) CALL runtime.deferreturn(SB)

0x00bb 00187 (counter.go:18) CALL runtime.racefuncexit(SB)

0x00c0 00192 (counter.go:18) MOVQ 104(SP), BP

0x00c5 00197 (counter.go:18) ADDQ $112, SP

在編譯的程式碼中,增加了 runtime.racefuncenter、runtime.raceread、runtime.racewrite、runtime.racefuncexit 等檢測 data race 的方法。透過這些插入的指令,Go race detector 工具就能夠成功地檢測出 data race 問題了。

總結一下,透過在編譯的時候插入一些指令,在執行時透過這些插入的指令檢測併發讀寫從而發現 data race 問題,就是這個工具的實作機制。

既然這個例子存在 data race 問題,我們就要想辦法來解決它。這個時候,我們這節課的主角 Mutex 就要登場了,它可以輕鬆地消除掉 data race。

具體怎麼做呢?下面,我就結合這個例子,來具體給你講一講 Mutex 的基本用法。

我們知道,這裡的共享資源是 count 變數,臨界區是 count++,只要在臨界區前面獲取鎖,在離開臨界區的時候釋放鎖,就能完美地解決 data race 的問題了。

package main

import (

"fmt"

"sync"

)

func main() {

// 互斥鎖保護計數器

var mu sync.Mutex

// 計數器的值

var count = 0

// 輔助變數,用來確認所有的goroutine都完成

var wg sync.WaitGroup

wg.Add(10)

// 啟動10個gourontine

for i := 0; i < 10; i++ {

go func() {

defer wg.Done()

// 累加10萬次

for j := 0; j < 100000; j++ {

mu.Lock()

count++

mu.Unlock()

}

}()

}

wg.Wait()

fmt.Println(count)

}

如果你再執行一下程式,就會發現,data race 警告沒有了,系統乾脆地輸出了 1000000:

怎麼樣,使用 Mutex 是不是非常高效?效果很驚喜。

這裡有一點需要注意:Mutex 的零值是還沒有 goroutine 等待的未加鎖的狀態,所以你不需要額外的初始化,直接宣告變數(如 var mu sync.Mutex)即可。

那 Mutex 還有哪些用法呢?

很多情況下,Mutex 會嵌入到其它 struct 中使用,比如下面的方式:

type Counter struct {

mu sync.Mutex

Count uint64

}

在初始化嵌入的 struct 時,也不必初始化這個 Mutex 欄位,不會因為沒有初始化出現空指標或者是無法獲取到鎖的情況。

有時候,我們還可以採用嵌入欄位的方式。透過嵌入欄位,你可以在這個 struct 上直接呼叫 Lock/Unlock 方法。

func main() {

var counter Counter

var wg sync.WaitGroup

wg.Add(10)

for i := 0; i < 10; i++ {

go func() {

defer wg.Done()

for j := 0; j < 100000; j++ {

counter.Lock()

counter.Count++

counter.Unlock()

}

}()

}

wg.Wait()

fmt.Println(counter.Count)

}

type Counter struct {

sync.Mutex

Count uint64

}

**如果嵌入的 struct 有多個欄位,我們一般會把 Mutex 放在要控制的欄位上面,然後使用空格把欄位分隔開來。**即使你不這樣做,程式碼也可以正常編譯,只不過,用這種風格去寫的話,邏輯會更清晰,也更易於維護。

甚至,你還可以把獲取鎖、釋放鎖、計數加一的邏輯封裝成一個方法,對外不需要暴露鎖等邏輯:

func main() {

// 封裝好的計數器

var counter Counter

var wg sync.WaitGroup

wg.Add(10)

// 啟動10個goroutine

for i := 0; i < 10; i++ {

go func() {

defer wg.Done()

// 執行10萬次累加

for j := 0; j < 100000; j++ {

counter.Incr() // 受到鎖保護的方法

}

}()

}

wg.Wait()

fmt.Println(counter.Count())

}

// 執行緒安全的計數器型別

type Counter struct {

CounterType int

Name string

mu sync.Mutex

count uint64

}

// 加1的方法,內部使用互斥鎖保護

func (c *Counter) Incr() {

c.mu.Lock()

c.count++

c.mu.Unlock()

}

// 得到計數器的值,也需要鎖保護

func (c *Counter) Count() uint64 {

c.mu.Lock()

defer c.mu.Unlock()

return c.count

}總結這節課,我介紹了併發問題的背景知識、標準庫中 Mutex 的使用和最佳實踐、透過 race detector 工具發現計數器程式的問題以及修復方法。相信你已經大致瞭解了 Mutex 這個同步原語。

在專案開發的初始階段,我們可能並沒有仔細地考慮資源的併發問題,因為在初始階段,我們還不確定這個資源是否被共享。經過更加深入的設計,或者新功能的增加、程式碼的完善,這個時候,我們就需要考慮共享資源的併發問題了。當然,如果你能在初始階段預見到資源會被共享併發訪問就更好了。

意識到共享資源的併發訪問的早晚不重要,重要的是,一旦你意識到這個問題,你就要及時透過互斥鎖等手段去解決。

比如 Docker issue 37583、35517、32826、30696等、kubernetes issue 72361、71617等,都是後來發現的 data race 而採用互斥鎖 Mutex 進行修復的。

思考題

你已經知道,如果 Mutex 已經被一個 goroutine 獲取了鎖,其它等待中的 goroutine 們只能一直等待。那麼,等這個鎖釋放後,等待中的 goroutine 中哪一個會優先獲取 Mutex 呢?

歡迎在留言區寫下你的思考和答案,我們一起交流討論。如果你覺得有所收穫,也歡迎你把今天的內容分享給你的朋友或同事。

02|Mutex:庖丁解牛看實作

你好,我是鳥窩。

本章導讀

Mutex 實作路徑(概念圖)

┌──────────────┐

│ Lock() │

└──────┬───────┘

│

┌───────▼────────┐

│ 快速路徑: CAS 成功 │───> 進入臨界區

└───────┬────────┘

│失敗

┌───────▼────────┐

│ 慢速路徑: 排隊/自旋 │

│ 休眠(wait sema) │

└───────┬────────┘

│

┌──────▼───────┐

│ Unlock() │

└──────┬───────┘

│喚醒/交棒

▼

下一個等待 goroutine

上一講我們一起體驗了 Mutex 的使用,竟是那麼簡單,只有簡簡單單兩個方法,Lock 和 Unlock,進入臨界區之前呼叫 Lock 方法,退出臨界區的時候呼叫 Unlock 方法。這個時候,你一定會有一絲好奇:“它的實作是不是也很簡單呢?”

其實不是的。如果你閱讀 Go 標準庫裡 Mutex 的原始碼,並且追溯 Mutex 的演進歷史,你會發現,從一個簡單易於理解的互斥鎖的實作,到一個非常複雜的資料結構,這是一個逐步完善的過程。Go 開發者們做了種種努力,精心設計。我自己每次看,都會被這種匠心和精益求精的精神打動。

所以,今天我就想帶著你一起去探索 Mutex 的實作及演進之路,希望你能和我一樣體驗到這種技術追求的美妙。我們從 Mutex 的一個簡單實作開始,看看它是怎樣逐步提升效能和公平性的。在這個過程中,我們可以學習如何逐步設計一個完善的同步原語,並能對複雜度、效能、結構設計的權衡考量有新的認識。經過這樣一個學習,我們不僅能通透掌握 Mutex,更好地使用這個工具,同時,對我們自己設計併發資料介面也非常有幫助。

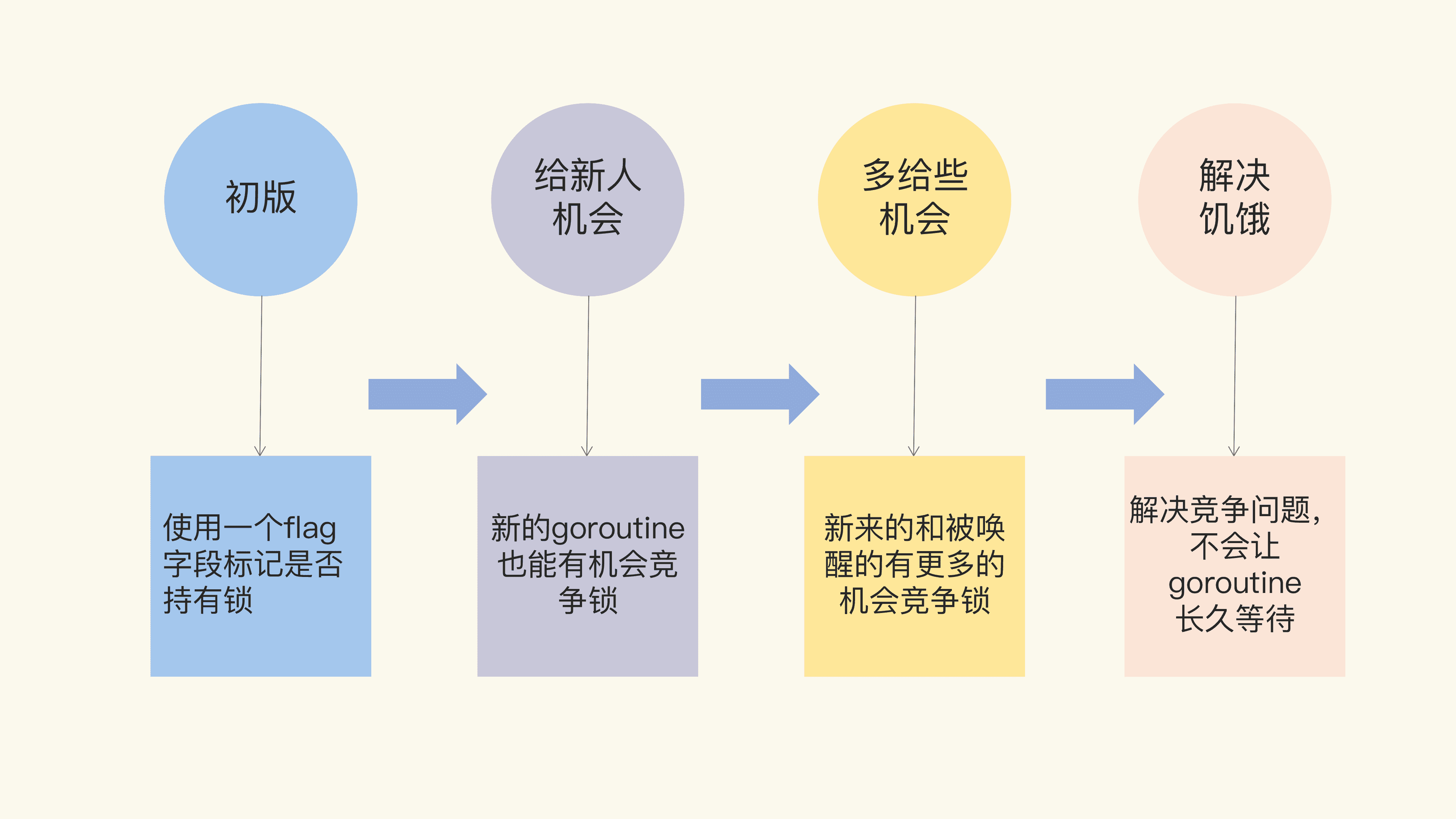

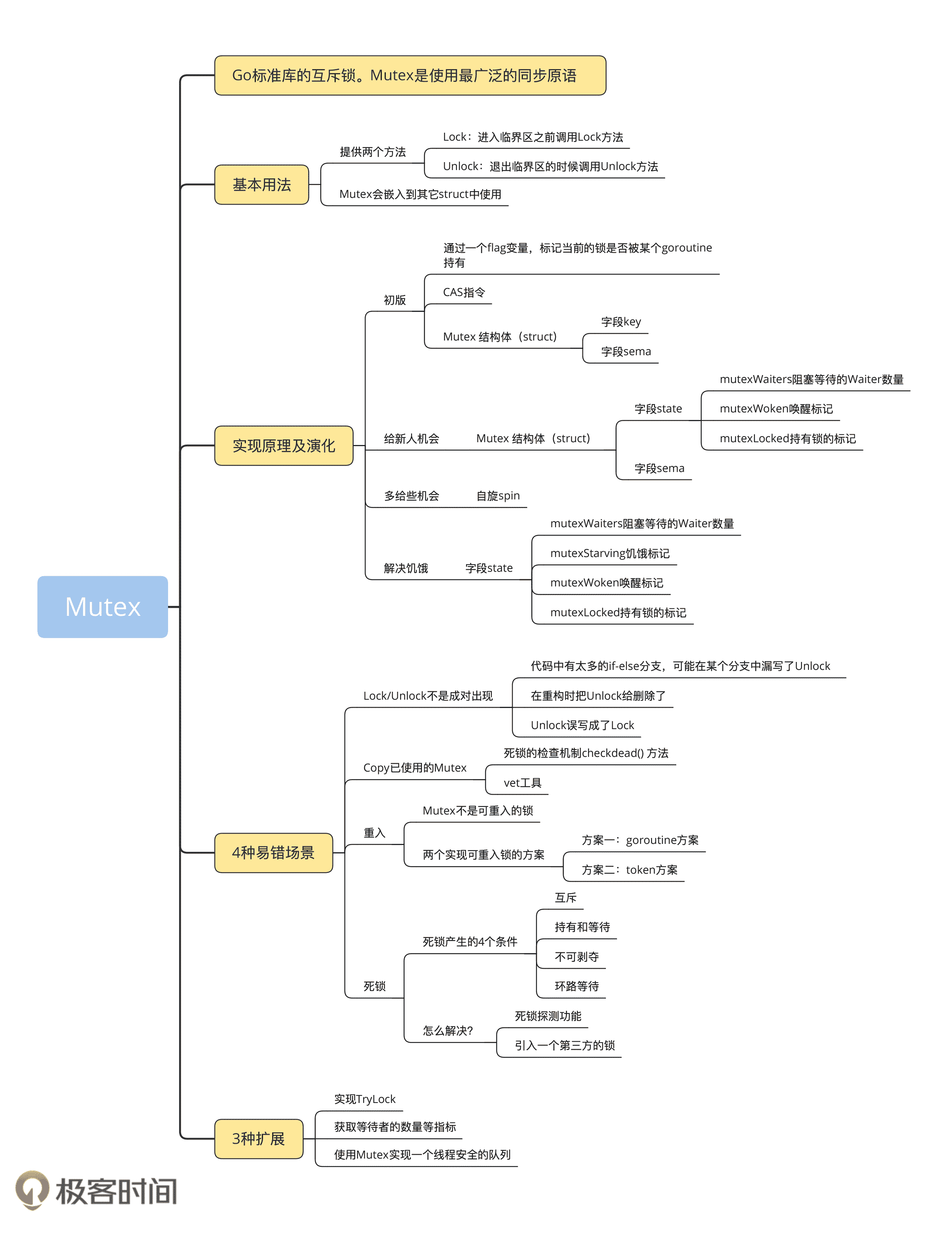

那具體怎麼來講呢?我把 Mutex 的架構演進分成了四個階段,下面給你畫了一張圖來說明。

“初版”的 Mutex 使用一個 flag 來表示鎖是否被持有,實作比較簡單;後來照顧到新來的 goroutine,所以會讓新的 goroutine 也儘可能地先獲取到鎖,這是第二個階段,我把它叫作“給新人機會”;那麼,接下來就是第三階段“多給些機會”,照顧新來的和被喚醒的 goroutine;但是這樣會帶來飢餓問題,所以目前又加入了飢餓的解決方案,也就是第四階段“解決飢餓”。

有了這四個階段,我們學習的路徑就清晰了,那接下來我會從程式碼層面帶你領略 Go 開發者這些大牛們是如何逐步解決這些問題的。

初版的互斥鎖

我們先來看怎麼實作一個最簡單的互斥鎖。在開始之前,你可以先想一想,如果是你,你會怎麼設計呢?

你可能會想到,可以透過一個 flag 變數,標記當前的鎖是否被某個 goroutine 持有。如果這個 flag 的值是 1,就代表鎖已經被持有,那麼,其它競爭的 goroutine 只能等待;如果這個 flag 的值是 0,就可以透過 CAS(compare-and-swap,或者 compare-and-set)將這個 flag 設定為 1,標識鎖被當前的這個 goroutine 持有了。

實際上,Russ Cox 在 2008 年提交的第一版 Mutex 就是這樣實作的。

// CAS操作,當時還沒有抽象出atomic包

func cas(val *int32, old, new int32) bool

func semacquire(*int32)

func semrelease(*int32)

// 互斥鎖的結構,包含兩個欄位

type Mutex struct {

key int32 // 鎖是否被持有的標識

sema int32 // 訊號量專用,用以阻塞/喚醒goroutine

}

// 保證成功在val上增加delta的值

func xadd(val *int32, delta int32) (new int32) {

for {

v := *val

if cas(val, v, v+delta) {

return v + delta

}

}

panic("unreached")

}

// 請求鎖

func (m *Mutex) Lock() {

if xadd(&m.key, 1) == 1 { //標識加1,如果等於1,成功獲取到鎖

return

}

semacquire(&m.sema) // 否則阻塞等待

}

func (m *Mutex) Unlock() {

if xadd(&m.key, -1) == 0 { // 將標識減去1,如果等於0,則沒有其它等待者

return

}

semrelease(&m.sema) // 喚醒其它阻塞的goroutine

}

這裡呢,我先簡單補充介紹下剛剛提到的 CAS。

CAS 指令將給定的值和一個記憶體地址中的值進行比較,如果它們是同一個值,就使用新值替換記憶體地址中的值,這個操作是原子性的。那啥是原子性呢?如果你還不太理解這個概念,那麼在這裡只需要明確一點就行了,那就是原子性保證這個指令總是基於最新的值進行計算,如果同時有其它執行緒已經修改了這個值,那麼,CAS 會返回失敗。

CAS 是實作互斥鎖和同步原語的基礎,我們很有必要掌握它。

好了,我們繼續來分析下剛才的這段程式碼。

雖然當時的 Go 語法和現在的稍微有些不同,而且標準庫的佈局、實作和現在的也有很大的差異,但是,這些差異不會影響我們對程式碼的理解,因為最核心的結構體(struct)和函式、方法的定義幾乎是一樣的。

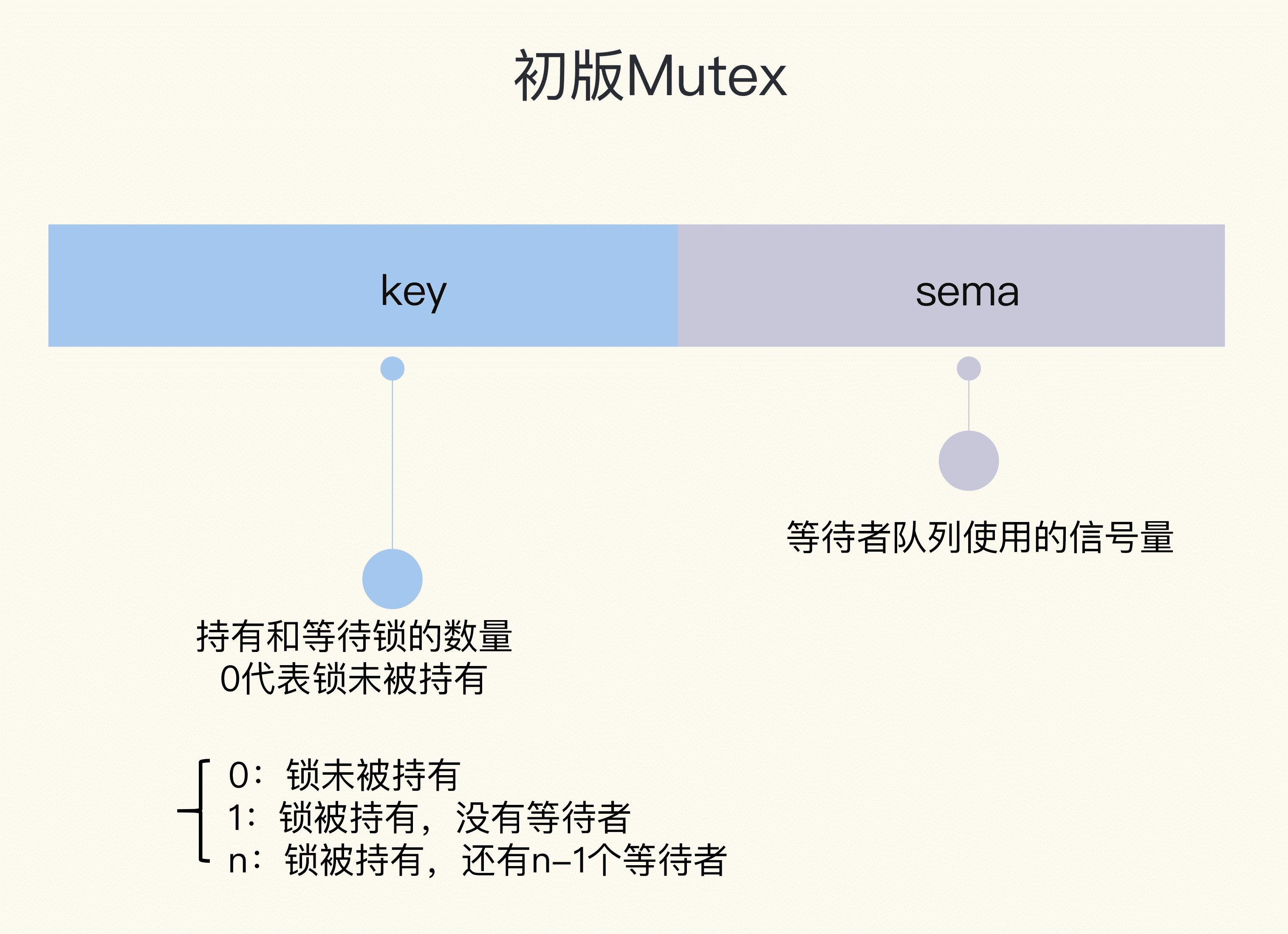

Mutex 結構體包含兩個欄位:

- **欄位 key:**是一個 flag,用來標識這個排外鎖是否被某個 goroutine 所持有,如果 key 大於等於 1,說明這個排外鎖已經被持有;

- **欄位 sema:**是個訊號量變數,用來控制等待 goroutine 的阻塞休眠和喚醒。

呼叫 Lock 請求鎖的時候,透過 xadd 方法進行 CAS 操作(第 24 行),xadd 方法透過迴圈執行 CAS 操作直到成功,保證對 key 加 1 的操作成功完成。如果比較幸運,鎖沒有被別的 goroutine 持有,那麼,Lock 方法成功地將 key 設定為 1,這個 goroutine 就持有了這個鎖;如果鎖已經被別的 goroutine 持有了,那麼,當前的 goroutine 會把 key 加 1,而且還會呼叫 semacquire 方法(第 27 行),使用訊號量將自己休眠,等鎖釋放的時候,訊號量會將它喚醒。

持有鎖的 goroutine 呼叫 Unlock 釋放鎖時,它會將 key 減 1(第 31 行)。如果當前沒有其它等待這個鎖的 goroutine,這個方法就返回了。但是,如果還有等待此鎖的其它 goroutine,那麼,它會呼叫 semrelease 方法(第 34 行),利用訊號量喚醒等待鎖的其它 goroutine 中的一個。

所以,到這裡,我們就知道了,初版的 Mutex 利用 CAS 原子操作,對 key 這個標誌量進行設定。key 不僅僅標識了鎖是否被 goroutine 所持有,還記錄了當前持有和等待獲取鎖的 goroutine 的數量。

Mutex 的整體設計非常簡潔,學習起來一點也沒有障礙。但是,注意,我要劃重點了。

Unlock 方法可以被任意的 goroutine 呼叫釋放鎖,即使是沒持有這個互斥鎖的 goroutine,也可以進行這個操作。這是因為,Mutex 本身並沒有包含持有這把鎖的 goroutine 的資訊,所以,Unlock 也不會對此進行檢查。Mutex 的這個設計一直保持至今。

這就帶來了一個有趣而危險的功能。為什麼這麼說呢?

你看,其它 goroutine 可以強制釋放鎖,這是一個非常危險的操作,因為在臨界區的 goroutine 可能不知道鎖已經被釋放了,還會繼續執行臨界區的業務操作,這可能會帶來意想不到的結果,因為這個 goroutine 還以為自己持有鎖呢,有可能導致 data race 問題。

所以,我們在使用 Mutex 的時候,必須要保證 goroutine 儘可能不去釋放自己未持有的鎖,一定要遵循“誰申請,誰釋放”的原則。在真實的實踐中,我們使用互斥鎖的時候,很少在一個方法中單獨申請鎖,而在另外一個方法中單獨釋放鎖,一般都會在同一個方法中獲取鎖和釋放鎖。

如果你接觸過其它語言(比如 Java 語言)的互斥鎖的實作,就會發現這一點和其它語言的互斥鎖不同,所以,如果是從其它語言轉到 Go 語言開發的同學,一定要注意。

以前,我們經常會基於效能的考慮,及時釋放掉鎖,所以在一些 if-else 分支中加上釋放鎖的程式碼,程式碼看起來很臃腫。而且,在重構的時候,也很容易因為誤刪或者是漏掉而出現死鎖的現象。

type Foo struct {

mu sync.Mutex

count int

}

func (f *Foo) Bar() {

f.mu.Lock()

if f.count < 1000 {

f.count += 3

f.mu.Unlock() // 此處釋放鎖

return

}

f.count++

f.mu.Unlock() // 此處釋放鎖

return

}

從 1.14 版本起,Go 對 defer 做了最佳化,採用更有效的內聯方式,取代之前的生成 defer 物件到 defer chain 中,defer 對耗時的影響微乎其微了,所以基本上修改成下面簡潔的寫法也沒問題:

func (f *Foo) Bar() {

f.mu.Lock()

defer f.mu.Unlock()

if f.count < 1000 {

f.count += 3

return

}

f.count++

return

}

這樣做的好處就是 Lock/Unlock 總是成對緊湊出現,不會遺漏或者多呼叫,程式碼更少。

但是,如果臨界區只是方法中的一部分,為了儘快釋放鎖,還是應該第一時間呼叫 Unlock,而不是一直等到方法返回時才釋放。

初版的 Mutex 實作之後,Go 開發組又對 Mutex 做了一些微調,比如把欄位型別變成了 uint32 型別;呼叫 Unlock 方法會做檢查;使用 atomic 包的同步原語執行原子操作等等,這些小的改動,都不是核心功能,你簡單知道就行了,我就不詳細介紹了。

但是,初版的 Mutex 實作有一個問題:請求鎖的 goroutine 會排隊等待獲取互斥鎖。雖然這貌似很公平,但是從效能上來看,卻不是最優的。因為如果我們能夠把鎖交給正在佔用 CPU 時間片的 goroutine 的話,那就不需要做上下文的切換,在高併發的情況下,可能會有更好的效能。

接下來,我們就繼續探索 Go 開發者是怎麼解決這個問題的。

給新人機會

Go 開發者在 2011 年 6 月 30 日的 commit 中對 Mutex 做了一次大的調整,調整後的 Mutex 實作如下:

type Mutex struct {

state int32

sema uint32

}

const (

mutexLocked = 1 << iota // mutex is locked

mutexWoken

mutexWaiterShift = iota

)

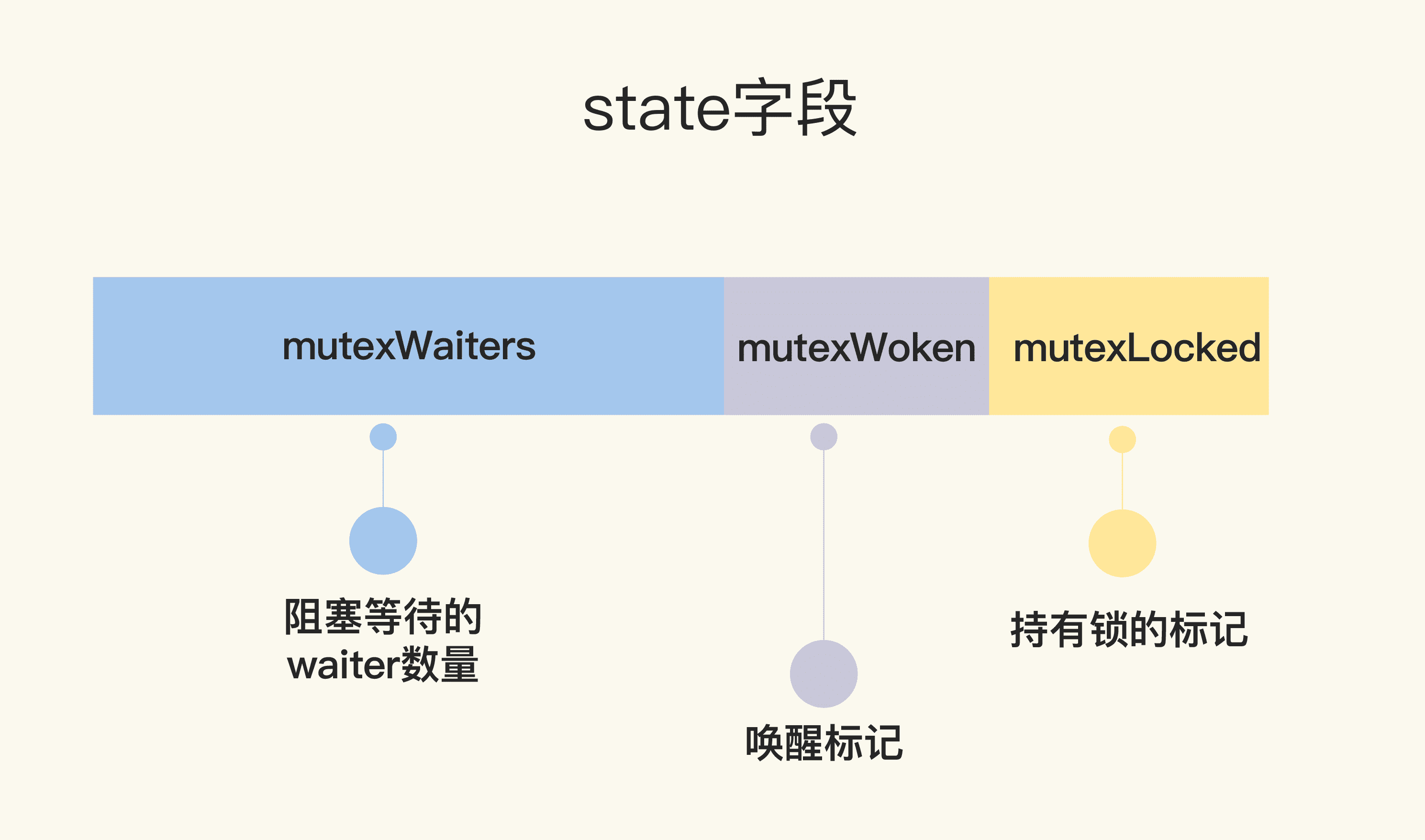

雖然 Mutex 結構體還是包含兩個欄位,但是第一個欄位已經改成了 state,它的含義也不一樣了。

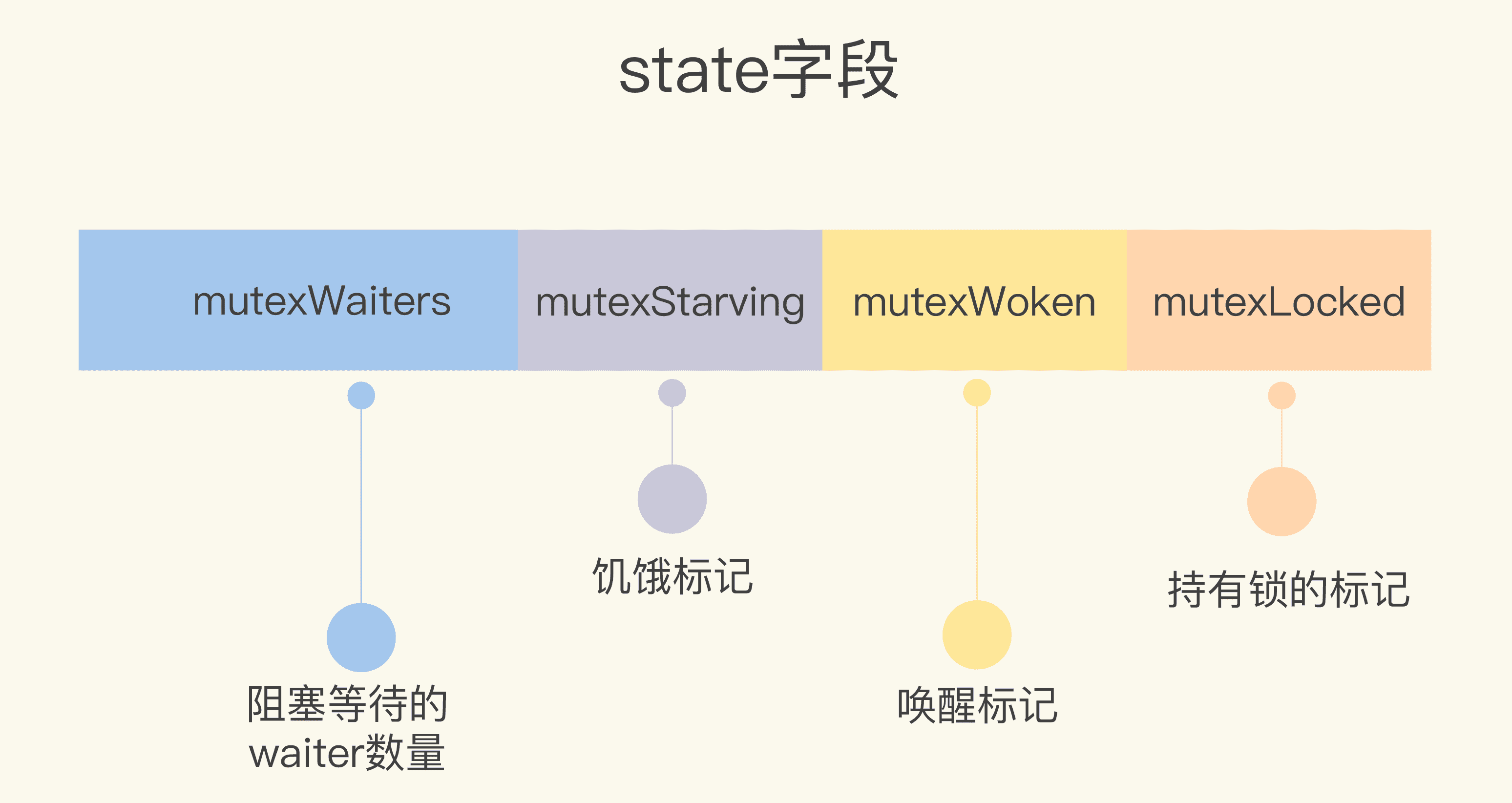

state 是一個複合型的欄位,一個欄位包含多個意義,這樣可以透過儘可能少的記憶體來實作互斥鎖。這個欄位的第一位(最小的一位)來表示這個鎖是否被持有,第二位代表是否有喚醒的 goroutine,剩餘的位數代表的是等待此鎖的 goroutine 數。所以,state 這一個欄位被分成了三部分,代表三個資料。

請求鎖的方法 Lock 也變得複雜了。複雜之處不僅僅在於對欄位 state 的操作難以理解,而且程式碼邏輯也變得相當複雜。

func (m *Mutex) Lock() {

// Fast path: 幸運case,能夠直接獲取到鎖

if atomic.CompareAndSwapInt32(&m.state, 0, mutexLocked) {

return

}

awoke := false

for {

old := m.state

new := old | mutexLocked // 新狀態加鎖

if old&mutexLocked != 0 {

new = old + 1<<mutexWaiterShift //等待者數量加一

}

if awoke {

// goroutine是被喚醒的,

// 新狀態清除喚醒標誌

new &^= mutexWoken

}

if atomic.CompareAndSwapInt32(&m.state, old, new) {//設定新狀態

if old&mutexLocked == 0 { // 鎖原狀態未加鎖

break

}

runtime.Semacquire(&m.sema) // 請求訊號量

awoke = true

}

}

}

首先是透過 CAS 檢測 state 欄位中的標誌(第 3 行),如果沒有 goroutine 持有鎖,也沒有等待持有鎖的 gorutine,那麼,當前的 goroutine 就很幸運,可以直接獲得鎖,這也是註釋中的 Fast path 的意思。

如果不夠幸運,state 不是零值,那麼就透過一個迴圈進行檢查。接下來的第 7 行到第 26 行這段程式碼雖然只有幾行,但是理解起來卻要費一番功夫,因為涉及到對 state 不同標誌位的操作。這裡的位操作以及操作後的結果和數值比較,並沒有明確的解釋,有時候你需要根據後續的處理進行推斷。所以說,如果你充分理解了這段程式碼,那麼對最新版的 Mutex 也會比較容易掌握了,因為你已經清楚了這些位操作的含義。

我們先前知道,如果想要獲取鎖的 goroutine 沒有機會獲取到鎖,就會進行休眠,但是在鎖釋放喚醒之後,它並不能像先前一樣直接獲取到鎖,還是要和正在請求鎖的 goroutine 進行競爭。這會給後來請求鎖的 goroutine 一個機會,也讓 CPU 中正在執行的 goroutine 有更多的機會獲取到鎖,在一定程度上提高了程式的效能。

for 迴圈是不斷嘗試獲取鎖,如果獲取不到,就透過 runtime.Semacquire(&m.sema) 休眠,休眠醒來之後 awoke 置為 true,嘗試爭搶鎖。

程式碼中的第 10 行將當前的 flag 設定為加鎖狀態,如果能成功地透過 CAS 把這個新值賦予 state(第 19 行和第 20 行),就代表搶奪鎖的操作成功了。

不過,需要注意的是,如果成功地設定了 state 的值,但是之前的 state 是有鎖的狀態,那麼,state 只是清除 mutexWoken 標誌或者增加一個 waiter 而已。

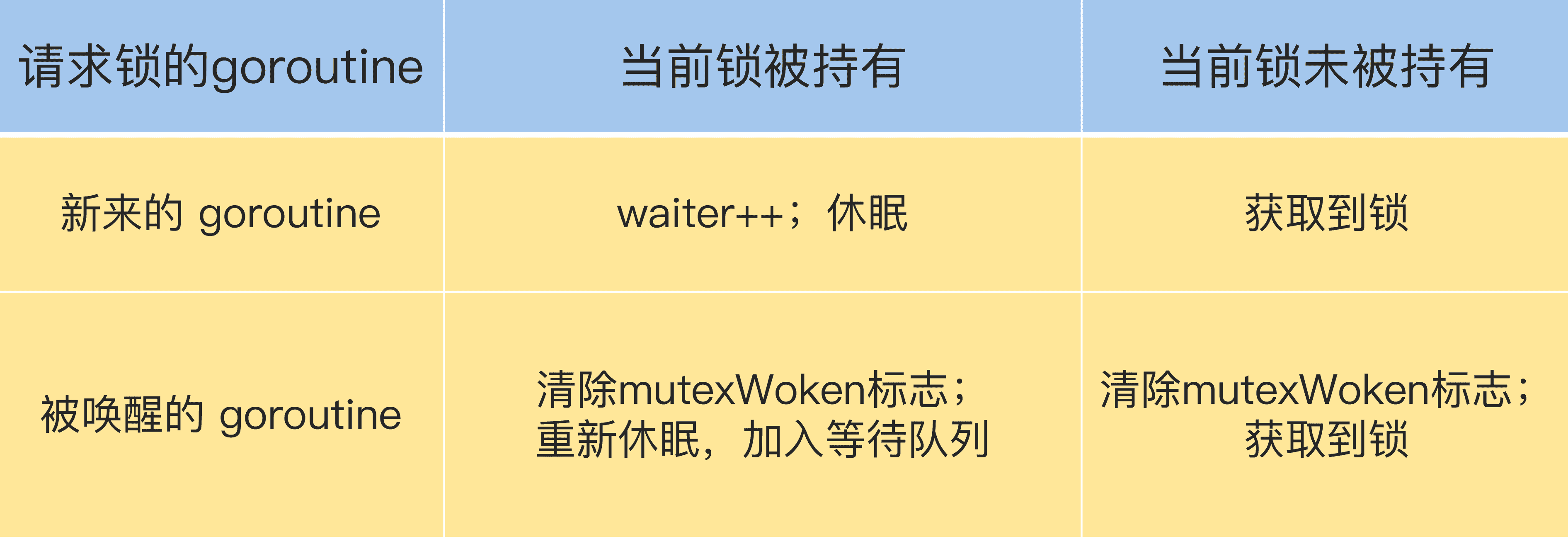

請求鎖的 goroutine 有兩類,一類是新來請求鎖的 goroutine,另一類是被喚醒的等待請求鎖的 goroutine。鎖的狀態也有兩種:加鎖和未加鎖。我用一張表格,來說明一下 goroutine 不同來源不同狀態下的處理邏輯。

剛剛說的都是獲取鎖,接下來,我們再來看看釋放鎖。釋放鎖的 Unlock 方法也有些複雜,我們來看一下。

func (m *Mutex) Unlock() {

// Fast path: drop lock bit.

new := atomic.AddInt32(&m.state, -mutexLocked) //去掉鎖標誌

if (new+mutexLocked)&mutexLocked == 0 { //本來就沒有加鎖

panic("sync: unlock of unlocked mutex")

}

old := new

for {

if old>>mutexWaiterShift == 0 || old&(mutexLocked|mutexWoken) != 0 { // 沒有等待者,或者有喚醒的waiter,或者鎖原來已加鎖

return

}

new = (old - 1<<mutexWaiterShift) | mutexWoken // 新狀態,準備喚醒goroutine,並設定喚醒標誌

if atomic.CompareAndSwapInt32(&m.state, old, new) {

runtime.Semrelease(&m.sema)

return

}

old = m.state

}

}

下面我來給你解釋一下這個方法。

第 3 行是嘗試將持有鎖的標識設定為未加鎖的狀態,這是透過減 1 而不是將標誌位置零的方式實作。第 4 到 6 行還會檢測原來鎖的狀態是否已經未加鎖的狀態,如果是 Unlock 一個未加鎖的 Mutex 會直接 panic。

不過,即使將加鎖置為未加鎖的狀態,這個方法也不能直接返回,還需要一些額外的操作,因為還可能有一些等待這個鎖的 goroutine(有時候我也把它們稱之為 waiter)需要透過訊號量的方式喚醒它們中的一個。所以接下來的邏輯有兩種情況。

第一種情況,如果沒有其它的 waiter,說明對這個鎖的競爭的 goroutine 只有一個,那就可以直接返回了;如果這個時候有喚醒的 goroutine,或者是又被別人加了鎖,那麼,無需我們操勞,其它 goroutine 自己幹得都很好,當前的這個 goroutine 就可以放心返回了。

第二種情況,如果有等待者,並且沒有喚醒的 waiter,那就需要喚醒一個等待的 waiter。在喚醒之前,需要將 waiter 數量減 1,並且將 mutexWoken 標誌設定上,這樣,Unlock 就可以返回了。

透過這樣複雜的檢查、判斷和設定,我們就可以安全地將一把互斥鎖釋放了。

相對於初版的設計,這次的改動主要就是,新來的 goroutine 也有機會先獲取到鎖,甚至一個 goroutine 可能連續獲取到鎖,打破了先來先得的邏輯。但是,程式碼複雜度也顯而易見。

雖然這一版的 Mutex 已經給新來請求鎖的 goroutine 一些機會,讓它參與競爭,沒有空閒的鎖或者競爭失敗才加入到等待佇列中。但是其實還可以進一步最佳化。我們接著往下看。

多給些機會

在 2015 年 2 月的改動中,如果新來的 goroutine 或者是被喚醒的 goroutine 首次獲取不到鎖,它們就會透過自旋(spin,透過迴圈不斷嘗試,spin 的邏輯是在runtime 實作的)的方式,嘗試檢查鎖是否被釋放。在嘗試一定的自旋次數後,再執行原來的邏輯。

func (m *Mutex) Lock() {

// Fast path: 幸運之路,正好獲取到鎖

if atomic.CompareAndSwapInt32(&m.state, 0, mutexLocked) {

return

}

awoke := false

iter := 0

for { // 不管是新來的請求鎖的goroutine, 還是被喚醒的goroutine,都不斷嘗試請求鎖

old := m.state // 先儲存當前鎖的狀態

new := old | mutexLocked // 新狀態設定加鎖標誌

if old&mutexLocked != 0 { // 鎖還沒被釋放

if runtime_canSpin(iter) { // 還可以自旋

if !awoke && old&mutexWoken == 0 && old>>mutexWaiterShift != 0 &&

atomic.CompareAndSwapInt32(&m.state, old, old|mutexWoken) {

awoke = true

}

runtime_doSpin()

iter++

continue // 自旋,再次嘗試請求鎖

}

new = old + 1<<mutexWaiterShift

}

if awoke { // 喚醒狀態

if new&mutexWoken == 0 {

panic("sync: inconsistent mutex state")

}

new &^= mutexWoken // 新狀態清除喚醒標記

}

if atomic.CompareAndSwapInt32(&m.state, old, new) {

if old&mutexLocked == 0 { // 舊狀態鎖已釋放,新狀態成功持有了鎖,直接返回

break

}

runtime_Semacquire(&m.sema) // 阻塞等待

awoke = true // 被喚醒

iter = 0

}

}

}

這次的最佳化,增加了第 13 行到 21 行、第 25 行到第 27 行以及第 36 行。我來解釋一下主要的邏輯,也就是第 13 行到 21 行。

如果可以 spin 的話,第 9 行的 for 迴圈會重新檢查鎖是否釋放。對於臨界區程式碼執行非常短的場景來說,這是一個非常好的最佳化。因為臨界區的程式碼耗時很短,鎖很快就能釋放,而搶奪鎖的 goroutine 不用透過休眠喚醒方式等待排程,直接 spin 幾次,可能就獲得了鎖。

解決飢餓

經過幾次最佳化,Mutex 的程式碼越來越複雜,應對高併發爭搶鎖的場景也更加公平。但是你有沒有想過,因為新來的 goroutine 也參與競爭,有可能每次都會被新來的 goroutine 搶到獲取鎖的機會,在極端情況下,等待中的 goroutine 可能會一直獲取不到鎖,這就是飢餓問題。

說到這兒,我突然想到了最近看到的一種叫做鸛的鳥。如果鸛媽媽尋找食物很艱難,找到的食物只夠一個幼鳥吃的,鸛媽媽就會把食物給最強壯的一隻,這樣一來,飢餓弱小的幼鳥總是得不到食物吃,最後就會被啄出巢去。

先前版本的 Mutex 遇到的也是同樣的困境,“悲慘”的 goroutine 總是得不到鎖。

Mutex 不能容忍這種事情發生。所以,2016 年 Go 1.9 中 Mutex 增加了飢餓模式,讓鎖變得更公平,不公平的等待時間限制在 1 毫秒,並且修復了一個大 Bug:總是把喚醒的 goroutine 放在等待佇列的尾部,會導致更加不公平的等待時間。

之後,2018 年,Go 開發者將 fast path 和 slow path 拆成獨立的方法,以便內聯,提高效能。2019 年也有一個 Mutex 的最佳化,雖然沒有對 Mutex 做修改,但是,對於 Mutex 喚醒後持有鎖的那個 waiter,排程器可以有更高的優先順序去執行,這已經是很細緻的效能優化了。

為了避免程式碼過多,這裡只列出當前的 Mutex 實作。想要理解當前的 Mutex,我們需要好好泡一杯茶,仔細地品一品了。

當然,現在的 Mutex 程式碼已經複雜得接近不可讀的狀態了,而且程式碼也非常長,刪減後佔了幾乎三頁紙。但是,作為第一個要詳細介紹的同步原語,我還是希望能更清楚地剖析 Mutex 的實作,向你展示它的演化和為了一個貌似很小的 feature 不得不將程式碼變得非常複雜的原因。

當然,你也可以暫時略過這一段,以後慢慢品,只需要記住,Mutex 絕不容忍一個 goroutine 被落下,永遠沒有機會獲取鎖。不拋棄不放棄是它的宗旨,而且它也儘可能地讓等待較長的 goroutine 更有機會獲取到鎖。

type Mutex struct {

state int32

sema uint32

}

const (

mutexLocked = 1 << iota // mutex is locked

mutexWoken

mutexStarving // 從state欄位中分出一個飢餓標記

mutexWaiterShift = iota

starvationThresholdNs = 1e6

)

func (m *Mutex) Lock() {

// Fast path: 幸運之路,一下就獲取到了鎖

if atomic.CompareAndSwapInt32(&m.state, 0, mutexLocked) {

return

}

// Slow path:緩慢之路,嘗試自旋競爭或飢餓狀態下飢餓goroutine競爭

m.lockSlow()

}

func (m *Mutex) lockSlow() {

var waitStartTime int64

starving := false // 此goroutine的飢餓標記

awoke := false // 喚醒標記

iter := 0 // 自旋次數

old := m.state // 當前的鎖的狀態

for {

// 鎖是非飢餓狀態,鎖還沒被釋放,嘗試自旋

if old&(mutexLocked|mutexStarving) == mutexLocked && runtime_canSpin(iter) {

if !awoke && old&mutexWoken == 0 && old>>mutexWaiterShift != 0 &&

atomic.CompareAndSwapInt32(&m.state, old, old|mutexWoken) {

awoke = true

}

runtime_doSpin()

iter++

old = m.state // 再次獲取鎖的狀態,之後會檢查是否鎖被釋放了

continue

}

new := old

if old&mutexStarving == 0 {

new |= mutexLocked // 非飢餓狀態,加鎖

}

if old&(mutexLocked|mutexStarving) != 0 {

new += 1 << mutexWaiterShift // waiter數量加1

}

if starving && old&mutexLocked != 0 {

new |= mutexStarving // 設定飢餓狀態

}

if awoke {

if new&mutexWoken == 0 {

throw("sync: inconsistent mutex state")

}

new &^= mutexWoken // 新狀態清除喚醒標記

}

// 成功設定新狀態

if atomic.CompareAndSwapInt32(&m.state, old, new) {

// 原來鎖的狀態已釋放,並且不是飢餓狀態,正常請求到了鎖,返回

if old&(mutexLocked|mutexStarving) == 0 {

break // locked the mutex with CAS

}

// 處理飢餓狀態

// 如果以前就在佇列裡面,加入到佇列頭

queueLifo := waitStartTime != 0

if waitStartTime == 0 {

waitStartTime = runtime_nanotime()

}

// 阻塞等待

runtime_SemacquireMutex(&m.sema, queueLifo, 1)

// 喚醒之後檢查鎖是否應該處於飢餓狀態

starving = starving || runtime_nanotime()-waitStartTime > starvationThresholdNs

old = m.state

// 如果鎖已經處於飢餓狀態,直接搶到鎖,返回

if old&mutexStarving != 0 {

if old&(mutexLocked|mutexWoken) != 0 || old>>mutexWaiterShift == 0 {

throw("sync: inconsistent mutex state")

}

// 有點繞,加鎖並且將waiter數減1

delta := int32(mutexLocked - 1<<mutexWaiterShift)

if !starving || old>>mutexWaiterShift == 1 {

delta -= mutexStarving // 最後一個waiter或者已經不飢餓了,清除飢餓標記

}

atomic.AddInt32(&m.state, delta)

break

}

awoke = true

iter = 0

} else {

old = m.state

}

}

}

func (m *Mutex) Unlock() {

// Fast path: drop lock bit.

new := atomic.AddInt32(&m.state, -mutexLocked)

if new != 0 {

m.unlockSlow(new)

}

}

func (m *Mutex) unlockSlow(new int32) {

if (new+mutexLocked)&mutexLocked == 0 {

throw("sync: unlock of unlocked mutex")

}

if new&mutexStarving == 0 {

old := new

for {

if old>>mutexWaiterShift == 0 || old&(mutexLocked|mutexWoken|mutexStarving) != 0 {

return

}

new = (old - 1<<mutexWaiterShift) | mutexWoken

if atomic.CompareAndSwapInt32(&m.state, old, new) {

runtime_Semrelease(&m.sema, false, 1)

return

}

old = m.state

}

} else {

runtime_Semrelease(&m.sema, true, 1)

}

}

跟之前的實作相比,當前的 Mutex 最重要的變化,就是增加飢餓模式。第 12 行將飢餓模式的最大等待時間閾值設定成了 1 毫秒,這就意味著,一旦等待者等待的時間超過了這個閾值,Mutex 的處理就有可能進入飢餓模式,優先讓等待者先獲取到鎖,新來的同學主動謙讓一下,給老同志一些機會。

透過加入飢餓模式,可以避免把機會全都留給新來的 goroutine,保證了請求鎖的 goroutine 獲取鎖的公平性,對於我們使用鎖的業務程式碼來說,不會有業務一直等待鎖不被處理。

那麼,接下來的部分就是選學內容了。如果你還有精力,並且對飢餓模式很感興趣,那就跟著我一起繼續來挑戰吧。如果你現在理解起來覺得有困難,也沒關係,後面可以隨時回來複習。

飢餓模式和正常模式

Mutex 可能處於兩種操作模式下:正常模式和飢餓模式。

接下來我們分析一下 Mutex 對飢餓模式和正常模式的處理。

請求鎖時呼叫的 Lock 方法中一開始是 fast path,這是一個幸運的場景,當前的 goroutine 幸運地獲得了鎖,沒有競爭,直接返回,否則就進入了 lockSlow 方法。這樣的設計,方便編譯器對 Lock 方法進行內聯,你也可以在程式開發中應用這個技巧。

正常模式下,waiter 都是進入先入先出佇列,被喚醒的 waiter 並不會直接持有鎖,而是要和新來的 goroutine 進行競爭。新來的 goroutine 有先天的優勢,它們正在 CPU 中執行,可能它們的數量還不少,所以,在高併發情況下,被喚醒的 waiter 可能比較悲劇地獲取不到鎖,這時,它會被插入到佇列的前面。如果 waiter 獲取不到鎖的時間超過閾值 1 毫秒,那麼,這個 Mutex 就進入到了飢餓模式。

在飢餓模式下,Mutex 的擁有者將直接把鎖交給佇列最前面的 waiter。新來的 goroutine 不會嘗試獲取鎖,即使看起來鎖沒有被持有,它也不會去搶,也不會 spin,它會乖乖地加入到等待佇列的尾部。

如果擁有 Mutex 的 waiter 發現下面兩種情況的其中之一,它就會把這個 Mutex 轉換成正常模式:

- 此 waiter 已經是佇列中的最後一個 waiter 了,沒有其它的等待鎖的 goroutine 了;

- 此 waiter 的等待時間小於 1 毫秒。

正常模式擁有更好的效能,因為即使有等待搶鎖的 waiter,goroutine 也可以連續多次獲取到鎖。

飢餓模式是對公平性和效能的一種平衡,它避免了某些 goroutine 長時間的等待鎖。在飢餓模式下,優先對待的是那些一直在等待的 waiter。

接下來,我們逐步分析下 Mutex 程式碼的關鍵行,徹底搞清楚飢餓模式的細節。

我們從請求鎖(lockSlow)的邏輯看起。

第 9 行對 state 欄位又分出了一位,用來標記鎖是否處於飢餓狀態。現在一個 state 的欄位被劃分成了阻塞等待的 waiter 數量、飢餓標記、喚醒標記和持有鎖的標記四個部分。

第 25 行記錄此 goroutine 請求鎖的初始時間,第 26 行標記是否處於飢餓狀態,第 27 行標記是否是喚醒的,第 28 行記錄 spin 的次數。

第 31 行到第 40 行和以前的邏輯類似,只不過加了一個不能是飢餓狀態的邏輯。它會對正常狀態搶奪鎖的 goroutine 嘗試 spin,和以前的目的一樣,就是在臨界區耗時很短的情況下提高效能。

第 42 行到第 44 行,非飢餓狀態下搶鎖。怎麼搶?就是要把 state 的鎖的那一位,置為加鎖狀態,後續 CAS 如果成功就可能獲取到了鎖。

第 46 行到第 48 行,如果鎖已經被持有或者鎖處於飢餓狀態,我們最好的歸宿就是等待,所以 waiter 的數量加 1。

第 49 行到第 51 行,如果此 goroutine 已經處在飢餓狀態,並且鎖還被持有,那麼,我們需要把此 Mutex 設定為飢餓狀態。

第 52 行到第 57 行,是清除 mutexWoken 標記,因為不管是獲得了鎖還是進入休眠,我們都需要清除 mutexWoken 標記。

第 59 行就是嘗試使用 CAS 設定 state。如果成功,第 61 行到第 63 行是檢查原來的鎖的狀態是未加鎖狀態,並且也不是飢餓狀態的話就成功獲取了鎖,返回。

第 67 行判斷是否第一次加入到 waiter 佇列。到這裡,你應該就能明白第 25 行為什麼不對 waitStartTime 進行初始化了,我們需要利用它在這裡進行條件判斷。

第 72 行將此 waiter 加入到佇列,如果是首次,加入到隊尾,先進先出。如果不是首次,那麼加入到隊首,這樣等待最久的 goroutine 優先能夠獲取到鎖。此 goroutine 會進行休眠。

第 74 行判斷此 goroutine 是否處於飢餓狀態。注意,執行這一句的時候,它已經被喚醒了。

第 77 行到第 88 行是對鎖處於飢餓狀態下的一些處理。

第 82 行設定一個標誌,這個標誌稍後會用來加鎖,而且還會將 waiter 數減 1。

第 84 行,設定標誌,在沒有其它的 waiter 或者此 goroutine 等待還沒超過 1 毫秒,則會將 Mutex 轉為正常狀態。

第 86 行則是將這個標識應用到 state 欄位上。

釋放鎖(Unlock)時呼叫的 Unlock 的 fast path 不用多少,所以我們主要看 unlockSlow 方法就行。

如果 Mutex 處於飢餓狀態,第 123 行直接喚醒等待佇列中的 waiter。

如果 Mutex 處於正常狀態,如果沒有 waiter,或者已經有在處理的情況了,那麼釋放就好,不做額外的處理(第 112 行到第 114 行)。

否則,waiter 數減 1,mutexWoken 標誌設定上,透過 CAS 更新 state 的值(第 115 行到第 119 行)。

總結

“羅馬不是一天建成的”,Mutex 的設計也是從簡單設計到複雜處理逐漸演變的。初版的 Mutex 設計非常簡潔,充分展示了 Go 創始者的簡單、簡潔的設計哲學。但是,隨著大家的使用,逐漸暴露出一些缺陷,為了彌補這些缺陷,Mutex 不得不越來越複雜。

有一點值得我們學習的,同時也體現了 Go 創始者的哲學,就是他們強調 GO 語言和標準庫的穩定性,新版本要向下相容,用新的版本總能編譯老的程式碼。Go 語言從出生到現在已經 10 多年了,這個 Mutex 對外的介面卻沒有變化,依然向下相容,即使現在 Go 出了兩個版本,每個版本也會向下相容,保持 Go 語言的穩定性,你也能領悟他們軟體開發和設計的思想。

還有一點,你也可以觀察到,為了一個程式 20% 的特性,你可能需要新增 80% 的程式碼,這也是程式越來越複雜的原因。所以,最開始的時候,如果能夠有一個清晰而且易於擴充套件的設計,未來增加新特性時,也會更加方便。

思考題

最後,給你留兩個小問題:

- 目前 Mutex 的 state 欄位有幾個意義,這幾個意義分別是由哪些欄位表示的?

- 等待一個 Mutex 的 goroutine 數最大是多少?是否能滿足現實的需求?

歡迎在留言區寫下你的思考和答案,我們一起交流討論。如果你覺得有所收穫,也歡迎你把今天的內容分享給你的朋友或同事。

03|Mutex:4種易錯場景大盤點

你好,我是鳥窩。

本章導讀

Mutex 常見踩坑(問題定位圖)

┌────────────────┐

│ Lock / Unlock 使用 │

└───────┬────────┘

│

┌─────┼───────────────┬───────────────┬──────────────┐

▼ ▼ ▼ ▼ ▼

忘記解鎖 重複解鎖 重入鎖死鎖 複製已使用 Mutex 鎖範圍過大

│ │ │ │ │

└───────┴───────┬───────┴───────┬───────┴───────┬──────┘

▼ ▼ ▼

卡住/ panic 行為異常 效能下降/難除錯

上一講,我帶你一起領略了 Mutex 的架構演進之美,現在我們已經清楚 Mutex 的實作細節了。當前 Mutex 的實作貌似非常複雜,其實主要還是針對飢餓模式和公平性問題,做了一些額外處理。但是,我們在第一講中已經體驗過了,Mutex 使用起來還是非常簡單的,畢竟,它只有 Lock 和 Unlock 兩個方法,使用起來還能複雜到哪裡去?

正常使用 Mutex 時,確實是這樣的,很簡單,基本不會有什麼錯誤,即使出現錯誤,也是在一些複雜的場景中,比如跨函式呼叫 Mutex 或者是在重構或者修補 Bug 時誤操作。但是,我們使用 Mutex 時,確實會出現一些 Bug,比如說忘記釋放鎖、重入鎖、複製已使用了的 Mutex 等情況。那在這一講中,我們就一起來看看使用 Mutex 常犯的幾個錯誤,做到“Bug 提前知,後面早防範”。

常見的 4 種錯誤場景

我總結了一下,使用 Mutex 常見的錯誤場景有 4 類,分別是 Lock/Unlock 不是成對出現、Copy 已使用的 Mutex、重入和死鎖。下面我們一一來看。

Lock/Unlock 不是成對出現

Lock/Unlock 沒有成對出現,就意味著會出現死鎖的情況,或者是因為 Unlock 一個未加鎖的 Mutex 而導致 panic。

我們先來看看缺少 Unlock 的場景,常見的有三種情況:

- 程式碼中有太多的 if-else 分支,可能在某個分支中漏寫了 Unlock;

- 在重構的時候把 Unlock 給刪除了;

- Unlock 誤寫成了 Lock。

在這種情況下,鎖被獲取之後,就不會被釋放了,這也就意味著,其它的 goroutine 永遠都沒機會獲取到鎖。

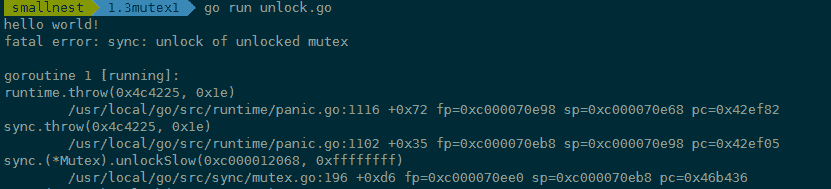

我們再來看缺少 Lock 的場景,這就很簡單了,一般來說就是誤操作刪除了 Lock。 比如先前使用 Mutex 都是正常的,結果後來其他人重構程式碼的時候,由於對程式碼不熟悉,或者由於開發者的馬虎,把 Lock 呼叫給刪除了,或者註釋掉了。比如下面的程式碼,mu.Lock() 一行程式碼被刪除了,直接 Unlock 一個未加鎖的 Mutex 會 panic:

func foo() {

var mu sync.Mutex

defer mu.Unlock()

fmt.Println("hello world!")

}

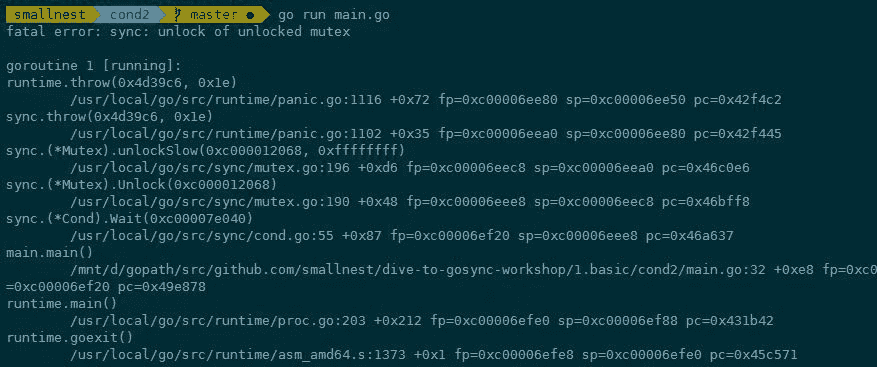

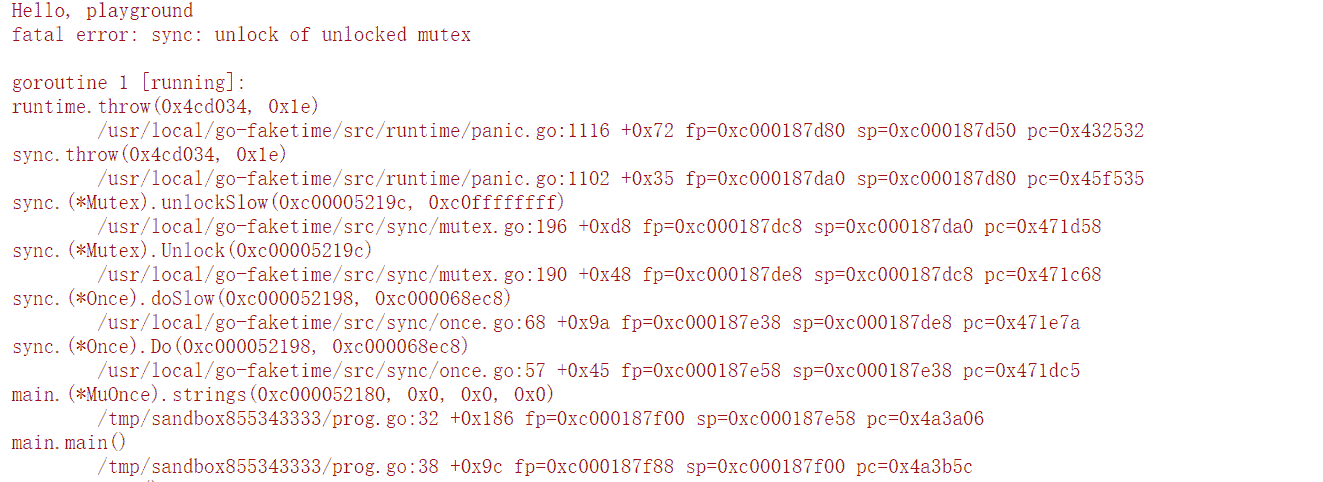

執行的時候 panic:

Copy 已使用的 Mutex

第二種誤用是 Copy 已使用的 Mutex。在正式分析這個錯誤之前,我先交代一個小知識點,那就是 Package sync 的同步原語在使用後是不能複製的。我們知道 Mutex 是最常用的一個同步原語,那它也是不能複製的。為什麼呢?

原因在於,Mutex 是一個有狀態的物件,它的 state 欄位記錄這個鎖的狀態。如果你要複製一個已經加鎖的 Mutex 給一個新的變數,那麼新的剛初始化的變數居然被加鎖了,這顯然不符合你的期望,因為你期望的是一個零值的 Mutex。關鍵是在併發環境下,你根本不知道要複製的 Mutex 狀態是什麼,因為要複製的 Mutex 是由其它 goroutine 併發訪問的,狀態可能總是在變化。

當然,你可能說,你說的我都懂,你的警告我都記下了,但是實際在使用的時候,一不小心就踩了這個坑,我們來看一個例子。

type Counter struct {

sync.Mutex

Count int

}

func main() {

var c Counter

c.Lock()

defer c.Unlock()

c.Count++

foo(c) // 複製鎖

}

// 這裡Counter的引數是透過複製的方式傳入的

func foo(c Counter) {

c.Lock()

defer c.Unlock()

fmt.Println("in foo")

}

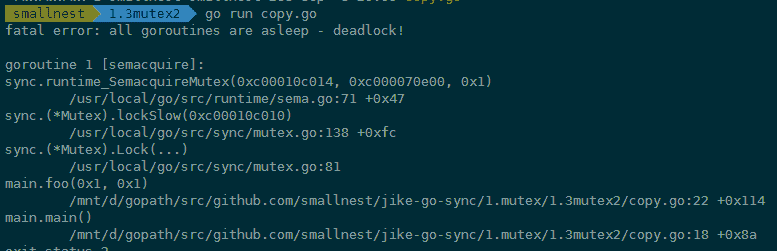

第 12 行在呼叫 foo 函式的時候,呼叫者會複製 Mutex 變數 c 作為 foo 函式的引數,不幸的是,複製之前已經使用了這個鎖,這就導致,複製的 Counter 是一個帶狀態 Counter。

怎麼辦呢?Go 在執行時,有死鎖的檢查機制(checkdead() 方法),它能夠發現死鎖的 goroutine。這個例子中因為複製了一個使用了的 Mutex,導致鎖無法使用,程式處於死鎖的狀態。程式執行的時候,死鎖檢查機制能夠發現這種死鎖情況並輸出錯誤資訊,如下圖中錯誤資訊以及錯誤堆疊:

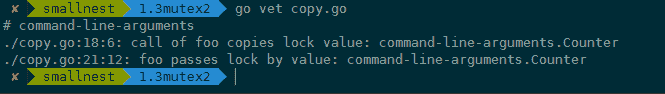

你肯定不想執行的時候才發現這個因為複製 Mutex 導致的死鎖問題,那麼你怎麼能夠及時發現問題呢?可以使用 vet 工具,把檢查寫在 Makefile 檔案中,在持續整合的時候跑一跑,這樣可以及時發現問題,及時修復。我們可以使用 go vet 檢查這個 Go 檔案:

你看,使用這個工具就可以發現 Mutex 複製的問題,錯誤資訊顯示得很清楚,是在呼叫 foo 函式的時候發生了 lock value 複製的情況,還告訴我們出問題的程式碼行數以及 copy lock 導致的錯誤。

那麼,vet 工具是怎麼發現 Mutex 複製使用問題的呢?我帶你簡單分析一下。

檢查是透過copylock分析器靜態分析實作的。這個分析器會分析函式呼叫、range 遍歷、複製、宣告、函式返回值等位置,有沒有鎖的值 copy 的情景,以此來判斷有沒有問題。可以說,只要是實作了 Locker 介面,就會被分析。我們看到,下面的程式碼就是確定什麼型別會被分析,其實就是實作了 Lock/Unlock 兩個方法的 Locker 介面:

var lockerType *types.Interface

// Construct a sync.Locker interface type.

func init() {

nullary := types.NewSignature(nil, nil, nil, false) // func()

methods := []*types.Func{

types.NewFunc(token.NoPos, nil, "Lock", nullary),

types.NewFunc(token.NoPos, nil, "Unlock", nullary),

}

lockerType = types.NewInterface(methods, nil).Complete()

}

其實,有些沒有實作 Locker 介面的同步原語(比如 WaitGroup),也能被分析。我先賣個關子,後面我們會介紹這種情況是怎麼實作的。

重入

接下來,我們來討論“重入”這個問題。在說這個問題前,我先解釋一下個概念,叫“可重入鎖”。

如果你學過 Java,可能會很熟悉 ReentrantLock,就是可重入鎖,這是 Java 併發包中非常常用的一個同步原語。它的基本行為和互斥鎖相同,但是加了一些擴充套件功能。

如果你沒接觸過 Java,也沒關係,這裡只是提一下,幫助會 Java 的同學對比來學。那下面我來具體講解可重入鎖是咋回事兒。

當一個執行緒獲取鎖時,如果沒有其它執行緒擁有這個鎖,那麼,這個執行緒就成功獲取到這個鎖。之後,如果其它執行緒再請求這個鎖,就會處於阻塞等待的狀態。但是,如果擁有這把鎖的執行緒再請求這把鎖的話,不會阻塞,而是成功返回,所以叫可重入鎖(有時候也叫做遞迴鎖)。只要你擁有這把鎖,你可以可著勁兒地呼叫,比如透過遞迴實作一些演算法,呼叫者不會阻塞或者死鎖。

瞭解了可重入鎖的概念,那我們來看 Mutex 使用的錯誤場景。劃重點了:Mutex 不是可重入的鎖。

想想也不奇怪,因為 Mutex 的實作中沒有記錄哪個 goroutine 擁有這把鎖。理論上,任何 goroutine 都可以隨意地 Unlock 這把鎖,所以沒辦法計算重入條件,畢竟,“臣妾做不到啊”!

所以,一旦誤用 Mutex 的重入,就會導致報錯。下面是一個誤用 Mutex 的重入例子:

func foo(l sync.Locker) {

fmt.Println("in foo")

l.Lock()

bar(l)

l.Unlock()

}

func bar(l sync.Locker) {

l.Lock()

fmt.Println("in bar")

l.Unlock()

}

func main() {

l := &sync.Mutex{}

foo(l)

}

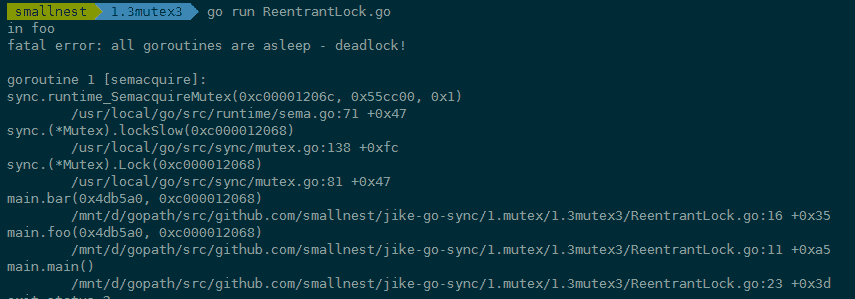

寫完這個 Mutex 重入的例子後,執行一下,你會發現類似下面的錯誤。程式一直在請求鎖,但是一直沒有辦法獲取到鎖,結果就是 Go 執行時發現死鎖了,沒有其它地方能夠釋放鎖讓程式執行下去,你透過下面的錯誤堆疊資訊就能定位到哪一行阻塞請求鎖:

學到這裡,你可能要問了,雖然標準庫 Mutex 不是可重入鎖,但是如果我就是想要實作一個可重入鎖,可以嗎?

可以,那我們就自己實作一個。這裡的關鍵就是,實作的鎖要能記住當前是哪個 goroutine 持有這個鎖。我來提供兩個方案。

- 方案一:透過 hacker 的方式獲取到 goroutine id,記錄下獲取鎖的 goroutine id,它可以實作 Locker 介面。

- 方案二:呼叫 Lock/Unlock 方法時,由 goroutine 提供一個 token,用來標識它自己,而不是我們透過 hacker 的方式獲取到 goroutine id,但是,這樣一來,就不滿足 Locker 介面了。

可重入鎖(遞迴鎖)解決了程式碼重入或者遞迴呼叫帶來的死鎖問題,同時它也帶來了另一個好處,就是我們可以要求,只有持有鎖的 goroutine 才能 unlock 這個鎖。這也很容易實作,因為在上面這兩個方案中,都已經記錄了是哪一個 goroutine 持有這個鎖。

下面我們具體來看這兩個方案怎麼實作。

方案一:goroutine id

這個方案的關鍵第一步是獲取 goroutine id,方式有兩種,分別是簡單方式和 hacker 方式。

簡單方式,就是透過 runtime.Stack 方法獲取棧幀資訊,棧幀資訊裡包含 goroutine id。你可以看看上面 panic 時候的貼圖,goroutine id 明明白白地顯示在那裡。runtime.Stack 方法可以獲取當前的 goroutine 資訊,第二個引數為 true 會輸出所有的 goroutine 資訊,資訊的格式如下:

goroutine 1 [running]:

main.main()

....../main.go:19 +0xb1

第一行格式為 goroutine xxx,其中 xxx 就是 goroutine id,你只要解析出這個 id 即可。解析的方法可以採用下面的程式碼:

func GoID() int {

var buf [64]byte

n := runtime.Stack(buf[:], false)

// 得到id字串

idField := strings.Fields(strings.TrimPrefix(string(buf[:n]), "goroutine "))[0]

id, err := strconv.Atoi(idField)

if err != nil {

panic(fmt.Sprintf("cannot get goroutine id: %v", err))

}

return id

}

瞭解了簡單方式,接下來我們來看 hacker 的方式,這也是我們方案一採取的方式。

首先,我們獲取執行時的 g 指標,反解出對應的 g 的結構。每個執行的 goroutine 結構的 g 指標儲存在當前 goroutine 的一個叫做 TLS 物件中。

第一步:我們先獲取到 TLS 物件;

第二步:再從 TLS 中獲取 goroutine 結構的 g 指標;

第三步:再從 g 指標中取出 goroutine id。

需要注意的是,不同 Go 版本的 goroutine 的結構可能不同,所以需要根據 Go 的不同版本進行調整。當然了,如果想要搞清楚各個版本的 goroutine 結構差異,所涉及的內容又過於底層而且複雜,學習成本太高。怎麼辦呢?我們可以重點關注一些庫。我們沒有必要重複發明輪子,直接使用第三方的庫來獲取 goroutine id 就可以了。

好訊息是現在已經有很多成熟的方法了,可以支援多個 Go 版本的 goroutine id,給你推薦一個常用的庫:petermattis/goid。

知道了如何獲取 goroutine id,接下來就是最後的關鍵一步了,我們實作一個可以使用的可重入鎖:

// RecursiveMutex 包裝一個Mutex,實作可重入

type RecursiveMutex struct {

sync.Mutex

owner int64 // 當前持有鎖的goroutine id

recursion int32 // 這個goroutine 重入的次數

}

func (m *RecursiveMutex) Lock() {

gid := goid.Get()

// 如果當前持有鎖的goroutine就是這次呼叫的goroutine,說明是重入

if atomic.LoadInt64(&m.owner) == gid {

m.recursion++

return

}

m.Mutex.Lock()

// 獲得鎖的goroutine第一次呼叫,記錄下它的goroutine id,呼叫次數加1

atomic.StoreInt64(&m.owner, gid)

m.recursion = 1

}

func (m *RecursiveMutex) Unlock() {

gid := goid.Get()

// 非持有鎖的goroutine嘗試釋放鎖,錯誤的使用

if atomic.LoadInt64(&m.owner) != gid {

panic(fmt.Sprintf("wrong the owner(%d): %d!", m.owner, gid))

}

// 呼叫次數減1

m.recursion--

if m.recursion != 0 { // 如果這個goroutine還沒有完全釋放,則直接返回

return

}

// 此goroutine最後一次呼叫,需要釋放鎖

atomic.StoreInt64(&m.owner, -1)

m.Mutex.Unlock()

}

上面這段程式碼你可以拿來即用。我們一起來看下這個實作,真是非常巧妙,它相當於給 Mutex 打一個補丁,解決了記錄鎖的持有者的問題。可以看到,我們用 owner 欄位,記錄當前鎖的擁有者 goroutine 的 id;recursion 是輔助欄位,用於記錄重入的次數。

有一點,我要提醒你一句,儘管擁有者可以多次呼叫 Lock,但是也必須呼叫相同次數的 Unlock,這樣才能把鎖釋放掉。這是一個合理的設計,可以保證 Lock 和 Unlock 一一對應。

方案二:token

方案一是用 goroutine id 做 goroutine 的標識,我們也可以讓 goroutine 自己來提供標識。不管怎麼說,Go 開發者不期望你利用 goroutine id 做一些不確定的東西,所以,他們沒有暴露獲取 goroutine id 的方法。

下面的程式碼是第二種方案。呼叫者自己提供一個 token,獲取鎖的時候把這個 token 傳入,釋放鎖的時候也需要把這個 token 傳入。透過使用者傳入的 token 替換方案一中 goroutine id,其它邏輯和方案一一致。

// Token方式的遞迴鎖

type TokenRecursiveMutex struct {

sync.Mutex

token int64

recursion int32

}

// 請求鎖,需要傳入token

func (m *TokenRecursiveMutex) Lock(token int64) {

if atomic.LoadInt64(&m.token) == token { //如果傳入的token和持有鎖的token一致,說明是遞迴呼叫

m.recursion++

return

}

m.Mutex.Lock() // 傳入的token不一致,說明不是遞迴呼叫

// 搶到鎖之後記錄這個token

atomic.StoreInt64(&m.token, token)

m.recursion = 1

}

// 釋放鎖

func (m *TokenRecursiveMutex) Unlock(token int64) {

if atomic.LoadInt64(&m.token) != token { // 釋放其它token持有的鎖

panic(fmt.Sprintf("wrong the owner(%d): %d!", m.token, token))

}

m.recursion-- // 當前持有這個鎖的token釋放鎖

if m.recursion != 0 { // 還沒有回退到最初的遞迴呼叫

return

}

atomic.StoreInt64(&m.token, 0) // 沒有遞迴呼叫了,釋放鎖

m.Mutex.Unlock()

}

死鎖接下來,我們來看第四種錯誤場景:死鎖。

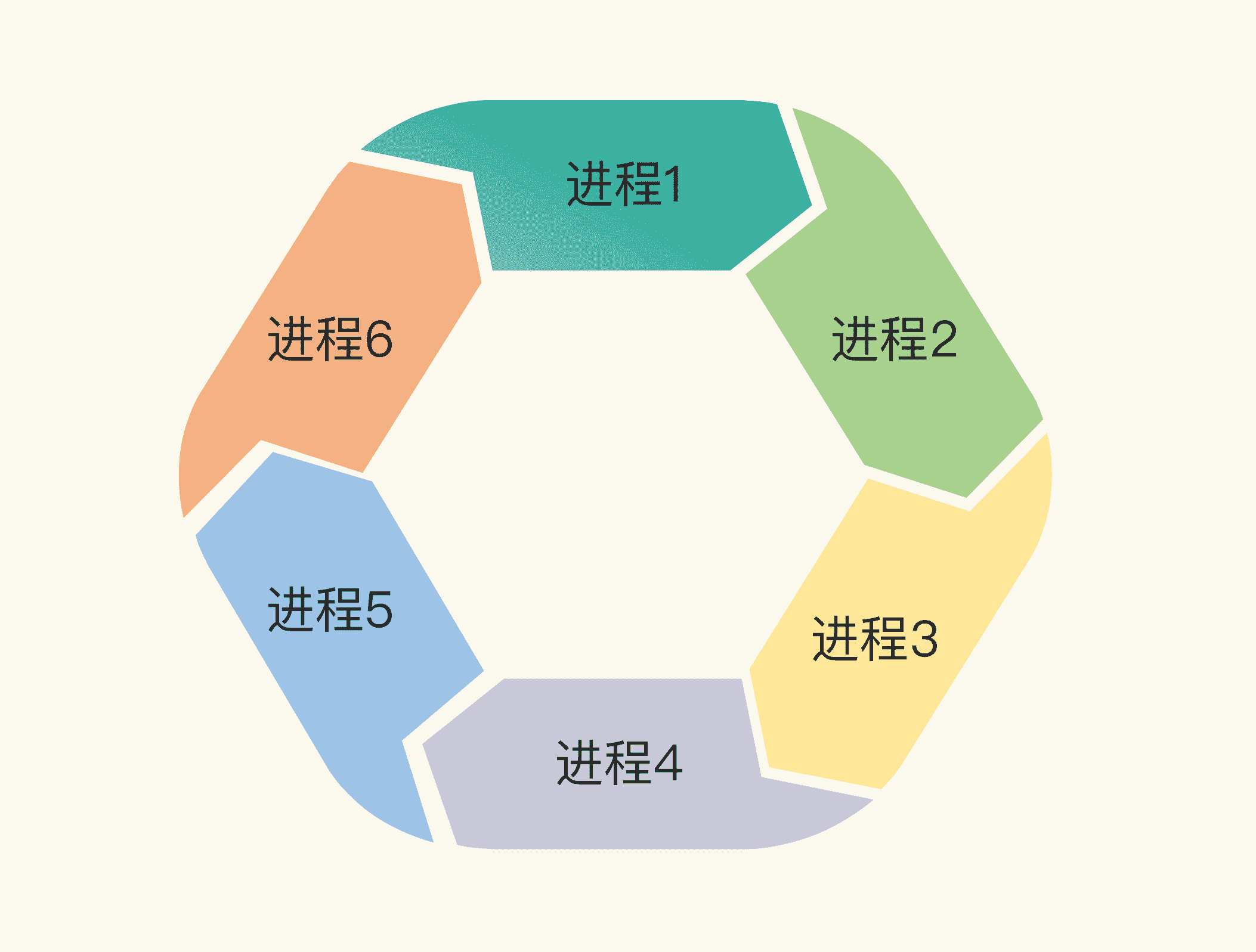

我先解釋下什麼是死鎖。兩個或兩個以上的程式(或執行緒,goroutine)在執行過程中,因爭奪共享資源而處於一種互相等待的狀態,如果沒有外部干涉,它們都將無法推進下去,此時,我們稱系統處於死鎖狀態或系統產生了死鎖。

我們來分析一下死鎖產生的必要條件。如果你想避免死鎖,只要破壞這四個條件中的一個或者幾個,就可以了。

- 互斥: 至少一個資源是被排他性獨享的,其他執行緒必須處於等待狀態,直到資源被釋放。

- 持有和等待:goroutine 持有一個資源,並且還在請求其它 goroutine 持有的資源,也就是咱們常說的“吃著碗裡,看著鍋裡”的意思。

- 不可剝奪:資源只能由持有它的 goroutine 來釋放。

- 環路等待:一般來說,存在一組等待程式,P={P1,P2,…,PN},P1 等待 P2 持有的資源,P2 等待 P3 持有的資源,依此類推,最後是 PN 等待 P1 持有的資源,這就形成了一個環路等待的死結。

你看,死鎖問題還真是挺有意思的,所以有很多人研究這個事兒。一個經典的死鎖問題就是哲學家就餐問題,我不做介紹了,你可以點選連結進一步瞭解。其實,死鎖問題在現實生活中也比比皆是。

舉個例子。有一次我去派出所開證明,派出所要求物業先證明我是本物業的業主,但是,物業要我提供派出所的證明,才能給我開物業證明,結果就陷入了死鎖狀態。你可以把派出所和物業看成兩個 goroutine,派出所證明和物業證明是兩個資源,雙方都持有自己的資源而要求對方的資源,而且自己的資源自己持有,不可剝奪。

這是一個最簡單的只有兩個 goroutine 相互等待的死鎖的例子,轉化成程式碼如下:

package main

import (

"fmt"

"sync"

"time"

)

func main() {

// 派出所證明

var psCertificate sync.Mutex

// 物業證明

var propertyCertificate sync.Mutex

var wg sync.WaitGroup

wg.Add(2) // 需要派出所和物業都處理

// 派出所處理goroutine

go func() {

defer wg.Done() // 派出所處理完成

psCertificate.Lock()

defer psCertificate.Unlock()

// 檢查材料

time.Sleep(5 * time.Second)

// 請求物業的證明

propertyCertificate.Lock()

propertyCertificate.Unlock()

}()

// 物業處理goroutine

go func() {

defer wg.Done() // 物業處理完成

propertyCertificate.Lock()

defer propertyCertificate.Unlock()

// 檢查材料

time.Sleep(5 * time.Second)

// 請求派出所的證明

psCertificate.Lock()

psCertificate.Unlock()

}()

wg.Wait()

fmt.Println("成功完成")

}

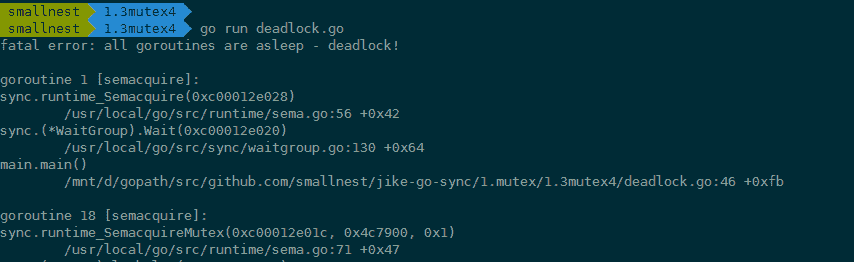

這個程式沒有辦法執行成功,因為派出所的處理和物業的處理是一個環路等待的死結。

Go 執行時,有死鎖探測的功能,能夠檢查出是否出現了死鎖的情況,如果出現了,這個時候你就需要調整策略來處理了。

你可以引入一個第三方的鎖,大家都依賴這個鎖進行業務處理,比如現在政府推行的一站式政務服務中心。或者是解決持有等待問題,物業不需要看到派出所的證明才給開物業證明,等等。

好了,到這裡,我給你講了使用 Mutex 常見的 4 類問題。你是不是覺得,哎呀,這幾類問題也太不應該了吧,真的會有人犯這麼基礎的錯誤嗎?

還真是有。雖然 Mutex 使用起來很簡單,但是,仍然可能出現使用錯誤的問題。而且,就連一些經驗豐富的開發人員,也會出現一些 Mutex 使用的問題。接下來,我就帶你圍觀幾個非常流行的 Go 開發專案,看看這些錯誤是怎麼產生和修復的。

流行的 Go 開發專案踩坑記

Docker

Docker 容器是一個開源的應用容器引擎,開發者可以以統一的方式,把他們的應用和依賴包打包到一個可移植的容器中,然後釋出到任何安裝了 docker 引擎的伺服器上。

Docker 是使用 Go 開發的,也算是 Go 的一個殺手級產品了,它的 Mutex 相關的 Bug 也不少,我們來看幾個典型的 Bug。

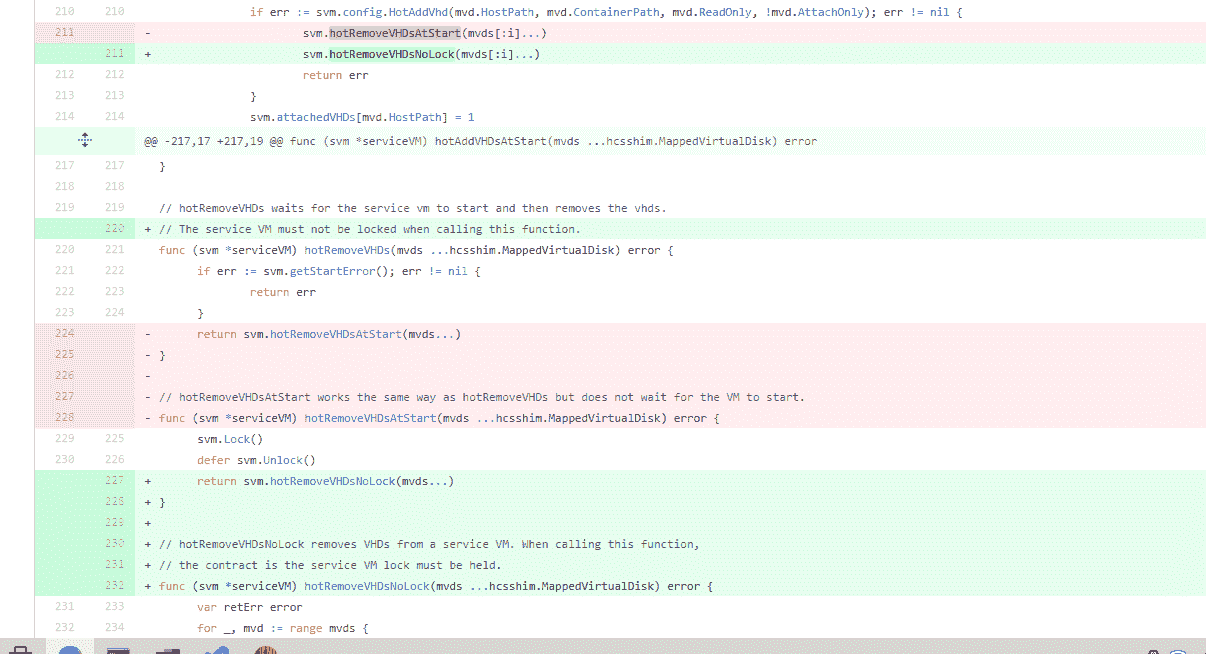

issue 36114

Docker 的issue 36114 是一個死鎖問題。

原因在於,hotAddVHDsAtStart 方法執行的時候,執行了加鎖 svm 操作。但是,在其中呼叫 hotRemoveVHDsAtStart 方法時,這個 hotRemoveVHDsAtStart 方法也是要加鎖 svm 的。很不幸,Go 標準庫中的 Mutex 是不可重入的,所以,程式碼執行到這裡,就出現了死鎖的現象。

針對這個問題,解決辦法就是,再提供一個不需要鎖的 hotRemoveVHDsNoLock 方法,避免 Mutex 的重入。

issue 34881

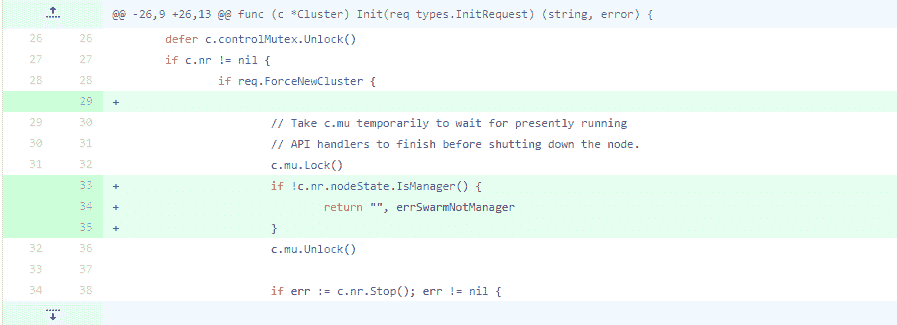

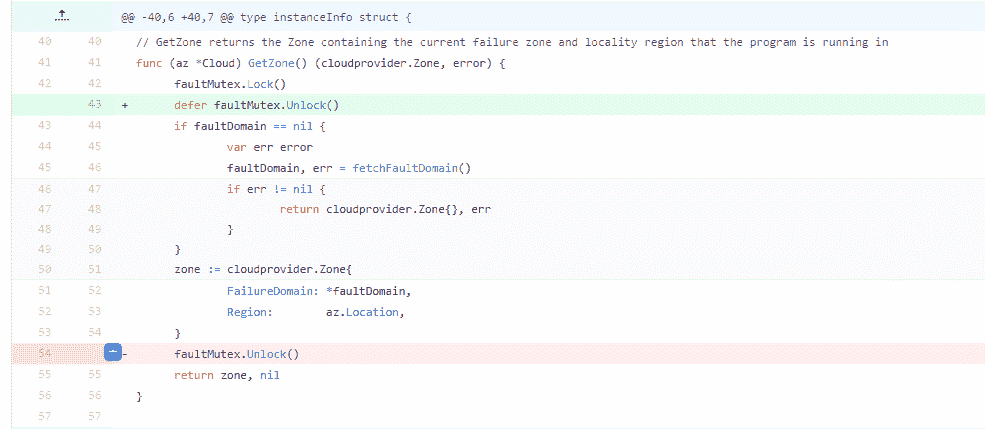

issue 34881本來是修復 Docker 的一個簡單問題,如果節點在初始化的時候,發現自己不是一個 swarm mananger,就快速返回,這個修復就幾行程式碼,你看出問題來了嗎?

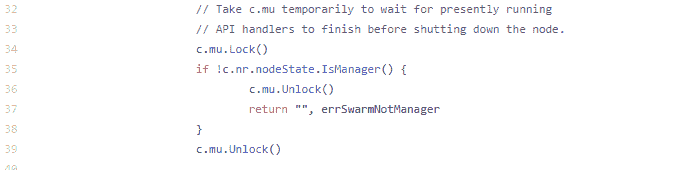

在第 34 行,節點發現不滿足條件就返回了,但是,c.mu 這個鎖沒有釋放!為什麼會出現這個問題呢?其實,這是在重構或者新增新功能的時候經常犯的一個錯誤,因為不太瞭解上下文,或者是沒有仔細看函式的邏輯,從而導致鎖沒有被釋放。現在的 Docker 當然已經沒有這個問題了。

這樣的 issue 還有很多,我就不一一列舉了。我給你推薦幾個關於 Mutex 的 issue 或者 pull request,你可以關注一下,分別是 36840、37583、35517、35482、33305、32826、30696、29554、29191、28912、26507 等。

Kubernetes

issue 72361

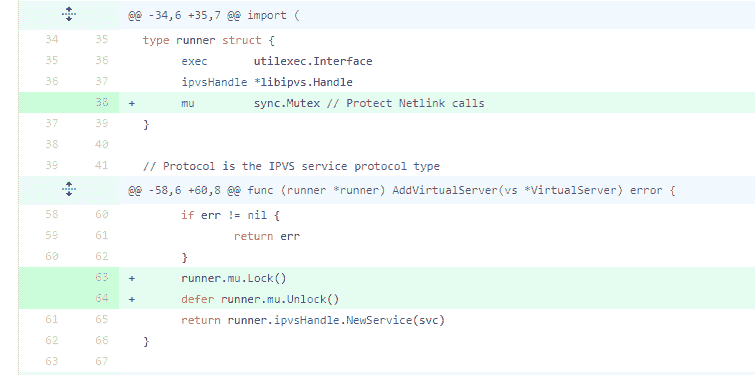

issue 72361 增加 Mutex 為了保護資源。這是為瞭解決 data race 問題而做的一個修復,修復方法也很簡單,使用互斥鎖即可,這也是我們解決 data race 時常用的方法。

issue 45192

issue 45192也是一個返回時忘記 Unlock 的典型例子,和 docker issue 34881 犯的錯誤都是一樣的。

兩大知名專案的開發者都犯了這個錯誤,所以,你就可以知道,引入這個 Bug 是多麼容易,記住晁老師這句話:保證 Lock/Unlock 成對出現,儘可能採用 defer mutex.Unlock 的方式,把它們成對、緊湊地寫在一起。

除了這些,我也建議你關注一下其它的 Mutex 相關的 issue,比如 71617、70605 等。

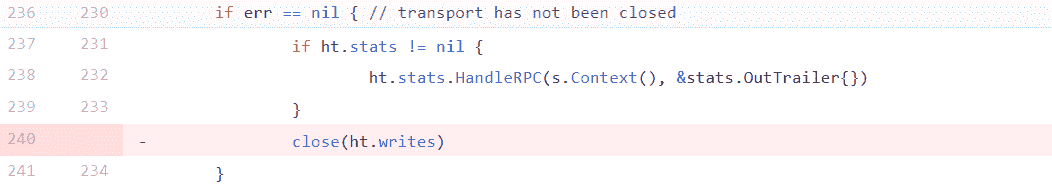

gRPC

gRPC 是 Google 發起的一個開源遠端過程呼叫 (Remote procedure call)系統。該系統基於 HTTP/2 協議傳輸,使用 Protocol Buffers 作為介面描述語言。它提供 Go 語言的實作。

即使是 Google 官方出品的系統,也有一些 Mutex 的 issue。

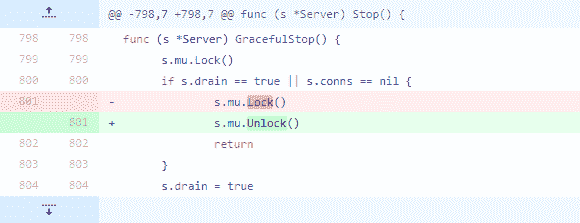

issue 795

issue 795是一個你可能想不到的 bug,那就是將 Unlock 誤寫成了 Lock。

關於這個專案,還有一些其他的為了保護共享資源而新增 Mutex 的 issue,比如 1318、2074、2542 等。

etcd

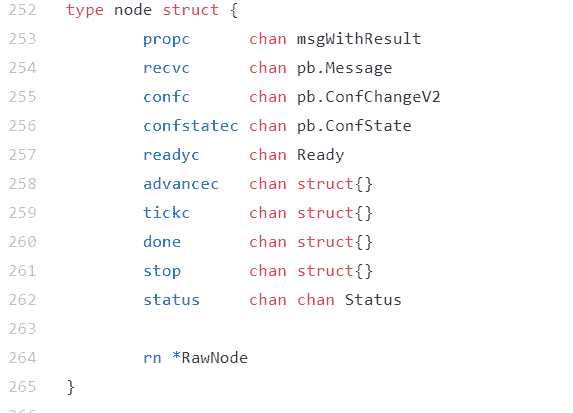

etcd 是一個非常知名的分散式一致性的 key-value 儲存技術, 被用來做配置共享和服務發現。

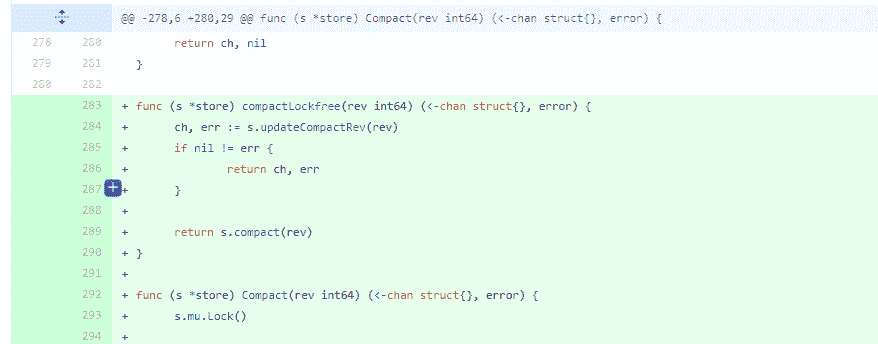

issue 10419

issue 10419是一個鎖重入導致的問題。 Store 方法內對請求了鎖,而呼叫的 Compact 的方法內又請求了鎖,這個時候,會導致死鎖,一直等待,解決辦法就是提供不需要加鎖的 Compact 方法。

總結

這節課,我們學習了 Mutex 的一些易錯場景,而且,我們還分析了流行的 Go 開源專案的錯誤,我也給你分享了我自己在開發中的經驗總結。需要強調的是,手誤和重入導致的死鎖,是最常見的使用 Mutex 的 Bug。

Go 死鎖探測工具只能探測整個程式是否因為死鎖而凍結了,不能檢測出一組 goroutine 死鎖導致的某一塊業務凍結的情況。你還可以透過 Go 執行時自帶的死鎖檢測工具,或者是第三方的工具(比如go-deadlock、go-tools)進行檢查,這樣可以儘早發現一些死鎖的問題。不過,有些時候,死鎖在某些特定情況下才會被觸發,所以,如果你的測試或者短時間的執行沒問題,不代表程式一定不會有死鎖問題。

併發程式最難跟蹤除錯的就是很難重現,因為併發問題不是按照我們指定的順序執行的,由於計算機排程的問題和事件觸發的時機不同,死鎖的 Bug 可能會在極端的情況下出現。透過搜尋日誌、檢視日誌,我們能夠知道程式有異常了,比如某個流程一直沒有結束。這個時候,可以透過 Go pprof 工具分析,它提供了一個 block profiler 監控阻塞的 goroutine。除此之外,我們還可以檢視全部的 goroutine 的堆疊資訊,透過它,你可以檢視阻塞的 groutine 究竟阻塞在哪一行哪一個物件上了。

思考題

查詢知名的資料庫系統 TiDB 的 issue,看看有沒有 Mutex 相關的 issue,看看它們都是哪些相關的 Bug。

歡迎在留言區寫下你的思考和答案,我們一起交流討論。如果你覺得有所收穫,也歡迎你把今天的內容分享給你的朋友或同事。

04| Mutex:駭客程式設計,如何拓展額外功能?

你好,我是鳥窩。

本章導讀

以 Mutex 為核心做功能擴充(包裝器概念)

┌──────────────┐ 包裝/組合 ┌─────────────────────┐

│ sync.Mutex │ ─────────────────> │ 自訂鎖型別/工具函式 │

└──────────────┘ └─────────┬───────────┘

│

┌───────────────────────────────┼──────────────────────────────┐

▼ ▼ ▼

TryLock 風格能力 超時控制/取消 統計/除錯資訊

前面三講,我們學習了互斥鎖 Mutex 的基本用法、實作原理以及易錯場景,可以說是涵蓋了互斥鎖的方方面面。如果你能熟練掌握這些內容,那麼,在大多數的開發場景中,你都可以得心應手。

但是,在一些特定的場景中,這些基礎功能是不足以應對的。這個時候,我們就需要開發一些擴充套件功能了。我來舉幾個例子。

比如說,我們知道,如果互斥鎖被某個 goroutine 獲取了,而且還沒有釋放,那麼,其他請求這把鎖的 goroutine,就會阻塞等待,直到有機會獲得這把鎖。有時候阻塞並不是一個很好的主意,比如你請求鎖更新一個計數器,如果獲取不到鎖的話沒必要等待,大不了這次不更新,我下次更新就好了,如果阻塞的話會導致業務處理能力的下降。

再比如,如果我們要監控鎖的競爭情況,一個監控指標就是,等待這把鎖的 goroutine 數量。我們可以把這個指標推送到時間序列資料庫中,再透過一些監控系統(比如 Grafana)展示出來。要知道,鎖是效能下降的“罪魁禍首”之一,所以,有效地降低鎖的競爭,就能夠很好地提高效能。因此,監控關鍵互斥鎖上等待的 goroutine 的數量,是我們分析鎖競爭的激烈程度的一個重要指標。

實際上,不論是不希望鎖的 goroutine 繼續等待,還是想監控鎖,我們都可以基於標準庫中 Mutex 的實作,透過 Hacker 的方式,為 Mutex 增加一些額外的功能。這節課,我就來教你實作幾個擴充套件功能,包括實作 TryLock,獲取等待者的數量等指標,以及實作一個執行緒安全的佇列。

TryLock

我們可以為 Mutex 新增一個 TryLock 的方法,也就是嘗試獲取排外鎖。

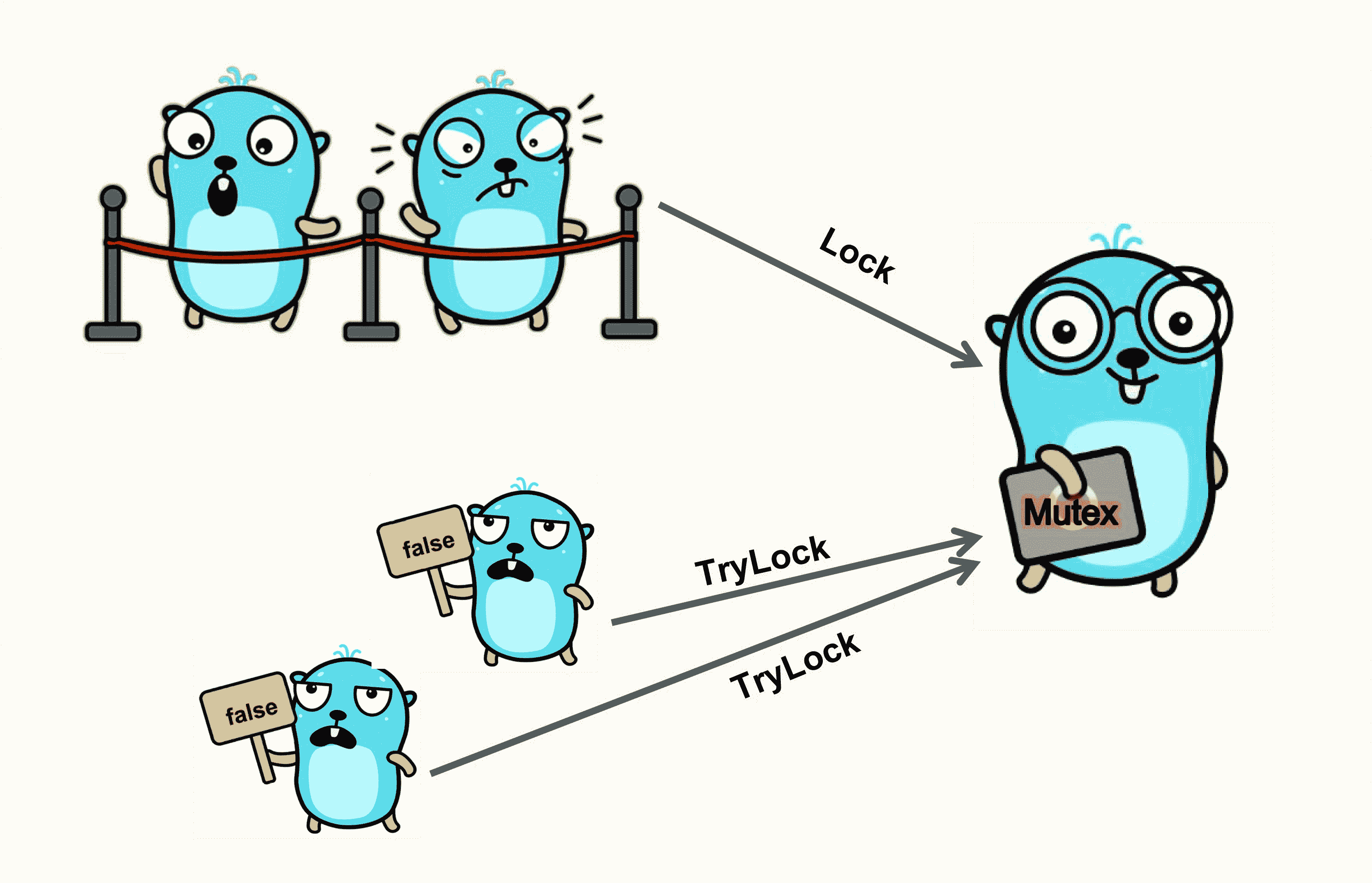

這個方法具體是什麼意思呢?我來解釋一下這裡的邏輯。當一個 goroutine 呼叫這個 TryLock 方法請求鎖的時候,如果這把鎖沒有被其他 goroutine 所持有,那麼,這個 goroutine 就持有了這把鎖,並返回 true;如果這把鎖已經被其他 goroutine 所持有,或者是正在準備交給某個被喚醒的 goroutine,那麼,這個請求鎖的 goroutine 就直接返回 false,不會阻塞在方法呼叫上。

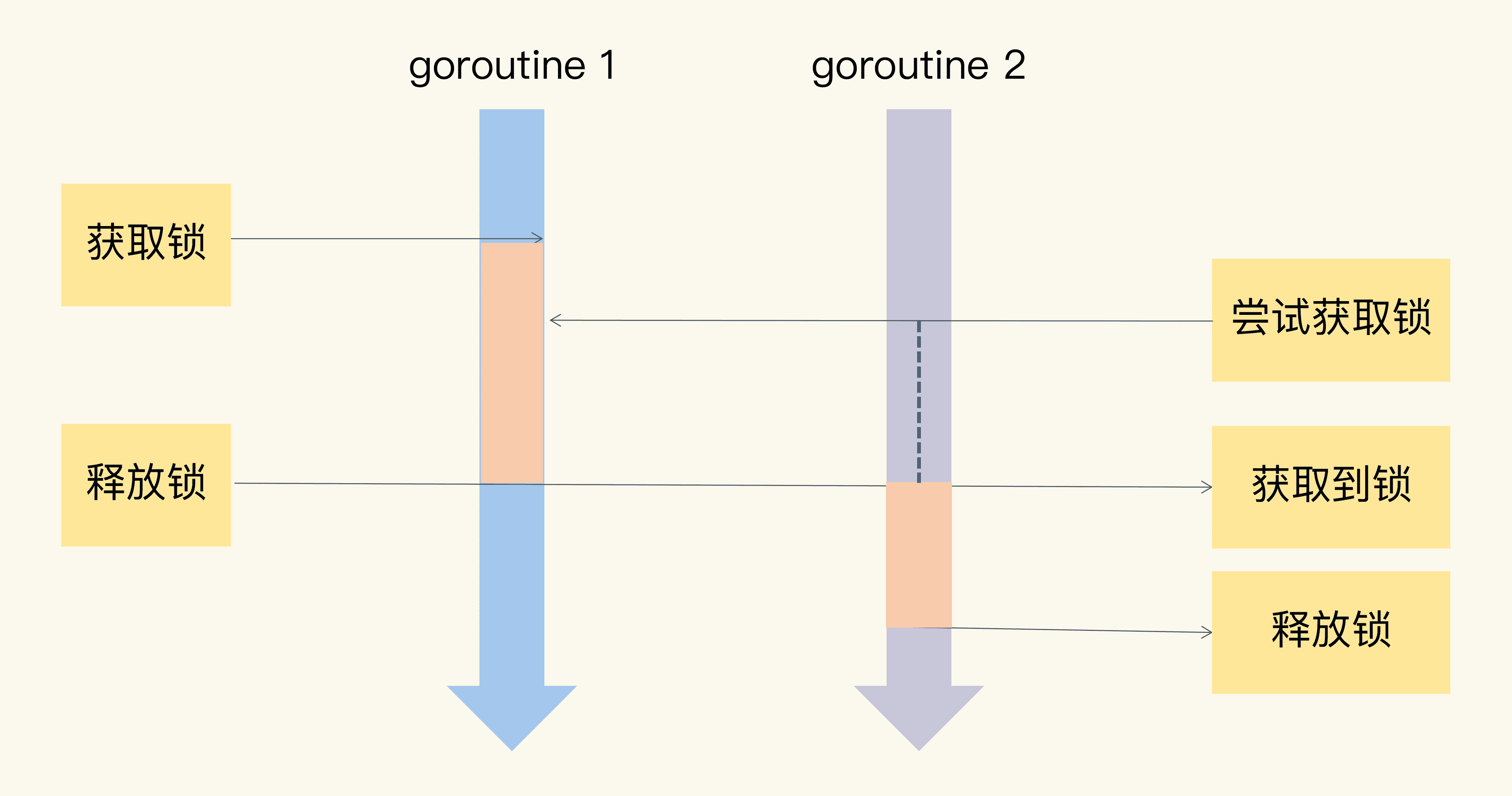

如下圖所示,如果 Mutex 已經被一個 goroutine 持有,呼叫 Lock 的 goroutine 阻塞排隊等待,呼叫 TryLock 的 goroutine 直接得到一個 false 返回。

在實際開發中,如果要更新配置資料,我們通常需要加鎖,這樣可以避免同時有多個 goroutine 併發修改資料。有的時候,我們也會使用 TryLock。這樣一來,當某個 goroutine 想要更改配置資料時,如果發現已經有 goroutine 在更改了,其他的 goroutine 呼叫 TryLock,返回了 false,這個 goroutine 就會放棄更改。

很多語言(比如 Java)都為鎖提供了 TryLock 的方法,但是,Go 官方issue 6123有一個討論(後來一些 issue 中也提到過),標準庫的 Mutex 不會新增 TryLock 方法。雖然透過 Go 的 Channel 我們也可以實作 TryLock 的功能,但是基於 Channel 的實作我們會放在 Channel 那一講中去介紹,這一次我們還是基於 Mutex 去實作,畢竟大部分的程式設計師還是熟悉傳統的同步原語,而且傳統的同步原語也不容易出錯。所以這節課,還是希望帶你掌握基於 Mutex 實作的方法。

那怎麼實作一個擴充套件 TryLock 方法的 Mutex 呢?我們直接來看程式碼。

// 複製Mutex定義的常量

const (

mutexLocked = 1 << iota // 加鎖標識位置

mutexWoken // 喚醒標識位置

mutexStarving // 鎖飢餓標識位置

mutexWaiterShift = iota // 標識waiter的起始bit位置

)

// 擴充套件一個Mutex結構

type Mutex struct {

sync.Mutex

}

// 嘗試獲取鎖

func (m *Mutex) TryLock() bool {

// 如果能成功搶到鎖

if atomic.CompareAndSwapInt32((*int32)(unsafe.Pointer(&m.Mutex)), 0, mutexLocked) {

return true

}

// 如果處於喚醒、加鎖或者飢餓狀態,這次請求就不參與競爭了,返回false

old := atomic.LoadInt32((*int32)(unsafe.Pointer(&m.Mutex)))

if old&(mutexLocked|mutexStarving|mutexWoken) != 0 {

return false

}

// 嘗試在競爭的狀態下請求鎖

new := old | mutexLocked

return atomic.CompareAndSwapInt32((*int32)(unsafe.Pointer(&m.Mutex)), old, new)

}

第 17 行是一個 fast path,如果幸運,沒有其他 goroutine 爭這把鎖,那麼,這把鎖就會被這個請求的 goroutine 獲取,直接返回。

如果鎖已經被其他 goroutine 所持有,或者被其他喚醒的 goroutine 準備持有,那麼,就直接返回 false,不再請求,程式碼邏輯在第 23 行。

如果沒有被持有,也沒有其它喚醒的 goroutine 來競爭鎖,鎖也不處於飢餓狀態,就嘗試獲取這把鎖(第 29 行),不論是否成功都將結果返回。因為,這個時候,可能還有其他的 goroutine 也在競爭這把鎖,所以,不能保證成功獲取這把鎖。

我們可以寫一個簡單的測試程式,來測試我們的 TryLock 的機制是否工作。

這個測試程式的工作機制是這樣子的:程式執行時會啟動一個 goroutine 持有這把我們自己實作的鎖,經過隨機的時間才釋放。主 goroutine 會嘗試獲取這把鎖。如果前一個 goroutine 一秒內釋放了這把鎖,那麼,主 goroutine 就有可能獲取到這把鎖了,輸出“got the lock”,否則沒有獲取到也不會被阻塞,會直接輸出“can't get the lock”。

func try() {

var mu Mutex

go func() { // 啟動一個goroutine持有一段時間的鎖

mu.Lock()

time.Sleep(time.Duration(rand.Intn(2)) * time.Second)

mu.Unlock()

}()

time.Sleep(time.Second)

ok := mu.TryLock() // 嘗試獲取到鎖

if ok { // 獲取成功

fmt.Println("got the lock")

// do something

mu.Unlock()

return

}

// 沒有獲取到

fmt.Println("can't get the lock")

}獲取等待者的數量等指標接下來,我想和你聊聊怎麼獲取等待者數量等指標。

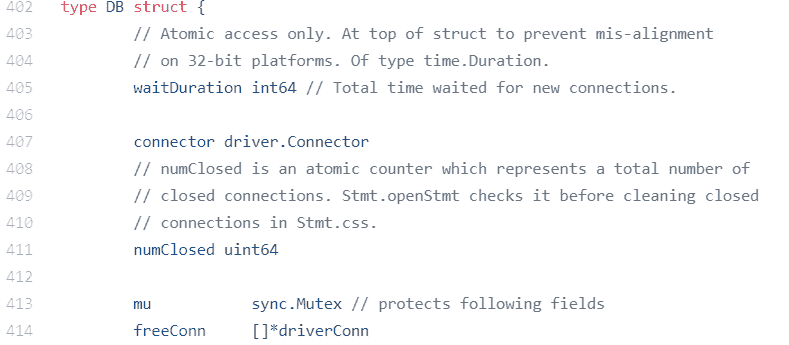

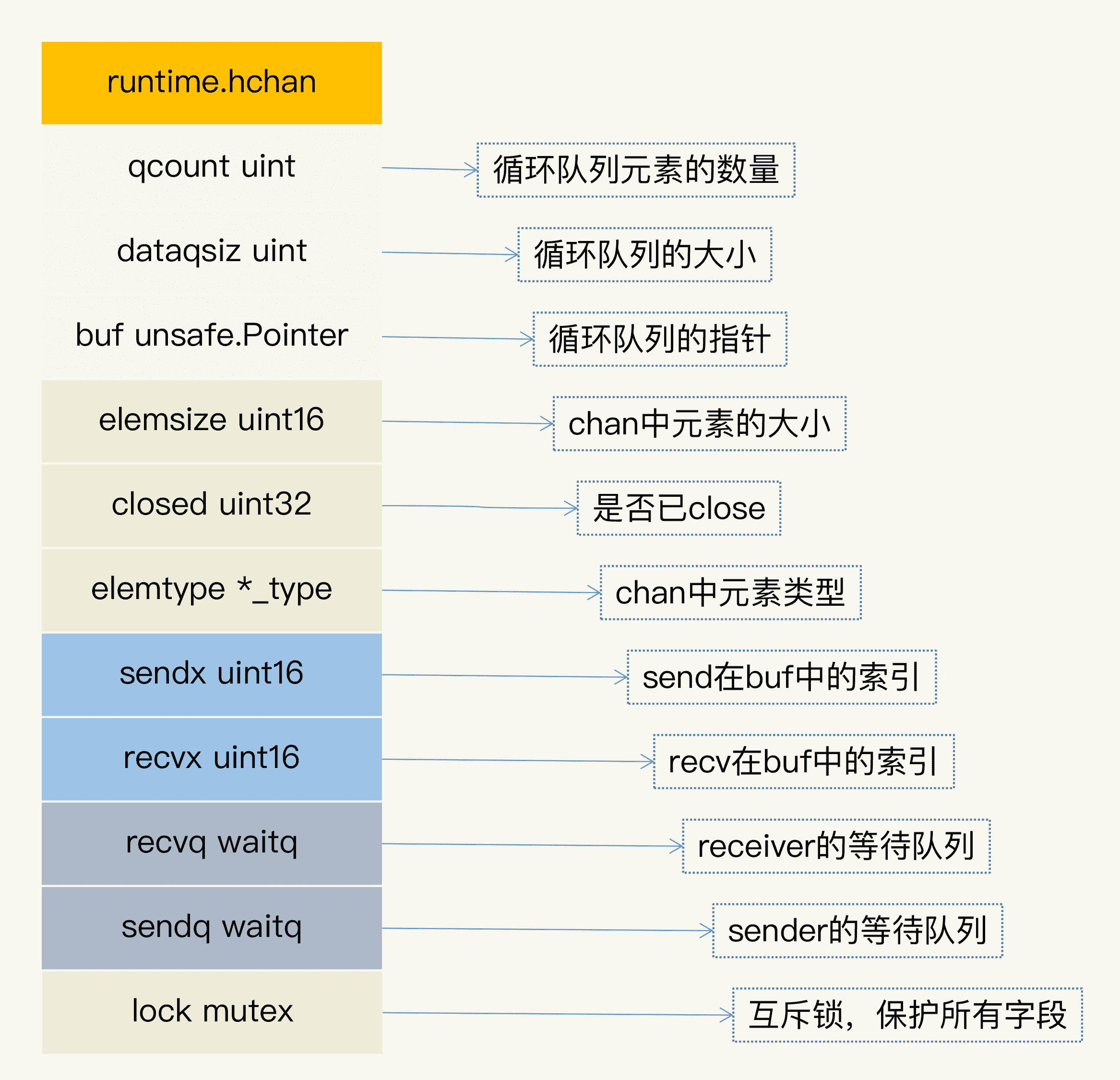

第二講中,我們已經學習了 Mutex 的結構。先來回顧一下 Mutex 的資料結構,如下面的程式碼所示。它包含兩個欄位,state 和 sema。前四個位元組(int32)就是 state 欄位。

type Mutex struct {

state int32

sema uint32

}

Mutex 結構中的 state 欄位有很多個含義,透過 state 欄位,你可以知道鎖是否已經被某個 goroutine 持有、當前是否處於飢餓狀態、是否有等待的 goroutine 被喚醒、等待者的數量等資訊。但是,state 這個欄位並沒有暴露出來,所以,我們需要想辦法獲取到這個欄位,並進行解析。

怎麼獲取未暴露的欄位呢?很簡單,我們可以透過 unsafe 的方式實作。我來舉一個例子,你一看就明白了。

const (

mutexLocked = 1 << iota // mutex is locked

mutexWoken

mutexStarving

mutexWaiterShift = iota

)

type Mutex struct {

sync.Mutex

}

func (m *Mutex) Count() int {

// 獲取state欄位的值

v := atomic.LoadInt32((*int32)(unsafe.Pointer(&m.Mutex)))

v = v >> mutexWaiterShift //得到等待者的數值

v = v + (v & mutexLocked) //再加上鎖持有者的數量,0或者1

return int(v)

}

這個例子的第 14 行透過 unsafe 操作,我們可以得到 state 欄位的值。第 15 行我們右移三位(這裡的常量 mutexWaiterShift 的值為 3),就得到了當前等待者的數量。如果當前的鎖已經被其他 goroutine 持有,那麼,我們就稍微調整一下這個值,加上一個 1(第 16 行),你基本上可以把它看作是當前持有和等待這把鎖的 goroutine 的總數。

state 這個欄位的第一位是用來標記鎖是否被持有,第二位用來標記是否已經喚醒了一個等待者,第三位標記鎖是否處於飢餓狀態,透過分析這個 state 欄位我們就可以得到這些狀態資訊。我們可以為這些狀態提供查詢的方法,這樣就可以即時地知道鎖的狀態了。

// 鎖是否被持有

func (m *Mutex) IsLocked() bool {

state := atomic.LoadInt32((*int32)(unsafe.Pointer(&m.Mutex)))

return state&mutexLocked == mutexLocked

}

// 是否有等待者被喚醒

func (m *Mutex) IsWoken() bool {

state := atomic.LoadInt32((*int32)(unsafe.Pointer(&m.Mutex)))

return state&mutexWoken == mutexWoken

}

// 鎖是否處於飢餓狀態

func (m *Mutex) IsStarving() bool {

state := atomic.LoadInt32((*int32)(unsafe.Pointer(&m.Mutex)))

return state&mutexStarving == mutexStarving

}

我們可以寫一個程式測試一下,比如,在 1000 個 goroutine 併發訪問的情況下,我們可以把鎖的狀態資訊輸出出來:

func count() {

var mu Mutex

for i := 0; i < 1000; i++ { // 啟動1000個goroutine

go func() {

mu.Lock()

time.Sleep(time.Second)

mu.Unlock()

}()

}

time.Sleep(time.Second)

// 輸出鎖的資訊

fmt.Printf("waitings: %d, isLocked: %t, woken: %t, starving: %t\n", mu.Count(), mu.IsLocked(), mu.IsWoken(), mu.IsStarving())

}

有一點你需要注意一下,在獲取 state 欄位的時候,並沒有透過 Lock 獲取這把鎖,所以獲取的這個 state 的值是一個瞬態的值,可能在你解析出這個欄位之後,鎖的狀態已經發生了變化。不過沒關係,因為你檢視的就是呼叫的那一時刻的鎖的狀態。

使用 Mutex 實作一個執行緒安全的佇列

最後,我們來討論一下,如何使用 Mutex 實作一個執行緒安全的佇列。

為什麼要討論這個話題呢?因為 Mutex 經常會和其他非執行緒安全(對於 Go 來說,我們其實指的是 goroutine 安全)的資料結構一起,組合成一個執行緒安全的資料結構。新資料結構的業務邏輯由原來的資料結構提供,而 Mutex 提供了鎖的機制,來保證執行緒安全。

比如佇列,我們可以透過 Slice 來實作,但是透過 Slice 實作的佇列不是執行緒安全的,出隊(Dequeue)和入隊(Enqueue)會有 data race 的問題。這個時候,Mutex 就要隆重出場了,透過它,我們可以在出隊和入隊的時候加上鎖的保護。

type SliceQueue struct {

data []interface{}

mu sync.Mutex

}

func NewSliceQueue(n int) (q *SliceQueue) {

return &SliceQueue{data: make([]interface{}, 0, n)}

}

// Enqueue 把值放在隊尾

func (q *SliceQueue) Enqueue(v interface{}) {

q.mu.Lock()

q.data = append(q.data, v)

q.mu.Unlock()

}

// Dequeue 移去隊頭並返回

func (q *SliceQueue) Dequeue() interface{} {

q.mu.Lock()

if len(q.data) == 0 {

q.mu.Unlock()

return nil

}

v := q.data[0]

q.data = q.data[1:]

q.mu.Unlock()

return v

}

因為標準庫中沒有執行緒安全的佇列資料結構的實作,所以,你可以透過 Mutex 實作一個簡單的佇列。透過 Mutex 我們就可以為一個非執行緒安全的 data interface{}實作執行緒安全的訪問。

總結

好了,我們來做個總結。

Mutex 是 package sync 的基石,其他的一些同步原語也是基於它實作的,所以,我們“隆重”地用了四講來深度學習它。學到後面,你一定能感受到,多花些時間來完全掌握 Mutex 是值得的。

今天這一講我和你分享了幾個 Mutex 的拓展功能,這些方法是不是給你帶來了一種“駭客”的程式設計體驗呢,透過 Hacker 的方式,我們真的可以讓 Mutex 變得更強大。

我們學習了基於 Mutex 實作 TryLock,透過 unsafe 的方式讀取到 Mutex 內部的 state 欄位,這樣,我們就解決了開篇列舉的問題,一是不希望鎖的 goroutine 繼續等待,一是想監控鎖。

另外,使用 Mutex 組合成更豐富的資料結構是我們常見的場景,今天我們就實作了一個執行緒安全的佇列,未來我們還會講到實作執行緒安全的 map 物件。

到這裡,Mutex 我們就係統學習完了,最後給你總結了一張 Mutex 知識地圖,幫你複習一下。

思考題

你可以為 Mutex 獲取鎖時加上 Timeout 機制嗎?會有什麼問題嗎?

歡迎在留言區寫下你的思考和答案,我們一起交流討論。如果你覺得有所收穫,也歡迎你把今天的內容分享給你的朋友或同事。

05| RWMutex:讀寫鎖的實作原理及避坑指南

你好,我是鳥窩。

本章導讀

RWMutex 讀寫分流示意

讀 goroutine A ──RLock()──┐

讀 goroutine B ──RLock()──┼────> [共享讀取區](可同時多讀)

讀 goroutine C ──RLock()──┘

寫 goroutine W ──Lock()────────> [獨占寫入區](寫入時阻擋新讀/寫)

重點:讀多寫少時,RWMutex 通常比 Mutex 更能提升吞吐量

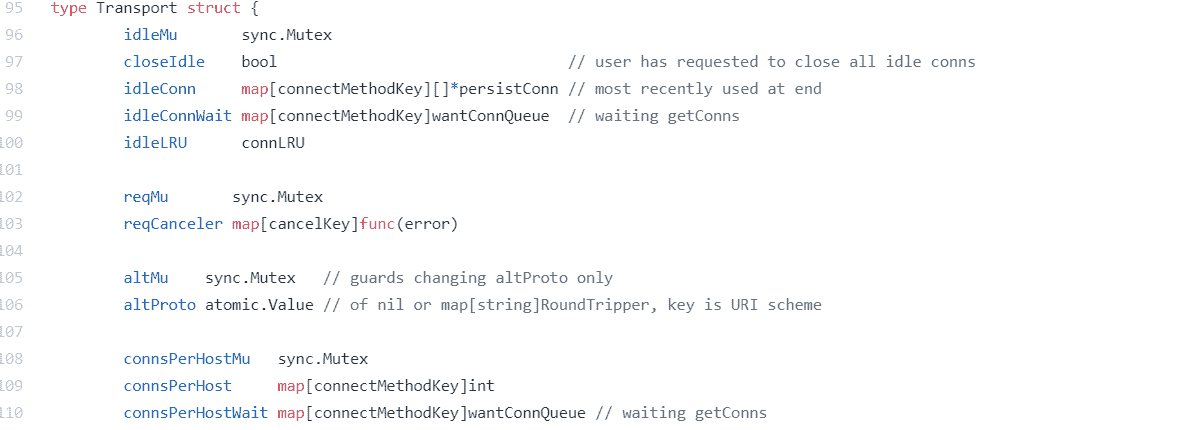

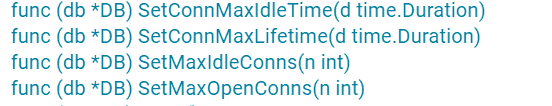

在前面的四節課中,我們學習了第一個同步原語,即 Mutex,我們使用它來保證讀寫共享資源的安全性。不管是讀還是寫,我們都透過 Mutex 來保證只有一個 goroutine 訪問共享資源,這在某些情況下有點“浪費”。比如說,在寫少讀多的情況下,即使一段時間內沒有寫操作,大量併發的讀訪問也不得不在 Mutex 的保護下變成了序列訪問,這個時候,使用 Mutex,對效能的影響就比較大。

怎麼辦呢?你是不是已經有思路了,對,就是區分讀寫操作。

我來具體解釋一下。如果某個讀操作的 goroutine 持有了鎖,在這種情況下,其它讀操作的 goroutine 就不必一直傻傻地等待了,而是可以併發地訪問共享變數,這樣我們就可以將序列的讀變成並行讀,提高讀操作的效能。當寫操作的 goroutine 持有鎖的時候,它就是一個排外鎖,其它的寫操作和讀操作的 goroutine,需要阻塞等待持有這個鎖的 goroutine 釋放鎖。

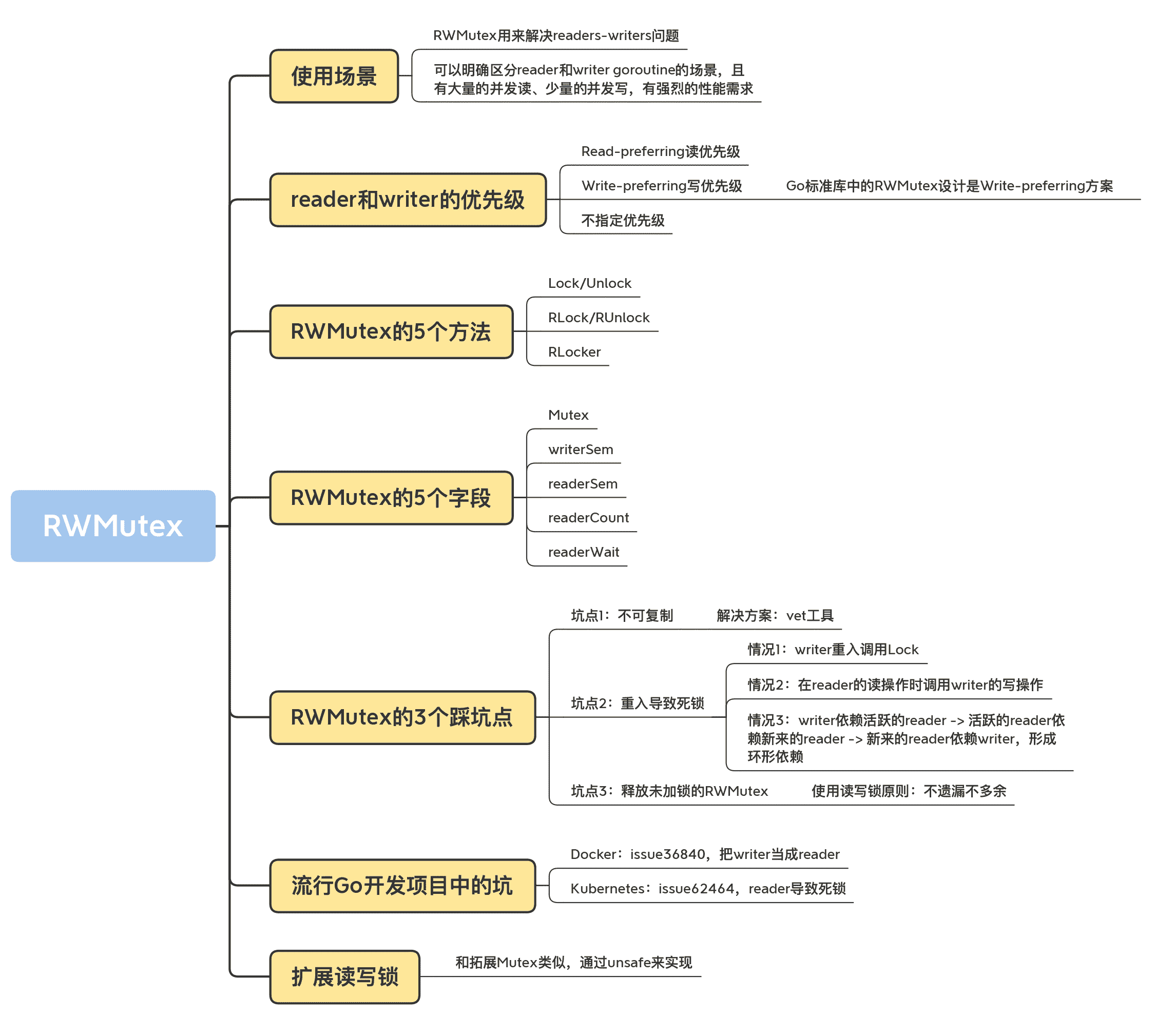

這一類併發讀寫問題叫作readers-writers 問題,意思就是,同時可能有多個讀或者多個寫,但是隻要有一個執行緒在執行寫操作,其它的執行緒都不能執行讀寫操作。

Go 標準庫中的 RWMutex(讀寫鎖)就是用來解決這類 readers-writers 問題的。所以,這節課,我們就一起來學習 RWMutex。我會給你介紹讀寫鎖的使用場景、實作原理以及容易掉入的坑,你一定要記住這些陷阱,避免在實際的開發中犯相同的錯誤。

什麼是 RWMutex?

我先簡單解釋一下讀寫鎖 RWMutex。標準庫中的 RWMutex 是一個 reader/writer 互斥鎖。RWMutex 在某一時刻只能由任意數量的 reader 持有,或者是隻被單個的 writer 持有。

RWMutex 的方法也很少,總共有 5 個。

- Lock/Unlock:寫操作時呼叫的方法。如果鎖已經被 reader 或者 writer 持有,那麼,Lock 方法會一直阻塞,直到能獲取到鎖;Unlock 則是配對的釋放鎖的方法。

- RLock/RUnlock:讀操作時呼叫的方法。如果鎖已經被 writer 持有的話,RLock 方法會一直阻塞,直到能獲取到鎖,否則就直接返回;而 RUnlock 是 reader 釋放鎖的方法。

- RLocker:這個方法的作用是為讀操作返回一個 Locker 介面的物件。它的 Lock 方法會呼叫 RWMutex 的 RLock 方法,它的 Unlock 方法會呼叫 RWMutex 的 RUnlock 方法。

RWMutex 的零值是未加鎖的狀態,所以,當你使用 RWMutex 的時候,無論是宣告變數,還是嵌入到其它 struct 中,都不必顯式地初始化。

我以計數器為例,來說明一下,如何使用 RWMutex 保護共享資源。計數器的 count++操作是寫操作,而獲取 count 的值是讀操作,這個場景非常適合讀寫鎖,因為讀操作可以並行執行,寫操作時只允許一個執行緒執行,這正是 readers-writers 問題。

在這個例子中,使用 10 個 goroutine 進行讀操作,每讀取一次,sleep 1 毫秒,同時,還有一個 gorotine 進行寫操作,每一秒寫一次,這是一個 1 writer-n reader 的讀寫場景,而且寫操作還不是很頻繁(一秒一次):

func main() {

var counter Counter

for i := 0; i < 10; i++ { // 10個reader

go func() {

for {

counter.Count() // 計數器讀操作

time.Sleep(time.Millisecond)

}

}()

}

for { // 一個writer

counter.Incr() // 計數器寫操作

time.Sleep(time.Second)

}

}

// 一個執行緒安全的計數器

type Counter struct {

mu sync.RWMutex

count uint64

}

// 使用寫鎖保護

func (c *Counter) Incr() {

c.mu.Lock()

c.count++

c.mu.Unlock()

}

// 使用讀鎖保護

func (c *Counter) Count() uint64 {

c.mu.RLock()

defer c.mu.RUnlock()

return c.count

}

可以看到,Incr 方法會修改計數器的值,是一個寫操作,我們使用 Lock/Unlock 進行保護。Count 方法會讀取當前計數器的值,是一個讀操作,我們使用 RLock/RUnlock 方法進行保護。

Incr 方法每秒才呼叫一次,所以,writer 競爭鎖的頻次是比較低的,而 10 個 goroutine 每毫秒都要執行一次查詢,透過讀寫鎖,可以極大提升計數器的效能,因為在讀取的時候,可以併發進行。如果使用 Mutex,效能就不會像讀寫鎖這麼好。因為多個 reader 併發讀的時候,使用互斥鎖導致了 reader 要排隊讀的情況,沒有 RWMutex 併發讀的效能好。

如果你遇到可以明確區分 reader 和 writer goroutine 的場景,且有大量的併發讀、少量的併發寫,並且有強烈的效能需求,你就可以考慮使用讀寫鎖 RWMutex 替換 Mutex。

在實際使用 RWMutex 的時候,如果我們在 struct 中使用 RWMutex 保護某個欄位,一般會把它和這個欄位放在一起,用來指示兩個欄位是一組欄位。除此之外,我們還可以採用匿名欄位的方式嵌入 struct,這樣,在使用這個 struct 時,我們就可以直接呼叫 Lock/Unlock、RLock/RUnlock 方法了,這和我們前面在01 講中介紹 Mutex 的使用方法很類似,你可以回去複習一下。

RWMutex 的實作原理

RWMutex 是很常見的併發原語,很多程式語言的庫都提供了類似的併發型別。RWMutex 一般都是基於互斥鎖、條件變數(condition variables)或者訊號量(semaphores)等併發原語來實作。Go 標準庫中的 RWMutex 是基於 Mutex 實作的。

readers-writers 問題一般有三類,基於對讀和寫操作的優先順序,讀寫鎖的設計和實作也分成三類。

- Read-preferring:讀優先的設計可以提供很高的併發性,但是,在競爭激烈的情況下可能會導致寫飢餓。這是因為,如果有大量的讀,這種設計會導致只有所有的讀都釋放了鎖之後,寫才可能獲取到鎖。

- Write-preferring:寫優先的設計意味著,如果已經有一個 writer 在等待請求鎖的話,它會阻止新來的請求鎖的 reader 獲取到鎖,所以優先保障 writer。當然,如果有一些 reader 已經請求了鎖的話,新請求的 writer 也會等待已經存在的 reader 都釋放鎖之後才能獲取。所以,寫優先順序設計中的優先權是針對新來的請求而言的。這種設計主要避免了 writer 的飢餓問題。

- 不指定優先順序:這種設計比較簡單,不區分 reader 和 writer 優先順序,某些場景下這種不指定優先順序的設計反而更有效,因為第一類優先順序會導致寫飢餓,第二類優先順序可能會導致讀飢餓,這種不指定優先順序的訪問不再區分讀寫,大家都是同一個優先順序,解決了飢餓的問題。

Go 標準庫中的 RWMutex 設計是 Write-preferring 方案。一個正在阻塞的 Lock 呼叫會排除新的 reader 請求到鎖。

RWMutex 包含一個 Mutex,以及四個輔助欄位 writerSem、readerSem、readerCount 和 readerWait:

type RWMutex struct {

w Mutex // 互斥鎖解決多個writer的競爭

writerSem uint32 // writer訊號量

readerSem uint32 // reader訊號量

readerCount int32 // reader的數量

readerWait int32 // writer等待完成的reader的數量

}

const rwmutexMaxReaders = 1 << 30

我來簡單解釋一下這幾個欄位。

- 欄位 w:為 writer 的競爭鎖而設計;

- 欄位 readerCount:記錄當前 reader 的數量(以及是否有 writer 競爭鎖);

- readerWait:記錄 writer 請求鎖時需要等待 read 完成的 reader 的數量;

- writerSem 和 readerSem:都是為了阻塞設計的訊號量。

這裡的常量 rwmutexMaxReaders,定義了最大的 reader 數量。

好了,知道了 RWMutex 的設計方案和具體欄位,下面我來解釋一下具體的方法實作。

RLock/RUnlock 的實作

首先,我們看一下移除了 race 等無關緊要的程式碼後的 RLock 和 RUnlock 方法:

func (rw *RWMutex) RLock() {

if atomic.AddInt32(&rw.readerCount, 1) < 0 {

// rw.readerCount是負值的時候,意味著此時有writer等待請求鎖,因為writer優先順序高,所以把後來的reader阻塞休眠

runtime_SemacquireMutex(&rw.readerSem, false, 0)

}

}

func (rw *RWMutex) RUnlock() {

if r := atomic.AddInt32(&rw.readerCount, -1); r < 0 {

rw.rUnlockSlow(r) // 有等待的writer

}

}

func (rw *RWMutex) rUnlockSlow(r int32) {

if atomic.AddInt32(&rw.readerWait, -1) == 0 {

// 最後一個reader了,writer終於有機會獲得鎖了

runtime_Semrelease(&rw.writerSem, false, 1)

}

}

第 2 行是對 reader 計數加 1。你可能比較困惑的是,readerCount 怎麼還可能為負數呢?其實,這是因為,readerCount 這個欄位有雙重含義:

- 沒有 writer 競爭或持有鎖時,readerCount 和我們正常理解的 reader 的計數是一樣的;

- 但是,如果有 writer 競爭鎖或者持有鎖時,那麼,readerCount 不僅僅承擔著 reader 的計數功能,還能夠標識當前是否有 writer 競爭或持有鎖,在這種情況下,請求鎖的 reader 的處理進入第 4 行,阻塞等待鎖的釋放。

呼叫 RUnlock 的時候,我們需要將 Reader 的計數減去 1(第 8 行),因為 reader 的數量減少了一個。但是,第 8 行的 AddInt32 的返回值還有另外一個含義。如果它是負值,就表示當前有 writer 競爭鎖,在這種情況下,還會呼叫 rUnlockSlow 方法,檢查是不是 reader 都釋放讀鎖了,如果讀鎖都釋放了,那麼可以喚醒請求寫鎖的 writer 了。

當一個或者多個 reader 持有鎖的時候,競爭鎖的 writer 會等待這些 reader 釋放完,才可能持有這把鎖。打個比方,在房地產行業中有條規矩叫做“買賣不破租賃”,意思是說,就算房東把房子賣了,新業主也不能把當前的租戶趕走,而是要等到租約結束後,才能接管房子。這和 RWMutex 的設計是一樣的。當 writer 請求鎖的時候,是無法改變既有的 reader 持有鎖的現實的,也不會強制這些 reader 釋放鎖,它的優先權只是限定後來的 reader 不要和它搶。

所以,rUnlockSlow 將持有鎖的 reader 計數減少 1 的時候,會檢查既有的 reader 是不是都已經釋放了鎖,如果都釋放了鎖,就會喚醒 writer,讓 writer 持有鎖。

Lock

RWMutex 是一個多 writer 多 reader 的讀寫鎖,所以同時可能有多個 writer 和 reader。那麼,為了避免 writer 之間的競爭,RWMutex 就會使用一個 Mutex 來保證 writer 的互斥。

一旦一個 writer 獲得了內部的互斥鎖,就會反轉 readerCount 欄位,把它從原來的正整數 readerCount(>=0) 修改為負數(readerCount-rwmutexMaxReaders),讓這個欄位保持兩個含義(既儲存了 reader 的數量,又表示當前有 writer)。

我們來看下下面的程式碼。第 5 行,還會記錄當前活躍的 reader 數量,所謂活躍的 reader,就是指持有讀鎖還沒有釋放的那些 reader。

func (rw *RWMutex) Lock() {

// 首先解決其他writer競爭問題

rw.w.Lock()

// 反轉readerCount,告訴reader有writer競爭鎖

r := atomic.AddInt32(&rw.readerCount, -rwmutexMaxReaders) + rwmutexMaxReaders

// 如果當前有reader持有鎖,那麼需要等待

if r != 0 && atomic.AddInt32(&rw.readerWait, r) != 0 {

runtime_SemacquireMutex(&rw.writerSem, false, 0)

}

}

如果 readerCount 不是 0,就說明當前有持有讀鎖的 reader,RWMutex 需要把這個當前 readerCount 賦值給 readerWait 欄位儲存下來(第 7 行), 同時,這個 writer 進入阻塞等待狀態(第 8 行)。

每當一個 reader 釋放讀鎖的時候(呼叫 RUnlock 方法時),readerWait 欄位就減 1,直到所有的活躍的 reader 都釋放了讀鎖,才會喚醒這個 writer。

Unlock

當一個 writer 釋放鎖的時候,它會再次反轉 readerCount 欄位。可以肯定的是,因為當前鎖由 writer 持有,所以,readerCount 欄位是反轉過的,並且減去了 rwmutexMaxReaders 這個常數,變成了負數。所以,這裡的反轉方法就是給它增加 rwmutexMaxReaders 這個常數值。

既然 writer 要釋放鎖了,那麼就需要喚醒之後新來的 reader,不必再阻塞它們了,讓它們開開心心地繼續執行就好了。

在 RWMutex 的 Unlock 返回之前,需要把內部的互斥鎖釋放。釋放完畢後,其他的 writer 才可以繼續競爭這把鎖。

func (rw *RWMutex) Unlock() {

// 告訴reader沒有活躍的writer了

r := atomic.AddInt32(&rw.readerCount, rwmutexMaxReaders)

// 喚醒阻塞的reader們

for i := 0; i < int(r); i++ {

runtime_Semrelease(&rw.readerSem, false, 0)

}

// 釋放內部的互斥鎖

rw.w.Unlock()

}

在這段程式碼中,我刪除了 race 的處理和異常情況的檢查,總體看來還是比較簡單的。這裡有幾個重點,我要再提醒你一下。首先,你要理解 readerCount 這個欄位的含義以及反轉方式。其次,你還要注意欄位的更改和內部互斥鎖的順序關係。在 Lock 方法中,是先獲取內部互斥鎖,才會修改的其他欄位;而在 Unlock 方法中,是先修改的其他欄位,才會釋放內部互斥鎖,這樣才能保證欄位的修改也受到互斥鎖的保護。

好了,到這裡我們就完整學習了 RWMutex 的概念和實作原理。RWMutex 的應用場景非常明確,就是解決 readers-writers 問題。學完了今天的內容,之後當你遇到這類問題時,要優先想到 RWMutex。另外,Go 併發原語程式碼實作的質量都很高,非常精煉和高效,所以,你可以透過看它們的實作原理,學習一些程式設計的技巧。當然,還有非常重要的一點就是要知道 reader 或者 writer 請求鎖的時候,既有的 reader/writer 和後續請求鎖的 reader/writer 之間的(釋放鎖 / 請求鎖)順序關係。

有個很有意思的事兒,就是官方的文件對 RWMutex 介紹是錯誤的,或者說是不明確的,在下一個版本(Go 1.16)中,官方會更改對 RWMutex 的介紹,具體是這樣的:

A RWMutex is a reader/writer mutual exclusion lock.

The lock can be held by any number of readers or a single writer, and

a blocked writer also blocks new readers from acquiring the lock.

這個描述是相當精確的,它指出了 RWMutex 可以被誰持有,以及 writer 比後續的 reader 有獲取鎖的優先順序。

雖然 RWMutex 暴露的 API 也很簡單,使用起來也沒有複雜的邏輯,但是和 Mutex 一樣,在實際使用的時候,也會很容易踩到一些坑。接下來,我給你重點介紹 3 個常見的踩坑點。

RWMutex 的 3 個踩坑點

坑點 1:不可複製

前面剛剛說過,RWMutex 是由一個互斥鎖和四個輔助欄位組成的。我們很容易想到,互斥鎖是不可複製的,再加上四個有狀態的欄位,RWMutex 就更加不能複製使用了。

不能複製的原因和互斥鎖一樣。一旦讀寫鎖被使用,它的欄位就會記錄它當前的一些狀態。這個時候你去複製這把鎖,就會把它的狀態也給複製過來。但是,原來的鎖在釋放的時候,並不會修改你複製出來的這個讀寫鎖,這就會導致複製出來的讀寫鎖的狀態不對,可能永遠無法釋放鎖。

那該怎麼辦呢?其實,解決方案也和互斥鎖一樣。你可以藉助 vet 工具,在變數賦值、函式傳參、函式返回值、遍歷資料、struct 初始化等時,檢查是否有讀寫鎖隱式複製的情景。

坑點 2:重入導致死鎖

讀寫鎖因為重入(或遞迴呼叫)導致死鎖的情況更多。

我先介紹第一種情況。因為讀寫鎖內部基於互斥鎖實作對 writer 的併發訪問,而互斥鎖本身是有重入問題的,所以,writer 重入呼叫 Lock 的時候,就會出現死鎖的現象,這個問題,我們在學習互斥鎖的時候已經瞭解過了。

func foo(l *sync.RWMutex) {

fmt.Println("in foo")

l.Lock()

bar(l)

l.Unlock()

}

func bar(l *sync.RWMutex) {

l.Lock()

fmt.Println("in bar")

l.Unlock()

}

func main() {

l := &sync.RWMutex{}

foo(l)

}

執行這個程式,你就會得到死鎖的錯誤輸出,在 Go 執行的時候,很容易就能檢測出來。

第二種死鎖的場景有點隱蔽。我們知道,有活躍 reader 的時候,writer 會等待,如果我們在 reader 的讀操作時呼叫 writer 的寫操作(它會呼叫 Lock 方法),那麼,這個 reader 和 writer 就會形成互相依賴的死鎖狀態。Reader 想等待 writer 完成後再釋放鎖,而 writer 需要這個 reader 釋放鎖之後,才能不阻塞地繼續執行。這是一個讀寫鎖常見的死鎖場景。

第三種死鎖的場景更加隱蔽。

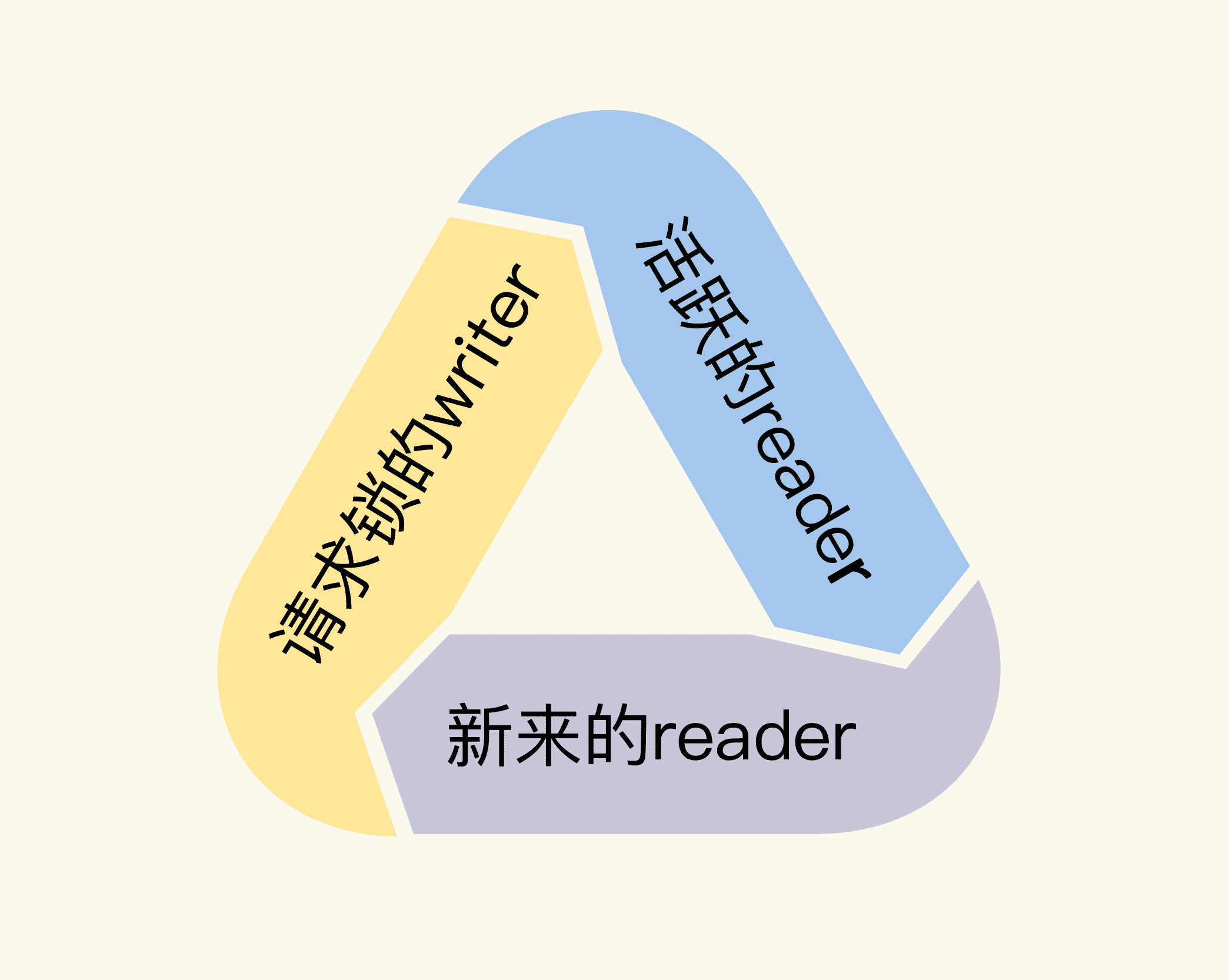

當一個 writer 請求鎖的時候,如果已經有一些活躍的 reader,它會等待這些活躍的 reader 完成,才有可能獲取到鎖,但是,如果之後活躍的 reader 再依賴新的 reader 的話,這些新的 reader 就會等待 writer 釋放鎖之後才能繼續執行,這就形成了一個環形依賴: writer 依賴活躍的 reader -> 活躍的 reader 依賴新來的 reader -> 新來的 reader 依賴 writer。

這個死鎖相當隱蔽,原因在於它和 RWMutex 的設計和實作有關。啥意思呢?我們來看一個計算階乘 (n!) 的例子:

func main() {

var mu sync.RWMutex

// writer,稍微等待,然後製造一個呼叫Lock的場景

go func() {

time.Sleep(200 * time.Millisecond)

mu.Lock()

fmt.Println("Lock")

time.Sleep(100 * time.Millisecond)

mu.Unlock()

fmt.Println("Unlock")

}()

go func() {

factorial(&mu, 10) // 計算10的階乘, 10!

}()

select {}

}

// 遞迴呼叫計算階乘

func factorial(m *sync.RWMutex, n int) int {

if n < 1 { // 階乘退出條件

return 0

}

fmt.Println("RLock")

m.RLock()

defer func() {

fmt.Println("RUnlock")

m.RUnlock()

}()

time.Sleep(100 * time.Millisecond)

return factorial(m, n-1) * n // 遞迴呼叫

}

factoria 方法是一個遞迴計算階乘的方法,我們用它來模擬 reader。為了更容易地製造出死鎖場景,我在這裡加上了 sleep 的呼叫,延緩邏輯的執行。這個方法會呼叫讀鎖(第 27 行),在第 33 行遞迴地呼叫此方法,每次呼叫都會產生一次讀鎖的呼叫,所以可以不斷地產生讀鎖的呼叫,而且必須等到新請求的讀鎖釋放,這個讀鎖才能釋放。

同時,我們使用另一個 goroutine 去呼叫 Lock 方法,來實作 writer,這個 writer 會等待 200 毫秒後才會呼叫 Lock,這樣在呼叫 Lock 的時候,factoria 方法還在執行中不斷呼叫 RLock。

這兩個 goroutine 互相持有鎖並等待,誰也不會退讓一步,滿足了“writer 依賴活躍的 reader -> 活躍的 reader 依賴新來的 reader -> 新來的 reader 依賴 writer”的死鎖條件,所以就導致了死鎖的產生。

所以,使用讀寫鎖最需要注意的一點就是儘量避免重入,重入帶來的死鎖非常隱蔽,而且難以診斷。

坑點 3:釋放未加鎖的 RWMutex

和互斥鎖一樣,Lock 和 Unlock 的呼叫總是成對出現的,RLock 和 RUnlock 的呼叫也必須成對出現。Lock 和 RLock 多餘的呼叫會導致鎖沒有被釋放,可能會出現死鎖,而 Unlock 和 RUnlock 多餘的呼叫會導致 panic。在生產環境中出現 panic 是大忌,你總不希望半夜爬起來處理生產環境程式崩潰的問題吧?所以,在使用讀寫鎖的時候,一定要注意,不遺漏不多餘。

流行的 Go 開發專案中的坑

好了,又到了泡一杯寧夏枸杞加新疆大灘棗的養生茶,靜靜地欣賞知名專案出現 Bug 的時候了,這次被拉出來的是 RWMutex 的 Bug。

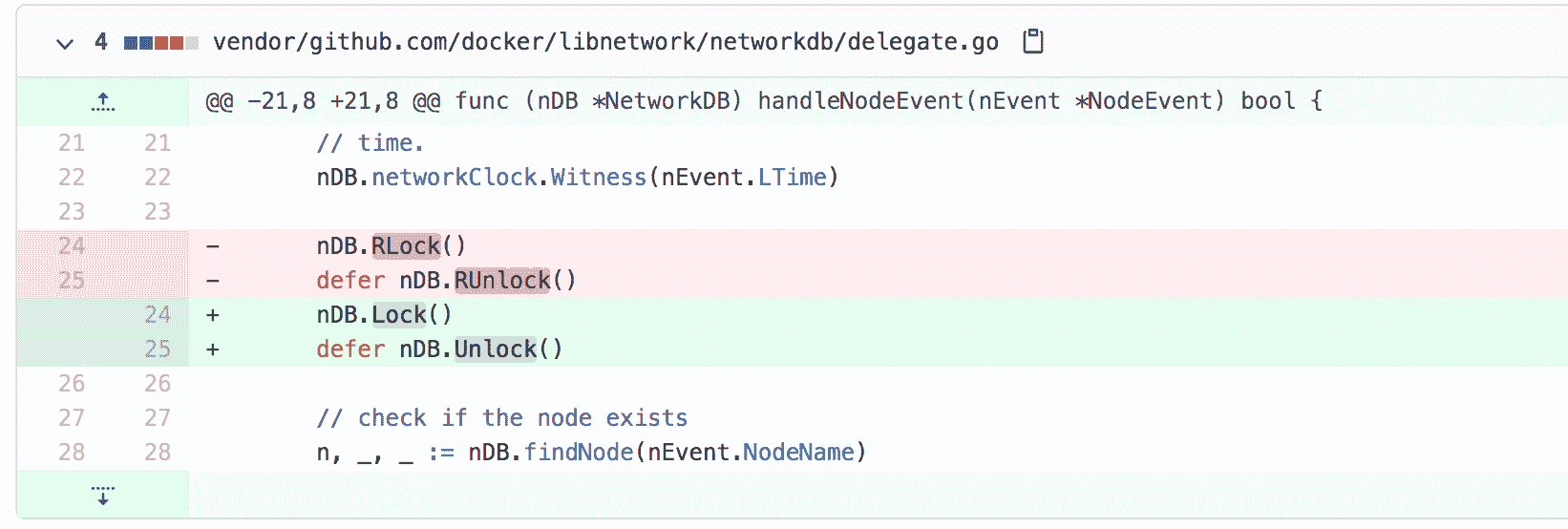

Docker

issue 36840

issue 36840修復的是錯誤地把 writer 當成 reader 的 Bug。 這個地方本來需要修改資料,需要呼叫的是寫鎖,結果用的卻是讀鎖。或許是被它緊挨著的 findNode 方法呼叫迷惑了,認為這只是一個讀操作。可實際上,程式碼後面還會有 changeNodeState 方法的呼叫,這是一個寫操作。修復辦法也很簡單,只需要改成 Lock/Unlock 即可。

Kubernetes

issue 62464

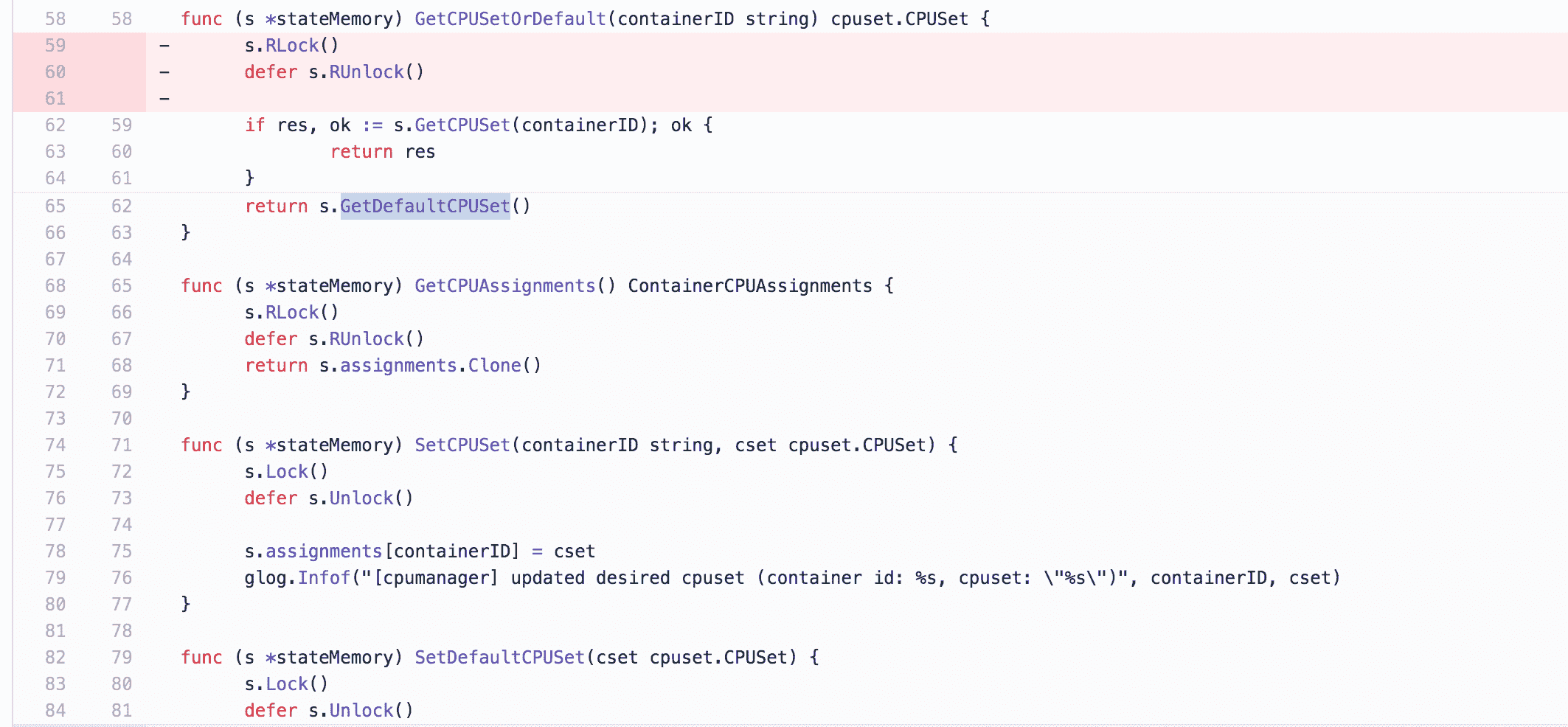

issue 62464就是讀寫鎖第二種死鎖的場景,這是一個典型的 reader 導致的死鎖的例子。知道墨菲定律吧?“凡是可能出錯的事,必定會出錯”。你可能覺得我前面講的 RWMutex 的坑絕對不會被人踩的,因為道理大家都懂,但是你看,Kubernetes 就踩了這個重入的坑。

這個 issue 在移除 pod 的時候可能會發生,原因就在於,GetCPUSetOrDefault 方法會請求讀鎖,同時,它還會呼叫 GetCPUSet 或 GetDefaultCPUSet 方法。當這兩個方法都請求寫鎖時,是獲取不到的,因為 GetCPUSetOrDefault 方法還沒有執行完,不會釋放讀鎖,這就形成了死鎖。

總結

在開發過程中,一開始考慮共享資源併發訪問問題的時候,我們就會想到互斥鎖 Mutex。因為剛開始的時候,我們還並不太瞭解併發的情況,所以,就會使用最簡單的同步原語來解決問題。等到系統成熟,真正到了需要效能最佳化的時候,我們就能靜下心來分析併發場景的可能性,這個時候,我們就要考慮將 Mutex 修改為 RWMutex,來壓榨系統的效能。

當然,如果一開始你的場景就非常明確了,比如我就要實作一個執行緒安全的 map,那麼,一開始你就可以考慮使用讀寫鎖。

正如我在前面提到的,如果你能意識到你要解決的問題是一個 readers-writers 問題,那麼你就可以毫不猶豫地選擇 RWMutex,不用考慮其它選擇。那在使用 RWMutex 時,最需要注意的一點就是儘量避免重入,重入帶來的死鎖非常隱蔽,而且難以診斷。

另外我們也可以擴充套件 RWMutex,不過實作方法和互斥鎖 Mutex 差不多,在技術上是一樣的,都是透過 unsafe 來實作,我就不再具體講了。課下你可以參照我們上節課學習的方法,實作一個擴充套件的 RWMutex。

這一講我們系統學習了讀寫鎖的相關知識,這裡提供給你一個知識地圖,幫助你複習本節課的知識。

思考題

請你寫一個擴充套件的讀寫鎖,比如提供 TryLock,查詢當前是否有 writer、reader 的數量等方法。

歡迎在留言區寫下你的思考和答案,我們一起交流討論。如果你覺得有所收穫,也歡迎你把今天的內容分享給你的朋友或同事。

06|WaitGroup:協同等待,任務編排利器

你好,我是鳥窩。

本章導讀

WaitGroup 任務編排圖

主 goroutine

┌──────────────┐ Add(n) ┌──────────────────────┐

│ 啟動子任務群 │ ────────> │ WaitGroup 計數器 = n │

└──────┬───────┘ └──────────┬───────────┘

│ │

│ 啟動 n 個 goroutine │ Wait() 阻塞

▼ │

┌──────────────┐ Done() │

│ 子任務 #1 │ ─────────────────────┤

├──────────────┤ Done() │

│ 子任務 #2 │ ─────────────────────┤

├──────────────┤ ... │

│ 子任務 #n │ ─────────────────────┘

└──────────────┘

計數歸零 -> 主 goroutine 繼續

WaitGroup,我們以前都多多少少學習過,或者是使用過。其實,WaitGroup 很簡單,就是 package sync 用來做任務編排的一個併發原語。它要解決的就是併發 - 等待的問題:現在有一個 goroutine A 在檢查點(checkpoint)等待一組 goroutine 全部完成,如果在執行任務的這些 goroutine 還沒全部完成,那麼 goroutine A 就會阻塞在檢查點,直到所有 goroutine 都完成後才能繼續執行。

我們來看一個使用 WaitGroup 的場景。

比如,我們要完成一個大的任務,需要使用並行的 goroutine 執行三個小任務,只有這三個小任務都完成,我們才能去執行後面的任務。如果透過輪詢的方式定時詢問三個小任務是否完成,會存在兩個問題:一是,效能比較低,因為三個小任務可能早就完成了,卻要等很長時間才被輪詢到;二是,會有很多無謂的輪詢,空耗 CPU 資源。

那麼,這個時候使用 WaitGroup 併發原語就比較有效了,它可以阻塞等待的 goroutine。等到三個小任務都完成了,再即時喚醒它們。

其實,很多作業系統和程式語言都提供了類似的併發原語。比如,Linux 中的 barrier、Pthread(POSIX 執行緒)中的 barrier、C++ 中的 std::barrier、Java 中的 CyclicBarrier 和 CountDownLatch 等。由此可見,這個併發原語還是一個非常基礎的併發型別。所以,我們要認真掌握今天的內容,這樣就可以舉一反三,輕鬆應對其他場景下的需求了。

我們還是從 WaitGroup 的基本用法學起吧。

WaitGroup 的基本用法

Go 標準庫中的 WaitGroup 提供了三個方法,保持了 Go 簡潔的風格。

func (wg *WaitGroup) Add(delta int)

func (wg *WaitGroup) Done()

func (wg *WaitGroup) Wait()

我們分別看下這三個方法:

- Add,用來設定 WaitGroup 的計數值;

- Done,用來將 WaitGroup 的計數值減 1,其實就是呼叫了 Add(-1);

- Wait,呼叫這個方法的 goroutine 會一直阻塞,直到 WaitGroup 的計數值變為 0。

接下來,我們透過一個使用 WaitGroup 的例子,來看下 Add、Done、Wait 方法的基本用法。

在這個例子中,我們使用了以前實作的計數器 struct。我們啟動了 10 個 worker,分別對計數值加一,10 個 worker 都完成後,我們期望輸出計數器的值。

// 執行緒安全的計數器

type Counter struct {

mu sync.Mutex

count uint64

}

// 對計數值加一

func (c *Counter) Incr() {

c.mu.Lock()

c.count++

c.mu.Unlock()

}

// 獲取當前的計數值

func (c *Counter) Count() uint64 {

c.mu.Lock()

defer c.mu.Unlock()

return c.count

}

// sleep 1秒,然後計數值加1

func worker(c *Counter, wg *sync.WaitGroup) {

defer wg.Done()

time.Sleep(time.Second)

c.Incr()

}

func main() {

var counter Counter

var wg sync.WaitGroup

wg.Add(10) // WaitGroup的值設定為10

for i := 0; i < 10; i++ { // 啟動10個goroutine執行加1任務

go worker(&counter, &wg)

}

// 檢查點,等待goroutine都完成任務

wg.Wait()

// 輸出當前計數器的值

fmt.Println(counter.Count())

}

我們一起來分析下這段程式碼。

- 第 28 行,宣告瞭一個 WaitGroup 變數,初始值為零。

- 第 29 行,把 WaitGroup 變數的計數值設定為 10。因為我們需要編排 10 個 goroutine(worker) 去執行任務,並且等待 goroutine 完成。

- 第 35 行,呼叫 Wait 方法阻塞等待。

- 第 32 行,啟動了 goroutine,並把我們定義的 WaitGroup 指標當作引數傳遞進去。goroutine 完成後,需要呼叫 Done 方法,把 WaitGroup 的計數值減 1。等 10 個 goroutine 都呼叫了 Done 方法後,WaitGroup 的計數值降為 0,這時,第 35 行的主 goroutine 就不再阻塞,會繼續執行,在第 37 行輸出計數值。

這就是我們使用 WaitGroup 編排這類任務的常用方式。而“這類任務”指的就是,需要啟動多個 goroutine 執行任務,主 goroutine 需要等待子 goroutine 都完成後才繼續執行。

熟悉了 WaitGroup 的基本用法後,我們再看看它具體是如何實作的吧。

WaitGroup 的實作

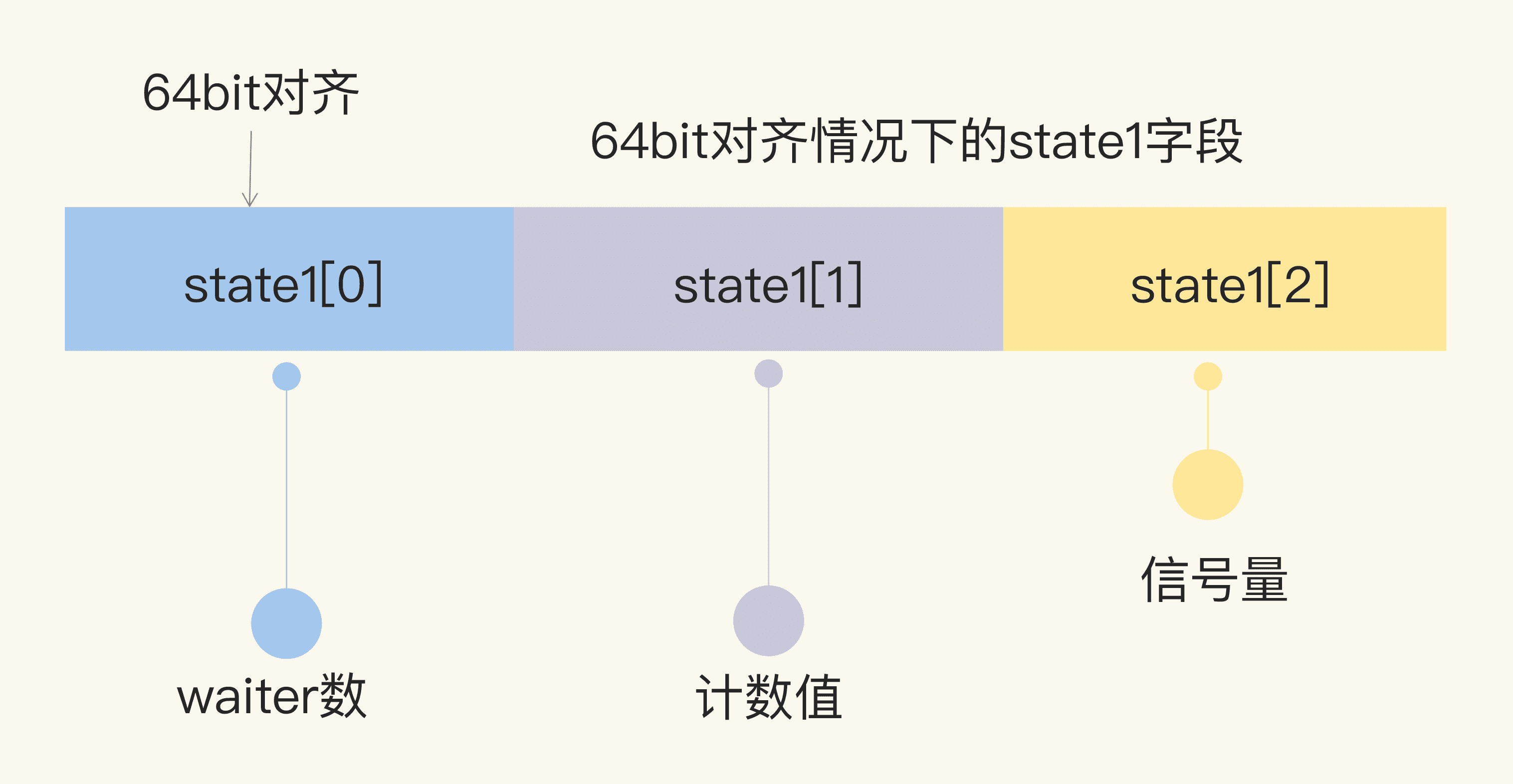

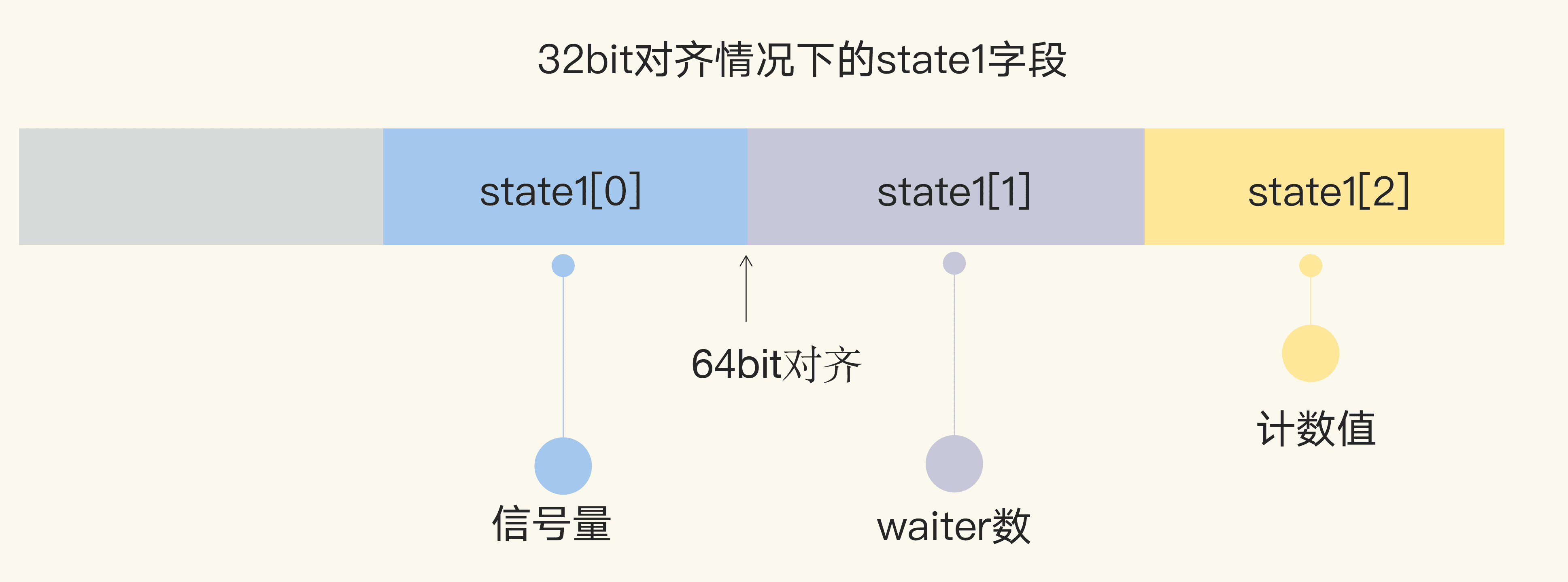

首先,我們看看 WaitGroup 的資料結構。它包括了一個 noCopy 的輔助欄位,一個 state1 記錄 WaitGroup 狀態的陣列。

- noCopy 的輔助欄位,主要就是輔助 vet 工具檢查是否透過 copy 賦值這個 WaitGroup 例項。我會在後面和你詳細分析這個欄位;

- state1,一個具有複合意義的欄位,包含 WaitGroup 的計數、阻塞在檢查點的 waiter 數和訊號量。

WaitGroup 的資料結構定義以及 state 資訊的獲取方法如下:

type WaitGroup struct {

// 避免複製使用的一個技巧,可以告訴vet工具違反了複製使用的規則

noCopy noCopy

// 64bit(8bytes)的值分成兩段,高32bit是計數值,低32bit是waiter的計數

// 另外32bit是用作訊號量的

// 因為64bit值的原子操作需要64bit對齊,但是32bit編譯器不支援,所以陣列中的元素在不同的架構中不一樣,具體處理看下面的方法

// 總之,會找到對齊的那64bit作為state,其餘的32bit做訊號量

state1 [3]uint32

}

// 得到state的地址和訊號量的地址

func (wg *WaitGroup) state() (statep *uint64, semap *uint32) {

if uintptr(unsafe.Pointer(&wg.state1))%8 == 0 {

// 如果地址是64bit對齊的,陣列前兩個元素做state,後一個元素做訊號量

return (*uint64)(unsafe.Pointer(&wg.state1)), &wg.state1[2]

} else {

// 如果地址是32bit對齊的,陣列後兩個元素用來做state,它可以用來做64bit的原子操作,第一個元素32bit用來做訊號量

return (*uint64)(unsafe.Pointer(&wg.state1[1])), &wg.state1[0]

}

}

因為對 64 位整數的原子操作要求整數的地址是 64 位對齊的,所以針對 64 位和 32 位環境的 state 欄位的組成是不一樣的。

在 64 位環境下,state1 的第一個元素是 waiter 數,第二個元素是 WaitGroup 的計數值,第三個元素是訊號量。

在 32 位環境下,如果 state1 不是 64 位對齊的地址,那麼 state1 的第一個元素是訊號量,後兩個元素分別是 waiter 數和計數值。

然後,我們繼續深入原始碼,看一下 Add、Done 和 Wait 這三個方法的實作。

在檢視這部分原始碼實作時,我們會發現,除了這些方法本身的實作外,還會有一些額外的程式碼,主要是 race 檢查和異常檢查的程式碼。其中,有幾個檢查非常關鍵,如果檢查不透過,會出現 panic,這部分內容我會在下一小節分析 WaitGroup 的錯誤使用場景時介紹。現在,我們先專注在 Add、Wait 和 Done 本身的實作程式碼上。

我先為你梳理下 Add 方法的邏輯。Add 方法主要操作的是 state 的計數部分。你可以為計數值增加一個 delta 值,內部透過原子操作把這個值加到計數值上。需要注意的是,這個 delta 也可以是個負數,相當於為計數值減去一個值,Done 方法內部其實就是透過 Add(-1) 實作的。

它的實作程式碼如下:

func (wg *WaitGroup) Add(delta int) {

statep, semap := wg.state()

// 高32bit是計數值v,所以把delta左移32,增加到計數上

state := atomic.AddUint64(statep, uint64(delta)<<32)

v := int32(state >> 32) // 當前計數值

w := uint32(state) // waiter count

if v > 0 || w == 0 {

return

}

// 如果計數值v為0並且waiter的數量w不為0,那麼state的值就是waiter的數量

// 將waiter的數量設定為0,因為計數值v也是0,所以它們倆的組合*statep直接設定為0即可。此時需要並喚醒所有的waiter

*statep = 0

for ; w != 0; w-- {

runtime_Semrelease(semap, false, 0)

}

}

// Done方法實際就是計數器減1

func (wg *WaitGroup) Done() {

wg.Add(-1)

}

Wait 方法的實作邏輯是:不斷檢查 state 的值。如果其中的計數值變為了 0,那麼說明所有的任務已完成,呼叫者不必再等待,直接返回。如果計數值大於 0,說明此時還有任務沒完成,那麼呼叫者就變成了等待者,需要加入 waiter 佇列,並且阻塞住自己。

其主幹實作程式碼如下:

func (wg *WaitGroup) Wait() {

statep, semap := wg.state()

for {

state := atomic.LoadUint64(statep)

v := int32(state >> 32) // 當前計數值

w := uint32(state) // waiter的數量

if v == 0 {

// 如果計數值為0, 呼叫這個方法的goroutine不必再等待,繼續執行它後面的邏輯即可

return

}

// 否則把waiter數量加1。期間可能有併發呼叫Wait的情況,所以最外層使用了一個for迴圈

if atomic.CompareAndSwapUint64(statep, state, state+1) {

// 阻塞休眠等待

runtime_Semacquire(semap)

// 被喚醒,不再阻塞,返回

return

}

}

}使用 WaitGroup 時的常見錯誤在分析 WaitGroup 的 Add、Done 和 Wait 方法的實作的時候,為避免幹擾,我刪除了異常檢查的程式碼。但是,這些異常檢查非常有用。

我們在開發的時候,經常會遇見或看到誤用 WaitGroup 的場景,究其原因就是沒有弄明白這些檢查的邏輯。所以接下來,我們就透過幾個小例子,一起學習下在開發時絕對要避免的 3 個問題。

常見問題一:計數器設定為負值

WaitGroup 的計數器的值必須大於等於 0。我們在更改這個計數值的時候,WaitGroup 會先做檢查,如果計數值被設定為負數,就會導致 panic。

一般情況下,有兩種方法會導致計數器設定為負數。

第一種方法是:呼叫 Add 的時候傳遞一個負數。如果你能保證當前的計數器加上這個負數後還是大於等於 0 的話,也沒有問題,否則就會導致 panic。

比如下面這段程式碼,計數器的初始值為 10,當第一次傳入 -10 的時候,計數值被設定為 0,不會有啥問題。但是,再緊接著傳入 -1 以後,計數值就被設定為負數了,程式就會出現 panic。

func main() {

var wg sync.WaitGroup

wg.Add(10)

wg.Add(-10)//將-10作為引數呼叫Add,計數值被設定為0

wg.Add(-1)//將-1作為引數呼叫Add,如果加上-1計數值就會變為負數。這是不對的,所以會觸發panic

}

第二個方法是:呼叫 Done 方法的次數過多,超過了 WaitGroup 的計數值。

使用 WaitGroup 的正確姿勢是,預先確定好 WaitGroup 的計數值,然後呼叫相同次數的 Done 完成相應的任務。比如,在 WaitGroup 變數宣告之後,就立即設定它的計數值,或者在 goroutine 啟動之前增加 1,然後在 goroutine 中呼叫 Done。

如果你沒有遵循這些規則,就很可能會導致 Done 方法呼叫的次數和計數值不一致,進而造成死鎖(Done 呼叫次數比計數值少)或者 panic(Done 呼叫次數比計數值多)。

比如下面這個例子中,多呼叫了一次 Done 方法後,會導致計數值為負,所以程式執行到這一行會出現 panic。

func main() {

var wg sync.WaitGroup

wg.Add(1)

wg.Done()

wg.Done()

}常見問題二:不期望的 Add 時機在使用 WaitGroup 的時候,你一定要遵循的原則就是,等所有的 Add 方法呼叫之後再呼叫 Wait,否則就可能導致 panic 或者不期望的結果。

我們構造這樣一個場景:只有部分的 Add/Done 執行完後,Wait 就返回。我們看一個例子:啟動四個 goroutine,每個 goroutine 內部呼叫 Add(1) 然後呼叫 Done(),主 goroutine 呼叫 Wait 等待任務完成。

func main() {

var wg sync.WaitGroup

go dosomething(100, &wg) // 啟動第一個goroutine

go dosomething(110, &wg) // 啟動第二個goroutine

go dosomething(120, &wg) // 啟動第三個goroutine

go dosomething(130, &wg) // 啟動第四個goroutine

wg.Wait() // 主goroutine等待完成

fmt.Println("Done")

}

func dosomething(millisecs time.Duration, wg *sync.WaitGroup) {

duration := millisecs * time.Millisecond

time.Sleep(duration) // 故意sleep一段時間

wg.Add(1)

fmt.Println("後臺執行, duration:", duration)

wg.Done()

}

在這個例子中,我們原本設想的是,等四個 goroutine 都執行完畢後輸出 Done 的資訊,但是它的錯誤之處在於,將 WaitGroup.Add 方法的呼叫放在了子 gorotuine 中。等主 goorutine 呼叫 Wait 的時候,因為四個任務 goroutine 一開始都休眠,所以可能 WaitGroup 的 Add 方法還沒有被呼叫,WaitGroup 的計數還是 0,所以它並沒有等待四個子 goroutine 執行完畢才繼續執行,而是立刻執行了下一步。

導致這個錯誤的原因是,沒有遵循先完成所有的 Add 之後才 Wait。要解決這個問題,一個方法是,預先設定計數值:

func main() {

var wg sync.WaitGroup

wg.Add(4) // 預先設定WaitGroup的計數值

go dosomething(100, &wg) // 啟動第一個goroutine

go dosomething(110, &wg) // 啟動第二個goroutine

go dosomething(120, &wg) // 啟動第三個goroutine

go dosomething(130, &wg) // 啟動第四個goroutine

wg.Wait() // 主goroutine等待

fmt.Println("Done")

}

func dosomething(millisecs time.Duration, wg *sync.WaitGroup) {

duration := millisecs * time.Millisecond

time.Sleep(duration)

fmt.Println("後臺執行, duration:", duration)

wg.Done()

}

另一種方法是在啟動子 goroutine 之前才呼叫 Add:

func main() {

var wg sync.WaitGroup

dosomething(100, &wg) // 呼叫方法,把計數值加1,並啟動任務goroutine

dosomething(110, &wg) // 呼叫方法,把計數值加1,並啟動任務goroutine

dosomething(120, &wg) // 呼叫方法,把計數值加1,並啟動任務goroutine

dosomething(130, &wg) // 呼叫方法,把計數值加1,並啟動任務goroutine

wg.Wait() // 主goroutine等待,程式碼邏輯保證了四次Add(1)都已經執行完了

fmt.Println("Done")

}

func dosomething(millisecs time.Duration, wg *sync.WaitGroup) {

wg.Add(1) // 計數值加1,再啟動goroutine

go func() {

duration := millisecs * time.Millisecond

time.Sleep(duration)

fmt.Println("後臺執行, duration:", duration)

wg.Done()

}()

}

可見,無論是怎麼修復,都要保證所有的 Add 方法是在 Wait 方法之前被呼叫的。

常見問題三:前一個 Wait 還沒結束就重用 WaitGroup

“前一個 Wait 還沒結束就重用 WaitGroup”這一點似乎不太好理解,我借用田徑比賽的例子和你解釋下吧。在田徑比賽的百米小組賽中,需要把選手分成幾組,一組選手比賽完之後,就可以進行下一組了。為了確保兩組比賽時間上沒有衝突,我們在模型化這個場景的時候,可以使用 WaitGroup。

WaitGroup 等一組比賽的所有選手都跑完後 5 分鐘,才開始下一組比賽。下一組比賽還可以使用這個 WaitGroup 來控制,因為 WaitGroup 是可以重用的。只要 WaitGroup 的計數值恢復到零值的狀態,那麼它就可以被看作是新建立的 WaitGroup,被重複使用。

但是,如果我們在 WaitGroup 的計數值還沒有恢復到零值的時候就重用,就會導致程式 panic。我們看一個例子,初始設定 WaitGroup 的計數值為 1,啟動一個 goroutine 先呼叫 Done 方法,接著就呼叫 Add 方法,Add 方法有可能和主 goroutine 併發執行。

func main() {

var wg sync.WaitGroup

wg.Add(1)

go func() {

time.Sleep(time.Millisecond)

wg.Done() // 計數器減1

wg.Add(1) // 計數值加1

}()

wg.Wait() // 主goroutine等待,有可能和第7行併發執行

}

在這個例子中,第 6 行雖然讓 WaitGroup 的計數恢復到 0,但是因為第 9 行有個 waiter 在等待,如果等待 Wait 的 goroutine,剛被喚醒就和 Add 呼叫(第 7 行)有併發執行的衝突,所以就會出現 panic。

總結一下:WaitGroup 雖然可以重用,但是是有一個前提的,那就是必須等到上一輪的 Wait 完成之後,才能重用 WaitGroup 執行下一輪的 Add/Wait,如果你在 Wait 還沒執行完的時候就呼叫下一輪 Add 方法,就有可能出現 panic。

noCopy:輔助 vet 檢查

我們剛剛在學習 WaitGroup 的資料結構時,提到了裡面有一個 noCopy 欄位。你還記得它的作用嗎?其實,它就是指示 vet 工具在做檢查的時候,這個資料結構不能做值複製使用。更嚴謹地說,是不能在第一次使用之後複製使用 ( must not be copied after first use)。

你可能會說了,為什麼要把 noCopy 欄位單獨拿出來講呢?一方面,把 noCopy 欄位穿插到 waitgroup 程式碼中講解,容易幹擾我們對 WaitGroup 整體的理解。另一方面,也是非常重要的原因,noCopy 是一個通用的計數技術,其他併發原語中也會用到,所以單獨介紹有助於你以後在實踐中使用這個技術。

我們在第 3 講學習 Mutex 的時候用到了 vet 工具。vet 會對實作 Locker 介面的資料型別做靜態檢查,一旦程式碼中有複製使用這種資料型別的情況,就會發出警告。但是,WaitGroup 同步原語不就是 Add、Done 和 Wait 方法嗎?vet 能檢查出來嗎?

其實是可以的。透過給 WaitGroup 新增一個 noCopy 欄位,我們就可以為 WaitGroup 實作 Locker 介面,這樣 vet 工具就可以做複製檢查了。而且因為 noCopy 欄位是未輸出型別,所以 WaitGroup 不會暴露 Lock/Unlock 方法。

noCopy 欄位的型別是 noCopy,它只是一個輔助的、用來幫助 vet 檢查用的型別:

type noCopy struct{}

// Lock is a no-op used by -copylocks checker from `go vet`.

func (*noCopy) Lock() {}

func (*noCopy) Unlock() {}

如果你想要自己定義的資料結構不被複制使用,或者說,不能透過 vet 工具檢查出複製使用的報警,就可以透過嵌入 noCopy 這個資料型別來實作。

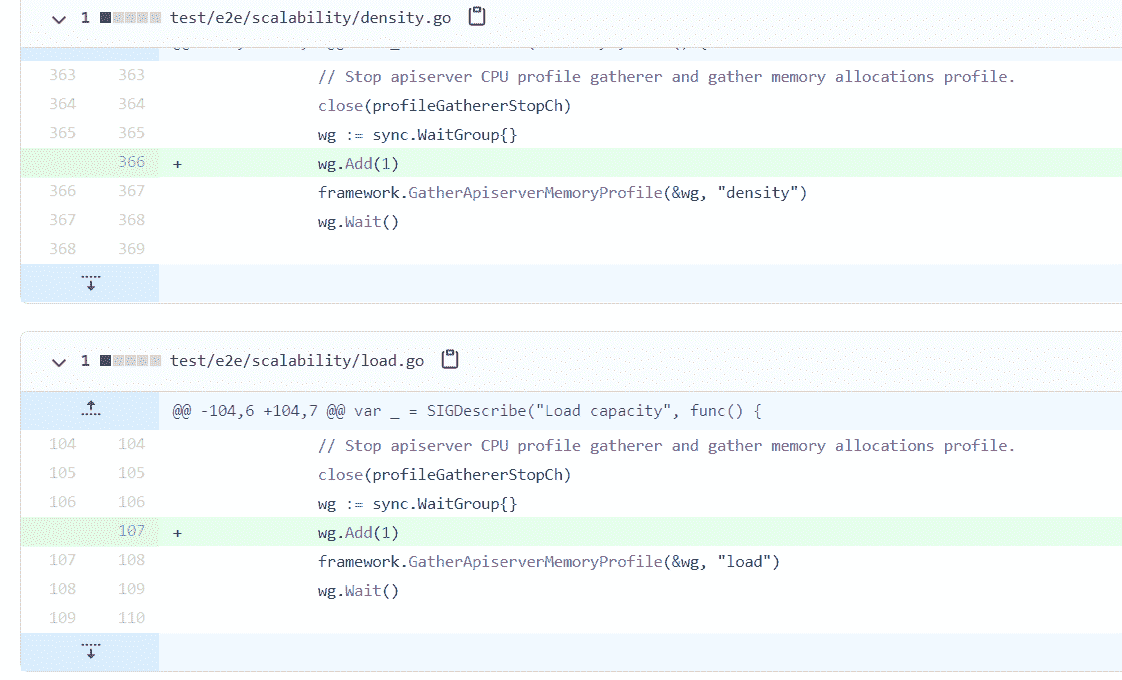

流行的 Go 開發專案中的坑

接下來又到了喝枸杞紅棗茶的時間了。你可以稍微休息一下,心態放輕鬆地跟我一起圍觀下知名專案犯過的錯,比如 copy Waitgroup、Add/Wait 併發執行問題、遺漏 Add 等 Bug。

有網友在 Go 的issue 28123中提了以下的例子,你能發現這段程式碼有什麼問題嗎?

type TestStruct struct {

Wait sync.WaitGroup

}

func main() {

w := sync.WaitGroup{}

w.Add(1)

t := &TestStruct{

Wait: w,

}

t.Wait.Done()

fmt.Println("Finished")

}

這段程式碼最大的一個問題,就是第 9 行 copy 了 WaitGroup 的例項 w。雖然這段程式碼能執行成功,但確實是違反了 WaitGroup 使用之後不要複製的規則。在專案中,我們可以透過 vet 工具檢查出這樣的錯誤。

Docker issue 28161 和 issue 27011 ,都是因為在重用 WaitGroup 的時候,沒等前一次的 Wait 結束就 Add 導致的錯誤。Etcd issue 6534 也是重用 WaitGroup 的 Bug,沒有等前一個 Wait 結束就 Add。

Kubernetes issue 59574 的 Bug 是忘記 Wait 之前增加計數了,這就屬於我們通常認為幾乎不可能出現的 Bug。

即使是開發 Go 語言的開發者自己,在使用 WaitGroup 的時候,也可能會犯錯。比如 issue 12813,因為 defer 的使用,Add 方法可能在 Done 之後才執行,導致計數負值的 panic。

總結

學完這一講,我們知道了使用 WaitGroup 容易犯的錯,是不是有些手腳被束縛的感覺呢?其實大可不必,只要我們不是特別複雜地使用 WaitGroup,就不用有啥心理負擔。

而關於如何避免錯誤使用 WaitGroup 的情況,我們只需要儘量保證下面 5 點就可以了:

- 不重用 WaitGroup。新建一個 WaitGroup 不會帶來多大的資源開銷,重用反而更容易出錯。

- 保證所有的 Add 方法呼叫都在 Wait 之前。

- 不傳遞負數給 Add 方法,只通過 Done 來給計數值減 1。

- 不做多餘的 Done 方法呼叫,保證 Add 的計數值和 Done 方法呼叫的數量是一樣的。

- 不遺漏 Done 方法的呼叫,否則會導致 Wait hang 住無法返回。

這一講我們詳細學習了 WaitGroup 的相關知識,這裡我整理了一份關於 WaitGroup 的知識地圖,方便你複習。

思考題

通常我們可以把 WaitGroup 的計數值,理解為等待要完成的 waiter 的數量。你可以試著擴充套件下 WaitGroup,來查詢 WaitGroup 的當前的計數值嗎?

歡迎在留言區寫下你的思考和答案,我們一起交流討論。如果你覺得有所收穫,也歡迎你把今天的內容分享給你的朋友或同事。

07|Cond:條件變數的實作機制及避坑指南

你好,我是鳥窩。

本章導讀

Cond 條件等待/通知圖

┌──────────────┐ 檢查條件(false) ┌──────────────┐

│ 等待 goroutine │ ────────────────> │ cond.Wait() │

└──────┬───────┘ └──────┬───────┘

│ (Wait 內部會先解鎖、睡眠) │

│ │ 被 Signal/Broadcast 喚醒

│ ▼

┌──────▼───────┐ 更新狀態 + 發通知 ┌──────────────┐

│ 生產/修改端 │ ──────────────────> │ Signal / │

│ (持有同一把鎖) │ │ Broadcast │

└──────────────┘ └──────────────┘

重點:醒來後要重新檢查條件(通常用 for)

在寫 Go 程式之前,我曾經寫了 10 多年的 Java 程式,也面試過不少 Java 程式設計師。在 Java 面試中,經常被問到的一個知識點就是等待 / 通知(wait/notify)機制。面試官經常會這樣考察候選人:請實作一個限定容量的佇列(queue),當佇列滿或者空的時候,利用等待 / 通知機制實作阻塞或者喚醒。

在 Go 中,也可以實作一個類似的限定容量的佇列,而且實作起來也比較簡單,只要用條件變數(Cond)併發原語就可以。Cond 併發原語相對來說不是那麼常用,但是在特定的場景使用會事半功倍,比如你需要在喚醒一個或者所有的等待者做一些檢查操作的時候。

那麼今天這一講,我們就學習下 Cond 這個併發原語。

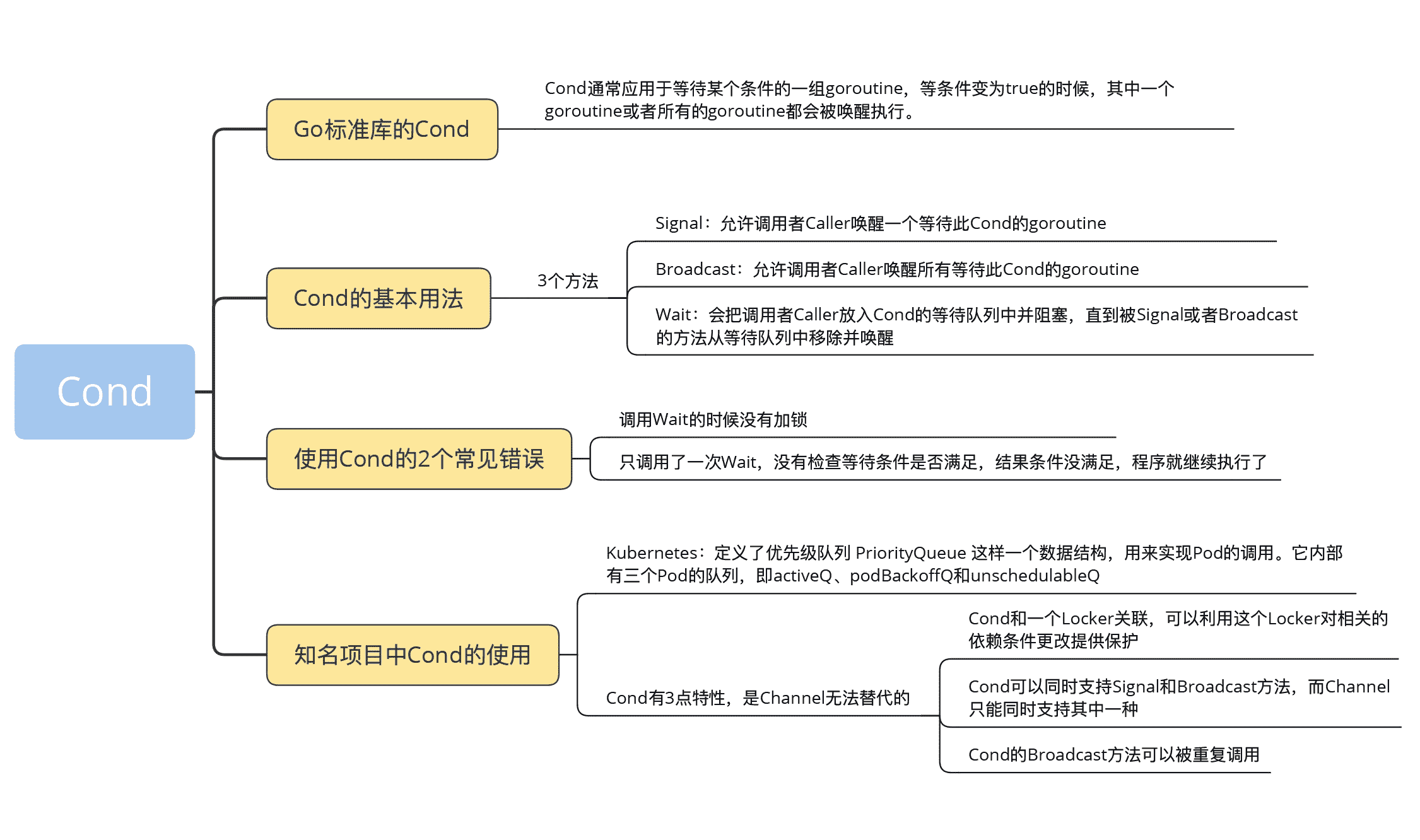

Go 標準庫的 Cond

Go 標準庫提供 Cond 原語的目的是,為等待 / 通知場景下的併發問題提供支援。Cond 通常應用於等待某個條件的一組 goroutine,等條件變為 true 的時候,其中一個 goroutine 或者所有的 goroutine 都會被喚醒執行。

顧名思義,Cond 是和某個條件相關,這個條件需要一組 goroutine 協作共同完成,在條件還沒有滿足的時候,所有等待這個條件的 goroutine 都會被阻塞住,只有這一組 goroutine 透過協作達到了這個條件,等待的 goroutine 才可能繼續進行下去。

那這裡等待的條件是什麼呢?等待的條件,可以是某個變數達到了某個閾值或者某個時間點,也可以是一組變數分別都達到了某個閾值,還可以是某個物件的狀態滿足了特定的條件。總結來講,等待的條件是一種可以用來計算結果是 true 還是 false 的條件。

從開發實踐上,我們真正使用 Cond 的場景比較少,因為一旦遇到需要使用 Cond 的場景,我們更多地會使用 Channel 的方式(我會在第 12 和第 13 講展開 Channel 的用法)去實作,因為那才是更地道的 Go 語言的寫法,甚至 Go 的開發者有個“把 Cond 從標準庫移除”的提議(issue 21165)。而有的開發者認為,Cond 是唯一難以掌握的 Go 併發原語。至於其中原因,我先賣個關子,到這一講的後半部分我再和你解釋。

今天,這一講我們就帶你仔細地學一學 Cond 這個併發原語吧。

Cond 的基本用法

標準庫中的 Cond 併發原語初始化的時候,需要關聯一個 Locker 介面的例項,一般我們使用 Mutex 或者 RWMutex。

我們看一下 Cond 的實作:

type Cond

func NeWCond(l Locker) *Cond

func (c *Cond) Broadcast()

func (c *Cond) Signal()

func (c *Cond) Wait()

首先,Cond 關聯的 Locker 例項可以透過 c.L 訪問,它內部維護著一個先入先出的等待佇列。

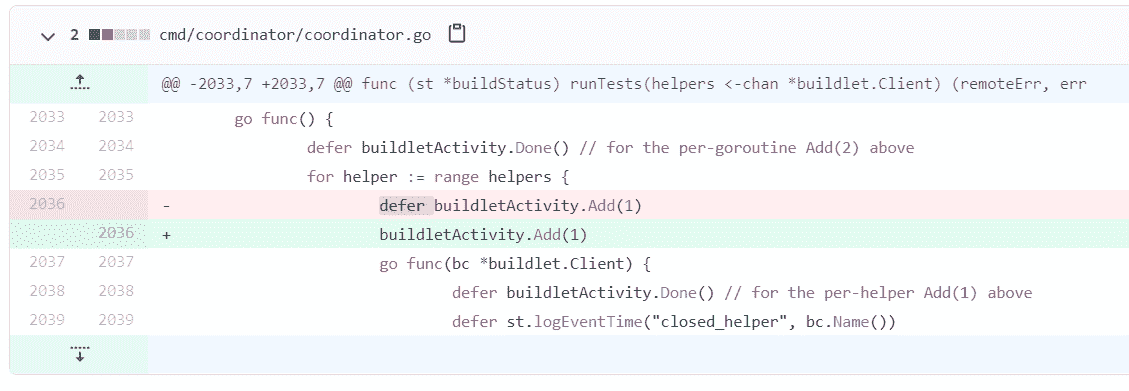

然後,我們分別看下它的三個方法 Broadcast、Signal 和 Wait 方法。